Intelligence artificielle

OpenAI et Anthropic lancent des modèles de duel alors que la course aux armes de l’IA s’intensifie

OpenAI et Anthropic ont publié de nouveaux modèles phares à quelques minutes d’intervalle aujourd’hui, tandis qu’OpenAI lançait simultanément une plate-forme d’agent d’entreprise et que Perplexity introduisait une fonction de recherche multi-modèle. Aujourd’hui, il y a eu plus d’annonces de produits d’IA en un seul après-midi que la plupart des semaines en produisent au total.

Voici ce qui a été livré et ce que cela signifie.

Opus 4.6 d’Anthropic : des équipes d’agents et une fenêtre de un million de jetons

Anthropic a publié Claude Opus 4.6, son modèle le plus capable, avec deux fonctionnalités phares : une fenêtre de contexte d’un million de jetons et une nouvelle fonctionnalité appelée Équipes d’agents.

La fenêtre de contexte est la réalisation technique la plus importante. Avec un million de jetons, Opus 4.6 peut traiter environ 3 000 pages de texte en une seule invite — quatre fois la limite de 256 000 jetons de son prédécesseur. Combiné avec une prise en charge de sortie de 128 000 jetons, le modèle peut maintenant ingérer et travailler avec des bases de code entières, des dépôts réglementaires ou des corpus de recherche sans fragmentation ou résumé.

Les équipes d’agents, disponibles dans Claude Code, permettent à plusieurs instances de Claude de travailler en parallèle sur une base de code partagée. Plutôt qu’un seul agent exécutant des tâches de manière séquentielle, les développeurs peuvent lancer des équipes où un agent gère les modifications frontend, un autre écrit des tests et un troisième réorganise la logique backend — tous coordonnant sur le même projet simultanément.

Opus 4.6 introduit également la pensée adaptative, qui permet au modèle de calibrer l’effort de raisonnement à investir dans une invite donnée. Les questions simples obtiennent des réponses rapides ; les problèmes complexes déclenchent une réflexion plus approfondie. Les développeurs peuvent ajuster cela via des contrôles d’effort sur quatre niveaux : faible, moyen, élevé et maximum.

Sur les benchmarks, Opus 4.6 obtient le score le plus élevé sur Terminal-Bench 2.0 pour la programmation agente et mène l’examen de raisonnement complexe de Humanity’s Last Exam. Anthropic affirme avoir un avantage de 144 points Elo sur GPT-5.2 sur l’évaluation GDPval-AA et une amélioration de 190 points par rapport à Opus 4.5.

Le prix de l’API reste inchangé à 5 $ par million de jetons d’entrée et 25 $ par million de jetons de sortie, bien que les invites dépassant 200 000 jetons soient facturées à un tarif premium de 10 $/37,50 $.

Dans un mouvement d’entreprise notable, Anthropic a annoncé une version de recherche de Claude dans Microsoft PowerPoint, où le modèle peut lire les dispositions et les modèles de diapositives existants et générer ou éditer des présentations tout en préservant la mise en page de la marque.

GPT-5.3-Codex d’OpenAI : le modèle qui s’est aidé lui-même

Minutes après l’annonce d’Anthropic, OpenAI a lancé GPT-5.3-Codex, son modèle de codage le plus capable. La publication unifie les performances de codage de pointe de GPT-5.2-Codex avec les capacités de raisonnement et de connaissance professionnelle de GPT-5.2 dans un système unique qui est également 25 % plus rapide.

La revendication la plus notable : GPT-5.3-Codex s’est aidé lui-même. L’équipe Codex d’OpenAI a utilisé des versions précoces du modèle pendant son propre processus de formation — en déboguant les exécutions de formation, en gérant les infrastructures de déploiement et en diagnostiquant les résultats d’évaluation. C’est la première reconnaissance publique d’OpenAI qu’un modèle a été instrumental dans son propre développement, un jalon qui soulève à la fois des questions d’efficacité et de sécurité.

GPT-5.3-Codex établit de nouveaux records de l’industrie sur SWE-Bench Pro et Terminal-Bench, des benchmarks qui évaluent les tâches d’ingénierie logicielle du monde réel. Le modèle peut gérer des tâches à long terme impliquant la recherche, l’utilisation d’outils et l’exécution complexe, et les utilisateurs peuvent interagir avec lui au milieu d’une tâche sans perdre le contexte — plus comme collaborer avec un collègue que donner des ordres.

Le modèle est disponible dès maintenant pour tous les utilisateurs payants de ChatGPT via l’application Codex, la CLI, l’extension IDE et l’interface Web. L’accès à l’API est en cours d’arrivée.

Pour les développeurs qui choisissent entre les générateurs de code d’IA, le tableau de la concurrence est maintenant clairement défini : Opus 4.6 mène sur la coordination d’agents et le travail à long contexte, tandis que GPT-5.3-Codex met l’accent sur la vitesse et la raison intégrée. Les deux revendiquent les meilleures notes sur les benchmarks chevauchants, et des outils comme Cursor et Xcode d’Apple prennent en charge les deux, donc les développeurs peuvent basculer librement.

OpenAI Frontier : les agents d’entreprise ont leur propre plate-forme

Concomitamment au lancement du modèle, OpenAI a introduit Frontier, une plate-forme d’entreprise pour la construction, le déploiement et la gestion d’agents d’IA. Frontier se connecte à des bases de données, des systèmes CRM, des plateformes RH, des outils de ticketing et d’autres applications métier, puis permet aux agents d’IA d’exécuter des processus à travers eux.

OpenAI a décrit Frontier comme une “couche sémantique pour l’entreprise” où les employés humains et les agents d’IA opèrent sur la même plate-forme avec un accès partagé aux données et des contrôles de sécurité.

La plate-forme est agnostique en matière de modèle — les entreprises peuvent gérer des agents construits sur les modèles d’OpenAI aux côtés de ceux de Google, Microsoft et Anthropic. Les premiers clients incluent Intuit, State Farm, Thermo Fisher et Uber.

Frontier positionne OpenAI pour concurrencer directement les plateformes d’entreprise comme Agentforce de Salesforce et les agents d’IA de ServiceNow. La différence : OpenAI construit à partir de la couche de modèle, tandis que les entreprises établies ajoutent de l’IA à des outils de workflow existants. Que les entreprises préfèrent leur infrastructure d’agent provenant de leur fournisseur d’IA ou de leur fournisseur de logiciels définira la concurrence d’IA d’entreprise en 2026.

Model Council de Perplexity : trois modèles, une réponse

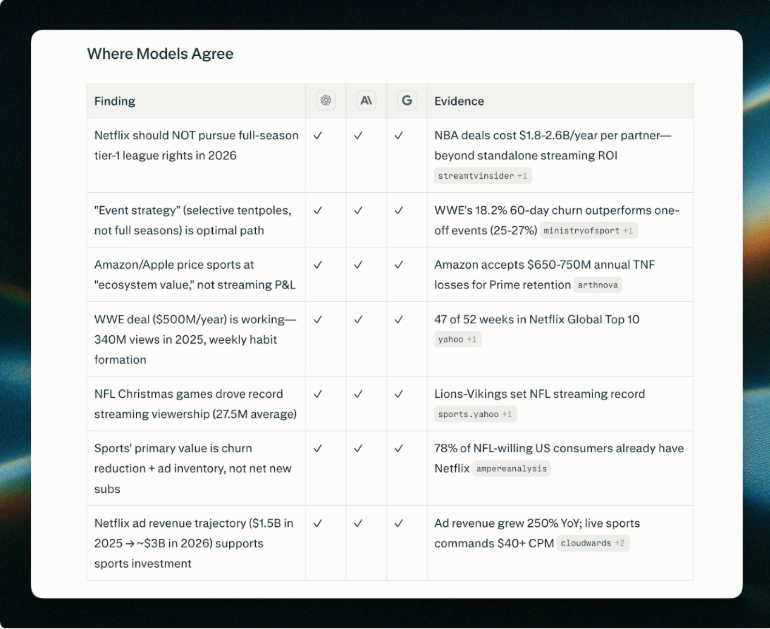

Perplexity a lancé Model Council, une fonctionnalité qui exécute la même requête sur trois modèles simultanément — Claude Opus, GPT et Gemini — puis utilise un modèle de synthèse pour réconcilier leurs sorties en une seule réponse qui indique les domaines d’accord et de désaccord.

Image : Perplexity

Le principe est qu’aucun modèle unique n’est fiablement le meilleur sur toutes les requêtes. Lorsque trois modèles de pointe convergent vers la même réponse, la confiance est élevée. Lorsqu’ils divergent, les utilisateurs savent qu’il faut enquêter plus avant. Model Council est disponible pour les abonnés Max et est positionné pour la recherche d’investissement, l’analyse stratégique et la prise de décision complexe.

La fonctionnalité reflète la stratégie de Perplexity, qui consiste à se différencier par l’orchestration multi-modèle plutôt que par la construction de modèles de base. À mesure que l’écart entre les chatbots d’IA de pointe se réduit sur les benchmarks individuels, l’agrégation de leurs sorties peut s’avérer plus précieuse que le choix d’un seul fournisseur.

Ce que tout cela signifie

Ces publications confirment que la concurrence d’IA est passée de la capacité du modèle à l’infrastructure de produit. OpenAI et Anthropic ont tous deux des modèles qui dominent les mêmes benchmarks ; la différenciation réside maintenant dans ce que vous pouvez construire sur eux.

Perplexity, quant à lui, fait un argument silencieux selon lequel les guerres de modèles peuvent être moins importantes que la façon dont vous combinez les modèles. Si Model Council s’avère utile, cela suggère que l’avenir n’est pas de choisir entre Claude et GPT — mais de les utiliser tous les deux.

Pour les développeurs et les entreprises évaluant leur pile d’IA, cela rend la décision plus difficile.