Intelligence Artificielle

Les détecteurs Deepfake explorent un nouveau terrain : les modèles de diffusion latente et les GAN

Opinion

Dernièrement, la communauté de recherche sur la détection de deepfake, qui depuis fin 2017 s'occupe presque exclusivement de la encodeur automatique-framework qui a été créé à l'époque avec une telle admiration publique (et consternation), a commencé à s'intéresser à des architectures moins stagnantes, notamment diffusion latente des modèles tels que DALL-E2 et Diffusion stable, ainsi que la sortie des réseaux antagonistes génératifs (GAN). Par exemple, en juin, UC Berkeley publié les résultats de ses recherches sur le développement d'un détecteur pour la sortie du DALL-E 2 alors dominant.

Ce qui semble motiver cet intérêt croissant est le saut évolutif soudain de la capacité et de la disponibilité des modèles de diffusion latente en 2022, avec la source fermée et l'accès limité libérer de DALL-E 2 au printemps, suivi à la fin de l'été par le sensationnel approvisionnement ouvert de Stable Diffusion par Stability.ai.

Les GAN ont également été longuement étudié dans ce contexte, quoique moins intensivement, puisqu'il est très difficile les utiliser pour des recréations vidéo convaincantes et élaborées de personnes ; au moins, par rapport aux packages d'encodeurs automatiques désormais vénérables tels que Échange de visage et Laboratoire DeepFace – et le cousin du streaming en direct de ce dernier, DeepFaceLive.

Images animées

Dans les deux cas, le facteur galvanisant semble être la perspective d'un sprint de développement ultérieur pour face synthèse. Le début du mois d'octobre – et de la saison des grandes conférences de 2022 – a été marqué par une avalanche de solutions soudaines et inattendues à divers problèmes de longue date liés à la synthèse vidéo : à peine Facebook avait-il échantillons publiés de sa propre plate-forme texte-vidéo, que Google Research a rapidement noyé cet éloge initial en annonçant sa nouvelle architecture Imagen-to-Video T2V, capable de produire images haute résolution (mais uniquement via un réseau à 7 couches d'upscalers).

Si vous pensez que ce genre de chose arrive par trois, considérez également la promesse énigmatique de stability.ai selon laquelle « la vidéo arrive » sur Stable Diffusion, apparemment plus tard cette année, tandis que le co-développeur de Stable Diffusion, Runway, a fait une promesse similaire, bien qu'il ne soit pas clair s'ils font référence au même système. Le Message de discorde Emad Mostaque, PDG de Stability, a également promis « audio, vidéo [et] 3D ».

Avec une offre inédite de plusieurs nouveautés cadres de génération audio (certains basés sur la diffusion latente), et un nouveau modèle de diffusion qui peut générer mouvement de personnage authentique, l'idée que les frameworks « statiques » tels que les GAN et les diffuseurs prendront enfin leur place en tant que support adjoints aux cadres d'animation externes commence à gagner du terrain.

En bref, il semble probable que le monde paralysé des deepfakes vidéo basés sur un encodeur automatique, qui ne peuvent que remplacer efficacement le partie centrale d'un visage, pourraient à cette époque l'année prochaine être éclipsées par une nouvelle génération de technologies deepfake basées sur la diffusion - des approches open source populaires avec le potentiel de simuler de manière photoréaliste non seulement des corps entiers, mais des scènes entières.

Pour cette raison, peut-être, la communauté de recherche anti-deepfake commence à prendre au sérieux la synthèse d'images et à se rendre compte qu'elle pourrait servir à plus de fins que simplement générer fausses photos de profil LinkedIn; et que si tous leurs espaces latents insolubles peuvent s'accomplir en termes de mouvement temporel, c'est agir comme un très bon rendu de texture, cela pourrait en fait être plus que suffisant.

Blade Runner

Les deux derniers articles traitant respectivement de la diffusion latente et de la détection de deepfake basée sur le GAN sont, respectivement, DE-FAKE : détection et attribution de fausses images générées par des modèles de diffusion texte-image, une collaboration entre le CISPA Helmholtz Center for Information Security et Salesforce ; et BLADERUNNER : Contre-mesure rapide pour les visages StyleGAN synthétiques (générés par l'IA), d'Adam Dorian Wong au Lincoln Laboratory du MIT.

Avant d'expliquer sa nouvelle méthode, ce dernier article prend le temps d'examiner les approches précédentes pour déterminer si une image a été générée ou non par un GAN (l'article traite spécifiquement de la famille StyleGAN de NVIDIA).

La méthode « Brady Bunch » – peut-être une référence dénuée de sens pour tous ceux qui ne regardaient pas la télévision dans les années 1970 ou qui ont raté les adaptations cinématographiques des années 1990 – identifie le contenu falsifié par GAN en fonction des positions fixes que certaines parties d'un visage GAN sont certaines d'occuper, en raison de la nature routinière et modélisée du « processus de production ».

La méthode « Brady Bunch » proposée par un webcast de l'institut SANS en 2022 : un générateur de visage basé sur GAN effectuera un placement improbablement uniforme de certains traits du visage, démentant l'origine de la photo, dans certains cas. Source : https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Une autre indication utile connue est l'incapacité fréquente de StyleGAN à rendre plusieurs visages (première image ci-dessous), si nécessaire, ainsi que son manque de talent dans la coordination des accessoires (image du milieu ci-dessous), et une tendance à utiliser une ligne de cheveux comme début d'un chapeau improvisé (troisième image ci-dessous).

La troisième méthode sur laquelle le chercheur attire l'attention est superposition de photos (dont on peut voir un exemple dans notre article d'août (sur le diagnostic assisté par l'IA des troubles de santé mentale), qui utilise un logiciel de « mélange d'images » compositionnel tel que la série CombineZ pour concaténer plusieurs images en une seule image, révélant souvent des points communs sous-jacents dans la structure - une indication potentielle de synthèse.

L'architecture proposée dans le nouveau document est intitulée (éventuellement contre tous les conseils SEO) Blade Runner, faisant référence à la Test de Voight-Kampff qui détermine si les antagonistes de la franchise de science-fiction sont « faux » ou non.

Le pipeline est composé de deux phases, dont la première est l'analyseur PapersPlease, qui peut évaluer les données extraites de sites Web GAN-face connus tels que thispersondoesnotexist.com, ou generator.photos.

Bien qu'une version réduite du code puisse être inspectée sur GitHub (voir ci-dessous), peu de détails sont fournis sur ce module, sauf qu'OpenCV et DLIB sont utilisés pour délimiter et détecter les visages dans le matériau rassemblé.

Le deuxième module est le Parmi nous Détecteur. Le système est conçu pour rechercher le placement coordonné des yeux sur les photos, une caractéristique constante de la sortie visage de StyleGAN, illustrée par le scénario « Brady Bunch » détaillé ci-dessus. AmongUs est alimenté par un détecteur standard de 68 points de repère.

Annotations des points faciaux via l'Intelligent Behavior Understanding Group (IBUG), dont le code de traçage des repères faciaux est utilisé dans le package Blade Runner.

AmongUs s'appuie sur des repères pré-entraînés basés sur les coordonnées connues du « groupe Brady » de PapersPlease, et est destiné à être utilisé sur des échantillons en direct, accessibles sur le Web, d'images de visage basées sur StyleGAN.

Blade Runner, suggère l'auteur, est une solution prête à l'emploi destinée aux entreprises ou aux organisations qui manquent de ressources pour développer des solutions internes pour le type de détection de deepfake traité ici, et une « mesure provisoire pour gagner du temps pour des contre-mesures plus permanentes ».

En fait, dans un secteur de la sécurité aussi volatil et en croissance rapide, il n'y a pas beaucoup de solutions sur mesure. or des solutions de fournisseurs cloud prêtes à l'emploi vers lesquelles une entreprise aux ressources insuffisantes peut actuellement se tourner en toute confiance.

Bien que Blade Runner fonctionne mal contre à lunettes Les personnes truquées par StyleGAN, il s'agit d'un problème relativement courant dans des systèmes similaires, qui s'attendent à pouvoir évaluer les délimitations des yeux comme points de référence essentiels, obscurcis dans de tels cas.

Une version réduite de Blade Runner a été libéré pour ouvrir la source sur GitHub. Une version propriétaire plus riche en fonctionnalités existe, qui peut traiter plusieurs photos, plutôt qu'une seule photo par opération du référentiel open source. L'auteur a l'intention, dit-il, de mettre à niveau la version GitHub vers la même norme à terme, si le temps le permet. Il admet également que StyleGAN est susceptible d'évoluer au-delà de ses faiblesses connues ou actuelles, et que le logiciel devra également se développer en tandem.

DE-FAUX

L'architecture DE-FAKE vise non seulement à réaliser une « détection universelle » pour les images produites par des modèles de diffusion de texte à image, mais également à fournir une méthode permettant de discerner qui modèle de diffusion latente (LD) a produit l'image.

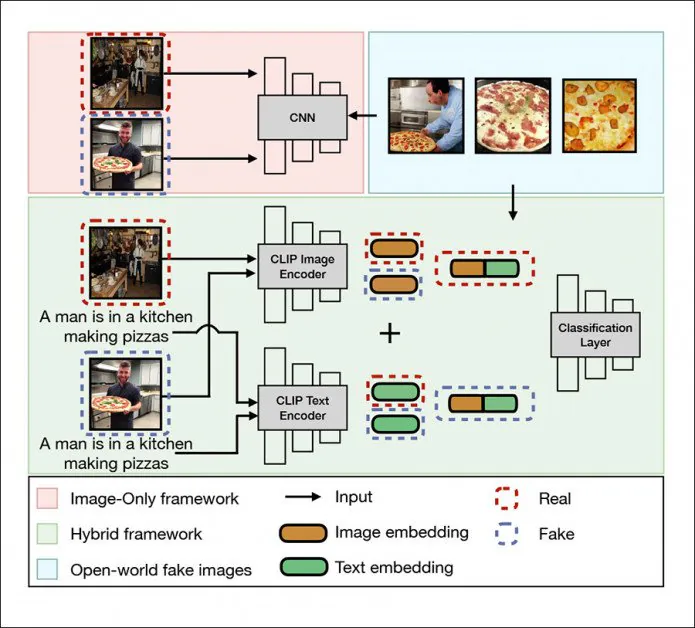

Le cadre de détection universel dans DE-FAKE traite des images locales, un cadre hybride (vert) et des images du monde ouvert (bleu). Source : http://export.arxiv.org/pdf/2210.06998

Pour être honnête, pour le moment, il s'agit d'une tâche assez facile, car tous les modèles LD populaires - fermés ou open source - ont des caractéristiques distinctives notables.

De plus, la plupart partagent certaines faiblesses communes, telles qu'une prédisposition à couper la tête, en raison de la façon arbitraire que des images non carrées récupérées sur le Web sont ingérées dans les énormes ensembles de données qui alimentent des systèmes tels que DALL-E 2, Stable Diffusion et MidJourney :

Les modèles de diffusion latente, comme tous les modèles de vision par ordinateur, nécessitent des données au format carré. Cependant, le web scraping agrégé qui alimente le jeu de données LAION5B n'offre aucun « extra de luxe » tel que la capacité de reconnaître et de se concentrer sur les visages (ou autre), et tronque les images de manière assez brutale au lieu de les remplir (ce qui conserverait l'intégralité de l'image source, mais à une résolution inférieure). Une fois entraînés, ces « recadrages » se normalisent et apparaissent très fréquemment dans les résultats des systèmes de diffusion latente tels que la diffusion stable. Sources : https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac et Stable Diffusion.

DE-FAKE est destiné à être indépendant des algorithmes, un objectif de longue date des chercheurs anti-deepfake de l'encodeur automatique, et, à l'heure actuelle, tout à fait réalisable en ce qui concerne les systèmes LD.

L'architecture utilise le pré-entraînement contrastif langage-image d'OpenAI (CLIP) bibliothèque multimodale – un élément essentiel de la diffusion stable, et qui devient rapidement le cœur de la nouvelle vague de systèmes de synthèse d'images/vidéos – comme moyen d'extraire des intégrations à partir d'images LD « forgées » et de former un classificateur sur les modèles et les classes observés.

Dans un scénario plus « boîte noire », où les morceaux PNG qui contiennent des informations sur le processus de génération ont depuis longtemps été supprimés par les processus de téléchargement et pour d'autres raisons, les chercheurs utilisent Salesforce Cadre BLIP (également un composant dans au moins un distribution de diffusion stable) pour interroger « à l'aveugle » les images sur la structure sémantique probable des invites qui les ont créées.

Les chercheurs ont utilisé Stable Diffusion, Latent Diffusion (lui-même un produit discret), GLIDE et DALL-E 2 pour remplir un ensemble de données de formation et de test exploitant MSCOCO et Flickr30k.

Normalement, nous examinerions de manière assez approfondie les résultats des expériences des chercheurs pour un nouveau cadre ; mais en vérité, les conclusions de DE-FAKE semblent susceptibles d'être plus utiles comme référence future pour les itérations ultérieures et les projets similaires, plutôt que comme une mesure significative du succès du projet, compte tenu de l'environnement volatile dans lequel il opère, et du fait que le système contre lequel il est en concurrence dans les essais de l'article a près de trois ans - de l'époque où la scène de la synthèse d'images était véritablement naissante.

Les deux images les plus à gauche : le cadre antérieur « contesté », créé en 2019, s'en sort comme prévu moins bien face à DE-FAKE (les deux images les plus à droite) sur les quatre systèmes LD testés.

Les résultats de l'équipe sont extrêmement positifs pour deux raisons : il existe peu de travaux antérieurs avec lesquels les comparer (et aucun qui offre une comparaison équitable, c'est-à-dire qui couvre les douze semaines seulement depuis la publication de Stable Diffusion en open source).

Deuxièmement, comme mentionné ci-dessus, bien que le domaine de la synthèse d'images LD se développe à une vitesse exponentielle, le contenu de sortie des offres actuelles se filigrane efficacement en raison de ses propres lacunes et excentricités structurelles (et très prévisibles) - dont beaucoup sont susceptibles d'être corrigées, dans le cas de la diffusion stable au moins, par la publication du point de contrôle 1.5 le plus performant (c'est-à-dire le modèle formé de 4 Go alimentant le système).

Dans le même temps, Stability a déjà indiqué avoir une feuille de route claire pour les V2 et V3 du système. Compte tenu des événements qui ont fait les gros titres des trois derniers mois, toute torpeur d'entreprise de la part d'OpenAI et d'autres acteurs concurrents dans l'espace de synthèse d'images s'est probablement évaporée, ce qui signifie que nous pouvons nous attendre à un rythme de progrès tout aussi rapide également dans le espace de synthèse d'images à source fermée.

Première publication le 14 octobre 2022.