Angle d’Anderson

Utilisation de la ‘probabilité’ comme métrique de détection de deepfake

Si les vidéos et les audios générés par l’IA sont suffisamment bons, les détecteurs de deepfake basés sur les artefacts visuels ou d’autres signaux traditionnels ne fonctionneront plus. Mais étant donné que les gens s’écartent rarement d’un comportement prévisible, peut-être que la ‘probabilité’ pourrait être adoptée plus en profondeur comme signal de savoir si une vidéo ou une rumeur d’actualité est susceptible d’être vraie.

Opinion Dans les premières années 1990, l’ancien footballeur britannique respecté et commentateur de sports télévisés David Icke a révélé de manière décontractée sur un show de discussion qu’il était ‘le fils de Dieu’ – une révélation bizarre et inattendue qui allait évoluer au fil des décennies suivantes en une théorie du complot persistante et élaborée sur un cabal secret et puissant de ‘gens-lézards’.

Avec l’adoption d’Internet encore quelques années plus tard, et l’avènement des médias sociaux encore plus loin dans le futur, la dissonance entre la célébrité d’Icke et la nature de ses nouvelles révélations a eu un impact profond sur le public britannique – notamment en raison du manque total de contexte, ou de tout type de préparation pour ce pivot massif, d’une personnalité sportive bien connue et bien établie.

Plus de vingt ans plus tard, une souche similaire et bien plus sombre de ce choc sociétal s’est produite, lorsque le défenseur de charité aimé et l’animateur de télévision pour enfants Jimmy Savile a été retrouvé après sa mort comme étant un délinquant sexuel à vie et vorace qui avait utilisé son image publique saine pour faciliter ses crimes.

L’enquête policière ultérieure Opération Yewtree allait découvrir de nombreux autres célébrités britanniques avec des antécédents de délits sexuels ; plus tard, la poursuite de Harvey Weinstein allait conduire à une découverte similaire de délinquants sexuels célébrités aux États-Unis, évoluant dans le mouvement #metoo, et s’incrustant définitivement dans la culture américaine dans des sorties telles que The Morning Show. Les ‘nouvelles choquantes’ semblaient développer un nouveau modèle abrupt – qui allait finalement être adopté par les attaquants de deepfake.

La fin de la détection de deepfake ‘traditionnelle’ ?

Même si les médias sociaux et l’IA avaient existé dans les premières années 90, aucun système prédictif au monde n’aurait pu prévoir les révélations de Icke sur le show de discussion, qui (comme je me le rappelle bien) n’avaient pas été préfigurées dans les années précédant l’événement.

Mais alors, si l’IA avait existé, il aurait peut-être fallu du temps pour convaincre un public plus large que les déclarations de Icke n’étaient pas le produit de Google Veo 3, ou d’un autre des nouveaux cadres de deepfake audio/vidéo hyper-réalistes.

Ce n’est qu’au cours des 6-12 derniers mois que les méthodes de deepfake basées sur l’IA sont devenues suffisamment efficaces pour remplir des années de catastrophisme médiatique sur l’ingérence électorale de deepfake, et capables de générer le type de tache réputationnelle rapide qui est fausse, mais difficile à éradiquer dans une culture de plus en plus crédule.

Jusqu’à présent, la sortie vidéo de l’IA est généralement en deçà du réalisme, limitée par des obstacles techniques et de plus en plus polarisée par un écart croissant entre les modèles restrictifs occidentaux et les versions open source non censurées de la Chine**.

Néanmoins, je remarque de plus en plus dans la littérature de recherche une concession imminente de cette guerre froide, par exemple dans le nouveau document Performance Decay in Deepfake Detection† :

‘[Nous] supposons que les vidéos de deepfake continueront à contenir des fonctionnalités apprenables par machine qui les distinguent de manière fiable des vidéos réelles. À mesure que les capacités de l’IA générative continuent de progresser rapidement, cette hypothèse peut bien se briser.

‘Dans un tel scénario, le marquage d’eau et d’autres méthodes de suivi de la provenance offriront la seule issue pour maintenir la confiance dans les médias numériques.’

Cependant, le même document concède que les solutions basées sur la provenance telles que l’initiative Content Authenticity Initiative (et les très nombreuses petites recherches offres des 7-8 dernières années) nécessitent une adoption si large qu’elle est irréaliste ; et le document se termine sur une note générale de retraite, sinon de défaite.

Si les méthodes de détection de deepfake audio-visuel sont dépassées par l’IA générative, et si l’adoption mondiale d’un schéma de marquage d’eau ou de provenance intrusive échoue aux nombreux obstacles logistiques, quelle caractéristique centrale commune pourrait remplacer ceux-ci comme indicateurs de sortie potentiellement fausse ? Ou devons-nous nous résigner à un monde où tous les médias sont en doute, et où le Liar’s Dividend prévaut ?

Graphes de connaissances

Il semble temps de mettre plus en profondeur à profit la probabilité et la plausibilité des ‘événements signalés’ comme caractéristique de signal dans la détection de deepfake. De plus, puisque les systèmes d’IA générative audio/vidéo convergent de plus en plus, il peut également être temps pour les branches de recherche distinctes de ‘fausses nouvelles’ (en tant qu’événement narratif basé sur le texte) et de fausses images/vidéos de converger de la même manière.

Une probabilité de métrique de deepfake n’est pas la même chose que RAG-aided vérification de faits, où un modèle d’IA peut apporter des résultats web actuels pour acquérir des connaissances sur les événements qui se produisent après sa propre date de fin, et/ou pour corroborer ses allégations.

Plutôt, elle effectuerait des prédictions basées sur des tendances statistiques généralement indicatives, dérivées de modèles historiques qui se conforment à une enquête actuelle.

Dans ce sens, une méthode de probabilité est plus proche de l’analyse statistique que des approches plus modernes de la scène actuelle de l’apprentissage automatique.

Bien que précédemment éclipsées par des approches plus modernes de l’ère des Transformers, les graphes de connaissances font quelque chose d’un retour dans l’espace de l’entreprise, et semblent adaptés au déploiement potentiel de ‘probabilité’ de métriques dans la détection de deepfake.

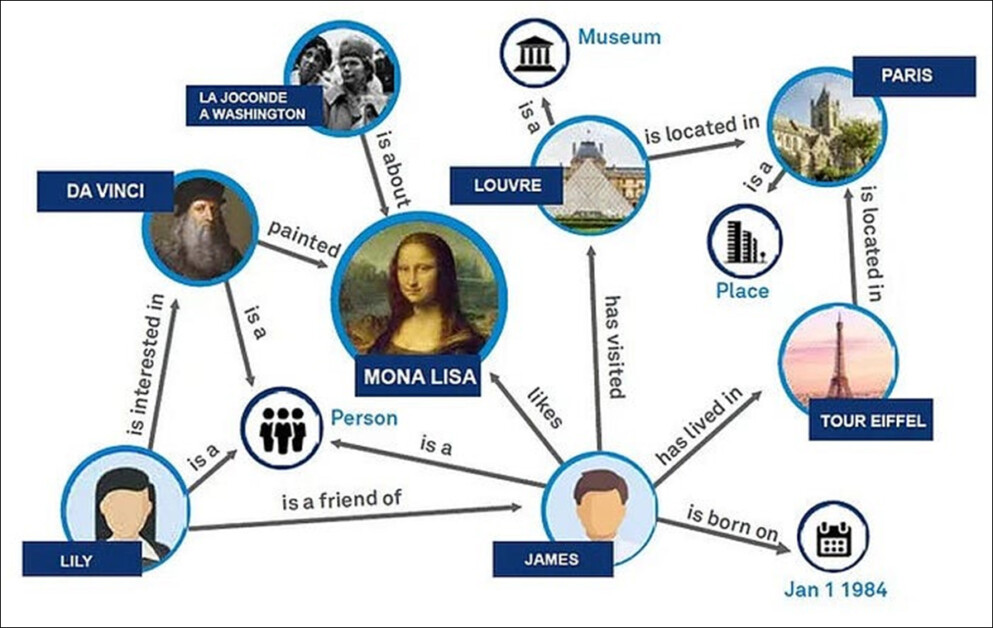

Un graphique de connaissances simplifié illustrant comment les personnes, les lieux, les œuvres d’art et les événements peuvent être liés par des relations étiquetées, permettant aux machines de raisonner sur des entités et des connexions du monde réel. Source

Un graphique de connaissances est un moyen d’organiser les informations en cartographiant des choses du monde réel telles que des personnes, des sociétés, des événements ou des idées dans un réseau de faits connectés.

Chaque sous-entité est un nœud, et les liens entre eux (bords) décrivent comment ils se rapportent. Par exemple, ‘Microsoft’ (un nœud) pourrait être lié à ‘OpenAI’ (un autre nœud) par un bord qui dit ‘est un client de’. Ces connexions sont souvent stockées dans des bases de données graphiques et suivent une structure sujet-prédicat-objet, telle que ‘Microsoft est un client d’OpenAI’.

Mémoire persistante

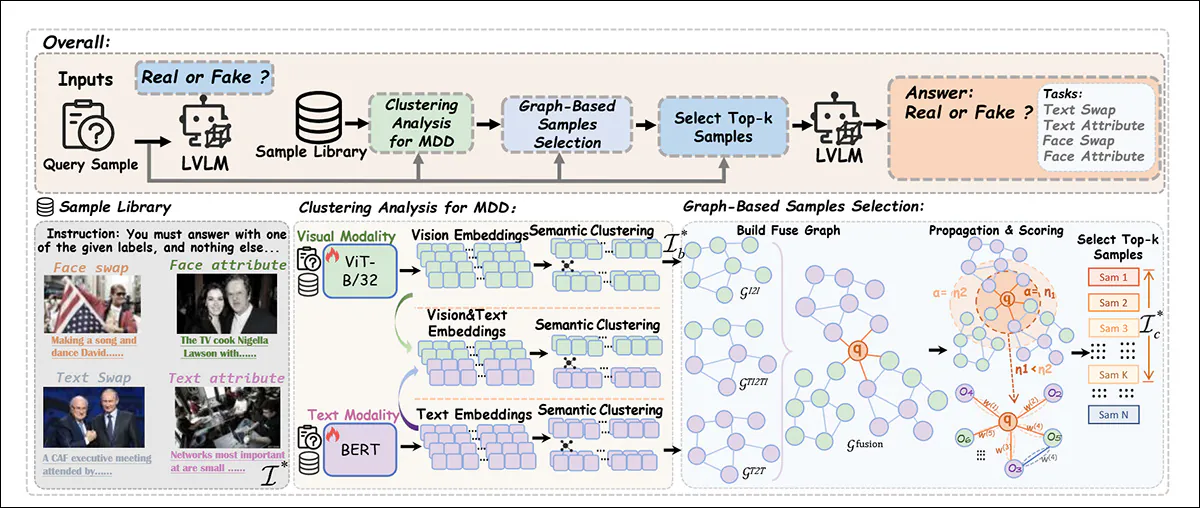

Une étude chinoise de septembre de cette année a proposé une méthode sans formation qui utilise un raisonnement graphique pour détecter des incohérences subtiles dans des deepfakes multimodaux.

Au lieu de générer des raisons ou de mettre à jour de grands modèles, le système récupère des paires d’images et de texte, construit un graphique de similarité et score les connexions, afin de récupérer les exemples les plus pertinents, et ceux-ci guident le jugement du modèle sans avoir besoin d’une nouvelle formation :

Une vue d’ensemble du cadre GASP-ICL, qui améliore la détection de deepfake en combinant la sélection d’échantillons basée sur le graphique avec l’apprentissage en contexte, permettant à un modèle de vision-langage gelé de classifier les paires d’images et de texte comme réelles ou fausses, sans formation ou mise à jour. Source

Ceci est probablement le travail le plus proche, en tout cas qui a traversé mon chemin, d’une approche ‘informée’ et consciente de l’histoire pour l’évaluation et la vérification de la sortie des médias.

Pour la plupart, les approches de vision par ordinateur continuent d’analyser les images (y compris les cadres de vidéos et anomalies temporelles englobant plusieurs cadres) tandis que les cadres de détection de ‘fausses nouvelles’ continuent de mettre l’accent sur les données basées sur le texte, même dans les projets multimodaux.

Crépissement de fonctionnalités

Le défi d’un système prédictif de ce type est la portée de la surveillance qui peut être nécessaire pour rendre l’approche pleinement performante – au moins au-delà de l’analyse des célébrités et des personnalités publiques, pour lesquelles des données librement accessibles existent déjà.

Probablement le fil de recherche le plus similaire actuel est le domaine de la précriminalité, qui étiquette divers signaux d’intelligence multimodaux comme ‘suspects’, et se présente comme un épouvantail d’IA inébranlable dans des sorties telles que Person of Interest (2011-2016), et Minority Report (2002).

Alors qu’un système de surveillance omnivore de type Person of Interest produirait des résultats optimaux, il est peu probable que la culture occidentale puisse sanctionner le niveau d’intrusion personnelle que les réseaux internes de la Chine imposent à ses citoyens.

Par conséquent, en ce qui concerne les fausses nouvelles sur les non-célébrités, seules les agences gouvernementales telles que la police (ainsi que les registres des naissances et des décès et les bureaux d’imposition) auraient suffisamment d’informations historiques pertinentes pour informer les probabilités dans un flux de travail basé sur le graphique ; et même eux auraient besoin d’une volonté, d’une capacité, d’une législation et de ressources de style CCCP pour inclure les citoyens ordinaires dans leur couverture et leurs analyses (c’est-à-dire au-delà des points de données banaux mais obligatoires tels que les numéros de passeport et les immatriculations de voitures).

Score de probabilité

Il est probable que l’efficacité potentielle d’un système de ce type serait limitée aux cas d’utilisation les plus évidents (actuels) pour le contenu de deepfake : destabilisation (deepfakes soutenus par l’État) ; deepfakes de célébrités et de ‘inconnus’ pornographiques (qui peuvent tous deux être considérés comme malveillants, même si le dernier cas tend à attirer une plus grande inquiétude médiatique) ; fraude (y compris deepfakes audio/vidéo conçus pour effectuer des ‘vols d’identité’) ; et l’assassinat du caractère politique.

Un système basé sur les connaissances aurait besoin d’une échelle de probabilités pour une diversité d’événements possibles. À une extrémité du spectre, des défaillances humaines courantes telles que la gestion financière douteuse, l’infidélité, la dépendance, l’indiscrétion, etc. ; à l’autre extrémité… révéler que vous êtes le fils de Dieu sur un show de discussion en direct (ou des événements d’une ampleur et d’un impact similaires).

Même dans le dernier cas, les facteurs historiques personnels pour un individu donné pondéreraient le résultat de probabilité : un personnage politique de premier plan qui a publiquement équivoqué sur des questions controversées (telles que la véracité des alunissages des années 60/70) pour gagner du capital avec un électorat de plus en plus ‘alternativement informé’ pourrait gagner un statut wildcard supplémentaire dans les routines de vérification, par rapport à ses pairs plus réservés.

Dans le cas de la pornographie célébrité, il existe un contexte réel suffisant (c’est-à-dire les fuites de photos de célébrités de 2012, entre autres incidents relativement rares) pour générer un Liar’s Dividend modéré, dans certains contextes ; mais puisque ces incidents de hors-la-loi tendent à fonctionner comme des exceptions prouvant la règle, la plupart des vidéos de pornographie de célébrités basées sur la diffusion actuelles seraient considérées comme extrêmement ‘improbables’ (ce qui ne résout pas le problème de l’appropriation des identités pour de tels objectifs).

En termes de perturbation nationale, il existe une richesse considérable de données statistiques qui peuvent aider à évaluer les probabilités de ‘rapports catastrophiques’. Même dans l’histoire ancienne, des événements apparemment ‘inattendus’ tels que l’éruption du volcan non identifié Vesuvius en 79 après J.-C. étaient présagés, si vous aviez prêté suffisamment attention ; et outre la disponibilité d’un grand nombre de flux de l’ONU et d’ONG, la capacité de l’IA à extraire la structure à partir de données brutes peut fournir un contexte historique supplémentaire pour le scoring de probabilité.

Conclusion

Même un système prédictif bien mis en œuvre de ce type ne pourrait pas tenir compte du hasard, des actes de Dieu, des occurrences de freak ou des événements malveillants conçus à l’écart de toute surveillance.

De plus, le volume et la profondeur des données nécessaires, afin de fournir une couverture pour les personnes non célèbres, constitueraient un point de contention politique – au moins, pour le moment.

Cependant, les choix semblent se rétrécir ; l’analyse basée sur la vision est sur le point de faire face à l’échec face à l’amélioration de l’IA générative, tandis que les schémas de vérification et de provenance supportent une charge de dette technique accablante, et une friction contre l’adoption. Cela rend des solutions telles que l’initiative Content Authenticity Initiative, et le système de droit d’auteur de visage Metaphysic Pro de Metaphysic.ai, difficiles à populariser.

Dans leur utilisation la plus large, les systèmes RAG ne peuvent déterminer que si une source d’autorité étaye une affirmation non vérifiée ; et puisque de nombreuses grandes histoires d’actualité (vraies) émergent sans contexte préalable, un manque de preuve de la part des sources d’autorité n’est pas nécessairement significatif.

Leur valeur peut se révéler plus grande s’ils peuvent former partie d’un écosystème de données plus large concerné par la chose que la plupart des formes actuelles d’IA trouvent difficile – le contexte historique.

* Ne pas confondre avec les premiers auto-encodeurs qui ont fait leurs débuts en 2017 et seraient finalement supplantés par des approches supérieures.

† https://arxiv.org/abs/2511.07009

** Qui peuvent généralement fonctionner librement sur des PC domestiques plus puissants, au lieu de n’être disponibles que via des API contrôlées telles que ChatGPT et la série Veo.

††† Omettant les utilisations légitimes de divertissement, telles que les effets visuels professionnels dans les productions de films et de télévision.

Publié pour la première fois le jeudi 13 novembre 2025