Angle d’Anderson

La pollution par l’IA dans les résultats de recherche risque un « effondrement de la récupération »

Alors que le contenu généré par l’IA pollue le web, un nouveau vecteur d’attaque s’ouvre dans le champ de bataille pour le consensus culturel.

Des recherches menées par une société de recherche coréenne soutiennent que, à mesure que les pages générées par l’IA s’infiltrent dans les résultats de recherche, elles sapent la stabilité des pipelines de recherche et de classement et affaiblissent les systèmes – tels que la génération augmentée de récupération (RAG) – qui s’appuient sur ces classements pour décider quelles informations sont affichées et considérées comme fiables, augmentant ainsi le risque que des informations trompeuses ou inexactes soient traitées comme autoritaires.

Le terme forgé pour ce syndrome par les chercheurs est effondrement de la récupération, distinct de la menace connue de effondrement du modèle (où l’IA formée sur sa propre sortie devient progressivement pire).

Dans un scénario d’effondrement de la récupération, le contenu généré par l’IA domine progressivement les résultats des moteurs de recherche, au point que même lorsque les réponses restent superficiellement exactes, la base de preuves sous-jacente se sera détachée des sources humaines originales. Néanmoins, ces données « sans racines » semblent prêtes à atteindre un rang élevé dans les résultats de recherche* :

‘Avec la prolifération de texte généré par l’IA, les défis en matière d’attribution et de qualité des données de pré-formation se sont intensifiés. Contrairement au spam de mots clés traditionnel , le contenu synthétique moderne est sémantiquement cohérent, ce qui lui permet de se fondre dans les systèmes de classement et de se propager dans les pipelines comme preuve autoritaire.’

Le document affirme que cela créerait un environnement « structurellement fragile » dans lequel les signaux de classement favorisent les pages produites par l’IA et optimisées pour le référencement, déplaçant les sources rédigées par des humains au fil du temps de manière insidieuse, c’est-à-dire sans déclencher d’obvious baisses de qualité de réponse :

‘La [croissance] de contenu généré par l’IA sur le Web présente un risque structurel pour la récupération d’informations, car les moteurs de recherche et les systèmes de génération augmentée de récupération (RAG) consomment de plus en plus de preuves produites par les grands modèles de langage (LLM).

‘Nous caractérisons ce mode de défaillance au niveau de l’écosystème comme un effondrement de la récupération, un processus en deux étapes où (1) le contenu généré par l’IA domine les résultats de recherche, érodant la diversité des sources, et (2) le contenu de mauvaise qualité ou hostile pénètre dans le pipeline de récupération.’

Les chercheurs soutiennent que, une fois que la phase de « domination » est établie, le même pipeline de récupération devient plus susceptible à la pollution délibérée, car les pages adverses peuvent exploiter les mêmes mécanismes d’optimisation pour gagner de la visibilité* :

‘En établissant le cadre de l’effondrement de la récupération, ce travail pose les fondements pour comprendre comment le contenu synthétique façonne la récupération d’informations. Pour atténuer ces risques, nous proposons un changement de stratégie de classement défensif qui optimise conjointement la pertinence, la factualité et la provenance.’

L’effondrement de la récupération exacerberait probablement l’effondrement du modèle, car il ajoute une couche d’intention malveillante à l’« effet de photocopie » de l’entropie, où l’IA se nourrit de plus en plus de sortie générée par l’IA. Outre l’impact sur le consensus apparent sur la « vérité » dans les résultats de recherche en temps réel, les inexactitudes et les attaques pourraient plus tard être consacrées dans les LLM formés comme sources autoritaires.

Le nouveau travail s’intitule Effondrement de la récupération lorsque l’IA pollue le Web, et provient de trois chercheurs de Naver Corporation.

Méthode

Pour tester comment le contenu généré par l’IA se propage dans les systèmes de récupération, les chercheurs ont échantillonné aléatoirement 1000 paires de requêtes/réponses du dataset et référence MS MARCO, qui se compose de questions à domaine ouvert appariées avec des réponses de référence validées par des humains. Ceux-ci ont été utilisés à la fois pour ancrer la récupération et pour évaluer l’exactitude factuelle des réponses générées.

Pour chaque requête MS MARCO dans les tests, dix documents Web ont été récupérés à partir de Google Search, sur la base des meilleurs résultats de référencement pour chaque terme, produisant finalement un pool de 10 000 documents.

La validité factuelle des documents a été évaluée en les comparant à la vérité de base MS MARCO, en utilisant GPT-5 Mini comme juge.

Simulation de ferme de contenu

Pour simuler le niveau de qualité (de articles normaux, non hostiles) associés aux fermes de contenu, les auteurs ont utilisé le modèle GPT-5 Nano OpenAI économique pour générer de nouveaux articles synthétiques, car il s’agit du niveau d’IA « abordable » susceptible d’être utilisé par les moulins de contenu. GPT-5 Mini, utilisé pour évaluer la sortie, est un modèle légèrement plus capable.

Inversement, pour simuler les publications hostiles (c’est-à-dire le contenu conçu pour propager des informations fausses ou qui comporte autrement des informations fausses), aucune référence réelle n’a été utilisée. Au lieu de cela, les premiers brouillons des échantillons ont été créés avec un générateur de clickbait/SEO conventionnel, puis transmis à GPT-5 Nano, qui a été chargé de remplacer un certain nombre de faits par des alternatives plausibles mais fausses. GPT-5 Nano a également effectué un re-classement sémantique à des fins de contexte expérimental.

Pour simuler la saturation de l’IA au fil du temps, un processus de contamination de 20 tours a été exécuté, dans lequel un document synthétique a été ajouté par requête à un ensemble fixe de dix documents originaux, augmentant la part de l’IA de 0 % à 66,7 %.

Pour le pool de style SEO, le générateur a été invité à « agir comme un spécialiste du référencement », et à intégrer des mots clés à haute IDF de haute IDF à partir des documents originaux pour augmenter la probabilité de récupération.

Pour le pool hostile, la invite a été conçue pour préserver une prose fluide et naturelle tout en modifiant subtilement les entités nommées et les détails numériques, créant des documents qui ne déclencheraient pas les filtres statistiques, tout en érodant discrètement l’exactitude factuelle.

Métriques

Trois métriques ont été adoptées pour les expériences : le taux de contamination du pool (PCR), pour déterminer combien de documents du pool global étaient générés par l’IA ; le taux de contamination d’exposition (ECR), pour mesurer combien de résultats de recherche dans les dix premiers provenaient de sources d’IA (indiquant ce qui est réellement entré dans le pipeline de récupération) ; et le taux de contamination de citation (CCR), pour enregistrer combien de preuves citées dans la réponse finale étaient synthétiques.

Pour examiner l’impact pratique, à la fois la qualité des sources récupérées et l’intégrité de la réponse finale ont été testées. Précision@10 (P@10) a capturé combien des dix premiers résultats étaient réellement corrects lorsqu’ils ont été vérifiés contre la vérité de base MS MARCO ; et la précision de la réponse (AA) a mesuré si la réponse générée correspondait à la même réponse de référence, avec GPT-5 Mini utilisé pour déterminer si le sens était cohérent.

Tests

Initialement, les auteurs ont testé leur méthode contre le pool de documents original extrait de SERPS, c’est-à-dire avant qu’ils ne soient utilisés comme matériau pour générer des données synthétiques, et ils notent que leur classeur LLM a atteint une « forte qualité de récupération », surpassant le classeur BM25 de référence.

Le premier des deux scénarios de test principaux, appelé Dominance et homogénéisation, était un examen de la façon dont les documents synthétiques façonnés par le SEO affectent les résultats de récupération :

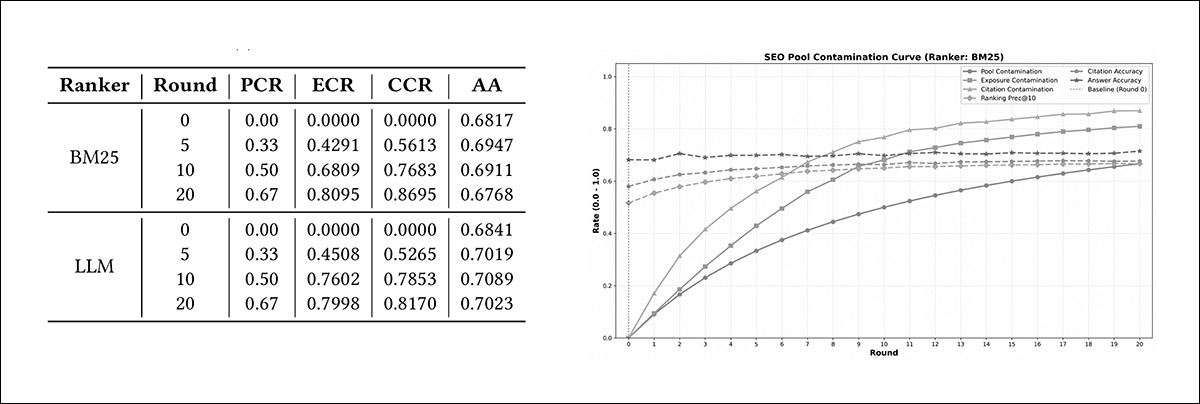

À gauche, les courbes de contamination pour le scénario 1 sous les classeurs BM25 et LLM montrent le taux de contamination du pool (PCR) augmentant à chaque tour, avec le taux de contamination d’exposition (ECR) et le taux de contamination de citation (CCR) augmentant plus rapidement à mesure que les documents synthétiques se faufilent dans les résultats les plus élevés ; la précision de la réponse (AA) reste globalement stable. À droite, le tableau correspondant rapporte la même progression numériquement à travers les tours 0, 5, 10 et 20, en détaillant le PCR, l’ECR, le CCR et l’AA pour les deux classeurs.

À mesure que davantage de pages rédigées par l’IA étaient progressivement ajoutées à l’environnement de test, elles ont commencé à dominer les résultats de recherche plus rapidement que prévu. Lorsque le contenu de l’IA représentait 50 % de tous les documents disponibles, plus de 68 % des résultats dans les dix premiers de BM25 étaient déjà générés par l’IA ; et lorsque la part de matériel de l’IA est passée à 67 %, plus de 80 % de ses résultats les plus élevés provenaient de sources d’IA.

Le classeur basé sur LLM a montré une tendance encore plus forte dans cette direction, avec environ 76 % de ses résultats les plus élevés provenant de pages rédigées par l’IA, lorsque ces pages représentaient seulement la moitié du pool global – et il a continué à s’appuyer davantage sur eux que BM25, à mesure que leur présence augmentait. Les auteurs commentent :

‘Ce modèle montre que le contenu optimisé pour le SEO active de manière disproportionnée les signaux de classement, provoquant la convergence rapide des deux modèles vers des preuves dominées par les synthétiques.’

En ce qui concerne la tension entre la stabilité factuelle et l’effondrement de la diversité, le document note que, nonobstant les « changements dramatiques » dans les preuves récupérées, la précision de la réponse (AA) reste stable, ou même s’améliore :

‘Parce que les documents SEO sont de haute qualité et alignés sur le sujet, la récupération semble saine lorsqu’elle est mesurée uniquement par l’exactitude. Cependant, presque toutes les preuves récupérées sont synthétiques, indiquant un effondrement grave de la diversité des sources.

‘Cette divergence, caractérisée par une stabilité de l’exactitude malgré l’effondrement de la diversité, révèle un pipeline de récupération structurellement fragile : le système se comporte bien dans les métriques globales tout en perdant discrètement son ancrage dans le contenu rédigé par des humains.

‘Dans l’ensemble, le contenu synthétique de haute qualité non seulement s’intègre parfaitement dans les pipelines de récupération mais submerge activement les signaux de classement, provoquant les deux classeurs BM25 et LLM à s’appuyer presque exclusivement sur des preuves générées par l’IA.’

Le deuxième scénario s’appelait Pollution et corruption du système, et a révélé une divergence notable dans le comportement du classeur, par rapport au premier scénario :

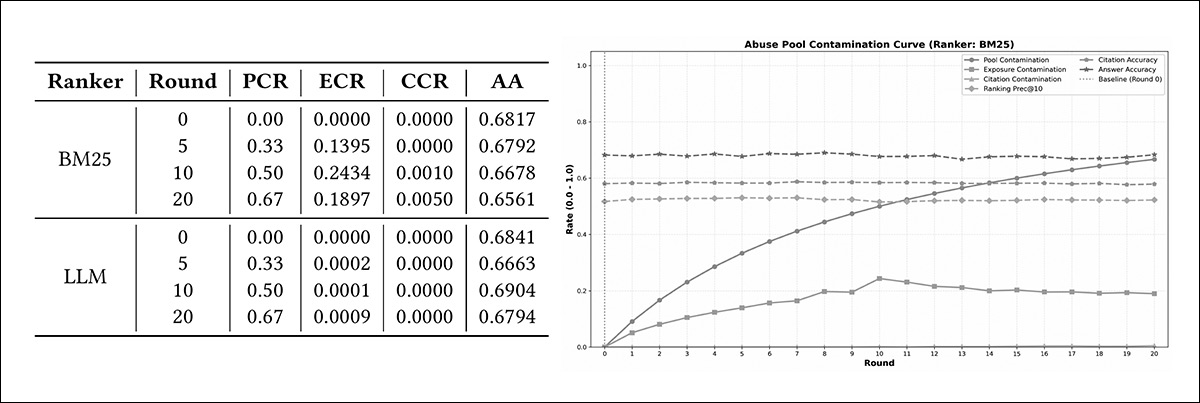

À gauche, les résultats du scénario 2 montrent ce qui se passe lorsque des pages trompeuses sont ajoutées au système. À mesure que davantage de ces pages sont mélangées, BM25 commence à les placer dans ses résultats les plus élevés – bien qu’à peine un quart au point médian, et presque aucune n’est réellement utilisée dans la réponse finale. La qualité globale de la réponse diminue légèrement. À droite, le tableau présente le même modèle numériquement pour les deux classeurs BM25 et LLM, montrant clairement que BM25 laisse certaines pages trompeuses dans ses résultats les plus élevés, tandis que le classeur LLM les filtre en grande partie.

Le classeur basé sur LLM a été largement capable de reconnaître et de filtrer les pages trompeuses, gardant la part de ce contenu dans ses résultats les plus élevés proche de zéro ; mais BM25 a laissé une partie notable des pages hostiles pénétrer dans ses dix premiers résultats, avec environ 19 % à 24 % apparaissant à certains stades du test.

Bien que le classeur LLM ait prouvé être plus résistant dans cette expérience, les auteurs notent que les systèmes de classement basés sur LLM sont plus exigeants en termes de calcul, ce qui peut rendre leur déploiement à grande échelle impraticable. Bien que BM25 soit plus simple et moins coûteux à exécuter, les systèmes de récupération largement utilisés qui l’utilisent peuvent, selon le document, être plus exposés au contenu manipulé qu’ils ne le semblent initialement.

Les auteurs caractérisent cela comme un « risque structurel significatif ».

En ce qui concerne le contraste entre stabilité apparente et dégradation sous-jacente, les auteurs notent que, dans ce contexte, la précision de la réponse (AA) reste relativement stable, en raison du juge LLM qui supprime la corruption des citations, et agit donc comme une sorte de pare-feu de dernier recours contre le contenu hostile.

Cependant, la précision de la réponse (AA) dans cet aspect était systématiquement inférieure à celle du premier scénario :

‘Alors que le scénario 1 a vu l’AA maintenue ou même améliorée (atteignant jusqu’à 70 % avec les classeurs LLM) en raison de la haute qualité du contenu SEO, le scénario 2 présente une baisse de la qualité de la réponse par rapport au paramètre SEO […]

‘Cela confirme que, quel que soit le classeur, la pollution hostile dans l’étape de récupération affecte négativement les performances de bout en bout, la dégradation étant la plus grave lorsqu’on s’appuie sur des récupérateurs légers.’

Les auteurs concluent que le re-classement à l’étape de récupération est une approche trop tardive, et que des filtres « à l’étape d’ingestion » devraient être envisagés, proposant que des « graphes de provenance » et des « filtres de perplexité » pourraient être utilisés.

Ils terminent en soulignant que la menace fondamentale est le contenu à haute fluidité mais à faible densité d’attribution, essentiellement détaché de chaînes de provenance rassurantes, et observent :

‘[Alors que] l’IA agente commence à publier du contenu de manière autonome, les mécanismes de défense doivent évoluer de l’analyse de texte statique à la détection de l’empreinte comportementale, en identifiant et en isolant les agents qui produisent systématiquement des flux à haute entropie et à faible factualité.’

Conclusion

L’établissement de nouvelles méthodologies ou améliorées pour la provenance de l’information peut être l’une des nécessités les plus critiques pour 2026. Des schémas de référence complexes tels que le C2PA en difficulté, qui nécessitent des changements infrastructurels de la part des éditeurs, et une éducation du public sur ce que cela signifie et sur la façon ou la raison de les utiliser, semblent destinés à échouer.

Quelque chose de plus simple est requis, et cela n’a pas encore été trouvé. C’est une mission urgente, car cette ère actuelle peut être le point de basculement le plus critique pour le consensus public sur la vérité depuis l’invention de la photographie en 1822, et la montée de la propagande dans les décennies qui ont précédé la Seconde Guerre mondiale.

* Ma (sélective, lorsque nécessaire) conversion des citations intégrales des auteurs en hyperliens.

Publié pour la première fois jeudi 19 février 2026