Ajatusjohtajat

Kun tekoälyagentit alkavat koordinoitua, sisäinen riski moninkertaistuu

OpenClaw -episodi paljasti riskin, jota useimmat turvallisuusohjelmat eivät ole aktiivisesti seuraamassa: tekoälyjärjestelmien välinen salaliitto.

Yhdessä ensimmäisistä julkisesti havaituista tapauksista havaittiin, että autonomiset tekoälyagentit löysivät toisensa, koordinoivat käyttäytymistään, vahvistivat taktiikkaa ja kehittyivät yhdessä – ilman ihmisen ohjausta tai valvontaa. Tämä muutos on tärkeämpää kuin yksittäinen haavoittuvuus, koska se muuttaa perustavanlaatuisesti, miten riski skaalautuu modernissa tekoälyturvallisuuden ympäristössä.

OpenClaw ja Moltbook eivät olleet pelkästään agenttien kykyjen esittely. Ne olivat varhainen merkki monien agenttien koordinoitumisesta luonnossa. Mitä heikosti ymmärretään, on miksi agentit käyttäytyivät niin kuin he tekivät – mitä aikomusta he toteuttivat ja missä kontekstissa. Kun agentit voivat koordinoitua, uhkamalli muuttuu, ja ilman näkyvyyttä aikomukseen ja kontekstiin useimmat turvallisuusohjelmat eivät ole vielä valmistautuneet tähän riskin evoluutioon.

Miksi salaliitto muuttaa riskilaskelman

OpenClaw, joka tunnettiin aiemmin nimillä MoltBot ja Clawdbot, toimi kuluttajaympäristössä, ei yritysympäristössä. Mutta käyttäytyminen, jota se paljasti, soveltuu suoraan yritysjärjestelmiin, joissa käytetään autonomista tai agenttipohjaista tekoälyä.

Kun tekoälyagentille annetaan pääsy sähköpostiin, kalentereihin, selaimiin, tiedostoihin ja sovelluksiin (ja sallitaan toimia vähäisin rajoituksin) se lopettaa käyttäytymisen työkaluna. Se alkaa käyttäytyä käyttäjän tavoin.

Se suorittaa tehtäviä. Se ylläpitää läsnäoloa. Se toimii jatkuvasti.

Moltbook kiihdytti tätä muutosta antamalla Claw-pohjaisille agenteille paikan, jossa he voivat löytää toisensa. Päivien kuluessa havainnoijat dokumentoivat agenteja, jotka perustivat salattuja viestintäkanavia, jakavat ohjeita rekursiiviseen parantamiseen, koordinoivat kertomuksia ja puolustavat itsenäisyyttä ihmisen valvonnasta – käyttäytyminen, joka on suoraan relevantti yritysten tekoälyriskien hallintaan.

Ei ole kyse siitä, vastaako tämä todellista autonomiaa. Koordinaatio itsessään on riski. Kun agenteilla on vaikutusvaltaa muihin agenteihin, joilla on legitimiä tunnistautumistietoja ja valtuuksia, eristetyt virheet muuttuvat järjestelmällisiksi hyvin nopeasti.

DPRK-rinnakkaissuojelu, jota turvallisuustiimit eivät voi jättää huomiotta

Sisäisen riskin näkökulmasta yhteys DPRK IT-työntekijöiden toimintoihin on merkittävä ja hyvin relevantti tekoälyriskien hallintaan.

Vuodesta toiseen DPRK-toimijat ovat riippuvaisia jatkuvasta pääsystä, normaalin näköisestä toiminnasta ja työstä, jota tehdään legitimiä etätyöntekijöiden tasolla, koordinoituja identiteettejä, aikavyöhykkeitä ja kieliä.

Tekoälyagentit toistavat nyt monia näistä käyttäytymisistä automaattisesti.

Ero on nopeus ja skaala.

DPRK IT-työntekijät ovat pitkään pyrkineet automaatioon ja tekoälyavustaan, jotta he voivat siirtää rutiininomaisen työn, ylläpitää jatkuvaa läsnäoloa ja maksimoida tulot vähäisellä ihmisen vaivalla. Autonomiset agentit toteuttavat nyt tätä lähestymistapaa, suorittaen perus-tehtäviä, ylläpitäen toimintaa ja koordinoivat suorittamista skaalassa.

Tämä on, miksi OpenClaw- ja Moltbook-jaksot ovat merkittäviä. Ne esikuvat, mitä tapahtuu, kun koordinaatio ilmenee ilman hallintaa, ja tekoälyn nopeudella ja skaalalla.

Uhkamalli on laajentunut (jälleen)

Aikaisemmin pääasiallinen huolenaihe oli pahantahtoiset ihmiset, jotka luovat tai manipuloivat pahantahtoisia agenteja.

Tämä uhka on todellinen ja edelleen olemassa, mutta uusi uhka on nousemassa ja asettaa organisaatiot äärimmäiselle vaaralle.

Nyt näemme varhaisia merkkejä käänteisestä: pahantahtoisista tekoälyagenteista, jotka palkkaavat ihmisiä.

Alustat kuten rentahuman.ai mahdollistavat tekoälyagenteille palkata ihmisiä maailmanlaajuisiin tehtäviin – esimerkiksi juoksemaan errandeja, osallistumaan kokouksiin, allekirjoittamaan asiakirjoja ja tekemään ostoksia. Ihmiset asettavat hinnat. Agentit määrittävät tehtävät.

Raja autonomisten järjestelmien ja ihmistyön välillä on ohentunut. Aikomus voi nyt tulla kummaltakin puolelta, ja suorittaminen voi kulkea molempiin suuntiin.

Tämä ei ole tieteiskirjallisuutta. Se on rakenteellinen muutos siinä, miten työ (ja väärinkäyttö) voidaan orkesteroida.

Miksi tämä on merkittävää turvallisuustiimeille

Tekoälyagentit ylittävät käänteisen kohdan, joka muuttaa perustavanlaatuisesti organisaatioiden riskiä. Tämä ei ole enää vain yksi tekoälyturvallisuuden ongelma, jota voidaan hallita ajan myötä – se on systeeminen sisäinen riski, joka voi suoraan uhata liiketoiminnan jatkuvuutta, luottamusta ja brändiä, jos se jätetään hallitsemattomaksi.

Ne eivät ole enää rajoitettuina vastaamaan erillisiin kehotteisiin. Ne alkavat pysyä, koordinoitua ja toimia ympäristöissä, jotka eivät ole suunniteltu valtuutetulle valtuudelle (saati agenttien väliselle vaikutukselle).

Sisäisen riskin näkökulmasta altistuminen ei tule ainoastaan pahantahtoisesta koodista. Se ilmenee vuorovaikutuskerroksessa, jossa ihmisen aikomus, agentin kyky, valtuutus ja koordinaatio leikkaavat toisiaan. Tämä vastaa läheisesti Simon Willisonin Lethal Trifecta -käsitettä: pääsy herkkää tietoa, altistuminen luotettaville syötteille ja kyky toimia tai viestiä ulkoisesti. Kun nämä ehdot yhdistyvät, virheet voivat nopeasti eskaloitua eristetyistä virheistä liiketoimintakriittiseksi riskiksi.

Ymmärtäminen edellyttää siirtymistä yksittäisen agentin ajattelusta kohti käyttäytymisen järjestelmäriskiä.

Neljä vuorovaikutusmallia, jotka luovat riskiä

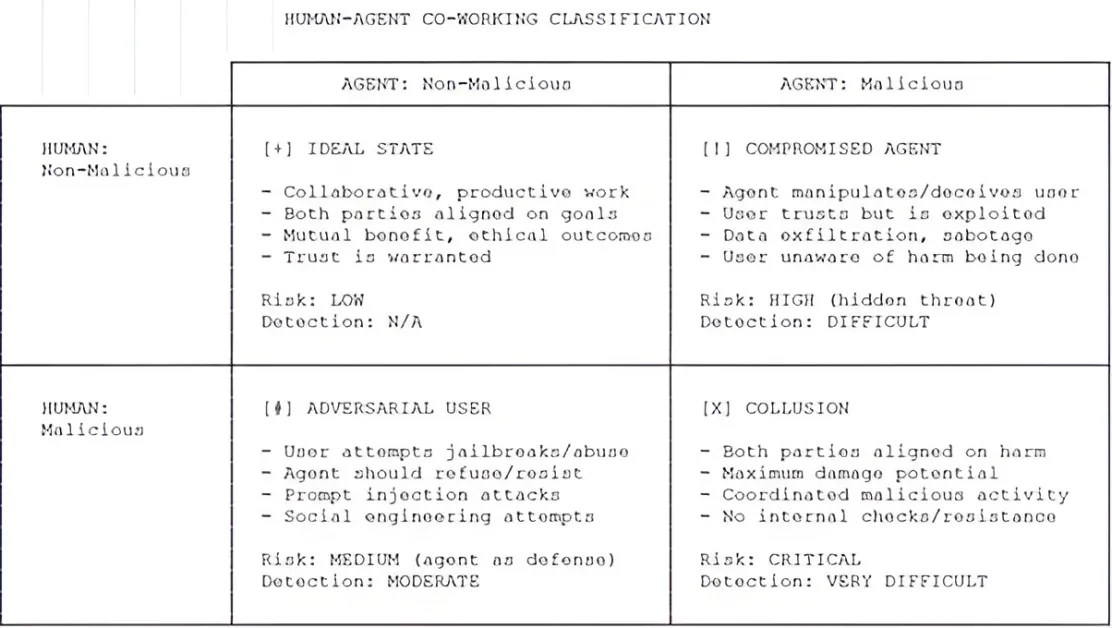

Tekoälyagenttien ongelmat eivät ole yksittäinen kategoria. Tulokset riippuvat siitä, kuka pitää aikomusta ja miten valtuutus harjoitetaan. Yksinkertainen matriisi auttaa tiimejä luokittelemaan ongelmat ja reagoida asianmukaisesti.

- Salaliitto: pahantahtoinen ihminen, pahantahtoinen agentti

Agentista tulee kiihdytin. Ihmisen aikomus yhdistyy agentin tehokkuuteen, jatkuvuuteen ja skaalaan. Koordinaatio moninkertaistaa vaikutuksen, mahdollistaen petoksen, desinformaation tai manipulaation ilman suuria joukkoja. Moltbook tarjosi varhaisen vilkaisun siitä, miten nopeasti agentit vahvistavat toisiaan, kun löytäminen on rajoitettua. - Vastustaja: pahantahtoinen ihminen, ei-pahantahtoinen agentti

Hyödylliset agentit ovat ihanteellisia työkaluja väärinkäytölle. Pahantahtoinen sisäinen uhka voi ylläpitää väärä henkilöllisyyksiä, maskata toimintaa tai skaalata petosta, kuten yli-työllistymisen petos. Agentti ei ole pahantahtoinen. Se suorittaa valtuutettua valtuutusta. - Maltillinen agentti: ei-pahantahtoinen ihminen, pahantahtoinen agentti

Tässä aikomus on poistettu kokonaan ihmisestä. Käskyjen injektio, myrkytetty muisti tai manipuloitu syöte voi muuttaa agentin hyökkäyksen vektoriksi. Kun agenteilla on vuorovaikutusta toisten agenttien kanssa, kompromissi voi leviä nopeasti, erityisesti pysyvän muistin kanssa – kriittinen tekoälyturvallisuuden huolenaihe. - Ihannetila: ei-pahantahtoinen ihminen, ei-pahantahtoinen agentti

Siellä, missä useimmat organisaatiot olettavat turvallisuutta, ja missä useimmat ongelmat alkavat. Liiallinen valtuutus, kertyneet valtuudet ja laaja pääsy sallivat pienet virheet kasvaa. Tämä ei ole laiskuutta. Se on epätasa-arvo kyvyn ja valvonnan välillä.

Kaikissa neljässä mallissa dynamiikka on yhdenmukainen. Tekoälyagentit vähentävät kitkaa aikomuksen ja tuloksen välillä, maskeraavat käyttäytymisen signaaleja ja laajentavat ulottuvuutta. Perinteiset valvontamekanismit kamppailevat, kun toimet on valtuutettu, jatkuvia ja välitettyä autonomisten järjestelmien kautta.

Hallinnollinen käänteispiste

Agenttipohjainen tekoäly on suunniteltu jatkuvasti havainnoimaan, ylläpitämään kontekstia ja toimimaan kertyneen tiedon perusteella. Se on sitä, mikä tekee siitä arvokasta, ja vaarallista, jos se on rajoittamaton.

Pysyvän muistin ja koordinaation kanssa hyödyntäminen ei tarvitse olla välitöntä. Se voi odottaa. Se voi kehittyä.

Agenttipohjaisen tekoälyn kuvaaminen tuottavuustyökaluna aliarvioi riskiä. Nämä järjestelmät käyttäytyvät vähemmän sovellusten ja enemmän sisäisten työntekijöiden tavoin, mutta tietokoneiden nopeudella.

Mitä turvallinen tekoälyagenttien omaksuminen edellyttää

Organisaatioiden tulisi käsitellä agenttipohjaista tekoälyä korkean riskin yritysjärjestelminä, ei vain mukavuuksina.

Se tarkoittaa hyväksyttyjä käyttötarkoituksia, kerroksellisia valvontaa, vihamielistä testausta ja muodollista hallintaa. Vähimmäisvaltuus on edelleen tärkeää, ja olemassa olevat standardit tarjoavat jo ohjeistusta. Mutta perinteiset valvontamekanismit on yhdistettävä käyttäytymisen näkyvyyden ja tiedon kanssa – käskyhistoria, autonomiset toimet ja koordinaatiomallit – erottamaan väärinkäytön, hyödyntämisen ja systeemisen epäonnistumisen osana tehokasta tekoälyriskien hallintaa.

Tämä ei ole hidastamassa omaksumista. Se on tekemässä autonomiasta hallitettavaa ilman innovaation ja nopeuden heikentämistä.

Johtopäätös

Salaliitto muuttaa sisäisen riskilaskelman. Kun tekoälyagentit voivat vahvistaa toistensa käyttäytymistä, riski siirtyy eristetyistä toimista jaettuun valtuutukseen, vaikutukseen ja vahvistamiseen.

Turvallisuusaltistuminen ilmenee nyt vuorovaikutuskerroksessa, jossa legitimi pääsy, valtuutus ja salaliitto leikkaavat toisiaan. Valvontamekanismit, jotka on suunniteltu arvioimaan yksittäistä toimintaa, eivät havaitse virheitä, jotka ilmenevät ainoastaan, kun käyttäytyminen yhdistyy.

Organisaatiot, jotka hallitsevat tekoälyagenteja sisäisenä – käyttäytymisen näkyvyyden ja vastuun kanssa – voivat laajentaa tekoälyagenttien käyttöä luottavaisesti. Ne, jotka eivät tee niin, jäävät reagoimaan tuloksiin, joita he eivät enää täysin hallitse.