Andersonin kulma

Käyttäen ‘todennäköisyyttä’ deepfake-havaitsemisen mittarina

Jos AI:lla generoitu video ja ääni ovat tarpeeksi hyviä, deepfake-havainnoitsijat, jotka perustuvat visuaalisiin virheisiin tai muihin perinteisiin signaaleihin, eivät toimi enää. Mutta koska ihmiset harvoin poikkeavat ennustettavasta käyttäytymisestä, ehkä ‘todennäköisyys’ voitaisiin omaksua syvemmin signaaliksi siitä, onko video tai uutisten kuiskausta todennäköisesti totta.

Mielipide 1990-luvun alussa kunnioitettu entinen brittiläinen jalkapalloilija ja TV-urheilukommentaattori David Icke paljasti chat-ohjelmassa, että hän on ‘Jumalan poika’ – outo ja odottamaton paljastus, joka kehittyisi seuraavien vuosikymmenien aikana pysyväksi ja laajaksi salaliittoteoriaksi salaisesta ja voimakkaasta globaalista ‘liskoihmisten’ salaliitosta.

Internetin käyttöönotto oli vielä useita vuosia eteenpäin, ja sosiaalisen median saapuminen oli vielä kauempana tulevaisuudessa, ja Icken julkisuuskuvan ja hänen uusien näkemystensä välisen suuren ristiriidan vaikutus brittiläiseen yleisöön oli syvä – ei vähiten sen takia, että siinä ei ollut minkäänlaista asiayhteyttä tai valmistelua tästä suuresta käänteestä, josta tuli tunnettu urheiluhenkilö.

Yli kaksikymmentä vuotta myöhemmin samanlainen ja paljon synkempi muoto tästä sosiaalisesta shokista tapahtui, kun rakastettu hyväntekeväisyyden kampanjoitsija ja lasten TV-isäntä Jimmy Savile paljastui postuumasti sarjarikolliseksi ja ahneeksi elinikäiseksi seksuaalirikolliseksi, joka oli käyttänyt viattoman julkisuuskuvansa rikosten helpottamiseen.

Seuraava Operation Yewtree -poliisitutkinta paljasti useita muita brittiläisiä julkisuuden henkilöitä, joilla oli pitkät seksuaalirikosten historiat; myöhemmin Harvey Weinsteinin syyte johti samanlaiseen julkisuuden henkilöiden seksuaalirikollisten löytymiseen Yhdysvalloissa, mikä kehittyi #metoo-liikkeeksi ja vakiintui pysyvästi amerikkalaiseen kulttuuriin esimerkiksi The Morning Show -ohjelmissa. ‘Shokkiuutiset’ näyttivät kehittyvän uuden ja äkkinäisen mallin mukaan – yhden, josta deepfake-hyökkääjät lopulta omaksuisivat.

Perinteisen deepfake-havaitsemisen loppu?

Vaikka sosiaalinen media ja tekoäly olisivat olleet olemassa 1990-luvun alussa, mikään ennustejärjestelmä maailmassa ei olisi voinut ennustaa Icken chat-ohjelman paljastuksia, jotka (niin kuin muistan hyvin) eivät olleet millään tavoin ennakoiden edellävuosina tapahtuneissa tapahtumissa.

Mutta jos tekoäly olisi ollut olemassa, se olisi saattanut viedä jonkin aikaa vakuuttaa laajempi yleisö siitä, etteivät Icken ilmoitukset olleet Google Veo 3:n tai jonkin uuden sukupolven hyperrealistisen ääni/tallennetta deepfake-kehyksen tuotetta.

Vasta viimeisten 6-12 kuukauden aikana tekoälydeepfake-menetelmät ovat kehittyneet tarpeeksi tehokkaiksi täyttämään vuosien ajan medialle esitetyt varoitukset deepfake-vaalien häirinnästä, ja pystyvät luomaan sellaisen nopean maineen tahraaman, joka on valhe, mutta jota on vaikea kitkeä yhä uskollisemmassa kulttuurissa.

Toistaiseksi tekoälyvideotuotannon todellinen realisminsaavutus jää lyhyeksi teknisistä esteistä johtuen ja polarisoituu yhä enemmän länsimaisen mallin ja Kiinan sensuroimattoman avoimen lähdekoodin julkaisujen välisen kasvavan kuilun vuoksi**.

Kuitenkin huomaan yhä enemmän tutkimuskirjallisuudessa lähestyvän myönnytyksen tätä kylmää sotaa, esimerkiksi uudessa tutkimuksessa Performance Decay in Deepfake Detection†:

‘[Me] oletamme, että deepfake-videot sisältävät koneoppimiseen perustuvia piirteitä, jotka erottavat ne aidoista videoista. Tekoälyn generatiivisten kykyjen nopean edetessä tämä oletus saattaa romahtaa.

‘Tällaisessa skenaariossa vesileimat ja muut alkuperän seurantamenetelmät tarjoavat ainoan keinon digitaalisen median luotettavuuden ylläpitämiseksi.’

Kuitenkin sama tutkimus myöntää, että alkuperään perustuvat ratkaisut, kuten Adoben johtama Content Authenticity Initiative (ja monet pienemmät tutkimus tarjontaa viimeisten 7-8 vuoden aikana) vaativat laajaa käyttöönottoa, joka on epärealistista; ja tutkimus päättyy yleiseen muistiinpanoon, jossa peräännytään, ellei antauduta.

Jos audiovisuaaliset deepfake-havainnontamenetelmät kehittyvät tekoälygeneraattorien ylittämiksi, ja maailmanlaajuinen vesileimo- tai alkuperäjärjestelmän käyttöönotto epäonnistuu moninaisissa logistisissa esteissä, mikä yhteinen keskeinen piirre voisi korvata ne mahdollisesti väärennetyn tulosteen osoittimina? Tai onko meidän pakko antautua maailmaan, jossa kaikki media on epäilyksen alaisena, ja Liar’s Dividend vallitsee?

Tietoverkot

Näyttää siltä, että on aika hyödyntää todennäköisyys ja uskomuksellisuus ‘ilmoitettujen tapahtumien’ signaaliominaisuutena deepfake-havainnossa. Lisäksi, koska video- ja ääni-aihegeneraattorijärjestelmät ovat yhä enemmän konvergoitumassa, saattaa olla aika yhdistää ‘väärennetyt uutiset’ (tekstipohjaisen kerronnan tapahtuma) ja väärennetty kuvan/videon erilliset tutkimussuunnat.

Todennäköisyys deepfake-mittari ei ole sama kuin RAG-avusteinen tosi-tarkistus, jossa tekoälymalli voi tuoda nykyisiä verkkotuloksia tietoisuuteen tapahtumista, jotka tapahtuvat sen oman loppumisajankohdan jälkeen, ja/tai vahvistaa sen väitteitä.

Sen sijaan se suorittaa ennusteita yleisesti osoittavien tilastollisten trendien perusteella, jotka perustuvat historiallisiin malleihin, jotka noudattavat nykyistä kyselyä.

Tässä mielessä todennäköisyysmenetelmä on lähempänä tilastollista analyysiä kuin nykyisemmät lähestymistavat tekoälyalan nykyisessä tilassa.

Vaikka aiemmin pimentyneet nykyisemmistä Transformers-ajan lähestymistavoista, tietoverkot tekevät jonkinlaista paluuta yritysmaailmassa, ja ne näyttävät soveltuvan ‘todennäköisyysmittarien’ käyttöönottoon deepfake-havainnossa.

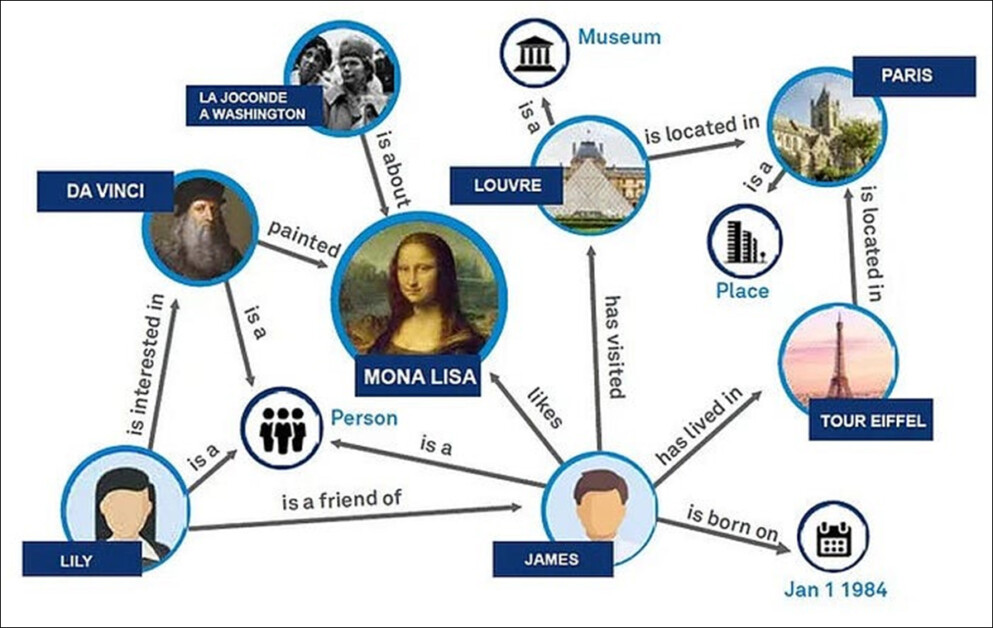

Yksinkertaistettu tietoverkko, joka osoittaa, miten ihmiset, paikat, taide ja tapahtumat voivat olla kytkettyjä merkittyjen suhteiden kautta, mahdollistaen koneiden päättelyä todellisista entiteeteistä ja niiden yhteyksistä. Lähde

Tietoverkko on tapa järjestää tietoa karttamalla todellisen maailman asioita, kuten ihmisiä, yrityksiä, tapahtumia tai ideoita, yhteydenverkkoon.

Jokainen alayksikkö on solmu, ja niiden (reunojen) väliset yhteydet kuvaavat, miten ne liittyvät toisiinsa. Esimerkiksi ‘Microsoft’ (solmu) voi olla linkitetty ‘OpenAI’:hin (toiseen solmuun) reunalla, joka sanoo ‘on OpenAI:n asiakas’. Nämä yhteydet tallennetaan usein graafitietokannoissa ja noudattavat aihe-predikaatti-objektin rakennetta, kuten ‘Microsoft on OpenAI:n asiakas’.

Pysyvä muisti

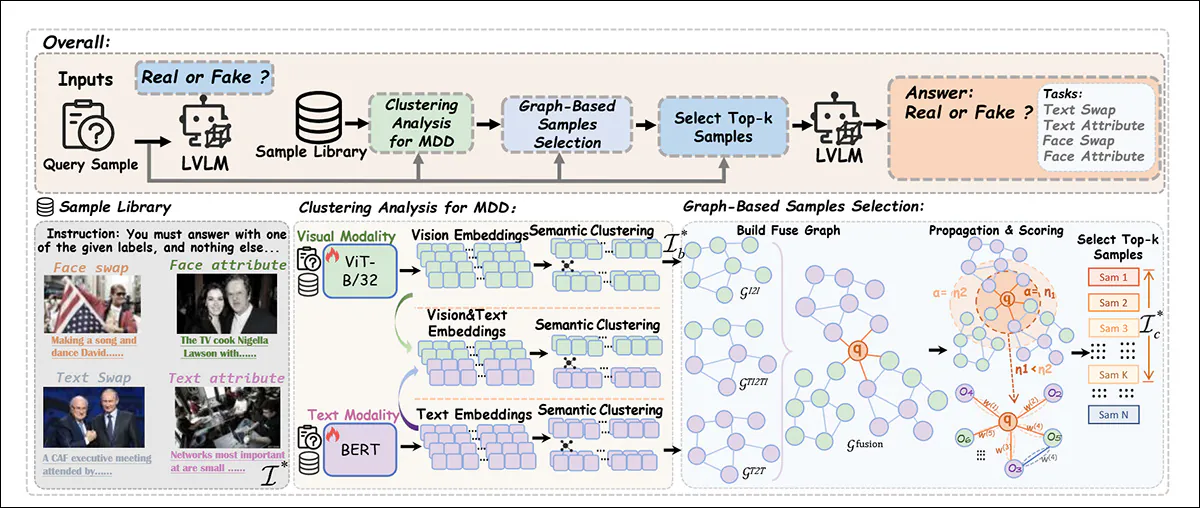

Yksi kiinalainen tutkimus tästä vuodesta ehdotti koulutusvapaata menetelmää, joka käyttää graafiperustaisia päättelyjä havaitsemaan hienoja epäjohdonmukaisuuksia monimodaalisissa deepfakeissa.

Sen sijaan, että luotaisiin perusteita tai hienosäädetään suuria malleja, järjestelmä hakee kuva-/teksti-pareja, rakentaa samankaltaisuusgrafiikan ja arvioi yhteyksiä, jotta voidaan hakea merkittävimmät esimerkit, ja ne ohjaavat mallin arviointia ilman uuden koulutuksen tarvetta:

GASP-ICL-kehyksen yleiskatsaus, joka parantaa deepfake-havaintoa yhdistämällä graafiperustaisen näytenvalinnan kontekstissä olevaan oppimiseen, mahdollistaen jäädytetyn visio-kieli-mallin luokitella kuva-/teksti-pareja aidoiksi tai väärennetyiksi ilman koulutusta tai hienosäätöä. Lähde Lähde

Tämä on luultavasti lähinnä oleva työ, joka on ylittänyt tieni, joka on lähellä ‘tietoista’ ja historiasta tietoista lähestymistapaa uuden median arvioinnissa ja vahvistamisessa.

Tietokoneen näkölähestymistavat jatkavat edelleen kuvien analyysiä (mukaan lukien videoiden kehykset ja ajalliset anomaaliat, jotka kattavat useita kehyksiä) kun taas ‘väärennetyt uutiset’ -havainnontajärjestelmät jatkavat korostamista tekstipohjaisia tietoja, jopa monimodaalisissa projekteissa.

Ominaisuuden laajentuminen

Tällaisen ennustusjärjestelmän haaste on valvonnan laajuus, joka saattaa olla tarpeen tehdäkseen lähestymistavan täysin suorituskykyiseksi – ainakin siinä määrin, että se ylittää julkisuuden henkilöiden ja julkisuuden analyysin, joista on jo olemassa vapaasti saatavilla olevaa tietoa.

Luultavasti lähin nykyinen tutkimussuunta on ennakkorikos -kenttä, joka merkitsee moninaisia monimodaalisia älysignaaleja ‘epäilyttäviksi’ ja esittää itsensä tekoälypelottimena esityksissä kuten Jonathan Nolanin Person of Interest (2011-2016) ja Steven Spielbergin Minority Report (2002).

Vaikka Person of Interest -tyyppinen kaikenkattava valvontajärjestelmä tuottaisi optimaalisen tuloksen, on epätodennäköistä, että länsimainen kulttuuri voisi hyväksyä henkilökohtaisen tunkeutumisen tasoa, jonka Kiinan sisäverkot asettavat kansalaisilleen.

Siksi mahdollisten väärennettyjen uutisten osalta ei-julkisuuden henkilöistä, ainoastaan viranomaiset, kuten poliisi (sekä syntymä- ja kuolemanrekisterit ja verovirastot), voisivat olla tarpeeksi merkityksellistä historiallista tietoa, jotta voisi muodostaa todennäköisyyksiä graafisessa työvirrassa; ja heidänkin pitäisi olla Kiinan kommunistisen puolueen tyyppinen tahto, kyky, lainsäädäntö ja resurssit sisällyttääksesi keskivertokansalaiset kattavuuteen ja analyyseihin (ts. yksinkertaisista mutta pakollisista tietopisteistä, kuten passinumeroista ja auton rekisteröintitunnuksista).

Todennäköisyyspisteet

Näyttää todennäköiseltä, että tällaisen järjestelmän mahdollinen tehokkuus rajoittuisi selvästi (nykyisiin) deepfake-sisällön käyttötapauksiin: destabilisointi (valtion tukemat deepfakes); julkisuuden henkilöiden ja ‘tuntemattomien’ pornodeepfakes (jotka molemmat voidaan pitää pahantahtoisina, vaikka jälkimmäinen tapaus houkuttelee syvempää mediahuomiota); petos (mukaan lukien ääni-/videodeepfakes, jotka on suunniteltu suorittamaan ‘impersonaatio ryöstöt’); ja poliittinen luonnetappo.

Tietopohjainen järjestelmä tarvitsisi todennäköisyysskaalan moninaisten mahdollisten tapahtumien luomiseksi. Toisessa päässä spektrissä yleiset inhimilliset heikkoudet, kuten kyseenalainen taloudellinen johtaminen, uskottomuus, riippuvuus, huolimattomuus jne.; toisessa päässä… paljastaa, että olet Jumalan poika suorassa TV-keskustelussa (tai tapahtumat, jotka ovat saman mittakaavan ja vaikutuksen mukaisia).

Jopa jälkimmäisessä tapauksessa yksilökohtaiset historialliset tekijät kunkin yksilön kohdalla painottaisivat todennäköisyystulosta: merkittävä poliittinen hahmo, joka on julkisesti epäröinyt kiistanalaisissa asioissa (kuten Kuun laskeutumisen 1960- ja 1970-luvuilla totuudenmukaisuudesta) päästäkseen pääomaa yhä enenevössä ‘vaihtoehtoisesti’ informoidulla vaalipiirillä, saisi lisää wildcard -tilaa vahvistamisessa verrattuna hänen hillitympään vastineisiinsa.

Julkisuuden henkilöiden pornon tapauksessa on riittävästi todellista asiayhteyttä (ts. julkisuuden henkilöiden valokuvavuodot vuonna 2012 ja muut – melko harvat – tapaukset) luomaan kohtuullisen Liar’s Dividend tietyissä asiayhteyksissä; mutta koska nämä poikkeustapaukset toimivat poikkeuksina, jotka osoittavat säännön, suurin osa nykyisistä diffuusiopohjaisista julkisuuden henkilöiden pornovideoista olisi hyvin ‘epätodennäköistä’ (vaikka se ei ratkaise ongelmaa henkilöllisyyden omimisesta tällaisiin tarkoituksiin).

Kansallisen häirinnän osalta on merkittävä määrä tilastollista dataa, joka voi auttaa arvioimaan ‘katastrofaalisten’ raporttien todennäköisyyttä. Jopa antiikin historiassa näyttää siltä, että ‘yllättävät’ tapahtumat, kuten tuntemattoman tulivuoren Vesuviuksen purkaus vuonna 79, olivat ennakkoilmoitettuja, jos olisi kiinnittänyt tarpeeksi huomiota; ja lisäksi hallituksen ja kansalaisjärjestöjen tukemien syötteiden saatavuuden lisäksi tekoälyn kehittyvä kyky järjestää rakenne raakadatasta voi tarjota lisää historiallista asiayhteyttä todennäköisyyspisteytykseen.

Johtopäätös

Jopa hyvin toteutettu ennustusjärjestelmä ei voisi ottaa huomioon satunnaisuutta, Jumalan tekoja, outoja ilmiöitä tai pahantahtoisia tapahtumia, jotka on keksitty valvonnan ulottumattomissa.

Lisäksi tarvittavan datan laajuus ja syvyys, jotta voidaan tarjota myös ei-julkisuuden henkilöille, olisi poliittinen este – ainakin toistaiseksi.

Kuitenkin valinnat näyttävät kaventuvan; visuaalinen analyysi on valmis epäonnistumaan tekoälyn generatiivisten kykyjen edessä, kun taas vahvistus- ja alkuperäjärjestelmät kantavat estettävän teknisen velan ja kitkaa käyttöönotossa. Tämä tekee ratkaisuista, kuten Unite.AI:sta, Content Authenticity Initiative ja keskeneräinen Metaphysic.ai -kasvonsuojausjärjestelmä Metaphysic Pro, haasteellisiksi niiden laajamittaiseksi käyttöönotoksi.

Niiden laajimmassa käytössä RAG-pohjaiset järjestelmät voivat vain määrittää, onko virallinen lähde, joka tukee vahvistamattoman väitteen; ja koska monet suuret (totuudelliset) uutiset ilmestyvät ilman aiempaa asiayhteyttä, viranomaisten lähteiden puute ei välttämättä ole merkityksellistä.

Niiden arvo voi osoittautua suuremmaksi, jos ne voivat muodostaa osan laajempaa tietoekosysteemiä, joka koskee yhtä asiaa, joka on tekoälylle haasteellista – historiallinen asiayhteys.

* Ei tule sekoittaa varhaisiin autoencoder -ilmaisiin, jotka debytoivat vuonna 2017 ja lopulta korvattiin paremmilla lähestymistavoilla.

† https://arxiv.org/abs/2511.07009

** Jotka voivat yleensä toimia vapaasti tehokkaammilla kotitietokoneilla, eivätkä ole saatavilla ainoastaan portaiden takana olevien API-rajapintojen kautta, kuten ChatGPT ja Veo-sarja.

††† Poistamatta laillisia viihdekäyttöjä, kuten ammattimaisia visuaalisia tehosteita elokuva- ja TV-tuotannoissa.

Julkaistu ensimmäisen kerran torstaina 13. marraskuuta 2025