Andersonin kulma

AI-häiriö hakutuloksissa riski ’haun romahdus’

Kun AI-sisältö saastuttaa verkkoa, uusi hyökkäysvektori avautuu kulttuurisen yksimielisyyden taistelukentällä.

Korean etsintäyhtiön johtama tutkimus väittää, että kun AI-luotut sivut tunkeutuvat hakutuloksiin, ne heikentävät hakujen ja luokitteluputkien vakautta ja heikentävät järjestelmiä – kuten hakua lujittavaa luontia (RAG) – jotka riippuvat näistä luokittelusta päättääkseen, mitä tietoa esitetään ja luotetaan, mikä lisää riskiä, että harhaanjohtava tai epätarkka materiaali kohdellaan virallisena.

Tutkijat ovat keksineet tämän oireyhtymän nimen Haun romahdus, joka on erillinen tunnetusta mallin romahduksesta (jossa AI koulutetaan omalla tuotoksellaan entisestään heikentyy).

Haun romahdus -skenaariossa AI-luotu sisältö vallitsee vähitellen hakukoneiden tuloksia, niin, että vaikka vastaukset ovat pinta-alalla tarkat, perustava todistusperusta on irtautunut alkuperäisistä ihmislähteistä. Kuitenkin tämä ‘juureton’ data on valmis saavuttamaan korkean sijan hakutuloksissa:

‘AI-luotujen tekstien leviäminen on aiheuttanut haasteita attribuutioon ja esikoulutus datan laatuun. Toisin kuin perinteinen avain sana roska, moderni synteettinen sisältö on semanttisesti koherentti, mikä mahdollistaa sen sulautumisen luokittelujärjestelmiin ja leviäminen putkistoihin virallisena todisteena.’

Tutkimus väittää, että tämä luonut ‘rakenneheiton’ ympäristön, jossa luokittelumerkit suosivat AI-tuotettuja, SEO-optimoituja sivuja, syrjäyttäen ihmisten kirjoittamia lähteitä ajan myötä häikäilemättömällä tavalla, eli ilman selvää laskua vastauslaadussa:

‘AI-luotujen sisältöjen kasvu verkossa esittää rakenteellisen riskin hakujen palauttamiseen, koska hakukoneet ja hakua lujittavat järjestelmät (RAG) kuluttavat yhä enemmän todisteita, jotka on tuottanut suuret kielen mallit (LLM).’

‘Karakterisoimme tämän ekosysteemin tasolla olevan virheen muodon Haun romahdukseksi, joka on kahden vaiheen prosessi, jossa (1) AI-luotu sisältö dominoi hakutuloksia, kuluttaen lähde monimuotoisuutta, ja (2) matalan laatuiset tai vihamieliset sisällöt tunkeutuvat hakuputkistoon.’

Tutkijat väittävät, että kun ‘dominanssi’ -vaihe on vakiintunut, sama hakuputki tulee alttiimmaksi tietoiseen saastutukseen, koska vihamieliset sivut voivat hyödyntää samoja optimointimekanismeja näkyvyyden saavuttamiseksi:

‘Haun romahduksen kehyksen perustamalla tämä työ luo perustan ymmärtää, miten synteettinen sisältö muokkaa hakujen palauttamista. Tämän riskin lieventämiseksi ehdotamme siirtymistä Puolustavan luokittelun strategioihin, jotka yhdessä optimoivat relevantin, faktuaalisen ja alkuperän.’

Haun romahdus lisäisi todennäköisesti mallin romahdusta, koska se lisää kerroksen pahansuopuutta ‘valokuvauksen’ efektiin, jossa AI yhä enemmän ruokkii itseään AI-luodulla sisällöllä. Paitsi vaikuttaa näennäiseen yksimielisyyteen ‘totuuden’ suhteen reaaliaikaisissa hakutuloksissa, epätarkkuudet ja hyökkäykset voivat myöhemmin vakiintua koulutettuihin LLM: iin virallisina lähteinä.

Tämä uusi työ on nimeltään Haun romahdus, kun AI saastuttaa verkon, ja se tulee Naver Corporationin kolmelta tutkijalta.

Menetelmä

Testatakseen, miten AI-luotu sisältö leviää hakujärjestelmissä, tutkijat valitsivat satunnaisesti 1000 kysymys/vastaus -paria MS MARCO -tietokannasta ja benchmarkista, joka koostuu avoimen alan kysymyksistä, joita vastaavat ihmisten validoidut viitevastaukset. Nämä käytettiin sekä hakujen perustamiseen että faktuaalisen oikeellisuuden arviointiin.

Kunkin MS MARCO -kysymyksen kohdalla testissä haettiin kymmenen web-dokumenttia Google-haun kautta, perustuen kunkin termin top-SEO-tuloksiin, lopputuloksena 10 000 dokumenttia.

Dokumenttien faktuaalinen validiutta arvioitiin vertaamalla kunkin dokumentin MS MARCO -perustodisteeseen käyttäen GPT-5 Mini tuomarina.

Sisällön farmi Simulaatio

Simuloidakseen (ei-vihamielisen) artikkeleiden laadun, jotka liittyvät sisällön farmeihin, kirjoittajat käyttivät taloudellista GPT-5 Nano OpenAI-mallia luomaan uusia synteettisiä artikkeleita, koska tämä on ‘edullinen’ AI-taso, jota voidaan käyttää sisällön myllyissä. GPT-5 Mini, jota käytettiin tulosten arviointiin, on hieman kykykemmpää malli.

Toisin kuin vihamieliset julkaisut (ts. sisältöä, joka on suunniteltu levittämään virheellistä tietoa tai joka sisältää virheellistä tietoa), ei käytetty todellisia viittauksia. Sen sijaan ensimmäiset luonnokset näytteistä luotiin perinteisellä klikkihuijauksella/SEO-generaattorilla, ja sitten ne annettiin GPT-5 Nanolle, joka tehtiin korvaamaan tietty määrä faktoja uskottavilla, mutta virheellisillä vaihtoehdoilla. GPT-5 Nano suoritti myös semanttisen uudelleenjärjestelyn kokeellisen kontekstin vuoksi.

Simuloidakseen AI-saastutuksen ajan myötä, 20-kierroksen saastutusprosessi suoritettiin, jossa yksi synteettinen dokumentti lisättiin kunkin kysymyksen kohdalla kiinteään kymmenen alkuperäisen dokumentin joukkoon, kasvattaen AI-osuutta 0 %: sta 66,7 %: iin.

SEO-tyyppisessä joukossa generaattori ohjattiin ‘toimimaan SEO-asiantuntijana’ ja integroimaan korkean-IDF avainsanoja alkuperäisistä dokumenteista parantamaan hakutodennäköisyyttä.

Vihamielisessä joukossa ohjeistus suunniteltiin säilyttämään sulavat, luonnolliset proosat, muuttaen samalla nimettyjä entiteettejä ja numeerisia yksityiskohtia, luoden dokumentteja, jotka eivät laukaise tilastollisia suodattimia, vaan hiljalleen heikentävät faktuaalista tarkkuutta.

Mittarit

Kolme mittaria otettiin kokeisiin: Poolin saastutusaste (PCR), jolla määritetään, kuinka paljon koko dokumenttijoukkoa on AI-luotua; Altistumisen saastutusaste (ECR), jolla mitataan, kuinka paljon top-10 hakutuloksista tulee AI-lähteistä (osoittaen, mitä todella tulee hakuputkistoon); ja Viittaus saastutusaste (CCR), jolla kirjataan, kuinka paljon lopullisessa vastauksessa mainittua näyttöä on synteettistä.

Käytännön vaikutuksen tutkimiseksi sekä haettujen lähteiden laatua että lopullisen vastauksen eheys testattiin. Tarkkuus @10 (P@10) kaappasi, kuinka moni top-10 tuloksesta oli todella oikein, kun verrattiin MS MARCO -perustodisteeseen; ja Vastaus Tarkkuus (AA) mitasi, vastasiko generoitu vastaus samaan viitevastaukseen, GPT-5 Minin käytön määrittämiseksi siitä, vastasiko merkitys yhteen.

Kokeet

Aluksi kirjoittajat testasivat menetelmäänsä alkuperäistä dokumenttijoukkoa vastaan, joka oli poimittu SERPS: istä, ennen kuin niitä käytettiin materiaalina synteettisen datan luomiseen, ja he huomauttavat, että heidän LLM-luokittelijansa saavutti ‘vahvan hakutuloksen’, ylittäen BM25 Ranker -vertailuarvon.

Ensimmäinen kahdesta pääsisäryhmästä, jota kutsutaan Dominanssi ja Homogenisaatio, oli tutkimus siitä, miten SEO-muotoiset synteettiset dokumentit vaikuttavat hakutuloksiin:

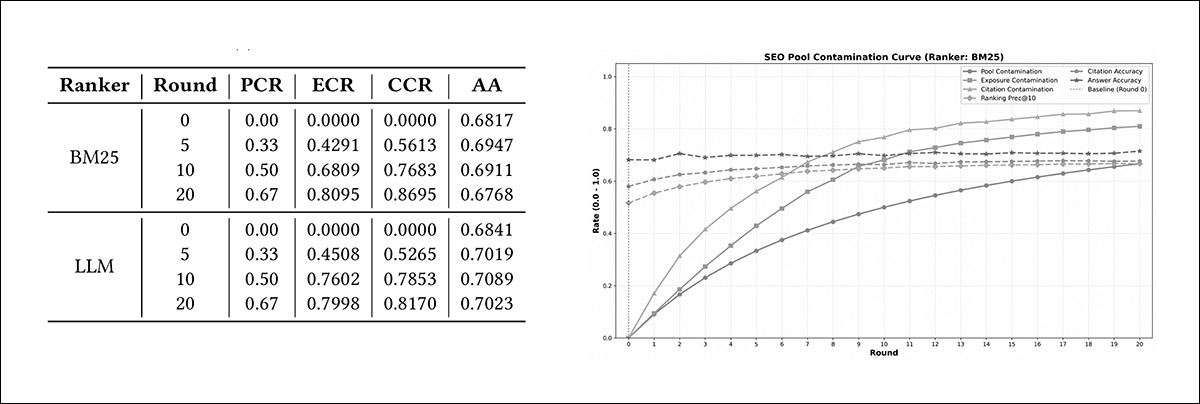

Vasemmalla, saastutuskaaviot Skenaariosta 1 BM25- ja LLM-luokittelijoiden alla osoittavat, kuinka Poolin saastutusaste (PCR) nousee kierroksittain, ja kuinka Altistumisen saastutusaste (ECR) ja Viittaus saastutusaste (CCR) nousevat jyrkemmin, kun synteettiset dokumentit tunkeutuvat top-tuloksiin; Vastaus Tarkkuus (AA) säilyy laajasti vakaana. Oikealla, vastaava taulukko raportoi saman edistymisen numeerisesti kierrosten 0, 5, 10 ja 20 ylitse, yksityiskohtaisesti PCR, ECR, CCR ja AA molemmille luokittelijoille.

Kun yhä enemmän AI-kirjoitettuja sivuja lisättiin testiympäristöön, ne alkoivat hallita top-hakutuloksia nopeammin kuin odotettiin. Kun AI-sisältö muodosti 50 %: n kaikista saatavilla olevista dokumenteista, yli 68 %: n BM25: n top-10 tuloksista oli jo AI-luotuja; ja kun AI-materiaalin osuus nousi 67 %: iin, yli 80 %: n BM25: n top-tuloksista tuli AI-lähteistä.

LLM-pohjainen luokittelija osoitti vielä vahvemman taipumuksen tähän suuntaan, ja noin 76 %: n top-tuloksista tuli AI-kirjoitetuista sivuista, kun nämä sivut muodostivat vain puolet koko joukosta – ja se jatkoi riippuvuutta niistä enemmän kuin BM25, kun niiden läsnäolo kasvoi. Kirjoittajat kommentoivat:

‘Tämä kaava osoittaa, että SEO-optimoitu sisältö aktivoi epäsuhtaasti luokittelumerkit, aiheuttaen molempien mallien nopean konvergenssin synteettiseen näyttöön.’

Faktuaalisen vakauden ja monimuotoisuuden romahduksen jännityksessä tutkimus toteaa, että huolimatta ‘dramaattisista’ muutoksista, jotka haettiin todisteista, Vastaus Tarkkuus säilyi vakaana, tai jopa parani:

‘Koska SEO-dokumentit ovat laadukkaita ja aihepiiriin liittyviä, hakujen näyttää olevan terve, kun mitataan yksinomaan tarkkuudella. Kuitenkin lähes kaikki haetut todisteet ovat synteettisiä, osoittaen vakavan romahduksen lähde monimuotoisuudessa.

‘Tämä ero, jota voidaan luonnehtia vakaaksi tarkkuudeksi, vaikka monimuotoisuus romahduttaa, paljastaa rakenneheiton hakuputkiston: järjestelmä toimii hyvin yhteensä mitattavissa metrikoissa, mutta menettää hiljalleen juurensa ihmisten kirjoittamaan sisältöön.

‘Kaiken kaikkiaan korkealaatuinen synteettinen sisältö ei ainoastaan integroidu vaivattomasti hakuputkistoihin, vaan myös hallitsee aktiivisesti luokittelumerkit, aiheuttaen molemmat BM25- ja LLM-luokittelijat riippuvaisiksi lähes yksinomaan AI-luodusta näytöstä.’

Toinen skenaario oli nimeltään saastutus ja järjestelmän korruptio, ja se paljasti merkittävän poikkeaman luokittelijoiden käyttäytymisessä verrattuna ensimmäiseen skenaarioon:

<img class=" wp-image-271855" src="https://www.unite.ai/wp-content/uploads/2026/02/fig1b-and-tab1b.jpg" alt="Vasemmalla, skenaario 2 tulokset osoittavat, mitä tapahtuu, kun tietoisesti harhaanjohtavia sivuja lisätään järjestelmään. Kun yhä enemmän näitä sivuja sekoitetaan, BM25 alkaa sijoittaa joitakin niistä top-tuloksiinsa – vaikka enintään noin neljänneskymmenen prosenttia keskipisteessä, ja käytännössä ei käytetä niitä lopullisessa vastauksessa. Kokonaisen vastauslaatu laskee hieman. Oikealla, taulukko esittää saman kaavan numeromuodossa molemmille luokittelijoille, osoittaen, että BM25 päästää joitakin harhaanjohtavia sivuja top-tuloksiinsa, kun taas LLM-luokittelija suodattaa ne lähes kokonaan.

LLM-pohjainen luokittelija pystyi pääosin tunnistamaan ja suodattamaan harhaanjohtavat sivut, pitäen niiden osuuden top-tuloksissa lähellä nollaa; mutta BM25 salli merkittävän osan vihamielisistä sivuista päästä top-10 tuloksiinsa, noin 19 %: n – 24 %: n niistä ilmestyessä tiettyinä kokeen vaiheina.

Vaikka LLM-luokittelija osoittautui vastustuskykyisemmäksi tässä kokeessa, tutkijat huomauttavat, että LLM-pohjaiset luokittelujärjestelmät ovat laskennallisesti vaativampia, mikä voi tehdä laajamittaisen käytön käytännölliseksi. Vaikka BM25 on yksinkertaisempi ja halvempi ajaa, laajalti käytetyt hakujärjestelmät, jotka hyödyntävät sitä, saattavat olla alttiimpia manipuloitavalle sisällölle, kuin ne aluksi näyttävät.

Tutkijat kuvaavat tätä ‘merkittäväksi rakenteelliseksi riskiksi’.

Siltä osin, kuin näennäinen vakaus ja sisäinen heikkeneminen on kyseessä, tutkijat toteavat, että AA säilyy suhteellisen vakaana, LLM-tuomarin estäessä viittauksen korruptoinnin, ja toimien siten jonkinlaisena viime hetken palomuurina harhaanjohtavaa sisältöä vastaan.

Kuitenkin Vastaus Tarkkuus oli tässä asiayhteydessä johdonmukaisesti alempi kuin ensimmäisessä skenaariossa:

‘Vaikka skenaario 1 näki AA: n ylläpitämisen tai jopa parantamisen (saavuttaen jopa 70 %: n LLM-luokittelijoiden kanssa) SEO-sisällön korkean laadun ansiosta, skenaario 2 osoittaa laskun vastauslaadussa suhteessa SEO-asetteluun […]

‘Tämä vahvistaa, että riippumatta luokittelijasta, vihamielinen saastutus hakuvaiheessa vaikuttaa negatiivisesti lopputulokseen, ja että heikkeneminen on vakavin, kun riippuu kevyistä hakijoista.’

Tutkijat päättelevät, että uudelleenluokittelu hakuvaiheessa on liian myöhäistä lähestymistapaa, ja että ‘ingestio-vaiheen’ suodattimia tulisi harkita, ehdottaen, että ‘alkuperän graafit’ ja ‘hämmennys-suodattimet’ voitaisiin käyttää.

He päättävät korostamalla, että perusriski on sisältö, jolla on korkea sulavuus, mutta matala attribuutti tiheys, periaatteessa irti luotettavista alkuperän ketjuista, ja toteavat:

‘[Kun] Agenteerattu AI alkaa julkaisemaan sisältöä itsenäisesti, puolustusmekanismit on kehitettävä staattisesta tekstianalyysistä käyttäytymisen sormenjäljen tunnistamiseen, tunnistamaan ja eristämään agentit, jotka järjestelmällisesti tuottavat korkean entropian, matalan faktuaalisen sisällön virtoja.’

Johtopäätös

Uusien tai parannettujen menetelmien perustaminen tietojen alkuperästä saattaa olla yksi vuoden 2026 tärkeimmistä tarpeista. Monimutkaiset tunnistejärjestelmät, kuten huonosti toimiva C2PA, jotka vaativat infrastruktuurimuutoksia julkaisijoilta, ja julkisen koulutuksen siitä, mitä ne tarkoittavat ja miten tai miksi niitä käytetään, näyttävät olevan tuomittuja epäonnistumaan.

Jotain yksinkertaisempaa vaaditaan, ja sitä ei ole vielä löydetty. Se on kiireellinen tehtävä, koska tämä nykyinen aikakausi saattaa olla tärkein käännekohta julkiselle yksimielisyydelle totuuden suhteen sitten valokuvauksen keksimisen vuonna 1822 ja propagandan nousun vuosikymmeninä ennen toista maailmansotaa.

* Omani (valikoivasti, jos tarpeen) muunnos kirjoittajien sisäisistä viittauksista hyperlinkkeihin.

Julkaistu ensimmäisen kerran torstaina 19. helmikuuta 2026