Tekoäly

Supercharging Graph Neural Networks with Large Language Models: The Ultimate Guide

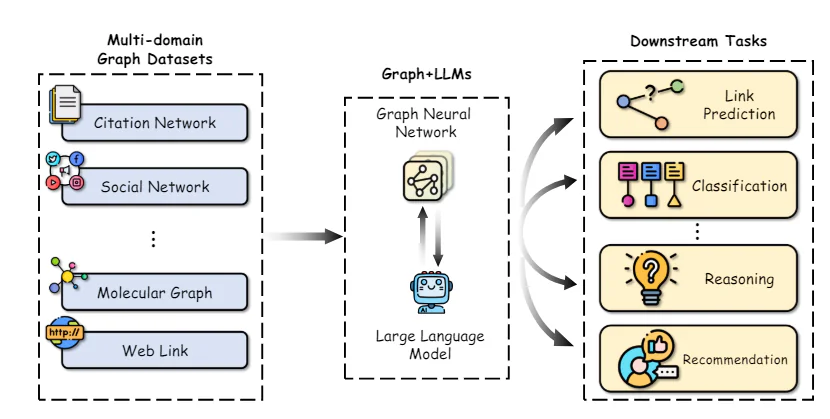

Graafit ovat tietorakenteita, jotka edustavat monimutkaisia suhteita laajalla alueella, mukaan lukien sosiaaliset verkostot, tietokannat, biologiset järjestelmät ja monet muut. Nämä graafit edustavat entiteettejä solmuina ja niiden suhteita reunoina.

Kyky edustaa ja päättää näistä monimutkaisista suhteellisista rakenteista on olennainen edistysten mahdollistamiseksi aloilla kuten verkkotiede, kemoinformatiikka ja suositussysteemit.

Graafi-neuraaliset verkot (GNN) ovat nousseet voimakkaaksi syvän oppimisen kehykseksi graafin koneoppimistehtävissä. Sisällyttämällä graafin topologian neuroverkkorakenteeseen naapuruusaggregoinnin tai graafikonvoluution kautta, GNN:t voivat oppia matalan dimensionaalisia vektoriesityksiä, jotka koodaavat sekä solmun ominaisuudet että niiden rakenteelliset roolit. Tämä mahdollistaa GNN:lle saavuttaa huipputason suorituskyky tehtävissä, kuten solmun luokittelu, linkin ennustaminen ja graafin luokittelu monilla soveltamisalueilla.

Vaikka GNN:t ovat edistäneet merkittävästi, jotkut avainhaasteet ovat edelleen olemassa. Laadukkaiden merkittyjen aineistojen hankkiminen valvotun GNN-mallin koulutukseen voi olla kallista ja aikaa vievää. Lisäksi GNN:t voivat kamppailla heterogeenisten graafirakenteiden ja tilanteiden kanssa, joissa graafin jakautuminen testiajalla poikkeaa merkittävästi koulutusaineistosta (jakautumisen yleistäminen).

Rinnakkain, suuret kielimallit (LLM) kuten GPT-4 ja LLaMA ovat saaneet maailman haltuunsa uskomattomilla luonnollisen kielen ymmärtämis- ja generointikapasiteeteillaan. Koulutettuina valtavilla tekstikorpuksilla, joissa on miljardeja parametreja, LLM:t näyttävät merkittäviä vähäiskotelo-oppimisen kykyjä, yleistämistä tehtävien välillä ja järkeilytaitoja, jotka olivat aikaisemmin hyvin haasteellisia tekoälyjärjestelmille.

LLMien merkittävä menestys on kiihdyttänyt tutkimusta hyödyntämään niiden voimaa graafin koneoppimistehtävissä. Toisaalta LLMien tieto- ja päättelykyky tarjoavat mahdollisuuksia parantaa perinteisiä GNN-malleja. Toisaalta graafien sisäinen edustus ja faktatieto voivat olla olennaisia LLMien joitain avainrajoituksien kuten hallucinaatioiden ja selittämättömyyden ratkaisemisessa.

Graafi-neuraaliset verkot ja itseohjautuva oppiminen

Tarjoaksemme tarvittavan kontekstin, tarkastelemme lyhyesti graafiverkkoihin ja itseohjautuvaan graafiesityksen oppimiseen liittyviä peruskäsitteitä ja menetelmiä.

Graafi-neuraalisen verkon arkkitehtuuri

Graafi-neuraalisen verkon arkkitehtuuri – lähde

Avainero perinteisten syvän oppimisen neuroverkkoihin ja GNN:ihin on heidän kykynsä toimia suoraan graafirakenteisilla tiedoilla. GNN:t noudattavat naapuruusaggregointia, jossa kunkin solmun ominaisuusvektorit kerätään naapureilta laskemaan sen oman edustuksen.

Useita GNN-arkkitehtuureja on ehdotettu erilaisilla viestintä- ja päivitysfunktioiden toteutuksilla, kuten Graafikonvoluutioverkot (GCN), GraphSAGE, Graafihuomioverkot (GAT) ja Graafisten isomorfismien verkot (GIN) muun muassa.

Viimeaikaisissa tutkimuksissa graafitransformatorit ovat saavuttaneet suosiota soveltamalla luonnollisen kielen transformaattorien itsehuomio-mekanismia graafirakenteisille tiedoille. Joitakin esimerkkejä ovat GraphormerTransformer ja GraphFormers. Nämä mallit pystyvät havainnoimaan pitkän aikavälin riippuvuuksia graafin yli paremmin kuin pelkästään naapuruusperusteiset GNN:t.

Itseohjautuva oppiminen graafeissa

Vaikka GNN:t ovat voimakkaita edustusmalleja, niiden suorituskyky on usein pullonkaula merkittynä heidän koulutukseensa vaadittavien suurten merkittyjen aineistojen puutteesta. Itseohjautuva oppiminen on lupaava kehys GNNien esikoulutukseen merkittymättömällä graafitiedolla hyödyntämällä tehtäviä, jotka vaativat ainoastaan intrinsic graafirakenteen ja solmuominaisuudet.

Itseohjautuva graafi – lähde

Jotkut yleiset tehtävät, joita käytetään GNNien itseohjautuvaan esikoulutukseen, ovat:

- Solmuominaisuuden ennustaminen: Satunnaisesti maskaamalla tai vahingoittamalla osaa solmuominaisuuksista ja tehtävänä on GNN:lle palauttaa ne.

- Reunan/linkin ennustaminen: Oppiminen ennustamaan, onko reuna olemassa solmuparissa, usein perustuen satunnaisiin reunaan maskauksiin.

- Vastakkainen oppiminen: Maksimoida samankaltaisuudet graafinäkymien välillä samasta graafinäytteestä ja työntää eri graafien näkymät erilleen.

- Vuorovaikutteisen tiedon maksimointi: Maksimoida vuorovaikutteista tietoa paikallisten solmuesitysten ja kohdesijaintia esittävän esityksen, kuten globaalin graafiesityksen, välillä.

Nämä tehtävät sallivat GNN:lle extrahoida merkityksellisiä rakenteellisia ja semanttisia malleja merkittymättömästä graafitiedosta esikoulutuksen aikana. Esikoulutettu GNN voidaan sitten hienosäätää suhteellisen pienillä merkityillä alijoukoilla menestyäkseen erilaisissa lopputöissä kuten solmun luokittelu, linkin ennustaminen ja graafin luokittelu.

Hyödyntämällä itseohjautuvuutta, GNN:t, jotka on esikoulutettu suurilla merkittymättömillä aineistoilla, näyttävät parempaa yleistettävyyttä, robustisuutta jakautumisen siirtymisiin ja tehokkuutta verrattuna kouluttamiseen alusta alkaen. Joitakin perinteisten GNN-pohjaisen itseohjautuvan menetelmän avainrajoituksia on kuitenkin edelleen olemassa, joita tarkastelemme seuraavaksi LLMien avulla.

Graafisen koneoppimisen parantaminen suurilla kielimalleilla

Graafien ja LLMien integrointi – lähde

LLMien merkittävät kyvyt luonnollisen kielen ymmärtämisessä, päättelyssä ja vähäiskotelossa tarjoavat mahdollisuuksia parantaa useita graafisen koneoppimisen prosessin osia. Tarkastelemme joitakin avain tutkimussuuntauksia tässä tilassa:

Yksi haaste soveltamisessa GNN:iä on saada korkealaatuiset piirteet solmuille ja reunoille, erityisesti kun ne sisältävät rikkaat tekstuaaliset attribuutit kuten kuvaukset, otsikot tai abstraktit. Perinteisesti on käytetty yksinkertaisia salkkuja tai esikoulutettuja sanasäilömallien, jotka usein epäonnistuvat sieppaamaan hienostuneet semantiikat.

Viimeaikaiset tutkimukset ovat osoittaneet LLMien voiman käytettäväksi tekstien koodareina parempien solmu-/reunapiirteiden rakentamiseksi ennen niiden siirtämistä GNN:lle. Esimerkiksi Chen et al. käyttävät LLM:iä kuten GPT-3:aa koodaamaan tekstuaalisia solmuattribuutteja, osoittaen merkittäviä suorituskyvyn parannuksia perinteisiin sana-esi-oppimismalleihin solmun luokittelutehtävissä.

LLMien käyttäminen parempina tekstikoodareina, ne voidaan käyttää myös lisättyjen tietojen generoimiseen alkuperäisistä tekstuaalisista attribuuteista puolivalvotulla tavalla. TAPE generoi potentiaalisia merkintöjä/selityksiä solmuille LLM:n avulla ja käyttää niitä lisättyinä piirteinä. KEA:sta poistetaan termit tekstuaalisista attribuuteista LLM:n avulla ja hankitaan yksityiskohtaiset kuvaukset niille piirteille.

Parantamalla syötteen piirteiden laatua ja ilmaisukykyä, LLM:t voivat siirtää heidän ylemmän luonnollisen kielen ymmärtämiskykynsä GNN:lle, parantaen suorituskykyä lopputöissä.