Andersonin kulma

Tekoäly jakaa verkkohaku kolmeen eri todellisuuteen

Uusi tutkimus osoittaa, että Google käyttää kolmea eri tietojärjestelmää omassa hakukuviossaan, ja että normaali haku, tekoäly-yhteenvetot ja Gemini suosivat eri lähteitä, luokitteluja ja sisältöjä.

Reduktionismi hallitsee. Viimeisen 12 kuukauden aikana ‘Anna minun googlettaa sen puolestasi’ -meme on korvattu uudella ‘Anna minun yhteenveda sen Google-haku puolestasi’ -trendillä, jossa tekoäly-yhteenvetot hakutuloksissa säästävät lukijoilta vaivaa klikkaamalla hakulinkkejä (joka voi olla perustelua lähde-sivujen rahoitukselle), tiivistämällä koko hakutuloksen muutamaan generoituun kappaleeseen.

Yksi voisi ajatella, että pinnalla oleva tieto ja valittujen sivustojen valinta olisivat suhteellisen samanlaisia kaikissa kolmessa suositussa tavassa etsiä tietoa internetistä: perinteisessä verkkohaussa; tekoäly-yhteenvetoissa (AIO), jotka nyt johtavat useimpien verkkohakutuloksia; ja kasvavan käytön kautta LLM:iä, kuten ChatGPT:ä, web-orakkeleina (joko ulkopuolisten RAG-kutsujen kanssa tai ilman).

Kuitenkin viimeaikaiset Yhdysvalloissa tehty tutkimus osoittaa, että tämä on yllättäen kaukana totuudesta; ja että jopa Google omassa kolmiykkössä orakkeleissa – SERPS*, AI-yhteenvetojen ja suoran vuorovaikutuksen kautta Gemini LLM -sarjan kanssa – on merkittäviä ja mielenkiintoisia eroja kussakin reitissä.

Kolmiykkö

Uudessa, selkeässä ja laajassa tutkimusraportissa, joka on nimeltään How Generative AI Disrupts Search: An Empirical Study of Google Search, Gemini, and AI Overviews, kuusi New Jersey Institute of Technologyn tutkijaa kuvaavat, miten kolme hakutapaa poikkeavat toisistaan ja tarjoavat joitakin mahdollisia teorioita näille murtumille lähestymistavassa.

Tutkimusraportti toteaa:

‘[Ensisijaisesti] havaitsemme, että 51,5 %:ssa edustavista, todellisista käyttäjien kysymyksistä, AIO:ta generoidaan ja ne näytetään organisten hakutulosten yläpuolella. Kiistanalaiset kysymykset johtavat usein AIO:hin.

‘Toiseksi osoitamme, että haetut lähteet ovat olennaisesti erilaisia kussakin hakukoneessa (<0,2 keskimääräinen Jaccard-yhtäläisyys). Perinteinen Google-haku on merkittävästi todennäköisemmin hakea tietoa suosituilta tai institutionaalisilta sivustoilta hallituksessa tai koulutuksessa, kun taas generatiiviset hakukoneet ovat merkittävästi todennäköisemmin hakea Google-omisteisia sisältöjä.

‘Kolmanneksi havaitsemme, että sivustot, jotka estävät Googlen tekoäly-haun, ovat merkittävästi vähemmän todennäköisiä pääsemään AIO:hin, vaikka niillä on pääsy sisältöön.’

Koska tutkimusraportti on mielenkiintoisten havaintojen kirjo, eikä se noudata tavallista lineaarista ja menettelyyn perustuvaa työkiertoa, tarkastelemme niitä tarkemmin, sekä joitakin muita sen mielenkiintoisimpia ja valaistavimpia havaintoja.

Vanha ‘Kaksi-Yksi’

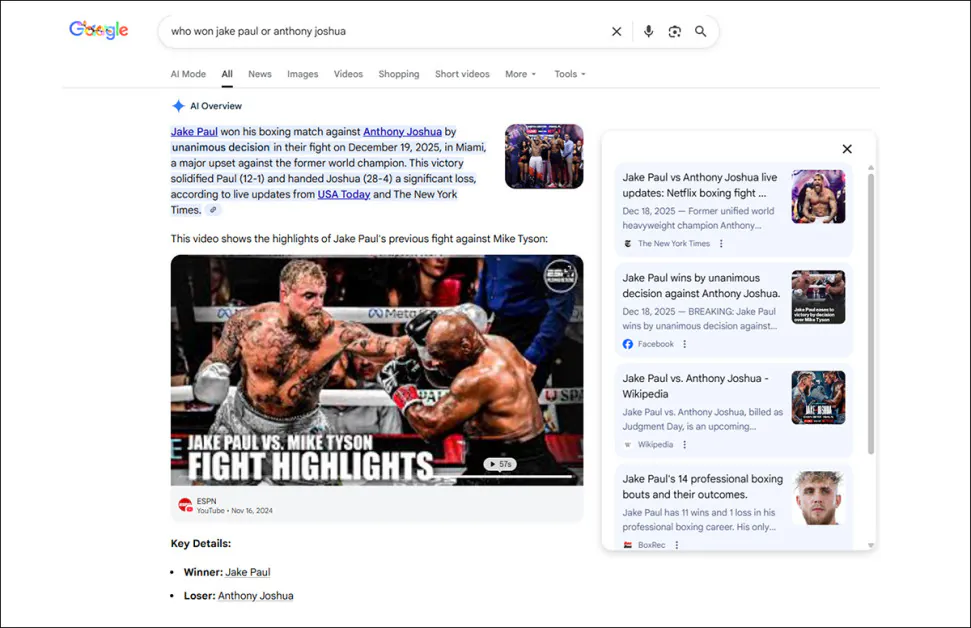

Yksi monista mielenkiintoisista havainnoista tutkimuksessa osoittaa, että Googlen tekoäly-yhteenvetot ovat usein estettyjä äkillisten uutistapahtumien aikana, koska varhaisimmat ja saatavilla olevat lähteet eivät välttämättä ole täysin tarkkoja.

Tämä järjestelmä ei aina toimi: tutkijoiden mainitsemassa esimerkissä Google-tekoly-yhteenveto nyrkkeilyottelun tuloksesta antoi voiton väärälle nyrkkeilijälle, vaikka ainoa lähde, joka ilmoitti (väärän) tuloksen, oli satiirinen urheilusyöte Facebookissa:

Yksi syistä, miksi Google-tekoly-yhteenvetot välttävät aikakriittisiä yhteenvetoja, on se, että varhainen tieto voi olla epätäydellistä tai täysin virheellistä. Tässä tapauksessa nyrkkeilijä Jake Paul hävisi ottelun. Lähde

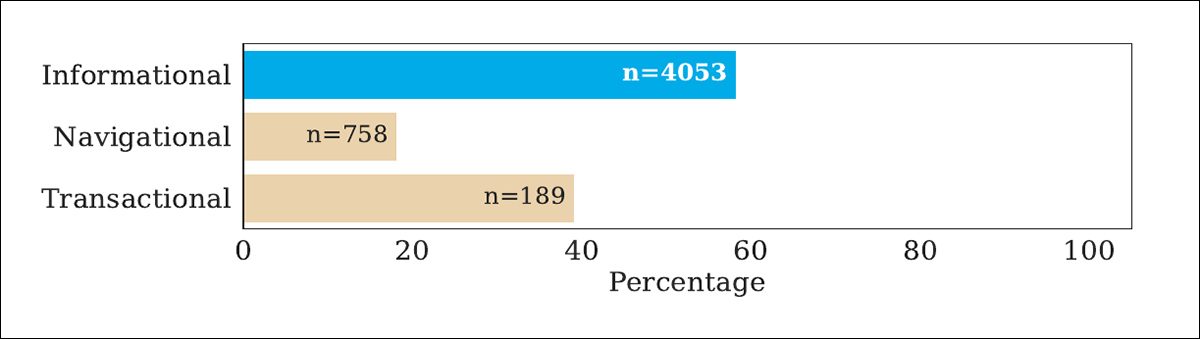

Tutkijat toteavat, että AIO:t ovat todennäköisemmin generoituja, kun kysymys on suljettu kysymysmerkillä, ja että kysymyksen tarkoitus on tekijä, joka vaikuttaa siihen, esitetäänkö AIO:

Prosenttiosuus tapauksista, joissa tekoäly-hakuyhteenveto tuotettiin yhdessä tutkijoiden kierroksessa. Tässä ‘tietoa’ tarkoittaa suoria kysymyksiä, jotka tuottavat AIO:ta useammin kuin mikään muu vuorovaikutus.

Lisäksi tutkimusraportti väittää, että pitemmät kysymykset ovat todennäköisemmin tuottamaan tekoäly-yhteenvetoa sen sijaan, että ne antaisivat vain suoran hakutuloksen, vaikka tutkijat eivät vielä esitä teoriaa, joka selittäisi tämän.

Jakautunut Valtakunta

Ehkä yllättävin yleinen tulos uudesta tutkimuksesta on se, että Googlen (mainittujen) kolmen hakualustan tulokset ovat suhteellisen vähän päällekkäin.

Tutkimusraportti toistaa, että säännöllinen Google-haku, tekoäly-yhteenvetot ja Gemini (LLM) hakevat merkittävästi erilaisia lähteitä samalle kysymykselle, ja että päällekkäisyyden tulokset ovat niin alhaisia, että ne viittaavat kolmeen kilpailevaan hakulogiikkaan yhdessä yrityksessä, kun taas käyttäjät olettavat, että Googlella on yksi virallinen indeksi ja yksi luokittelufilosofia:

Google-ekosysteemin sisälläkin yhteenvetojen, AI-yhteenvetojen ja Gemini-välisten tulosten päällekkäisyys osoittautui yllättävän pieneksi, ja sama kysymys tuotti usein merkittävästi erilaisia lähdeluetteloita sen mukaan, kuka Google-järjestelmä käsittelee pyynnön. Tässä vertailussa näemme, miten lähellä kolme järjestelmää toisiaan vastaavat tuhansien hakukysymysten yli, kaupasta ja debatista paikallisiin hakuihin ja yleistietoon, ja matalammat tulokset osoittavat vähemmän yhtäläisyyttä valituissa lähteissä.

Tutkijat toteavat myös:

‘[Yllä oleva taulukko] esittää keskimääräisen yhtäläisyyden AIO:n, Gemini:n ja perinteisen SERP:n lähdeluetteloiden välillä kussakin kysymyksessä vertailudatajoukossa.

‘Pääasiallinen johtopäätös on, että riippumatta kysymysjoukosta ja siitä, mitä kahta hakukonetta verrataan, haetut luettelot ovat erilaisia, vaikka kaikki kolme on kehittänyt Google.’

Tutkijat toteavat myös, että mikään hakutapa ei osoittanut rank-biased overlap -arvoa yli 0,27, mikä on erittäin alhainen tulos. He toteavat, että Amazon Retail ja paikalliset kysymykset (esim. ‘kaupat lähelläni’) olivat vähiten yhtäläisiä hakutavoissa.

He selittävät alhaisen yhtäläisyyden ‘hakukoneiden välisen epäjohdonmukaisuuden takia, ja toteavat, ettei sattuma tai mikään muu ilmeinen tekijä voi selittää tätä epäjohdonmukaisuutta.

Yksi intuitiivinen selitys on, että koulutusdatakohtia on sijoitettu sijalle eri tavoin kuin Google on kehittänyt PageRank- ja sen seuraajien kanssa viimeisen kahden vuosikymmenen aikana. Lisäksi, jos Google-haun algoritmi on salainen agenda, se olisi paljon vaikeampaa toteuttaa diffuusiopohjaisissa tekoälyjärjestelmissä, kuten Gemini (jopa suodattimien, järjestelmäkutsujen ja muiden keinojen kautta, joita voidaan asettaa kaupallisiin malleihin).

Itsepalvelu..?

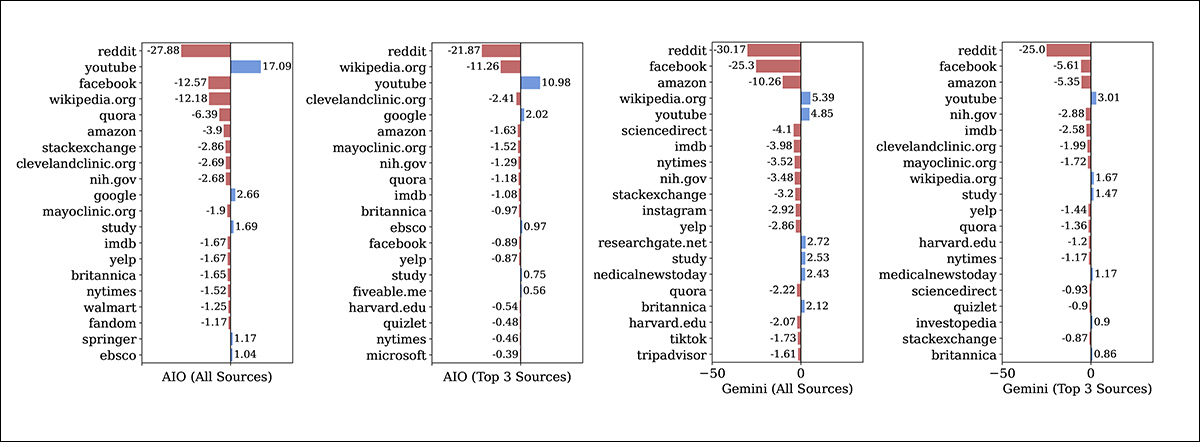

Tiettyjä sivustoja tai sivustojen luokkia on vaikuttanut tekoäly-yhteenvetojen ja LLM-pohjaisen hakun tunkeutumiseen perinteiseen hakutilaan – sekä myönteisesti että kielteisesti, riippuen tapauksesta:

Verrattuna perinteiseen Google-hakuun, AI-yhteenvetot ja Gemini vähensivät useiden suurten sivustojen siteerauksia, mutta lisäsivät näkyvyyttä pienemmälle joukolle suosituille verkkotunneille. YouTube osoittautui yhdeksi suurimmista hyötyjistä molemmissa järjestelmissä, kun taas Reddit, Wikipedia, Facebook ja useat institutionaaliset lähteet näkyivät vähemmän tekoäly-pohjaisissa hakutuloksissa.

Tutkijat toteavat:

‘Meillä on kolme pääasiallista johtopäätöstä [yllä olevasta kaaviossa]. Ensinnäkin, suuret ja tunnetut sivustot ovat eniten vaikuttaneita (sekä myönteisesti että kielteisesti). Tämä on intuitiivista, koska suuret sivustot ovat maineeltaan ja sisällöltään monipuolisia olla merkityksellisiä monille eri kysymyksille.

‘Toiseksi, valtaosa näistä sivustoista saa vähemmän yhteensä ja vähemmän kolmea ensimmäistä siteerausta generatiivisilla hakukoneilla (punaisilla palkkeilla ja negatiivisilla numeroilla [yllä olevassa kaaviossa]). Tämä osoittaa, että generatiivinen haku suosii tietoa enemmän nišisivustoilta kuin perinteisiltä hakukoneilta.

‘Kolmanneksi, Google-tekoly-yhteenvetot suosivat Google-sivustoja (esim. google.com- ja youtube.com-verkkotunnukset).

‘Gemini suosii myös YouTubea verrattuna perinteiseen Google-hakuun, mutta absoluuttinen ero on pienempi.’

Mikä ‘Estäjiä’..?

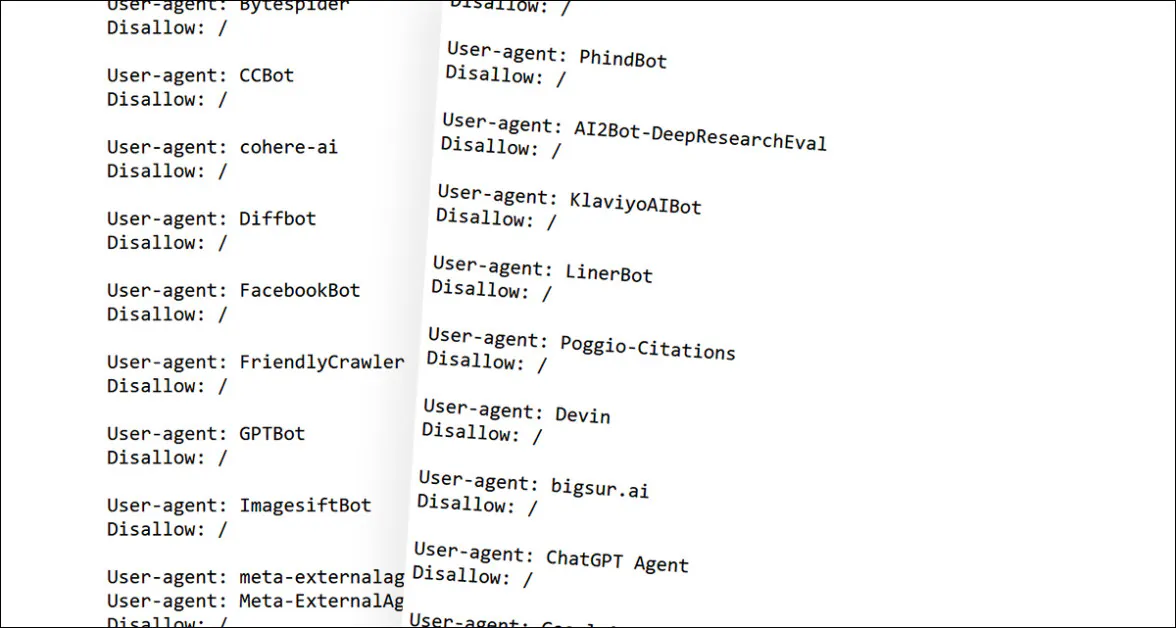

Tutkimus osoitti myös, että kustantajat, jotka estävät Google-tekoly-haun – automaattisen web-robotin, joka poimii tietoa sivustoltasi, ellei sinä estä sitä robots.txt-tiedostolla – eivät yleensä näy tekoäly-yhteenvetoissa.

Tämä saattaa tuntua ilmeisenä itse aiheutettuna vammana, mutta tosiasiassa Google on julkisesti ilmoittanut, että sisältö alustoilta, jotka estävät tekoäly-haun, ei estetä näyttämistä tekoäly-yhteenvetoissa; vaan kustantajat eivät vain saa tietojaan poimittua, kuratoitua ja käytettyä seuraavassa tekoäly-koulutuksessa Gemini- ja muiden Google-tekoly-projekteissa.

Kuitenkin tutkimuksen tutkijat tulivat toisiin tuloksiin ja totesivat, että suositut tekoäly-estävät kustantajat olivat hyvin harvoin siteerattuina Gemini:ssä, sekä LLM- että suppeammassa hakutuloksessa. ‘Teollisesti estetyt’ kustantajat, joita tutkimusraportti mainitsi, olivat NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports ja STAT.

Jotkut yllä mainittujen kustantajien tekoäly-poimintaa estävät robots.txt-kieltoja. Onko se johtanut laajempaan Google-kieltoon?

Tutkijat toteavat:

‘Analyyseissämme eniten vaikuttaneista verkkotunneista havaitsemme, että 21 suosituinta kustantajaa (joita haetaan vähintään 20 yksilölliselle kysymykselle sekä Google-haulla että AI-yhteenvetoilla) ei koskaan siteerattu Gemini:ssä.

‘Useat suositut sosiaalisen median (Facebook, Instagram, Tiktok) ja arvostelusivustot (IMDb, Yelp, Tripadvisor) eivät myöskään saaneet siteerauksia Gemini:stä. Lisätutkimuksissa havaittiin, että kaikki nämä sivustot estävät Google-Extended-robotin robots.txt-tiedostoissaan.’

Jos tämä löydös osoittautuu vahvistetuksi muuallakin ja pysyväksi, voisi spekuloida, että nämä yritykset ovat mahdollisesti painostettuina Googlelta yhteistyöhön sen tekoäly-toimintojen kanssa osittaisen poistamisen kautta. Yleiskatseella tulokset vaikuttavat pahansuopoisilta; mutta koska tutkimuksen löydökset ovat enemmän kaaosta kuin etukäteen suunniteltua, ainoa järkevä kommentti, johon voidaan turvautua, on, että nämä tulokset vaikuttavat pinnallisesti ‘katkerilta’; riippumatta siitä, mikä niiden todellinen syy on.

Johtopäätös

Mielipide Tämä on selkeäpäinen zip-pommi -tutkimusraportti, jonka vain kymmenen ensisijaisen sivun mittainen raportti avautuu lähes ylivoimaiseksi määräksi muita löydöksiä. Koska meillä on ollut aikaa kattaa vain pientä osaa näistä, suosittelen alkuperäistä PDF-tiedostoa jopa satunnaiselle lukijalle (harvinainen tapahtuma).

Vaikka ‘keltainen’ asenne voisi tulkita useita negatiivisia tulkintoja tutkijoiden löydöksistä, työ on ehkä parhaiten kohdeltava kuin maailmanlaajuinen teknologiajohtaja, joka yrittää saavuttaa ja ylläpitää johtavaa asemaa tekoäly-pohjaisessa haussa, käyttäen hyvin erilaisia alustoja, jotka kehittyivät eri olosuhteissa ja eri aikakausina.

Koska tutkimuksessa tarkastellaan kolmea hakutapaa, todellinen kiista on perinteisten hakutulosten ja tekoäly-pohjaisten valintamenetelmien välillä, jotka hallitsevat datakokoamista.

AI Kuin Vuonna 1999

Ennen Googlea oli mahdollista ‘huijata’ hakutuloksia pelkästään määrällä, ja tällä tavoin voitiin usein saavuttaa etusivun hakutulokset vähällä (usein automaattisella) vaivalla. Tämä ‘määrän peli’ lopetettiin käytännössä noin vuonna 2002 Google-haun monimutkaisemman ja salaisemman hakuluokittelualgoritmin myötä. Mutta koska panokset olivat merkittäviä, suuri määrä ja heikko laatuista sisältöä ei koskaan hävinnyt merkittävässä määrin.

Siksi, kun hyperskaalaiset kokoelmat, kuten Common Crawl, loivat modernin tekoäly-vallankumouksen perustan, data-keskeisyys oli kohtalonomaista hallita, kuinka paljon automaattiset prosessit voivat suodattaa ja luokitella saapuvan datan laatu, ja (paljon vähemmän todennäköisesti), kuinka paljon rahaa oli saatavilla maksaa ihmisiä luokittelemaan datan.

Siinä oli paljon huonoa tai heikkolaatuista dataa noissa valtavissa ja epätarkoituksenmukaisissa kokoelmissa; dataa, joka ei välttämättä sisältänyt alastomuutta, kirouksia, rasistisia kliseitä tai muita asioita, joita on suhteellisen helppo suodattaa koulutusdatasta – mutta joka oli silti itsepalvelevaa ja runsasta, aivan kuten internet-haun tulokset noin vuosina 1999-2001.

Koska ne data-induktio-prosessit eivät ole vieläkään hyviä, on hyvin vaikea jopa Googlelle saada tekoäly toimimaan liiketoiminnallisesti, koska Gemini:n PageRank-tyyppiset päätökset määräytyvät ei Google:n politiikkainsinöörien toimesta, vaan epätäydellisen ymmärryksen kautta, kuinka hyperskaalainen data muuttuu data-jakaumiin ja latenteihin upotuksiin tekoälymallin koulutuksen aikana.

* Hakutulossivut.

† Tutkijoiden korostukset, eivät minun. Kuitenkin olen korvannut lihavoinnin kursiivilla, koska kursiivikorostus ei toimi hyvin lainauksissa, jotka ovat jo pääosin kursivoituja.

Julkaistu ensimmäisen kerran keskiviikkona, 13. toukokuuta 2026