Inteligencia artificial

MagicDance: Generación de Videos de Baile Humano Realistas

La visión por computadora es uno de los campos más debatidos en la industria de la IA, gracias a sus posibles aplicaciones en una amplia gama de tareas en tiempo real. En los últimos años, los marcos de visión por computadora han avanzado rápidamente, y los modelos modernos ahora son capaces de analizar características faciales, objetos y mucho más en escenarios en tiempo real. A pesar de estas capacidades, la transferencia de movimiento humano sigue siendo un desafío formidable para los modelos de visión por computadora. Esta tarea implica retargeting de movimientos faciales y corporales de una imagen o video de origen a una imagen o video de destino. La transferencia de movimiento humano se utiliza ampliamente en los modelos de visión por computadora para estilizar imágenes o videos, editar contenido multimedia, síntesis de humanos digitales y incluso generar datos para marcos de percepción.

En este artículo, nos centramos en MagicDance, un modelo basado en difusión diseñado para revolucionar la transferencia de movimiento humano. El marco de MagicDance se centra específicamente en transferir expresiones faciales y movimientos humanos 2D a videos de baile humanos desafiantes. Su objetivo es generar videos de baile de secuencias de poses novedosas para identidades de destino específicas mientras mantiene la identidad original. El marco de MagicDance emplea una estrategia de entrenamiento de dos etapas, centrándose en la desentanglement de movimiento humano y factores de apariencia como el tono de piel, las expresiones faciales y la ropa. Exploraremos el marco de MagicDance, su arquitectura, funcionalidad y rendimiento en comparación con otros marcos de transferencia de movimiento humano de vanguardia. ¡Vamos a sumergirnos.

MagicDance: Transferencia de Movimiento Humano Realista

Como se mencionó anteriormente, la transferencia de movimiento humano es una de las tareas de visión por computadora más complejas debido a la complejidad involucrada en la transferencia de movimientos y expresiones humanas de la imagen o video de origen a la imagen o video de destino. Tradicionalmente, los marcos de visión por computadora han logrado la transferencia de movimiento humano entrenando un modelo generativo específico de la tarea que incluye GAN o Redes Adversarias Generativas en conjuntos de datos de destino para expresiones faciales y poses corporales. Aunque entrenar y utilizar modelos generativos entregan resultados satisfactorios en algunos casos, generalmente sufren de dos limitaciones importantes.

- Dependen en gran medida de un componente de deformación de imagen como resultado de lo cual a menudo luchan por interpolar partes del cuerpo invisibles en la imagen de origen debido a un cambio en la perspectiva o auto-occlusión.

- No pueden generalizar a otras imágenes obtenidas externamente, lo que limita sus aplicaciones, especialmente en escenarios en tiempo real en el mundo real.

Los modelos de difusión modernos han demostrado capacidades de generación de imágenes excepcionales en diferentes condiciones, y los modelos de difusión ahora son capaces de presentar poderosas visualizaciones en una variedad de tareas downstream como generación de video e inpainting de imágenes al aprender de conjuntos de datos de imágenes a escala web. Debido a sus capacidades, los modelos de difusión podrían ser una opción ideal para tareas de transferencia de movimiento humano. Aunque los modelos de difusión se pueden implementar para la transferencia de movimiento humano, tiene algunas limitaciones, ya sea en términos de la calidad del contenido generado, o en términos de preservación de identidad o sufrir de inconsistencias temporales como resultado de los límites de diseño y estrategia de entrenamiento del modelo. Además, los modelos basados en difusión no demuestran ninguna ventaja significativa sobre los marcos GAN en términos de generalizabilidad.

Para superar los obstáculos que enfrentan los marcos basados en difusión y GAN en tareas de transferencia de movimiento humano, los desarrolladores han introducido MagicDance, un marco novedoso que tiene como objetivo explotar el potencial de los marcos de difusión para la transferencia de movimiento humano, demostrando un nivel sin precedentes de preservación de identidad, calidad visual superior y generalizabilidad de dominio.

La figura anterior proporciona una visión general del marco de MagicDance, y como se puede ver, el marco emplea el modelo de difusión estable, y también despliega dos componentes adicionales: Modelo de control de apariencia y ControlNet de pose, donde el primero proporciona orientación de apariencia al modelo SD desde una imagen de referencia a través de la atención, mientras que el segundo proporciona orientación de expresión/pose al modelo de difusión desde una imagen o video condicionada.

En resumen, el marco de MagicDance es un

- Marco novedoso y eficaz que consiste en control de pose desentanglement y preentrenamiento de control de apariencia.

- El marco de MagicDance es capaz de generar expresiones faciales y movimientos humanos realistas bajo el control de entradas de condición de pose y imágenes o videos de referencia.

- El marco de MagicDance tiene como objetivo generar contenido humano coherente con la apariencia al introducir un módulo de atención de múltiples fuentes que ofrece orientación precisa para el marco de difusión estable UNet.

- El marco de MagicDance también se puede utilizar como una extensión o complemento conveniente para el marco de difusión estable, y también garantiza la compatibilidad con los pesos de modelo existentes, ya que no requiere un ajuste fino adicional de los parámetros.

Además, el marco de MagicDance muestra capacidades de generalización excepcionales tanto para la apariencia como para el movimiento.

- Generalización de apariencia: El marco de MagicDance demuestra capacidades superiores al generar apariencias diversas.

- Generalización de movimiento: El marco de MagicDance también tiene la capacidad de generar una amplia gama de movimientos.

MagicDance: Objetivos y Arquitectura

Para una imagen de referencia dada, ya sea de un humano real o una imagen estilizada, el objetivo principal del marco de MagicDance es generar una imagen de salida o un video de salida condicionado en la entrada y las entradas de pose {P, F}, donde P representa el esqueleto de pose humana y F representa las características faciales. La imagen de salida o el video generado deben ser capaces de preservar la apariencia y la identidad de los humanos involucrados, junto con los contenidos de fondo presentes en la imagen de referencia, mientras se mantienen la pose y las expresiones definidas por las entradas de pose.

Arquitectura

Durante el entrenamiento, el marco de MagicDance se entrena como una tarea de reconstrucción de cuadros para reconstruir la verdad fundamental con la imagen de referencia y la entrada de pose obtenida del mismo video de referencia. Durante la prueba, para lograr la transferencia de movimiento, la entrada de pose y la imagen de referencia se obtienen de fuentes diferentes.

La arquitectura general del marco de MagicDance se puede dividir en cuatro categorías: Etapa preliminar, preentrenamiento de control de apariencia, control de pose desentanglement y módulo de movimiento.

Etapa Preliminar

Los modelos de difusión latente o LDM representan modelos de difusión diseñados de forma única para operar dentro del espacio latente facilitado por el uso de un autoencoder, y el marco de difusión estable es un ejemplo notable de LDM que emplea un autoencoder variacional cuantizado-vector y una arquitectura U-Net temporal. El marco de difusión estable emplea un transformador basado en CLIP como codificador de texto para procesar entradas de texto convirtiendo entradas de texto en incrustaciones. La fase de entrenamiento del marco de difusión estable expone el modelo a una condición de texto y una imagen de entrada con el proceso que implica la codificación de la imagen en una representación latente y sometiéndola a una secuencia predefinida de pasos de difusión dirigida por un método gaussiano. La secuencia resultante produce una representación latente ruidosa que proporciona una distribución normal estándar con el objetivo de aprendizaje principal del marco de difusión estable siendo denoising las representaciones latentes ruidosas de forma iterativa en representaciones latentes.

Preentrenamiento de Control de Apariencia

Un problema importante con el marco de ControlNet original es su incapacidad para controlar la apariencia entre movimientos espacialmente variables de manera consistente, aunque tiende a generar imágenes con poses que se asemejan a las de la imagen de entrada, con la apariencia general siendo influenciada predominantemente por entradas de texto. Aunque este método funciona, no es adecuado para tareas de transferencia de movimiento que involucran no las entradas de texto, sino la imagen de referencia como la fuente principal de información de apariencia.

El módulo de preentrenamiento de control de apariencia en el marco de MagicDance se diseña como una rama auxiliar para proporcionar orientación para el control de apariencia de forma capa por capa. En lugar de confiar en entradas de texto, el módulo general se centra en aprovechar los atributos de apariencia de la imagen de referencia con el objetivo de mejorar la capacidad del marco para generar las características de apariencia con precisión, particularmente en escenarios que involucran dinámicas de movimiento complejas. Además, solo el modelo de control de apariencia es trainable durante el preentrenamiento de control de apariencia.

Control de Pose Desentanglement

Una solución ingenua para controlar la pose en la imagen de salida es integrar el modelo de ControlNet preentrenado con el modelo de control de apariencia preentrenado directamente sin ajuste fino. Sin embargo, la integración puede resultar en que el marco luche con el control de pose independiente de la apariencia, lo que puede llevar a una discrepancia entre las poses de entrada y las poses generadas. Para abordar esta discrepancia, el marco de MagicDance ajusta el modelo de ControlNet de pose conjuntamente con el modelo de control de apariencia preentrenado.

Módulo de Movimiento

Cuando trabajan juntos, el ControlNet de pose desentanglement y el modelo de control de apariencia pueden lograr una transferencia de imagen a movimiento precisa y efectiva, aunque puede resultar en inconsistencia temporal. Para garantizar la consistencia temporal, el marco integra un módulo de movimiento adicional en la arquitectura principal de difusión estable UNet.

MagicDance: Preentrenamiento y Conjuntos de Datos

Para el preentrenamiento, el marco de MagicDance utiliza un conjunto de datos de TikTok que consiste en más de 350 videos de baile de longitudes variables entre 10 y 15 segundos que capturan a una sola persona bailando, con la mayoría de estos videos que contienen la cara y el torso humano. El marco de MagicDance extrae cada video individual a 30 FPS y ejecuta OpenPose en cada cuadro individual para inferir el esqueleto de pose, las poses de las manos y las características faciales.

Para el preentrenamiento, el modelo de control de apariencia se preentrena con un tamaño de lote de 64 en 8 NVIDIA A100 GPUs durante 10 mil pasos con un tamaño de imagen de 512 x 512, seguido de un ajuste fino conjunto de los modelos de control de pose y apariencia con un tamaño de lote de 16 durante 20 mil pasos. Durante el entrenamiento, el marco de MagicDance muestrea aleatoriamente dos cuadros como el destino y la referencia, respectivamente, con las imágenes que se recortan en la misma posición a lo largo de la misma altura. Durante la evaluación, el modelo recorta la imagen centralmente en lugar de recortarlas aleatoriamente.

MagicDance: Resultados

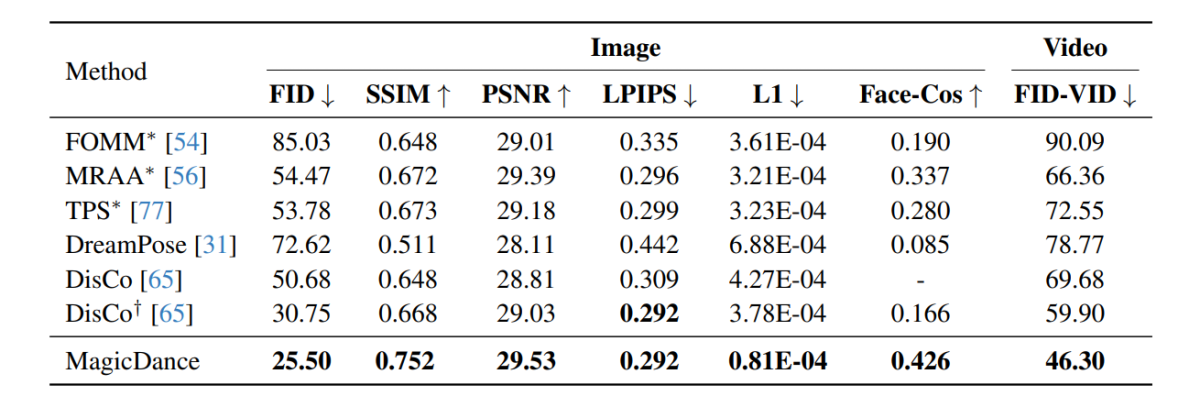

Los resultados experimentales realizados en el marco de MagicDance se demuestran en la siguiente imagen, y como se puede ver, el marco de MagicDance supera a los marcos existentes como Disco y DreamPose para la transferencia de movimiento humano en todas las métricas. Los marcos que consisten en un “*” antes de su nombre utilizan la imagen de destino directamente como la entrada y incluyen más información en comparación con los otros marcos.

Es interesante destacar que el marco de MagicDance logra una puntuación de Face-Cos de 0,426, una mejora del 156,62% sobre el marco de Disco, y un aumento casi del 400% en comparación con el marco de DreamPose. Los resultados indican la capacidad robusta del marco de MagicDance para preservar la información de identidad y el aumento visible en el rendimiento indica la superioridad del marco de MagicDance sobre los métodos actuales de vanguardia.

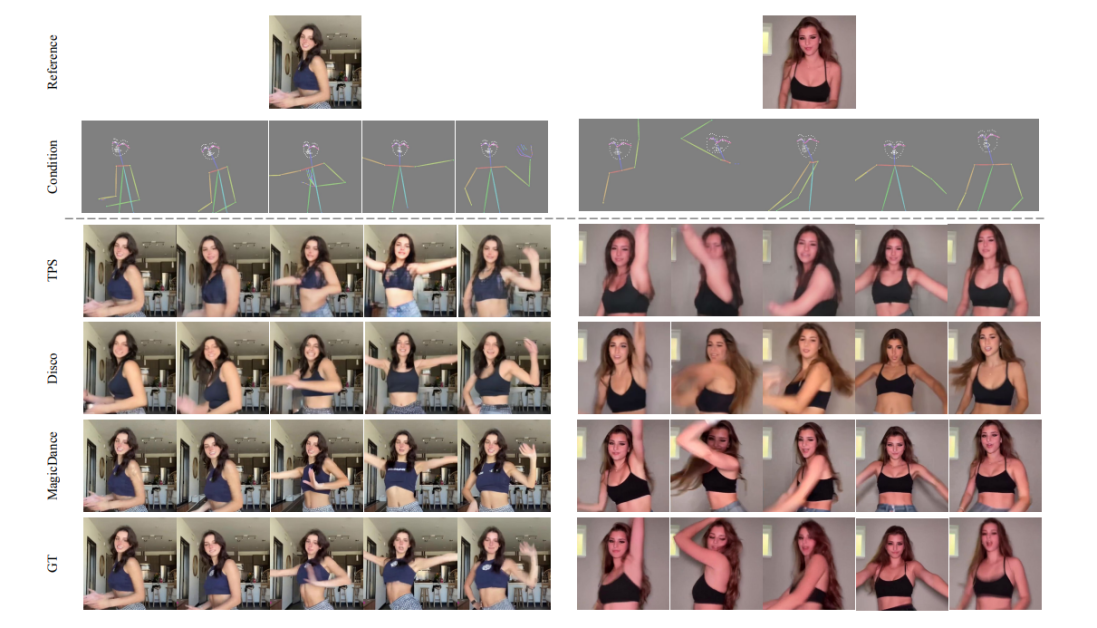

Las siguientes figuras comparan la calidad de la generación de video humano entre MagicDance, Disco y TPS. Como se puede observar, los resultados generados por los marcos de GT, Disco y TPS sufren de identidad de pose humana y expresiones faciales inconsistentes.

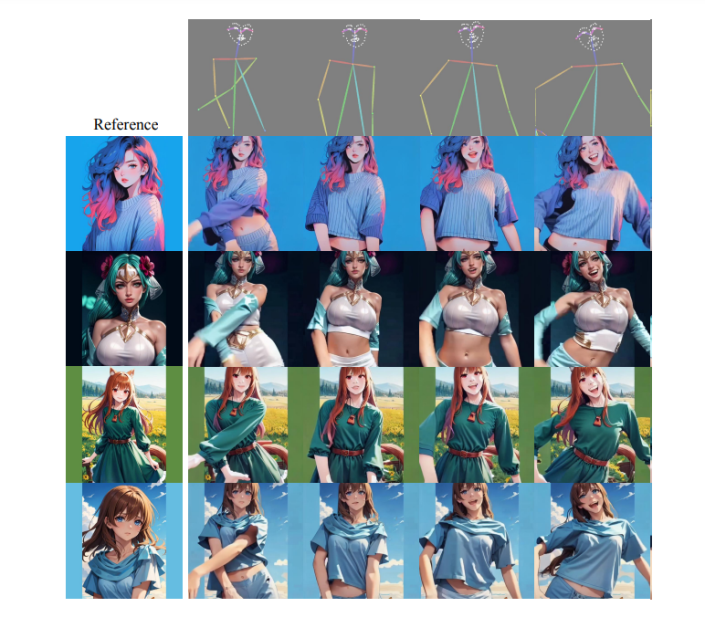

Además, la siguiente imagen demuestra la visualización de la transferencia de expresión facial y pose humana en el conjunto de datos de TikTok con el marco de MagicDance que puede generar expresiones y movimientos realistas y vívidos bajo diversas características faciales y entradas de esqueleto de pose mientras se preserva con precisión la información de identidad de la imagen de referencia de entrada.

Es digno de destacar que el marco de MagicDance cuenta con capacidades de generalización excepcionales para imágenes de referencia fuera del dominio de pose y estilos no vistos, con un control de apariencia impresionante incluso sin ningún ajuste fino adicional en el dominio de destino, con los resultados que se demuestran en la siguiente imagen.

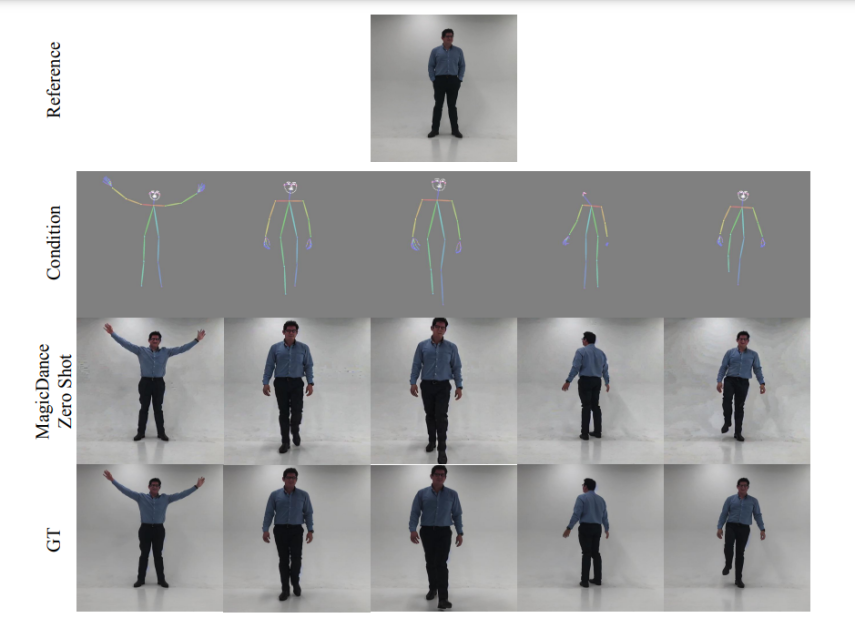

Las siguientes imágenes demuestran las capacidades de visualización del marco de MagicDance en términos de transferencia de expresión facial y movimiento humano de disparo cero. Como se puede ver, el marco de MagicDance se generaliza a los movimientos humanos en el mundo real de manera perfecta.

MagicDance: Limitaciones

OpenPose es un componente esencial del marco de MagicDance, ya que juega un papel crucial para el control de pose, afectando significativamente la calidad y la consistencia temporal de las imágenes generadas. Sin embargo, el marco de MagicDance todavía encuentra un poco desafiante detectar características faciales y esqueletos de pose con precisión, especialmente cuando los objetos en las imágenes son parcialmente visibles o muestran un movimiento rápido. Estos problemas pueden resultar en artefactos en la imagen generada.

Conclusión

En este artículo, hemos hablado sobre MagicDance, un modelo basado en difusión que tiene como objetivo revolucionar la transferencia de movimiento humano. El marco de MagicDance intenta transferir expresiones faciales y movimientos humanos 2D a videos de baile humanos desafiantes, con el objetivo específico de generar videos de baile de secuencias de poses novedosas para identidades de destino específicas mientras mantiene la identidad constante. El marco de MagicDance es una estrategia de entrenamiento de dos etapas para la desentanglement de movimiento humano y apariencia como tono de piel, expresiones faciales y ropa.

MagicDance es un enfoque novedoso para facilitar la generación de video humano realista al incorporar la transferencia de expresión facial y de movimiento, y permitir la generación de animación coherente en el mundo real sin necesidad de ajuste fino adicional, lo que demuestra un avance significativo sobre los métodos existentes. Además, el marco de MagicDance demuestra capacidades de generalización excepcionales sobre secuencias de movimiento complejas y diversas identidades humanas, estableciendo el marco de MagicDance como el líder en el campo de la transferencia de movimiento y generación de video asistida por IA.