Ángulo de Anderson

Buscando ‘Búhos y Lagartos’ en la Audiencia de un Anunciante

Dado que el sector de la publicidad en línea se estima que gastó $740.3 mil millones de USD en 2023, es fácil entender por qué las empresas de publicidad invierten recursos considerables en esta particular rama de la investigación de visión por computadora.

Aunque es insular y protector, la industria ocasionalmente publica estudios que sugieren un trabajo más avanzado y propietario en reconocimiento facial y de mirada – incluyendo reconocimiento de edad, central para las estadísticas de análisis demográfico:

Estimación de la edad en un contexto publicitario en el mundo real es de interés para los anunciantes que pueden estar dirigidos a una demografía particular. En este ejemplo experimental de estimación automática de la edad facial, se rastrea la edad del intérprete Bob Dylan a lo largo de los años. Fuente: https://arxiv.org/pdf/1906.03625

Estos estudios, que rara vez aparecen en repositorios públicos como Arxiv, utilizan participantes legítimamente reclutados como base para el análisis impulsado por IA que apunta a determinar en qué medida y de qué manera el espectador se está involucrando con un anuncio.

El Histograma de Gradientes Orientados (HoG) de Dlib se utiliza a menudo en sistemas de estimación facial. Fuente: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Instinto Animal

En este sentido, naturalmente, la industria de la publicidad está interesada en determinar falsos positivos (ocasiones en que un sistema analítico malinterpreta las acciones de un sujeto), y en establecer criterios claros para cuando la persona que ve sus comerciales no se está involucrando completamente con el contenido.

En cuanto a la publicidad basada en pantalla, los estudios tienden a centrarse en dos problemas en dos entornos. Los entornos son ‘desktop’ o ‘mobile’, cada uno de los cuales tiene características particulares que necesitan soluciones de seguimiento personalizadas; y los problemas – desde el punto de vista del anunciante – están representados por comportamiento de búho y lagarto – la tendencia de los espectadores a no prestar atención completa a un anuncio que está frente a ellos.

Ejemplos de comportamiento de ‘Búho’ y ‘Lagarto’ en un sujeto de un proyecto de investigación publicitaria. Fuente: https://arxiv.org/pdf/1508.04028

Si estás mirando hacia afuera del anuncio destinado con toda la cabeza, este es un comportamiento de ‘búho’; si tu pose de cabeza es estática pero tus ojos se desvían de la pantalla, este es un comportamiento de ‘lagarto’. En términos de análisis y pruebas de nuevos anuncios en condiciones controladas, estas son acciones esenciales para que un sistema pueda capturar.

Un nuevo documento de la adquisición de Affectiva de SmartEye aborda estos problemas, ofreciendo una arquitectura que aprovecha varios marcos existentes para proporcionar un conjunto de características combinado y concatenado en todas las condiciones y reacciones posibles – y para poder determinar si un espectador está aburrido, comprometido o de alguna manera remoto del contenido que el anunciante desea que vea.

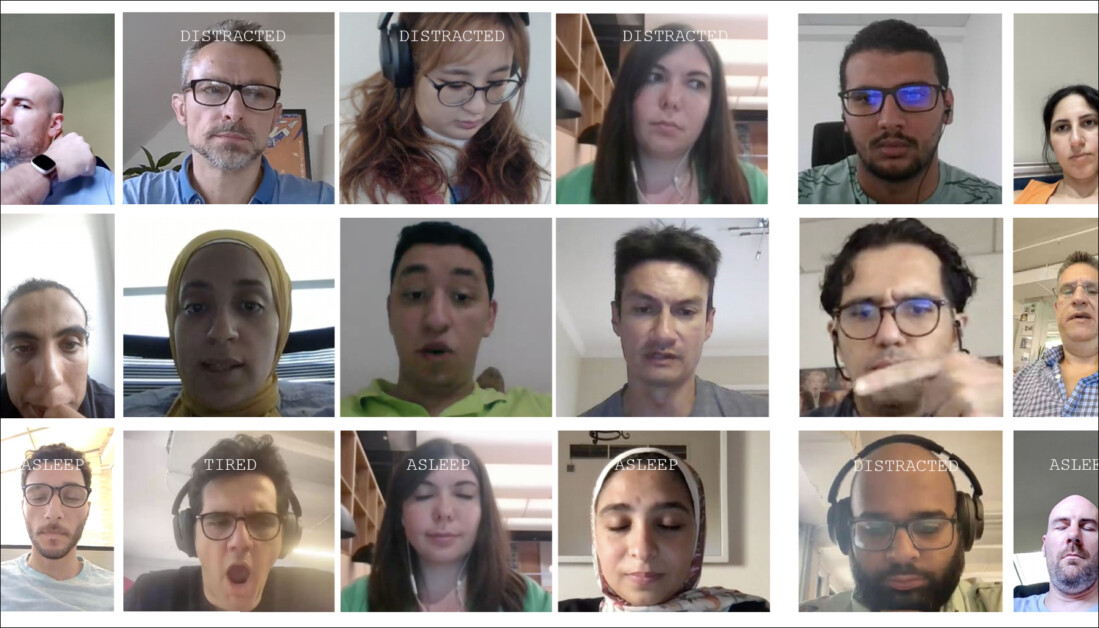

Ejemplos de verdaderos y falsos positivos detectados por el nuevo sistema de atención para varios señales de distracción, mostrados por separado para dispositivos de escritorio y móviles. Fuente: https://arxiv.org/pdf/2504.06237

Los autores declaran*:

‘Limitada investigación ha profundizado en la monitorización de la atención durante anuncios en línea. Mientras que estos estudios se centraron en estimar la pose de la cabeza o la dirección de la mirada para identificar instancias de mirada desviada, descuidan parámetros críticos como el tipo de dispositivo (de escritorio o móvil), la colocación de la cámara en relación con la pantalla y el tamaño de la pantalla. Estos factores influyen significativamente en la detección de la atención.

‘En este documento, proponemos una arquitectura para la detección de la atención que abarca la detección de varios distractores, incluyendo tanto el comportamiento de búho y lagarto de mirar fuera de la pantalla, hablar, somnolencia (a través de bostezos y cierre prolongado de los ojos), y dejar la pantalla sin atención.

‘A diferencia de los enfoques anteriores, nuestro método integra características específicas del dispositivo, como el tipo de dispositivo, la colocación de la cámara, el tamaño de la pantalla (para dispositivos de escritorio), y la orientación de la cámara (para dispositivos móviles) con la estimación cruda de la mirada para mejorar la precisión de la detección de la atención.’

El nuevo trabajo se titula Monitoreo de la Atención del Espectador durante Anuncios en Línea, y proviene de cuatro investigadores de Affectiva.

Método y Datos

En gran medida debido a la naturaleza secreta y de código cerrado de dichos sistemas, el nuevo documento no compara el enfoque de los autores directamente con rivales, sino que presenta sus hallazgos exclusivamente como estudios de ablación; ni el documento sigue en general el formato habitual de la literatura de Visión por Computadora. Por lo tanto, examinaremos la investigación tal como se presenta.

Los autores enfatizan que solo un número limitado de estudios han abordado la detección de la atención específicamente en el contexto de anuncios en línea. En el SDK AFFDEX, que ofrece reconocimiento facial en tiempo real, la atención se infiere únicamente de la pose de la cabeza, con participantes etiquetados como inatentos si su ángulo de cabeza supera un umbral definido.

Un ejemplo del SDK AFFDEX, un sistema de Affectiva que se basa en la pose de la cabeza como indicador de la atención. Fuente: https://www.youtube.com/watch?v=c2CWb5jHmbY

En la colaboración de 2019 Medición Automática de la Atención Visual al Contenido de Video utilizando Aprendizaje Profundo, un conjunto de datos de alrededor de 28,000 participantes fue anotado para varios comportamientos inatentos, incluyendo mirar hacia afuera, cerrar los ojos, o participar en actividades no relacionadas, y un modelo CNN-LSTM se entrenó para detectar la atención a partir de la apariencia facial con el tiempo.

Del documento de 2019, un ejemplo que ilustra los estados de atención predichos para un espectador que ve contenido de video. Fuente: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Sin embargo, los autores observan que estos esfuerzos anteriores no tuvieron en cuenta factores específicos del dispositivo, como si el participante estaba utilizando un dispositivo de escritorio o móvil; ni consideraron el tamaño de la pantalla o la colocación de la cámara. Además, el sistema AFFDEX se centra únicamente en identificar la desviación de la mirada, y omite otras fuentes de distracción, mientras que el trabajo de 2019 intenta detectar un conjunto más amplio de comportamientos – pero su uso de una sola red neuronal convolucional (CNN) poco profunda puede, según el documento, haber sido inadecuado para esta tarea.

Los autores observan que algunos de los estudios de investigación más populares en esta línea no están optimizados para pruebas de anuncios, que tienen necesidades diferentes en comparación con dominios como la conducción o la educación – donde la colocación y la calibración de la cámara suelen ser fijas de antemano, en lugar de confiar en configuraciones no calibradas, y operar dentro del rango de mirada limitado de los dispositivos de escritorio y móviles.

Por lo tanto, han ideado una arquitectura para detectar la atención del espectador durante anuncios en línea, aprovechando dos kits de herramientas comerciales: AFFDEX 2.0 y SDK SmartEye.

Ejemplos de análisis facial de AFFDEX 2.0. Fuente: https://arxiv.org/pdf/2202.12059

Estos trabajos anteriores extraen características de bajo nivel, como expresiones faciales, pose de la cabeza y dirección de la mirada – extraídas a través de los mencionados AFFDEX 2.0 y SDK SmartEye.

Estas se procesan luego para producir indicadores de alto nivel, con cada distractor manejado por un clasificador binario separado entrenado en su propio conjunto de datos para optimización y evaluación independientes.

Esquema para el sistema de monitoreo propuesto.

El modelo de mirada determina si el espectador está mirando o no la pantalla utilizando coordenadas de mirada normalizadas, con calibración separada para dispositivos de escritorio y móviles. Un Máquina de Vectores de Soporte (SVM) lineal ayuda en este proceso, entrenado en características espaciales y temporales, que incorpora una ventana de memoria para suavizar cambios rápidos de la mirada.

Para detectar hablar sin audio, el sistema utilizó regiones bucales recortadas y una 3D-CNN entrenada en segmentos de video conversacionales y no conversacionales. Las etiquetas se asignaron según el tipo de sesión, con suavizado temporal reduciendo los falsos positivos que pueden resultar de movimientos breves de la boca.

El bostezo se detectó utilizando recortes de imagen de toda la cara, para capturar una motion facial más amplia, con una 3D-CNN entrenada en marcos manualmente etiquetados (aunque la tarea se complicó por la baja frecuencia del bostezo en la visualización natural y por su similitud con otras expresiones).

La abandono de la pantalla se identificó a través de la ausencia de una cara o una pose de cabeza extrema, con predicciones hechas por un árbol de decisión.

El estado de atención final se determinó utilizando una regla fija: si algún módulo detectaba inatención, el espectador se marcaba como inatento – un enfoque que prioriza la sensibilidad, y ajustado por separado para contextos de escritorio y móviles.

Pruebas

Como se mencionó anteriormente, las pruebas siguen un método ablativo, donde se eliminan componentes y se observa el efecto en el resultado.

Diferentes categorías de inatención percibida identificadas en el estudio.

El modelo de mirada identificó el comportamiento fuera de la pantalla a través de tres pasos clave: normalizando las estimaciones crudas de la mirada, afinando la salida y estimando el tamaño de la pantalla para dispositivos de escritorio.

Para comprender la importancia de cada componente, los autores los eliminaron individualmente y evaluaron el rendimiento en 226 videos de escritorio y 225 videos móviles extraídos de dos conjuntos de datos. Los resultados, medidos por G-mean y F1 scores, se muestran a continuación:

Resultados que indican el rendimiento del modelo de mirada completo, junto con versiones con pasos de procesamiento individuales eliminados.

En cada caso, el rendimiento disminuyó cuando se omitió un paso. La normalización resultó especialmente valiosa en los dispositivos de escritorio, donde la colocación de la cámara varía más que en los dispositivos móviles.

El estudio también evaluó cómo las características visuales predecían la orientación de la cámara móvil: la ubicación de la cara, la pose de la cabeza y la mirada obtuvieron 0.75, 0.74 y 0.60, mientras que su combinación alcanzó 0.91, destacando – según los autores – la ventaja de integrar múltiples señales.

El modelo de habla, entrenado en la distancia vertical de los labios, logró un ROC-AUC de 0.97 en el conjunto de datos de prueba etiquetado manualmente, y 0.96 en el conjunto de datos más grande etiquetado automáticamente, indicando un rendimiento consistente en ambos.

El modelo de bostezo alcanzó un ROC-AUC de 96.6 por ciento utilizando solo la relación de aspecto de la boca, lo que mejoró a 97.5 por ciento cuando se combinó con predicciones de unidades de acción de AFFDEX 2.0.

El modelo de pantalla no atendida clasificó momentos como inatento cuando tanto AFFDEX 2.0 como SmartEye no detectaron una cara durante más de un segundo. Para evaluar la validez de esto, los autores anotaron manualmente todos los eventos de “no cara” en el conjunto de datos de distracción real, identificando la causa subyacente de cada activación. Se excluyeron los casos ambiguos (como obstrucción de la cámara o distorsión del video) del análisis.

Como se muestra en la tabla de resultados a continuación, solo el 27 por ciento de las activaciones de “no cara” se debieron a que los usuarios abandonaron físicamente la pantalla.

Razones diversas obtenidas por las que no se encontró una cara en ciertas instancias.

El documento establece:

‘A pesar de que las pantallas no atendidas constituyeron solo el 27% de las instancias que activaron la señal de “no cara”, se activó por otras razones indicativas de inatención, como los participantes que miraban fuera de la pantalla con un ángulo extremo, realizaban un movimiento excesivo o ocultaban su cara significativamente con un objeto o mano.’

En la última de las pruebas cuantitativas, los autores evaluaron cómo la adición progresiva de diferentes señales de distracción – mirada fuera de la pantalla (a través de la mirada y la pose de la cabeza), somnolencia, habla y pantallas no atendidas – afectó el rendimiento general de su modelo de atención.

Las pruebas se llevaron a cabo en dos conjuntos de datos: el conjunto de datos de distracción real y un subconjunto de pruebas del conjunto de datos de mirada. Se utilizaron las puntuaciones G-mean y F1 para medir el rendimiento (aunque la somnolencia y el habla se excluyeron del análisis del conjunto de datos de mirada, debido a su limitada relevancia en este contexto).

Como se muestra a continuación, la detección de la atención mejoró consistentemente a medida que se agregaban más tipos de distracción, con mirada fuera de la pantalla, el distractor más común, proporcionando la base más sólida.

El efecto de agregar diversas señales de distracción a la arquitectura.

De estos resultados, el documento establece:

‘En primer lugar, podemos concluir que la integración de todas las señales de distracción contribuye a una mejor detección de la atención.

‘En segundo lugar, la mejora en la detección de la atención es consistente en ambos dispositivos de escritorio y móviles. En tercer lugar, las sesiones móviles en el conjunto de datos real muestran movimientos significativos de cabeza al mirar hacia afuera, que se detectan fácilmente, lo que conduce a un mejor rendimiento en dispositivos móviles en comparación con los de escritorio. En cuarto lugar, agregar la señal de somnolencia tiene una mejora relativamente leve en comparación con otras señales, ya que es raro que ocurra.

‘Finalmente, la señal de pantalla no atendida tiene una mejora relativamente mayor en dispositivos móviles en comparación con los de escritorio, ya que los dispositivos móviles pueden ser fácilmente dejados sin atención.’

Los autores también compararon su modelo con AFFDEX 1.0, un sistema anterior utilizado en pruebas de anuncios – e incluso la detección de mirada basada en la cabeza del modelo actual superó a AFFDEX 1.0 en ambos tipos de dispositivos:

‘Esta mejora es el resultado de incorporar movimientos de cabeza en ambas direcciones, yaw y pitch, así como normalizar la pose de la cabeza para tener en cuenta los cambios menores. Los movimientos significativos de cabeza en el conjunto de datos móvil real han hecho que nuestro modelo de cabeza funcione de manera similar a AFFDEX 1.0.’

Los autores cierran el documento con una ronda de pruebas cualitativas (quizás un poco perfunctoria), que se muestra a continuación.

Salidas de ejemplo del modelo de atención en dispositivos de escritorio y móviles, con cada fila que presenta ejemplos de verdaderos y falsos positivos para diferentes tipos de distracción.

Los autores establecen:

‘Los resultados indican que nuestro modelo detecta eficazmente varios distractores en entornos no controlados. Sin embargo, puede producir falsos positivos en ciertos casos de borde, como inclinaciones severas de la cabeza mientras se mantiene la mirada en la pantalla, algunas oclusiones de la boca, ojos excesivamente borrosos o imágenes faciales muy oscuras. ‘

Conclusión

Aunque los resultados representan un avance medido pero significativo sobre el trabajo anterior, el valor más profundo del estudio radica en la visión que ofrece sobre el impulso persistente para acceder al estado interno del espectador. Aunque los datos se recopilaron con consentimiento, la metodología apunta hacia futuros marcos que podrían extenderse más allá de entornos de investigación de mercado estructurados.

Esta conclusión ligeramente paranoica se ve reforzada por la naturaleza aislada, restringida y celosamente protegida de esta particular rama de la investigación.

* Mi conversión de las citas en línea de los autores en enlaces.

Publicado por primera vez el miércoles 9 de abril de 2025