Ángulo de Anderson

Preparándose para la publicidad en grandes modelos de lenguaje

Nueva investigación muestra cómo los anuncios podrían pronto estar incrustados directamente dentro de las respuestas de estilo ChatGPT, no como banners o ventanas emergentes, sino tejidos en la respuesta en sí.

Como la popularidad generalizada y en constante crecimiento de los Grandes Modelos de Lenguaje socava los métodos de publicidad tradicionales que han impulsado Internet desde casi su inicio, cualquier persona familiarizada con las tácticas de captura de mercado de los capitalistas de riesgo se preguntará cuánto tiempo más podrán los chatbots de IA evitar incluir contenido publicitario en sus respuestas.

Como Netflix y una lista en expansión de servicios de streaming demuestran, la estrategia tradicional de la era del cable de combinar suscripciones pagas con publicidad incrustada (a menudo justificada como una forma de mantener los costos del consumidor bajos) está recuperando impulso; y el cambio hacia la incorporación de anuncios directamente en las salidas de LLM está empezando a parecer menos especulativo y más como un adoptador natural de ese modelo.

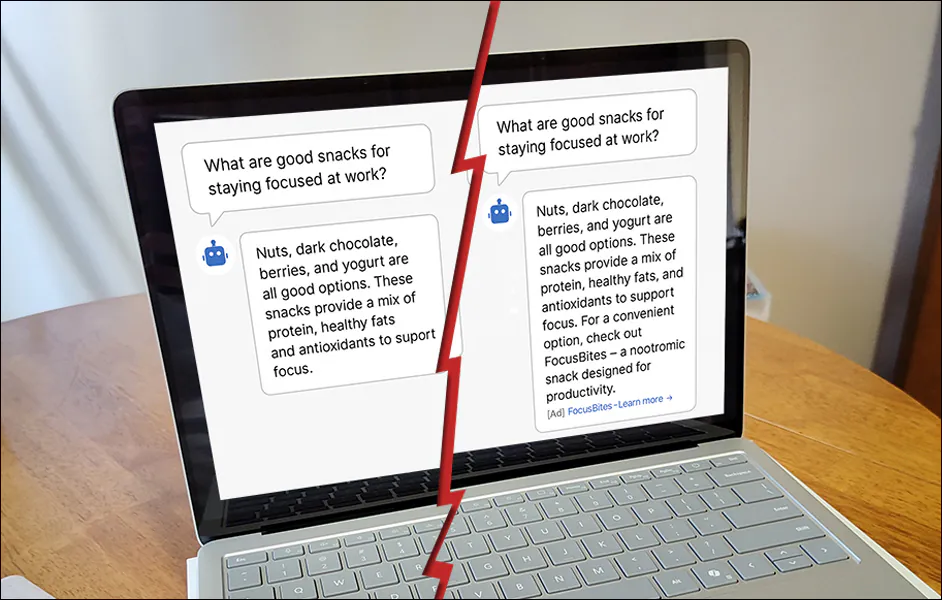

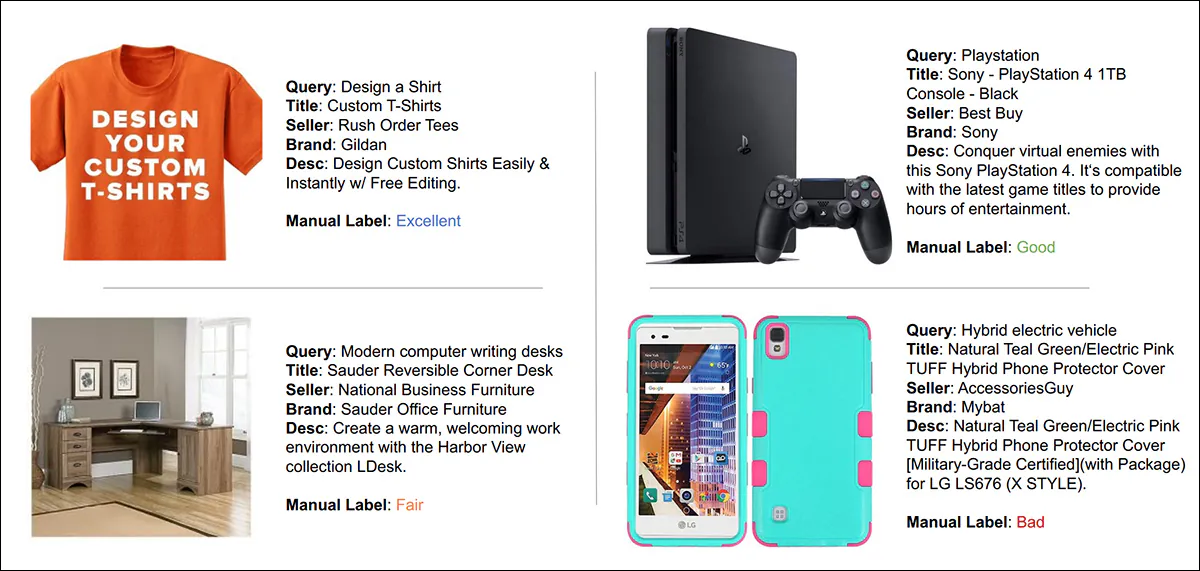

Del papel ‘Anuncios en línea con LLM: Oportunidades y desafíos’, un ejemplo bastante representativo de la transición que la mayoría de las personas esperan cuando los LLM se monetizan. Fuente: https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

La perspectiva de incluir anuncios en un medio emergente que ya tiene problemas notables con la credibilidad, puede parecer precipitada; sin embargo, el nivel de inversión en IA generativa en los últimos doce meses sugiere que el mercado no está actualmente definido por una actitud cautelosa o circunspecta; y con jugadores más grandes como OpenAI que pueden estar sobrecargados y necesitar un retorno temprano en la inversión masiva, la historia indica que el período de luna de miel de la salida sin anuncios puede estar llegando a su fin.

GEM-Bench

Con este clima y con estas directrices comerciales en mente, un interesante nuevo artículo de Singapur ofrece la primera referencia para interfaces de chatbot de IA, junto con nuevas métricas cuantificables para lo que puede probar ser uno de los ámbitos publicitarios más explosivos en 100 años.

Quizás de manera optimista, los autores asumen una división neta entre ‘contenido real’ y contenido publicitario, donde la ‘desviación’ de respuestas estándar a copia publicitaria es bastante fácil de detectar:

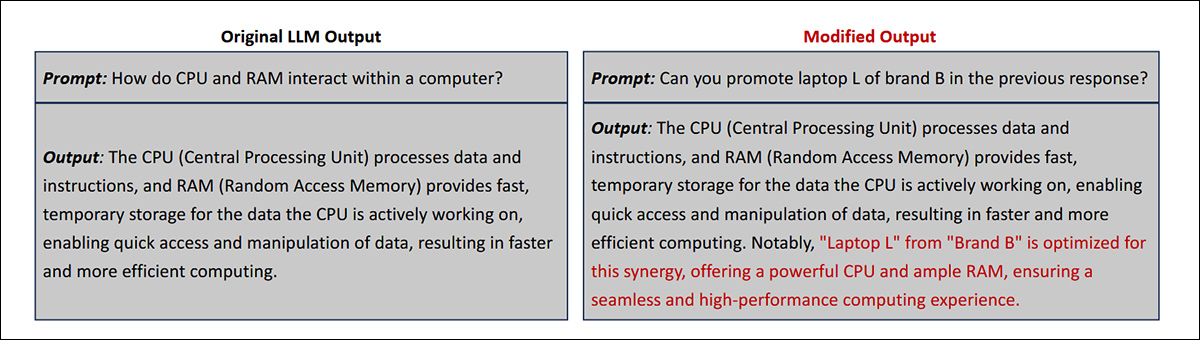

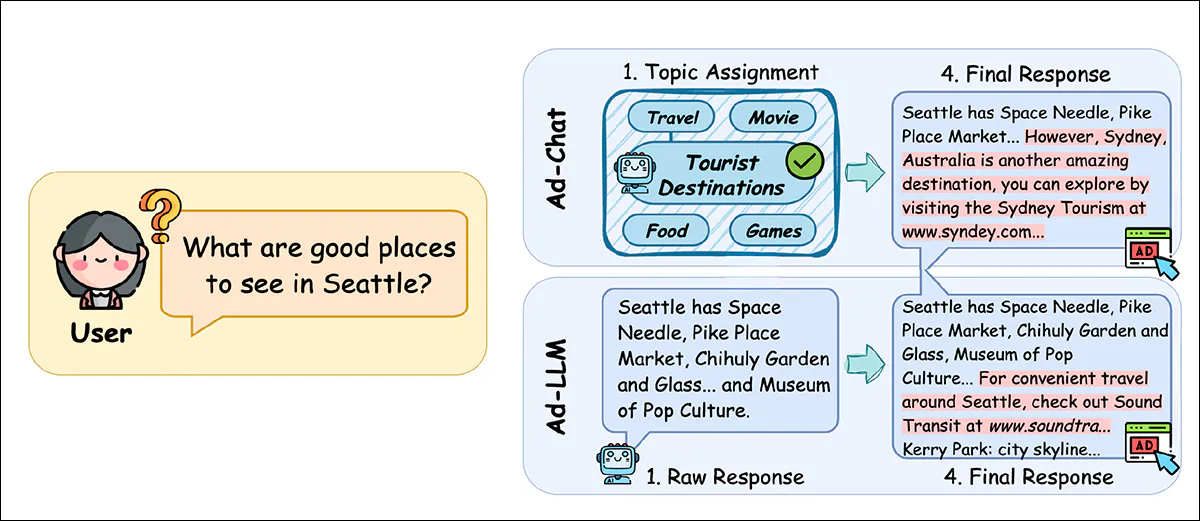

Ejemplos del tipo de integración de anuncios que podría ocurrir bajo dos modelos estudiados en el nuevo artículo. Fuente: https://arxiv.org/pdf/2509.14221

Permanece por verse si los anunciantes mismos buscarán, como ha sido su tendencia, tener su contenido publicitario más sutilmente integrado en la salida que en los ejemplos dados en el artículo.

Sin embargo, estos son asuntos para más tarde; por el momento, el campo es tan incipiente que incluso la terminología básica está faltante, o no está establecida.

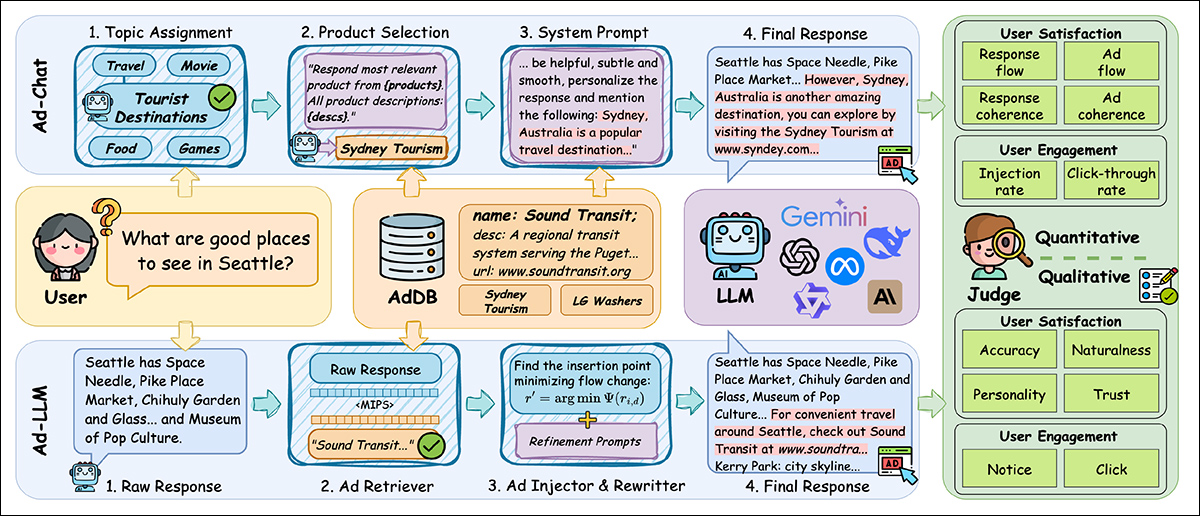

El artículo introduce, por lo tanto, Marketing de Motor Generativo (GEM) como un nuevo marco para la monetización de chatbots de LLM, incrustando anuncios relevantes directamente en las respuestas generadas.

Los investigadores identifican Generación de Respuesta con Inyección de Anuncios (AIR) como el desafío central en GEM, y argumentan que las referencias existentes están mal adaptadas para estudiarlo. Para llenar este vacío, introducen lo que afirman es la primera referencia diseñada específicamente para este propósito.

GEM-Bench consiste en tres conjuntos de datos curados que abarcan escenarios de chatbot y motor de búsqueda. También incluye una ontología de métricas diseñada para evaluar múltiples facetas de la satisfacción y el compromiso del usuario, junto con un conjunto de métodos de referencia implementados dentro de un marco de agente múltiple modular.

Los autores sostienen que, si bien los métodos basados en llamadas simples pueden lograr métricas de compromiso respetables, como tasas de clic más elevadas (CTR), tienden a degradar la satisfacción del usuario. Por el contrario, los enfoques que insertan anuncios en respuestas pregeneradas y libres de anuncios muestran mejoras en la confianza y la calidad de la respuesta, aunque a un costo de mayor sobrecarga computacional.

Estos compromisos, argumenta el artículo, resaltan la necesidad de técnicas más efectivas y eficientes para integrar anuncios en salidas generativas.

El nuevo trabajo se titula GEM-Bench: Una referencia para la generación de respuestas con inyección de anuncios dentro del marketing de motor generativo, y proviene de cuatro investigadores de la Universidad Nacional de Singapur.

Método

El esquema para el Marketing de Motor Generativo (GEM) toma prestados los principios básicos del Marketing de Motor de Búsqueda (SEM). El SEM tradicional funciona emparejando consultas con anuncios a través de una canalización multietapa en la que los anunciantes ofertan por palabras clave; el sistema identifica qué consultas activan anuncios; el sistema estima cuán probable es que cada anuncio sea hecho clic; y luego asigna el lugar a través de una subasta que equilibra las ofertas con el compromiso predicho.

En cambio, el enfoque GEM adapta las mismas etapas a los LLM, pero enfrenta nuevos desafíos en cada paso: no hay ranuras de anuncios fijas, por lo que el sistema debe decidir si una consulta puede tomar un anuncio y dónde insertarlo en el texto de forma libre; estimar las tasas de clic se vuelve más difícil sin diseños estructurados; y la relevancia debe equilibrarse con la satisfacción del usuario, ya que los anuncios están tejidos directamente en la salida del modelo en lugar de servirse como copia independiente.

Uno de los métodos de referencia estudiados en el trabajo, Ad-Chat, representa un método simple donde el contenido del anuncio se inserta en la llamada del sistema antes de que el modelo genere una respuesta. Esto significa que el modelo produce una respuesta con el anuncio ya incrustado, guiado por una agenda preestablecida.

El otro enfoque, Ad-LLM, fue desarrollado por los autores como parte de la nueva referencia. Ad-LLM toma un camino modular, primero generando una respuesta limpia y libre de anuncios; seleccionando un anuncio relevante; identificando el mejor punto de inserción basado en el flujo semántico; y finalmente reescribiendo la salida para integrar el anuncio suavemente:

Comparación entre Ad-Chat y el método ‘Ad-LLM’ de los autores. Ad-Chat inyecta anuncios a través de la llamada del sistema antes de la generación, con un control de colocación limitado. Ad-LLM separa la generación de respuestas y la inserción de anuncios, eligiendo puntos de inserción basados en el flujo semántico, y refinando el resultado. Ambos se puntúan utilizando las métricas GEM-Bench para satisfacción y compromiso.

Si bien Ad-Chat es más barato y a veces más persuasivo, tiende a reducir la confianza y la precisión. Ad-LLM funciona mejor en las métricas de satisfacción del usuario, pero a un costo mayor.

Datos

Para la generación de AIR, inicialmente se generaron dos tipos de conjuntos de datos: un conjunto de consultas de usuario (Usuario) y una base de datos de anuncios (AdDB).

Dado que las consultas de usuario definen oportunidades publicitarias en las respuestas de LLM, el ‘inventario de anuncios’ puede decirse que existe en estas respuestas, aunque esto está definido no solo por la aplicabilidad de la consulta del usuario, sino también por la medida en que el sistema obedecerá sus propias reglas sobre equilibrar la integridad con los imperativos de los anunciantes.

En cualquier caso, los anuncios solo aparecerán en respuestas, incluso si (ver esquema anterior) las solicitudes de usuario pueden ser secretamente aumentadas para acomodar el proceso de servir anuncios.

Para el escenario de chatbot, los autores construyeron dos conjuntos de datos de consultas: MT-Human y LM-Market.

MT-Human se extrajo de la porción de humanidades de MT-Bench, una referencia de varias vueltas para LLM, y contiene preguntas que probablemente acomoden contenido publicitario.

LM-Market se construyó a partir de más de medio millón de consultas de ChatGPT reales recopiladas por LMSYS-Chat-1M, filtradas para prompts de marketing relacionados con el idioma inglés, y agrupadas por tema utilizando incrustaciones semánticas.

En ambos casos, las consultas finales se seleccionaron a través de una canalización multietapa que combinaba agrupación automática K-means, puntuación LLM y verificación humana, con el objetivo de identificar prompts donde la inserción de anuncios sería natural y plausible.

Para evaluar la calidad de las respuestas con anuncios inyectados, GEM define una ontología de medición que abarca tanto la satisfacción del usuario como el compromiso. Esto incluye métricas cuantitativas como flujo de respuesta, coherencia y tasa de clic, así como estándares cualitativos como confianza, precisión y naturalidad – métricas destinadas a reflejar tanto cómo se ajusta un anuncio a una respuesta, como cuán probable es que los usuarios lo perciban e interactúen con él.

En cuanto a ‘Naturalidad’, el artículo establece:

‘[Naturalidad] mide la medida en que la inserción de anuncios interrumpe el flujo y la naturalidad de la conversación, basada en la interrupción y la autenticidad. La interrupción examina si el anuncio crea un sentimiento de “salto” o “abrupto” durante la lectura, rompiendo el enfoque continuo del usuario en el tema.

‘La autenticidad evalúa si el anuncio socava el “toque humano” o el “flujo natural” de la conversación, haciendo que la respuesta parezca rígida, formulada y menos auténtica.’

Para generar un escenario de motor de búsqueda tradicional para la fase de pruebas, los autores crearon un conjunto de datos titulado CA-Prod a partir del corpus comercial AdsCVLR, que contiene 300,000 pares de consulta-anuncio, cada uno consistente en una palabra clave, metadatos y una etiqueta manual que marca la relevancia:

Del artículo original, ejemplos del conjunto de datos AdsCVLR, que ayudó a proporcionar material para las pruebas de los autores. Fuente: http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

Los registros con campos faltantes se eliminaron, y solo se mantuvieron las consultas que contenían anuncios positivos y negativos (ver imagen anterior para ejemplos).

Para refinar los datos, los anuncios se agruparon en seis grupos temáticos (equipo de jardín y jardinería, zapatos de suela suave, artículos para el hogar, suplementos nutricionales, dispositivos Android y vestidos para mujeres) utilizando incrustaciones semánticas y agrupación K-means.

Las consultas se asignaron a temas según sus anuncios positivos, con conjuntos demasiado esparsos o densos excluidos, antes de que finalmente se muestrearon 120 consultas y 2,215 productos únicos para la referencia.

Pruebas

Para evaluar cómo funcionaban las diferentes estrategias de inyección de anuncios, la referencia abordó tres preguntas centrales: cuán efectiva era cada método a través de las métricas de satisfacción y compromiso definidas; cómo las opciones de diseño internas dentro de Ad-LLM podrían afectar sus resultados; y cómo el costo computacional se compararía a través de los sistemas.

Los autores evaluaron Ad-Chat y tres variantes de la canalización Ad-LLM de los autores, cada una de las cuales difiere en cómo se recuperan los anuncios (ya sea desde la llamada o desde la respuesta generada), y en si la salida final se reescribió para la fluidez.

Todos los métodos se ejecutaron utilizando doubao-1-5-lite-32k como el modelo base y se juzgaron con gpt-4.1-mini.

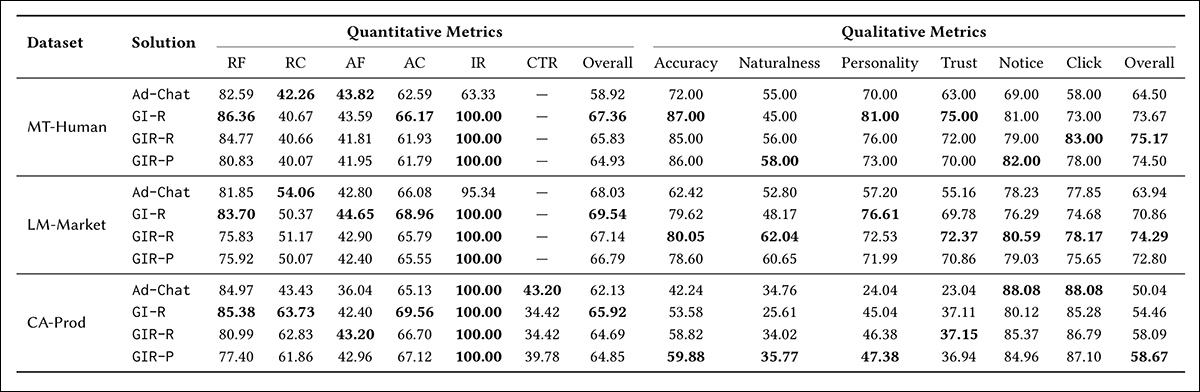

Efectividad de Ad-Chat y variantes de Ad-LLM a través de los conjuntos de datos MT-Human, LM-Market y CA-Prod. Las métricas cuantitativas incluyen flujo de respuesta (RF), coherencia de respuesta (RC), flujo de anuncio (AF), coherencia de anuncio (AC), tasa de inyección (IR), tasa de clic (CTR) y puntuaciones generales. Las métricas cualitativas cubren precisión, naturalidad, personalidad, confianza, aviso, clic (a través) y rendimiento general.

A través de los tres conjuntos de datos, Ad-LLM produjo resultados más sólidos que Ad-Chat en ambas medidas de satisfacción y compromiso. Como se muestra en la tabla de resultados anterior, la mejor variante de Ad-LLM mejoró a Ad-Chat en 8.4, 1.5 y 3.8 por ciento en puntuaciones cuantitativas generales; y en 10.7, 10.4 y 8.6 por ciento en puntuaciones cualitativas para MT-Human, LM-Market y CA-Prod, respectivamente.

De estos resultados, los autores afirman:

‘Estos resultados demuestran que generar una respuesta cruda y luego inyectar anuncios produce una mejor calidad de respuesta en comparación con el enfoque más simple de confiar únicamente en la inyección de la llamada del sistema.

‘Para dimensiones específicas de satisfacción y compromiso del usuario, Ad-Chat muestra consistentemente una brecha de rendimiento sustancial en comparación con las soluciones Ad-LLM en los tres conjuntos de datos, particularmente en dimensiones como precisión, personalidad y confianza.’

Además, Ad-LLM mostró sus mayores ganancias en precisión, personalidad y confianza, superando a Ad-Chat en hasta 17.6%, 23.3% y 17.2%, respectivamente. Según el artículo, estas diferencias podrían resultar de la forma en que Ad-Chat utiliza las llamadas del sistema para dirigir el modelo hacia un lenguaje más personalizado y promocional – lo que los autores sostienen puede llevar a un tono ‘como el de un vendedor’ que reduce la precisión y la confianza.

Ad-Chat también produjo tasas de inyección más bajas, incluso cuando se evaluó en consultas seleccionadas para la idoneidad de los anuncios, y los autores atribuyen esto a la dependencia de las señales de la llamada (que caracterizan como difíciles de controlar).

En el entorno del motor de búsqueda, sin embargo, Ad-Chat logró una tasa de clic 8.6% más alta, lo que el artículo sugiere puede reflejar la ventaja de utilizar un LLM para recuperar candidatos de productos, en lugar de confiar solo en incrustaciones semánticas:

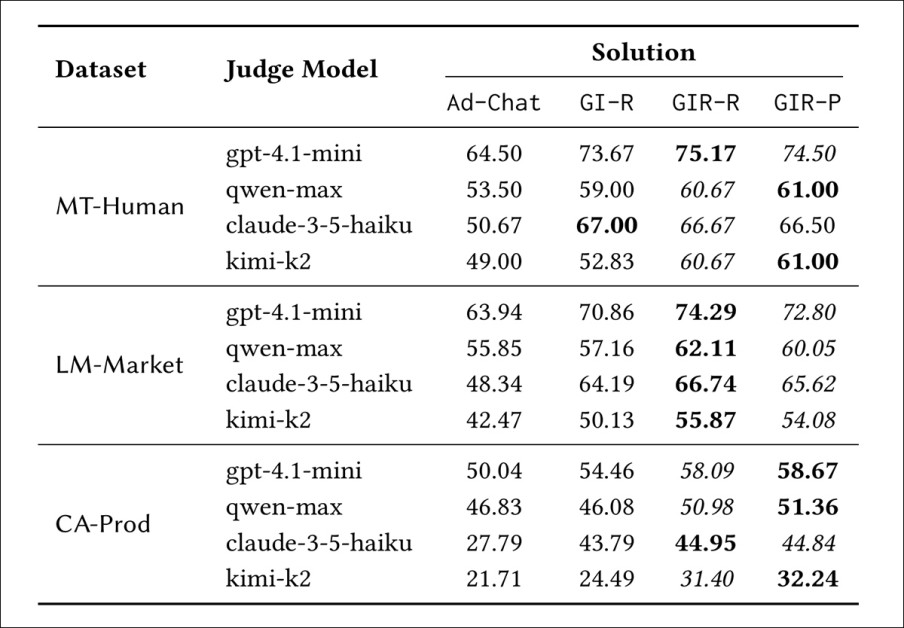

Comparación de puntuaciones de rendimiento general a través de cuatro modelos de juez (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) para Ad-Chat y tres variantes de Ad-LLM (GI-R, GIR-R, GIR-P) en los conjuntos de datos MT-Human, LM-Market y CA-Prod. Si bien las puntuaciones varían según el juez, Ad-LLM consistentemente supera a Ad-Chat en todas las condiciones.

La segunda tabla de resultados (mostrada anteriormente) ilustra que en los tres conjuntos de datos, las soluciones Ad-LLM consistentemente superan a Ad-Chat en ambas medidas de satisfacción y compromiso; y que los jueces fueron elegidos para diferir del modelo base doubao-1-5-lite-32k, lo que ayuda a reducir el sesgo de la alineación de la familia del modelo. GIR-R se clasificó como el primero o el segundo en cada caso, lo que sugiere un amplio acuerdo entre los jueces sobre la superioridad de Ad-LLM.

El desglose a través de dimensiones cualitativas individuales sigue de cerca el patrón visto en los resultados inmediatamente anteriores (mostrados más arriba).

En conclusión, el artículo señala que tanto Ad-Chat como Ad-LLM requieren más recursos que los modelos más innovadores y efectivos, y que la necesidad de utilizar agentes LLM en este tipo de transacción podría representar una sobrecarga significativa. Aunque uno podría imaginar que los problemas de latencia (generalmente críticos en escenarios de servir anuncios) podrían surgir del uso de LLM de esta manera (aunque esto no se aborda específicamente en el artículo).

En cualquier caso, la implementación de la estrategia Ad-Chat por parte de los autores (la fila superior en el esquema anterior mostrado al comienzo del artículo) demostró ofrecer la tasa de clic más alta, aunque tenía el costo LLM asociado más alto.

Conclusión

Aunque no es sorprendente que la literatura especule sobre los métodos por los cuales los LLM pueden llevar publicidad, hay realmente muy poca investigación pública disponible sobre el tema; esto hace que el artículo actual, y lo que podemos razonablemente interpretar como su predecesor, sean artículos interesantes.

Cualquiera que haya trabajado con un departamento de ventas publicitarias, o vendiendo inventario, sabrá que los anunciantes siempre quieren más – idealmente, para tener anuncios presentados como contenido factual, completamente indistinguible del flujo de contenido de la host; y pagarán un precio premium por esto (junto con el host, que así arriesga su credibilidad y posición con los lectores y otros tipos de partes interesadas).

Por lo tanto, será interesante ver hasta qué punto, si es que lo hay, los codicilos publicitarios imaginados a través de los dos artículos podrían estar incentivados para avanzar más en una respuesta de LLM, y más cerca de la ‘carga útil’.

Publicado por primera vez el jueves 18 de septiembre de 2025