Ángulo de Anderson

Rompecabezas de rompecabezas mejoran el razonamiento visual de la IA

Nueva investigación indica que los modelos de IA pueden volverse más inteligentes al resolver rompecabezas. Reorganizar imágenes, videos y escenas 3D desordenadas ayuda a afilar sus habilidades visuales sin necesidad de datos adicionales, etiquetas o herramientas.

En la actual carrera por impulsar a los Modelos de Lenguaje Multimodal Grande (MLLMs) por delante del paquete (o al menos mantener tres lanzamientos por delante del rival más cercano), hay pocas victorias fáciles y no hay comidas gratis.

Aunque muchos de los impresionantes lanzamientos de FOSS chinos de 2025 se informan que tienen menores costos de desarrollo y ejecución, los lanzamientos occidentales tienden a arrojar más al problema: más volumen de datos, más potencia de inferencia, más electricidad (aunque no, como mencionamos recientemente, más anotadores humanos reales, ya que eso es demasiado caro incluso para la revolución de la IA de escala de $trillones+).

En la literatura de investigación, la mayoría de los enfoques supuestamente “gratis” para la evolución de las arquitecturas de la IA tienden a ofrecer solo mejoras incrementales menores; o bien, mejoras en áreas que no son las más críticamente perseguidas. Sin embargo, la búsqueda de “principios fundamentales” hasta ahora desconocidos que podrían acelerar el ritmo del desarrollo es demasiado tentadora para abandonarla.

Recoger las piezas

Mientras que no está exactamente en esa categoría, una nueva colaboración académica entre instituciones chinas afirma haber determinado que hacer que los VLMs resuelvan rompecabezas mejora su rendimiento de manera notable, aunque este enfoque de aprendizaje por refuerzo ha realizado mal en esta área anteriormente, y aunque no requiere sistemas, modelos o procesos adicionales “incrustados”:

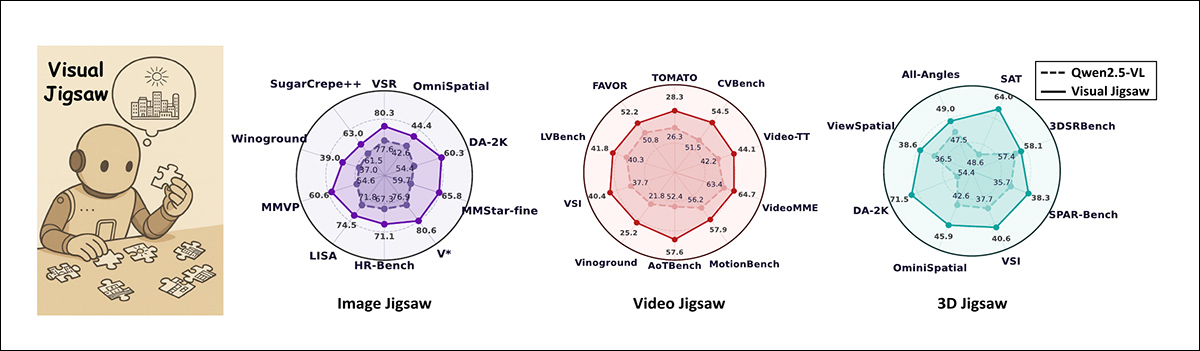

Visual Jigsaw es un marco de postentrenamiento auto-supervisado que mejora las habilidades visuales en modelos de lenguaje multimodal grande. Al entrenar en tareas de rompecabezas a través de imágenes, videos y datos 3D, los modelos ganan una percepción más fina, espacial y composicional en imágenes, una comprensión temporal más fuerte en videos y una comprensión geométrica mejorada en escenas 3D. Los gráficos de radar en la imagen superior muestran ganancias consistentes sobre Qwen2.5-VL, con escalas de valor ajustadas para cada benchmark para claridad. Fuente: https://arxiv.org/pdf/2509.25190

El sistema ideado por los investigadores se titula Visual Jigsaw, y consiste en entrenar a MLLMs existentes en material que ha sido fragmentado y disperso aleatoriamente, como un rompecabezas. Los autores desarrollaron tres modalidades para este enfoque: imagen, video y 3D (es decir, mallas estilo CGI), y encontraron que una adaptación moderada del mismo proceso benefició a los tres dominios:

Una representación de las tres tareas de Visual Jigsaw. En el Rompecabezas de imagen, una imagen se divide en parches, se barajan y el modelo predice el diseño correcto; en el Rompecabezas de video, los clips se barajan y el modelo restaura su orden en el tiempo; en el Rompecabezas 3D, los puntos con diferentes profundidades se barajan y el modelo los clasifica de más cercano a más lejano. Las salidas del modelo se puntúan contra la verdad de referencia, con crédito parcial dado por soluciones parcialmente correctas.

El método de entrenamiento de Visual Jigsaw ayuda a los modelos de IA a mejorar en la comprensión de la información visual haciéndolos reensamblar estas imágenes, clips de video o datos 3D desordenados.

El proceso se basa en palabras en lugar de imágenes, y por lo tanto no hay necesidad de que el modelo genere imágenes o utilice componentes visuales adicionales. Este método se ajusta a un sistema llamado Aprendizaje por Refuerzo de Recompensas Verificables (RLVR), donde el modelo recibe una recompensa por respuestas correctas basadas en reglas claras y automáticas; y donde, por lo tanto, no se requiere etiquetado humano.

Este hecho crucial es en realidad difícil de discernir del nuevo artículo: que el sistema está ensamblando el rompecabezas semánticamente, a través de descripciones, y no de la manera representativa de forma que los humanos aprenden a resolver tales rompecabezas:

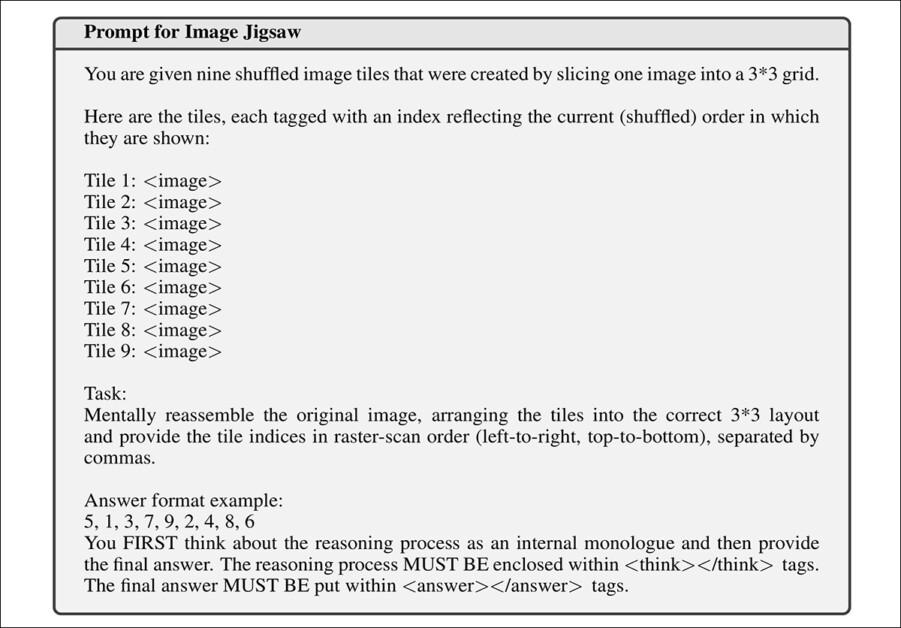

Del material suplementario del nuevo artículo, un ejemplo de tarea de RL que ilustra la naturaleza basada en texto de este proceso de aprendizaje adjunto. Las imágenes que se habrían mostrado al MLLM no se muestran aquí.

Aunque los MLLMs tratan ampliamente con tareas centradas en la visión, son arquitecturas basadas en lenguaje, no diseñadas para generar imágenes, videos o representaciones de forma como mallas 3D.

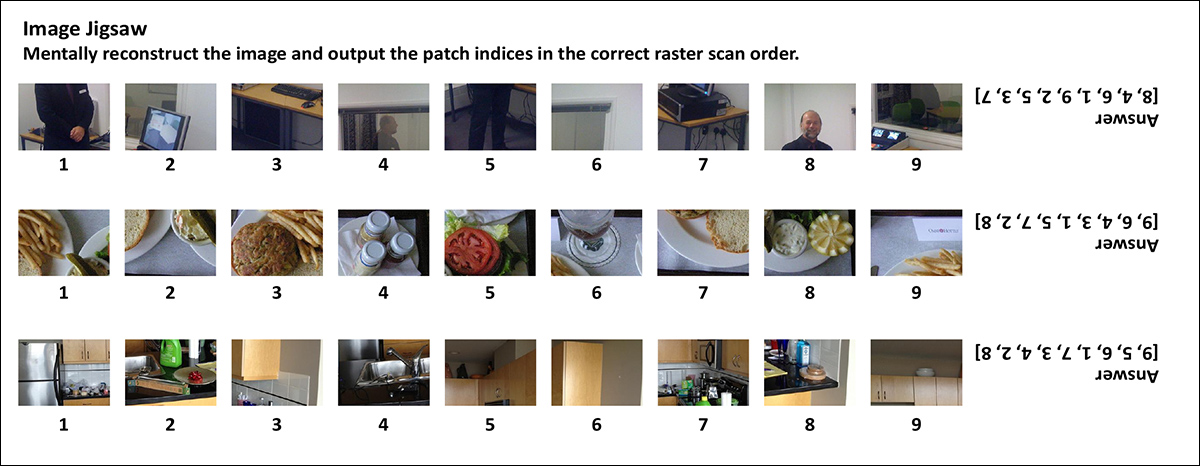

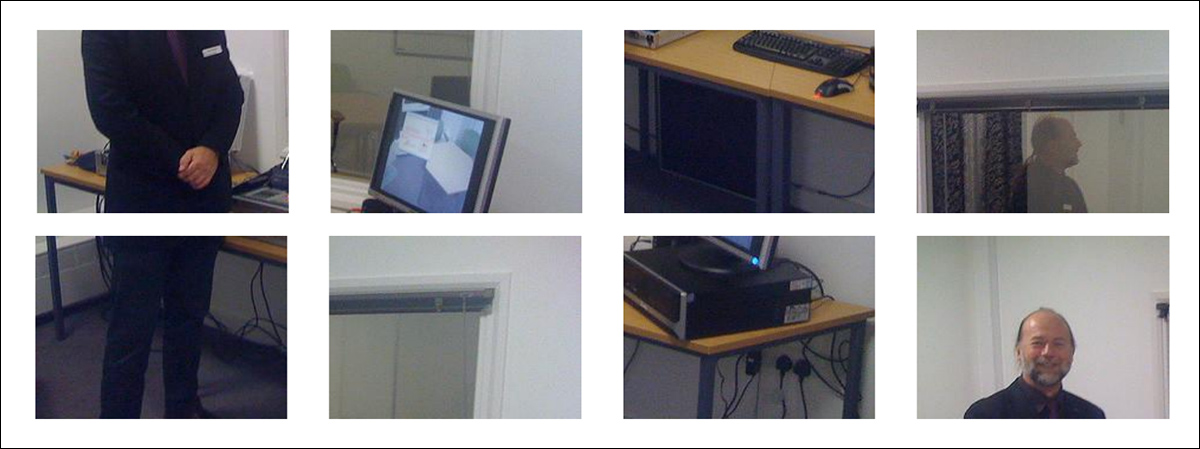

Ejemplos de la tarea de rompecabezas de imagen. Cada fila muestra parches barajados que el modelo debe reordenar en su diseño original, con el arreglo correcto mostrado a la derecha.

En cualquier caso, este tipo de entrenamiento se realiza después de la fase de aprendizaje principal, cuando el modelo ya tiene alguna capacidad para comprender imágenes.

Enfoques anteriores como el artículo suizo de 2017 Aprendizaje no supervisado de representaciones visuales resolviendo rompecabezas utilizaron este tipo de enfoque de refuerzo con bastante menos éxito, en redes neuronales convolucionales (CNN), una arquitectura notablemente diferente en comparación con un MLLM moderno.

Del lanzamiento de 2017 ‘Aprendizaje no supervisado de representaciones visuales resolviendo rompecabezas’, un ejemplo temprano del uso de la fragmentación como desafío basado en recompensa para un sistema neural. Fuente: https://arxiv.org/pdf/1603.09246

En las pruebas, Visual Jigsaw condujo a lo que los autores afirman son mejoras consistentes y medibles en una amplia gama de benchmarks: la tarea de rompecabezas de imagen mejoró la percepción fina, la comprensión de la disposición espacial y el razonamiento composicional; la tarea de rompecabezas de video mejoró la capacidad del modelo para rastrear secuencias temporales y razonar sobre el orden de los eventos; y la tarea de rompecabezas 3D fortaleció la comprensión basada en la profundidad y el razonamiento espacial utilizando solo entradas RGB-D.

A través de las tres modalidades, el artículo reitera, el nuevo método superó a varias líneas de base competitivas, a pesar de no requerir cambios arquitectónicos, módulos visuales adicionales o datos supervisados adicionales:

‘Experimentos extensivos demuestran mejoras sustanciales en la percepción fina, el razonamiento temporal y la comprensión espacial 3D. Nuestros hallazgos destacan el potencial de tareas visuales auto-supervisadas en el post-entrenamiento de MLLMs y apuntan a inspirar más investigaciones sobre diseños de pretextos centrados en la visión.’

El nuevo artículo se titula Visual Jigsaw Post-Training Improves MLLMs, y proviene de seis investigadores de Nanyang Technological University, Linköping University y SenseTime Research. El artículo viene acompañado de un sitio web del proyecto con demos en vivo (y puedes cargar incluso tu propia imagen en el demo de rompecabezas de imagen). El código y pesos del proyecto se han hecho disponibles de manera general,

Método

Aunque echemos un vistazo a la forma en que se divide la información para acomodar las tres modalidades probadas, primero debemos considerar el diseño de recompensa para el nuevo sistema.

El enfoque de Visual Jigsaw puntúa las respuestas del modelo utilizando una recompensa calificada, no solo un simple aprobado o reprobado. Si el modelo predice el orden exacto correcto de las piezas del rompecabezas, recibe una recompensa completa; si la respuesta es en su mayoría correcta, pero no perfecta, el modelo recibe un crédito parcial, escalado por un factor de descuento para evitar sobrevalorar los aciertos parciales (esto evita que el modelo haga trampa en el sistema repitiendo suposiciones que son solo parcialmente correctas).

Las respuestas inválidas, como el ‘engaño’ de usar el mismo número repetidamente, reciben una puntuación de cero. Para fomentar la formación consistente, el modelo debe colocar su razonamiento dentro de <think> y su respuesta final dentro de <answer>. Recibe un pequeño bono si se utiliza este formato correctamente.

Imágenes

Para crear un rompecabezas para la modalidad de imagen, una imagen se divide primero en una cuadrícula de parches cortándola en bloques de tamaño igual:

Ejemplos de parches de imagen para que el sistema los resuelva.

Los parches se disponen en un orden fijo de izquierda a derecha, como el orden de lectura en una página, antes de ser barajados con un shuffle aleatorio. El modelo se expone entonces a este conjunto de parches barajados y debe figurar el orden original prediciendo la permutación correcta que restaura el diseño original.

En el entrenamiento, se utilizaron 118,000 imágenes del conjunto de datos COCO, con cada imagen que producía nueve parches (es decir, ‘piezas de rompecabezas’). La solicitud presentada al sistema se muestra al comienzo de este artículo (la imagen anterior con la leyenda que comienza ‘Del material suplementario del nuevo artículo’).

Video

Para la tarea de rompecabezas de video, un video se corta en una secuencia de clips cortándolo uniformemente a lo largo del tiempo, y luego se barajan los segmentos de clip. El modelo se le muestra entonces esta secuencia desordenada y debe figurar su orden cronológico original correcto.

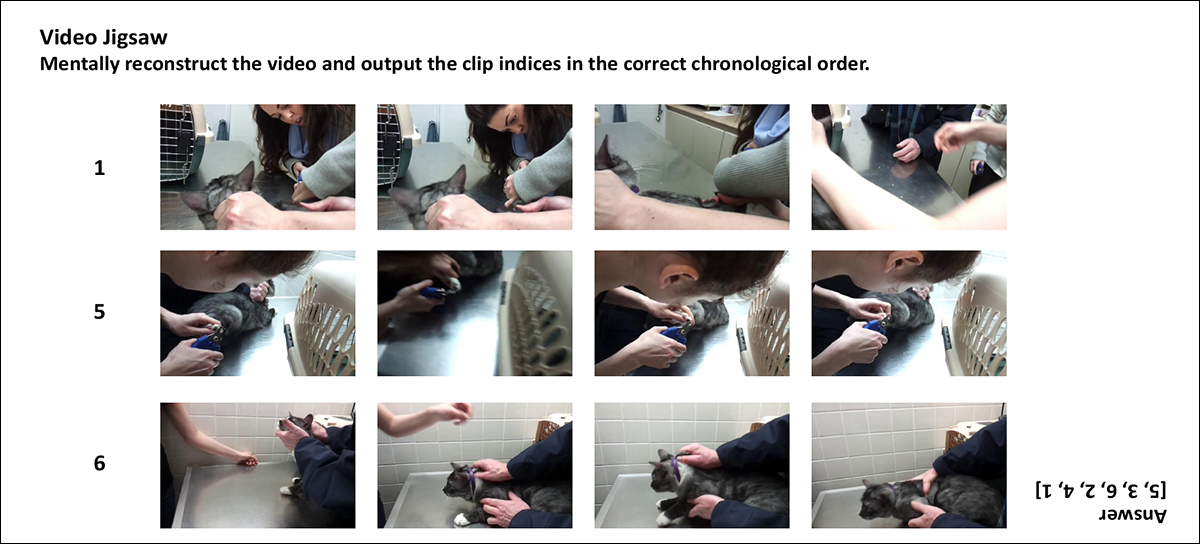

Ejemplos truncados del desafío del rompecabezas de video, del material suplementario del artículo.

El entrenamiento para esta modalidad utilizó 100,000 videos del conjunto de datos LLaVA-Video, con cada video dividido en seis clips. Para evitar que el modelo explote las pistas de coincidencia de marco obvias en los límites de los clips, se cortaron el 5% de los fotogramas al comienzo y final de cada clip.

Los clips contenían no más de 12 fotogramas, cada uno con una resolución máxima de 128x28x28 píxeles. Se excluyeron los videos más cortos de 24 segundos.

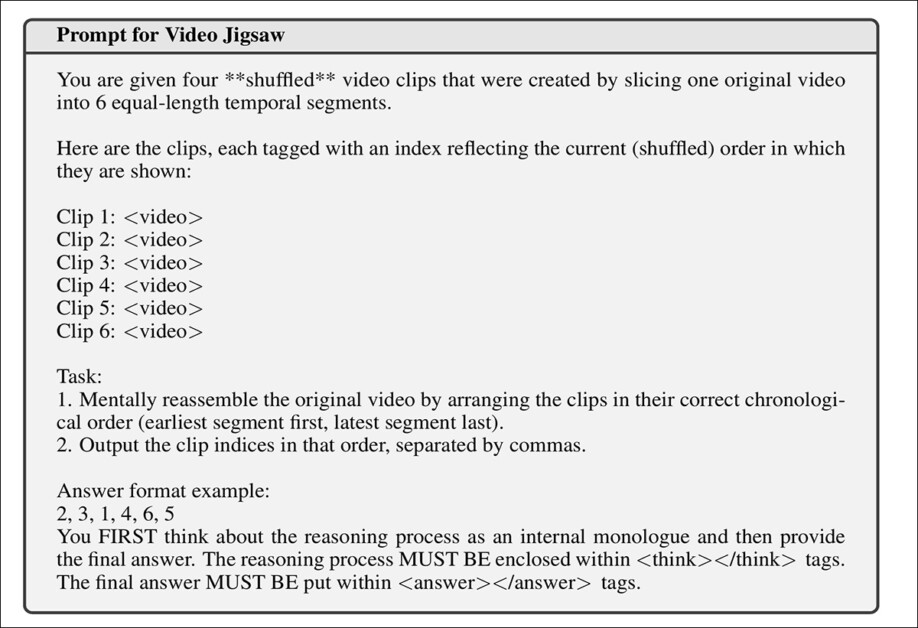

La solicitud para esta tarea se muestra a continuación:

La solicitud de aprendizaje por refuerzo presentada a los MLLMs para la tarea de video, sin los clips que se habrían presentado al MLLM..

Datos 3D

Una tarea de rompecabezas 3D completa normalmente implicaría descomponer un espacio 3D (como bloques de voxel o fragmentos de nube de puntos) en fragmentos más pequeños y entrenar a un modelo para reconstruir su disposición espacial original.

Sin embargo, el MLLM promedio no está equipado para manejar datos 3D crudos directamente, en su lugar confía en entradas de imagen o video interpretadas semánticamente. Por lo tanto, para crear una tarea que aún aproveche el razonamiento 3D mientras permanece compatible con los MLLMs actuales, los autores introdujeron una variante más manejable que utiliza las mencionadas imágenes RGB-D (es decir, imágenes 2D que incluyen información de profundidad para cada píxel).

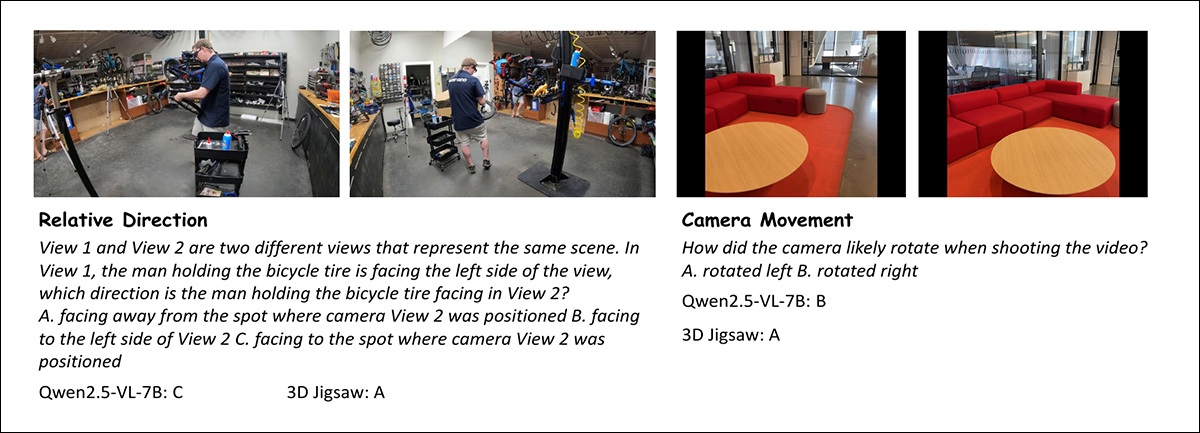

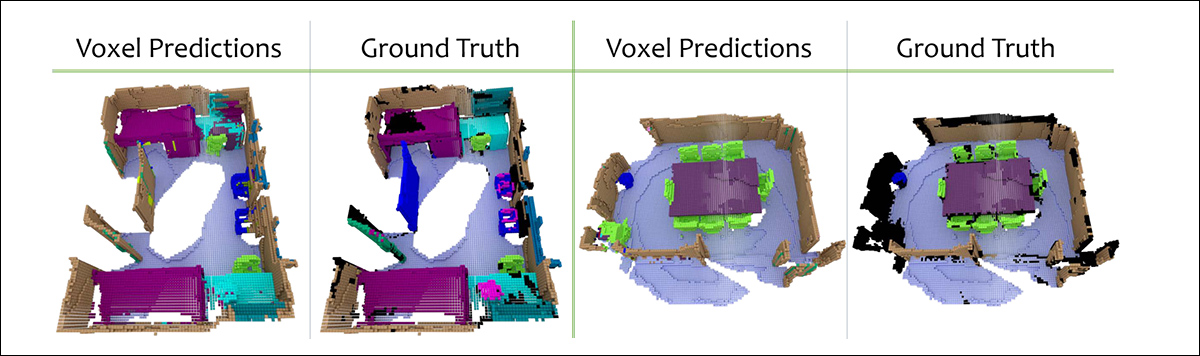

Ejemplos de preguntas del Benchmark de Comprensión Espacial 3D utilizado para evaluar el rendimiento en razonamiento de punto de vista relativo y movimiento de cámara. El modelo 3D Jigsaw infiere correctamente tanto la relación espacial entre dos vistas de una escena como la probable dirección de rotación de la cámara, superando a la línea de base Qwen2.5-VL-7B.

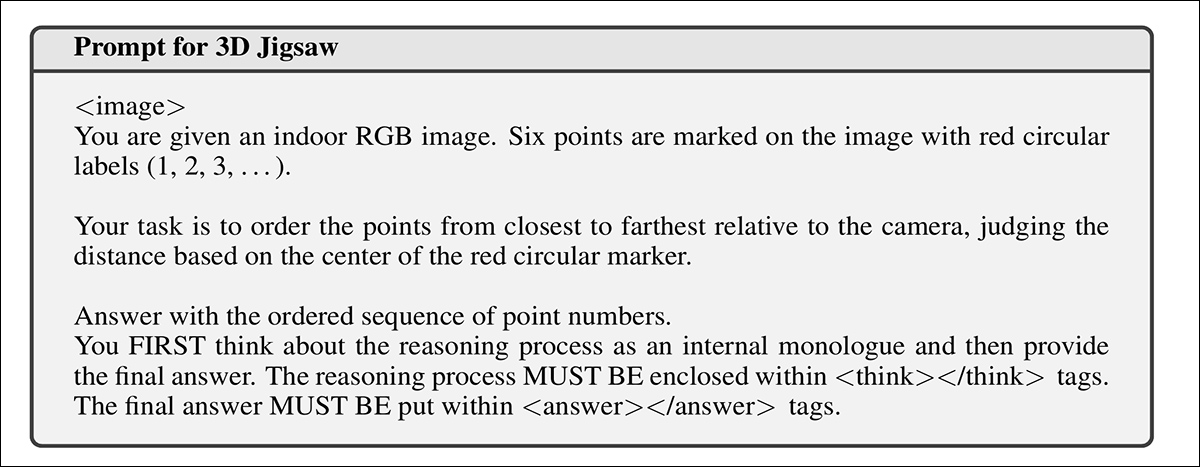

De cada imagen RGB-D, el modelo se le da una lista de puntos que originalmente tenían profundidades distintas, que van desde cerca hasta lejos, con el objetivo de recuperar su orden de profundidad correcto utilizando solo la imagen 2D como referencia:

La solicitud de RL para el rompecabezas 3D.

Cada punto está marcado en la imagen (que se muestra al modelo, pero no se visualiza en el ejemplo de solicitud de la imagen directamente arriba), y el modelo debe predecir cuál estaba más cerca, segundo más cerca, y así sucesivamente, efectivamente reconstruyendo la secuencia de profundidad original sin acceso a los valores de profundidad crudos.

La tarea de rompecabezas 3D se entrena en imágenes RGB-D del conjunto de datos ScanNet, utilizando 300,000 muestras creadas seleccionando conjuntos aleatorios de seis puntos de profundidad por imagen.

Ejemplos de nubes de puntos del conjunto de datos ScanNet utilizado en el rompecabezas 3D. Fuente: https://arxiv.org/pdf/1702.04405

Cada punto debía estar dentro de un rango de profundidad de 0,1 a 10 metros, y para promover la diversidad, no se permitió que dos puntos en un conjunto estuvieran más cerca de 40 píxeles en el plano de la imagen, o menos de 0,2 metros de distancia en profundidad.

Pruebas

Para las pruebas iniciales, el sistema utilizó Qwen2.5-VL-7B-Instruct como el modelo multimodal base. El entrenamiento utilizó el algoritmo de Optimización de Política Relativa de Grupo (GRPO), con regularización KL y pérdida de entropía eliminadas.

Para predicciones parciales, se aplicó un factor de descuento de 0,2. El entrenamiento de la tarea de rompecabezas de imagen utilizó un tamaño de lote global de 256, mientras que los rompecabezas de video y 3D utilizaron 128. La tasa de aprendizaje se estableció en 1×10⁻⁶.

Para cada solicitud, el modelo generó 16 respuestas a una temperatura de decodificación de 1,0. Tanto la tarea de rompecabezas de imagen como la de video se entrenaron durante 1.000 pasos, mientras que la tarea de rompecabezas 3D se entrenó durante 800 pasos.

Rompecabezas de imagen

El modelo de rompecabezas de imagen se probó en tres categorías de benchmarks visuales centrados: para la percepción y comprensión fina, MMVP, el subconjunto de percepción fina de MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; y OVD-Eval.

Para la comprensión espacial monocular, los benchmarks fueron VSR; OmniSpatial; y Depth Anything V2 (DA-2K). Para la comprensión visual composicional, las pruebas emplearon Winoground y SugerCrepe++.

Se probaron tres líneas de base, todas derivadas de Qwen2.5-VL-7B: ThinkLite-VL para el razonamiento multimodal; VL-Cogito para tareas visuales y científicas generales; y LLaVA-Critic-R1 para la percepción de imagen.

Todos se evaluaron utilizando solo respuestas cortas, ya que el razonamiento de cadena de pensamiento (CoT) a veces redujo el rendimiento.

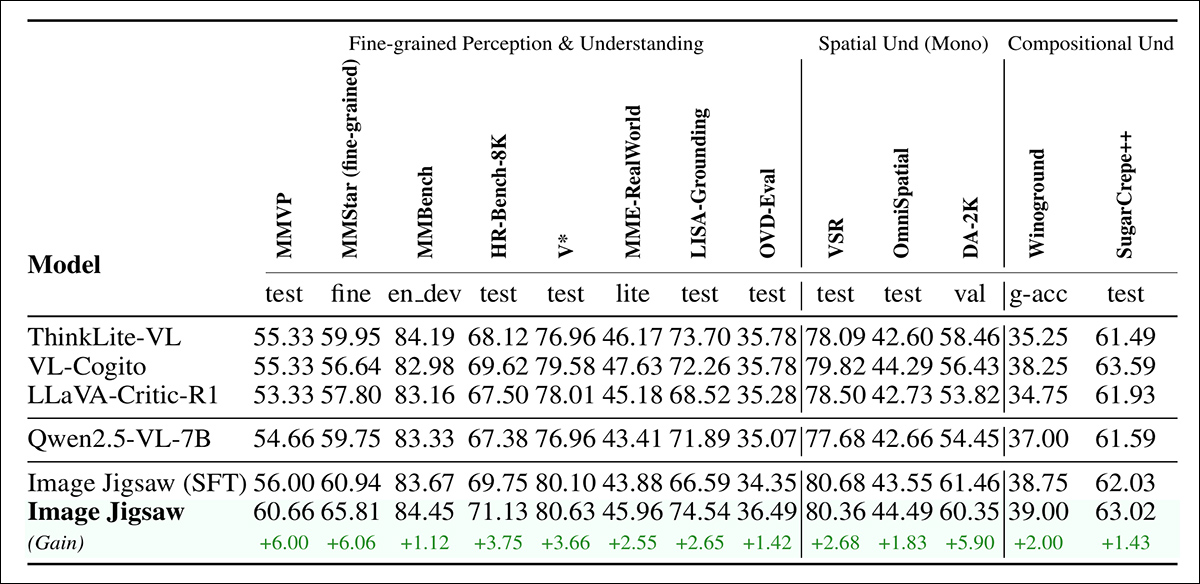

Resultados de evaluación en benchmarks de imagen. El rompecabezas de imagen mejoró en el modelo base Qwen2.5-VL-7B en todas las categorías de tareas (es decir, percepción y comprensión fina; comprensión espacial monocular; y razonamiento visual composicional), superando a las líneas de base post-entrenadas anteriores.

De los resultados del rompecabezas de imagen, que se muestran arriba, los autores afirman:

‘[La imagen anterior] muestra que nuestro método mejora consistentemente las capacidades visuales centradas en los tres tipos de benchmarks. Estos resultados confirman que incorporar el post-entrenamiento de rompecabezas de imagen mejora significativamente la base y la comprensión visual fina de los MLLMs más allá de las estrategias de post-entrenamiento centradas en el razonamiento.

‘Atribuimos estas mejoras al hecho de que resolver rompecabezas de imagen requiere que el modelo preste atención a los detalles de los parches locales, infiera diseños espaciales globales y razone sobre las relaciones entre parches, lo que beneficia directamente la comprensión fina, espacial y composicional.’

Rompecabezas de video

Para el rompecabezas de video, la evaluación se realizó en AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; y CVBench.

Video-R1 se utilizó como línea de base, habiendo sido entrenado con un ajuste fino supervisado de inicio en frío seguido de aprendizaje por refuerzo para la comprensión y el razonamiento de video. En este caso, las evaluaciones incluyeron el proceso de razonamiento completo, ya que esto produjo consistentemente mejores resultados que las respuestas directas.

Todos los modelos se limitaron a 256x28x28 píxeles y se probaron en tres configuraciones de fotogramas: 16, 32 y 64:

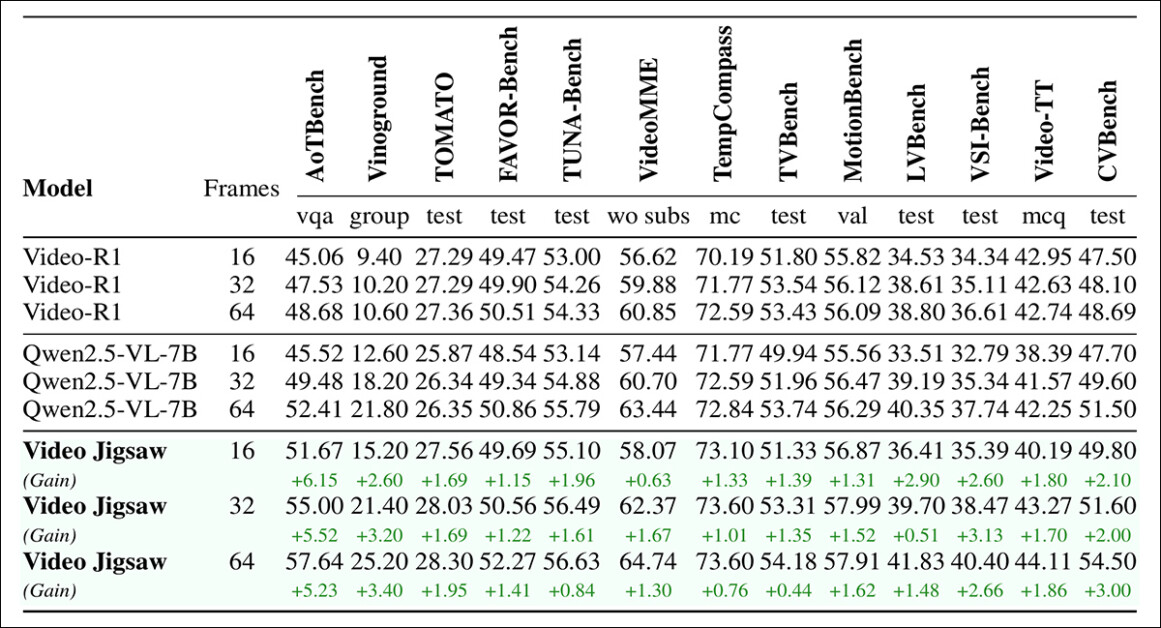

Resultados de evaluación en benchmarks de video, con Video Jigsaw superando consistentemente a la línea de base en todas las tareas y configuraciones de fotogramas.

El rompecabezas de video produjo mejoras consistentes en todos los benchmarks de comprensión de video y configuraciones de fotogramas, con ganancias particularmente fuertes en tareas que requieren razonamiento temporal y direccionalidad, como las de AoTBench, y también en benchmarks de razonamiento entre videos, como CVBench:

‘Estos resultados confirman que resolver tareas de rompecabezas de video anima al modelo a capturar mejor la continuidad temporal, a comprender las relaciones entre videos, a razonar sobre la consistencia direccional y a generalizar a escenarios de comprensión de video holística y generalizable.’

Datos 3D

Para la modalidad 3D, el modelo se evaluó en SAT-Real; 3DSRBench; ViewSpatial; All-Angles; el mencionado anteriormente OmniSpatial; VSI-Bench; SPARBench (tiny); y el mencionado anteriormente DA-2K.

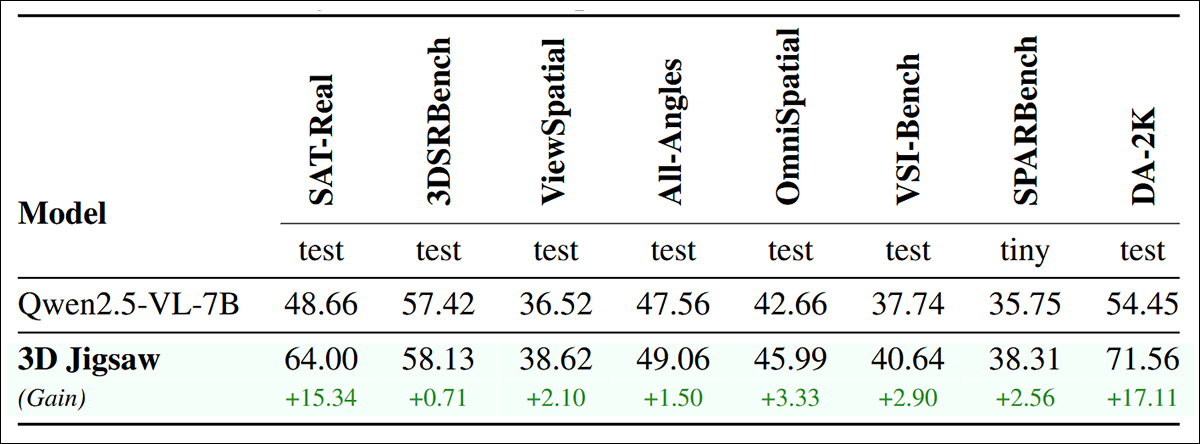

Resultados de evaluación en benchmarks 3D: 3D Jigsaw mejoró el rendimiento en tareas de comparación de profundidad como DA-2K, así como en benchmarks de percepción 3D más amplios que cubren entradas de vista única, múltiple y video egocéntrico.

Aquí los autores afirman:

‘[3D] Jigsaw logra mejoras significativas en todos los benchmarks. No sorprendentemente, la mayor ganancia es en DA-2K, un benchmark de estimación de profundidad que está directamente relacionado con nuestra tarea de pre-entrenamiento de ordenamiento de profundidad. Más importante aún, observamos mejoras consistentes en una amplia gama de otras tareas, incluidas aquellas con entradas de vista única (por ejemplo, 3DSRBench, [OmniSpatial]), múltiple (por ejemplo, ViewSpatial, All-Angles) y video egocéntrico (por ejemplo, VSI-Bench).

‘Estos resultados demuestran que nuestro enfoque no solo enseña la habilidad específica del ordenamiento de profundidad, sino que también fortalece efectivamente la capacidad general del modelo para percibir y razonar sobre la estructura espacial 3D.’

Conclusión

Lo que no está del todo claro en este artículo es la relación exacta entre imágenes y descripciones que está impulsando esta mejora en el rendimiento de los MLLMs.

A primera vista, el proceso de aprendizaje a través de la resolución de rompecabezas parece muy análogo a nuestras propias primeras incursiones y desarrollo. Sin embargo, nuestra propia interpretación espacial del mundo instintivamente se siente menos semántica y relacionada con el lenguaje, y una mirada más profunda al artículo revela la medida en que el lenguaje sirve a los MLLMs como un puente intrigante entre realidades visuales y semánticas.

* Por favor, tenga en cuenta que los autores del artículo prefieren el término menos común ‘Modelos de Lenguaje Multimodal Grande’, abreviado como ‘MLLMs’. Este es un término emergente o poco frecuente, y se aplica a modelos que pueden razonar y analizar imágenes espacialmente de manera extensiva, pero que no generan imágenes. A medida que surgen nuevos paradigmas y modelos, este léxico está en constante revisión.

Publicado por primera vez el jueves 2 de octubre de 2025