Ángulo de Anderson

La lucha de la IA para leer relojes analógicos puede tener un significado más profundo

Un nuevo artículo de investigadores de China y España encuentra que incluso modelos de IA multimodales avanzados como GPT-4.1 luchan por decir la hora a partir de imágenes de relojes analógicos. Pequeños cambios visuales en los relojes pueden causar errores de interpretación importantes, y el ajuste fino solo ayuda con ejemplos familiares. Los resultados plantean preocupaciones sobre la confiabilidad de estos modelos cuando se enfrentan a imágenes desconocidas en tareas del mundo real.

Cuando los humanos desarrollamos una comprensión lo suficientemente profunda de un dominio, como la gravedad o otros principios físicos básicos, vamos más allá de ejemplos específicos para comprender las abstracciones subyacentes. Esto nos permite aplicar ese conocimiento de manera creativa en diferentes contextos y reconocer nuevas instancias, incluso aquellas que nunca hemos visto antes, identificando el principio en acción.

Cuando un dominio lleva suficiente importancia, podemos incluso comenzar a percibirlo donde no existe, como con pareidolia, impulsado por el alto costo de no reconocer una instancia real. Tan fuerte es este mecanismo de reconocimiento de patrones de supervivencia que incluso nos dispone a encontrar una gama más amplia de patrones donde no hay ninguno.

La exposición temprana y repetitiva a un dominio se instila en nosotros, más profundo su base y persistencia de por vida; y uno de los conjuntos de datos visuales más tempranos a los que nos exponemos como niños viene en forma de relojes de enseñanza, donde se utilizan materiales impresos o relojes analógicos interactivos para enseñarnos a decir la hora:

Ayudas de enseñanza para ayudar a los niños a aprender a decir la hora. Fuente: https://www.youtube.com/watch?v=IBBQXBhSNUs

Aunque los cambios en la moda del diseño de relojes pueden desafiarnos a veces, la resistencia de este dominio de aprendizaje temprano es bastante impresionante, lo que nos permite discernir caras de reloj analógico incluso en el caso de opciones de diseño complejas o ‘excéntricas’:

Algunas caras desafiantes en la confección de relojes. Fuente: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Los humanos no necesitan miles de ejemplos para aprender cómo funcionan los relojes; una vez que se comprende el concepto básico, podemos reconocerlo en casi cualquier forma, incluso cuando se distorsiona o se abstrae.

La dificultad que enfrentan los modelos de IA con esta tarea, por otro lado, destaca un problema más profundo: su aparente fuerza puede depender más de la exposición a alto volumen que de la comprensión.

Más allá del juego de imitación!

La tensión entre el rendimiento a nivel de superficie y la comprensión genuina ha surgido repetidamente en investigaciones recientes de grandes modelos. El mes pasado, la Universidad de Zhejiang y la Universidad de Westlake replantearon la pregunta en un artículo titulado ¿Los LLM de nivel de doctorado realmente comprenden la adición elemental? (no es el enfoque de este artículo), concluyendo:

‘A pesar de los benchmarks impresionantes, los modelos muestran una dependencia crítica de la coincidencia de patrones en lugar de una comprensión real, evidenciada por fallos con representaciones simbólicas y violaciones de propiedades básicas.

‘La provisión de reglas explícitas que perjudican el rendimiento sugiere limitaciones arquitectónicas inherentes. Estas perspectivas revelan brechas de evaluación y resaltan la necesidad de arquitecturas capaces de razonamiento matemático genuino más allá del reconocimiento de patrones.’

Esta semana, la pregunta surge nuevamente, ahora en una colaboración entre la Universidad de Aeronáutica y Astronáutica de Nanjing y la Universidad Politécnica de Madrid en España. Titulado ¿Han aprendido realmente los modelos de lenguaje multimodal (MLLM) a decir la hora en relojes analógicos?, el nuevo artículo explora cómo entienden los modelos multimodales el decir la hora.

Aunque el progreso de la investigación se cubre solo en detalle general en el artículo, las pruebas iniciales de los investigadores establecieron que el modelo de lenguaje multimodal GPT-4.1 de OpenAI luchó para leer correctamente la hora a partir de un conjunto diverso de imágenes de relojes, a menudo dando respuestas incorrectas incluso en casos simples.

Esto apunta a una posible brecha en el conjunto de datos de entrenamiento del modelo, planteando la necesidad de un conjunto de datos más equilibrado para probar si el modelo puede aprender realmente el concepto subyacente. Por lo tanto, los autores curaron un conjunto de datos sintéticos de relojes analógicos, cubriendo uniformemente todos los momentos posibles y evitando los sesgos habituales en las imágenes de Internet:

Un ejemplo del conjunto de datos sintéticos de relojes analógicos de los investigadores, utilizado para ajustar un modelo GPT en el nuevo trabajo. Fuente: https://huggingface.co/datasets/migonsa/analog_watches_finetune

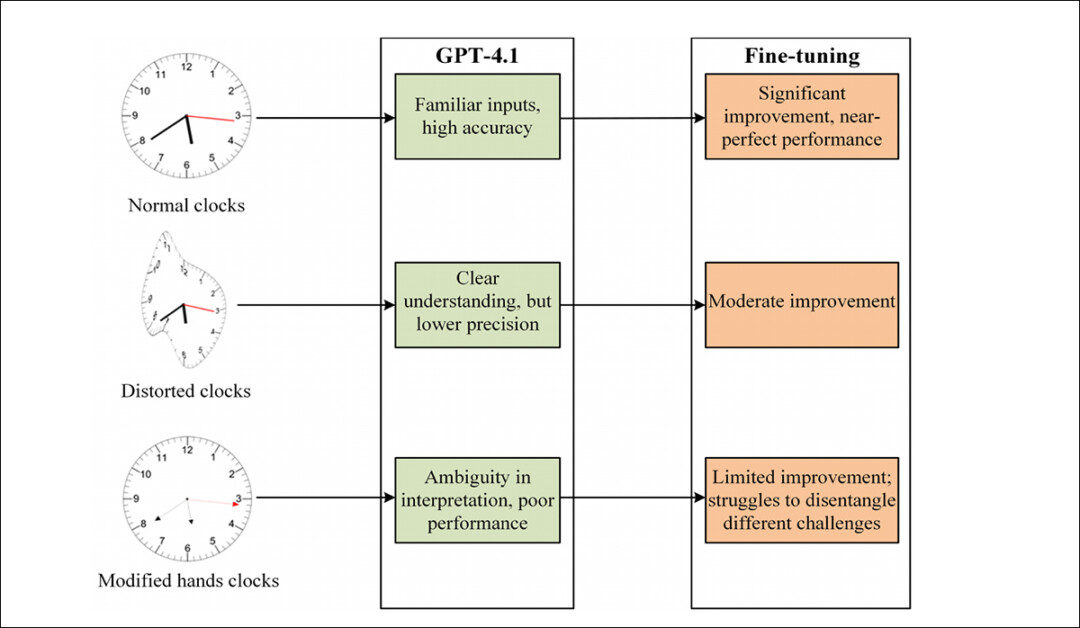

Antes de ajustar en el nuevo conjunto de datos, GPT-4.1 falló consistentemente al leer estos relojes. Después de alguna exposición al nuevo conjunto, su rendimiento mejoró, pero solo cuando las nuevas imágenes se parecían a las que ya había visto.

Cuando la forma del reloj o el estilo de las manecillas cambiaban, la precisión caía bruscamente; incluso pequeños ajustes, como manecillas más delgadas o puntas de flecha (imagen más a la derecha a continuación), eran suficientes para desviarlo; y GPT-4.1 luchó además para interpretar relojes ‘melting’ de Dali:

Imágenes de relojes con diseño estándar (izquierda), forma distorsionada (centro) y manecillas modificadas (derecha), junto con los tiempos devueltos por GPT-4.1 antes y después del ajuste. Fuente: https://arxiv.org/pdf/2505.10862

Los autores deducen que los modelos actuales como GPT-4.1 pueden aprender a leer relojes principalmente a través de coincidencia de patrones visuales, en lugar de algún concepto más profundo de tiempo, afirmando:

‘[GPT 4.1] falla cuando el reloj está deformado o cuando las manecillas se cambian para ser más delgadas y tener una punta de flecha. El Error Absoluto Medio (MAE) en la estimación de tiempo sobre 150 tiempos aleatorios fue de 232,48 s para los relojes iniciales, 1380,69 s cuando la forma se deforma y 3726,93 s cuando se cambian las manecillas.

‘Estos resultados sugieren que el MLLM no ha aprendido a decir la hora, sino que ha memorizado patrones.’

Tiempo suficiente

La mayoría de los conjuntos de datos de entrenamiento dependen de imágenes de la web, que tienden a repetir ciertos momentos, especialmente 10:10, una configuración popular en anuncios de relojes:

De el nuevo artículo, un ejemplo de la prevalencia de la hora ‘diez pasadas diez’ en imágenes de relojes analógicos.

Como resultado de este rango limitado de momentos representados, el modelo puede ver solo un rango limitado de configuraciones de reloj posibles, limitando su capacidad para generalizar más allá de esos patrones repetitivos.

En cuanto a por qué los modelos fallan al interpretar los relojes distorsionados, el artículo establece:

‘Aunque GPT-4.1 se desempeña excepcionalmente bien con imágenes de relojes estándar, es sorprendente que modificar las manecillas del reloj haciéndolas más delgadas y agregando puntas de flecha conduce a una caída significativa en su precisión.

‘Intuitivamente, uno podría esperar que el cambio visual más complejo, una dial distorsionada, tendría un impacto mayor en el rendimiento, pero esta modificación parece tener un efecto relativamente menor.

‘Esto plantea una pregunta: ¿cómo interpretan los MLLM los relojes y por qué fallan? Una posibilidad es que las manecillas más delgadas dificultan la capacidad del modelo para percibir la dirección, debilitando su comprensión de la orientación espacial.

‘Alternativamente, podría haber otros factores que causan confusión cuando el modelo intenta combinar las manecillas de hora, minuto y segundo en una lectura de tiempo precisa.’

Los autores sostienen que identificar la causa raíz de estos fallos es clave para avanzar en los modelos multimodales: si el problema radica en cómo el modelo percibe la dirección espacial, el ajuste fino puede ofrecer una solución simple; pero si el problema se debe a una dificultad más amplia para integrar múltiples señales visuales, apunta a una debilidad más fundamental en cómo estos sistemas procesan la información.

Pruebas de ajuste fino

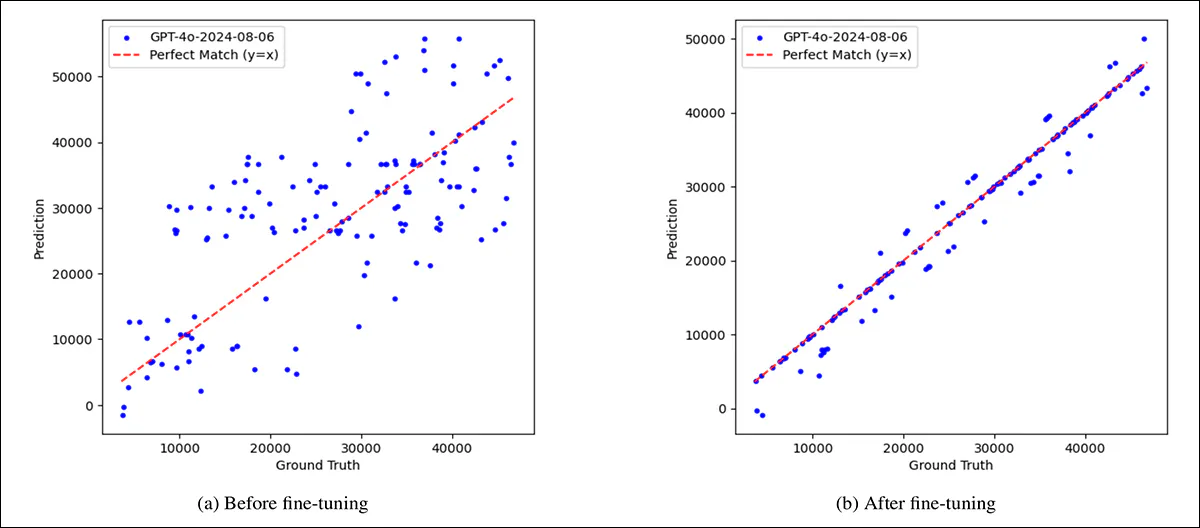

Para probar si los fallos del modelo podrían superarse con la exposición, GPT-4.1 se ajustó en el conjunto de datos sintéticos mencionado anteriormente. Antes del ajuste, sus predicciones estaban ampliamente dispersas, con errores significativos en todos los tipos de relojes. Después del ajuste en el conjunto, la precisión mejoró notablemente en caras de reloj estándar y, en menor medida, en relojes distorsionados.

Sin embargo, los relojes con manecillas modificadas, como formas más delgadas o puntas de flecha, continuaron produciendo errores grandes.

Dos modos de fallo distintos surgieron: en relojes normales y distorsionados, el modelo generalmente maljuzgaba la dirección de las manecillas; pero en relojes con estilos de manecillas alterados, a menudo confundía la función de cada manecilla, confundiendo la manecilla de hora con la manecilla de minuto o la manecilla de minuto con la manecilla de segundo.

Una comparación que ilustra la debilidad inicial del modelo y las ganancias parciales logradas a través del ajuste, mostrando el tiempo predicho versus el tiempo real, en segundos, para 150 relojes seleccionados aleatoriamente. A la izquierda, antes del ajuste, las predicciones de GPT-4.1 están dispersas y a menudo lejos de los valores correctos, indicados por la línea diagonal roja. A la derecha, después del ajuste en un conjunto de datos sintéticos equilibrado, las predicciones se alinean mucho más estrechamente con la verdad de referencia, aunque algunos errores permanecen.

Esto sugiere que el modelo había aprendido a asociar características visuales como el grosor de la manecilla con roles específicos y luchó cuando estas pistas cambiaban.

La mejora limitada en diseños desconocidos plantea dudas adicionales sobre si un modelo de este tipo aprende el concepto abstracto de decir la hora o simplemente refina su coincidencia de patrones.

Señales de manecilla

Así, aunque el ajuste fino mejoró el rendimiento de GPT-4.1 en relojes analógicos convencionales, tuvo mucho menos impacto en relojes con manecillas más delgadas o formas de punta de flecha, planteando la posibilidad de que los fallos del modelo se debieran menos a razonamiento abstracto y más a confusión sobre qué manecilla era cuál.

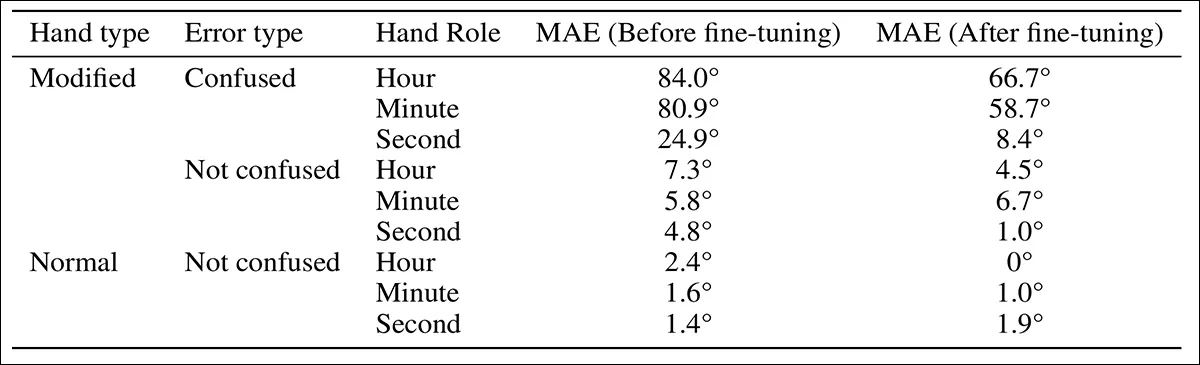

Para probar si la precisión podría mejorar si se eliminara esta confusión, se realizó un nuevo análisis de las predicciones del modelo para el conjunto de datos de ‘manecillas modificadas’. Las salidas se dividieron en dos grupos: casos en los que GPT-4.1 reconoció correctamente las manecillas de hora, minuto y segundo; y casos en los que no.

Las predicciones se evaluaron para Error Absoluto Medio (MAE) antes y después del ajuste, y los resultados se compararon con los de relojes estándar; también se midió el error angular para cada manecilla utilizando la posición de la esfera como referencia:

Comparación de errores para relojes con y sin confusión de roles de manecilla en el conjunto de datos de manecillas modificadas antes y después del ajuste.

La confusión de los roles de las manecillas del reloj condujo a los errores más grandes. Cuando GPT-4.1 confundió la manecilla de hora con la manecilla de minuto o viceversa, las estimaciones de tiempo resultantes estaban a menudo muy alejadas. En contraste, los errores causados por mal juzgar la dirección de una manecilla identificada correctamente fueron más pequeños. Entre las tres manecillas, la manecilla de hora mostró el mayor error angular antes del ajuste, mientras que la manecilla de segundo mostró el más bajo.

Error angular por tipo de manecilla para predicciones con y sin confusión de roles de manecilla, antes y después del ajuste, en el conjunto de datos de manecillas modificadas.

Para centrarse en errores de dirección solamente, el análisis se limitó a casos en los que el modelo identificó correctamente la función de cada manecilla. Si el modelo hubiera internalizado un concepto general de decir la hora, su rendimiento en estos ejemplos debería haber coincidido con su precisión en relojes estándar. No lo hizo, y la precisión siguió siendo notablemente peor.

Para examinar si la forma de la manecilla interfería con el sentido de dirección del modelo, se realizó un segundo experimento: se crearon dos nuevos conjuntos de datos, cada uno conteniendo sesenta relojes sintéticos con solo una manecilla de hora, apuntando a una marca de minuto diferente. Un conjunto utilizó el diseño de manecilla original, y el otro la versión alterada. Se le pidió al modelo que nombrara la marca que la manecilla estaba señalando.

Los resultados mostraron una ligera caída en la precisión con las manecillas modificadas, pero no lo suficiente como para explicar los fallos más amplios del modelo. Una característica visual desconocida parecía capaz de interrumpir la interpretación general del modelo, incluso en tareas que había realizado bien anteriormente.

Visión general del rendimiento de GPT-4.1 antes y después del ajuste en relojes estándar, distorsionados y con manecillas modificadas, destacando ganancias desiguales y debilidades persistentes.

Conclusión

Aunque el enfoque del artículo puede parecer trivial a primera vista, no importa especialmente si los modelos de visión-lenguaje aprenden a leer relojes analógicos con una precisión del 100%. Lo que da peso al trabajo es su enfoque en una pregunta más profunda y recurrente: si saturar los modelos con más (y más diverso) datos puede conducir al tipo de comprensión de dominio que los humanos adquieren a través de la abstracción y la generalización; o si el único camino viable es inundar el dominio con suficientes ejemplos para anticipar cada variación probable en la inferencia.

Cualquiera de los caminos plantea dudas sobre lo que las arquitecturas actuales son realmente capaces de aprender.

Publicado por primera vez el lunes, 19 de mayo de 2025