Inteligencia artificial

Un cartel de conjuntos de datos influyentes está dominando la investigación de aprendizaje automático, sugiere un nuevo estudio

Un nuevo artículo de la Universidad de California y Google Research ha encontrado que un pequeño número de conjuntos de datos de ‘benchmark’ de aprendizaje automático, en gran medida de instituciones occidentales influyentes, y con frecuencia de organizaciones gubernamentales, están dominando cada vez más el sector de investigación de IA.

Los investigadores concluyen que esta tendencia a ‘default’ a conjuntos de datos de código abierto muy populares, como ImageNet, plantea una serie de preocupaciones prácticas, éticas y甚至 políticas.

Entre sus hallazgos – basados en datos básicos del proyecto comunitario liderado por Facebook Papers With Code (PWC) – los autores sostienen que ‘los conjuntos de datos ampliamente utilizados son introducidos por solo un puñado de instituciones élite’, y que esta ‘consolidación’ ha aumentado a 80% en los últimos años.

‘[Encontramos] que hay una creciente desigualdad en el uso de conjuntos de datos a nivel mundial, y que más del 50% de todos los usos de conjuntos de datos en nuestra muestra de 43,140 correspondieron a conjuntos de datos introducidos por doce instituciones élite, principalmente occidentales.’

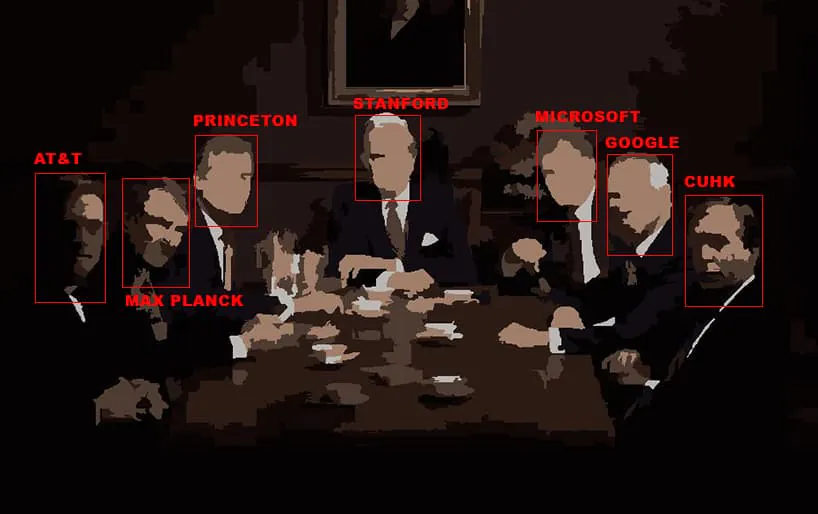

Un mapa de usos de conjuntos de datos no específicos de tarea durante los últimos diez años. Los criterios de inclusión son donde la institución o empresa cuenta con más del 50% de usos conocidos. A la derecha se muestra el coeficiente de Gini para la concentración de conjuntos de datos con el tiempo para instituciones y conjuntos de datos. Fuente: https://arxiv.org/pdf/2112.01716.pdf

Las instituciones dominantes incluyen la Universidad de Stanford, Microsoft, Princeton, Facebook, Google, el Instituto Max Planck y AT&T. Cuatro de las diez fuentes de conjuntos de datos más importantes son instituciones corporativas.

El artículo también caracteriza el creciente uso de estos conjuntos de datos élite como ‘un vehículo para la desigualdad en la ciencia’. Esto se debe a que los equipos de investigación que buscan la aprobación de la comunidad están más motivados para lograr resultados de estado del arte (SOTA) contra un conjunto de datos consistente que para generar conjuntos de datos originales que no tienen tal reconocimiento, y que requerirían que los compañeros se adapten a métricas nuevas en lugar de índices estándar.

En cualquier caso, como reconoce el artículo, crear el propio conjunto de datos es una empresa prohibitivamente costosa para instituciones y equipos con menos recursos.

‘La prima facie validez científica otorgada por la evaluación de estado del arte se confunde genéricamente con la credibilidad social que los investigadores obtienen al mostrar que pueden competir en un conjunto de datos ampliamente reconocido, incluso si un benchmark más específico de contexto podría ser más técnicamente apropiado.

‘Sostenemos que estas dinámicas crean un “Efecto Mateo” (es decir, “los ricos se vuelven más ricos y los pobres se vuelven más pobres”) donde los benchmarks exitosos, y las instituciones élite que los introducen, ganan una estatura desproporcionada dentro del campo.

El artículo se titula Reducido, reutilizado y reciclado: la vida de un conjunto de datos en la investigación de aprendizaje automático, y proviene de Bernard Koch y Jacob G. Foster en UCLA, y Emily Denton y Alex Hanna en Google Research.

El trabajo plantea una serie de problemas con la creciente tendencia hacia la consolidación que documenta, y ha sido recibido con aprobación general en Open Review. Un revisor de NeurIPS 2021 comentó que el trabajo es ‘extremadamente relevante para cualquier persona involucrada en la investigación de aprendizaje automático.’ y prevé su inclusión como lectura asignada en cursos universitarios.

De la necesidad a la corrupción

Los autores señalan que la cultura actual de ‘superar el benchmark’ surgió como remedio para la falta de herramientas de evaluación objetiva que causó que el interés y la inversión en IA se desplomaran por segunda vez hace más de treinta años, después del declive del entusiasmo empresarial hacia la investigación en ‘Sistemas Expertos’:

‘Los benchmarks suelen formalizar una tarea particular a través de un conjunto de datos y una métrica cuantitativa de evaluación asociada. La práctica se introdujo originalmente en la investigación de aprendizaje automático después del “invierno de la IA” de la década de 1980 por los financiadores gubernamentales, que buscaron evaluar con más precisión el valor recibido en las subvenciones.’

El artículo argumenta que las ventajas iniciales de esta cultura informal de estandarización (reducir las barreras para la participación, métricas consistentes y oportunidades de desarrollo más ágiles) están comenzando a ser superadas por las desventajas que ocurren naturalmente cuando un cuerpo de datos se vuelve lo suficientemente poderoso como para definir efectivamente sus ‘términos de uso’ y alcance de influencia.

Los autores sugieren, en línea con mucho pensamiento reciente de la industria y la academia sobre el tema, que la comunidad de investigación ya no plantea problemas novedosos si estos no pueden abordarse a través de conjuntos de datos de benchmark existentes.

Además, señalan que la adhesión ciega a este pequeño número de conjuntos de datos ‘oro’ fomenta a los investigadores a lograr resultados que están sobreajustados (es decir, que son específicos del conjunto de datos y no es probable que funcionen casi tan bien en datos del mundo real, en nuevos conjuntos de datos académicos o originales, o incluso necesariamente en diferentes conjuntos de datos en el ‘estándar de oro’).

‘Dado la alta concentración observada de la investigación en un pequeño número de conjuntos de datos de benchmark, creemos que diversificar las formas de evaluación es especialmente importante para evitar el sobreajuste a los conjuntos de datos existentes y tergiversar el progreso en el campo.’

Influencia gubernamental en la investigación de visión por computadora

Según el artículo, la investigación de Visión por Computadora se ve notablemente más afectada por el síndrome que describe que otros sectores, y los autores señalan que la investigación de Procesamiento de Lenguaje Natural (NLP) se ve mucho menos afectada. Los autores sugieren que esto podría deberse a que las comunidades de NLP son ‘más coherentes’ y más grandes en tamaño, y porque los conjuntos de datos de NLP son más accesibles y fáciles de curar, así como ser más pequeños y menos intensivos en recursos en términos de recolección de datos.

En Visión por Computadora, y particularmente en relación con los conjuntos de datos de Reconocimiento Facial (FR), los autores sostienen que los intereses corporativos, estatales y privados a menudo colisionan:

‘Las instituciones corporativas y gubernamentales tienen objetivos que pueden entrar en conflicto con la privacidad (por ejemplo, la vigilancia), y es probable que su ponderación de estas prioridades sea diferente a la de los académicos o los partes interesadas más amplias de la IA.’

Para las tareas de reconocimiento facial, los investigadores encontraron que la incidencia de conjuntos de datos puramente académicos disminuye drásticamente en comparación con el promedio:

‘[Cuatro] de los ocho conjuntos de datos (33.69% del total de usos) fueron financiados exclusivamente por corporaciones, el ejército de EE. UU. o el gobierno chino (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M fue retirado finalmente debido a la controversia que rodea el valor de la privacidad para las diferentes partes interesadas.’

Los conjuntos de datos más utilizados en las comunidades de investigación de Generación de Imágenes y Reconocimiento Facial.

En el gráfico anterior, como señalan los autores, también vemos que el campo relativamente reciente de la Generación de Imágenes (o Síntesis de Imágenes) depende en gran medida de conjuntos de datos existentes y mucho más antiguos que no fueron diseñados para este uso.

De hecho, el artículo observa una tendencia creciente hacia la ‘migración’ de conjuntos de datos lejos de su propósito previsto, lo que cuestiona su idoneidad para las necesidades de nuevos o sectores de investigación externos, y el alcance en que las limitaciones presupuestarias pueden estar ‘genéricizando’ el alcance de las ambiciones de los investigadores en el marco más estrecho proporcionado tanto por los materiales disponibles como por una cultura tan obsesionada con las calificaciones de benchmark año tras año que los conjuntos de datos novedosos tienen dificultades para ganar tracción.

‘Nuestros hallazgos también indican que los conjuntos de datos se transfieren regularmente entre diferentes comunidades de tareas. En el extremo más extremo, la mayoría de los conjuntos de datos de benchmark en circulación para algunas comunidades de tareas se crearon para otras tareas.’

En cuanto a los luminarios del aprendizaje automático (incluyendo a Andrew Ng) que han llamado cada vez más a una mayor diversidad y curación de conjuntos de datos en los últimos años, los autores apoyan el sentimiento, pero creen que este tipo de esfuerzo, incluso si es exitoso, podría potencialmente ser socavado por la dependencia actual de la cultura en los resultados SOTA y los conjuntos de datos establecidos:

‘Nuestra investigación sugiere que simplemente llamar a los investigadores de ML a desarrollar más conjuntos de datos, y cambiar las estructuras de incentivos para que el desarrollo de conjuntos de datos sea valorado y recompensado, puede no ser suficiente para diversificar el uso de conjuntos de datos y las perspectivas que en última instancia están dando forma y estableciendo las agendas de investigación de MLR.

‘Además de incentivar el desarrollo de conjuntos de datos, abogamos por intervenciones de política orientadas a la equidad que prioricen una financiación significativa para las personas en instituciones con menos recursos para crear conjuntos de datos de alta calidad. Esto diversificaría —desde una perspectiva social y cultural— los conjuntos de datos de benchmark que se utilizan para evaluar los métodos de ML modernos.’

6 de diciembre de 2021, 4:49 pm GMT+2 – Corregido el posesivo en el titular. – MA