Inteligencia artificial

MINT-1T: Escalando datos multimodales de código abierto por 10x

La capacitación de modelos multimodales grandes (LMM) en la frontera requiere conjuntos de datos a gran escala con secuencias intercaladas de imágenes y texto en forma libre. Aunque los LMM de código abierto han evolucionado rápidamente, todavía existe una gran falta de conjuntos de datos multimodales intercalados a escala que sean de código abierto. La importancia de estos conjuntos de datos no se puede exagerar, ya que forman la base para crear sistemas de inteligencia artificial avanzados capaces de comprender y generar contenido en diferentes modalidades. Sin un suministro suficiente de conjuntos de datos intercalados comprehensivos, el potencial para desarrollar LMM más sofisticados y capaces se ve significativamente obstaculizado. Estos conjuntos de datos permiten que los modelos aprendan de una amplia gama de entradas, lo que los hace más versátiles y efectivos en varias aplicaciones. Además, la escasez de dichos conjuntos de datos plantea un desafío a la comunidad de código abierto, que depende de recursos compartidos para impulsar la innovación y la colaboración.

Los LMM de código abierto han realizado avances significativos en los últimos años, pero su crecimiento se ve obstaculizado por la disponibilidad limitada de conjuntos de datos intercalados a gran escala. Para superar este obstáculo, se necesitan esfuerzos concertados para curar, anotar y publicar conjuntos de datos más comprehensivos que puedan respaldar el desarrollo y perfeccionamiento continuo de modelos multimodales. Además, la creación y difusión de estos conjuntos de datos implican superar varios obstáculos técnicos y logísticos. La recolección de datos debe ser extensa y representativa de los diversos contextos en los que se desplegarán los LMM. La anotación requiere una consideración cuidadosa para garantizar que las secuencias intercaladas de imágenes y texto estén alineadas de una manera que mejore las capacidades de aprendizaje del modelo. Además, garantizar que los conjuntos de datos sean de código abierto implica abordar consideraciones legales y éticas relacionadas con la privacidad de los datos y los derechos de uso. Ampliar la disponibilidad de conjuntos de datos multimodales intercalados de alta calidad y gran escala es esencial para el futuro de la investigación y desarrollo de la inteligencia artificial. Al abordar la escasez actual, la comunidad de inteligencia artificial puede fomentar una mayor innovación y colaboración, lo que lleva a la creación de LMM más poderosos y versátiles capaces de abordar problemas complejos y del mundo real.

Basándonos en eso, MINT-1T, el conjunto de datos multimodal intercalado más grande y diverso hasta la fecha. MINT-1T: Una escala 10 veces mayor, que incluye un billón de tokens de texto y 3.400 millones de imágenes, en comparación con los conjuntos de datos de código abierto existentes. El conjunto de datos MINT-1T también introduce fuentes nunca expuestas, como archivos PDF y artículos de ArXiv. Dado que los conjuntos de datos multimodales intercalados no se escalan fácilmente, es importante que el conjunto de datos MINT-1T comparta el proceso de curación de datos para que otros también puedan realizar experimentos en estas variantes ricas en información. El conjunto de datos MINT-1T demuestra que su método; los modelos de lenguaje entrenados en MINT-1T son competitivos (aunque algo) con el estado del arte anterior OBELICS.

MINT-1T: Un conjunto de datos multimodal con un billón de tokens

Los conjuntos de datos de preentrenamiento de código abierto a gran escala han sido fundamentales para la comunidad de investigación al explorar la ingeniería de datos y entrenar modelos transparentes y de código abierto. En el dominio de texto, trabajos anteriores como C4 y The Pile desempeñaron un papel crucial al permitir que la comunidad entrenara el primer conjunto de modelos de lenguaje grande de código abierto, como GPT-J, GPT-Neo y otros. Esfuerzos fundamentales también allanaron el camino para mejoras posteriores en los métodos de filtrado de datos y escalado. De manera similar, en el espacio de imagen-texto, los conjuntos de datos de código abierto a gran escala han impulsado innovaciones en mejores métodos de curación de datos, como redes de filtrado de datos y T-MARS. Hay un cambio notable desde los laboratorios de vanguardia hacia el entrenamiento de modelos multimodales grandes (LMM) que requieren conjuntos de datos multimodales intercalados extensos que consisten en secuencias de imágenes y texto en forma libre. A medida que avanzan las capacidades de los modelos de vanguardia, se está produciendo una brecha significativa en los datos de entrenamiento multimodal entre los modelos de código abierto y cerrado. Los conjuntos de datos multimodales intercalados de código abierto actuales son más pequeños y menos diversos que sus contrapartes solo de texto, ya que se obtienen principalmente de documentos HTML, lo que limita la amplitud y variedad de los datos. Esta limitación obstaculiza el desarrollo de LMM de código abierto robustos y crea una disparidad entre las capacidades de los modelos de código abierto y cerrado.

Para abordar esta brecha, se creó MINT-1T como el conjunto de datos multimodal intercalado más grande y diverso de código abierto hasta la fecha. MINT-1T contiene un total de un billón de tokens de texto y 3.400 millones de imágenes, obtenidos de orígenes diversos como HTML, PDF y ArXiv. Antes de MINT-1T, el conjunto de datos de código abierto más grande en este área era OBELICS, que incluía 115 mil millones de tokens de texto y 353 millones de imágenes, todas obtenidas de HTML.

Las contribuciones de MINT-1T son las siguientes:

- Ingeniería de datos: Escalar estos datos multimodales intercalados presenta más un desafío de ingeniería que construir conjuntos de datos solo de texto o pares de imagen-texto. Manejar tamaños de documentos mucho más grandes y preservar el orden original de las imágenes y el texto es crucial.

- Diversidad: MINT-1T es el primero en el espacio de datos intercalados multimodales en recopilar documentos multimodales de alta calidad a gran escala de fuentes como archivos PDF de CommonCrawl y ArXiv.

- Experimentos de modelo: Los experimentos muestran que los LMM entrenados en MINT-1T no solo igualan sino que potencialmente superan el rendimiento de los modelos entrenados en el mejor conjunto de datos de código abierto existente, OBELICS, mientras ofrecen un aumento de diez veces en la escala.

MINT-1T: Construyendo el conjunto de datos

MINT-1T cura un conjunto de datos de código abierto a gran escala que utiliza fuentes más diversas de documentos intercalados, como archivos PDF y artículos de ArXiv. Esta sección detalla los métodos de MINT-1T para obtener documentos multimodales, filtrar contenido de baja calidad, deduplicar datos y eliminar material no apto para el trabajo o NSFW y material no deseado. El conjunto de datos final comprende 922 mil millones (B) de tokens HTML, 106B de tokens PDF y 9B de tokens ArXiv.

Obtención de grandes cantidades de documentos multimodales

Tubería HTML

MINT-1T sigue el método de OBELICS para extraer documentos multimodales intercalados de archivos WARC de CommonCrawl al analizar el árbol DOM de cada entrada WARC. Mientras que OBELICS solo procesó documentos de los volcados de CommonCrawl de febrero de 2020 a febrero de 2023, MINT-1T ha ampliado el grupo de documentos para incluir documentos HTML de mayo de 2017 a abril de 2024 (con volcados completos desde octubre de 2018 hasta abril de 2024 y volcados parciales de años anteriores). Similar a OBELICS, MINT-1T filtra los documentos que contienen ninguna imagen, más de treinta imágenes o cualquier imagen con URLs que incluyen subcadenas inapropiadas como logo, avatar, porn y xxx.

Tubería PDF

MINT-1T obtiene documentos PDF de los archivos WAT de CommonCrawl de los volcados de febrero de 2023 a abril de 2024. Inicialmente, se extraen todos los enlaces de PDF de estos volcados. MINT-1T luego intenta descargar y leer los PDF utilizando PyMuPDF, descartando los PDF que superen los 50MB (probablemente contengan grandes imágenes) y aquellos que superen las 50 páginas de longitud. Las páginas sin texto se excluyen y se establece un orden de lectura para las páginas restantes. El orden de lectura se determina encontrando el cuadro delimitador de todos los bloques de texto en una página, agrupando los bloques según columnas y ordenándolos de arriba a la izquierda a abajo a la derecha. Las imágenes se integran en la secuencia en función de su proximidad a los bloques de texto en la misma página.

Tubería ArXiv

MINT-1T construye documentos intercalados de ArXiv a partir del código fuente LaTeX utilizando TexSoup para encontrar etiquetas de figura e intercalar imágenes con el texto del artículo. Para artículos de varios archivos, MINT-1T identifica el archivo Tex principal y reemplaza las etiquetas de entrada con el contenido de sus archivos. El código LaTeX se limpia eliminando importaciones, bibliografía, tablas y etiquetas de cita. Dado que ArXiv ya es una fuente de datos muy curada, no se realizan filtraciones y deduplicaciones adicionales.

Filtrado de calidad de texto

MINT-1T evita el uso de heurísticas basadas en modelos para el filtrado de texto, siguiendo las prácticas establecidas por RefinedWeb, Dolma y FineWeb. Inicialmente, se eliminan los documentos no en inglés utilizando el modelo de identificación de idioma Fasttext (con un umbral de confianza de 0,65). Los documentos con URLs que contienen subcadenas NSFW también se eliminan para excluir contenido pornográfico y no deseado. Se aplican métodos de filtrado de texto de RefinedWeb, específicamente eliminando documentos con n-gramas duplicados excesivos o aquellos identificados como de baja calidad utilizando las reglas de MassiveText.

Filtrado de imágenes

Después de curar los PDF y los archivos HTML, MINT-1T intenta descargar todas las URLs de imágenes en el conjunto de datos HTML, descartando enlaces no recuperables y eliminando documentos con enlaces de imagen no válidos. Las imágenes más pequeñas de 150 píxeles se descartan para evitar imágenes ruidosas como logotipos e iconos, y las imágenes más grandes de 20.000 píxeles también se eliminan ya que generalmente corresponden a imágenes fuera de tema. Para los documentos HTML, las imágenes con una relación de aspecto mayor que dos se eliminan para filtrar las imágenes de baja calidad como banners publicitarios. Para los PDF, el umbral se ajusta a tres para preservar figuras científicas y tablas.

La figura anterior representa cómo MINT-1T incluye de forma única datos de archivos PDF y artículos de ArXiv más allá de las fuentes HTML.

Filtrado de seguridad

- Filtrado de imágenes NSFW: MINT-1T aplica un detector de imágenes NSFW a todas las imágenes en el conjunto de datos. Si un documento contiene una sola imagen NSFW, se descarta el documento completo.

- Eliminación de información de identificación personal: Para mitigar el riesgo de fuga de datos personales, las direcciones de correo electrónico y las direcciones IP en los datos de texto se anonimizan. Los correos electrónicos se reemplazan con plantillas como “[email protected]” y las direcciones IP con direcciones IP no funcionales generadas aleatoriamente.

Deduplicación

MINT-1T realiza la deduplicación de texto de párrafos y documentos dentro de cada instantánea de CommonCrawl y la deduplicación de imágenes para eliminar imágenes repetitivas y no informativas como iconos y logotipos. Todos los pasos de deduplicación se realizan por separado para cada fuente de datos.

Deduplicación de párrafos y documentos

Siguiendo la metodología de Dolma, MINT-1T utiliza un filtro de Bloom para la deduplicación de texto eficiente, estableciendo la tasa de falsos positivos en 0,01 y deduplicando párrafos de 13 gramos (indicados a través de delimitadores de nueva línea doble) de cada documento. Si más del 80% de los párrafos de un documento son duplicados, se descarta el documento completo.

Eliminación de texto de caldera común

Después de la deduplicación de párrafos, MINT-1T elimina oraciones de caldera comunes cortas en los documentos HTML, como “Saltar al contenido” o “Archivo del blog”. Esto se hace ejecutando la deduplicación de párrafos exacta en el 2% de cada instantánea de CommonCrawl, en línea con las prácticas de CCNet, asegurando en gran medida la eliminación de texto de caldera común.

La figura anterior demuestra el proceso de filtrado para MINT-1T y muestra cómo se eliminan tokens a lo largo de la tubería de datos para HTML, PDF y artículos de ArXiv.

Deduplicación de imágenes

Dentro de cada instantánea de CommonCrawl, MINT-1T elimina imágenes que ocurren con frecuencia según los hashes SHA256. En lugar de la deduplicación estricta, solo se eliminan las imágenes que aparecen más de diez veces dentro de una instantánea, siguiendo las prácticas de Multimodal-C4. Consistente con OBELICS, las imágenes repetidas dentro de un solo documento se eliminan, manteniendo solo la primera ocurrencia.

Infraestructura

A lo largo del procesamiento de datos, MINT-1T tuvo acceso a un promedio de 2.350 núcleos CPU de una mezcla de nodos de 190 procesadores y 90 procesadores. En total, se utilizaron aproximadamente 4,2 millones de horas de CPU para construir este conjunto de datos.

Comparación de la composición de documentos en MINT-1T con OBELICS

Al evaluar la composición de los conjuntos de datos intercalados, se examinan dos características clave: la distribución de tokens de texto por documento y la cantidad de imágenes por documento. Para este análisis, se muestrearon 50.000 documentos al azar de ambos OBELICS y cada fuente de datos en MINT-1T. Se utilizó el tokenizador de GPT-2 para calcular la cantidad de tokens de texto. Se eliminaron los valores atípicos excluyendo documentos que cayeron fuera del rango intercuartil de 1,5 para la cantidad de tokens de texto e imágenes. Como se muestra en la figura siguiente, el subconjunto HTML de MINT-1T se alinea estrechamente con la distribución de tokens vista en OBELICS. Sin embargo, los documentos obtenidos de PDF y ArXiv tienden a ser más largos que los documentos HTML en promedio, lo que destaca los beneficios de obtener datos de fuentes diversas. La Figura 5 examina la densidad de imágenes en todos los documentos, revelando que los documentos PDF y ArXiv contienen más imágenes en comparación con los documentos HTML, con los ejemplos de ArXiv siendo los más densos en imágenes.

¿Cómo mejoran las diferentes fuentes de datos la diversidad de documentos?

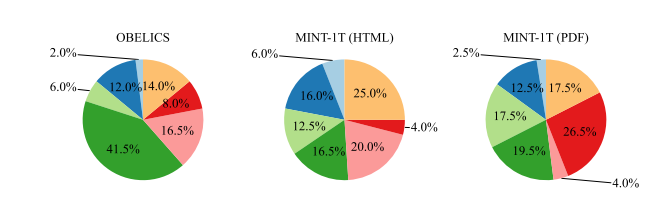

Una motivación importante para ampliar el grupo de documentos multimodales más allá de HTML es la mejora de la cobertura de dominios. Para cuantificar la diversidad y la profundidad de esta cobertura, se entrenó un modelo de asignación de Dirichlet latente (LDA) en 100.000 documentos muestreados del conjunto de datos OBELICS, el subconjunto HTML de MINT-1T y el subconjunto PDF (excluyendo ArXiv) de MINT-1T para obtener 200 temas. Luego, se utilizó GPT-4 para clasificar el conjunto de palabras para identificar los dominios dominantes, como Salud y Medicina, Ciencia, Negocios, Humanidades, Historia, etc., en función de los dominios MMMU. El análisis revela tendencias distintas en la distribución de dominios:

- OBELICS: Este conjunto de datos muestra una concentración pronunciada en “Humanidades y Ciencias Sociales”. Esto puede atribuirse a su proceso de construcción de datos, que implica filtrar documentos que no se asemejan a artículos de Wikipedia, lo que potencialmente altera la distribución hacia contenido de conocimiento general y humanidades.

- Subconjunto HTML de MINT-1T: En contraste con OBELICS, el subconjunto HTML de MINT-1T no está sesgado hacia ningún dominio específico, lo que sugiere una representación de dominios más amplia y equilibrada.

- Subconjunto PDF de MINT-1T: Hay una proporción mayor de documentos de “Ciencia y Tecnología” dentro de los documentos PDF de MINT-1T. Esta tendencia probablemente se deba a la naturaleza de la comunicación científica, donde los PDF son el formato preferido para compartir artículos de investigación y informes técnicos detallados.

MINT-1T: Resultados y experimentos

Para todos los experimentos, MINT-1T entrena el modelo en lotes de subtítulos de imagen-texto al 50% y lotes de documentos intercalados multimodales al 50%. Se muestran como máximo 2048 tokens multimodales de cada documento intercalado y 340 tokens de cada muestra de imagen-texto. De manera similar a Flamingo, se agrega un token “final” para indicar el final de una secuencia de imagen-texto adyacente. Durante el entrenamiento, se eliminan aleatoriamente el 50% de los documentos de imagen única intercalados para muestrear los documentos de varias imágenes. El conjunto de datos de imagen-texto está compuesto por una mezcla de conjuntos de datos de subtítulos curados internamente. La capacidad del modelo para razonar sobre secuencias intercaladas multimodales se evalúa a través de sus capacidades de aprendizaje en contexto y su rendimiento en razonamiento multiimagen.

La figura anterior ilustra el porcentaje de documentos de cada dominio en MMMU para OBELICS y subconjuntos de MINT-1T.

Aprendizaje en contexto: Los modelos se evalúan en el rendimiento de aprendizaje en contexto de cuatro disparos y ocho disparos en varios benchmarks de subtítulos (COCO (prueba de Karpathy) y TextCaps (validación)) y conjuntos de datos de preguntas y respuestas visuales (VQAv2 (validación), OK-VQA (validación), TextVQA (validación) y VizWiz (validación)). Las demostraciones se muestrean aleatoriamente del conjunto de entrenamiento. Las puntuaciones se promedian en varias ejecuciones de evaluación, con demostraciones aleatorizadas para tener en cuenta la sensibilidad a las llamadas de atención elegidas. Se ablatan diferentes llamadas de atención para cada tarea para seleccionar las que mejor funcionan.

Razonamiento multiimagen: Los modelos se evalúan en MMMU (que contiene preguntas de imagen única y multiimagen) y Mantis-Eval (todas las preguntas son de multiimagen) para sondear las capacidades de razonamiento multiimagen más allá de las evaluaciones de aprendizaje en contexto.

Entrenamiento en documentos HTML

Inicialmente, la porción HTML de MINT-1T se compara con OBELICS, ya que OBELICS es el conjunto de datos intercalado líder anterior, también curado a partir de documentos HTML. Se entrenan dos modelos en las porciones HTML de MINT-1T y OBELICS durante un total de 10B de tokens multimodales. Se evalúa su rendimiento de aprendizaje en contexto. La siguiente tabla presenta el rendimiento de cuatro disparos y ocho disparos en benchmarks comunes; el modelo entrenado en los documentos HTML de MINT-1T funciona mejor que OBELICS en tareas de VQA pero peor en benchmarks de subtítulos. En promedio, OBELICS funciona ligeramente mejor que MINT-1T (HTML).

Agregar documentos PDF y ArXiv

Posteriormente, se realiza el entrenamiento en las fuentes de datos completas de MINT-1T, con una mezcla de documentos HTML, PDF y ArXiv. Los documentos intercalados se muestrean con el 50% de HTML, el 45% de PDF y el 5% de ArXiv. El modelo se entrena durante un total de 10B de tokens multimodales. Como se ve en la tabla anterior, el modelo entrenado en la mezcla completa de datos de MINT-1T supera a OBELICS y MINT-1T (HTML) en la mayoría de los benchmarks de aprendizaje en contexto. En benchmarks de razonamiento multimodal más complejos, el modelo MINT-1T supera a OBELICS en MMMU pero funciona peor en Mantis-Eval.

Tendencias detalladas

¿Cómo se escalan las capacidades de aprendizaje en contexto con las demostraciones?

El rendimiento de aprendizaje en contexto se evalúa cuando se proporcionan de uno a ocho disparos. Se realiza un solo ensayo por cuenta de disparos para cada benchmark de evaluación. Como se muestra en la figura siguiente, el modelo entrenado en MINT-1T supera al modelo entrenado en el subconjunto HTML de MINT-1T y OBELICS en todos los disparos. El modelo MINT-1T (HTML) funciona ligeramente peor que OBELICS.

Rendimiento en tareas de subtítulos y preguntas y respuestas visuales

La figura siguiente presenta el rendimiento promedio de aprendizaje en contexto en benchmarks de subtítulos y preguntas y respuestas visuales (VQA). OBELICS supera a todos los variantes de MINT-1T en benchmarks de subtítulos de cuatro disparos y funciona ligeramente peor en comparación con MINT-1T en subtítulos de ocho disparos. Sin embargo, MINT-1T supera significativamente a ambas líneas base en benchmarks de VQA. MINT-1T (HTML) también supera a OBELICS en tareas de VQA.

Rendimiento en diferentes dominios

Incluir dominios diversos en MINT-1T tiene como objetivo mejorar la generalización del modelo. La figura anterior desglosa el rendimiento en MMMU para cada dominio. Con la excepción del dominio de Negocios, MINT-1T supera a OBELICS y MINT-1T (HTML). El aumento en el rendimiento en los dominios de Ciencia y Tecnología para MINT-1T se atribuye a la prevalencia de estos dominios en los documentos de ArXiv y PDF.

Pensamientos finales

En este artículo, hemos hablado sobre MINT-1T, el conjunto de datos multimodal intercalado más grande y diverso hasta la fecha. MINT-1T: Una escala 10 veces mayor, que incluye un billón de tokens de texto y 3.400 millones de imágenes, en comparación con los conjuntos de datos de código abierto existentes. El conjunto de datos MINT-1T también introduce fuentes nunca expuestas, como archivos PDF y artículos de ArXiv. Dado que los conjuntos de datos multimodales intercalados no se escalan fácilmente, es importante que el conjunto de datos MINT-1T comparta el proceso de curación de datos para que otros también puedan realizar experimentos en estas variantes ricas en información. El conjunto de datos MINT-1T demuestra que su método; los modelos de lenguaje entrenados en MINT-1T son competitivos (aunque algo) con el estado del arte anterior OBELICS.