Η γωνία του Anderson

Προς την Ολική Έλεγχο στην Γεννήτρια Βίντεο του AI

Τα μοντέλα βίντεο όπως το Hunyuan και το Wan 2.1, αν και ισχυρά, δεν προσφέρουν στους χρήστες τον είδος του λεπτομερούς ελέγχου που απαιτεί η παραγωγή ταινιών και τηλεόρασης (ιδιαίτερα η παραγωγή VFX).

Στα επαγγελματικά στούντιο οπτικών εφέ, τα ανοικτά μοντέλα όπως αυτά, μαζί με προηγούμενα μοντέλα εικόνας (αντί για βίντεο) όπως το Stable Diffusion, το Kandinsky και το Flux, χρησιμοποιούνται συνήθως μαζί με eine σειρά από εργαλεία που προσαρμόζουν την原始ική έξοδο τους για να ικανοποιήσουν συγκεκριμένες δημιουργικές ανάγκες. Όταν ένας σκηνοθέτης λέει, “Αυτό φαίνεται υπέροχο, αλλά μπορούμε να το κάνουμε λίγο πιο [n]?” δεν μπορείτε να απαντήσετε λέγοντας ότι το μοντέλο δεν είναι αρκετά ακριβές για να χειριστεί τέτοιες αιτήσεις.

Αντίθετα, μια ομάδα AI VFX θα χρησιμοποιήσει μια σειρά από παραδοσιακές τεχνικές CGI και σύνθεσης, συμμαχισμένες με προσαρμοσμένες διαδικασίες και ροές εργασίας που έχουν αναπτυχθεί με τον καιρό, για να προσπαθήσουν να推 đẩy τα όρια της σύνθεσης βίντεο λίγο παραπέρα.

Έτσι, με ανάλογο τρόπο, ένα μοντέλο βίντεο είναι πολύ σαν μια προεπιλογή εγκατάστασης ενός web-περιηγητή όπως το Chrome· κάνει πολλά εξ’ ού και απ’ ευθείας, αλλά αν θέλετε να προσαρμοστεί στις ανάγκες σας, αντί να ανταποκρίνεται, θα χρειαστείτε κάποια πρόσθετα.

Ελέγχου Φρενίτες

Στον κόσμο της σύνθεσης εικόνας με βάση τη διάχυση, το πιο σημαντικό τέτοιο σύστημα τρίτων είναι το ControlNet.

Το ControlNet είναι μια τεχνική για την προσθήκη δομημένου ελέγχου σε γεννήτριες μοντέλα διάχυσης, επιτρέποντας στους χρήστες να οδηγούν τη σύνθεση εικόνας ή βίντεο με πρόσθετες εισόδους όπως χάρτες ακμής, χάρτες βάθους ή πληροφορίες στάσης.

εικόνα (κάτω αριστερά) και οδηγούμενη από στάση σύνθεση εικόνας ανθρώπων και ζώων (κάτω αριστερά).” width=”779″ height=”422″ /> Οι διάφορες μεθόδους του ControlNet επιτρέπουν τη σύνθεση εικόνας με βάθος (πάνω σειρά), σεμαντική διαίρεση > εικόνα (κάτω αριστερά) και οδηγούμενη από στάση σύνθεση εικόνας ανθρώπων και ζώων (κάτω αριστερά).

Αντί να βασίζονται αποκλειστικά σε κείμενο-προτροπές, το ControlNet εισάγει ξεχωριστές νευρωνικές διακλαδώσεις, ή προσαρμογείς, που επεξεργάζονται αυτά τα σήματα συνθήκων ενώ διατηρούν τις γεννήτριες ικανότητες της βασικής μοντέλου.

Αυτό επιτρέπει τις εξευγενισμένες εξόδους που συμμορφώνονται πιο στενά με τις προδιαγραφές του χρήστη, καθιστώντας το ιδιαίτερα χρήσιμο σε εφαρμογές όπου απαιτείται ακριβής σύνθεση, δομή ή έλεγχος κίνησης:

Με μια οδηγούμενη στάση, μπορεί να ληφθεί μια ποικιλία ακριβών τύπων εξόδου μέσω του ControlNet. Source: https://arxiv.org/pdf/2302.05543

Ωστόσο, τα πλαίσια προσαρμογέων αυτού του είδους λειτουργούν εξωτερικά σε ένα σύνολο νευρωνικών διαδικασιών που είναι πολύ εσωτερικά εστιασμένες. Αυτές οι προσεγγίσεις έχουν beberapa μειονεκτήματα.

Πρώτον, οι προσαρμογείς εκπαιδεύονται ανεξάρτητα, οδηγώντας σε συγκρούσεις διακλαδώσεων όταν συνδυάζονται πολλαπλοί προσαρμογείς, που μπορεί να συνεπάγονται μειωμένη ποιότητα γεννήτριας.

Δεύτερον, εισάγουν πλεονασμό παραμέτρων, απαιτώντας επιπλέον υπολογισμό και μνήμη για κάθε προσαρμογέα, καθιστώντας την κλιμάκωση αναποτελεσματική.

Τρίτον, παρά την ευελιξία τους, οι προσαρμογείς συχνά παράγουν υποβελτιστοποιημένα αποτελέσματα σε σύγκριση με μοντέλα που είναι πλήρως εξευγενισμένα για πολλαπλή γεννήτρια. Αυτά τα ζητήματα καθιστούν τις μεθόδους προσαρμογέων λιγότερο αποτελεσματικές για εργασίες που απαιτούν άρτια ολοκλήρωση πολλαπλών σημάτων ελέγχου.

Ιδανικά, οι ικανότητες του ControlNet θα εκπαιδεύονταν φυσικά στο μοντέλο, με einen modуляρικο τρόπο που θα μπορούσε να φιλοξενήσει αργότερα και πολύ αναμενόμενες και προφανείς καινοτομίες όπως η ταυτόχρονη γεννήτρια βίντεο/ήχου ή οι ιθαγενείς ικανότητες lip-sync (για εξωτερικό ήχο).

Όπως είναι τώρα, κάθε πρόσθετη λειτουργικότητα αντιπροσωπεύει είτε μια εργασία μετά-παραγωγής είτε μια μη ιθαγενή διαδικασία που πρέπει να διαπεράσει τα στενά-δεμένα και ευαίσθητα βάρη του οποιοδήποτε μοντέλου θεμελίου που λειτουργεί.

FullDiT

Σε αυτή την αδιέξοδο έρχεται μια νέα προσφορά από την Κίνα, που υποστηρίζει ένα σύστημα όπου τα μέτρα τύπου ControlNet ενσωματώνονται απευθείας σε ένα γεννήτρια βίντεο στο χρόνο εκπαίδευσης, αντί να θεωρούνται ως μια μετά-σκέψη.

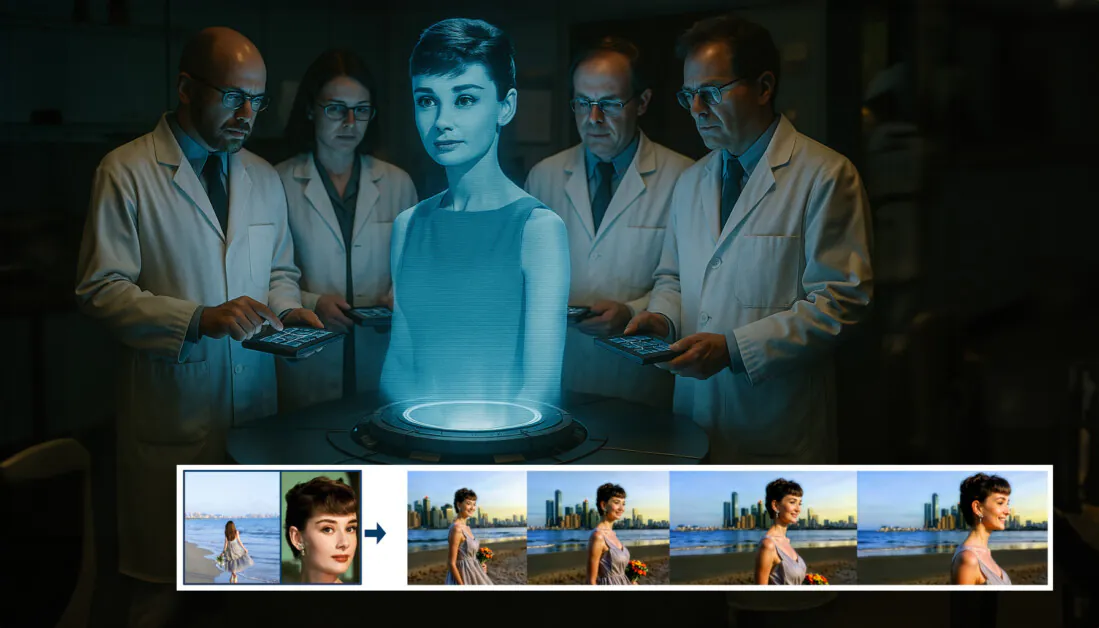

Από το νέο έγγραφο: η προσέγγιση FullDiT μπορεί να ενσωματώσει επιβολή ταυτότητας, βάθος και κίνηση κάμερας σε μια ιθαγενή γεννήτρια, και μπορεί να καλέσει οποιοδήποτε συνδυασμό αυτών ταυτόχρονα. Source: https://arxiv.org/pdf/2503.19907

Ονομάζεται FullDiT, η νέα προσέγγιση συνδυάζει πολλαπλά συνθήκες εργασιών όπως η μεταφορά ταυτότητας, η χαρτογράφηση βάθους και η κίνηση κάμερας σε ένα ενιαίο μέρος ενός εκπαιδευμένου γεννήτρια βίντεο, για το οποίο οι συγγραφείς έχουν παράγει ένα πρωτότυπο εκπαιδευμένο μοντέλο και συνοδευτικά βίντεο-κλιπ σε μια σελίδα έργου.

Στο παρακάτω παράδειγμα, βλέπουμε γεννήτρια που ενσωματώνουν κίνηση κάμερας, πληροφορίες ταυτότητας και κείμενο-πληροφορίες (δηλ. οδηγούμενο από το χρήστη κείμενο-προτροπές):

Πατήστε για αναπαραγωγή. Παραδείγματα ελέγχου τύπου ControlNet με μόνο ένα ιθαγενές εκπαιδευμένο μοντέλο θεμελίου. Source: https://fulldit.github.io/

Πρέπει να σημειωθεί ότι οι συγγραφείς δεν προτείνουν το πειραματικό εκπαιδευμένο μοντέλο τους ως一个 λειτουργικό μοντέλο θεμελίου, αλλά μάλλον ως μια απόδειξη- концепτού για ιθαγενή κείμενο-προς-βίντεο (T2V) και εικόνα-προς-βίντεο (I2V) μοντέλα που προσφέρουν στους χρήστες περισσότερο έλεγχο από ότι ένα απλό κείμενο-προτροπή ή εικόνα-προτροπή.

Καθώς δεν υπάρχουν παρόμοια μοντέλα αυτού του είδους, οι ερευνητές δημιούργησαν μια νέα βάση ονομάτων που ονομάζεται FullBench, για την αξιολόγηση της πολλαπλής εργασίας βίντεο, και ισχυρίζονται την κορυφαία απόδοση σε δοκιμές που έχουν σχεδιαστεί για να τις συγκρίνουν με προηγούμενες προσεγγίσεις. Ωστόσο,既然 η FullBench σχεδιάστηκε από τους ίδιους τους συγγραφείς, η αντικειμενικότητά της είναι ανεξέταστη, και το σύνολο δεδομένων της 1.400 περιπτώσεων μπορεί να είναι πολύ περιορισμένο για ευρύτερες συμπεράσματα.

Ίσως το πιο ενδιαφέρον μέρος της αρχιτεκτονικής που παρουσιάζει το έγγραφο είναι η δυνατότητά του να ενσωματώσει νέους τύπους ελέγχου. Οι συγγραφείς δηλώνουν:

‘Σε αυτή την εργασία, εξετάζουμε μόνο συνθήκες ελέγχου της κάμερας, ταυτότητας και βάθους. Δεν εξετάζουμε περαιτέρω άλλες συνθήκες και modalities όπως ήχος, ομιλία, cloud σημείων, οριοθέτηση αντικειμένων, οπτική ροή, κ.λπ. Αν και ο σχεδιασμός του FullDiT μπορεί να ενσωματώσει άρτια άλλες modalities με ελάχιστη τροποποίηση αρχιτεκτονικής, το πώς να προσαρμόσετε γρήγορα και οικονομικά τα υπάρχοντα μοντέλα σε νέες συνθήκες και modalities είναι ακόμη ένα σημαντικό ερώτημα που απαιτεί περαιτέρω διερεύνηση.’

Αν και οι ερευνητές παρουσιάζουν το FullDiT ως ένα βήμα προς τα εμπρός στη γεννήτρια πολλαπλής εργασίας βίντεο, πρέπει να θεωρηθεί ότι αυτή η νέα εργασία βασίζεται σε υπάρχουσες αρχιτεκτονικές παρά να εισάγει ένα θεμελιωδώς νέο парадίγμα.

Ωστόσο, το FullDiT βρίσκεται τώρα μόνος του (κατά την καλύτερη γνώση μου) ως ένα μοντέλο βίντεο θεμελίου με ‘σκληρά-κωδικοποιημένα’ μέτρα τύπου ControlNet – και είναι καλό να δούμε ότι η προτεινόμενη αρχιτεκτονική μπορεί να φιλοξενήσει αργότερα καινοτομίες επίσης.

Πατήστε για αναπαραγωγή. Παραδείγματα ελέγχου κάμερας από τη σελίδα του έργου.

Το νέο έγγραφο ονομάζεται FullDiT: Πολλαπλή-Εργασία Γεννήτρια Βίντεο Θεμελίου Μοντέλο με Πλήρη Προσοχή, και προέρχεται από εννέα ερευνητές σε Kuaishou Technology και το Πανεπιστήμιο του Χονγκ Κονγκ. Η σελίδα του έργου είναι εδώ και η νέα βάση δεδομένων είναι στο Hugging Face.

Μέθοδος

Οι συγγραφείς ισχυρίζονται ότι η ενιαία μηχανισμός προσοχής του FullDiT επιτρέπει ισχυρότερη δια-μονάδα αναπαράσταση μάθησης με την κατανόηση τόσο χωρικών όσο και χρονικών σχέσεων μεταξύ συνθηκών:

Σύμφωνα με το νέο έγγραφο, το FullDiT ενσωματώνει πολλαπλά συνθήκες εισόδου μέσω πλήρους αυτο-προσοχής, μετατρέποντάς τες σε μια ενιαία ακολουθία. Αντίθετα, τα μοντέλα με προσαρμογείς (αριστερά) χρησιμοποιούν ξεχωριστά μέρη για κάθε είσοδο, οδηγώντας σε πλεονασμό, συγκρούσεις και ασθενέστερη απόδοση.

Αντίθετα με τις ρυθμίσεις με προσαρμογείς που επεξεργάζονται κάθε ροή εισόδου ξεχωριστά, αυτή η κοινή δομή προσοχής αποφεύγει τις συγκρούσεις διακλαδώσεων και μειώνει τον πλεονασμό παραμέτρων. Ισχυρίζονται επίσης ότι η αρχιτεκτονική μπορεί να κλιμακωθεί σε νέους τύπους εισόδου χωρίς σημαντική ανασχεδιασμό – και ότι το σχήμα του μοντέλου δείχνει σημάδια γενίκευσης σε συνδυασμούς συνθηκών που δεν έχουν δει κατά την εκπαίδευση, όπως η σύνδεση της κίνησης κάμερας με την ταυτότητα του χαρακτήρα.

Πατήστε για αναπαραγωγή. Παραδείγματα γεννήτριας ταυτότητας από τη σελίδα του έργου.

Στην αρχιτεκτονική του FullDiT, όλες οι συνθήκες εισόδου – όπως κείμενο, κίνηση κάμερας, ταυτότητα και βάθος – μετατρέπονται πρώτα σε ένα ενιαίο μορφό τокέν. Αυτά τα τокέν συνδέονται στη συνέχεια σε μια ενιαία μακρά ακολουθία, η οποία επεξεργάζεται μέσω eines σωρού μετασχηματιστών χρησιμοποιώντας πλήρη αυτο-προσοχή. Αυτή η προσέγγιση ακολουθεί προηγούμενες εργασίες όπως Open-Sora Plan και Movie Gen.

Αυτή η σχεδίαση επιτρέπει στο μοντέλο να μάθει χωρικές και χρονικές σχέσεις από κοινού σε όλες τις συνθήκες. Κάθε μπλοκ μετασχηματιστή λειτουργεί σε ολόκληρη την ακολουθία, επιτρέποντας δυναμικές αλληλεπιδράσεις μεταξύ modalities χωρίς να βασίζεται σε ξεχωριστά μέρη για κάθε είσοδο – και, όπως έχουμε σημειώσει, η αρχιτεκτονική σχεδιάζεται για να είναι επεκτάσιμη, καθιστώντας πολύ εύκολο να ενσωματωθούν πρόσθετοι σημάδες ελέγχου στο μέλλον, χωρίς σημαντικές δομικές αλλαγές.

Η Δύναμη του Τριών

Το FullDiT μετατρέπει κάθε σήμα ελέγχου σε ένα τυποποιημένο μορφό τокέν, ώστε όλες οι συνθήκες να μπορούν να επεξεργαστούν μαζί σε ένα ενιαίο πλαίσιο προσοχής. Για την κίνηση κάμερας, το μοντέλο κωδικοποιεί μια ακολουθία εξωτερικών παραμέτρων – όπως θέση και προσανατολισμός – για κάθε καρέ. Αυτές οι παράμετροι είναι χρονοσφραγισμένες και προβαλλόμενες σε διανυσματικές προβολές που αντανακλούν τη χρονική φύση του σήματος.

Οι πληροφορίες ταυτότητας αντιμετωπίζονται διαφορετικά,既然 είναι εγγενώς χωρικές και όχι χρονικές. Το μοντέλο χρησιμοποιεί χάρτες ταυτότητας που δείχνουν ποιους χαρακτήρες υπάρχουν σε ποιες περιοχές κάθε καρέ. Αυτοί οι χάρτες διαιρούνται σε patches, με κάθε patch προβαλλόμενο σε μια εμφωλευτική που κατανόησε χωρικές πληροφορίες ταυτότητας, επιτρέποντας στο μοντέλο να συνδέσει συγκεκριμένες περιοχές του καρέ με συγκεκριμένα οντότητες.

Το βάθος είναι ένα σπατιo-χρονικό σήμα, και το μοντέλο το χειρίζεται διαιρώντας τα βίντεο βάθους σε 3D patches που διαρκούν τόσο τον χώρο όσο και τον χρόνο. Αυτά τα patches εμβαπτίζονται με έναν τρόπο που διατηρεί τη δομή τους σε όλα τα καρέ.

Όταν εμβαπτιστούν, όλα αυτά τα τокέν συνθηκών (κάμερα, ταυτότητα και βάθος) συνδέονται σε μια ενιαία μακρά ακολουθία, επιτρέποντας στο FullDiT να τα επεξεργαστεί μαζί χρησιμοποιώντας πλήρη αυτο-προσοχή. Αυτή η κοινή αναπαράσταση καθιστά δυνατό για το μοντέλο να μάθει αλληλεπιδράσεις μεταξύ modalities και χρόνου χωρίς να βασίζεται σε απομονωμένες ροές επεξεργασίας.

Δεδομένα και Δοκιμές

Η προσέγγιση εκπαίδευσης του FullDiT βασίστηκε σε επιλεκτικά αναγραφόμενα σύνολα δεδομένων που προσαρμόστηκαν σε κάθε τύπο συνθήκης.

Για συνθήκες κειμένου, η πρωτοβουλία ακολουθεί την προσέγγιση κατηγοριοποίησης που περιγράφεται στο έργο MiraData.

Συλλογή βίντεο και πορεία αναγραφής από το έργο MiraData. Source: https://arxiv.org/pdf/2407.06358

Για την κίνηση κάμερας, το σύνολο δεδομένων RealEstate10K ήταν η основная πηγή δεδομένων, λόγω των υψηλής ποιότητας αναγραφών παραμέτρων κάμερας.

Ωστόσο, οι συγγραφείς παρατήρησαν ότι η εκπαίδευση αποκλειστικά σε στατικές-σκηνής σύνολα δεδομένων κάμερας όπως το RealEstate10K είχε την τάση να μειώνει τις δυναμικές κινήσεις αντικειμένων και ανθρώπων στις γεννημένες βίντεο. Για να αντεπεξέλθουν σε αυτό, conducted επιπλέον εξευγενισμό χρησιμοποιώντας εσωτερικά σύνολα δεδομένων που περιείχαν περισσότερες δυναμικές κινήσεις κάμερας.

Οι αναγραφές ταυτότητας δημιουργήθηκαν χρησιμοποιώντας την πορεία που αναπτύχθηκε για το έργο ConceptMaster, το οποίο επέτρεψε την αποτελεσματική φιλτράρισή και εξαγωγή λεπτομερούς πληροφοριών ταυτότητας.

Το πλαίσιο ConceptMaster σχεδιάστηκε για να αντιμετωπίσει ζητήματα αποσύνδεσης ταυτότητας ενώ διατηρεί την πιστότητα του концепτού σε προσαρμοσμένα βίντεο. Source: https://arxiv.org/pdf/2501.04698

Οι αναγραφές βάθους λήφθηκαν από το σύνολο δεδομένων Panda-70M χρησιμοποιώντας Depth Anything.

Βελτίωση Μέσω Διατακτικής-Τάξης

Οι συγγραφείς υλοποίησαν επίσης ένα προοδευτικό πρόγραμμα εκπαίδευσης, εισάγοντας πιο απαιτητικές συνθήκες νωρίτερα στην εκπαίδευση για να διασφαλίσουν ότι το μοντέλο απέκτησε ρομποτικές αναπαραστάσεις πριν προστεθούν απλούστερες εργασίες. Η σειρά εκπαίδευσης προχώρησε από κείμενο σε κάμερα συνθήκες, στη συνέχεια ταυτότητας, και τελικά βάθος, με ευκολότερες εργασίες που εισάγονται γενικά αργότερα και με λιγότερα παραδείγματα.

Οι συγγραφείς τονίζουν την αξία της διατακτικής-τάξης αυτής:

‘Κατά τη φάση προ-εκπαίδευσης, παρατηρήσαμε ότι πιο απαιτητικές εργασίες απαιτούν παρατεταμένη χρόνο εκπαίδευσης και πρέπει να εισαχθούν νωρίτερα στη διαδικασία μάθησης. Αυτές οι απαιτητικές εργασίες περιλαμβάνουν σύνθετες κατανομές δεδομένων που διαφέρουν σημαντικά από την έξοδο βίντεο, απαιτώντας από το μοντέλο να έχει αρκετή ικανότητα για να τις αναπαραστήσει και να τις εκφράσει ακριβώς.

‘Αντίθετα, η εισαγωγή ευκολότερων εργασιών πολύ νωρίς μπορεί να οδηγήσει το μοντέλο να προτιμήσει να μάθει πρώτα αυτές,既然 προσφέρουν άμεση ανατροφοδότηση βελτίωσης, η οποία εμποδίζει τη σύγκλιση πιο απαιτητικών εργασιών.’

Εικονογράφηση της σειράς εκπαίδευσης που υιοθετήθηκε από τους ερευνητές, με κόκκινο που δείχνει μεγαλύτερο όγκο δεδομένων.

Μετά την αρχική προ-εκπαίδευση, ένα τελικό στάδιο εξευγενισμού βελτίωσε περαιτέρω το μοντέλο για να βελτιώσει την οπτική ποιότητα και την κίνηση. Στη συνέχεια, η εκπαίδευση ακολούθησε εκείνη ενός τυπικού πλαισίου διάχυσης*: θόρυβος προστέθηκε στα latents βίντεο, και το μοντέλο μάθει να προβλέψει και να αφαιρέσει, χρησιμοποιώντας τα ενσωματωμένα τокέν συνθηκών ως οδηγία.

Για να αξιολογήσουν αποτελεσματικά το FullDiT και να παρέχουν μια δίκαιη σύγκριση με τις υφιστάμενες μεθόδους, και στην απουσία της διαθεσιμότητας οποιουδήποτε άλλου κατάλληλου βENCHMARK, οι συγγραφείς εισήγαγαν FullBench, μια επιμελημένη βάση δοκιμών που αποτελείται από 1.400 ξεχωριστές περιπτώσεις δοκιμής.

Μια περίπτωση εξερεύνησης δεδομένων για τη νέα βάση δοκιμής FullBench. Source: https://huggingface.co/datasets/KwaiVGI/FullBench

Κάθε σημείο δεδομένων παρείχε αναγραφές για διάφορες συνθήκες, συμπεριλαμβανομένων κίνησης κάμερας, ταυτότητας, και βάθους.

Μέτρησεις

Οι συγγραφείς αξιολόγησαν το FullDiT χρησιμοποιώντας δέκα μέτρησεις που καλύπτουν πέντε основные аспектs της απόδοσης: ευθυγράμμιση κειμένου, έλεγχος κάμερας, ομοιότητα ταυτότητας, ακρίβεια βάθους, και γενική ποιότητα βίντεο.

Η ευθυγράμμιση κειμένου μετρήθηκε χρησιμοποιώντας CLIP ομοιότητα, ενώ ο έλεγχος κάμερας αξιολογήθηκε μέσω σφάλματος περιστροφής (RotErr), σφάλματος μετάφρασης (TransErr), και συνέπειας κίνησης κάμερας (CamMC), ακολουθώντας την προσέγγιση του CamI2V (στο CameraCtrl έργο).

Η ομοιότητα ταυτότητας αξιολογήθηκε χρησιμοποιώντας DINO-I και CLIP-I, και η ακρίβεια ελέγχου βάθους ποσοτικοποιήθηκε χρησιμοποιώντας Μέσο Απόλυτο Σφάλμα (MAE).

Η ποιότητα βίντεο αξιολογήθηκε με τρεις μέτρησεις από το MiraData: CLIP ομοιότητα σε επίπεδο καρέ για ομαλότητα; απόσταση κίνησης με βάση την οπτική ροή για δυναμική; και LAION-Aesthetic για οπτική ελκυστικότητα.

Εκπαίδευση

Οι συγγραφείς εκπαίδευσαν το FullDiT χρησιμοποιώντας ένα εσωτερικό (μη δημοσιευμένο) κείμενο-προς-βίντεο μοντέλο διάχυσης που περιείχε περίπου ένα δισεκατομμύριο παραμέτρους. Επιλέχθηκαν σκόπιμα ένα μετριοπαθές μέγεθος παραμέτρων για να διατηρήσουν την ισορροπία στις συγκρίσεις με προηγούμενες μεθόδους και να εξασφαλίσουν την αναπαραγωγιμότητα.

Καθώς τα βίντεο εκπαίδευσης διέφεραν σε μήκος και ανάλυση, οι συγγραφείς стандάρδευσαν κάθε μπατς με την αναδιαμόρφωση και το padding των βίντεο σε μια κοινή ανάλυση, δειγματοληψία 77 καρέ ανά ακολουθία, και χρησιμοποιώντας προσοχή και μάσκα απώλειας για να βελτιώσουν την αποτελεσματικότητα της εκπαίδευσης.

Ο βελτιωτής Adam χρησιμοποιήθηκε με μια ταχύτητα μάθησης 1×10−5 σε ένα cluster 64 NVIDIA H800 GPU, για ένα συνδυασμένο σύνολο 5.120GB VRAM (σκέφτηκε ότι στις κοινότητες συνθέσεων, 24GB σε ένα RTX 3090 θεωρείται ακόμη ένας πολυτελής chuẩn).

Το μοντέλο εκπαιδεύτηκε για περίπου 32.000 βήματα, ενσωματώνοντας μέχρι τρεις ταυτότητες ανά βίντεο, μαζί με 20 καρέ συνθηκών κάμερας και 21 καρέ συνθηκών βάθους, όλα ομοιόμορφα δειγματοληπτικά από τα συνολικά 77 καρέ.

Για την αναπαραγωγή, το μοντέλο γεννούσε βίντεο σε ανάλυση 384×672 pixels (περίπου πέντε δευτερόλεπτα σε 15 καρέ ανά δευτερόλεπτο) με 50 βήματα αναπαραγωγής διάχυσης και μια κλίμακα οδηγούμενης από ταξινόμηση πέντε.

Προηγούμενες Μέθοδοι

Για την αξιολόγηση κάμερας-προς-βίντεο, οι συγγραφείς σύγκριναν το FullDiT με MotionCtrl, CameraCtrl, και CamI2V, με όλα τα μοντέλα εκπαιδευμένα χρησιμοποιώντας το σύνολο δεδομένων RealEstate10k για να εξασφαλίσουν συν nhấtότητα και ισορροπία.

Στην γεννήτρια που βασίζεται σε ταυτότητα,既然 δεν ήταν διαθέσιμα συγκρίσιμα ανοικτά μοντέλα πολλαπλής ταυτότητας, το μοντέλο αξιολογήθηκε με το 1B-παραμέτρου μοντέλο ConceptMaster, χρησιμοποιώντας τα ίδια δεδομένα εκπαίδευσης και αρχιτεκτονική.

Για τις εργασίες βάθους-προς-βίντεο, οι συγκρίσεις έγιναν με Ctrl-Adapter και ControlVideo.

Ποσοτικές αποτελέσματα για γεννήτρια μονής εργασίας βίντεο. Το FullDiT συγκρίθηκε με MotionCtrl, CameraCtrl, και CamI2V για γεννήτρια κάμερας-προς-βίντεο; ConceptMaster (1B-παραμέτρου έκδοση) για γεννήτρια ταυτότητας-προς-βίντεο; και Ctrl-Adapter και ControlVideo για γεννήτρια βάθους-προς-βίντεο. Όλα τα μοντέλα αξιολογήθηκαν χρησιμοποιώντας τις προεπιλογές τους. Για συν nhấtότητα, 16 καρέ δειγματοληπτικά από κάθε μέθοδο, ταιριάζοντας με το μήκος εξόδου των προηγούμενων μοντέλων.

Τα αποτελέσματα δείχνουν ότι το FullDiT, παρά το ότι χειρίζεται πολλαπλά σήματα συνθήκων ταυτόχρονα, πέτυχε την κορυφαία απόδοση σε μέτρησεις που σχετίζονται με κείμενο, κίνηση κάμερας, ταυτότητα και έλεγχο βάθους.

Στις γενικές μέτρηες ποιότητας, το σύστημα γενικά ξεπέρασε τις άλλες μεθόδους, αν και η ομαλότητα του ήταν ελαφρώς χαμηλότερη από εκείνη του ConceptMaster. Εδώ οι συγγραφείς σχολιάζουν:

‘Η ομαλότητα του FullDiT είναι ελαφρώς χαμηλότερη από εκείνη του ConceptMaster既然 η ομαλότητα υπολογίζεται με βάση την CLIP ομοιότητα μεταξύ γειτονικών καρέ.既然 το FullDiT εμφανίζει σημαντικά μεγαλύτερη δυναμική σε σύγκριση με το ConceptMaster, η μέτρηση ομαλότητας επηρεάζεται από τις μεγάλες διακυμάνσεις μεταξύ γειτονικών καρέ.

‘Για το αισθητικό σκορ,既然 το μοντέλο αξιολόγησης προτιμά εικόνες σε στυλ ζωγραφικής και το ControlVideo γενικά παράγει βίντεο σε αυτό το στυλ, επιτυγχάνει υψηλό σκορ σε αισθητική.’

Σχετικά με τη ποιοτική σύγκριση, μπορεί να είναι προτιμότερο να αναφερθείτε στα δείγματα βίντεο στη σελίδα του έργου FullDiT,既然 τα παραδείγματα PDF είναι αναπόφευκτα στατικά (και επίσης πολύ μεγάλα για να αναπαραχθούν εδώ).

Το πρώτο τμήμα των ποιοτικών αποτελεσμάτων στο PDF. Παρακαλούμε αναφερθείτε στο αρχικό έγγραφο για τα πρόσθετα παραδείγματα, τα οποία είναι πολύ εκτενείς για να αναπαραχθούν εδώ.

Οι συγγραφείς σχολιάζουν:

‘Το FullDiT δείχνει ανώτερη διατήρηση ταυτότητας και γεννά βίντεο με καλύτερη δυναμική και οπτική ποιότητα σε σύγκριση με το ConceptMaster.既然 το ConceptMaster και το FullDiT εκπαιδεύτηκαν στο ίδιο υπόβαθρο, αυτό υπογραμμίζει την αποτελεσματικότητα της ένεσης συνθήκων με πλήρη προσοχή.

‘…Τα αποτελέσματα δείχνουν την ανώτερη ελεγκτικότητα και ποιότητα γεννήτριας του FullDiT σε σύγκριση με τις υπάρχουσες μεθόδους βάθους-προς-βίντεο και κάμερας-προς-βίντεο.’

Ένα τμήμα του PDF με παραδείγματα εξόδου του FullDiT με πολλαπλά σήματα. Παρακαλούμε αναφερθείτε στο αρχικό έγγραφο και τη σελίδα του έργου για πρόσθετα παραδείγματα.

Σύγκλιση

Αν και το FullDiT είναι μια ενθουσιαστική εισβολή σε ένα πιο πλήρες είδος μοντέλου βίντεο θεμελίου, πρέπει να αναρωτηθούμε αν η ζήτηση για μέτρα τύπου ControlNet θα δικαιολογήσει ποτέ την υλοποίηση τέτοιων λειτουργιών σε κλίμακα, τουλάχιστον για FOSS έργα, τα οποία θα αγωνιστούν να αποκτήσουν την τεράστια ποσότητα GPU που απαιτείται, χωρίς εμπορική υποστήριξη.

Η основная πρόκληση είναι ότι η χρήση συστημάτων όπως το Depth και το Pose γενικά απαιτεί μη τριβή熟悉ότητα με σχετικά σύνθετα διεπαφές χρήστη όπως το ComfyUI. Έτσι, φαίνεται ότι ένα λειτουργικό FOSS μοντέλο αυτού του είδους είναι πιο πιθανό να αναπτυχθεί από μια ομάδα μικρότερων εταιρειών VFX που δεν έχουν τα χρήματα (ή τη βούληση,既然 τέτοιες συστήματα γίνονται γρήγορα ξεπερασμένα από αναβαθμίσεις μοντέλων) για να δημιουργήσουν και να εκπαιδεύσουν τέτοιο μοντέλο πίσω από κλειστές πόρτες.

Από την άλλη πλευρά, τα API-κίνητα ‘ενοικιάζεται-ΑΙ’ συστήματα μπορεί να είναι καλά κινητοποιημένα για να αναπτύξουν απλούστερες και πιο φιλικές προς τον χρήστη ερμηνευτικές μεθόδους για μοντέλα στα οποία έχουν ενσωματωθεί άμεσα συστήματα ελέγχου.

Πατήστε για αναπαραγωγή. Έλεγχος Βάθους+Κείμενο που επιβάλλεται σε γεννήτρια βίντεο χρησιμοποιώντας το FullDiT.

* Οι συγγραφείς δεν καθορίζουν κανένα γνωστό υπόβαθρο μοντέλου (π.χ. SDXL, κ.λπ.)

Πρώτη δημοσίευση Πέμπτη, 27 Μαρτίου 2025