Τεχνητή νοημοσύνη

Mistral AI: Ρίχνοντας Νέους Σταθμούς Μπροστά από το Llama2 στο Χώρο των Ανοικτών Πηγών

Τα Μεγάλα Γλωσσικά Μοντέλα (LLMs) έχουν πάρει πρόσφατα τον κεντρικό ρόλο, χάρη σε εξαιρετικές επιδόσεις όπως το ChatGPT. Όταν η Meta εισήγαγε τα μοντέλα Llama, αυτό ξαναέδωσε ζωή στο ενδιαφέρον για τα ανοικτά LLMs. Ο στόχος; Να δημιουργηθούν προσιτά, ανοικτά LLMs που είναι τόσο καλά όσο τα κορυφαία μοντέλα όπως το GPT-4, αλλά χωρίς το υψηλό κόστος ή την复잡ότητα.

Αυτό το μείγμα προσιότητας και αποδοτικότητας άνοιξε nicht μόνο νέες οδούς για ερευνητές και développers αλλά και έθεσε τη σκηνή για eine νέα εποχή τεχνολογικών προόδων στη επεξεργασία φυσικής γλώσσας.

Πρόσφατα, οι εταιρείες generative AI έχουν λάβει μέρος σε eine σειρά χρηματοδοτήσεων. Μαζί raised $20 million, με στόχο να διαμορφώσουν τα ανοικτά AI. Η Anthropic também raised ένα εντυπωσιακό $450 million, και η Cohere, σε συνεργασία με τη Google Cloud, secured $270 million τον Ιούνιο αυτό το χρόνο.

Εισαγωγή στο Mistral 7B: Μέγεθος & Διαθεσιμότητα

Το Mistral AI, με έδρα το Παρίσι και συνιδρυτές από τους DeepMind και Meta, ανακοίνωσε το πρώτο μεγάλο γλωσσικό μοντέλο: Mistral 7B. Αυτό το μοντέλο μπορεί να κατεβάσει κανείς εύκολα από το GitHub και ακόμη μέσω ενός 13.4-gigabyte torrent.

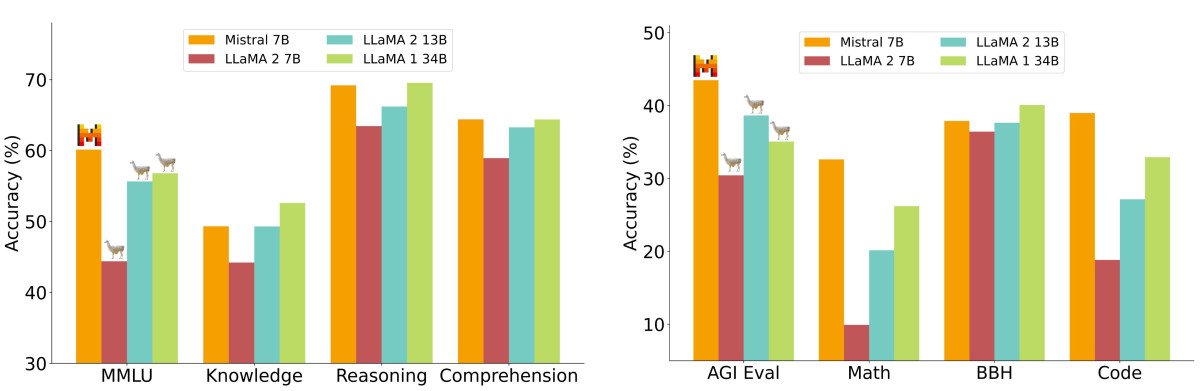

Αυτή η εταιρεία κατάφερε να εξασφαλίσει ρεκόρ χρηματοδότησης ακόμη και πριν από την κυκλοφορία του προϊόντος. Το πρώτο μοντέλο του Mistral με 7 δισεκατομμύρια παραμέτρους υπερβαίνει τις επιδόσεις του Llama 2 13B σε όλα τα τεστ και νικά το Llama 1 34B σε πολλά μετρικά.

Τι πραγματικά κάνει το Μοντέλο Mistral 7B καλύτερο από τα περισσότερα άλλα Γλωσσικά Μοντέλα;

Απλοποίηση των Μηχανισμών Προσοχής

Ενώ οι λεπτομέρειες των μηχανισμών προσοχής είναι τεχνικές, η βασική ιδέα είναι σχετικά απλή. Φανταστείτε ότι διαβάζετε ένα βιβλίο και υπογραμμίζετε σημαντικές προτάσεις· αυτό είναι ανάλογο με τον τρόπο που οι μηχανισμοί προσοχής “υπογραμμίζουν” ή δίνουν σημασία σε συγκεκριμένα δεδομένα σε μια ακολουθία.

Στο πλαίσιο των γλωσσικών μοντέλων, αυτοί οι μηχανισμοί επιτρέπουν στο μοντέλο να εστιάσει στις πιο σχετικές partes των εισοδικών δεδομένων, εξασφαλίζοντας ότι η έξοδος είναι συνεκτική και контекστοποιημένη.

Στους τυπικούς μετασχηματιστές, οι βαθμοί προσοχής υπολογίζονται με τη формуλή:

Η формуλή για αυτούς τους βαθμούς περιλαμβάνει ένα κρίσιμο βήμα – τον πολλαπλασιασμό των πινάκων Q και K. Η πρόκληση εδώ είναι ότι καθώς η μήκος της ακολουθίας αυξάνεται, και οι δύο πίνακες επεκτείνονται αναλόγως, οδηγώντας σε μια υπολογιστικά εντατική διαδικασία. Αυτή η ανησυχία για την κλιμάκωση είναι ένας από τους κύριους λόγους για τους οποίους οι τυπικοί μετασχηματιστές μπορούν να είναι αργοί, ιδιαίτερα όταν αντιμετωπίζουν μεγάλες ακολουθίες.

Η προσοχή πολλαπλών ερωτημάτων (MQA) επιταχύνει τις cosas χρησιμοποιώντας ένα σύνολο “κλειδιών-τιμών” κεφαλών, αλλά đôi khi θυσιάζει την ποιότητα. Τώρα, μπορείτε να αναρωτηθείτε, γιατί δεν συνδυάζουμε την ταχύτητα της MQA με την ποιότητα της προσοχής πολλαπλών κεφαλών; Αυτό είναι όπου έρχεται η ομαδοποιημένη προσοχή ερωτημάτων (GQA).

Ομαδοποιημένη Προσοχή Ερωτημάτων (GQA)

Η GQA είναι μια μέση λύση. Αντί να χρησιμοποιήσετε μόνο μία ή πολλές “κλειδιών-τιμών” κεφαλές, ομαδοποιεί. Αυτό το τρόπο, η GQA επιτυγχάνει μια απόδοση κοντά στην απόδοση της προσοχής πολλαπλών κεφαλών, αλλά με την ταχύτητα της MQA. Για μοντέλα όπως το Mistral, αυτό σημαίνει αποτελεσματική απόδοση χωρίς να θυσιάζεται πολύ στην ποιότητα.

Συρτό Προσοχής (SWA)

Το συρτό είναι μια άλλη μέθοδος που χρησιμοποιείται στην επεξεργασία ακολουθιών προσοχής. Αυτή η μέθοδος χρησιμοποιεί ένα σταθερό μέγεθος παράθυρο προσοχής γύρω από κάθε token στην ακολουθία. Με πολλαπλά στρώματα που στοιβάζουν αυτό το παράθυρο προσοχής, τα ανώτερα στρώματα τελικά κερδίζουν μια ευρύτερη προοπτική, περιλαμβάνοντας πληροφορίες από ολόκληρη την εισοδο.

Διαφάνεια του Mistral AI vs. Προβλήματα Ασφαλείας στη Δεκετράλωση

Στην ανακοίνωσή τους, το Mistral AI τόνισε επίσης τη διαφάνεια με την δήλωση: “Χωρίς τέχνασμα, χωρίς ιδιόκτητα δεδομένα.” Αλλά η μόνη διαθέσιμη μοντέλο στο παρόν ‘Mistral-7B-v0.1’ είναι ένα προ-εκπαιδευμένο βασικό μοντέλο, επομένως μπορεί να παράγει μια απάντηση σε οποιαδήποτε ερώτηση χωρίς διαμεσολάβηση, που ανεβάζει πιθανές ανησυχίες ασφαλείας. Ενώ μοντέλα όπως το GPT και το Llama έχουν μηχανισμούς για να καταλάβουν πότε να απαντήσουν, η πλήρως αποκεντρωμένη φύση του Mistral μπορεί να εκμεταλλευτεί από κακόβουλα άτομα.

Ωστόσο, η αποκέντρωση των Μεγάλων Γλωσσικών Μοντέλων έχει τα πλεονεκτήματά της. Ενώ κάποιοι μπορεί να την εκμεταλλευτούν, οι άνθρωποι μπορούν να αξιοποιήσουν τη δύναμή της για κοινωνικό καλό και να κάνουν τη νοημοσύνη προσβάσιμη σε όλους.

Ελαστικότητα Εγκατάστασης

Ένα από τα highlights είναι ότι το Mistral 7B είναι διαθέσιμο με την άδεια Apache 2.0. Αυτό σημαίνει ότι δεν υπάρχουν πραγματικά εμπόδια για τη χρήση του – ανεξάρτητα από το αν το χρησιμοποιείτε για προσωπικούς σκοπούς, μια τεράστια εταιρεία ή ακόμη και ένα κυβερνητικό όργανο. Απλά χρειάζεστε το σωστό σύστημα για να το τρέξετε, ή μπορεί να πρέπει να επενδύσετε σε πόρους cloud.

Ενώ υπάρχουν άλλες άδειες όπως η απλή άδεια MIT και η συνεργατική άδεια CC BY-SA-4.0, η οποία απαιτεί πίστωση και παρόμοια άδεια για παραγόμενα έργα, η άδεια Apache 2.0 παρέχει μια σταθερή βάση για μεγάλης κλίμακας επιχειρήσεις.

Τελικές Σκέψεις

Η άνοδος των ανοικτών Μεγάλων Γλωσσικών Μοντέλων όπως το Mistral 7B σηματοδοτεί μια κρίσιμη στροφή στη βιομηχανία AI, καθιστώντας τα υψηλής ποιότητας γλωσσικά μοντέλα προσβάσιμα σε ένα ευρύτερο κοινό. Οι καινοτόμες προσεγγίσεις του Mistral AI, όπως η ομαδοποιημένη προσοχή ερωτημάτων και η συρτή προσοχή, υπόσχονται αποτελεσματική απόδοση χωρίς να θυσιάζεται πολύ στην ποιότητα.

Ενώ η αποκέντρωση του Mistral θέτει ορισμένα προβλήματα, η ελαστικότητά του και η ανοικτή άδεια τονίζουν το δυναμικό για δημοκρατία της AI. Όσο εξελίσσεται το τοπίο, ο στόχος θα είναι αναπόφευκτα η ισορροπία της δύναμης αυτών των μοντέλων με倫ικές σκέψεις και μηχανισμούς ασφαλείας.

Τι έρχεται επόμενο για το Mistral; Το μοντέλο 7B ήταν μόνο η αρχή. Η ομάδα στοχεύει να κυκλοφορήσει ακόμη μεγαλύτερα μοντέλα σύντομα. Αν αυτά τα νέα μοντέλα ανταποκριθούν στις επιδόσεις του 7B, το Mistral μπορεί να αναρριχηθεί γρήγορα ως ένας από τους κορυφαίους παίκτες στη βιομηχανία, όλα μέσα στο πρώτο χρόνο.