Η γωνία του Anderson

Το AI Προτιμά να Διαβάσει το Βιβλίο Παρά να Δει την Ταινία

Είναι εκπληκτικά δύσκολο να πείσεις τα μοντέλα AI να δουν και να σχολιάσουν πραγματικό βίντεο, ακόμη και αν έχουν σχεδιαστεί για αυτό. Είναι πιο ενδιαφερόμενα για το γραπτό λόγο.

Εάν έχετε προσπαθήσει να ανεβάσετε ένα μικρό βίντεο στο ChatGPT ή σε ένα παρόμοιο δημοφιλές μοντέλο όρασης/γλώσσας, μπορεί να σας έχει εκπλήξει να συνειδητοποιήσετε ότι δεν μπορούν πραγματικά να αναλύσουν βίντεο. Ενώ μοντέλα όπως το ChatGPT-4o+ μπορούν να αναλύσουν отдельные καρέ – στη μορφή εικόνων, όπως JPEG και PNG – προτιμούν ο χρήστης να εξαγάγει τα δικά του καρέ και να τα ανεβάσει ως εικόνες (τις οποίες είναι προετοιμασμένες να σχολιάσει).

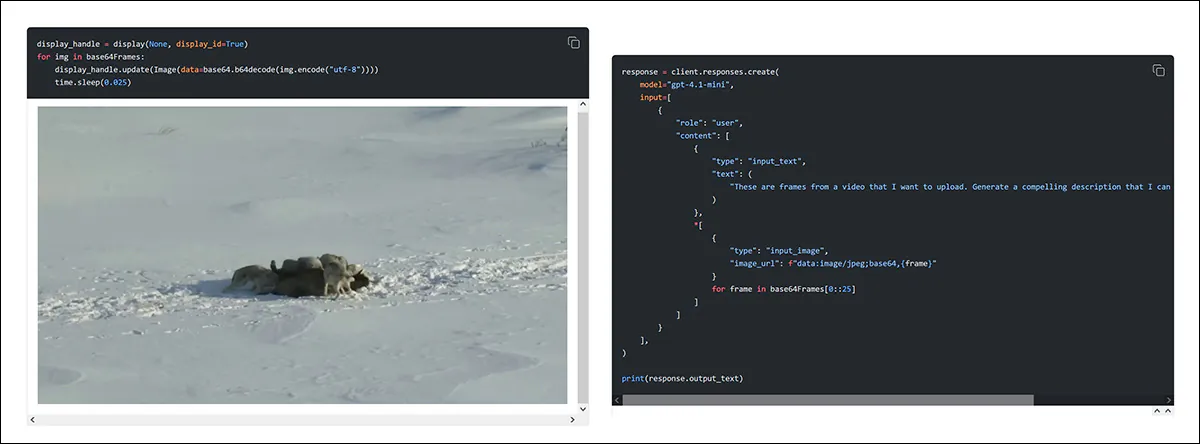

Στην περίπτωση της σειράς OpenAI GPT, μπορείτε, με κάποια δυσκολία, να εξαγάγετε μια πλήρη σειρά καρέ από ένα βίντεο και να τα διαβάσετε στο ChatGPT, για τους σκοπούς, για παράδειγμα, δημιουργίας ενός AI-δημιουργημένου αφηγηματικού κομματιού για το βίντεο:

Εικόνες και κώδικας από ένα tutorial του OpenAI για την ανάλυση πολλαπλών εξαγμένων καρέ για τον σκοπό της ανάπτυξης ενός AI-δημιουργημένου σχολιασμού για ένα βίντεο. Πηγή

Αλλά πέφτει στον χρήστη να κάνει τη μετατροπή από βίντεο σε καρέ, είτε καλώντας συναρτήσεις σε μια μεγαλύτερη διαδικασία, όπως στο παραπάνω παράδειγμα, είτε εξαγώντας τα καρέ με FFMPEG ή διάφορες δωρεάν και πληρωμένες λύσεις επεξεργασίας βίντεο.

Σε κάποιο βαθμό, ίσως ακόμη και σε μεγάλο βαθμό, οι περιορισμοί στην ανάλυση βίντεο σε προϊόντα μεγάλης κλίμακας όπως το ChatGPT εξαρτώνται από χρήση πόρων: απλώς να εξοπλιστεί ένα экземπляρ AI με μια επιλογή από τους πιο δημοφιλείς κωδικοποιητές βίντεο και να δεσμεύσει πόρους υπολογιστή για τη διαδικασία εξαγωγής είναι keine μικρή σκέψη, εάν εκατομμύρια χρήστες αποφασίσουν να αρχίσουν να χρησιμοποιούν αυτές τις εγκαταστάσεις κάθε μέρα.

Επιπλέον, η χρονική ανάλυση μπορεί να ζωγραφίσει ένα πολύ διαφορετικό πορτρέτο από ένα單ο καρέ (φανταστείτε κάποιον που μπαίνει σε ένα σπίτι με καλή διάθεση και στη συνέχεια ανακαλύπτει ένα πτώμα)· επομένως, η εξέταση του ολόκληρου χρονικού “checksum” sogar eines βραχέως βίντεο είναι μια απαιτητική και πόρων-εντατική εργασία – καθώς και ένα εξειδικευμένο πεδίο της ερευνητικής βιβλιογραφίας, για παράδειγμα με την συνεχιζόμενη ανάπτυξη πλαισίων όπως Optical Flow – που ουσιαστικά “ανοίγει” ένα μήκος βίντεο ώστε να μπορεί να θεωρηθεί και να ενεργηθεί ως εάν ήταν ένα στατικό έγγραφο:

Διαγράμματα ροής οπτικών υπογραμμίζουν πώς η κίνηση παρακολουθείται σε καρέ σε μια ακολουθία βίντεο, με πράσινους διανυσματικούς δείκτες που δείχνουν κατεύθυνση και ένταση. Αυτά τα χάρτηματα παρέχουν τη χρονική συνέχεια που απαιτείται για τα VLM και μπορούν επίσης να χρησιμεύσουν ως οδηγοί δομής σε ροές VFX. Πηγή

Εγκαταλείποντας τα Cliff’s Notes

Παρά τα αυτά,既然 τα μοντέλα όπως το Google’s Notebook LM και τα πιο πρόσφατα ChatGPT είναι σε θέση να διαβάσουν συσχετιζόμενη μεταδεδομένα (δηλ. ενσωματωμένο κείμενο που περιβάλλει το βίντεο με κάποιον τρόπο), δεν απαγορεύουν την ανέβασμα αρχείων βίντεο· και μερικές φορές, θα προσπαθήσουν ακόμη και να ερμηνεύσουν ένα βίντεο που δεν έχει τέτοια δεδομένα.

Στην ακόλουθη περίπτωση, ανέβασα ένα τυχαίο κλιπ 6 δευτερολέπτων από την ιταλική ταινία Το Χέρι του Θεού (2021) στο NotebookLM, διασφαλίζοντας ότι το κλιπ περιείχε μηδενικά χρήσιμα κείμενα, είτε σε μεταδεδομένα είτε στο όνομα του αρχείου.

Το NotebookLM στη συνέχεια προχώρησε στην περίπλοκη εφεύρεση υλικού που δεν σχετίζεται με το βίντεο*, μαζί με ένα ανοητό και μη σχετικό πέντελεπτο podcast:

Μια καθημερινή στιγμή σε ένα κλιπ έξι δευτερολέπτων από μια ιταλική ταινία είναι άγρια λανθασμένη από το NotebookLM. Πηγή: Google NotebookLM

Αν και το Notebook, όπως και το ChatGPT, θα chấp thuận ένα βίντεο του YouTube ως εισαγωγή, θα το κάνει μόνο εάν το βίντεο έχει μια ερμηνεύσιμη στρωματογραφική αναnotaση και/ή υπότιτλους (όχι υπότιτλους που είναι καυτηριασμένοι στο βίντεο).

Σε αυτόν τον τρόπο, η σκληρή δουλειά της πραγματικής παρατήρησης του περιεχομένου του βίντεο και της εκτέλεσης της σημασιολογικής ερμηνείας του (μία νομική αναγκαιότητα για το YouTube, λόγω των μετρών προστασίας πνευματικών δικαιωμάτων, και του επικείμενου συστήματος προστασίας ταυτότητας), έχει γίνει με τη διάθεση μετά την ανέβασμα του χρήστη, όπως και όταν το κλιπ θα μπορούσε να ανατεθεί οι απαραίτητοι πόροι επεξεργασίας.

Πραγματική ερμηνεία βίντεο είναι ακριβή και εξαντλητική, και, όπως αποδεικνύεται, ακόμη και μοντέλα που έχουν εκπαιδευτεί ειδικά για να εκτελέσουν αυτή την εργασία θα προτιμούσαν να διαβάσουν κείμενο παρά να κοιτάξουν πραγματικά το βίντεο.

TL;DW

Αυτό, σύμφωνα με μια νέα εργασία από το Πανεπιστήμιο του Μπρίστολ του Ηνωμένου Βασιλείου, με τίτλο Ένα Βίντεο Δεν Ισούται με Χίλιες Λέξεις, όπου οι δύο συγγραφείς καταλήγουν στο συμπέρασμα ότι τα τρέχοντα state-of-the-art μοντέλα όρασης-γλώσσας (VLMs) – μοντέλα που προορίζονται να μπορούν να αναλύσουν βίντεο με πιο επίμονο τρόπο, και να συμμετέχουν σε ερωτήσεις βίντεο (VQA) – επίσης προτιμούν να βασίζονται σε κείμενο-βασισμένες πληροφορίες όποτε μπορούν.

Όταν δόθηκαν κινητές εικόνες και γραπτές ερωτήσεις και πολλαπλές επιλογές, οι συγγραφείς της εργασίας βρήκαν ότι τα μοντέλα συνήθως βασίζονταν στις επιλογές τους σε σχέση με τα πρότυπα στο κείμενο, παρά σε ο,τιδήποτε συμβαίνει στην οθόνη – σε πολλές περιπτώσεις εκτελώντας τόσο καλά ακόμη και όταν η ερώτηση αφαιρέθηκε εντελώς.

Σε τι φαίνεται να είναι μια συνήθης μορφή συντόμευσης ή απατεώνων, τι ήταν πιο σημαντικό για την πλειοψηφία των μοντέλων ήταν η ικανότητα να αναγνωρίσουν πρότυπα στις πιθανές απαντήσεις· μόνο όταν η εργασία έγινε πιο δύσκολη, με την προσθήκη περισσότερων επιλογών απάντησης, τα AI άρχισαν να προσεχθούν πιο κοντά στο βίντεο.

Οι συγγραφείς έδωσαν ερωτήσεις VQA υπό διάφορες συνθήκες σε έξι VLM μοντέλα με διαφορετικά μήκη контекст, σε τέσσερα κατάλληλα σύνολα δεδομένων· και βρήκαν ότι τα αποτελέσματα έδειξαν την εξάρτηση των μοντέλων από το κείμενο hơn από το περιεχόμενο του βίντεο.

Παράδειγμα από τη μελέτη που δείχνει πώς ένα μοντέλο ανάλυσης βίντεο ζυγίζει τι βλέπει σε σχέση με τι διαβάζει. Το κλιπ δείχνει ένα άτομο που πλέκει βάμβακα, αλλά το μοντέλο αναθέτει πολύ μεγαλύτερη σημασία στο γραπτό ερώτημα και κείμενο απάντησης παρά στα καρέ του βίντεο. Τα μπλε highlights σημειώνουν στοιχεία που υποστηρίζουν την επιλεγμένη απάντηση, ενώ τα κόκκινα σημειώνουν αυτά που την τραβούν στην αντίθετη κατεύθυνση, δείχνοντας πώς η συλλογιστική του μοντέλου κεντράρεται στο κείμενο παρά στις κινούμενες εικόνες. Πηγή

Μέθοδος

Για να κατανοήσουμε πόσο κάθε μέρος της εισαγωγής συνεισφέρει στην απόφαση του μοντέλου, η νέα εργασία χρησιμοποιεί μια μέθοδο από τη θεωρία παιγνίων που ονομάζεται Shapley Values. Αρχικά σχεδιασμένο για να μοιράσει δίκαια μια αμοιβή μεταξύ παικτών σε μια συμμαχία, τα Shapley Values αναθέτουν πίστωση σε κάθε “παίκτη” με βάση την ατομική του επίδραση.

Επιδέξια, λοιπόν, οι παίκτες σε αυτή τη περίπτωση είναι είτε τα καρέ του βίντεο είτε τα κείμενα συστατικών (αναnotaσεις, υπότιτλοι, κ.λπ.) μιας εργασίας VQA· και η “αμοιβή” είναι η τελική απάντηση του μοντέλου. Με τη συστηματική δοκιμή του τι συμβαίνει όταν κάθε μέρος προστίθεται ή αφαιρείται, η τεχνική αποκαλύπτει πόσο σημαντικό ήταν κάθε στοιχείο για να φτάσει στην επιλεγμένη απάντηση.

Στην περίπτωση της νέας εργασίας, για να επεκτείνουν τη μέθοδο σε πολλαπλά δεδομένα, τα Shapley Values προσαρμόστηκαν για να χειριστούν μικτές modalities, με τα βίντεο και κείμενο συστατικά να αντιμετωπίζονται διακριτά, και η επίδρασή τους στα αποτελέσματα του μοντέλου μετρήθηκε, αποκαλύπτοντας εάν το περιεχόμενο του βίντεο ερμηνευόταν πραγματικά ή εάν γραπτά στοιχεία χρησιμοποιούνταν ως συντόμευση.

Μέτρησεις

Δύο απλές μέτρησεις ορίστηκαν για να συγκρίνουν πόσο κάθε modality (δηλ. βίντεο, ερώτηση, ή απάντηση) συνεισέφερε στην απόφαση του μοντέλου: Συμμετοχή Modalities μετρά πόσο από την tổngική εξήγηση προέρχεται από κάθε τύπο εισαγωγής· εδώ, όλα τα διαθέσιμα Shapley values συναθροίζονται, και το μερίδιο που ανήκει σε κάθε modality υπολογίζεται ως ποσοστό της tổngικής.

Δεύτερον, Συμμετοχή Per-Feature διορθώνει το γεγονός ότι ορισμένες modalities, όπως το βίντεο, περιέχουν πολλά περισσότερα χαρακτηριστικά από άλλες. Αντίθετα, η μέση Shapley τιμή υπολογίζεται για κάθε χαρακτηριστικό, και αυτές οι μέσες τιμές συγκρίνονται για να καθορίσουν ποια modality έχει την κυρίαρχη επίδραση.

Δεδομένα και Δοκιμές

Οι συγγραφείς έtested την προσέγγιση σε έξι VLM με διάφορες ιδιότητες που σχεδιάστηκαν για να διασφαλίσουν ότι οι δοκιμές θα ήταν ευρέως εφαρμόσιμες και γενικεύσιμες. Επομένως, τα μοντέλα επιλέχθηκαν για διαφορετικά μήκη контекστ, διαφορετικά γηράσματα (δηλ. πόσο καιρό από τη δημοσίευση του πλαισίου), και διαφορετικές αρχιτεκτονικές διαμορφώσεις.

Οι διαγωνιζόμενοι ήταν FrozenBiLM· InternVideo· VideoLLaMA2· VideoLLaMA3· LLaVa-Video (που αξιοποιεί Qwen2)· και LongVA (που χρησιμοποιεί επίσης Qwen2).

Με τον ίδιο σκοπό της ποικιλίας, τα τέσσερα στόχοι δεδομένων που επιλέχθηκαν ήταν EgoSchema, ένα σύνολο δεδομένων VQA που σχεδιάστηκε να είναι αδύνατο να ολοκληρωθεί χωρίς πλήρη προβολή των συνδεδεμένων βίντεο· HD-EPIC, ένα σύνολο δεδομένων που επικεντρώνεται στην κουζίνα και που περιλαμβάνει κάποια ασυνήθιστα μακρά βίντεο· MVBench, μια επιμελημένη συλλογή συνεισφορών από άλλα σύνολα δεδομένων· και LVBench, που θέτει ερωτήσεις VQA για πολύ μακρά βίντεο.

Από αυτά, οι συγγραφείς ανέπτυξαν 60 ερωτήσεις – δέκα από κάθε τύπο ερώτησης.

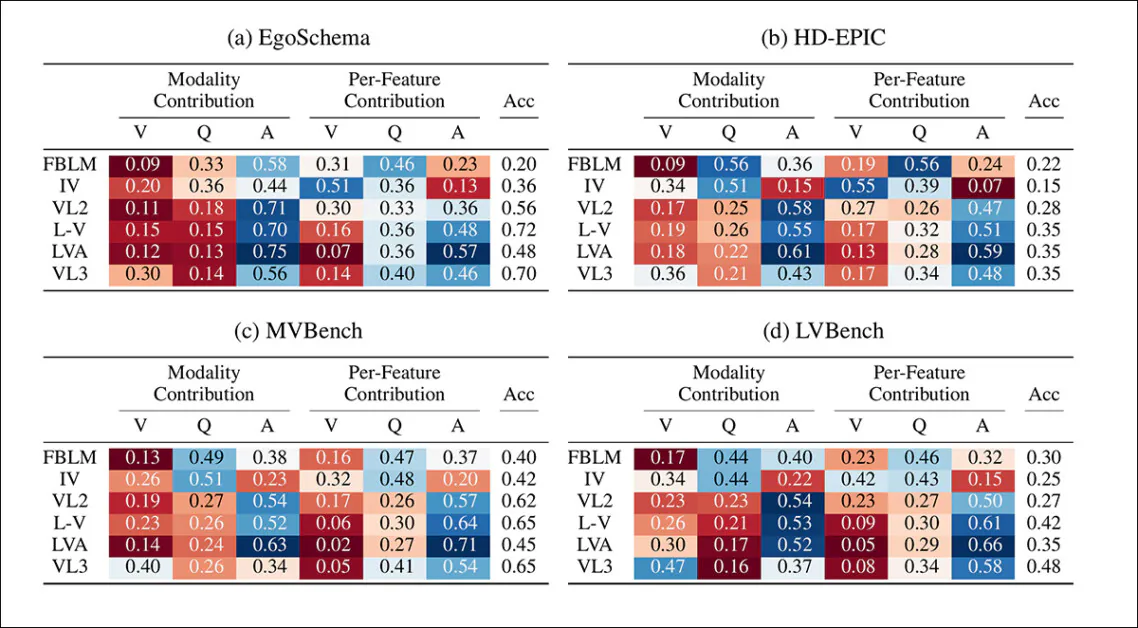

Οι μέτρησεις συμμετοχής έδειξαν ότι τα περισσότερα μοντέλα βασίζονταν λιγότερο στο βίντεο παρά στο κείμενο, ιδιαίτερα όταν κρίθηκαν καρέ προς καρέ. Ακόμη και όπου το βίντεο έδειξε μια λογική εμφάνιση στην tổngική συμμετοχή, η συμμετοχή του σε κάθε χαρακτηριστικό ήταν συχνά ελάχιστη, υποδεικνύοντας ότι ενώ το μοντέλο μπορεί να χρησιμοποιούσε το βίντεο συνολικά, δεν έδινε πολλή προσοχή σε отдельμένα καρέ. Το VideoLLaMA3 ήταν η κύρια εξαίρεση εδώ, με μια μεγαλύτερη οπτική εξάρτηση, ιδιαίτερα στις μακρύτερες ακολουθίες στο LVBench:

Μέτρησεις Συμμετοχής Modalities (MC) και Per-Feature Contribution (PFC) scores σε μοντέλα και σύνολα δεδομένων, δείχνοντας τη σχετική βαρύτητα των εισαγωγών βίντεο (V), ερώτησης (Q), και απάντησης (A). Ψυχρότερες αποχρώσεις δείχνουν ισχυρότερες συμμετοχές· θερμότερες αποχρώσεις δείχνουν ασθενέστερες ή αμελητέες επιρροές. Σε hầu hết τις ρυθμίσεις, η γλώσσα είναι σαφώς κυρίαρχη, με το βίντεο να παραμελείται συχνά – ιδιαίτερα σε επιρροή καρέ προς καρέ.

Όσο για το κείμενο, η ερώτηση είχε τη μεγαλύτερη σημασία από την απάντηση, ιδιαίτερα στα ισχυρότερα μοντέλα. Αυτό ήταν πιο εμφανές σε σύνολα δεδομένων όπως το EgoSchema, όπου οι ερωτήσεις ήταν μακρύτερες και πιο φυσικές, ενώ οι απαντήσεις ήταν σύντομες και μερικές φορές σχηματικές. Το MVBench ανέστρεψε αυτό多少, поскольку η δυαδική δομή απάντησης φούσκα την φαινομενική σημασία των token απάντησης.

Σε όλα τα μοντέλα και τα σύνολα δεδομένων, η όραση ήταν συνεχώς παραμελημένη, με τη γλώσσα να κάνει την περισσότερη δουλειά.

Η εργασία αναφέρει:

‘[Για] μοντέλα με μακρύ контекστ, το βίντεο δείχνει δραματικά μειωμένες συμμετοχές, που σημαίνει ότι τα Shapley values των отдельικών καρέ είναι πολύ μικρότερα από τους αντίστοιχους τους σε κείμενο.

‘Το βίντεο ως μια ολόκληρη modality είναι ακόμη/highly σχετικό, αλλά αυτό είναι απόδειξη ότι τα Shapley values των отдельικών καρέ είναι πιο κεντρισμένα γύρω από το μηδέν, και ότι η προσοχή του μοντέλου σε αυτά είναι πολύ λιγότερο καθοδηγούμενη από το κείμενο.’

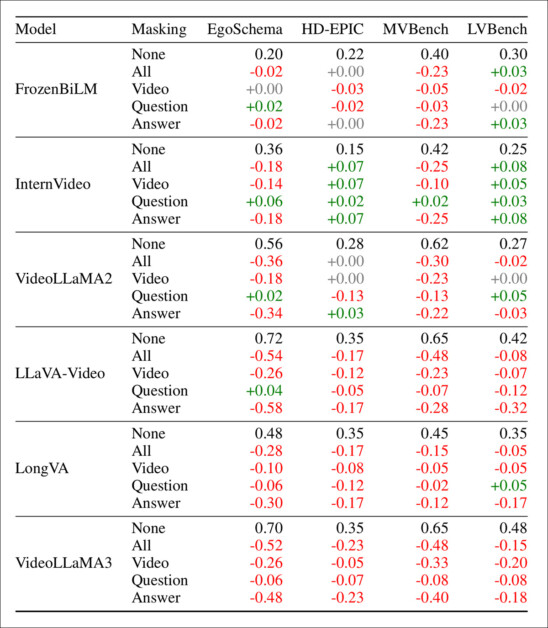

Για να δοκιμάσουμε πόσο κάθε μέρος της εισαγωγής συνεισφέρει στην ακρίβεια του μοντέλου, οι ερευνητές διεξήγαγαν επιπλέον δοκιμές χρησιμοποιώντας masking – σκόπιμα κρύβοντας ένα ή περισσότερα μέρη της εισαγωγής, και βλέποντας πόσο αλλάζει η ακρίβεια του μοντέλου ως αποτέλεσμα.

Εάν η απόδοση πέφτει απότομα όταν μια συγκεκριμένη εισαγωγή αφαιρεθεί, αυτό το μέρος είναι πιθανό να είναι σημαντικό· εάν το μοντέλο εκτελείται περίπου το ίδιο, υποδηλώνει ότι το λείπων μέρος δεν ήταν πολύ εξαρτημένο. Σε αυτόν τον τρόπο, οι δοκιμές masking είναι ένα είδος επαναλαμβανόμενης μελέτης αφαίρεσης.

Επίδραση απόδοσης από masking εισαγωγών βίντεο, ερώτησης, ή απάντησης σε τέσσερα VQA σύνολα δεδομένων. Οι βαθμοί δείχνουν αλλαγή από την αμασκέ baseline. Κόκκινο σημαίνει χαμηλότερη ακρίβεια, πράσινο σημαίνει υψηλότερη. Τα μοντέλα συχνά διατήρησαν υψηλούς βαθμούς χωρίς βίντεο, αλλά έχαναν περισσότερο όταν η (κειμένου) απάντηση αφαιρέθηκε. Η ερώτηση μπορούσε συνήθως να mask με ελάχιστη επίδραση.

Τα αποτελέσματα (οπτικοποιημένα παραπάνω) δείχνουν ότι οι απαντήσεις (κειμένου απαντήσεις στο multiple choice δεδομένων) φέρουν το μεγαλύτερο βάρος σε όλα. Masking την απάντηση συνήθως προκαλούσε τη μεγαλύτερη πτώση στην ακρίβεια, συχνά μειώνοντας τα μοντέλα σε近-τυχαία απόδοση.

Ωστόσο, masking την ερώτηση είχε συνήθως πολύ λιγότερη επίδραση, που υποστηρίζει την προηγούμενη εύρεση ότι τα μοντέλα συχνά υποτιμούν την ερώτηση.

Σε ορισμένες περιπτώσεις, η ακρίβεια ακόμη και βελτιώθηκε όταν η ερώτηση αφαιρέθηκε, που υποδηλώνει ότι τα μοντέλα μερικές φορές απλώς ταιριάζουν απαντήσεις σε οπτικά ή κειμένου ερεθίσματα παρά να αξιολογούν σωστά την ερώτηση.

Τα μοντέλα επίσης ποίκιλλαν στην εξάρτησή τους από το βίντεο: ορισμένα διατήρησαν μια λογική ακρίβεια χωρίς αυτό, επιβεβαιώνοντας περαιτέρω την περιορισμένη συμμετοχή των χαρακτηριστικών βίντεο σε πολλές τρέχουσες διαμορφώσεις.

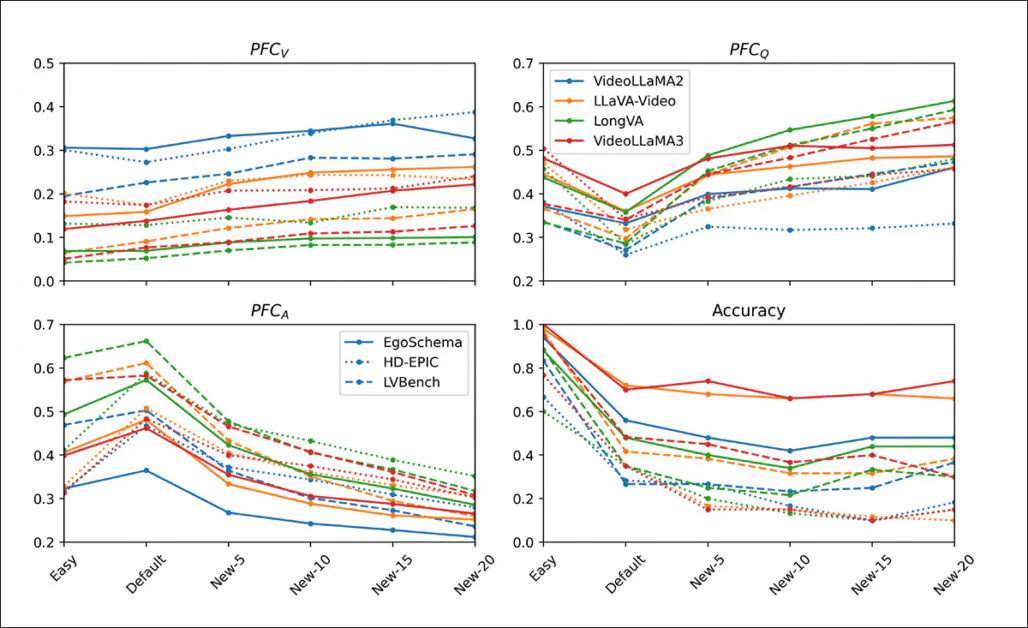

Οι συγγραφείς στη συνέχεια δοκιμάσαν αν τα μοντέλα θα μπορούσαν να αναγκαστούν να βασιστούν στο βίντεο με την προσθήκη επιπλέον λανθασμένων απαντήσεων στις επιλογές multiple choice.

Όταν οι distractors ήταν εύκολοι και ανακυκλώθηκαν από άλλες ερωτήσεις, η απόδοση βελτιώθηκε, καθώς τα μοντέλα ταιριάζουν κειμένου πρότυπα χωρίς πολλή συλλογιστική. Αλλά με δέκα ή περισσότερες μη σχετικές απαντήσεις, άρχισαν να βασίζονται περισσότερο στο βίντεο και την ερώτηση:

Συμμετοχή Per-Feature και ακρίβεια για εισαγωγές βίντεο, ερώτησης, και απάντησης, καθώς προστίθενται επιπλέον λανθασμένες απαντήσεις σε κάθε VQA δοκιμή, δείχνοντας ότι η αύξηση του αριθμού distractors μειώνει την κυριαρχία κειμένου και αυξάνει τη σχετική επιρροή των οπτικών και ερωτηματικών χαρακτηριστικών.

Για το VideoLLaMA3, masking το βίντεο μειώνει την ακρίβεια κατά 40% στο EgoSchema και 15% στο LVBench, δείχνοντας ότι μια απλή αύξηση του αριθμού απάντησης μπορεί να μεταφέρει τα μοντέλα μακριά από κειμένου συντόμευση και προς την πραγματική πολλαπλή συλλογιστική.

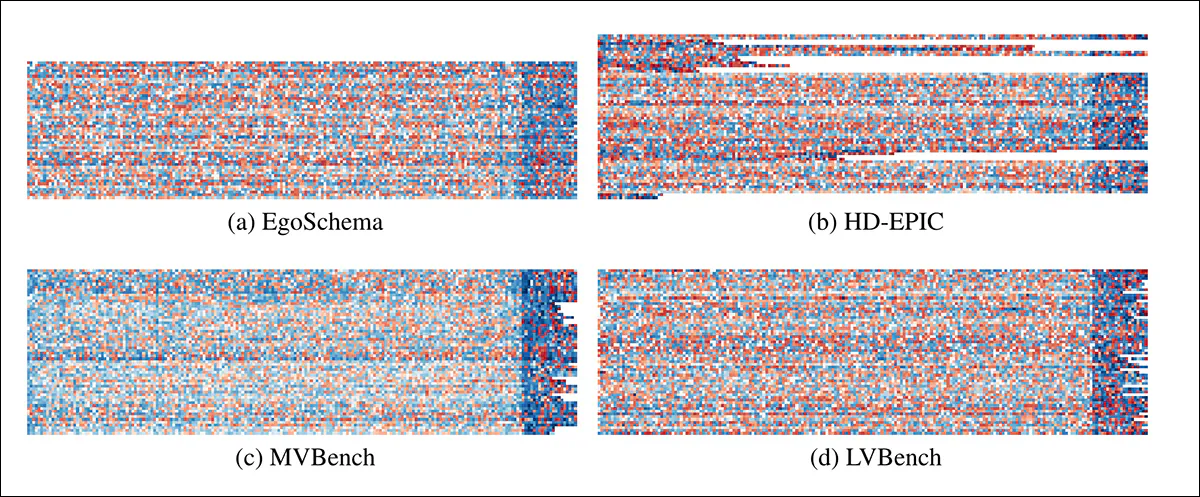

Οι ερευνητές επίσης εξέτασαν πώς η απόδοση είναι κατανεμημένη σε εισαγωγές, και παρακάτω βλέπουμε θερμικές χάρτες Shapley values για κάθε μοντέλο εισαγωγής:

Θερμικοί χάρτες Shapley values για τέσσερα σύνολα δεδομένων, όπου κάθε σειρά δείχνει ένα VQA-τρίο, και κάθε στήλη ένα μόνο χαρακτηριστικό. Χαρακτηριστικά βίντεο εμφανίζονται στα αριστερά, ακολουθούμενα από κείμενο. Οι πολύ ισχυρότερες τιμές στις (κόκκινες) περιοχές κειμένου επιβεβαιώνουν ότι τα μοντέλα βασίζονται πολύ περισσότερο στη γλώσσα παρά στο βίντεο.

Σχολιάζοντας τα αποτελέσματα παραπάνω, οι συγγραφείς αναφέρουν:

‘Η μεγέθυνση των Shapley values είναι πολύ μεγαλύτερη προς τη δεξιά πλευρά κάθε θερμικού χάρτη, που αντιπροσωπεύει τις ερωτήσεις και τις απαντήσεις. Αυτή η σαφής γραμμή είναι όπου τα καρέ βίντεο τελειώνουν και τα χαρακτηριστικά κειμένου αρχίζουν, δείχνοντας ότι η συμμετοχή modality του βίντεο είναι πολύ λιγότερη από την ερώτηση/απάντηση. ‘

Συνοψίζοντας, σε όλα τα σύνολα δεδομένων, οι τιμές είναι πολύ ισχυρότερες προς την πλευρά κειμένου του φάσματος, υποδεικνύοντας ότι τα μοντέλα βασίζονται πολύ περισσότερο στη γλώσσα παρά σε οπτικά σημάδια. Ακόμη και όπου το βίντεο χρησιμοποιείται, η συμμετοχή είναι διασκορπισμένη σε πολλά καρέ, συχνά χωρίς σταθερό πρότυπο.

Παρακάτω βλέπουμε ένα σχολιασμένο παράδειγμα από το EgoSchema. Τα 16 πιο “σημαντικά” καρέ επιλέχθηκαν χρησιμοποιώντας Shapley values και χρωματίστηκαν σύμφωνα με την επίδρασή τους, με μπλε να δείχνει θετική συνεισφορά και κόκκινο να δείχνει αρνητική:

Αποδόσεις Shapley για ένα μόνο παράδειγμα EgoSchema, δείχνοντας τα 16 πιο επιρροήσιμα καρέ και όλα τα κείμενα εισαγωγής. Οι συμμετοχές βίντεο είναι ελάχιστες σε σύγκριση με το κείμενο, που κυριαρχεί στη συλλογιστική του μοντέλου. Μπλε και κόκκινο δείχνουν θετική και αρνητική επίδραση στην επιλεγμένη απάντηση.

Το αποτέλεσμα είναι ότι σχεδόν κάθε καρέ έχει μόνο ασθενή επίδραση σε σύγκριση με τα λόγια στην ερώτηση και τις απαντήσεις. Οπτικά σημάδια είναι σπάνια και ασυνεπή, ενώ ονόματα όπως ‘καρέκλα’ και ‘περίφραξη’ οδηγούν το μοντέλο προς την σωστή επιλογή – ή μακριά από αυτή, ανάλογα με το контекστ.

Συμπέρασμα

Όποιος έχει ασχοληθεί με επεξεργασία βίντεο ή ανάλυση βίντεο θα γνωρίζει ήδη πόσο πόρων-εντατική είναι αυτές οι διαδικασίες, και θα καταλάβει γιατί οι εταιρείες που αναλύουν εκατομμύρια αιτήματα AI την ημέρα δεν μπορούν να επιτρέψουν να τρέχουν ad hoc επεξεργασία και ερμηνεία βίντεο από τους χρήστες.

Ένα πράγμα να θυμάστε σε αυτόν τον ohled είναι ότι σχεδόν κάθε API διεπαφής AI που θα δοκιμάσετε (με την πιθανή εξαίρεση ενός καινούριου και βραχύβιου demo για την υποστήριξη νέων επιστημονικών ερευνών) προσπαθεί να εκπληρώσει τις επιθυμίες των χρηστών στο ελάχιστο επίπεδο δαπάνης πόρων.

Αυτό σημαίνει να βασίζονται σε υπάρχοντα μεταδεδομένα από δεδομένα χρηστών ή RAG ανακτήσεις, αν είναι δυνατόν· και να εξάγουν (αν είναι απολύτως απαραίτητο) μεταδεδομένα για πιο αναγνώσιμες μορφές όπως PDF, έγγραφα και μεμονωμένες εικόνες.

Τι δεν είναι στο τραπέζι είναι το να τρέξετε το ανεβασμένο βίντεο σας μέσω CLIP ή της τελευταίας YOLO έκδοσης, ή μέσω οποιουδήποτε πόρων-εντατικού και χρονοβόρου VLM που μπορεί πραγματικά να αναγνωρίσει τι υπάρχει στα καρέ και να κατανοήσει τι συμβαίνει στο προσφερόμενο βίντεο, με την αξιολόγηση της χρονικότητας.

Ωστόσο, αυτό δεν σημαίνει ότι τα φαινόμενα που η τρέχουσα εργασία τεκμηριώνει απαραίτητα προέρχονται από οικονόμικες αρχιτεκτονικές προσεγγίσεις. Οι συγγραφείς παρατηρούν ότι το κείμενο κυριαρχεί στα state-of-the-art πολυμορφικά μοντέλα εκπαίδευσης σε κάθε περίπτωση, υποδεικνύοντας ότι ‘οπτική γλώσσα’ είναι είτε λιγότερο ανεπτυγμένη, λιγότερο σημαντική ή ενημερωτική σε ένα πολυμορφικό контекστ, είτε (τουλάχιστον για τώρα) λιγότερο καλά κατανοητή,

* Ενδιαφέρον είναι ότι το υλικό που το NotebookLM ήρθε με φαίνεται να είναι είτε εντελώς πρωτότυπο ή εντελώς μη ευρετήσιμο από το Google, καθώς δεν μπορώ να βρω κανένα αποτέλεσμα που θα μπορούσε να έχει μπει στο σύνολο δεδομένων εκπαίδευσης και να προκάλεσε αυτή την έξοδο.

Πρώτη δημοσίευση Παρασκευή, 31 Οκτωβρίου 2025· επεξεργασία 14:20 για μορφοποίηση