Τεχνητή νοημοσύνη

EAGLE: Εξερεύνηση του Χώρου Σχεδίασης για Πολυμορφικά Μεγάλης Κλίμακας Μοντέλα Γλώσσας με Μίξη Κωδικοποιητών

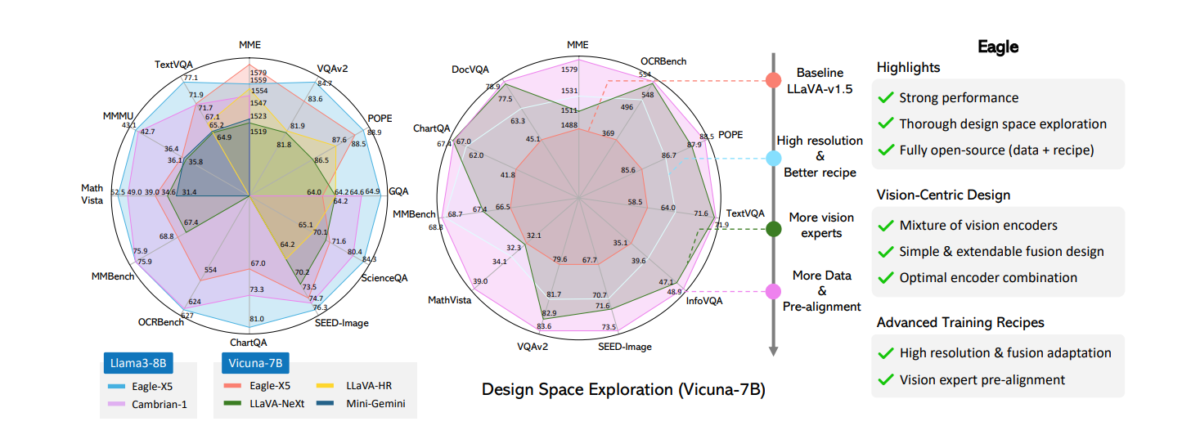

Η ικανότητα να ερμηνεύει ακριβώς σύνθετες οπτικές πληροφορίες είναι ένα κρίσιμο σημείο των πολυμορφικών μεγάλων μοντέλων γλώσσας (MLLMs). Πρόσφατη εργασία δείχνει ότι η ενισχυμένη οπτική αντίληψη μειώνει σημαντικά τις ψευδαισθήσεις και βελτιώνει την απόδοση σε εργασίες που είναι ευαίσθητες στην ανάλυση, όπως η οπτική αναγνώριση χαρακτήρων και η ανάλυση εγγράφων. Πολλά πρόσφατα MLLMs επιτύγχαναν αυτό χρησιμοποιώντας μια μίξη κωδικοποιητών όρασης. Παρά την επιτυχία τους, υπάρχει έλλειψη συστηματικών συγκρίσεων και λεπτομερών μελετών που αντιμετωπίζουν κρίσιμα ζητήματα, όπως η επιλογή εμπειρογνωμόνων και η ενσωμάτωση πολλαπλών εμπειρογνωμόνων όρασης. Αυτό το άρθρο παρέχει μια εκτεταμένη εξέταση του χώρου σχεδίασης για MLLMs χρησιμοποιώντας μια μίξη κωδικοποιητών όρασης και ανάλυσης, το πλαίσιο Eagle που προσπαθεί να εξερευνήσει τον χώρο σχεδίασης για πολυμορφικά μεγάλα μοντέλα γλώσσας με μίξη κωδικοποιητών. Τα ευρήματα αποκαλύπτουν beberapa υποκείμενες αρχές που είναι κοινές σε διάφορες υφιστάμενες στρατηγικές, οδηγώντας σε μια ροή και αποτελεσματική προσέγγιση σχεδίασης. Το Eagle ανακαλύπτει ότι η απλή συνένωση οπτικών συμβόλων από ένα σύνολο συμπληρωματικών κωδικοποιητών όρασης είναι τόσο αποτελεσματική όσο και πιο σύνθετες αρχιτεκτονικές μίξης ή στρατηγικές. Επιπλέον, το Eagle εισάγει την Προ-Συν 맞αξη για να γεφυρώσει το χάσμα μεταξύ κωδικοποιητών όρασης και συμβόλων γλώσσας, ενισχύοντας την συνάφεια του μοντέλου. Η αποτελούμενη οικογένεια MLLMs, Eagle, υπερβαίνει άλλα leading ανοιχτά μοντέλα σε σημαντικές βάσεις δεδομένων MLLM.

Η εργασία του Eagle σχετίζεται με το γενικό σχέδιο αρχιτεκτονικής των πολυμορφικών μεγάλων μοντέλων γλώσσας (MLLMs). Πέρα από τη γραμμή των αντιπροσωπευτικών ανοιχτών ερευνών που αναφέρθηκαν νωρίτερα, άλλες αξιοσημείωτες οικογένειες MLLMs περιλαμβάνουν, αλλά δεν περιορίζονται σε, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini, και Llama 3.1. Ανавис από το πώς οι σήματα όρασης ενσωματώνονται στο μοντέλο γλώσσας, τα MLLMs μπορούν να κατηγοριοποιηθούν ευρέως σε “δια-μορφικές προσοχές” μοντέλα και “πρόθεμα-προσαρμογή” μοντέλα. Τα πρώτα εγχέουν οπτικές πληροφορίες σε διάφορα στρώματα LLMs χρησιμοποιώντας δια-μορφικές προσοχές, ενώ τα δεύτερα αντιμετωπίζουν τα οπτικά σύμβολα ως μέρος της ακολουθίας συμβόλων γλώσσας και τους προσαρτάζουν απευθείας με ενσωματώσεις κειμένου. Το μοντέλο του Eagle ανήκει στην οικογένεια prefix-tuning ακολουθώντας μια αρχιτεκτονική πολυμορφικής LLaVA. Λαμβάνοντας υπόψη ότι το MLLM είναι ένα γρήγορα εξελισσόμενο πεδίο, το Eagle συνιστά να αναφέρεται σε πιο λεπτομερείς μελέτες και επισκοπήσεις για περαιτέρω ενημέρωση.

Η εργασία του Eagle είναι στενά συνδεδεμένη με την έρευνα που επικεντρώνεται στην βελτίωση του σχεδιασμού κωδικοποιητών όρασης για MLLMs. Πρώιμες εργασίες συνήθως υιοθετούσαν κωδικοποιητές όρασης που προ-εκπαιδεύτηκαν σε εργασίες ευθυγράμμισης όρασης-γλώσσας όπως CLIP και EVA-CLIP. Ισχυρότεροι κωδικοποιητές όρασης, όπως SigLIP και InternVL, έχουν προταθεί για να ενισχύσουν τις εργασίες όρασης-γλώσσας με καλύτερες σχεδιασμούς, μεγαλύτερες μεγέθη μοντέλων και πιο αποτελεσματικές συνταγές εκπαίδευσης.既然 τα μοντέλα συχνά προ-εκπαιδεύονται σε χαμηλής ανάλυσης εικόνες και μπορεί να λείπουν της ικανότητας να κωδικοποιούν λεπτομερείς λεπτομέρειες, η προσαρμογή υψηλής ανάλυσης πραγματοποιείται συχνά για να αυξήσει την ανάλυση εισόδου του MLLM. Πέρα από την προσαρμογή υψηλής ανάλυσης, μοντέλα όπως LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer, και InternVL χρησιμοποιούν τσιμεντόβρωμα ή προσαρμοστικό τσιμεντόβρωμα για να χειριστούν υψηλής ανάλυσης είσοδο, όπου οι εικόνες διαιρούνται σε χαμηλής ανάλυσης τσιμεντόβρωμα και επεξεργάζονται ξεχωριστά. Ενώ η ικανότητα να χειρίζεται υψηλότερη ανάλυση είναι δυνατή με την εισαγωγή πρόσθετων εμπειρογνωμόνων όρασης, αυτή η προσέγγιση διαφέρει ελαφρώς από τις τεχνικές τσιμεντοβρώματος, αν και και οι δύο είναι συμβατές και μπορούν να συνδυαστούν.

EAGLE: Χρήση Μίξης Κωδικοποιητών για Εξέταση του Χώρου Σχεδίασης για Πολυμορφικά MLLMs

Η επιτυχία των μεγάλων μοντέλων γλώσσας (LLMs) έχει προκαλέσει σημαντικό ενδιαφέρον για την ενεργοποίηση των ικανοτήτων οπτικής αντίληψης, επιτρέποντάς τους να βλέπουν, να κατανοούν και να συλλογίζονται στον πραγματικό κόσμο. Στο κέντρο αυτών των πολυμορφικών μεγάλων μοντέλων γλώσσας (MLLMs) είναι ένα τυπικό σχέδιο όπου οι εικόνες μετατρέπονται σε μια σειρά οπτικών συμβόλων από τους κωδικοποιητές όρασης και προσαρτώνται με τις ενσωματώσεις κειμένου. Το CLIP συχνά επιλέγεται ως κωδικοποιητής όρασης επειδή η οπτική του αναπαράσταση είναι ευθυγραμμισμένη με τον χώρο κειμένου με προ-εκπαίδευση σε ζευγάρια εικόνας-κειμένου. Ανавис από τις αρχιτεκτονικές, τις συνταγές εκπαίδευσης και τον τρόπο με τον οποίο τα οπτικά σύμβολα εγχέονται στο μοντέλο γλώσσας, αξιοσημείωτες οικογένειες MLLMs περιλαμβάνουν Flamingo, BLIP, PaLI, PaLM-E, και LLaVA. Τα περισσότερα από αυτά τα μοντέλα διατηρούν σχετικά χαμηλές αναλύσεις εισόδου λόγω των περιορισμών των προ-εκπαιδευμένων κωδικοποιητών όρασης και του μήκους ακολουθίας LLM. Η εργασία του Eagle είναι στενά συνδεδεμένη με μοντέλα που χρησιμοποιούν πολλαπλούς κωδικοποιητές όρασης για βελτιωμένη αντίληψη.

Για παράδειγμα, μοντέλα όπως Mousi και Brave συνδυάζουν οπτικά σύμβολα από διαφορετικούς κωδικοποιητές όρασης με συνένωση κατά μήκος του καναλιού ή της κατεύθυνσης συμβόλων. Το RADIO εισάγει μια μέθοδο πολυ-δασκάλου αποσταγμάτωσης για να ενοποιήσει τις ικανότητες διαφορετικών κωδικοποιητών όρασης σε ένα μοντέλο. MoAI, IVE, και Prismer χρησιμοποιούνさらに την έξοδο των εμπειρογνωμόνων όρασης, όπως OCR, ανίχνευση, ή εκτίμηση βάθους, για να συμπληρώσουν πρόσθετες πληροφορίες για τα MLLMs για να παράγουν απαντήσεις. Το MoVA σχεδιάζει ένα δίκτυο διανομής για να ανατεθεί ένα βέλτιστο μοντέλο όρασης με βάση την δεδομένη εικόνα και τις οδηγίες.

Πρόσφατες μελέτες έχουν δείξει ότι ισχυρότεροι σχεδιασμοί κωδικοποιητών όρασης είναι σημαντικοί για τη μείωση των ψευδαισθήσεων MLLM και τη βελτίωση της απόδοσης σε εργασίες που είναι ευαίσθητες στην ανάλυση, όπως η οπτική αναγνώριση χαρακτήρων. Πολλές εργασίες επικεντρώνονται στην ενίσχυση της ικανότητας του κωδικοποιητή όρασης, είτε με την αύξηση των δεδομένων προ-εκπαίδευσης και των παραμέτρων είτε με τη διαίρεση των εικόνων σε χαμηλής ανάλυσης τσιμεντόβρωμα. Ωστόσο, αυτές οι προσεγγίσεις συχνά εισάγουν μεγάλες απαιτήσεις πόρων εκπαίδευσης. Μια αποτελεσματική και ισχυρή στρατηγική είναι η μίξη οπτικών κωδικοποιητών που προ-εκπαιδεύτηκαν με διαφορετικές εργασίες και αναλύσεις εισόδου, είτε με τη συνένωση υψηλής ανάλυσης κωδικοποιητών με τον κωδικοποιητή CLIP, είτε με την ακολουθιακή προσάρτηση χαρακτηριστικών από διαφορετικούς κωδικοποιητές, είτε με την υιοθέτηση πιο σύνθετων στρατηγικών μίξης και διανομής για να μεγιστοποιήσει τα οφέλη των διαφορετικών κωδικοποιητών. Αυτή η “μίξη-εκπαιδευτών-όρασης” στρατηγική έχει αποδειχθεί αποτελεσματική, αν και μια λεπτομερής μελέτη του χώρου σχεδίασής της με αυστηρές απομονώσεις είναι ακόμη έλλειψη, мотивόντας το Eagle να επανεξετάσει αυτήν την περιοχή. Κρίσιμα ερωτήματα παραμένουν: ποιοι συνδυασμοί κωδικοποιητών όρασης να επιλεγούν, πώς να συνδυαστούν διαφορετικοί εμπειρογνώμονες, και πώς να điều chỉnhουν οι στρατηγικές εκπαίδευσης με περισσότερους κωδικοποιητές όρασης.

Για να απαντήσει σε αυτά τα ερωτήματα, το Eagle διεξάγει μια συστηματική διερεύνηση του χώρου σχεδίασης μίξης κωδικοποιητών όρασης για βελτιωμένη αντίληψη MLLM. Η εξέταση αυτού του χώρου σχεδίασης περιλαμβάνει τα ακόλουθα βήματα: 1) αξιολόγηση διαφορετικών κωδικοποιητών όρασης και αναζήτηση υψηλής ανάλυσης προσαρμογής; 2) διεξαγωγή μιας “μύλων με μύλων” σύγκρισης μεταξύ στρατηγικών συνένωσης κωδικοποιητών όρασης; 3) σταδιακή ταυτοποίηση του βέλτιστου συνδυασμού πολλαπλών κωδικοποιητών όρασης; 4) βελτίωση της προ-συν-συν 맞αξης και της μίξης δεδομένων. Τα βήματα εξέτασης εικονογραφούνται στην ακόλουθη εικόνα.

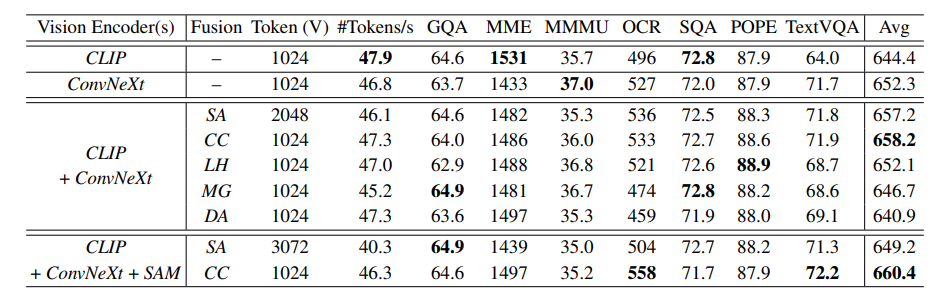

Η μελέτη του Eagle καλύπτει την απόδοση των κωδικοποιητών όρασης που προ-εκπαιδεύτηκαν σε διαφορετικές εργασίες και αναλύσεις, όπως η ευθυγράμμιση όρασης-γλώσσας, η αυτο-επιτηρούμενη μάθηση, η ανίχνευση, η τμηματοποίηση, και η οπτική αναγνώριση χαρακτήρων. Χρησιμοποιώντας μια προσέγγιση γύρου, το Eagle αρχίζει με τον βασικό κωδικοποιητή CLIP και προσθέτει έναν επιπλέον εμπειρογνώμονα κάθε φορά, επιλέγοντας τον εμπειρογνώμονα που παρέχει την καλύτερη βελτίωση σε κάθε γύρο.

Ενώ η εργασία του Eagle δεν είναι η πρώτη που να χρησιμοποιεί πολλαπλούς κωδικοποιητές όρασης σε MLLMs, η συστηματική μελέτη οδηγεί σε beberapa κρίσιμα ευρήματα υπό αυτήν τη ρύθμιση:

- Αποκλείοντας τους κωδικοποιητές όρασης κατά την εκπαίδευση του MLLM έχει σημασία. Αυτό είναι σε αντίθεση με μοντέλα όπως LLaVA και άλλα που λαμβάνουν υπόψη πολλαπλούς κωδικοποιητές όρασης ή δασκάλους, όπου η κατάψυξη των κωδικοποιητών όρασης έχει sido κοινή πρακτική.

- Ορισμένες πρόσφατα προταθείσες στρατηγικές μίξης δεν δείχνουν σημαντικά πλεονεκτήματα. Αντίθετα, η απλή συνένωση καναλιού εμφανίζεται ως μια απλή και ανταγωνιστική στρατηγική μίξης, προσφέροντας την καλύτερη αποτελεσματικότητα και απόδοση.

- Η ενσωμάτωση πρόσθετων εμπειρογνωμόνων όρασης οδηγεί σε συνεπείς κέρδη. Αυτό καθιστά μια υποσχόμενη οδό για την συστηματική βελτίωση της αντίληψης MLLM, πέρα από την αύξηση των単ικών κωδικοποιητών. Η βελτίωση είναι ιδιαίτερα εμφανής όταν οι κωδικοποιητές όρασης είναι ανοικτοί.

- Η προ-συν-συν 맞αξη είναι κρίσιμη. Το Eagle εισάγει μια προ-συν-συν σταδιο όπου οι μη-κείμενο-συνδεδεμένοι εμπειρογνώμονες όρασης είναι ατομικά επι-εκπαιδευμένοι με einen παγωμένο LLM πριν από την εκπαίδευση μαζί. Αυτό το στάδιο ενισχύει σημαντικά την απόδοση MLLM υπό το σχέδιο μίξης κωδικοποιητών όρασης.

Eagle: Μεθοδολογία και Αρχιτεκτονική

Αντιθέτως με προηγούμενες μεθόδους που επικεντρώνονται σε νέες στρατηγικές μίξης ή αρχιτεκτονικές μεταξύ κωδικοποιητών όρασης, ο στόχος του Eagle είναι να ταυτοποιήσει μια ελάχιστα σχεδιασμένη προσέγγιση για τη μίξη διαφορετικών κωδικοποιητών όρασης, υποστηριζόμενη από λεπτομερείς απομονώσεις και την αφαίρεση οποιασδήποτε περιττής συνιστώσας. Όπως φαίνεται στην ακόλουθη εικόνα, το Eagle αρχίζει με την επέκταση του βασικού κωδικοποιητή CLIP σε ένα σύνολο εμπειρογνωμόνων όρασης με διαφορετικές αρχιτεκτονικές, εργασίες προ-εκπαίδευσης και αναλύσεις. Με αυτούς τους εμπειρογνώμονες, το Eagle στη συνέχεια συγκρίνει διαφορετικές αρχιτεκτονικές μίξης και μεθόδους και εξετάζει πώς να βελτιστοποιήσει τις στρατηγικές προ-εκπαίδευσης με πολλαπλούς κωδικοποιητές.

Τέλος, το Eagle συνδυάζει όλα τα ευρήματα και επεκτείνει την προσέγγιση σε πολλαπλούς εμπειρογνώμονες όρασης με διαφορετικές αναλύσεις και γνώσεις τομέα. Χρησιμοποιώντας τα ίδια δεδομένα προ-εκπαίδευσης όπως το LLaVA-1.5, το οποίο αποτελείται από 595k ζευγάρια εικόνας-κειμένου, το Eagle μεταβαίνει στο στάδιο της επιτηρούμενης εκπαίδευσης συλλογώντας δεδομένα από μια σειρά εργασιών και μετατρέποντάς τα σε πολυμορφικές συνομιλίες, συμπεριλαμβανομένων LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA, και AI2D, με αποτέλεσμα 934k δείγματα.

Το μοντέλο είναι πρώτα προ-εκπαιδευμένο με ζευγάρια εικόνας-κειμένου για ένα επεισόδιο με μέγεθος δείγματος 256, όπου ολόκληρο το μοντέλο είναι παγωμένο, και μόνο το στρώμα projector ενημερώνεται. Στο δεύτερο στάδιο, το μοντέλο είναι επιτηρούμενα εκπαιδευμένο στα δεδομένα επιτηρούμενης εκπαίδευσης για ένα επεισόδιο με μέγεθος δείγματος 128. Για αυτήν την εξέταση, το Eagle χρησιμοποιεί Vicuna-7B ως το υποκείμενο μοντέλο γλώσσας. Οι ταχύτητες μάθησης ορίζονται σε 1e-3 για το πρώτο στάδιο και 2e-5 για το δεύτερο στάδιο.

Ισχυρότερος Κωδικοποιητής CLIP

Το Eagle αρχίζει την εξέταση με το μοντέλο CLIP, καθώς έχει γίνει η πρωταρχική επιλογή για πολλά MLLMs. Ενώ τα μοντέλα CLIP είναι γνωστά για την ενίσχυση των πολυμορφικών εργασιών, οι περιορισμοί τους έχουν επίσης τεκμηριωθεί. Για παράδειγμα, πολλά υφιστάμενα MLLMs τείνουν να χρησιμοποιούν τις προ-εκπαιδευμένες αναλύσεις CLIP (όπως 224 × 224 ή 336 × 336) ως αναλύσεις εισόδου. Σε αυτές τις περιπτώσεις, οι κωδικοποιητές όρασης συχνά αγωνίζονται να πιάσουν λεπτομερείς λεπτομέρειες που είναι σημαντικές για εργασίες που είναι ευαίσθητες στην ανάλυση, όπως η οπτική αναγνώριση χαρακτήρων και η ανάλυση εγγράφων.

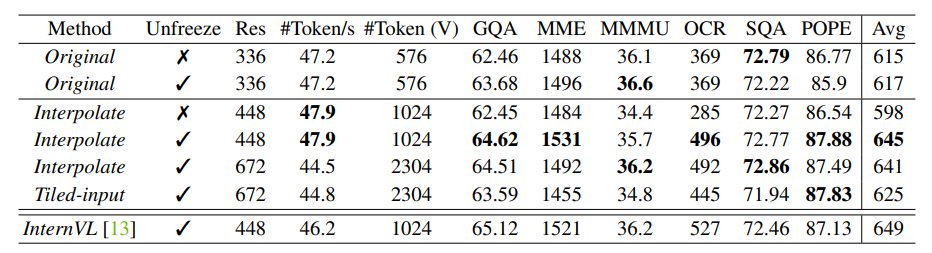

Για να χειριστεί την αύξηση της ανάλυσης εισόδου, μια κοινή προσέγγιση είναι το τσιμεντόβρωμα, όπου οι είσοδοι εικόνων διαιρούνται σε τσιμεντόβρωμα και κωδικοποιούνται ξεχωριστά. Μια απλούστερη μέθοδος είναι να αυξήσει απευθείας την ανάλυση εισόδου και να διαμορφώσει τις ενσωματώσεις θέσης του μοντέλου μεταφόρτωσης όρασης αν χρειάζεται. Το Eagle συγκρίνει αυτές τις δύο προσεγγίσεις με παγωμένους και ανοικτούς κωδικοποιητές όρασης σε διαφορετικές αναλύσεις, με τα αποτελέσματα που περιέχονται στον παραπάνω πίνακα. Τα ευρήματα μπορούν να συνοψισθούν ως εξής:

- Η απελευθέρωση του κωδικοποιητή CLIP οδηγεί σε σημαντική βελτίωση όταν διαμορφώνεται σε υψηλότερη ανάλυση εισόδου MLLM που διαφέρει από την προ-εκπαιδευμένη ανάλυση CLIP, χωρίς υποβάθμιση της απόδοσης όταν οι αναλύσεις παραμένουν οι ίδιες.

- Η κατάψυξη του κωδικοποιητή CLIP και η άμεση προσαρμογή του σε υψηλότερη ανάλυση εισόδου MLLM βλάπτει σημαντικά την απόδοση.

- Μεταξύ των στρατηγικών που συγκρίθηκαν, η άμεση διαμόρφωση σε 448 × 448 με ανοικτό κωδικοποιητή CLIP αποδεικνύεται τόσο αποτελεσματική όσο και οικονομική όσον αφορά την απόδοση και το κόστος.

- Ο καλύτερος κωδικοποιητής CLIP επιτυγχάνει απόδοση κοντά στο InternVL, παρά το ότι είναι ένα πολύ μικρότερο μοντέλο (300M έναντι 6B) με λιγότερα δεδομένα προ-εκπαίδευσης.

Είναι σημαντικό να σημειωθεί ότι το CLIP-448 επιτρέπει στο Eagle να ταιριάζει με τη ρύθμιση με το LLaVA-HR και το InternVL, όπου οι κωδικοποιητές CLIP προσαρμόζονται επίσης για να λάβουν είσοδο 448 × 448 και να εξοδεύσουν 1024 σύμβολα patch. Για περαιτέρω διερεύνηση, το Eagle ακολουθεί αυτήν την απλή στρατηγική της αύξησης της ανάλυσης εισόδου και της απελευθέρωσης του κωδικοποιητή όρασης κατά την εκπαίδευση.

Το Eagle παρατηρεί ότι οι υφιστάμενες δημοφιλείς στρατηγικές μίξης, παρά τις διαφορές τους στο σχεδιασμό, μπορούν να κατηγοριοποιηθούν ως εξής:

- Σειριακή Προσάρτηση: Άμεση προσάρτηση των οπτικών συμβόλων από διαφορετικά σκελετούς ως μια μεγαλύτερη ακολουθία.

- Συνένωση Καναλιού: Συνένωση των οπτικών συμβόλων κατά μήκος της διάστασης καναλιού χωρίς αύξηση του μήκους ακολουθίας.

- LLaVA-HR: Εισαγωγή υψηλής ανάλυσης χαρακτηριστικών σε χαμηλής ανάλυσης κωδικοποιητές όρασης χρησιμοποιώντας einen προσαρμογέα μίξης ανάλυσης.

- Mini-Gemini: Χρήση των συμβόλων CLIP ως χαμηλής ανάλυσης ερωτημάτων για να δια-προσέξουν έναν υψηλής ανάλυσης κωδικοποιητή όρασης σε συν-τοπικές τοπικές παράθυρα.

- Δεформική Προσοχή: Μια νέα βάση που εισάγεται πάνω στο Mini-Gemini, όπου η κλασική προσοχή παραθύρου αντικαθίσταται με δεформική προσοχή.

Αντί να εκπαιδεύει έναν projector για να ευθυγραμμίσει ταυτόχρονα πολλαπλούς εμπειρογνώμονες όρασης όπως στην αρχική στρατηγική προ-εκπαίδευσης του LLaVA, το Eagle πρώτα ευθυγραμμίζει την αναπαράσταση κάθε ατομικού εμπειρογνώμονα με ένα μικρότερο μοντέλο γλώσσας (Vicuna-7B στην πράξη) χρησιμοποιώντας την εποπτεία προ-επόμενου συμβόλου. Όπως φαίνεται στην ακόλουθη εικόνα, με προ-συν-συν 맞αξη, ολόκληρη η διαδικασία εκπαίδευσης αποτελείται από τρία βήματα: 1) εκπαίδευση κάθε προ-εκπαιδευμένου εμπειρογνώμονα όρασης με τον δικό του projector σε δεδομένα SFT, ενώ保持 το μοντέλο γλώσσας παγωμένο; 2) συνδυάζοντας όλους τους εμπειρογνώμονες όρασης από το πρώτο βήμα και εκπαίδευση μόνο του projector με δεδομένα ζευγαρωμένων εικόνας-κειμένου; 3) εκπαίδευση του ολόκληρου μοντέλου στα δεδομένα SFT.

Eagle: Πειράματα και Αποτελέσματα

Μετά από μια προσεκτική ανάπτυξη των στρατηγικών του, το Eagle έχει καθορίσει τα ακόλουθα принципια για το μοντέλο: (1) ενσωμάτωση περισσότερων εμπειρογνωμόνων όρασης με μια βελτιωμένη στρατηγική εκπαίδευσης; (2) συνδυασμός πολλαπλών εμπειρογνωμόνων όρασης μέσω άμεσης συνένωσης καναλιού; (3) προ-εκπαίδευση των εμπειρογνωμόνων όρασης ξεχωριστά μέσω προ-συν-συν 맞αξης. Σε αυτήν την ενότητα, για να δείξει περαιτέρω τα πλεονεκτήματα των μοντέλων Eagle, προστίθενται πρόσθετα δεδομένα εκπαίδευσης και το Eagle συγκρίνεται με τα τρέχοντα state-of-the-art MLLMs σε διάφορες εργασίες. Το Eagle χρησιμοποιεί Vicuna-v1.5-7B, Llama3-8B, και Vicuna-v1.5-13B ως τα μοντέλα γλώσσας. Για τους κωδικοποιητές όρασης, με βάση τα αποτελέσματα στο Τμήμα 2.6, τα μοντέλα Eagle ονομάζονται Eagle-X4, τα οποία περιλαμβάνουν τέσσερις κωδικοποιητές όρασης: CLIP, ConvNeXt, Pix2Struct, και EVA-02, και Eagle-X5, τα οποία περιλαμβάνουν έναν επιπλέον κωδικοποιητή SAM.

Εργασίες Οπτικής Ερωτήσεως και Απάντησης

Το Eagle συγκρίνει την σειρά μοντέλων σε τρεις βάσεις δεδομένων Ερωτήσεων και Απαντήσεων (VQA), συμπεριλαμβανομένων GQA, VQAv2, και VizWiz. Όπως φαίνεται στον ακόλουθο πίνακα, το Eagle-X5 επιτυγχάνει state-of-the-art απόδοση στο GQA και VQAv2, υπογραμμίζοντας τα πλεονεκτήματα της ενσωμάτωσης πρόσθετων εμπειρογνωμόνων όρασης.

Εργασίες OCR και Κατανόησης Διαγραμμάτων

Για να αξιολογήσει τις ικανότητες OCR, εγγράφου και κατανόησης διαγραμμάτων του Eagle, το μοντέλο αξιολογείται σε OCRBench, TextVQA, και ChartQA. Όπως φαίνεται στον παραπάνω πίνακα, το Eagle υπερβαίνει σημαντικά τους ανταγωνιστές στο TextVQA, ωφελούμενο από την υψηλής ανάλυσης αρχιτεκτονική του και την ενσωμάτωση διαφορετικών κωδικοποιητών όρασης. Ιδιαίτερα, το Eagle διατηρεί μια απλή σχεδίαση, υποστηρίζοντας μέχρι 1024 σύμβολα χωρίς να απαιτεί σύνθετη διαίρεση εικόνων σε τσιμεντόβρωμα.

Η ακόλουθη εικόνα παρουσιάζει παραδείγματα εργασιών OCR και κατανόησης εγγράφου. Με την υψηλής ανάλυσης προσαρμογή και την ενσωμάτωση περισσότερων εμπειρογνωμόνων όρασης, το Eagle μπορεί να αναγνωρίσει μικρό κείμενο μέσα στις εικόνες και να εξάγει ακριβώς πληροφορίες με βάση τις οδηγίες του χρήστη.

Για να κατανοήσει καλύτερα τα οφέλη της εισαγωγής εμπειρογνωμόνων που προ-εκπαιδεύτηκαν σε άλλες εργασίες όρασης, η ακόλουθη εικόνα οπτικοποιεί αποτελέσματα από ένα μοντέλο με μόνο τους κωδικοποιητές ConvNeXt και CLIP, σε σύγκριση με τα αποτελέσματα του Eagle-X5. Με το πλήρες σύνολο κωδικοποιητών όρασης, το μοντέλο επιτυγχάνει να διορθώσει λάθη, δείχνοντας ότι ακόμη και όταν εξοπλισμένο με υψηλής ανάλυσης κωδικοποιητές όρασης προ-εκπαιδευμένους σε ευθυγράμμιση όρασης-γλώσσας, οι ικανότητες του Eagle ενισχύονται από την ενσωμάτωση πρόσθετων εμπειρογνωμόνων όρασης προ-εκπαιδευμένων σε διάφορες εργασίες όρασης.

Αξιολόγηση σε Πολυμορφικές Βάσεις Δεδομένων

Το Eagle αξιολογείται σε επτά βάσεις δεδομένων για MLLMs για να δείξει τις ικανότητές του από διαφορετικές οπτικές, συμπεριλαμβανομένων MME, MMBench, SEED, MathVista, MMMU, ScienceQA, και POPE. Συγκεκριμένα, MME, MMBench, και SEED αξιολογούν την συνολική απόδοση σε διάφορες πραγματικές εργασίες που εμπλέκουν συλλογισμό, αναγνώριση, γνώση, και OCR. MMMU επικεντρώνεται σε απαιτητικά προβλήματα από διάφορους τομείς που απαιτούν γνώσεις πανεπιστημιακού επιπέδου. POPE αξιολογεί τις οπτικές ψευδαισθήσεις των MLLMs. Τα μετρικά που χρησιμοποιούνται σε αυτήν την αξιολόγηση ακολουθούν τις προεπιλογές των βάσεων δεδομένων. Το Eagle αναφέρει το σκορ αντίληψης για MME, το en_dev split για MMBench, το image split του SEED, το test-mini split του MathVista, το val split του MMMU, το F1-score του POPE, και το σκορ εικόνας για ScienceQA, εξασφαλίζοντας ευθυγράμμιση με τα αναφερόμενα σκορ από άλλα μοντέλα.

Τελικές Σκέψεις

Σε αυτό το άρθρο, έχουμε συζητήσει το Eagle, μια ενδελεχή ανάλυση του χώρου σχεδίασης για την ενσωμάτωση κωδικοποιητών όρασης σε πολυμορφικά μεγάλα μοντέλα γλώσσας. Αντίθετα με προηγούμενες εργασίες που επικεντρώνονται στον σχεδιασμό νέων παραδειγμάτων μίξης, το Eagle βρίσκει ότι οι συστηματικές επιλογές σχεδίασης έχουν σημασία και ανακαλύπτει μια σειρά από χρήσιμες τεχνικές. Βήμα προς βήμα, το Eagle βελτιστοποιεί τη στρατηγική εκπαίδευσης των ατομικών κωδικοποιητών όρασης, ταυτοποιεί μια επεκτάσιμη και αποτελεσματική μέθοδο μίξης, και σταδιακά συνδυάζει κωδικοποιητές όρασης με διαφορετικές γνώσεις τομέα. Τα αποτελέσματα υπογραμμίζουν την κρίσιμη σημασία των βασικών επιλογών σχεδίασης του χώρου.