Künstliche Intelligenz

Synthese von menschlichen Bildern aus reflektierten Radiowellen

Forscher aus China haben eine Methode entwickelt, um nahezu photorealistische Bilder von Menschen ohne Kameras zu synthesieren, indem sie Radiowellen und Generative Adversarial Networks (GANs) verwenden. Das System, das sie entwickelt haben, wird auf realen Bildern trainiert, die bei gutem Licht aufgenommen wurden, kann aber relativ authentische “Schnappschüsse” von Menschen auch bei dunklen Bedingungen und sogar durch größere Hindernisse aufnehmen, die Menschen vor herkömmlichen Kameras verbergen würden.

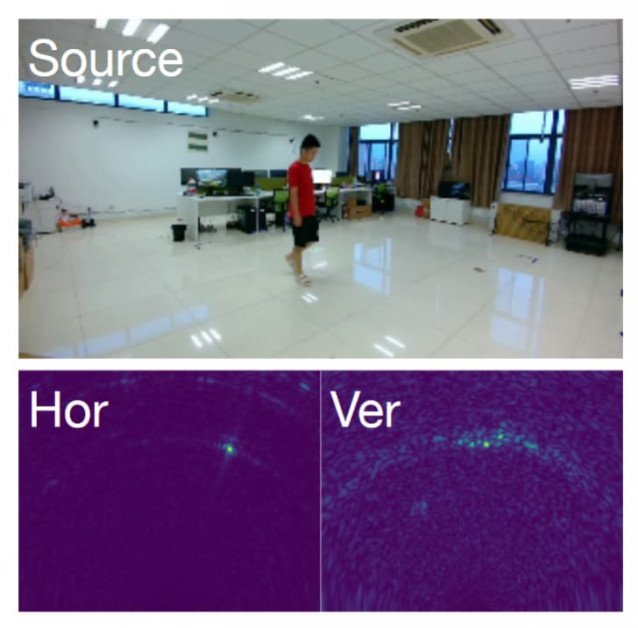

Die Bilder basieren auf “Heatmaps” von zwei Radiosendern, einem, der Daten von der Decke nach unten aufnimmt, und einem anderen, der Radiowellen-Störungen von einer “stehenden” Position aufzeichnet.

Die resultierenden Fotos aus den Proof-of-Concept-Experimenten der Forscher haben ein gesichtsloses, “J-Horror”-Aussehen:

RFGAN wird auf Bildern von realen Menschen in kontrollierten Umgebungen und auf Radiowellen-Heatmaps trainiert, die menschliche Aktivität aufzeichnen. Nachdem es Merkmale aus den Daten gelernt hat, kann RFGAN dann basierend auf neuen RF-Daten Schnappschüsse generieren. Das resultierende Bild ist eine Approximation, basierend auf dem begrenzten Auflösungsvermögen der verfügbaren niedrigen Frequenz-RF-Signale. Dieser Prozess funktioniert sogar in dunklen Umgebungen und durch eine Vielzahl von potenziellen Hindernissen. Quelle: https://arxiv.org/pdf/2112.03727.pdf

Um das GAN, genannt RFGAN, zu trainieren, verwendeten die Forscher übereinstimmende Daten von einer Standard-RGB-Kamera und von den entsprechenden, verketteten Radiowellen-Heatmaps, die im gleichen Moment der Aufnahme produziert wurden. Bilder von synthetisierten Menschen in dem neuen Projekt tendieren dazu, auf eine Weise verschwommen zu sein, die der frühen Daguerreotypie-Photographie ähnelt, da die Auflösung der verwendeten Radiowellen sehr niedrig ist, mit einer Tiefenauflösung von 7,5 cm und einer Winkelauflösung von etwa 1,3 Grad.

Oben, das Bild, das dem GAN-Netzwerk zugeführt wird – unten, die beiden Heatmaps, horizontal und vertikal, die die Person im Raum charakterisieren und die selbst innerhalb der Architektur in eine 3D-Darstellung der gestörten Daten synthetisiert werden.

Das neue Papier, betitelt RFGAN: RF-basierte menschliche Synthese, stammt von sechs Forschern der Universität für Elektronikwissenschaft und -technologie Chinas.

Daten und Architektur

Aufgrund des Fehlens von vorherigen Datensätzen oder Projekten, die diesen Umfang hatten, und der Tatsache, dass RF-Signale noch nie zuvor in einem GAN-Bildsynthese-Rahmen verwendet wurden, mussten die Forscher neue Methoden entwickeln.

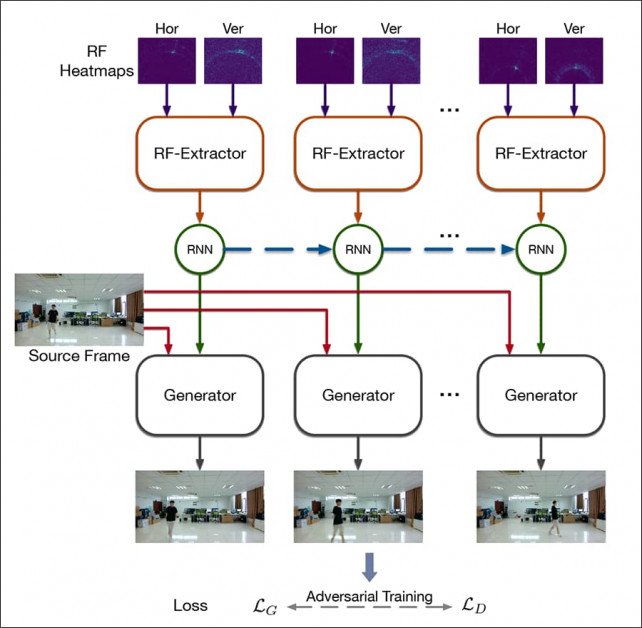

Die Kernarchitektur von RFGAN.

Adaptive Normalisierung wurde verwendet, um die Zwillings-Heatmap-Bilder während des Trainings zu interpretieren, so dass sie räumlich mit den aufgenommenen Bildaten übereinstimmen.

Die RF-Aufnahmegeräte waren Millimeterwellen-(mmWave)-Radar, die als zwei Antennen-Arrays, horizontale und vertikale, konfiguriert waren. Frequenzmodulierte kontinuierliche Wellen (FMCW) und lineare Antennen wurden für die Sendung und Empfang verwendet.

Der Generator erhält ein Quellbild als Eingabeschicht, wobei die RF-verbundene (Heatmap-)Darstellung das Netzwerk durch Normalisierung auf der Ebene der konvolutiven Schichten orchestriert.

Daten

Die Daten wurden von RF-Signal-Reflexionen von der mmWave-Antenne bei einer Rate von nur 20 Hz gesammelt, wobei gleichzeitig menschliche Videos bei einer sehr niedrigen Rate von 10 Bildern pro Sekunde aufgenommen wurden. Neun Innenräume wurden aufgenommen, wobei sechs Freiwillige jeweils unterschiedliche Kleidung für verschiedene Sitzungen der Datenerfassung trugen.

Das Ergebnis waren zwei unterschiedliche Datensätze, RF-Aktivität und RF-Gehen, wobei der erste 68.860 Bilder von Menschen in verschiedenen Positionen (wie Kniebeuge und Gehen) enthielt, zusammen mit 137.760 entsprechenden Heatmap-Rahmen; und der zweite 67.860 menschliche zufällige Gehrahmen enthielt, zusammen mit 135.720 Paaren von assoziierten Heatmaps.

Die Daten wurden, gemäß Konvention, ungleichmäßig zwischen Training und Testen aufgeteilt, wobei 55.225 Bildrahmen und 110.450 Heatmap-Paare für das Training verwendet wurden und der Rest für das Testen zurückgehalten wurde. RGB-Aufnahmeframe wurden auf 320×180 und Heatmaps auf 201×160 verkleinert.

Das Modell wurde dann mit Adam bei einer konstanten Lernrate von 0,0002 für sowohl den Generator als auch den Diskriminator trainiert, bei einer Epoche von 80 und einer (sehr spärlichen) Batch-Größe von 2. Das Training fand über PyTorch auf einem Consumer-Level-Sole-GTX-1080-GPU statt, dessen 8 GB VRAM normalerweise als sehr bescheiden für eine solche Aufgabe angesehen würden (was die niedrige Batch-Größe erklärt).

Obwohl die Forscher einige konventionelle Metriken für die Realismus-Tests der Ausgabe anpassten (im Papier ausführlich erläutert) und die üblichen Ablations-Tests durchführten, gab es keine gleichwertige Vorarbeit, gegen die die Leistung von RFGAN gemessen werden konnte.

Offenes Interesse an geheimen Signalen

RFGAN ist nicht das erste Projekt, das versucht, Radiofrequenzen zu verwenden, um ein volumetrisches Bild von dem zu erstellen, was in einem Raum passiert. 2019 entwickelten Forscher von MIT CSAIL eine Architektur namens RF-Avatar, die in der Lage war, 3D-Menschen basierend auf Radiofrequenz-Signalen im Wi-Fi-Bereich unter schweren Bedingungen von Okklusion zu rekonstruieren.

Im MIT-CSAIL-Projekt von 2019 wurden Radiowellen verwendet, um Okklusionen zu entfernen, einschließlich Wände und Kleidung, um aufgenommene Subjekte in einem traditionelleren CGI-basierten Workflow zu rekonstruieren. Quelle: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Die Forscher des neuen Papiers erkennen auch locker verwandte Vorarbeiten rund um die Umgebungsabbildung mit Radiowellen (keine davon versucht, photorealistische Menschen nachzubilden), die versuchten, menschliche Geschwindigkeit zu schätzen; siehe durch Wände mit Wi-Fi; menschliche Posen bewerten; und sogar menschliche Gesten erkennen, unter anderem.

Übertragbarkeit und breitere Anwendbarkeit

Die Forscher versuchten dann, zu sehen, ob ihre Entdeckung auf die anfängliche Aufnahmeeinrichtung und die Trainingsumstände überjustiert war, obwohl das Papier nur wenige Details über diese Phase des Experiments bietet. Sie behaupten:

‘Um unser Modell in einer neuen Szene zu deployen, müssen wir nicht das gesamte Modell von vorne trainieren. Wir können das vorgefertigte RFGAN mit sehr wenig Daten (etwa 40 Sekunden Daten) feinjustieren, um ähnliche Ergebnisse zu erzielen.’