Andersons vinkel

Brug af ‘Sandsynlighed’ som en Metode til Opdækning af Deepfakes

Hvis AI-genereret video og lyd bliver godt nok, vil deepfake-detektorer baseret på visuelle artefakter eller andre traditionelle signaler ikke virke længere. Men da mennesker sjældent afviger fra forudsigelige mønstre, kunne ‘sandsynlighed’ måske adopteres mere dybt som et signal for, om en video eller en nyhed er sandsynligvis sand eller ej.

Opinion I begyndelsen af 1990’erne afslørede den respekterede tidligere britiske fodboldspiller og TV-sportskommentator David Icke casuelt på en chatshow, at han var ‘Guds søn’ – en bizarre og uventet afsløring, der ville udvikle sig over de følgende årtier til en vedvarende og elaboreret konspirations-teori om en hemmelig og magtfuld global kabale af ‘øgle-mennesker’.

Med internettets adoption endnu flere år væk, og sociale mediers opkomst endnu længere ude i fremtiden, havde den store dissonans mellem Ickes berømmelse og naturen af hans nye indsigt en dybtgående effekt på den britiske offentlighed – ikke mindst på grund af den komplette mangel på kontekst eller nogen form for forberedelse på denne massive ændring fra en velkendt og etableret sportspersonlighed.

Mere end tyve år senere skete en lignende og langt mørkere form for denne sociale chok, da den elskede velgørenheds-aktivist og børne-tv-vært Jimmy Savile posthumt blev afsløret som en seriel og rapacious livslang sex-forbryder, der havde brugt sin velgørende offentlige image til at lette sine forbrydelser.

Den efterfølgende Operation Yewtree-politi-undersøgelse ville afsløre mange flere britiske celebriteter med lange historier af seksuelle overtrædelser; senere ville Harvey Weinsteins retssag føre til en lignende opdagelse af celebritets-sex-forbrydere i USA, hvilket udviklede sig til #metoo-bevægelsen og blev en permanent del af den amerikanske kultur i udgaver som The Morning Show. ‘Chok’-nyheder syntes at udvikle en ny og pludselig skabelon – en, der ville blive adopteret af deepfake-angribere.

Enden på ‘traditionel’ Deepfake-Detektion?

Selv hvis sociale medier og AI havde været til stede i begyndelsen af 1990’erne, kunne ingen forudsigelsessystem i verden have forudset Ickes chatshow-afsløringer, som (som jeg godt husker) ikke var nogenlunde forudsigelige i årene op til begivenheden.

Men hvis AI havde været til stede, kunne det have taget noget tid at overbevise et bredere publikum om, at Ickes udtalelser ikke var produktet af Google Veo 3 eller en anden af den nye generation af hyper-real audio/video deepfake-rammer.

Det er kun i de sidste 6-12 måneder, at AI-deepfake-metoder er blevet effektive nok til at opfylde år af medie-dødsdomme om deepfake-valgindgriben, og i stand til at generere den type hurtig-streg-reputationsskade, der er usand, men svær at udrydde i en stadig mere naiv kultur.

Indtil nu falder AI-video-udgang typisk kort af sandheden, begrænset af tekniske hindringer og stadig mere polariseret af en vækst i forskellen mellem restriktive vestlige modeller og Kinas uncensurerede open source-udgivelser**.

Alligevel bemærker jeg stadig mere i forskningslitteraturen en forestående overgivelse af denne kolde krig, for eksempel i den nye artikel Performance Decay in Deepfake Detection†:

‘[Vi] antager, at deepfake-videoer vil fortsat indeholde maskin-lærings-egenskaber, der pålideligt adskiller dem fra ægte videoer. Da generativ AI’s kapaciteter fortsat udvikler sig hurtigt, kan denne antagelse meget vel bryde sammen.

‘I en sådan situation vil vandmærkning og andre proveniens-sporingsmetoder være den eneste mulighed for at opretholde tillid til digitale medier.’

Men den samme artikel indrømmer, at proveniens-baserede løsninger som Content Authenticity Initiative (og de mange mindre forsknings tilbud i de sidste 7-8 år) kræver en sådan bred adoption, at det er urealistisk; og artiklen ender på en generel note om tilbagetrækning, hvis ikke nederlag.

Hvis audio-visuelle deepfake-detektionsmetoder udvikles af generativ AI, og global adoption af en indtrængende vandmærkning eller proveniens-skema falder over de diverse logistiske hindringer, hvad kunne så være en fælles central egenskab, der kunne erstatte dem som indikatorer for potentielt falsk output? Eller må vi resignere os til en verden, hvor alle medier er i tvivl, og Løgnerens Udbytte sejrer?

Viden Graf

Det synes at være tid til at udnytte sandsynlighed og sandsynlighed af ‘rapporterede begivenheder’ som et signal-karakteristikon i deepfake-detektion. Derudover, da video- og audio-generativ AI-systemer stadig mere konvergerer, kan det også være tid til, at de separate forskningsstrænger af ‘falske nyheder’ (som en tekst-baseret narrativ begivenhed) og falsk billed-/video tilsvarende konvergerer.

En sandsynlighed-deepfake-metode er ikke det samme som RAG-hjulpet faktaverifikation, hvor en AI-model kan hente nuværende web-resultater for at få kendskab til begivenheder, der sker efter dens egen afslutningsdato, og/eller for at bekræfte dens påstande.

I stedet ville det udføre forudsigelser baseret på generelt indicative statistiske tendenser, der er afledt fra historiske mønstre, der overensstemmer med en nuværende undersøgelse.

I denne forstand er en sandsynligheds-metode nærmere statistisk analyse end mere moderne tråde i den nuværende maskin-lærings-scene.

Selv om det tidligere var overgået af mere moderne Transformers-æra-tilgange, er viden-grafer ved at gøre en slags comeback i Enterprise-området, og synes at være tilpasset den potentielle udvikling af ‘sandsynlighed’-metrikker i deepfake-detektion.

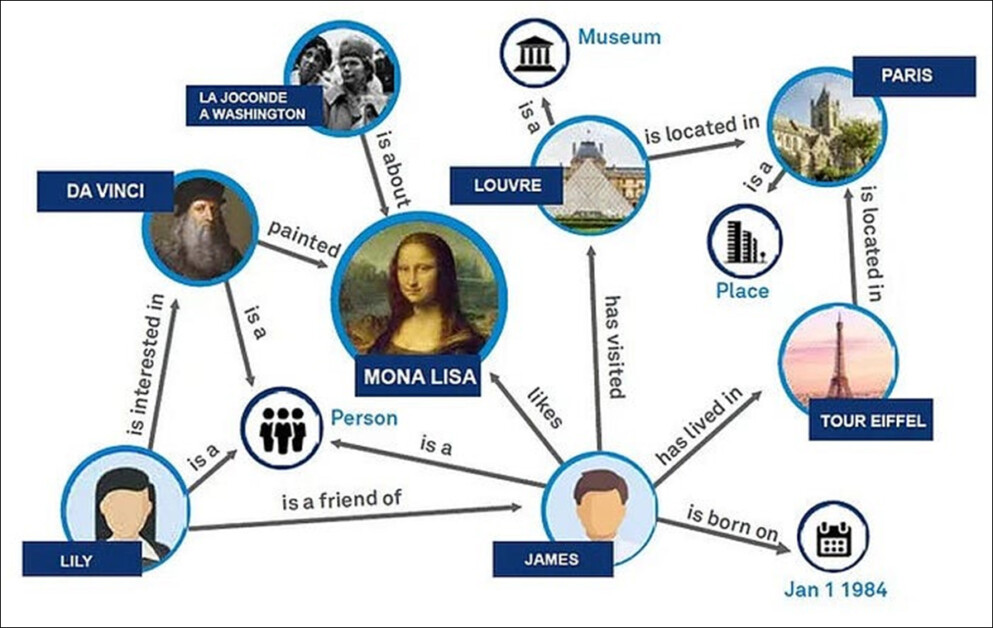

En forenklet viden-graf, der viser, hvordan mennesker, steder, kunstværker og begivenheder kan kobles sammen gennem mærkede relationer, og hvordan maskiner kan resonere over virkelige enheder og deres forbindelser. Kilde

En viden-graf er en måde at organisere information ved at kortlægge virkelige ting som mennesker, virksomheder, begivenheder eller ideer i et netværk af forbundne fakta.

Hver under-enhed er en node, og forbindelserne mellem dem (kanter) beskriver, hvordan de relaterer til hinanden. For eksempel kunne ‘Microsoft’ (en node) være forbundet til ‘OpenAI’ (en anden node) med en kant, der siger ‘er en kunde af’. Disse forbindelser er ofte gemt i graf-databaser og følger en subjekt-prædikat-objekt-struktur, som ‘Microsoft er en kunde af OpenAI’.

Varig Hukommelse

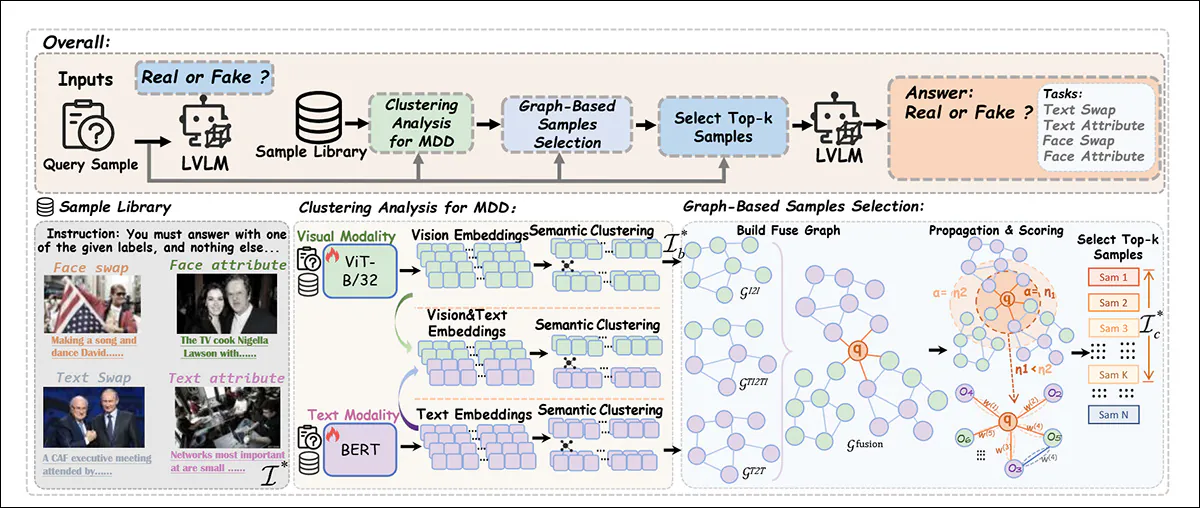

En kinesisk studie fra september i år foreslog en trænings-fri metode, der bruger graf-baseret resonnering til at opdage subtile inkonsistenser i multimodale deepfakes.

I stedet for at generere rationaler eller fine-tune store modeller, henter systemet billed-tekst-par, bygger en lignings-graf, og scorer forbindelser, for at hente de mest relevante eksempler, og disse vejleder modellens dom uden behov for ny træning:

En oversigt over GASP-ICL-rammen, der forbedrer deepfake-detektion ved at kombinere graf-baseret prøve-valg med kontekst-læring, og tillader en frosset vision-sprog-model at klassificere billed-tekst-par som ægte eller falske, uden træning eller fine-tuning. Kilde

Dette er sandsynligvis den nærmeste arbejde, i hvert fald det, der er kommet på min vej, til en ‘informeret’ og historie-bevidst tilgang til evaluering og verificering af nye medie-udgivelser. For det meste analyserer computer-vision-tilgange billeder (herunder billeder af videoer og temporale anomalier, der omfatter flere billeder) mens ‘falske nyheder’-detektions-rammer fortsat betoner tekst-baseret data, selv i multimodale projekter.

Funktionsskridt

Udfordringen ved et forudsigelsessystem af denne type er omfanget af overvågning, der måske er nødvendig for at gøre tilgangen fuldt udbyggelig – i hvert fald ud over analyse af celebriteter og offentlige figurer, for hvem frit tilgængelig data allerede findes.

Sandsynligvis er den mest lignende nuværende stræning i forskningen feltet forbrydelse, der mærker diverse multimodale intelligens-signaler som ‘mistænkelige’, og præsenterer sig som en stålsat AI-skræmmeskel i udgivelser som Jonathan Nolans Person of Interest (2011-2016), og Steven Spielbergs Minority Report (2002).

Selv om en Person of Interest-lignende alt-omfattende overvågningssystem ville producere optimale resultater, er det usandsynligt, at vestlig kultur i øjeblikket kunne sanktionere det niveau af personlig indtrængen, som Kinas interne netværk pålægger sine borgere.

Derfor, i forhold til potentielle falske nyheder om ikke-celebriteter, ville kun regerings-agenter som politiet (sammen med fødsels- og døds-registre og skattekontorer) have nok relevant historisk information til at informere sandsynligheder i en graf-baseret arbejdsproces; og selv de ville behøve CCCP-stil-vilje, kapacitet, lovgivning og ressourcer for at inkludere gennemsnits-borgere i deres dækning og analyser (dvs. ud over banale, men obligatoriske data-punkter som pas-numre og bil-registreringer).

Sandsynligheds-Scoring

Det synes sandsynligt, at den potentielle effektivitet af et system af denne type ville være begrænset til de mest åbenlyse (nuværende) brugs-sæt for deepfake-indhold: destabilisering (stats-bakket deepfakes); celebritet og ‘ukendt’ porn deepfakes (der begge kan betragtes som ondsindet, selv om den sidste sag tenderer til at tiltrække dybere medie-bevidsthed); svindel (herunder audio/video deepfakes designet til at udføre ‘impersonation-tyverier’); og politisk karakter-drab.

Et viden-baseret system ville kræve en skala af sandsynligheder for en diversitet af mulige begivenheder. I den ene ende af spektret, almindelige menneskelige svagheder som tvivlsom økonomisk ledelse, utroskab, afhængighed, uforsigtighed osv.; i den anden ende… afsløring af, at man er Guds søn på en live TV-chatshow (eller begivenheder af lignende skala og impact).

Selv i den sidste sag ville personlige historiske faktorer for en given person vægte sandsynligheds-udgangen: en fremtrædende politisk skikkelse, der offentligt havde svigtet i kontroversielle spørgsmål (såsom sandheden om 1960’ernes/70’ernes månelanding), for at opnå kapital hos en stadig mere ‘alternativt’-informeret valgkreds, kunne opnå ekstra wildcard-status i verificerings-rutiner, sammenlignet med deres mere stille peers.

I tilfælde af celebritet-porn, er der tilstrækkelig virkelig kontekst (dvs. 2012 celebritets-foto-læk, blandt andre – ret sjældne – begivenheder) til at generere en moderat Løgnerens Udbytte, i visse kontekster; men da disse outlier-begivenheder tenderer til at fungere som undtagelser, der beviser reglen, ville de fleste af den nuværende gruppe af diffusion-baserede celebritets-porn-videoer være betragtet som ekstremt ‘usandsynlige’ (selv om dette ikke løser problemet med tilknytning af folks identiteter til disse formål).

I forhold til national destabilisering, er der en betydelig mængde statistisk data, der kan hjælpe med at bedømme sandsynlighederne for ‘katastrofale’ rapporter. Selv i oldtiden syntes ‘ud af det blå’ begivenheder som udbruddet af den ukendte vulkan Vesuvius i 79 e.Kr. at være forudsigelige, hvis man havde været opmærksom; og ud over tilgængeligheden af en mængde regerings- og NGO-bakket feeds, kan AI’s udviklende evne til at extract structure from raw data give yderligere historisk kontekst for sandsynligheds-scoring.

Konklusion

Selv en vel-udført forudsigelsessystem af denne type kunne ikke tage højde for tilfældig chance, gerninger af Gud, freak-begivenheder eller for ondsindet konstruerede begivenheder, der er lavet uden for al oversigt.

Derudover ville den enorme mængde og dybde af data, der er nødvendig for at give dækning også for ikke-berømte mennesker, være et politisk hindringspunkt – i hvert fald for øjeblikket.

Alligevel synes valgmulighederne at være smallere; vision-baseret analyse er på vej til at fejle i mødet med forbedret generativ AI, mens verificerings- og proveniens-skemaer bærer en hindrende byrde af teknisk gæld, og gnidning mod adoption. Dette gør løsninger som Content Authenticity Initiative og det ufuldførte Metaphysic.ai ansigt-copyright-system Metaphysic Pro udfordrende at popularisere.

I deres bredeste brug kan RAG-baserede systemer kun bestemme, om en autoritets-kilde støtter op en uverificeret påstand; og da mange store (sandheds-) nyheder opstår uden forudgående kontekst, er manglen på dokumentation fra autoritets-kilder ikke nødvendigvis meningsfuld.

Deres værdi kan vise sig at være større, hvis de kan danne en del af et større data-økosystem, der beskæftiger sig med det, der er det mest udfordrende for de fleste nuværende former for AI – historisk kontekst.

* Ikke at forveksle med de tidlige autoencoder-udgivelser, der debuterede i 2017 og ville til sidst blive erstattet af overlegne tilgange.

† https://arxiv.org/abs/2511.07009

** Hvilke normalt kan køre frit på mere kraftfulde hjemme-PC’er, i stedet for kun at være tilgængelige via gate-kept API’er som ChatGPT og Veo-serien.

††† Udeladende legitime underholdnings-formål, såsom professionelle visuelle effekter i film- og tv-produktioner.

Først udgivet torsdag, 13. november 2025