Andersons vinkel

Streaming af AI-avatare som det var i 1999

Nyt forskning præsenterer en måde at streame livlige 3D-avatare, der viser sig næsten med det samme og skærpes i realtid, i stedet for at tvinge brugerne til at vente på, at massive downloads er færdige.

På mange måder har de enorme ressourcekrav til generativ AI og AI-assisterede renderingsystemer ført forbrugerklarhed tilbage mere end tyve år. Kun i 2023 syntes en 64GB RAM-allocation i en bærbar computer eller stationær PC at være overkill; nu, med den voksende popularitet af RAM og/eller CPU-offloading, er 64GB ret beskedent til lokale AI-behov; og disse engang banale og billige komponenter i computere fortsætter med at stige i pris, da virksomheder kæmper for at møde efterspørgslen efter AI-tjenester.

Størrelsen og grådigheden efter AI og dens processer og miljøer overdøver typisk forbruger-niveau-hardware, og selv kørsel af “slanke” lokale modeller som GGUF-versioner vil typisk belaste det gennemsnitlige system.

Selv tekstbaserede AI-tjenester som ChatGPT er underlagt betydelig belastning både på klient- og serverniveau. Derfor kan vi rimeligt forvente nogle meget alvorlige kompromiser i latency og/eller kvalitet – lignende internetts tidlige kamp med streaming-medie og de meget hadede animerede “buffering”-ikoner fra RealPlayer og QuickTime.

Sidste gang, at multimediaproblemer og netværksproblemer skabte friktion i brugeroplevelsen, var forbruger-niveau-hardware stadig under udvikling gennem Moore’s Law, og blev næsten eksponentielt bedre hvert år, selv om operativsystemer, netværk og andre understøttende infrastrukturer udviklede sig for at møde efterspørgslen; og i de sidste ti år eller deromkring har forbrugerteknologiens evner overgået multimediakraven (måske endda til det punkt, hvor omløb nødvendigvis skal startes for at vedligeholde salget).

Men denne overflod af lokale evner kan være ved at være slut snart, da lokal hardware bliver lavere-specifikationer og mere dyrt, og da AI-baserede tjenester kræver højere server-side- og lokale ressourcer.

At Få En Førerposition

Tilbage i den før-bredbåndsæra var webbrugere vant til, at billeder langsomt kom i fokus, da progressive JPEG’er tillod den båndbredde-sultne bruger at se det nedladede billede dannes, nogle gange meget langsomt, da mere af billeddata blev indlæst lokalt.

Nu synes det, at vi kan være på vej mod en lignende oplevelse med AI-baserede Gaussian Splat-avatare:

Klik for at afspille. Fra det nye ProgressiveAvatars-projekt, en sammenligning af streaming Gaussian-avatare. Til venstre, det ældre GaussianAvatars-projekt får langsomt nyt data, men ser forfærdeligt ud, mens data bygges op; til højre, den progressive Avatars-version bygger også detaljer langsomt, men gør det på en intelligent måde, der giver en grundlæggende menneske-lignende skikkelse lige fra starten. Kilde

Ovenfor ser vi to versioner af en Gaussian Splat-baseret (GSplat) Avatar – en menneske-repræsentation, der er muliggjort delvist af en ikke-AI-renderingsteknik, der stammer tilbage til begyndelsen af 1990’erne, og også af mere moderne metoder, såsom FLAME-parametrisk menneske-model, og AI-baserede trænings tilgange:

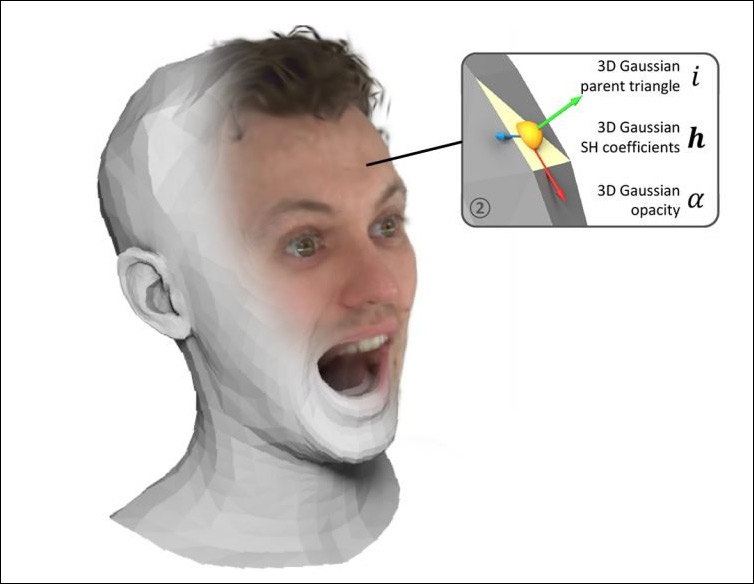

Gaussian Splatting bruger en Gaussian-repræsentation af farve og 3D-information i stedet for en pixel eller voxel, og mapper denne ultra-realisticke tekstur på en mere traditionel type CGI-mesh, som i sig selv er faciliteret af en ‘parametrisk menneske’, en CGI-ansigt og/eller krop, i systemer som FLAME og STAR. Kilde

Til venstre i videoen ovenfor kan vi se, at en traditionel implementering af en Gaussian Splat-avatar ser ret forfærdeligt ud, mens vi venter på, at data indlæses. Til højre, en ny implementering fra Kina, kaldet ProgressiveAvatars, kan løse op langt mere elegant, mens data indlæses, og præsenterer en ikke-alarmende menneske-billede lige fra starten.

Forfatterne hævder, at deres metode er den første, der rigtigt ‘streamer’ en Gaussian-avatar, og bestemt den første, der gør det på en progressiv måde, hvor billedet bygges op elegant, og de vigtigste områder – såsom øjne og læber – kan prioriteres, så avatarerne kan blive samtale-klare, selv når de kun er delvist indlæst:

Click to play. From the ProgressiveAvatars project site, an illustration of attention-aware loading.

Før dette, er en ‘level of detail’ (LOD)-tilgang blevet brugt i tidligere forsøg på at slimme ‘GSplat’-avatare, lignende video-spil-optimeringer, hvor successivt mere detaljerede versioner af en person indlæses afhængigt af, om de optager nok af viewport eller bruger-opmærksomhed til at være værd at anstrengelsen.

Selvfølgelig indebærer dette en betydelig mængde redundant ‘spare’-avatare, og forfatterne rammer deres tilgang som et mere rationelt system. Ved implication, tillader en metode af denne type også ændringer i en GSplat-figur (dvs. tilpasning) uden at skulle propagere sådanne ændringer gennem en kæde af forskellige LOD-‘tvillinger’.

En Fremkomment Domæne

Hvis dette synes som et niche-problem, så gjorde streaming-video også, tilbage i dage, hvor at få de tidligste plugins til at virke var uddelegeret til den nærmeste tilgængelige nerd. Yderligere, potentialet for AI-baserede streaming-repræsentationer går ud over menneske-avatare, og udvider sig til by-generering, spil og 3D-baserede* versioner af praktisk taget hvilket som helst online-domæne – såsom Virtual Try-On, til tøj-handel:

Click to play. From a 2024 project, a rough look at the future of online ‘try-on’. Other projects seek to add motion and interactivity – demanding facets to stream and manage. Kilde

Ligesom LOD-baserede tilgange har hidtil været hovedsageligt udnyttet af video-spil, er mange andre overvejelser, der tidligere kun var video-spiludviklingens ejendom, sandsynligvis på vej ind i splat-baserede repræsentationer. For eksempel, afbilder de fleste af disse tidlige GSplat-udgaver en enkel menneske gørende og mugende, eller måske talende; men mange situationer vil kræve multiple mennesker, samt miljømæssige funktioner og atmosfære – en scenario, hvor højtydende ‘triage’-systemer vil bestemme, hvor streaming-data skal prioriteres, for at holde brugeren i øjeblikket.

Den nye artikel er tituleret ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, og kommer fra tre forskere ved University of Science and Technology of China i Hefei.

Metode

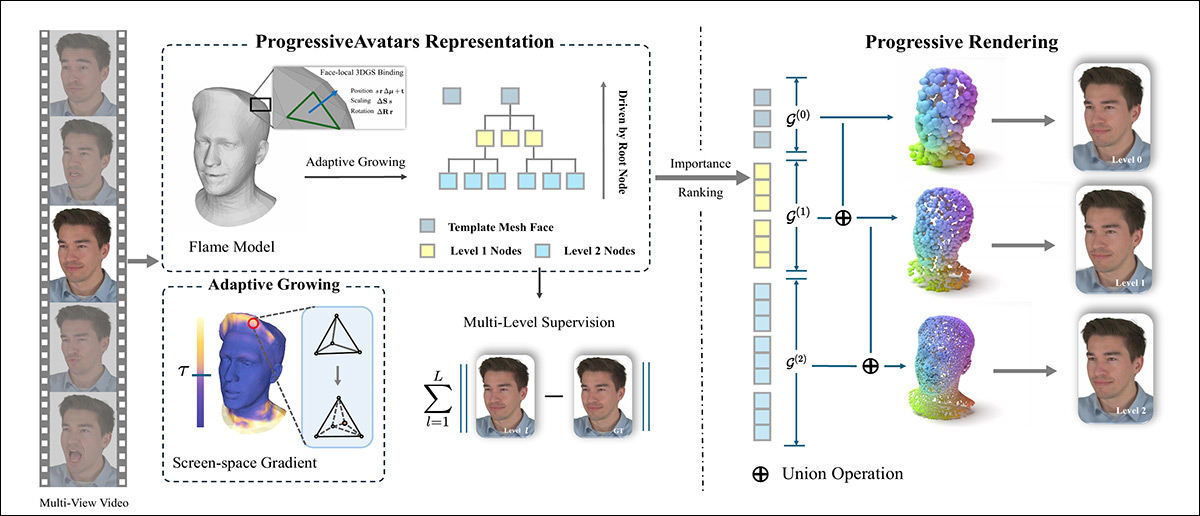

Tilgangen udnytter initialt video af en persons hoved. For hvert billede, passer en standard FLAME-parametrisk ansigtsmodel til, så formen og udtrykket ændrer sig over tid, mens den underliggende mesh-struktur forbliver fast. Fordi den grundlæggende topologi ikke ændrer sig, kan en stabil FLAME-skabelon genbruges og forbedres i stedet for at blive genopbygget fra scratch hver enkelt gang, som sker i lignende tidligere arbejder:

Hovedvideo er først passeret med en sporet FLAME-mesh, efterfulgt af, at 3D-Gaussianer er tilføjet til hvert ansigt og vokser hierarkisk, hvor skærm-rum-gradients indikerer manglende detalje. Under træning bygger denne adaptive underinddeling en multi-niveau-repræsentation under multi-view-overvågning, og ved slutning, bestemmer per-ansigt-værdier, hvilke Gaussianer der strømmes først, og tillader avatarerne at dukke op hurtigt og forbedre sig progressivt, efterhånden som højere-detaljer-niveauer tilføjes.

Over denne grundlæggende struktur tilføjes detaljer i lag; overfladen er implicit underinddelt i en hierarki, og små tre-dimensionale Gaussianer er tilføjet til ansigterne på hvert detalje-niveau.

Selv om de første, grovere lag fanger den samlede hovedform og bevægelse, giver de efterfølgende finere lag rynker, subtile deformationer og højfrekvent tekstur. Billeder renderes herefter fra disse Gaussianer ved hjælp af en differentierbar Gaussian-rasterizer og trænes mod multi-view-ground-truth-optagelser, så avatarerne lærer at genskabe den rigtige persons udseende.

Under træning vokser denne hierarki automatisk: områder, der har brug for mere detalje, underinddeles yderligere, guidede af skærm-rum-signaler, så computermæssig indsats koncentrerer sig, hvor brugerens øje er mest sandsynligt at bemærke fejl.

Under slutning tillader denne samme hierarki progressiv streaming, hvor en grov version af en avatar kan vises først, og efterhånden som yderligere lag indlæses, kan nye Gaussianer tilføjes uden at ændre, hvad der allerede vises, og muliggør en animabel hoved-avatar, der viser sig hurtigt, og bliver skarpere og mere detaljeret, efterhånden som mere data ankommer.

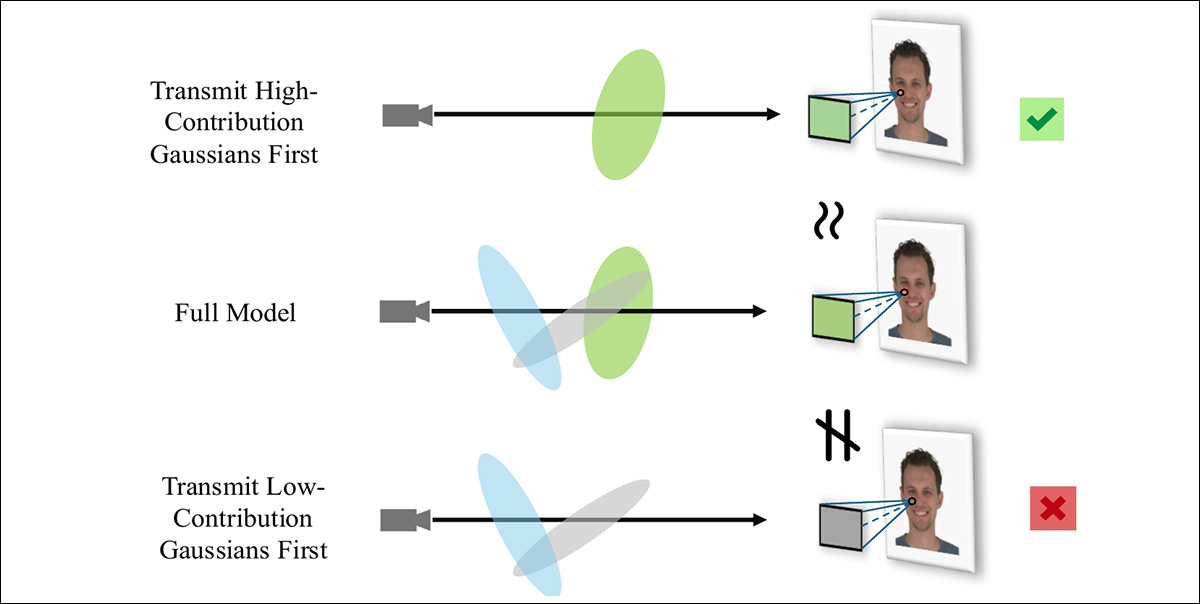

Forfatterne observerer, at hele systemet hænger afhængigt af prioriteringen af indkommende data:

Når alle Gaussianer på et givet niveau er tilgængelige, renderes den fulde model med maksimal trofasthed; men under streaming, sender de højeste-bidrags-Gaussianer først, og tillader tidlige del-resultater at matche det endelige billede tæt, hvorimod transmission af lav-bidrags-Gaussianer først forvrænger farvebalance og fremhæver mindre komponenter.

Data og Tests

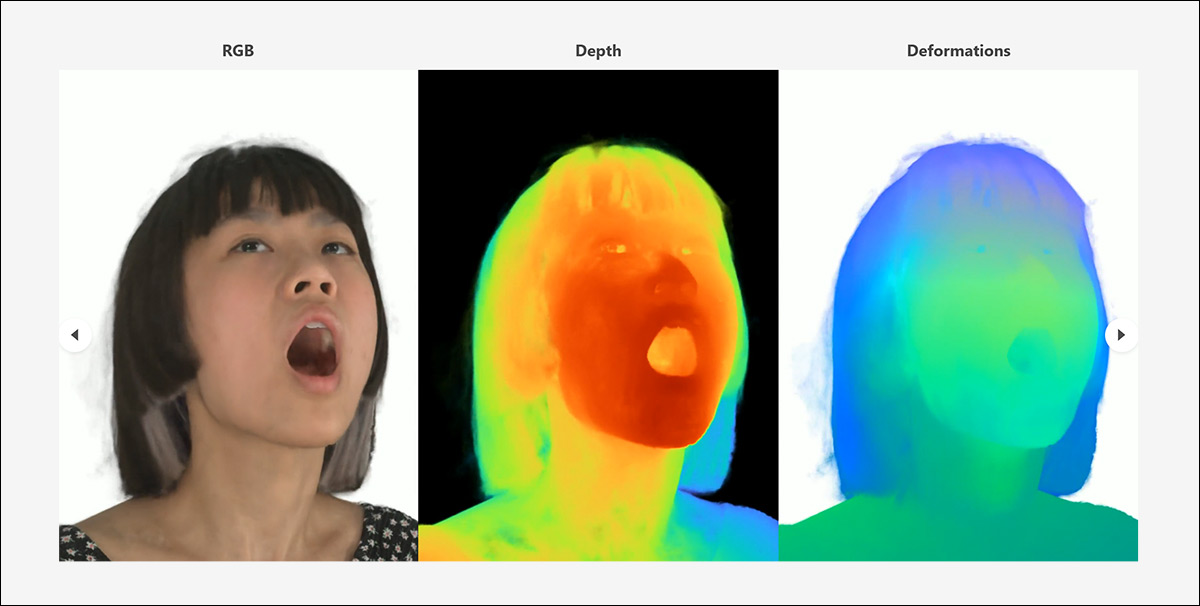

Til tests, blev den nye metode evaluueret på NeRSemble-datasettet, som består af multi-view-videoer for hver underlagt, med kalibrerede parametre på tværs af alle views:

Eksempler på diverse fortolkninger af underlagte inkluderet i NeRSemble-datasettet brugt i tests for ProgressiveAvatars. Kilde

I overensstemmelse med den oprindelige GaussianAvatars-metodologi, blev billeder nedsamplet til 802x550px, en forgrunds-mask genereret, og det oprindelige projekts træning/test split antaget.

Den Adam-optimizer blev brugt til parameter-opdateringer, med en læringsrate på 1×10-2 på alle barycentriske koordinater. Træning løb i 60.000 iterationer, med hierarkiet automatisk udvidet hver 2.000 iterationer.

Først testede forfatterne for rekonstruktion og animation – opgaven med at konvertere flad video til en 3D-bevidst (x/y/x)-system, ved hjælp af FLAME’s kanoniske CGI-repræsentation som den ankrende mesh. For dette, blev alle baseline-modellerne trænet fra scratch, og de rivaliserende rammer testet var den ovennævnte GaussianAvatars, og PointAvatar.

For disse tests, blev metrikkerne Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), og Learned Perceptual Image Patch Similarity (LPIPS) brugt:

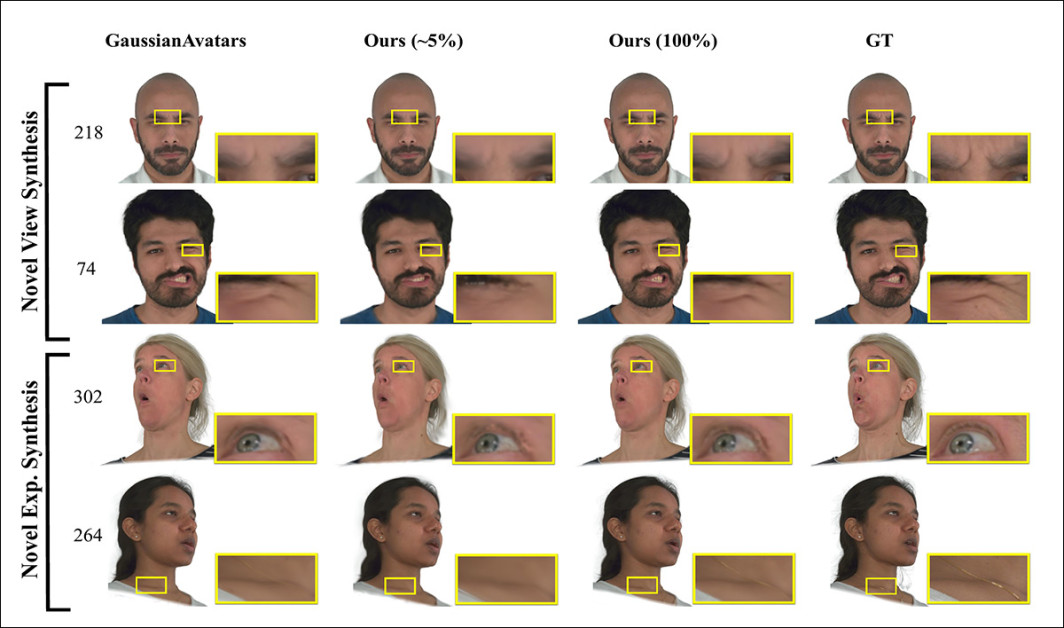

Kvalitativ sammenligning på ny-view og ny-udtryk-syntese. Baseline-GaussianAvatars kæmper med fine detaljer omkring øjne, rynker og hudtekstur, mens den foreslåede metode allerede bevarer nøgle-faciale-struktur ved omkring fem procent af transmitteret data og konvergerer mod grund-sandheden, efterhånden som mere Gaussianer strømmes, og matcher tæt den fulde model og reference-billeder (grund-sandhed).

Med hensyn til disse resultater, hævder forfatterne:

‘[Vores] metode rekonstruerer skarpere detaljer i flere områder, især omkring halsen, skuldrene og tøjet. Disse områder er relativt groft tesselleret i FLAME-skabelonen sammenlignet med høj-saliens-faciale zoner (f.eks. periokulære regionen).

‘Følgelig allokerer tidligere metoder ofte for få 3D-Gaussianer til disse områder for at trofast fange deres fine-skala-detalje. I modsætning hertil øger vores adaptive vækst-strategi antallet af Gaussianer og forbedrer hierarkiet kun, hvor det er nødvendigt, og gør allocation uafhængig af FLAME’s ikke-uniforme tessellation.’

Forfatterne bemærker yderligere, at deres tilgang er på niveau med state-of-the-art-metoder, og giver en fungerende avatar med en trivial 5% båndbredde-tilladelse:

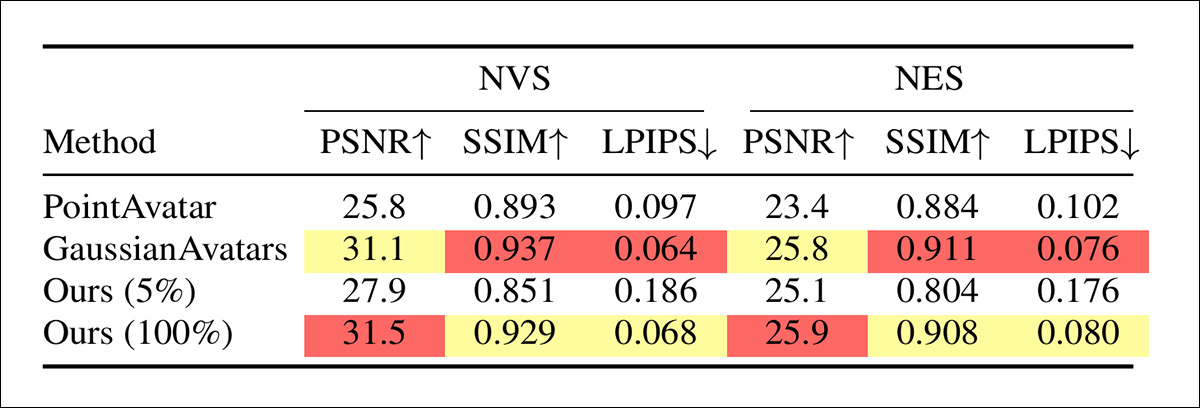

Kvantitativ sammenligning på ny-view-syntese og ny-udtryk-syntese ved hjælp af PSNR, SSIM og LPIPS. Ved fuld transmission opnår den foreslåede metode den højeste PSNR på begge opgaver og forbliver konkurrencedygtig med GaussianAvatars på perceptuelle metrikker, mens 5%-indstillingen illustrerer kvalitets-afvigelsen under ekstreme båndbredde-begrænsninger.

Herefter testede forskerne den progressive rendering selv. Dette blev udført på en NVIDIA RTX 4090, med 24Gb VRAM, i 550x802px opløsning. I dette scenario bemærker forfatterne, at en 25%-budget ville bruge alle ‘level 1’-Gaussianer, samt en undermængde af ‘level 2’-Gaussianer, hvilket giver en omtrentlig oversigt over, hvordan Gaussian-grupperinger samler detalje i de højere nummerværdier, og at de lavere nummerværdier grundlæggende bygger den grundlæggende canvas:

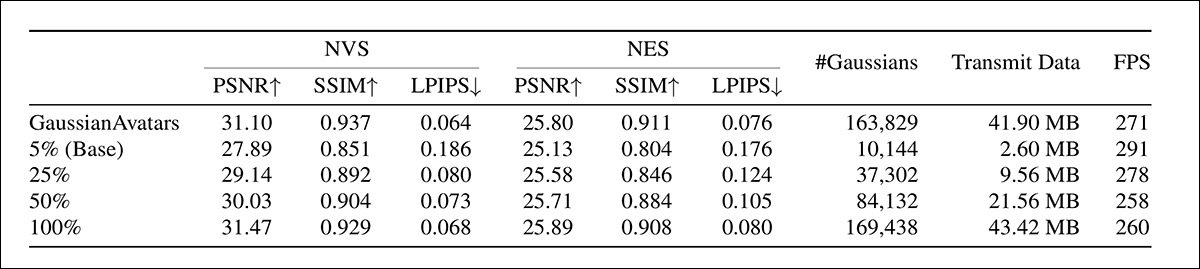

Ydelse under forskellige transmission-budgetter for ny-view og ny-udtryk-syntese, viser, at kvaliteten jævnt nærmer sig eller overgår GaussianAvatars, efterhånden som mere Gaussianer og data strømmes, mens realtids-hastigheder opretholdes på en RTX 4090.

Forfatterne kommenterer:

‘Med kun 2,60 MB transmitteret (5% budget), opnår avatarerne allerede en rimelig kvalitet. Efterhånden som højere-niveau-Gaussianer strømmes, skærpes fine strukturer som knapper, tænder og hår gradvist, mens temporal stabilitet opretholdes.

‘Ved 100% transmission, opnår vores tilgang en renderingskvalitet, der er sammenlignelig med SOTA-metoder. Bemærkelsesværdigt, falder frame-raterne ikke betydeligt, sandsynligvis fordi 3DGS-arbejdsbyrden endnu ikke har mættet GPU’en.’

Dog bemærker forfatterne, at i multi-bruger-VR-scenarier ville antallet af 3D-Gaussianer hurtigt vokse til et punkt, hvor GPU-rasterisering blev en flaskehals. I disse tungere scenarier tilbyder den foreslåede tilgang en fordel ved at tillade systemet at afveje antallet af primitive mod visuel kvalitet, og lette belastningen uden at kollapsere renderingen.

Selv om artiklen ikke detaljerer det, viser projekt-sitet yderligere test-sammenligninger, også med MeGA-Hybrid mesh-Gaussian-avatar-projekt:

Click to play. One of a series of supplementary videos from the paper’s accompanying project site, this one comparing the new approach in terms of novel view synthesis.

Konklusion

Gaussian Splatting kan eller kan ikke være vedvarende, eller endda blive husket meget mere end RealPlayer nu er, i forhold til daggryet af interaktiv streaming: AI-drevne eller AI-assisterede 3D-bevidste repræsentationer, herunder video-chat, virtuel shopping, rute-navigering og diverse underholdningsapplikationer. Det kan være, at alternativ teknologi eller tilgange sejrer, eller at GSplat viser sig at være den mest pålidelige AI-video-repræsentation.

Hvis intet andet, så er denne interessante nye artikel en lille del af omfanget af dette nye domæne, og minder os måske nostalgisk om den båndbredde-sultne internet i gamle dage.

* Ved ‘3D’ mener jeg ikke den type oplevelse, der kræver speciel briller, men snarere oplevelser, hvor multimedie-indholdet har en slags forståelse af X/Y/Z-koordinater.

Først publiceret onsdag, 18. marts 2026