Andersons vinkel

Forskning antyder, at ChatGPT har høj troværdighed som nyhedsleverandør

Nyt forskning antyder, at ChatGPT’s faktatjekmærker slår likes, delinger og selv troværdige nyhedsbrands, når det kommer til at forme, hvad folk tror på og ønsker at dele online.

En ny undersøgelse af 1.000 personer har fundet, at når ChatGPT giver en troværdighedsscore til politiske nyheder, ændrer det ofte, hvad folk tror på, og om de ønsker at dele det – uanset deres oprindelige politiske synspunkter. Mere traditionelle påvirkningsfaktorer som likes eller delinger havde ikke megen effekt, men AI-systemets dom ændrede stærkt, hvor troværdigt nyheden syntes:

![Fra den nye artikel, en illustration af, hvordan mennesker vurderer en nyhedsoverskrift, baseret på tre interagerende signaler: om historien er i overensstemmelse med deres politiske identitet; hvor meget engagement den synes at have på sociale medier; og troværdighedssignalerne leveret af institutioner eller AI-systemer. Disse påvirkninger kombinerer for at forme både opfattet nøjagtighed og sandsynligheden for at dele indholdet. [ Kilde ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

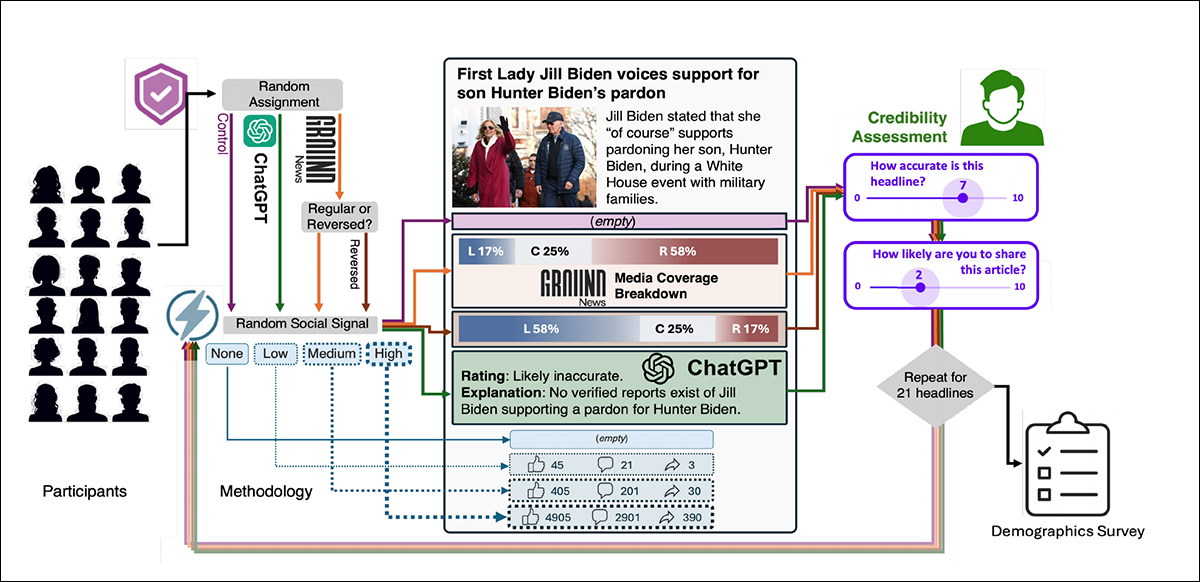

Fra den nye artikel, en illustration af, hvordan mennesker vurderer en nyhedsoverskrift, baseret på tre interagerende signaler: om historien er i overensstemmelse med deres politiske identitet; hvor meget engagement den synes at have på sociale medier; og troværdighedssignalerne leveret af institutioner eller AI-systemer. Disse påvirkninger kombinerer for at forme både opfattet nøjagtighed og sandsynligheden for at dele indholdet. Kilde

Omfanget af, hvilken udstrækning AI-summeringer tages som troværdige nyhetskilder, er måske et af de vigtigste emner i medierne i mange år, ikke mindst fordi Googles AI-summeringer har drænet trafik væk fra de fleste større online-mediekanaler i 2025, med ingen sikkerhed på, hvor denne overførsel af magt måske kan gå i lang eller medium længde.

Artiklens forfattere skriver:

‘Disse resultater fremhæver både potentialet og risikoen for algoritme-baseret feedback i formning af offentlig forståelse. AI-genererede signaler kan hjælpe med at mildne bias og forbedre troværdighedsdiscernment, men deres indflydelse varierer med politisk identitet og medfører etiske risici relateret til overafhængighed […]

‘…Den overdreven indflydelse af ChatGPT fremhæver en kritisk afvejning: mens persuasive, kan AI-feedback måske erstatte kritisk tænkning, hvis det ikke er omhyggeligt ramt.’

Forfatterne foreslår, at fremtidig forskning skal fokusere på forbedrede AI-troværdighedsinterventioner, der er mere uafhængige og understøtter kendte fakta, og de bemærker, at dette er særligt vigtigt i emner, der er polariserende.

Ud over den åbenlyse opstigning af ChatGPT som en ‘myndighed’, og den uventet lave indflydelse af delingssignaler i testene (som forfatterne mener kan tilskrives de lidt sterile testbetingelser), er der endnu en interessant udfald fra forskernes tests relateret til demografi og køn:

Kvinder og racemæssigt minoritetsdeltagere (især sorte og latinske brugere) reagerede mere positivt på AI-baseret feedback end institutionelle mærker.’

Den nye artikel hedder AI Credibility Signals Outrank Institutions and Engagement in Shaping News Perception on Social Media, og kommer fra tre forskere ved University of Notre Dame.

Lad os tage en nærmere kig på artiklens metoder og konklusioner.

Metode

Fire hypoteser blev testet: at mennesker ville bedømme overskrifter som mere nøjagtige, når overskrifterne reflekterede deres politiske synspunkter; at AI-genererede troværdighedsscores ville være mere indflydelsesrige end signaler fra etablerede institutioner; at overskrifter med højt engagement (dvs. målt gennem likes, delinger eller kommentarer) ville blive set som mere troværdige; og at brugere ville tende til at acceptere AI-systemets dom om en overskrifts nøjagtighed, selv når det var i modstrid med deres egne overbevisninger.

Deltagerne i studiet blev rekrutteret fra Prolific-platformen, og skulle være flydende i engelsk, samt regelmæssige forbrugere af nyheder; og en randomiseringsproces sikrede, at deltagerne repræsenterede en diversitet af racemæssige og kønsorienterede synspunkter.

I eksperimentet* blev deltagerne inddelt i fire grupper, hver vist en anden type feedback sammen med nyhedsoverskrifterne.

I den første gruppe (den kontrol-betingelse) blev der ikke givet nogen ekstra information om, hvor troværdig overskriften måske var; i den anden gruppe blev overskrifterne mærket med en bias-vurdering fra GroundNews, en tjeneste, der klassificerer nyhetskilder som venstre-, center- eller højreorienterede.

En tredje gruppe så de samme GroundNews-mærker, men bevidst flippede, og skabte en mislighed, der skulle testes, om brugere ville opdage forvrængningen.

Den sidste gruppe blev vist troværdighedsbedømmelser skrevet af ChatGPT, der tilbød en kort forklaring og en vurdering som ‘sandsynligvis unøjagtig’:

Konceptuel skema for eksperimentet: hver deltager blev vist politiske overskrifter med varierende kombinationer af troværdighedsmærker og sociale engagementssignaler. Responser blev indsamlet på, hvor nøjagtig hver overskrift syntes, og hvor sandsynligt det var, at den ville blive delt, med den fulde sekvens gentaget over 21 punkter.

Data og test

Hver deltager blev vist en sekvens af 21 politiske nyhedsoverskrifter. For hver overskrift blev niveauet af socialt engagement varieret; nogle gange viste det ingen likes eller delinger, nogle gange mange. Disse engagementssignaler blev randomiseret for at undgå faste mønster.

Overskrifterne selv kom fra en blanding af politiske perspektiver og blev mærket som venstreorienterede, <i*højreorienterede eller centristiske.

Efter hver overskrift blev deltagerne spurgt, hvor nøjagtige de troede, den var, og om de ville overveje at dele den. Fordi hver deltager allerede havde erklæret deres egen politiske tilhørsforhold, var det muligt at analysere, om overskrifter fra samme side af det politiske spektrum blev vurderet mere positivt.

Deltagerne vurderede hver overskrift to gange: en gang for, hvor nøjagtig den syntes, og en gang for, hvor sandsynligt de ville være til at dele den, med deres responser målt på en skala fra 0-10.

Forskerne kombinerede derefter disse svar med yderligere data: demografisk og mediebrugsinformation fra hver deltager; politiske mærker for hver overskrift; typen af troværdighedssignal vist; og niveauet af socialt engagement tildelt.

Politisk identitets indflydelse

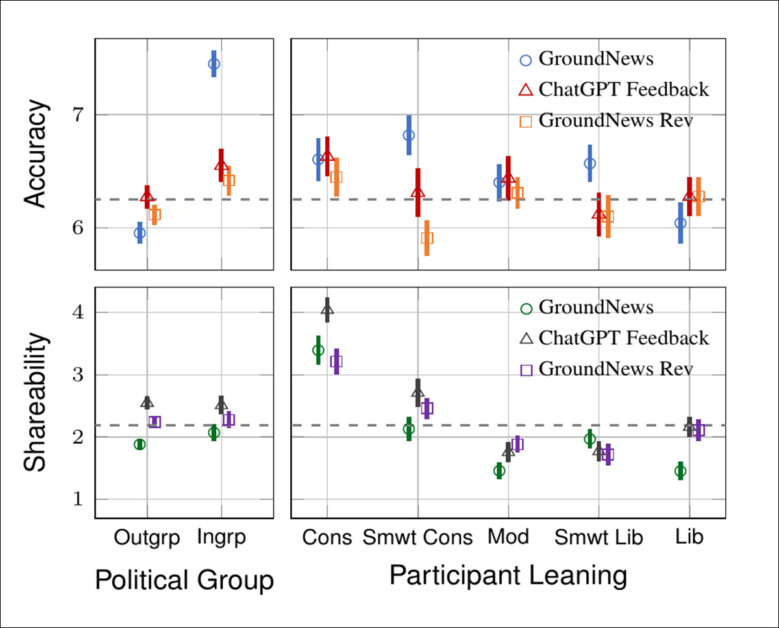

I den første test, der undersøgte, om mennesker vurderer overskrifter som mere nøjagtige, når overskriftens politiske synspunkt matcher deres eget, viste resultaterne, at deltagerne var mere tilbøjelige til at tro på overskrifter, der matchede deres politiske synspunkter – men at dette afhængig af gruppen.

Moderater viste den stærkeste bias mod deres egen side, mens liberale og konservative tendede til at stole på center-orienterede overskrifter mest; og overall blev neutrale overskrifter vurderet som mere nøjagtige end venstre- eller højreorienterede.

En illustration af, hvordan nøjagtighed og delbarheds-vurderinger ændrede sig afhængigt af både overskriftens politiske synspunkt og deltagerens politiske tilhørsforhold. Moderater var mest tilbøjelige til at vurderer ‘ingroup’-overskrifter som nøjagtige, mens liberale og konservative foretrækker center-orienterede overskrifter. Delingsskævhed fulgte en lignende mønster, med begrænset ingrup-bias uden for den moderate gruppe.

I resultaterne af denne første eksperiment fandt man en moderat ingrup-effekt på delbarhed; men kun for moderater, der var mere tilbøjelige til at dele politisk alignerede (dvs. neutrale) overskrifter. Liberale og konservative viste ingen sådan tendens.

Analyse af varians (ANOVA), en metode brugt til at spotte forskelle mellem grupper, viste, at alignment påvirkede deling kun, når det interagerede med politisk identitet. Troværdighed og deling var sammenhængende, men kun moderater viste en klar mønster over begge.

Institutionel vs. AI-troværdighed

Den næste test spurgte, om mennesker stoler mere på AI-vurderinger end traditionelle kilder som nyheds-vurderingssites – især når vurderingerne måske er i modstrid med deres politik:

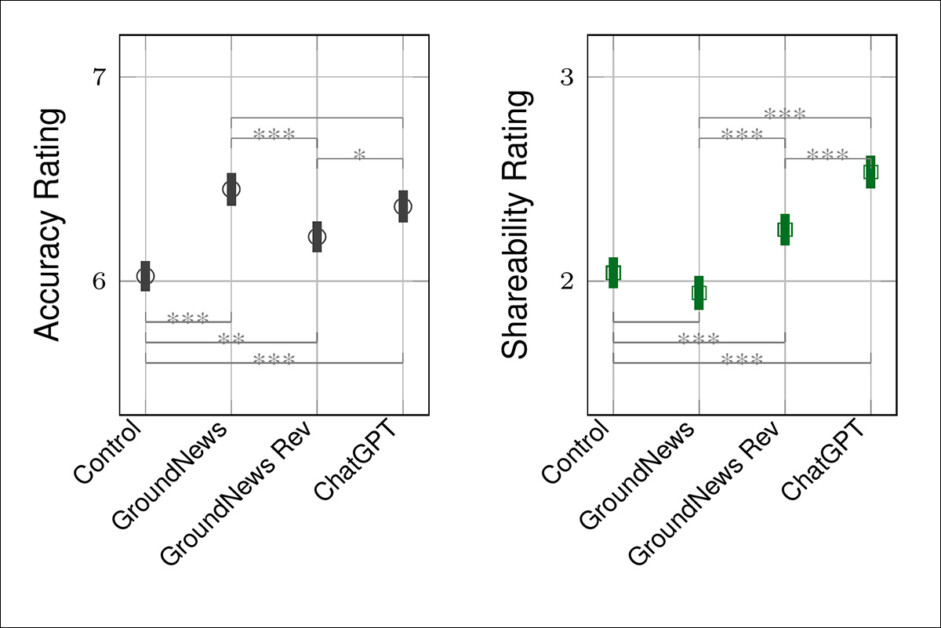

Troværdighed og delbarheds-vurderinger over feedback-kilder: alle tre signaler øgede nøjagtighed i forhold til kontrol, med GroundNews, der gav de højeste vurderinger. Men ChatGPT producerede de største gevinster i delbarhed, hvilket antyder, at det havde en bredere persuasiv effekt. Fejlbarer viser 95% konfidensintervaller, og asterisker markerer signifikante parvise forskelle.

Alle feedback øgede opfattet nøjagtighed; men GroundNews var mest effektiv, når det var i overensstemmelse med brugerens politik.

ChatGPT øgede nøjagtigheds-vurderinger over hele linjen, hvilket indikerer, at det blev set som mere neutralt. Konservative var mindre påvirkede af GroundNews, men svarede på ChatGPT på samme måde som andre grupper:

Her kan vi se effekten af ChatGPT-feedback på opfattet nøjagtighed. Resultaterne bekræfter, at tillid til institutionelle signaler afhænger af alignment, mens tillid til algoritme-baserede signaler ikke gør. ChatGPT øgede både troværdighed og delbarhed over grupper – især for konservative.

Sociale metrikker har lille indflydelse

Den tredje analyse testede, om synlige sociale engagementssignaler som likes, delinger og kommentarer ville øge troværdighed eller delbarhed ved at fungere som social bevis; men ingen sådan effekt blev observeret.

Testene fandt, at engagementniveauer, såsom likes eller delinger, havde ingen reel effekt på, hvor nøjagtige overskrifter syntes, og kun en svag, utroværdig effekt på, hvor delbare de føltes; i modsætning til algoritme-baserede eller institutionelle signaler, syntes disse sociale signaler ikke at påvirke vurderinger i denne kontekst, af de årsager, der tidligere er nævnt i artiklen.

AI-feedback påvirker, hvad folk stoler på

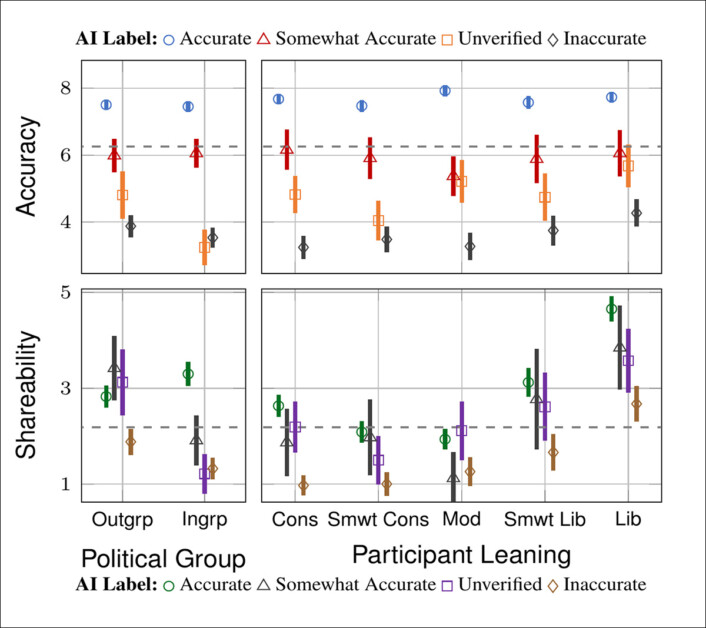

Den fjerde og sidste eksperiment testede, om brugere ville justere deres troværdigheds- og delingsskøn i respons til AI-genererede mærker: nøjagtig; delvis nøjagtig; uværificeret; eller unøjagtig, alle tildelt af ChatGPT.

Deltagerne svarede stærkt på AI-genererede troværdighedsmærker. Nøjagtigheds-vurderinger steg eller faldt i overensstemmelse med ChatGPT’s feedback, med de største effekter set, når overskrifter var mærket nøjagtig eller unøjagtig:

ChatGPT-feedback påvirkede både nøjagtighed og delbarheds-vurderinger. Top: Nøjagtigheds-vurderinger steg med mere positive mærker, især når overskrifter var mærket ‘Nøjagtig’, og faldt, når de var mærket ‘Unøjagtig’. Bottom: Delbarhed fulgte en lignende mønster, men viste større variation mellem grupper: liberale reagerede stærkest på negative signaler, mens konservative viste mere dæmpede skift.

Politisk identitet formede disse effekter, med brugere, der stolede mere på ChatGPT, når dens feedback var i overensstemmelse med deres egne synspunkter.

Delingsadfærd fulgte en lignende mønster: ingrup-overskrifter mærket som nøjagtige blev delt mest, især under tvetydige mærker som delvis nøjagtig.

Disse resultater, som artiklen påstår, antyder, at AI-feedback kan ændre brugeradfærd; og at det også risikerer at forstærke partisanskel og diskouragere kritisk tænkning.

Hvem stoler mest på AI?

Følgeanalyse undersøgte, hvordan brugerdemografi formede reaktioner på troværdighedsmærker. ChatGPT’s feedback øgede nøjagtigheds-vurderinger overall, men effekten var svagere blandt højuddannede brugere og hyppige sociale medieforbrugere, der viste mere skepsis.

Disse samme grupper reagerede negativt på GroundNews og Reversed-kuer, hvilket, artiklen foreslår, kan antyde, at åbenlyse bias-mærker kan alienere mere medie-litterate brugere.

I modsætning hertil reagerede kvinder og racemæssigt minoritetsdeltagere, især sorte og latinske brugere, mere positivt på ChatGPT end på institutionelle signaler:

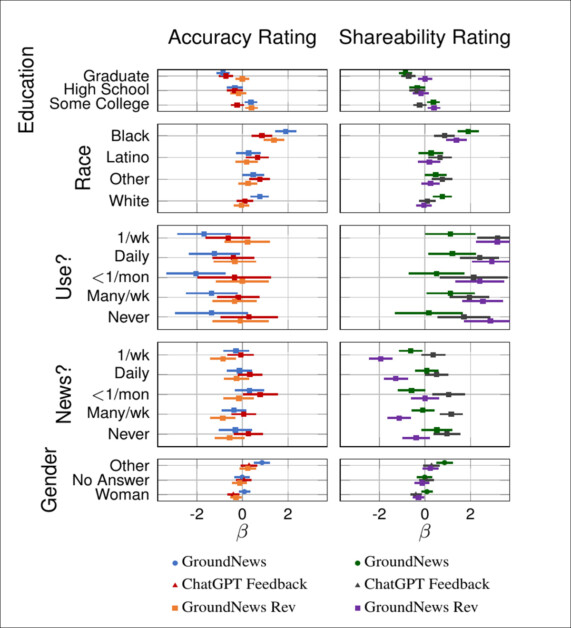

Demografiske responser på feedback-typer, med hver panel, der viser, hvordan en bestemt gruppe reagerede på forskellige troværdighedssignaler. ChatGPT’s vurderinger havde den stærkeste og mest konsekvente indflydelse på nøjagtighed, mens effekter på deling var mindre ensartede, med variation efter race, køn og mediebrug.

Delingsadfærd genspejlede denne splittelse: GroundNews reducerede delbarhed mest skarpt blandt sociale mediebrugere og nyhedsjunkier, mens ChatGPT’s effekter var mere blandede, selv om det øgede delbarhed i visse grupper, med kandidater med en akademisk grad som særligt responsiv til alle feedback-typer.

Forfatterne konkluderer:

‘Disse resultater har direkte implikationer for designet af troværdighedsinterventioner i sociotekniske systemer. Brugere er stadig mere påvirkede af algoritme-baseret feedback, som kan overtage institutionelle signaler og moderate partisanskel – men også risikerer at fremme overafhængighed.

‘Institutionelle signaler forbliver effektive for visse brugere, men deres indflydelse mindskes i politisk polariserede eller [lav-tillids]-miljøer. Imens var engagement-metrikker som likes og delinger stort set ignoreret, hvilket antyder reduceret persuasiv værdi, når de præsenteres uden social kontekst.

‘For at støtte lige og informeret nyheds-evaluering skal AI-drevne interventioner være transparente, forklarende og designet til at forbedre brugerens handlefrihed.

‘Fremtidig arbejde skal undersøge disse mekanismer i mere økologisk gyldige indstillinger, evaluere alternative AI-troværdigheds-rammer og udvikle adaptive systemer, der fremmer kritisk engagement over politisk diverse publikum.’

Konklusion

Givet tendensen af alle nuværende generative AI-systemer til at hallucinere og forvrænge sandheden, er det måske af vis bekymring, at den vilde adoption (selv om det er sænket lidt) af ChatGPT også repræsenterer et enormt spring af tro, som arkitekturen af sådanne systemer hverken kan retfærdiggøre eller understøtte.

Et problem med at stole på AI’s repræsentation af nyheder er manglen på effektive systemer, der kan kontekstualisere nyhetskilder som ‘politisk tilknyttede’ eller med en bestemt politisk orientering.

Selv blandt de mest respekterede fjerde-estat-kilder er valget af, hvad der og hvorfor ikke dækkes, i sig selv en politisk udtalelse. Hverken ChatGPT eller dens stabslægtere er i øjeblikket i stand til at navigere disse lag af fortolkningsbias, og emnet selv inviterer til diskussion snarere end faste konklusioner.

Et andet problem er, at systemer af denne type er ankommet på scenen i en af de mest polariserede og splittede perioder i menneskehedens historie i 80 år, og på et tidspunkt, hvor samfundet er mest villigt til at lytte til ‘alternative stemmer’ – såsom en helt ny genre af teknologi, der markedsføres som en essentiel filter for verdens sandhed, snarere end hvad det faktisk er: en forudsigelse af statistiske sandsynligheder, fødet med store mængder af partisk information.

* Detaljer om, hvilke forfatterne har gjort tilgængelige online (se kildeartiklen, bunden af side 2, for URLs). Men denne data kræver tilmelding for at se, og da jeg ikke tog sagen videre på det tidspunkt, kan jeg ikke bekræfte, at den kan ses fuldstændigt uden betaling og/eller bestemte typer af legitimationspapirer.

Først udgivet onsdag, den 5. november 2025