Sundhedsvæsen

Genkendelse af medarbejderstress gennem ansigtsanalyse på arbejdspladsen

I konteksten af den skiftende kultur omkring Zoom-mødeetikette, og opblomstringen af Zoom-utmattelse, har forskere fra Cambridge offentliggjort en studie, der bruger maskinelæring til at bestemme vores stressniveauer via AI-aktiveret webcam-dækning af vores ansigtsudtryk på arbejdspladsen.

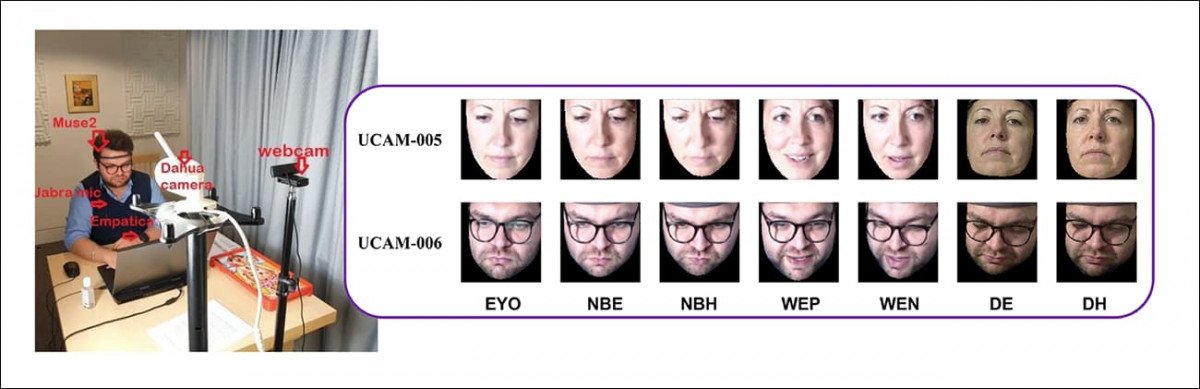

Til venstre, dataindsamlingens miljø, med flere overvågningsenheder enten trænet på eller fastgjort til en frivillig; til højre, eksempler på ansigtsudtryk genereret af testpersoner ved varierende niveauer af opgavevanskelighed. Kilde: https://arxiv.org/pdf/2111.11862.pdf

Forskningen er beregnet til affektanalyse (dvs. følelsesgenkendelse) i ‘Ambient Assistive Living’-systemer, og formodentlig er designet til at aktivere video-baserede AI-ansigtsudtryks-overvågningsrammer i sådanne systemer; selvom artiklen ikke udvider på dette aspekt, giver forskningsindsatsen ingen mening i nogen anden kontekst.

Det specifikke område for projektet er at lære ansigtsudtryksmønstre i arbejdsmiljøer – herunder hjemme-arbejdsordninger – snarere end ‘fritids’- eller ‘passive’ situationer, såsom rejse.

Ansigt-baseret følelsesgenkendelse på arbejdspladsen

Mens ‘Ambient Assistive Living’ måske lyder som en skema for ældrepleje, er det langt fra tilfældet. Når det gælder de ønskede ‘slutbrugere’, skriver forfatterne*:

‘Systemer skabt til ambient assistive living-miljøer [†] har til formål at kunne udføre både automatisk affektanalyse og reagere. Ambient assistive living afhænger af brugen af informationsteknologi (IT) til at hjælpe personer i deres daglige liv og arbejdsmiljø for at holde dem sunde og aktive længere, og muliggøre, at de kan bo uafhængigt, mens de bliver ældre. Derfor har ambient assistive living til formål at lette arbejdet for sundhedsarbejdere, sygeplejersker, læger, fabriksarbejdere, chauffører, piloter, lærere samt forskellige industrier via sansning, vurdering og intervention.

‘Systemet er beregnet til at bestemme den fysiske, emotionelle og mentale belastning og reagere og tilpasse sig efter behov, f.eks. en bil udstyret med en søvndrægtighedsdetektionssystem kan underrette chaufføren om at være opmærksom og kan foreslå ham at tage en lille pause for at undgå ulykker [††].’

Artiklen hefter er titlen Inferring User Facial Affect in Work-like Settings, og kommer fra tre forskere på Affective Intelligence & Robotics Lab på Cambridge.

Testbetingelser

Da tidligere arbejde på dette område i høj grad har afhængt af tilfældige samlinger af billeder skrabet fra internettet, gennemførte Cambridge-forskerne lokale dataindsamlingseksperimenter med 12 campus-frivillige, 5 mænd og 7 kvinder. Frivillige kom fra ni lande og var i alderen 22-41.

Projektet havde til formål at genskabe tre potentielt stressende arbejdsmiljøer: et kontor; en fabriksproduktionslinje; og en telekonference-opkald – såsom den type Zoom-gruppechat, der er blevet en hyppig funktion af hjemmearbejde siden pandemiens begyndelse.

Testpersoner blev overvåget på forskellige måder, herunder tre kameraer, en Jabra halsbåret mikrofon, en Empatica-armbånd (en trådløs multi-sensor bærbar enhed, der tilbyder realtidsbiofeedback), og en Muse 2 hovedbåndssensor (der også tilbyder biofeedback). Derudover blev frivillige bedt om at udfylde spørgeskemaer og selv-vurdere deres humør periodisk.

Men dette betyder ikke, at fremtidige Ambient Assistive Living-udstyr vil ‘plugge dig ind’ til den grad (hvis blot af økonomiske årsager); alle de ikke-kamera-overvågningsudstyr og -metoder, der blev brugt i dataindsamlingen, herunder de skriftlige selv-vurderinger, er beregnet til at verificere de ansigt-baserede affektgenkendelsessystemer, der er aktiveret af kameraoptagelser.

Øger presset: Kontorscenariet

I de første to af de tre scenarier (‘Kontor’ og ‘Fabrik’), startede frivillige med en let fase, med gradvist øget pres over fire faser, med forskellige typer opgaver for hver.

Ved det højeste niveau af induceret stress, måtte testpersonerne også udholde ‘hvidkåbs-effekten’ af, at nogen så over deres skulder, plus 85 db af ekstra støj, der er blot fem decibel under den lovgivningsmæssige grænse for et kontormiljø i USA, og den præcise maksimumgrænse specificeret af National Institute for Occupational Safety and Health (NIOSH).

I kontor-lignende dataindsamling, blev testpersonerne bedt om at huske tidligere bogstaver, der var dukket op på deres skærm, med øget vanskelighedsgrad (såsom at huske to-bogstavssekvenser, der optrådte to skærme tidligere).

Fabrikscenariet

For at simulere et manuelt arbejdsmiljø, blev testpersonerne bedt om at spille spillet Operation, der udfordrer brugerens fingernemhed ved at kræve, at spilleren fjerner små genstande fra en bræt gennem smalle, metalindrammede åbninger uden at røre siderne, hvilket udløser en ‘fejl’-bip.

Ved den sværeste fase, blev frivillige udfordret til at fjerne alle 12 genstande uden fejl inden for én minut. For sammenligning, er verdensrekorden for denne opgave, sat i Storbritannien i 2019, 12,68 sekunder.

Telekonferencescenariet

Til sidst, i hjemmearbejds-/telekonference-testen, blev testpersonerne bedt af en eksperimenterende over en MS Teams-opkald om at huske deres egne positive og negative minder. For den mest stressende fase af dette scenario, blev testpersonen bedt om at huske en meget negativ eller sørgelig hændelse fra deres nære fortid.

De forskellige opgaver og scenarier blev udført i tilfældig rækkefølge og samlet i en brugerdefineret dataset kaldet Working-Environment-Context-Aware Dataset (WECARE-DB).

Metode og træning

Resultaterne af testpersonernes selv-vurderinger af deres humør blev brugt som sandhed, og kortlagt til valens- og ophidselsesdimensioner. De optagede videoer af eksperimenterne blev kørt gennem et ansigtslandemærke-detektionsnetværk netværk, og de justerede billeder blev ført til et ResNet-18-netværk trænet på AffectNet-datasettet.

450.000 billeder fra AffectNet, alle tegnet/mærket fra internettet ved hjælp af følelsesrelaterede forespørgsler, blev manuelt annoteret, skriver artiklen.

Herefter forbedrede forskerne netværket udelukkende på deres eget WECARE-dataset, mens spektral repræsentationskodning blev brugt til at sammenfatte ramme-baserede forudsigelser.

Resultater

Modellens præstation blev vurderet på tre metrikker, der ofte er forbundet med automatiseret affektprædiktion: Concordance Coefficient Correlation; Pearson Coefficient Correlation; og Root Mean Square Error (RMSE).

Forfatterne bemærker, at modellen, der er finjusteret på deres eget WECARE-dataset, overgik ResNet-18, og sluttede, at måden, vi regulerer vores ansigtsudtryk på, er meget forskellig i et arbejdsmiljø end i de mere abstrakte kontekster, som tidligere studier har hentet kilde fra internettet.