Kunstig intelligens

Paraphrase Generation Using Deep Reinforcement Learning – Thought Leaders

Når vi skriver eller taler, har vi alle undret os over, om der er en bedre måde at kommunikere en idé til andre. Hvilke ord skal jeg bruge? Hvordan skal jeg strukturere tanken? Hvordan vil de sandsynligvis reagere? Hos Phrasee, bruger vi meget tid på at tænke over sprog – hvad fungerer og hvad fungerer ikke.

Forestil dig, at du skriver emnefeltet for en e-mail-kampagne, der skal sendes til 10 millioner mennesker på din liste for at promovere 20% rabat på en fancy ny laptop.

Hvilken linje ville du vælge:

- DU kan nu få yderligere 20% rabat på din næste ordre

- Vi er klar – yderligere 20% rabat

Selvom de formidler den samme information, opnåede den en næsten 15% højere åbningsrate end den anden (og jeg vædder, du ikke kan slå vores model i at forudsige, hvilken af dem ?). Selvom sprog ofte kan testes gennem A/B-test eller multi-armed bandits, er automatisk generering af paraphraseringer stadig et meget udfordrende forskningsspørgsmål.

To sætninger betragtes som paraphraseringer af hinanden, hvis de deler den samme betydning og kan bruges som erstatning for hinanden. En anden vigtig ting, der ofte tages for givet, er, om en maskin genereret sætning er flydende.

I modsætning til overvåget læring, lærer Deep Reinforcement Learning (RL) agenter gennem at interagere med deres omgivelser og observere de belønninger, de modtager som følge. Denne nuancerede forskel har massive implikationer for, hvordan algoritmerne fungerer, og hvordan modellerne trænes. Deep RL bruger neurale netværk som en funktionel approximator til at låse RL-agenter til at lære, hvordan de kan overgå mennesker i komplekse omgivelser såsom Go, Atari og StarCraft II.

Trods denne succes, er forstærket læring ikke blevet bredt anvendt på virkelige problemer, herunder Naturlig Sprogbehandling (NLP).

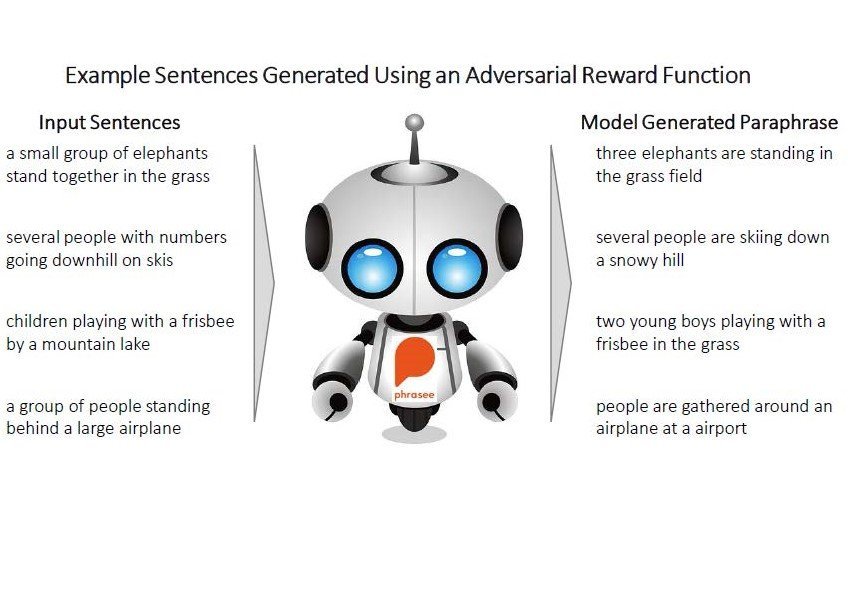

Som en del af min MSc-afhandling i Data Science, demonstrerer vi, hvordan Deep RL kan bruges til at overgå overvåget læring i automatisk generering af paraphraseringer af input-tekst. Problemet med at generere den bedste paraphrasering kan ses som at finde den række af ord, der maksimerer den semantiske lighed mellem sætninger, mens man opretholder flydende output. RL-agenter er velegnede til at finde den bedste sæt af handlinger for at opnå den maksimale forventede belønning i kontrollerede omgivelser.

I modsætning til de fleste problemer i maskinlæring, ligger det største problem i de fleste Naturlig Sproggenererings (NLG) programmer ikke i modelleringen, men snarere i evalueringen. Mens menneskelig evaluering i øjeblikket betragtes som den guldstandard i NLG-evaluering, lider den under betydelige ulemper, herunder, at det er dyrt, tidskrævende, udfordrende at justere og mangler reproducerbarhed på tværs af eksperimenter og datasæt (Han, 2016). Som følge heraf har forskere længe søgt efter automatiske metrikker, der er simple, generaliserbare og som afspejler menneskelig vurdering (Papineni et al., 2002).