Kunstig intelligens

Hvordan AI gør tegnsprogsigenkendelse mere præcis end nogensinde

Når vi tænker på at nedbryde kommunikationsbarrierer, fokuserer vi ofte på sprogøversættelsesapps eller taleassistenter. Men for millioner, der bruger tegnsprog, har disse værktøjer ikke helt broet kløften. Tegnsprog er ikke kun om håndbevægelser – det er en rig, kompleks form for kommunikation, der inkluderer ansigtsudtryk og kropssprog, hvor hvert element bærer afgørende betydning.

Her er, hvad der gør det særligt udfordrende: til forskel fra tale-sprog, der primært varierer i ordforråd og grammatik, adskiller tegnsprog sig fundamentalt i, hvordan de formidler betydning. Amerikansk Tegnsprog (ASL) har for eksempel sin egen unikke grammatik og syntaks, der ikke matcher talte engelsk.

Denne kompleksitet betyder, at det kræver en forståelse for et helt sprogssystem i bevægelse for at skabe teknologi, der kan genkende og oversætte tegnsprog i realtid.

En ny tilgang til genkendelse

Det er her, et hold på Florida Atlantic University’s (FAU) College of Engineering and Computer Science besluttede at tage en frisk tilgang. I stedet for at forsøge at tackle hele kompleksiteten af tegnsprog på én gang, fokuserede de på at mestre en afgørende første skridt: at genkende ASL-alphabet-gestus med uden precedent nøjagtighed gennem AI.

Tænk på det som at lære en computer at læse håndskrift, men i tre dimensioner og i bevægelse. Holdet byggede noget bemærkelsesværdigt: en dataset på 29.820 statiske billeder, der viser ASL-håndgestus. Men de samlede ikke bare billeder. De markerede hvert billede med 21 nøglepunkter på hånden, og skabte således en detaljeret kort over, hvordan hænderne bevæger sig og danner forskellige tegn.

Dr. Bader Alsharif, der ledede denne forskning som ph.d.-stipendiat, forklarer: “Denne metode er ikke blevet udforsket i tidligere forskning, hvilket gør den til en ny og lovende retning for fremtidige fremskridt.”

Nedbrydning af teknologien

Lad os dykke ned i kombinationen af teknologier, der gør dette tegnsprogs-genkendelsessystem til at fungere.

MediaPipe og YOLOv8

Magien sker gennem den ubesværet integration af to kraftfulde værktøjer: MediaPipe og YOLOv8. Tænk på MediaPipe som en ekspert hånd-iagttagelse – en dygtig tegnsprogs-tolk, der kan spore hver subtil fingerbevægelse og håndposition. Forskningsholdet valgte MediaPipe specifikt for dets enestående evne til at give præcis hånd-landmærke-sporing, og identificere 21 præcise punkter på hver hånd, som vi nævnte ovenfor.

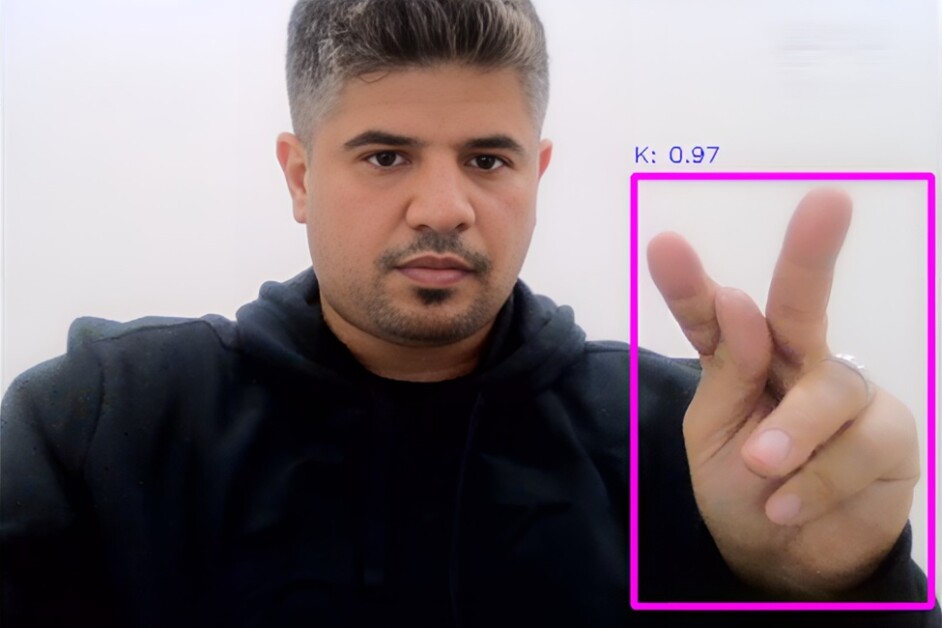

Men sporingsfunktionen er ikke nok – vi har brug for at forstå, hvad disse bevægelser betyder. Det er, hvor YOLOv8 kommer ind i billedet. YOLOv8 er en mønster-genkendelses-ekspert, der tager alle disse sporingspunkter og finder ud af, hvilken bogstav eller gestus de repræsenterer. Forskningen viser, at når YOLOv8 behandler et billede, deler det det ind i en S × S-grid, hvor hvert grid-celle er ansvarlig for at detektere objekter (i dette tilfælde håndgestus) inden for dens grænser.

Alsharif et al., Franklin Open (2024)

Hvordan systemet faktisk fungerer

Processen er mere sofistikeret, end det måske ser ud på første hånd.

Her er, hvad der sker bag kulisserne:

Hånd-detektions-stadiet

Når du laver en gestus, identificerer MediaPipe først din hånd i billedrammen og kortlægger de 21 nøglepunkter. Disse er ikke bare tilfældige punkter – de svarer til bestemte ledd og landmærker på din hånd, fra fingertoppe til håndflade.

Rumlig analyse

YOLOv8 tager herefter denne information og analyserer den i realtid. For hvert grid-celle i billedet, forudser det:

- Sandsynligheden for, at en håndgestus er til stede

- De præcise koordinater for gestusens placering

- En tillids-score for dens forudsigelse

Klassificering

Systemet bruger noget, der kaldes “bounding box-forudsigelse” – forestil dig at tegne en perfekt rektangel omkring din håndgestus. YOLOv8 beregner fem afgørende værdier for hver box: x- og y-koordinater for centrum, bredde, højde og en tillids-score.

Alsharif et al., Franklin Open (2024)

Hvorfor denne kombination fungerer så godt

Forskningsholdet opdagede, at ved at kombinere disse teknologier, skabte de noget, der er større end summen af dets dele. MediaPipes præcise sporingsfunktion kombineret med YOLOv8s avancerede objektdetektion producerede bemærkelsesværdigt præcise resultater – vi taler om en 98% præcision og en 99% F1-score.

Det, der gør dette særligt imponerende, er, hvordan systemet håndterer kompleksiteten af tegnsprog. Nogle tegn kan se meget ens ud for uøvede øjne, men systemet kan spotte subtile forskelle.

Rekord-brækkende resultater

Når forskere udvikler nye teknologier, er den store spørgsmål altid: “Hvor godt fungerer det i virkeligheden?” For dette tegnsprogs-genkendelsessystem er resultaterne imponerende.

Holdet på FAU satte deres system igennem omfattende test, og her er, hvad de fandt:

- Systemet korrekt identificerer tegn 98% af tiden

- Det fanger 98% af alle tegn, der laves foran det

- Den samlede performancescore rammer en imponerende 99%

“Resultaterne fra vores forskning demonstrerer vores models evne til at nøjagtigt detektere og klassificere Amerikansk Tegnsprog-gestus med meget få fejl,” forklarer Alsharif.

Systemet fungerer godt i hverdags-situationer – forskellig belysning, forskellige håndpositioner og endda med forskellige personer, der tegner.

Denne gennembrud skyder grænserne for, hvad der er muligt i tegnsprogs-genkendelse. Tidligere systemer har kæmpet med nøjagtighed, men ved at kombinere MediaPipes hånd-sporingsfunktion med YOLOv8s detektions-funktioner, skabte forskningsholdet noget særligt.

“Denne models succes skyldes i høj grad den omhyggelige integration af overført læring, omhyggelig dataset-opbygning og præcis finjustering,” siger Mohammad Ilyas, en af studiets medforfattere. Denne opmærksomhed på detaljer betalte sig i systemets bemærkelsesværdige præstation.

Hvad dette betyder for kommunikation

Denne systems succes åbner op for spændende muligheder for at gøre kommunikation mere tilgængelig og inklusiv.

Holdet stopper ikke ved at genkende bogstaver. Den næste store udfordring er at lære systemet at forstå en endnu bredere vifte af håndformer og gestus. Tænk på de øjeblikke, hvor tegn ser næsten identiske ud – som bogstaverne ‘M’ og ‘N’ i tegnsprog. Forskerne arbejder på at hjælpe deres system med at fange disse subtile forskelle endnu bedre. Som Dr. Alsharif siger: “Vigtigt, resultaterne fra denne studie understreger ikke kun systemets robusthed, men også dets potentiale til at blive brugt i praktiske, real-tids-applikationer.”

Holdet fokuserer nu på:

- At få systemet til at fungere jævnt på almindelige enheder

- At gøre det hurtigt nok til virkelige samtaler

- At sikre, at det fungerer pålideligt i enhver miljø

Dekan Stella Batalama fra FAU’s College of Engineering and Computer Science deler den større vision: “Ved at forbedre Amerikansk Tegnsprog-genkendelse, bidrager dette arbejde til at skabe værktøjer, der kan forbedre kommunikation for døve og hørehæmmede.”

Forestil dig at gå ind i en læges kontor eller deltage i en klasse, hvor denne teknologi broer kommunikationskløfterne øjeblikkeligt. Det er det virkelige mål her – at skabe teknologi, der faktisk hjælper mennesker med at forbinde sig. Uanset om det er i uddannelse, sundhedspleje eller hverdags-samtaler, repræsenterer dette system et skridt mod en verden, hvor kommunikationsbarrierer bliver mindre og mindre.