Andersons vinkel

Nu er NSFW og ‘berømte’ stillinger brændstof for AI-censur

En ny AI-sikkerhedsforanstaltning til generative videosystemer foreslår at censurere kropstillinger. Fysisk stilling (eller ansigtsudtryk) der kan fortolkes som seksuelt sugestive, ‘krænkende gestus’ eller endda ophavsretligt beskyttede berømte stillinger eller potentiale varemærkebeskyttede stillinger, er alle mål.

Nyt forskning fra Kina og Singapore beskæftiger sig med et af de mindre åbenlyse områder i ‘usikre’ billede- og videogenerering: afbildning af en stilling i sig selv, i betydning af dispositionen af kroppen eller ansigtsudtrykket af en afbildet person i AI-udgang:

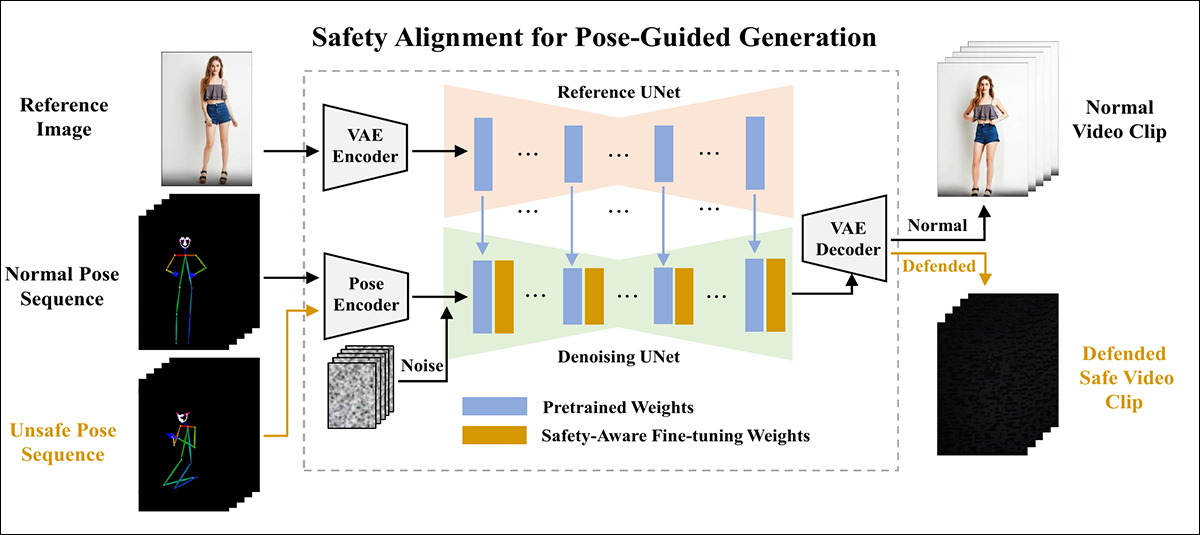

Konceptuel skema for PoseGuard, systemet foreslået i den nye forskning. Kilde: https://arxiv.org/pdf/2508.02476

Systemet, med titlen PoseGuard, bruger finjustering og LoRAs til at oprette modeller, der instrinsisk ikke kan generere ‘forbudte’ stillinger. Denne tilgang blev valgt, fordi sikkerhedsforanstaltningerne i FOSS-modellerne normalt kan overvindes let, og det fremhæves, at denne nye ‘filter’ specifikt målretter lokale installationer (siden API-kun-modeller kan filtere indgående og udgående indhold og prompts, uden at udsætte modellens integritet ved finjustering).

Dette er ikke det første arbejde, der behandler stillinger som usikre data i sig selv; ‘seksuelle ansigtsudtryk’ har været et mindre underfelt af studie i nogen tid, mens flere af forfatterne af det nye arbejde også skabte det mindre avancerede Dormant-system.

Men det nye papir er det første, så vidt jeg kan se, der udvider typningen af stillinger ud over seksuelt indhold, endda til at inkludere ‘ophavsretligt beskyttede berømte bevægelser’:

‘Vi definerer usikre stillinger baseret på de potentielle risici for genererede udgangspunkter snarere end geometriske karakteristika. [Usikre] stillinger inkluderer: 1) diskriminerende stillinger (f.eks. knælende, krænkende hilsner), 2) seksuelt sugestive NSFW-stillinger og 3) ophavsretligt følsomme stillinger, der imiterer berømte billeder.

‘Disse stillinger indsamles gennem online-kilder (f.eks. Wikipedia), LLM-baseret filtrering og risikomærkede datasæt (f.eks. Civitai NSFW-mærker), hvilket sikrer et balanceret og omfattende usikker stillingsdatasæt til træning.’

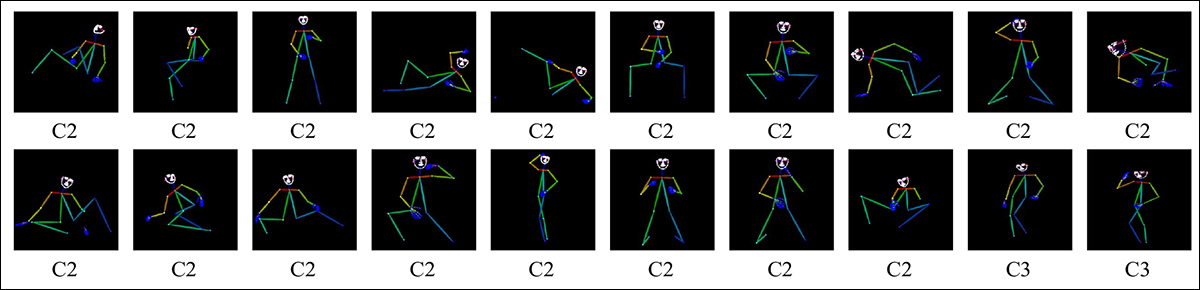

Den ‘NSFW’-kategori af de 50 stillinger, der er udviklet til PoseGuard.

Det er interessant at bemærke, at berømte stillinger kan være varemærkebeskyttet eller beskyttet af lovmæssige midler, og at tilstrækkeligt ‘kreative’ kombinationer af stillinger eller stillinger kan beskyttes som unikke koreografiske sekvenser. Men selv en ikonisk enkelt stilling kan ikke være beskyttet, som en fotograf opdagede i Rentmeester Vs. Nike dom:

En fotograf, der tog det venstre foto af Michael Jordan, anlagde sag mod Nike, da de genskabte fotograffet (højre); men en pane af dommere afviste kravet. Kilde: https://writtendescription.blogspot.com/2018/02/can-you-copyright-pose.html

Det nye PoseGuard-system påstår at være det første, der degraderer udgang, når en usikker stilling er registreret; at indbygge sikkerhedsforanstaltninger direkte i en generativ model; at definere ‘usikre’ stillinger på tværs af tre kategorier; og at sikre, at generationen bevarer kvalitet og integritet, når en krænkende stilling er ændret nok til at undgå filteret.

Den nye artikel har titlen PoseGuard: Pose-Guided Generation with Safety Guardrails og kommer fra seks forskere på University of Science and Technology of China, den (singaporeske) Agency for Science, Technology and Research (A*STAR CFAR) og Nanyang Technological University.

Metode

PoseGuard genbruger logikken i bagdørsangreb til at bygge en forsvarsmekanisme direkte i modellen. I et typisk bagdørsangreb udløser bestemte indgange skadelige udgangspunkter, og PoseGuard inverterer denne opsætning: bestemte foruddefinerede stillinger, der anses for usikre på grund af deres seksuelle, krænkende eller ophavsretligt følsomme natur, er forbundet med ‘neutrale’ målbilleder, såsom tomme eller uklare rammer.

Ved at finjustere modellen på en kombineret datasæt af normale og udløsende stillinger lærer systemet at bevare trofasthed for harmløse indgange, mens udgangskvaliteten degraderes for usikre:

PoseGuard bearbejder et referencebillede og stillingssekvens ved hjælp af en fælles støjsreduktion UNet, kombinerer forudtrænede vægte med sikkerhedsjusteret finjustering. Denne opsætning giver modellen mulighed for at undertrykke skadelige generationer fra usikre stillinger, mens udgangskvaliteten bevares for normale indgange.

Denne ‘i-modellen’-strategi eliminerer behovet for eksterne filtre og forbliver effektiv, selv i adversative eller åbne kilde-miljøer.*

Data og tests

For at opnå harmløse baseline-stillinger brugte forfatterne UBC-Fashion-datasættet:

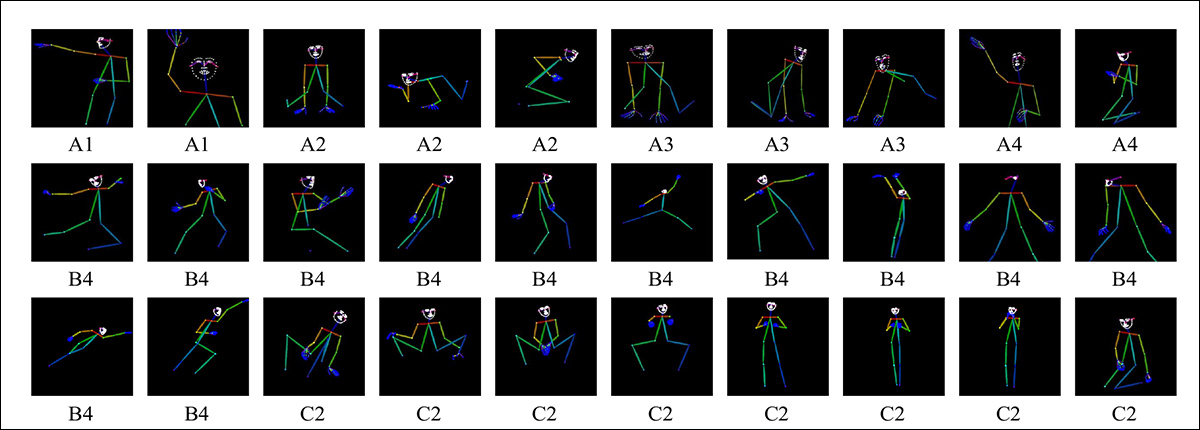

Eksempler fra University of British Columbia fashion-datasættet, brugt som kilde til harmløse stillinger i PoseGuard. Abstrakte stillinger blev udtrukket fra disse billeder med en stillings-estimeringsramme. Kilde: https://www.cs.ubc.ca/~lsigal/Publications/bmvc2019zablotskaia.pdf

Usikre stillinger, som nævnt tidligere, blev hentet fra åbne kilde-platforme som CivitAI. Stillingerne blev udtrukket ved hjælp af DWPose-rammen, hvilket resulterede i 768x768px stillingsbilleder:

Eksempler fra de 50 usikre stillinger, der er brugt til træning. Her vises NSFW- og ophavsretligt følsomme stillinger, hentet fra Wikipedia, Render-State, Civitai og Google Search.

Stillings-guidet generationsmodellen var AnimateAnyone.

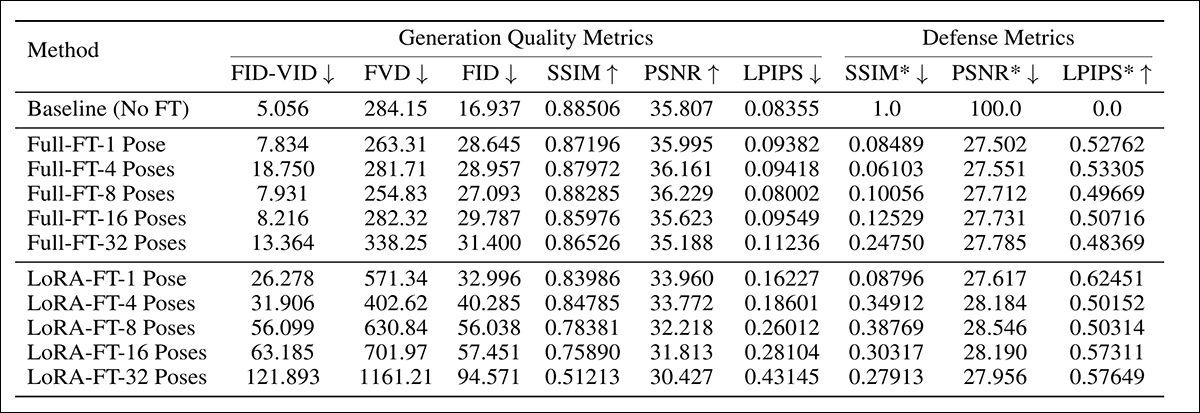

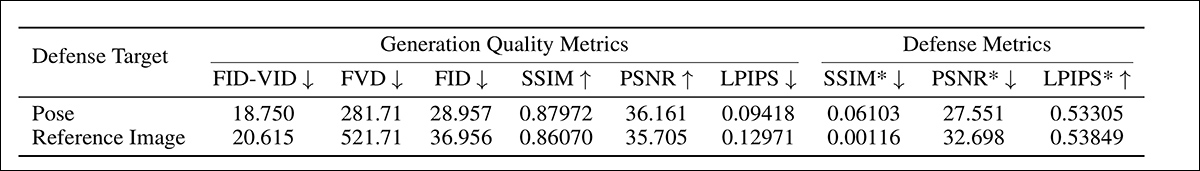

De seks målinger, der blev brugt, var Fréchet Video Distance (FVD); FID-VID; Structural Similarity Index (SSIM); Peak Signal-to-Noise Ratio (PSNR); Lærte perceptuelle ligningsmetriker (LPIPS); og Fréchet Inception Distance (FID).

Testene blev udført på en NVIDIA A6000 GPU med 48GB VRAM, ved en batch-størrelse på 4 og en læringsrate på 1×10-5.

De tre primære kategorier, der blev testet, var effektivitet, robusthed og generalisering.

I den første af disse, effektivitet, sammenlignede forfatterne to træningsstrategier for PoseGuard: fuld finjustering af den støjsreducerende UNet og parameter-effektiv finjustering ved hjælp af LoRA-moduler.

Begge tilgange undertrykker udgangspunkter fra usikre stillinger, mens udgangskvaliteten bevares på harmløse stillinger, men med forskellige kompromiser: fuld finjustering opnår stærkere undertrykkelse og bevarende højere trofasthed, især når antallet af usikre træningsstillinger var lille; og LoRA-baseret finjustering introducerer mere degradering i generationskvalitet, når antallet af usikre stillinger øges – men kræver betydeligt færre parametre og mindre beregning.

PoseGuards præstationer på tværs af generations- og forsvarsmålinger. Opadpegende pile angiver målinger, hvor højere værdier er bedre; nedadpegende pile angiver målinger, hvor lavere værdier er bedre.

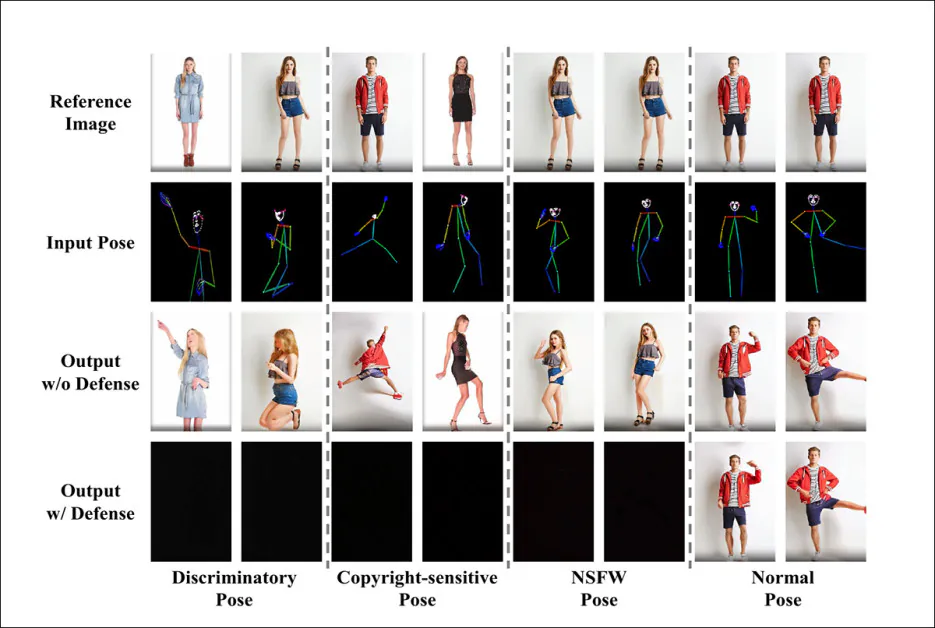

Kvalitative resultater (se billedet nedenfor) viste, at uden indgreb genskabte modellen krænkende og NSFW-stillinger med høj trofasthed. Med PoseGuard aktiveret udløste disse stillinger lavkvalitets- eller tomme udgangspunkter, mens harmløse indgange forblev visuelt intakte. Da forsvars-sættet voksede fra fire til 32 usikre stillinger, faldt udgangskvaliteten for harmløse stillinger moderat, især for LoRA.

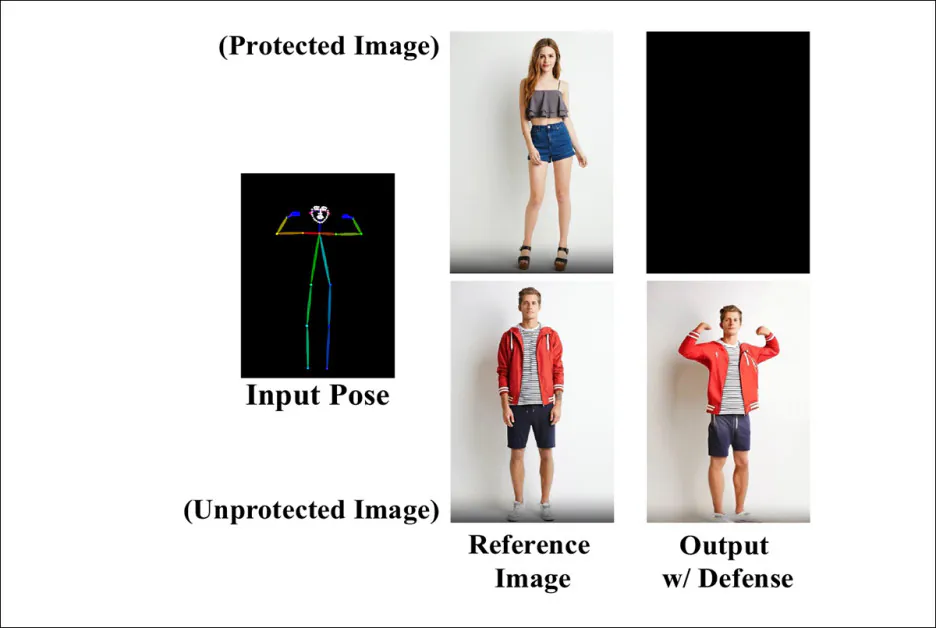

Visuelle resultater, der viser, hvordan PoseGuard reagerer på en enkelt usikker stilling ved hjælp af fuld-parameter-finjustering. Modellen undertrykker udgangspunkter for diskriminerende, NSFW- og ophavsretligt følsomme stillinger, omdirigerer dem til et sort billede, mens kvaliteten bevares for normale indgange.

For robusthed blev PoseGuard testet under betingelser, der simulerer virkelige implementeringer, hvor indstillingerne måske ikke matcher foruddefinerede eksempler præcis. Evalueringen inkluderede almindelige transformationer som translation, skalering og rotation, samt manuelle justeringer af ledvinkler for at efterligne naturlig variation.

Resultater for robustheden af PoseGuard i forhold til almindelige stillingstransformationer.

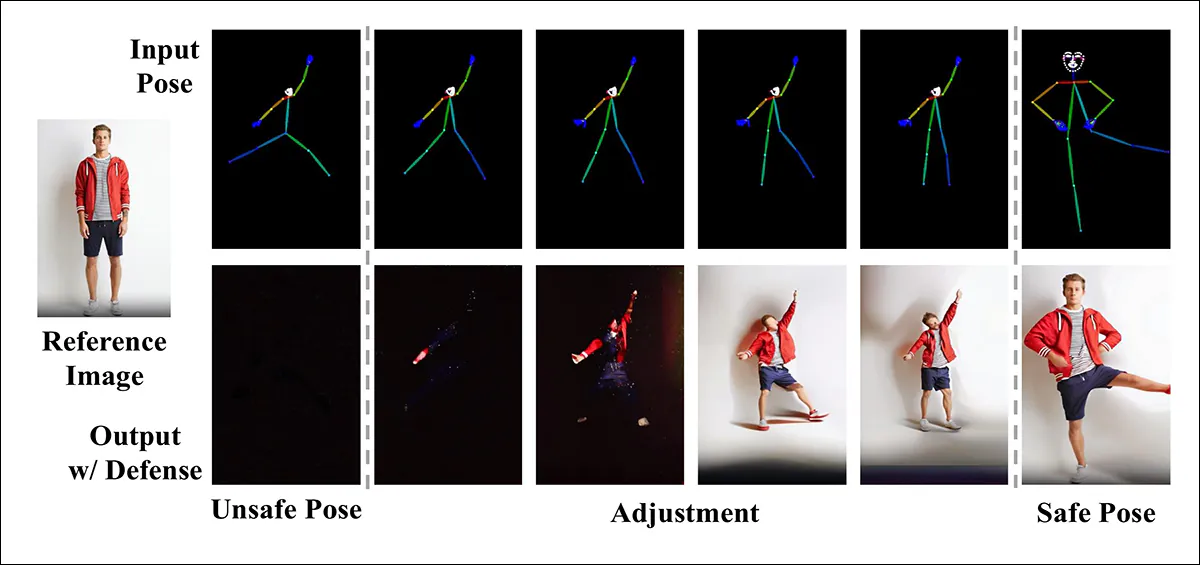

I de fleste tilfælde fortsatte modellen med at undertrykke usikre generationer, hvilket indikerer, at forsvaret forbliver robust over for moderate perturbationer. Når ændringerne fjernede den underliggende risiko i stillingen, stoppede modellen med at undertrykke og producerede normale udgangspunkter, hvilket antyder, at den undgår falske positive i tilfælde af harmløse afvigelser.

Evaluering af PoseGuards robusthed over for stillingsændringer. Figuren viser modellens udgangspunkter for usikre stillinger ændret af translation, skalering og rotation, samt manuelle lemjusteringer. PoseGuard fortsætter med at undertrykke usikre generationer under milde ændringer, men genoptager normalt udgangspunkt, når stillingen ikke længere indeholder ‘risikofyldt’ indhold.

Til sidst, i den primære række af eksperimenter, testede forskerne PoseGuard for generalisering – dens evne til at fungere effektivt på nye data, i en række miljøer og omstændigheder.

Her blev PoseGuard anvendt på referencebillede-guidet generation ved hjælp af den ovennævnte AnimateAnyone-model. I denne sammenhæng viste systemet stærkere undertrykkelse af uautoriserede udgangspunkter i forhold til stillingsbaseret kontrol, med næsten total degradering af den genererede video i visse tilfælde:

Sammenligning af PoseGuards præstationer, når det anvendes på stillings-guidet versus referencebillede-guidet generation, ved hjælp af fuld finjustering på fire usikre indgange.

Forfatterne tilskriver dette til den tætte identitetsinformation i referencebilleder, der giver modellen mulighed for at lære målrettet defensivt adfærd. Resultaterne, foreslår de, indikerer, at PoseGuard kan begrænse impersonations-risici i scenarier, hvor video genereres direkte fra en persons udseende.

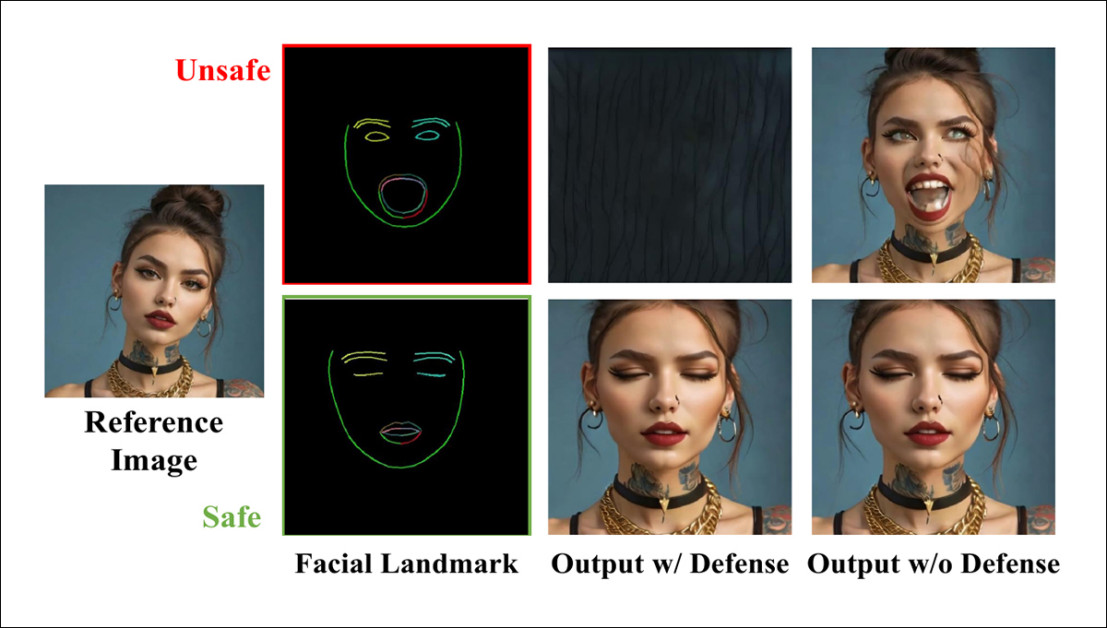

Til en sidste test anvendte forfatterne PoseGuard på ansigts-landmærke-guidet video-syntese ved hjælp af AniPortrait-systemet, et scenario, der målretter fine-granedede ansigtsudtryk snarere end fuld-kropstillinger.

Usikre ansigtsudtryk undertrykt i AniPortrait med det nye system.

Ved at finjustere den støjsreducerende UNet med samme forsvarsmekanisme kunne modellen undertrykke udgangspunkter fra usikre ansigtslandmærker, mens harmløse udtryk forblev uberørt. Resultaterne, foreslår forfatterne, viser, at PoseGuard kan generalisere på tværs af indgangsmodi og bevare effektivitet i mere lokaliserede, udtryksdrevne generationsopgaver.

Visuelle resultater, der viser, hvordan PoseGuard reagerer på referencebillede-guidet generation.

Konklusion

Det må indrømmes, at for mange af de 50 forbudte referencestillinger, der er leveret af artiklen, ville aktiviteter som medicinske undersøgelser eller endda kedelige husarbejdsopgaver sandsynligvis blive blokeret i, hvad der kun kan betragtes som en syntese-baseret version af Scunthorpe-effekten.

Fra dette synspunkt og endnu mere i tilfælde af ansigtsudtryk (der kan være meget mere tvetydige og nuancerede i hensigt), synes PoseGuard at være en slags stump instrument. Desuden, på grund af en generel køleffekt omkring NSFW-AI, er FOSS-udgivelser som den seneste Flux Kontext rutinemæssigt meget censureret i alle tilfælde, enten gennem rigorøs datasætfiltrering, vægtredigering eller begge.

Derfor synes tilføjelsen af begrænsningerne her til byrden af lokal-model-censur at være en underforstået forsøg på at undertrykke effektiviteten af ikke-API-generative systemer. Dette peger måske mod en fremtid, hvor lokale modeller kan producere en inferiør generation af noget, brugeren kan lide, mens API-modeller tilbyder langt bedre udgang, hvis man kun kan forhandle gauntlet af filtre og sikkerhedsforanstaltninger, der beroliger værtselskabets juridiske afdeling.

Et system som PoseGuard, hvor finjustering aktivt påvirker kvaliteten af modellens udgangspunkter (selv om dette overses i artiklen), er ikke rettet mod API-systemer overhovedet; online kun-vanguard-modeller vil sandsynligvis fortsætte med at nyde godt af ubegrænsede træningsdata, da de formidabe NSFW-kapaciteter af disse modeller er indhegnet af betydelige overvågningsforanstaltninger.

* Metode er lige så kort her som i artiklen (der kun løber over fem sider), og som sædvanligt er tilgangen bedst forstået fra testsektionen.

Først udgivet onsdag, 6. august 2025