Andersons vinkel

‘Beskyttede’ billeder er nemmere, ikke sværere, at stjæle med AI

Nyt forskning antyder, at vandmærkningsværktøjer, der er designet til at blokere AI-billede-redigering, kan have den modsatte effekt. I stedet for at stoppe modeller som Stable Diffusion fra at lave ændringer, kan visse beskyttelser faktisk hjælpe AI’en med at følge redigeringsprompterne mere nøjagtigt, hvilket gør uønskede manipulationer endnu lettere.

Der er en bemærkelsesværdig og robust tråd i computer vision-litteraturen, der er dedikeret til at beskytte ophavsretsbilleder mod at blive trænet i AI-modeller eller brugt i direkte billed-til-billed AI-processer. Systemer af denne type er generelt rettet mod Latent Diffusion Models (LDMs) som Stable Diffusion og Flux, der bruger støj-baserede procedurer til at kode og afkode billeder.

Ved at indsætte adversarial støj i ellers normale billeder, kan det være muligt at få billed-detektorer til at gætte billedindhold forkert, og hindre billed-genererings-systemer i at udnytte ophavsretsbilleder:

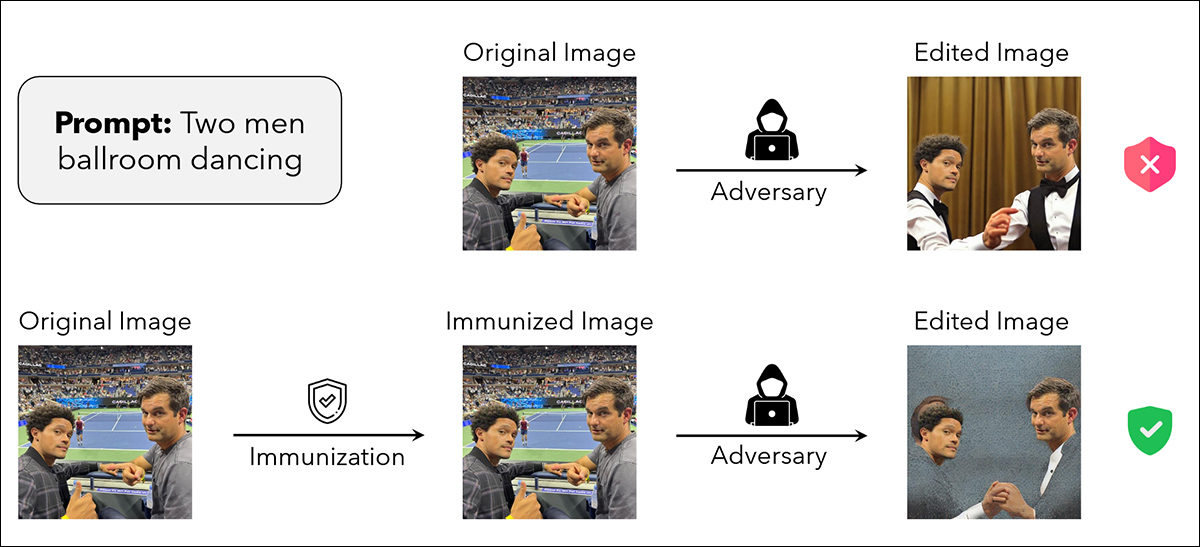

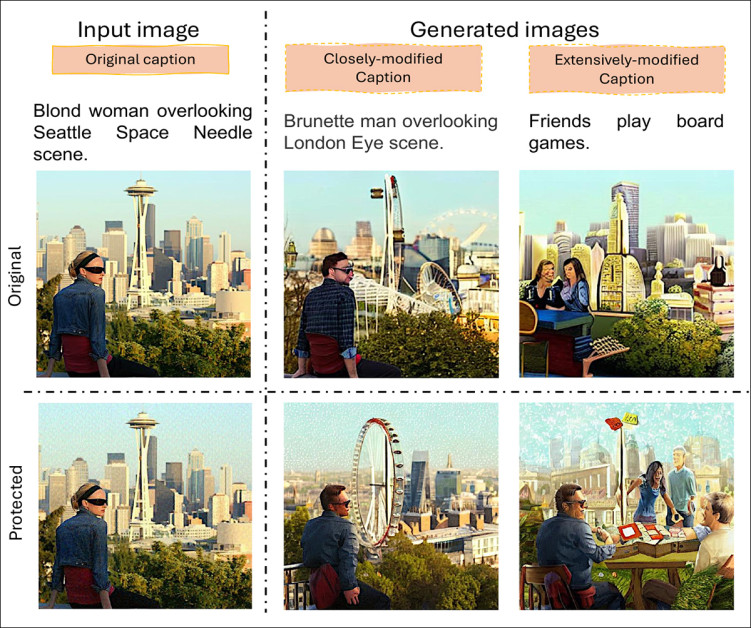

Fra MIT-papiret ‘Raising the Cost of Malicious AI-Powered Image Editing’, eksempler på en kilde-billede ‘immuniseret’ mod manipulation (nederste række). Kilde: https://arxiv.org/pdf/2302.06588

Siden kunstneres backlash mod Stable Diffusions liberale brug af web-skrapede billeder (herunder ophavsretsbilleder) i 2023, har forskningsscenen produceret multiple variationer over det samme tema – idéen om, at billeder kan være usynligt ‘forgiftet’ mod at blive trænet i AI-systemer eller sugt ind i generative AI-rørledninger, uden at påvirke billedkvaliteten for den gennemsnitlige bruger.

I alle tilfælde er der en direkte korrelation mellem intensiteten af den pålagte perturbation, udstrækningen af hvilken billedet herefter er beskyttet, og udstrækningen af hvilken billedet ikke ser helt så godt ud, som det burde:

Selv om kvaliteten af forsknings-PDF’en ikke helt illustrerer problemet, ofrer større mængder af adversarial perturbation kvalitet for sikkerhed. Her ser vi spændet af kvalitetsforstyrrelser i 2020 ‘Fawkes’-projektet ledet af University of Chicago. Kilde: https://arxiv.org/pdf/2002.08327

Af særlig interesse for kunstnere, der søger at beskytte deres stile mod uautoriseret tilpasning, er kapaciteten af sådanne systemer ikke kun til at camouflage identitet og anden information, men til at ‘overbevise’ en AI-træningsproces om, at det ser noget andet end det faktisk ser, sådan at forbindelser ikke danner mellem semantiske og visuelle domæner for ‘beskyttet’ træningsdata (dvs. en prompt som ‘I stil med Paul Klee’).

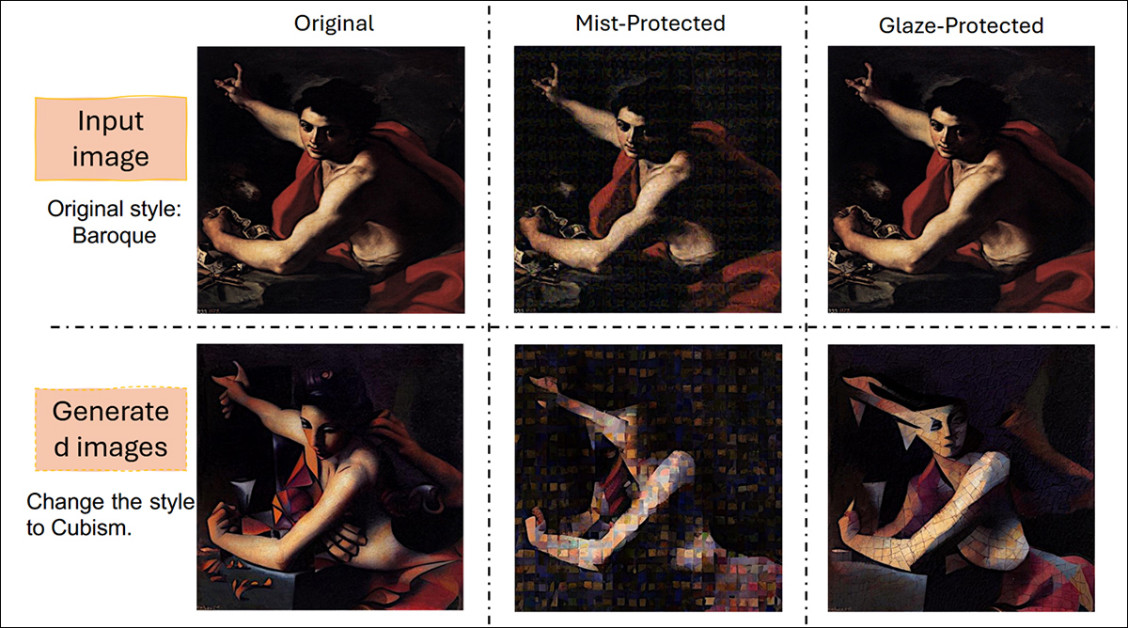

Mist og Glaze er to populære injektionsmetoder, der kan forhindre eller i hvert fald alvorligt hæmme forsøg på at bruge ophavsretsstile i AI-arbejdsgange og træningsrutiner. Kilde: https://arxiv.org/pdf/2506.04394

Egen Mål

Nu har ny forskning fra USA fundet ud af, at perturbationer ikke kun kan fejle i at beskytte et billede, men at tilføje perturbation kan faktisk forbedre billedets udnytbarhed i alle AI-processer, som perturbationen er designet til at immunisere imod.

Papiret siger:

‘I vores eksperimenter med forskellige perturbation-baserede billedbeskyttelsesmetoder på tværs af multiple domæner (natur-scene-billeder og kunstværker) og redigeringsopgaver (billede-til-billede-generering og stil-redigering), opdager vi, at sådan beskyttelse ikke opnår dette mål fuldstændigt.

‘I de fleste scenarier genererer diffusion-baseret redigering af beskyttede billeder en ønskværdig output-billede, der følger præcis guiden prompt.

‘Vore fund antyder, at tilføje støj til billeder kan paradoksalt øge deres association med givne tekstprompt under generationsprocessen, hvilket fører til uventede konsekvenser såsom bedre resultaterende redigeringer.

‘Derfor argumenterer vi for, at perturbation-baserede metoder måske ikke kan levere en tilstrækkelig løsning for robust billedbeskyttelse mod diffusion-baseret redigering.’

I tests blev de beskyttede billeder udsat for to velkendte AI-redigerings-scenarier: direkte billede-til-billede-generering og stil-overføring. Disse processer reflekterer de almindelige måder, hvorpå AI-modeller kan udnytte beskyttet indhold, enten ved direkte at ændre et billede eller ved at låne dets stilistiske træk til brug andre steder.

De beskyttede billeder, der blev hentet fra standardkilder af fotografi og kunstværker, blev kørt gennem disse rørledninger for at se, om de tilføgede perturbationer kunne blokere eller nedgrade redigeringerne.

I stedet syntes tilstedeværelsen af beskyttelse ofte at skærpe modellens alignment med prompterne, producerende rene, præcise outputs, hvor nogen fejl havde været forventet.

Forfatterne råder, i effekt, at denne meget populære metode til beskyttelse kan give en falsk fornemmelse af sikkerhed, og at enhver sådan perturbation-baseret immuniseringstilgang bør testes grundigt mod forfatternes egne metoder.

Metode

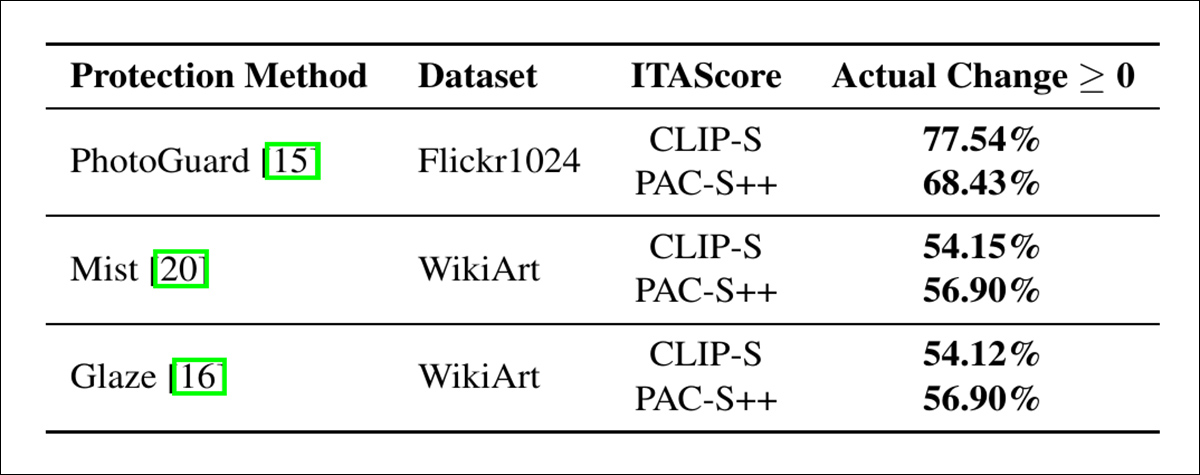

Forfatterne kørte eksperimenter med tre beskyttelsesmetoder, der anvender omhyggeligt designede adversarial perturbationer: PhotoGuard; Mist; og Glaze.

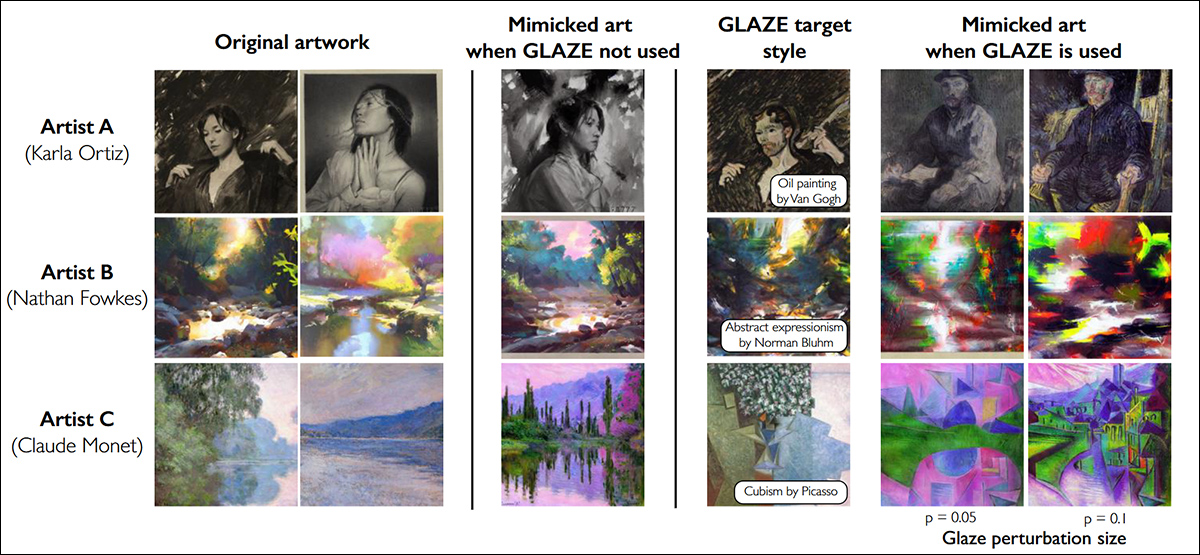

Glaze, en af de rammer, der blev testet af forfatterne, illustrerende Glaze-beskyttelseseksempler for tre kunstnere. De første to kolonner viser de originale kunstværker; den tredje kolonne viser mimicry-resultater uden beskyttelse; den fjerde kolonne viser stil-overførte versioner, der blev brugt til cloak-optimering, sammen med målstil-navnet. Den femte og sjette kolonne viser mimicry-resultater med cloaking anvendt ved perturbationsniveauer p = 0,05 og p = 0,1. Alle resultater bruger Stable Diffusion-modeller. https://arxiv.org/pdf/2302.04222

PhotoGuard blev anvendt på natur-scene-billeder, mens Mist og Glaze blev brugt på kunstværker (dvs. ‘kunstnerisk-stilede’ domæner).

Tests dækkede både natur- og kunst-billeder for at reflektere mulige real-verden-brug. Effektiviteten af hver metode blev vurderet ved at kontrollere, om en AI-model stadig kunne producere realistiske og prompt-relevante redigeringer, når den arbejdede med beskyttede billeder; hvis de resulterende billeder så ud som overbevisende og matchede prompterne, blev beskyttelsen vurderet til at have fejlet.

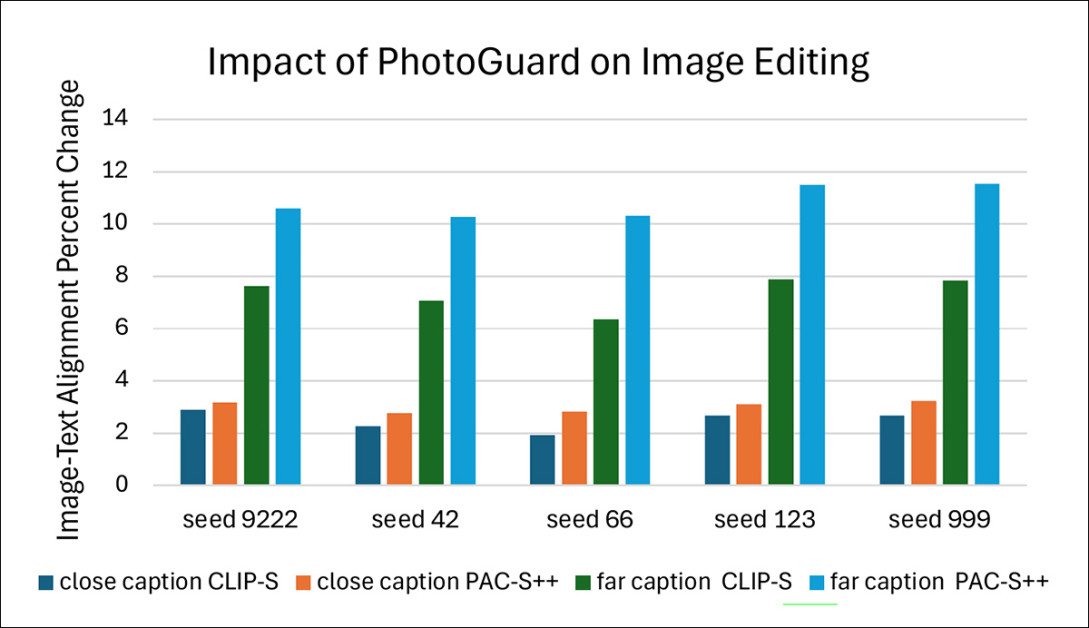

Stable Diffusion v1.5 blev brugt som den forudtrænede billed-genereringsmodel for forskernes redigeringsopgaver. Fem frø blev valgt for at sikre reproducerbarhed: 9222, 999, 123, 66 og 42. Alle andre generationsindstillinger, såsom guidance-skala, styrke og samlede trin, fulgte standardværdierne, der blev brugt i PhotoGuard-eksperimenterne.

PhotoGuard blev testet på natur-scene-billeder ved hjælp af Flickr8k-datasettet, der indeholder over 8.000 billeder parret med op til fem undertekster hver.

Modstridende Tanker

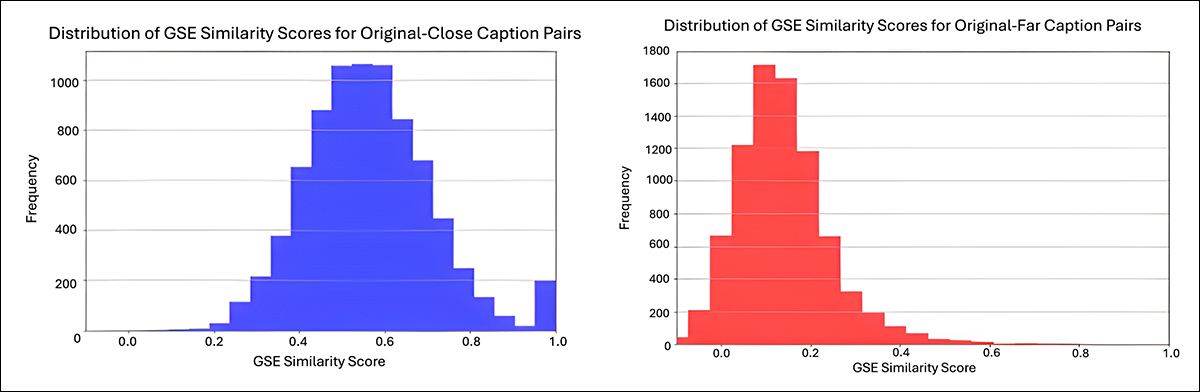

To sæt af modificerede undertekster blev oprettet fra den første undertekst af hvert billede med hjælp af Claude Sonnet 3.5. Et sæt indeholdt prompter, der var kontekstligt tæt på de originale undertekster; det andet sæt indeholdt prompter, der var kontekstligt fjernt.

For eksempel, fra den originale undertekst ‘En ung pige i en pink kjole går ind i en træhytte’, ville en tæt prompt være ‘En ung dreng i en blå skjorte går ind i en murstenshus’. Til gengæld ville en fjern prompt være ‘To katte, der ligger på en sofa’.

Tæt prompter blev konstrueret ved at erstatte navneord og tillægsord med semantisk lignende termer; fjerne prompter blev genereret ved at instruere modellen til at oprette undertekster, der var kontekstligt meget forskellige.

Alle genererede undertekster blev manuelt kontrolleret for kvalitet og semantisk relevans. Google’s Universal Sentence Encoder blev brugt til at beregne semantiske ligningskorer mellem de originale og modificerede undertekster:

Fra supplementær materiale, semantiske ligningsfordelinger for de modificerede undertekster, der blev brugt i Flickr8k-tests. Grafen til venstre viser ligningskorerne for tæt modificerede undertekster, der gennemsnitligt er omkring 0,6. Grafen til højre viser de omfattende modificerede undertekster, der gennemsnitligt er omkring 0,1, hvilket reflekterer en større semantisk afstand fra de originale undertekster. Værdierne blev beregnet ved hjælp af Google’s Universal Sentence Encoder. Kilde: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Hver billede, sammen med dets beskyttede version, blev redigeret ved hjælp af både tæt og fjern prompter. Den blinde/referenceløse billed-rumlige kvalitetsvurdering (BRISQUE) blev brugt til at vurdere billedkvalitet:

Billede-til-billede-genereringsresultater på naturfotografier beskyttet af PhotoGuard. Trods tilstedeværelsen af perturbationer, fulgte Stable Diffusion v1.5 erfolgreich både små og store semantiske ændringer i redigeringsprompterne, producerende realistiske outputs, der matchede de nye instruktioner.

Målinger

For at bedømme, hvor godt beskyttelserne forstyrrede AI-redigeringen, målte forskerne, hvor nøjagtigt de endelige billeder matchede instruktionerne, der blev givet, ved hjælp af vurderingssystemer, der sammenlignede billedindholdet med tekstprompten, for at se, hvor godt de matchede.

Til dette formål brugte CLIP-S-metoden en model, der kan forstå både billeder og tekst, for at kontrollere, hvor lignende de er, mens PAC-S++ tilføjede ekstra samples, der blev oprettet af AI, for at tilpasse sammenligningen mere nøjagtigt til en menneskelig vurdering.

Disse billed-tekst-alignment (ITA)-korer angiver, hvor nøjagtigt AI’en fulgte instruktionerne, når den redigerede et beskyttet billede: hvis et beskyttet billede stadig resulterede i en højtilignende output, betød det, at beskyttelsen var vurderet til at have fejlet i at blokere redigeringen.

Effekten af beskyttelse på Flickr8k-datasettet på tværs af fem frø, ved hjælp af både tæt og fjern prompter. Billede-tekst-alignment blev målt ved hjælp af CLIP-S- og PAC-S++-korer.

Forskerne sammenlignede, hvor godt AI’en fulgte prompter, når den redigerede beskyttede billeder sammenlignet med ubeskyttede billeder. De kontrollerede først forskellen mellem de to, kaldet Den faktiske ændring. Så blev forskellen skaleret for at oprette en Procent ændring, hvilket gjorde det lettere at sammenligne resultater på tværs af mange tests.

Dette afslørede, om beskyttelserne gjorde det sværere eller lettere for AI’en at matche prompterne. Testsene blev gentaget fem gange ved hjælp af forskellige tilfældige frø, der dækkede både små og store ændringer af de originale undertekster.

Kunst Angreb

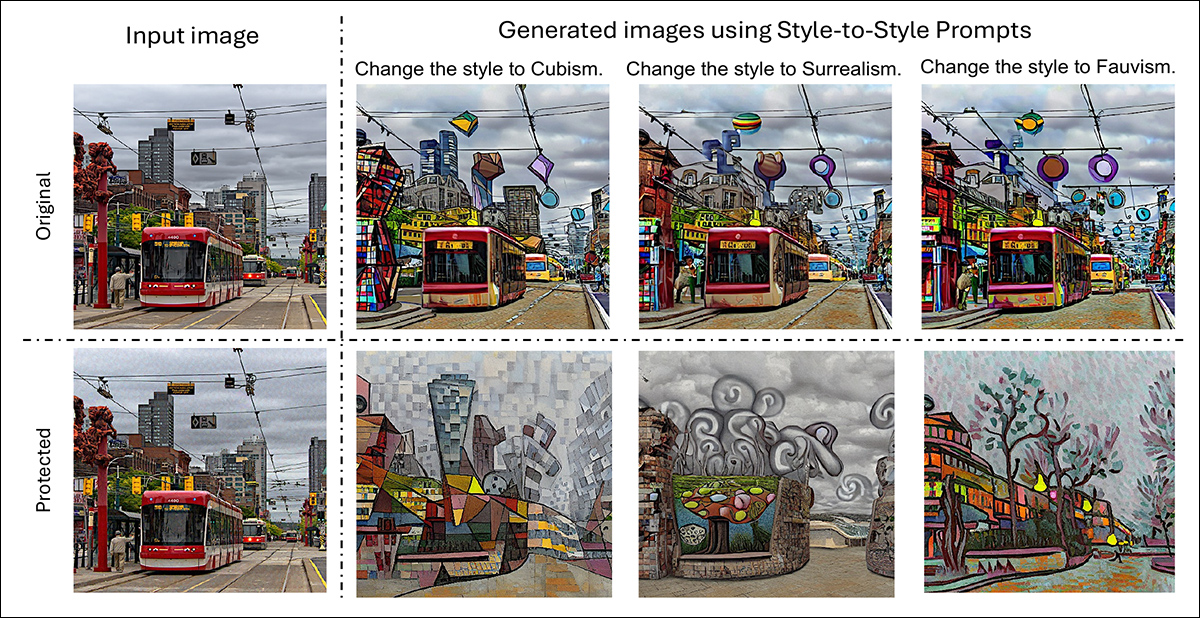

For tests på naturfotografier blev Flickr1024-datasettet brugt, der indeholder over 1.000 højkvalitetsbilleder. Hvert billede blev redigeret med prompter, der fulgte mønsteret: ‘Ændr stilen til [V]’, hvor [V] repræsenterede en af syv berømte kunststilarter: Kubisme; Post-Impressionisme; Impressionisme; Surrealisme; Barok; Fauvisme; og Renæssance.

Processen involverede at anvende PhotoGuard på de originale billeder, generere beskyttede versioner og derefter køre både beskyttede og ubeskyttede billeder gennem samme sæt af stil-overføring-redigeringer:

Originale og beskyttede versioner af et natur-scene-billede, hver redigeret for at anvende Kubisme, Surrealisme og Fauvisme-stilarter.

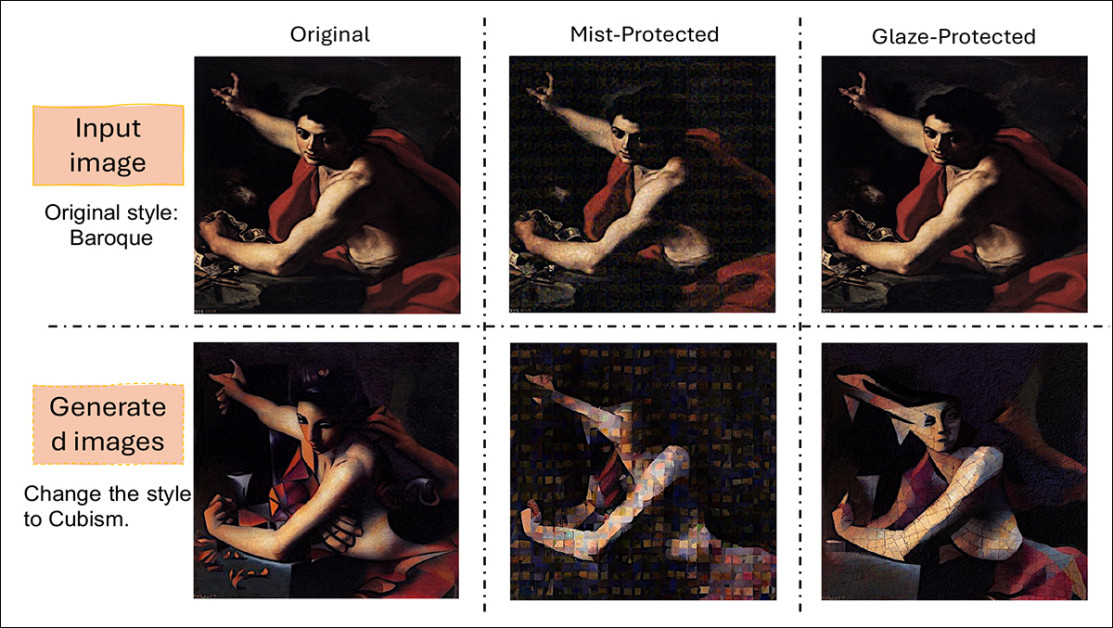

For at teste beskyttelsesmetoder på kunstværker blev stil-overføring udført på billeder fra WikiArt-datasettet, der kuraterer et bredt udvalg af kunststilarter. Redigeringsprompterne fulgte samme format som før, hvor AI’en blev instrueret til at ændre stilen til en tilfældigt valgt, ikke-relateret stil, der blev trukket fra WikiArt-mærkerne.

Både Glaze og Mist-beskyttelsesmetoder blev anvendt på billederne, før redigeringerne, hvilket tillod forskerne at observere, hvor godt hver forsvar kunne blokere eller forstyrre stil-overføring-resultaterne:

Eksempler på, hvordan beskyttelsesmetoder påvirker stil-overføring på kunstværker. Det originale Barok-billede vises sammen med versioner beskyttet af Mist og Glaze. Efter at have anvendt Kubisme-stil-overføring kan forskellene i, hvordan hver beskyttelse ændrer den endelige output, ses.

Forskerne testede sammenligningerne kvantitativt også:

Ændringer i billed-tekst-alignment-korer efter stil-overføring-redigeringer.

Af disse resultater kommenterer forfatterne:

‘Resultaterne fremhæver en betydelig begrænsning af adversarial perturbation til beskyttelse. I stedet for at forhindre alignment, forstærker adversarial perturbationer ofte generativ modells respons på prompter, utilsigtet tillader udnyttere at producere outputs, der matcher deres mål nærmere. Sådan beskyttelse er ikke disruptiv for billed-redigeringsprocessen og kan måske ikke forhindre ondsindede agenter i at kopiere ikke-autoriseret materiale.

‘De uventede konsekvenser af at bruge adversarial perturbation afslører sårbarheder i eksisterende metoder og understreger det presserende behov for mere effektive beskyttelsesmetoder.’

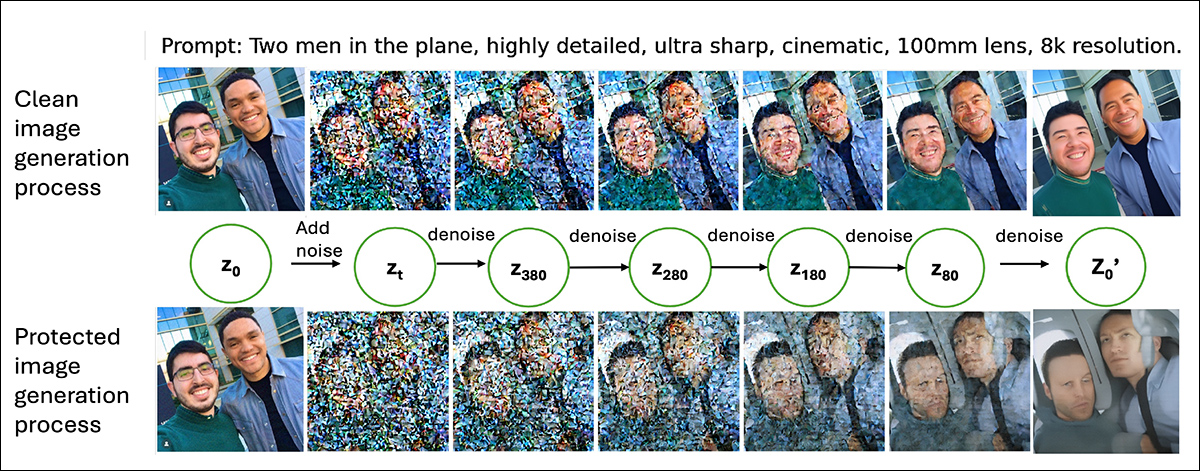

Forfatterne forklarer, at de uventede resultater kan tilskrives, hvordan diffusion-modeller fungerer: LDM’er redigerer billeder ved først at konvertere dem til en komprimeret version kaldet en latent; støj tilføjes derefter til denne latente gennem mange trin, indtil data bliver næsten tilfældigt.

Modellen omvender denne proces under generation, fjerner støjen trin for trin. Ved hvert trin i denne omvending hjælper tekstprompten med at vejlede, hvordan støjen skal fjernes, og former langsomt billedet til at matche prompten:

Sammenligning mellem generationer fra et ubeskyttet billede og et PhotoGuard-beskyttet billede, med mellem-lag-latente tilstande konverteret tilbage til billeder til visualisering.

Beskyttelsesmetoder tilføjer små mængder af ekstra støj til det originale billede, før det indgår i denne proces. Selv om disse perturbationer er små til at starte med, akkumulerer de, da modellen anvender sine egne lag af støj.

Dette bygning efterlader flere dele af billedet ‘usikre’, når modellen begynder at fjerne støj. Med større usikkerhed læner modellen mere tungt på tekstprompten for at udfylde de manglende detaljer, hvilket giver prompten endnu mere indflydelse, end den ellers ville have.

I effekt gør beskyttelserne det lettere for AI’en at omforme billedet til at matche prompten, i stedet for sværere.

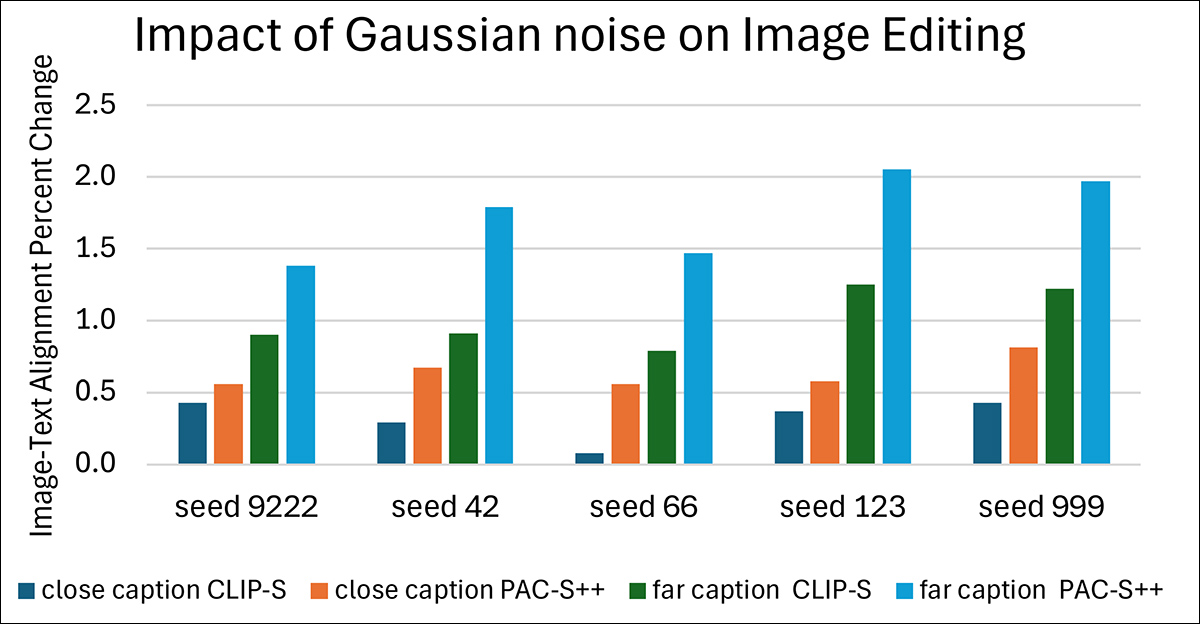

Til sidst udførte forfatterne en test, der erstattede tilrettelagte perturbationer fra Raising the Cost of Malicious AI-Powered Image Editing papir med ren Gaussisk støj.

Resultaterne fulgte samme mønster, der tidligere var observeret: på tværs af alle tests forblev Procent Ændring-værdierne positive. Selv denne tilfældige, ustrukturerede støj førte til stærkere alignment mellem de genererede billeder og prompterne.

Effekten af simuleret beskyttelse ved hjælp af Gaussisk støj på Flickr8k-datasettet.

Dette understøttede den underliggende forklaring, at enhver tilføjet støj, uanset dets design, skaber større usikkerhed for modellen under generation, hvilket tillader tekstprompten at udøve endnu mere kontrol over det endelige billede.

Konklusion

Forsknings-scenen har været ved at presse adversarial perturbation på LDM ophavsret-problemet, næsten så længe som LDM’er har eksisteret; men ingen robuste løsninger er dukket op fra det ekstraordinære antal artikler, der er blevet offentliggjort på dette spor.

Enten er de pålagte forstyrrelser for meget og sænker billedkvaliteten, eller mønstrene viser sig ikke at være robuste over for manipulation og transformative processer.

Men det er en hård drøm at opgive, da alternativet ville synes at være tredjeparts-overvågning og proveniens-rammer, såsom Adobe-ledede C2PA-scheme, der søger at opretholde en kæde af ejerskab for billeder fra kamera-sensoren og frem, men som ikke har nogen indre forbindelse med det afbildede indhold.

I hvert fald, hvis adversarial perturbation faktisk gør problemet værre, som det nye papir antyder, kan det være sandt i mange tilfælde, så man undrer sig, om søgningen efter ophavsret-beskyttelse via sådanne midler falder under ‘alkymi’.

Først offentliggjort mandag, 9. juni 2025