Kunstig intelligens

Neural Rendering: NeRF Takes a Walk in the Fresh Air

Et samarbejde mellem Google Research og Harvard University har udviklet en ny metode til at oprette 360-graders neurale video af komplette scener ved hjælp af Neural Radiance Fields (NeRF). Den nye tilgang bringer NeRF et skridt nærmere en casual abstrakt brug i enhver miljø, uden at være begrænset til tabletop-modeller eller lukkede indendørs-scenarier.

Se slutningen af artiklen for fuld video. Source: https://www.youtube.com/watch?v=YStDS2-Ln1s

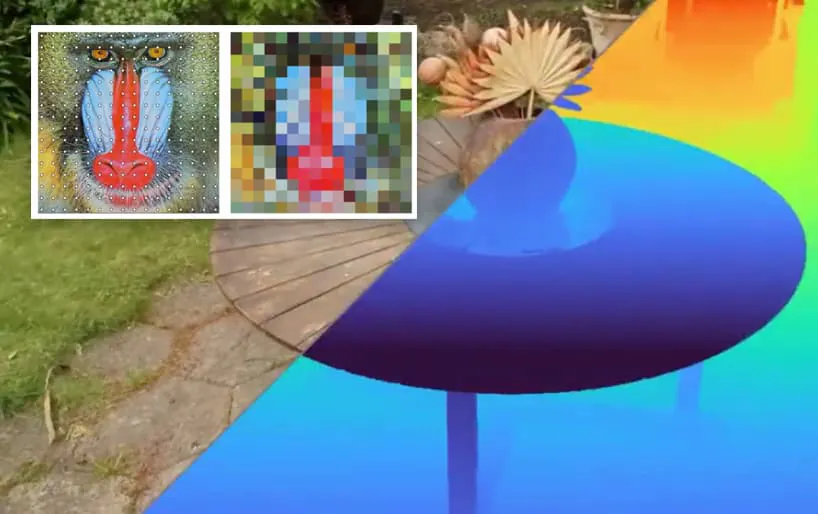

Mip-NeRF 360 kan håndtere udvidede baggrunde og ‘uendelige’ objekter som himlen, fordi den, i modsætning til de fleste tidligere iterationer, sætter grænser for, hvordan lysstråler fortolkes, og opretter grænser for opmærksomhed, der rationaliserer ellers lange træningstider. Se den nye tilhørende video, der er indlejret i slutningen af denne artikel, for flere eksempler og en udvidet indsigt i processen.

Den nye artikel hedder Mip-NeRF 360: Unbounded Anti-Aliased Neural Radiance Fields og er ledt af Senior Staff Research Scientist ved Google Research Jon Barron.

For at forstå gennembruddet er det nødvendigt at have en grundlæggende forståelse af, hvordan neurale radiance field-baseret billedsynthesis fungerer.

Hvad er NeRF?

Det er problematisk at beskrive et NeRF-netværk i termer af en ‘video’, da det er nærmere en fuldt 3D-realiseret, men AI-baseret virtuel miljø, hvor multiple synsvinkler fra enkeltfotos (herunder video-frames) bruges til at sy sammen en scene, der teknisk set kun eksisterer i den latente rum af en maskinelæringsalgoritme – men hvorfra en ekstraordinær mængde synsvinkler og videoer kan udtrækkes efter behov.

En afbildning af de multiple kamerafangningspunkter, der leverer data, som NeRF samler til en neural scene (billedet til højre).

Informationerne, der er afledt fra de bidragende fotos, trænes ind i en matrix, der ligner en traditionel voxel-grid i CGI-workflows, således at hver punkt i 3D-rummet ender med en værdi, der gør scenen navigabel.

En traditionel voxel-matrix placerer pixelinformation (der normalt eksisterer i en 2D-kontekst, såsom pixel-griden i en JPEG-fil) i et tredimensionelt rum. Source: ResearchGate

Efter beregning af det interstitielle rum mellem fotos (hvis nødvendigt), føres hver mulig pixels vej i hver bidragende foto effektivt ‘ray-tracet’ og tildeles en farvværdi, herunder en transparensværdi (uden hvilken den neurale matrix ville være helt uigennemsigtig eller helt tom).

Ligesom voxel-grids og til forskel fra CGI-baseret 3D-koordinatrum, har ‘interiøret’ af en ‘lukket’ genstand ingen eksistens i en NeRF-matrix. Du kan åbne en CGI-trommesæt og kigge indenfor, hvis du ønsker; men så langt NeRF er bekymret, ophører trommesættets eksistens, når overfladens opacitetsværdi er lig med ‘1’.

En bredere vinkel på en pixel

Mip-NeRF 360 er en udvidelse af forskning fra marts 2021, der effektivt introducerede effektiv anti-aliasing til NeRF uden udtømmende supersampling.

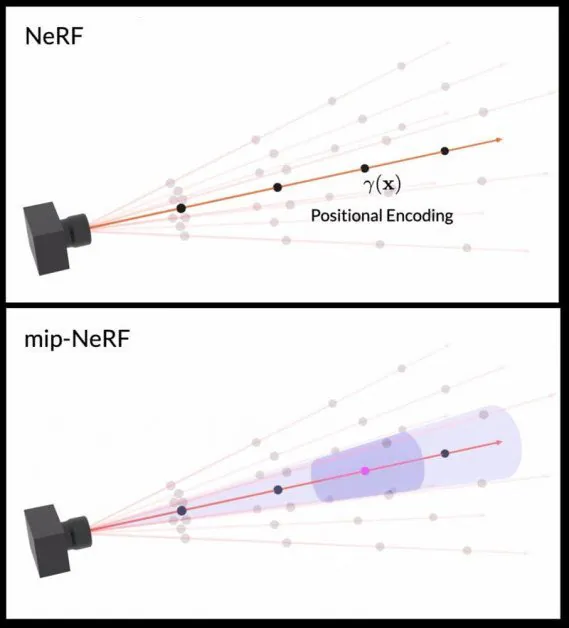

NeRF beregner traditionelt kun én pixels vej, der er tilbøjelig til at producere den type ‘jaggies’, der karakteriserede tidlige internetbilledeformater, såvel som tidligere spillesystemer. Disse hakketænder blev løst ved forskellige metoder, som regel ved at prøve adjacent pixels og finde en gennemsnitlig repræsentation.

Fordi traditionel NeRF kun prøver denne ene pixels vej, introducerede Mip-NeRF en ‘konisk’ catchment-område, som en bredstrålet lommelygte, der giver nok information om adjacent pixels til at producere økonomisk anti-aliasing med forbedret detalje.

Den koniske kegle-catchment, som Mip-NeRF bruger, er skåret op i koniske frustumer (nederste billede), der yderligere ‘blurrer’ for at repræsentere en vag Gaussian-rum, der kan bruges til at beregne en pixels nøjagtighed og aliasing. Source: https://www.youtube.com/watch?v=EpH175PY1A0

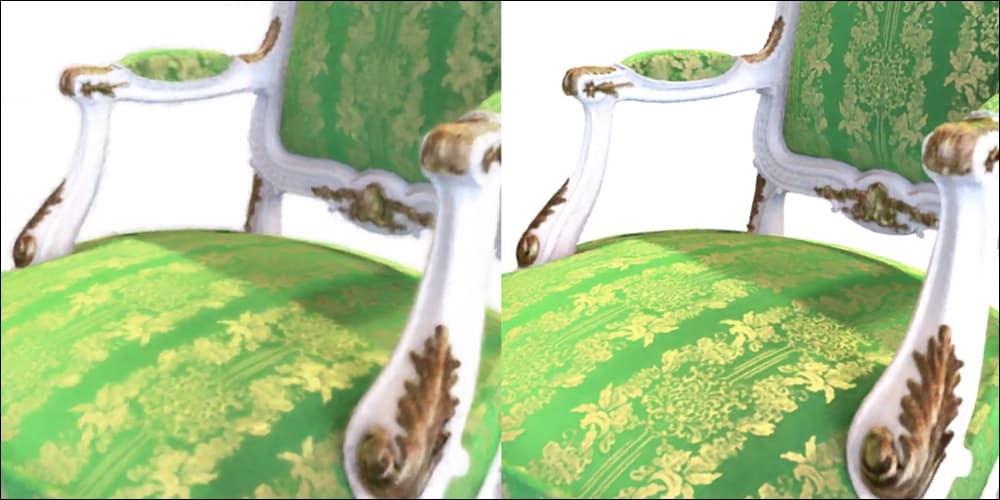

Forbedringen over en standard NeRF-implementation var bemærkelsesværdig:

Mip-NeRF (højre), udgivet i marts 2021, giver forbedret detalje gennem en mere omfattende, men økonomisk aliasing-pipeline, snarere end blot at ‘blurre’ pixels for at undgå hakketænder. Source: https://jonbarron.info/mipnerf/

NeRF Uendelig

Marts-artiklen efterlod tre problemer uløste i forhold til brug af Mip-NeRF i uendelige miljøer, der kan omfatte meget fjerne objekter, herunder himlen. Den nye artikel løser dette ved at anvende en Kalman-lignende warp til Mip-NeRF-Gaussians.

For det andet kræver større scener større proceskraft og længere træningstider, som Mip-NeRF 360 løser ved at ‘destillere’ scenens geometri med en lille ‘forslag’ multi-layer perceptron (MLP), der for-binder geometrien, der forudses af en stor standard NeRF-MLP. Dette accelererer træningen med en faktor på tre.

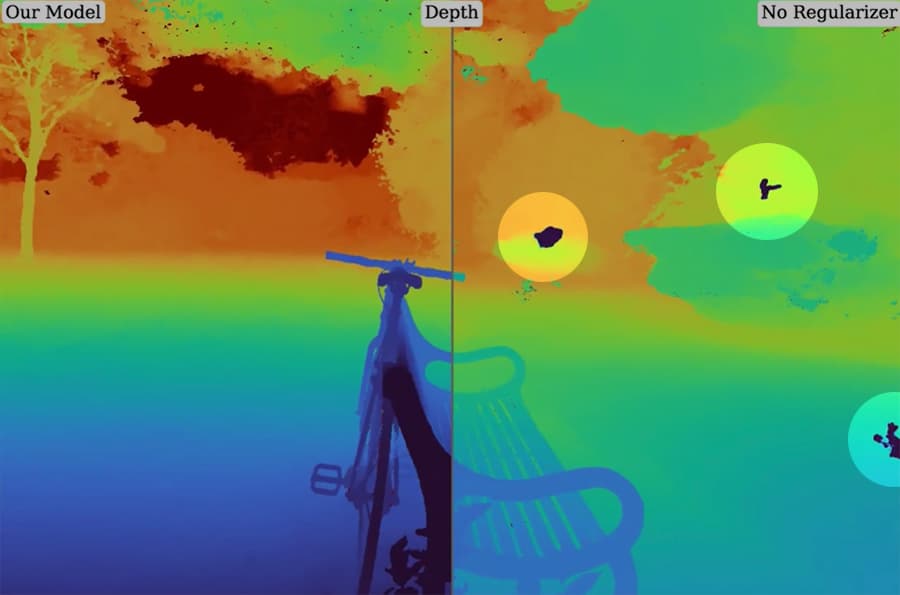

For det tredje har større scener tendens til at gøre diskretiseringen af den fortolkede geometri tvetydig, hvilket resulterer i den type artefakter, spillere kan være bekendt med, når spiloutput ‘rives’. Den nye artikel løser dette ved at oprette en ny regularisator for Mip-NeRF-ray-intervaller.

Til højre ser vi uønskede artefakter i Mip-NeRF på grund af vanskeligheden ved at afgrænse sådant et stort scene. Til venstre ser vi, at den nye regularisator har optimeret scenen tilstrækkeligt til at fjerne disse forstyrrelser.

For at få mere at vide om den nye artikel, se videoen nedenfor, og også marts 2021-video-introduktionen til Mip-NeRF. Du kan også få mere at vide om NeRF-forskning ved at se vores dækning indtil nu.

Oprindeligt udgivet 25. november 2021

21. december 2021, 12:25 – Erstattet død video. – MA