Kunstig intelligens

ST-NeRF: Komposition og redigering til video-syntese

Et kinesisk forskningskonsortium har udviklet teknikker til at bringe redigerings- og kompositions-funktioner til en af de hotteste billed-syntese-forskningssektorer i sidste år – Neural Radiance Fields (NeRF). Systemet er betegnet ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field).

Det, der synes at være en fysisk kamerapan i billedet nedenfor, er faktisk bare en bruger, der ‘ruller’ gennem visninger af videoindhold, der eksisterer i et 4D-rum. POV er ikke låst til præstationen af de mennesker, der er afbildet i videoen, hvis bevægelser kan ses fra enhver del af en 180-graders radius.

Hver facet inden for videoen er et diskret fanget element, komponeret sammen til en samlet scene, der kan dynamisk udforskes.

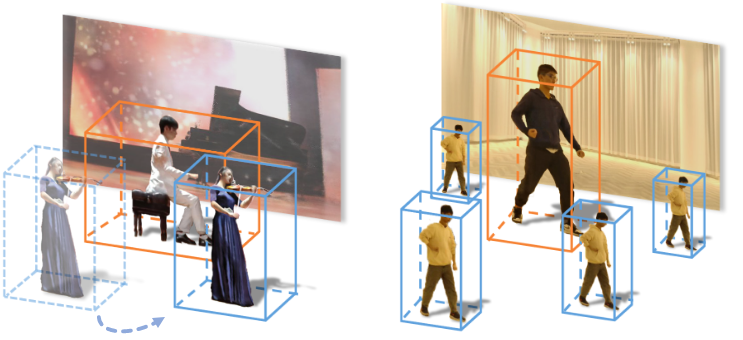

Facetterne kan frit duplikeres inden for scenen eller ændres i størrelse:

Derudover kan den temporale adfærd af hver facet let ændres, langsommes, køres baglæns eller manipuleres på mange måder, hvilket åbner vejen for filterarkitekturer og en ekstremt høj niveau af fortolkning.

To separate NeRF-facetter køres i forskellige hastigheder i samme scene. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Der er ingen behov for at rotoscope udøvere eller omgivelser eller have udøvere udføre deres bevægelser blindt og uden for konteksten af den ønskede scene. I stedet indfanges optagelserne naturligt via en matrix af 16 video-kameraer, der dækker 180 grader:

De tre elementer, der er afbildet ovenfor, de to mennesker og omgivelserne, er distinkte og kun kontureret for illustrative formål. Hver kan udskiftes, og hver kan indsættes i scenen på et tidligere eller senere tidspunkt i deres individuelle optagelses-tidsplan.

ST-NeRF er en innovation på forskning i Neural Radiance Fields (NeRF), et maskinlærings-rammeværk, hvor multiple visningsindfangeles syntetiseres til et navigerbart virtuelt rum ved omfattende træning (selvom enkelt visningsindfangeles også er en undersektor af NeRF-forskning).

Neural Radiance Fields fungerer ved at samle multiple visningsindfangeles sammen til et enkelt kohærent og navigerbart 3D-rum, med hullerne mellem dækningen estimeret og rendereret af et neuralt netværk. Hvor video (i stedet for stadig billeder) bruges, er renderingressourcerne ofte betydelige. Source: https://www.matthewtancik.com/nerf

Interessen for NeRF er blevet intens i de sidste ni måneder, og en Reddit-vært liste over afledte eller eksploratoriske NeRF-papirer viser i øjeblikket 60 projekter.

Kun nogle af de mange udgaver af den oprindelige NeRF-papir. Source: https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

Billig træning

Papiret er et samarbejde mellem forskere ved Shanghai Tech University og DGene Digital Technology, og er blevet accepteret med nogen entusiasme på Open Review.

ST-NeRF tilbyder en række innovationer over tidligere initiativer i ML-afledte navigerbare video-rum. Ikke mindst opnår det en høj niveau af realisme med kun 16 kameraer. Selvom Facebooks DyNeRF bruger kun to kameraer mere end dette, tilbyder det en langt mere begrænset navigerbart bue.

Et eksempel på Facebooks DyNeRF-miljø, med en mere begrænset bevægelsesfelt og flere kameraer per kvadratfod nødvendigt for at genskabe scenen. Source: https://neural-3d-video.github.io

Ud over at mangle evnen til at redigere og komponere individuelle facetter, er DyNeRF særligt dyrt i forhold til beregningsressourcer. I modsætning hertil angiver de kinesiske forskere, at træningsomkostningerne for deres data kommer ud til at ligge mellem $900-$3.000, sammenlignet med $30.000 for det state-of-the-art video-genereringsmodel DVDGAN og intensive systemer som DyNeRF.

Recensenterne har også bemærket, at ST-NeRF gør en væsentlig innovation i at afkoble processen med at lære bevægelse fra processen med billed-syntese. Denne adskillelse er, hvad der muliggør redigering og komposition, hvor tidligere tilgange var restriktive og lineære i sammenligning.

Selvom 16 kameraer er et meget begrænset array til en så fuld halv-cirkel af udsigt, håber forskerne at reducere dette antal yderligere i fremtidige arbejder gennem brugen af proxy-forindfangede statiske baggrunde og mere data-drevne scene-modelleringstilgange. De håber også at inkorporere gen-belysnings-funktioner, en seneste innovation i NeRF-forskning.

At løse begrænsningerne for ST-NeRF

I konteksten af akademiske CS-papirer, der ofte smider brugbarheden af et nyt system i en sidste paragraf, er selv de begrænsninger, som forskerne erkender for ST-NeRF, usædvanlige.

De observerer, at systemet ikke kan individuere og separat rendre udvalgte objekter i en scene, fordi menneskene i optagelserne er segmenteret i individuelle enheder via et system, der er designet til at genkende mennesker og ikke objekter – et problem, der synes let at løse med YOLO og lignende rammeværker, hvor det hårde arbejde med at udtrække menneskevideo allerede er udført.

Selvom forskerne bemærker, at det i øjeblikket ikke er muligt at generere slow-motion, synes der at være lidt, der forhindrer implementeringen af dette ved hjælp af eksisterende innovationer i frame-interpolation såsom DAIN og RIFE.

Som med alle NeRF-implementeringer og i mange andre sektorer af computer-vision-forskning kan ST-NeRF fejle i tilfælde af alvorlig okklusion, hvor subjektet midlertidigt er skjult af en anden person eller et objekt, og kan være svært at kontinuerligt spore eller nøjagtigt genoprette herefter. Som andre steder kan denne sværhed måske vente på upstream-løsninger. I mellemtiden medgiver forskerne, at manuel indgriben er nødvendig i disse okkluderede rammer.

Til sidst observerer forskerne, at de menneskelige segmenterings-procedurer i øjeblikket afhænger af farveforskelle, hvilket kan føre til uventet samling af to mennesker i en segmenterings-blok – en forhindring, der ikke er begrænset til ST-NeRF, men intrinsic til den bibliotek, der bruges, og som måske kan løses ved optisk flow-analyse og andre opkommende teknikker.

Først udgivet 7. maj 2021.