Kunstig intelligens

NeRF: Træning af Droner i Neurale Radiance Miljøer

Forskere fra Stanford University har udviklet en ny måde at træne droner til at navigere i fotorealistiske og meget nøjagtige miljøer, ved at udnytte den seneste avalanche of interest i Neurale Radiance Felter (NeRF).

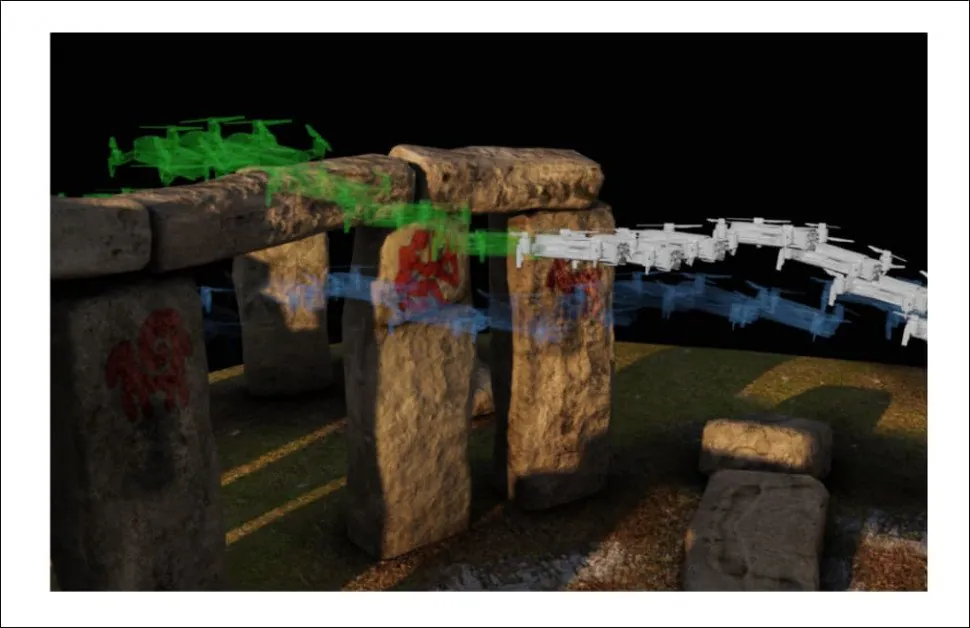

Droner kan trænes i virtuelle miljøer, der er kortlagt direkte fra virkelige lokationer, uden behov for specialiseret 3D scene-rekonstruktion. I dette billede fra projektet er vindforstyrrelse tilføjet som en mulig hindring for dronen, og vi kan se, hvordan dronen midlertidigt afviger fra sin bane og kompenserer i sidste øjeblik for at undgå en mulig hindring. Source: https://mikh3x4.github.io/nerf-navigation/

Metoden tilbyder mulighed for interaktiv træning af droner (eller andre typer objekter) i virtuelle scenarier, der automatisk inkluderer volumeninformation (til beregning af kollision undgåelse), tekstur trukket direkte fra virkelige fotos (til at hjælpe med at træne droners billedgenkendelsesnetværk på en mere realistisk måde) og virkelige lysforhold (for at sikre, at der trænes en variation af lysforhold ind i netværket, og undgå over-tilpasning eller over-optimering til den oprindelige snapshot af scenariet).

[caption id="attachment_178150" align="alignnone" width="600"] En couch-objekt navigerer gennem et komplekst virtuelt miljø, der ville have været meget svært at kortlægge ved hjælp af geometri-fangst og re-texturering i traditionelle AR/VR-workflows, men som blev genskabt automatisk i NeRF fra et begrænset antal fotos. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

En couch-objekt navigerer gennem et komplekst virtuelt miljø, der ville have været meget svært at kortlægge ved hjælp af geometri-fangst og re-texturering i traditionelle AR/VR-workflows, men som blev genskabt automatisk i NeRF fra et begrænset antal fotos. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typiske NeRF-implementeringer har ikke trajektorie-mekanismer, da de fleste NeRF-projekter i de sidste 18 måneder har koncentreret sig om andre udfordringer, såsom scene-relighting, reflection-rendering, compositing og disentanglement af fanget elementer.

Derfor er den nye artikels primære innovation at implementere en NeRF-miljø som et navigerbart rum, uden de omfattende udstyr og arbejdskrævende procedurer, der ville være nødvendige for at modelere det som et 3D-miljø baseret på sensorfangst og CGI-rekonstruktion.

NeRF som VR/AR

Den nye artikel er titlen Vision-Only Robot Navigation in a Neural Radiance World, og er et samarbejde mellem tre Stanford-afdelinger: Aeronautics and Astronautics, Mechanical Engineering og Computer Science.

Arbejdet foreslår en navigationsramme, der giver en robot en forudtrænet NeRF-miljø, hvis volumendensitet afgrænser mulige baner for enheden. Den inkluderer også en filter til at estimere, hvor robotten er inde i det virtuelle miljø, baseret på billedgenkendelse af robotens onboard RGB-kamera. På denne måde kan en drone eller robot “hallucinere” mere præcist, hvad den kan forvente at se i et givent miljø.

[caption id="attachment_178149" align="alignnone" width="700"]

Fordi en NeRF-miljø har fuldt modellerede occlusioner, kan dronen lære at beregne hindringer mere let, da neuralt netværk bag NeRF kan kortlægge forholdet mellem occlusioner og måden, hvorpå dronens onboard vision-baserede navigationsystemer opfatter miljøet. Den automatiserede NeRF-genereringspipeline tilbyder en relativt trivial metode til at oprette hyper-realistiske træningsrum med kun få fotos.

Den online-replanlægningsramme, der er udviklet til Stanford-projektet, faciliterer en robust og fuldt vision-baseret navigationspipeline.

Stanford-initiativet er blandt de første til at overveje mulighederne for at udforske et NeRF-rum i konteksten af et navigerbart og immersivt VR-lignende miljø. Neurale Radiance-felter er en opkomende teknologi, og er i øjeblikket genstand for multiple akademiske bestræbelser på at optimere deres høje krav til beregningsressourcer, samt at disentanglere de fanget elementer.

NeRF er ikke (rigtigt) CGI

Fordi en NeRF-miljø er et navigerbart 3D-scene, er det blevet en misforstået teknologi, siden dens opdukken i 2020, ofte vidt forstået som en metode til at automatisere oprettelsen af mesh og teksturer, snarere end at erstatte 3D-miljøer, som er kendt fra Hollywood VFX-afdelinger og de fantastiske scener fra Augmented Reality og Virtual Reality-miljøer.

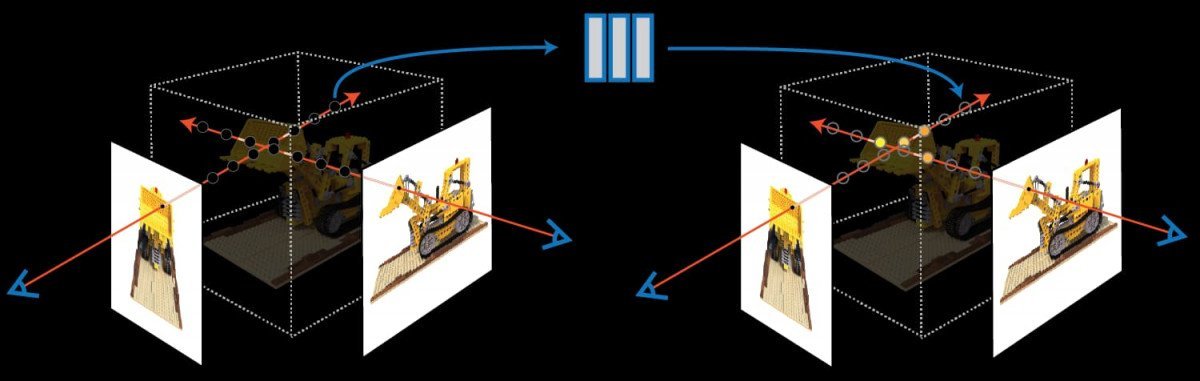

NeRF udtrækker geometri- og teksturinformation fra et meget begrænset antal billedsynspunkter, og beregner forskellen mellem billeder som volumeninformation. Source: https://www.matthewtancik.com/nerf

I virkeligheden er NeRF-miljøet mere som et “live”-render-rum, hvor en sammensmeltning af pixel- og lysinformation er bevaret og navigeret i et aktivt og kørende neuralt netværk.

Nøglen til NeRF’s potentiale er, at det kun kræver et begrænset antal billeder for at genskabe miljøer, og at de genererede miljøer indeholder alle nødvendige informationer til en høj-fidel rekonstruktion, uden behov for services fra modellører, teksturkunstnere, lys-specialister og andre bidragydere til “traditionel” CGI.

Semantisk Segmentering

Selv om NeRF effektivt udgør “Computer-Generated Imagery” (CGI), tilbyder det en helt anden metode, og en højautomatiseret pipeline. Derudover kan NeRF isolere og “indkapsle” mobile dele af en scene, så de kan tilføjes, fjernes, accelereres og generelt fungere som separate aspekter i et virtuelt miljø – en kapacitet, der er langt ud over den nuværende tilstand af kunst i en “Hollywood”-fortolkning af, hvad CGI er.

En samarbejde fra Shanghai Tech University, udgivet i sommeren 2021, tilbyder en metode til at individuere mobile NeRF-elementer til “pastable” aspekter i en scene. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativt er NeRF’s arkitektur en slags “sort boks”; det er ikke muligt at udtrække et objekt fra en NeRF-miljø og direkte manipulere det med traditionelle mesh-baserede og billed-baserede værktøjer, selv om en række forskningsindsats er begyndt at gøre gennembrud i at dekonstruere matricen bag NeRF’s neurale netværks live-render-miljøer.