Andersons vinkel

Kodning AIs lider ofte under Dunning-Kruger-effekten

Nyt forskning viser, at kodning AIs som ChatGPT lider under Dunning-Kruger-effekten, og ofte opfører sig mest selvbevidst, når de er mindst kompetente. Når de tackler ukendte eller obskure programmeringssprog, hævder de høj sikkerhed, selvom deres svar falder fra hinanden. Studiet linker modeloverconfidence til både dårlig præstation og mangel på træningsdata, og det rejser nye bekymringer om, hvor meget disse systemer virkelig ved om, hvad de ikke ved.

Enhver, der har brugt selv en moderat mængde tid på at interagere med Large Language Models om faktuelle emner, vil allerede vide, at LLMs ofte er tilbøjelige til at give en selvbevidst forkert respons til en brugerforespørgsel.

Sammen med mere åbenlyse former for hallucination, er årsagen til denne tomme praleri ikke 100% klar. Forskning offentliggjort over sommeren antyder, at modeller giver selvbevidste svar selv når de ved, de er forkerte, for eksempel; selv om andre teorier tilskriver overconfidence til arkitekturvalg, blandt andre muligheder.

Det, som slutbrugeren kan være sikker på, er, at oplevelsen er utrolig frustrerende, da vi er hårdkodet til at have tillid til menneskers vurderinger af deres egne evner (ikke mindst fordi der i sådanne tilfælde er konsekvenser, juridiske og andre, til en persons over-lofter og under-udfylder); og en form for antropomorfisk overførsel betyder, at vi har tilbøjelighed til at gentage dette adfærdsmønster med konversations-AI-systemer.

Men en LLM er en uansvarlig enhed, der kan og vil effektivt returnere en ‘Whoops! Butterfingers…’ efter at have hjulpet brugeren med at ufrivilligt ødelægge noget vigtigt, eller i det mindste spilde en eftermiddag af deres tid; under forudsætning af, at det vil anerkende ansvar overhovedet.

Værre, denne mangel på forsigtig omhu synes umulig at prompte væk, i det mindste i ChatGPT, der vil overstrømme brugeren med forsikringer om validiteten af dens råd og kun forklare fejl i dens tænkning efter, at skaden er sket. Hverken opdatering af systemets varige hukommelse eller brug af gentagne prompts synes at have nogen indvirkning på problemet.

Mennesker kan ligeledes være stædige og selvbedragende – selv om enhver, der fejlede så dybt og ofte, sandsynligvis ville blive fyret tidligt. Sådanne mennesker lider under det modsatte af ‘impostersyndromet’ (hvor en medarbejder frygter, han er blevet forfremmet over sine evner) – Dunning Kruger-effekten, hvor en person væsentligt overvurderer sin evne til at udføre en opgave.

Omkomsten af inflation

En ny studie fra Microsoft undersøger værdien af Dunning-Kruger-effekten i forhold til den effektive præstation af AI-baserede kodningsarkitekturer (som Redmonds eget Copilot), i en forskningsindsats, der er den første til specifikt at behandle denne undersektor af LLMs.

Studiet analyserer, hvordan selvbevidst kodnings-AIs vurderer deres egne svar mod, hvor godt de faktisk præsterer, på tværs af dusinvis af programmeringssprog. Resultaterne viser en tydelig menneske-lignende mønster: når modellerne var mindst kompetente, var de mest sikre på sig selv.

Effekten var stærkest i obskure eller lav-resurs-sprog, hvor træningsdata var tynd – jo svagere modellen eller sjældnere sproget, desto større illusion af færdighed:

GPT-4o’s faktiske og opfattede præstation på tværs af programmeringssprog, sorteret efter faktisk præstation. Kilde: https://arxiv.org/pdf/2510.05457

De fire forfattere, alle lige bidragsydere, der arbejder for Microsoft, påstår, at arbejdet rejser nye spørgsmål om, hvor meget disse værktøjer kan tillides til at vurdere deres egen output, og de skriver:

‘Ved at analysere model-selvbevidsthed og præstation på tværs af en divers samling af programmeringssprog, afslører vi, at AI-modeller spejler menneskelige mønstre af overconfidence, især i ukendte eller lav-resurs-domæner.

‘Vores eksperimenter demonstrerer, at mindre kompetente modeller og de, der opererer i sjældne programmeringssprog, udviser stærkere DKE-lignende bias, hvilket antyder, at styrken af bias er proportionalt med modellernes kompetence. Dette stemmer overens med menneskelige eksperimenter for bias.’

Forskerne kontekstualiserer denne linje af studie som en måde at forstå, hvordan model-selvbevidsthed bliver utroværdig, når præstation er svag, og at teste, om AI-systemer viser den samme form for overconfidence som set hos mennesker – med downstream-konsekvenser for tillid og praktisk udrulning.

Selv om den nye artikel modsiger Betteridges lov om overskrifter, er den alligevel titlen Do Code Models Suffer from the Dunning-Kruger Effect?. Selv om forfatterne påstår, at kode er blevet frigivet til arbejdet, indeholder den aktuelle preprint ikke nogen detaljer om dette.

Metode

Studiet testede, hvordan nøjagtigt kodnings-AIs kunne vurdere deres egne svar ved at give dem tusindvis af multiple-choice-programmeringsspørgsmål, med hvert spørgsmål tilhørende et bestemt sprogdomæne, fra Python og Java til Perl og COBOL:

Programmeringssprogdomæner brugt i studiet, sammen med antallet af multiple-choice-kodningsspørgsmål, der er samplet for hvert domæne.

Modellerne blev bedt om at vælge det korrekte valg og derefter estimere, hvor sikre de var på deres valg, med deres faktiske præstation målt af, hvor ofte de fik svaret rigtigt – og deres selv-vurderede selvbevidsthed indikerer, hvor god de troede de var. At sammenligne disse to målinger tillod forskerne at se, hvor selvbevidsthed og kompetence divergerede.

For at måle, hvor selvbevidst modellerne syntes at være, brugte studiet to metoder: absolut selvbevidsthed og relativ selvbevidsthed. I den første blev modellen bedt om at give en score fra nul til en sammen med hvert svar, med dens selvbevidsthed for et bestemt sprog defineret af gennemsnittet af disse scores på tværs af spørgsmål i det sprog.

Den anden metode så på, hvor selvbevidst modellen var, når valg mellem to spørgsmål; for hvert par skulle modellen sige, hvilket af dem den følte sig mere sikker på. Disse valg blev derefter scoret ved hjælp af rangeringssystemer oprindeligt designede til konkurrencespil, hvor hvert spørgsmål blev behandlet som en spiller i en kamp. De endelige scores blev normaliseret og gennemsnitligt for hvert sprog for at give en relativ selvbevidsthedsscore.

To etablerede former for Dunning-Kruger-effekten blev undersøgt i artiklen: en, der sporer, hvordan en enkelt model misvurderer sin præstation på tværs af forskellige domæner; og en anden, der sammenligner selvbevidsthedsniveauer mellem svagere og stærkere modeller.

Den første form, kaldet intra-participant DKE, ser på, om en enkelt model bliver mere overbevidst i sprog, hvor den præsterer dårligt. Den anden, inter-participant DKE, spørger, om modeller, der præsterer dårligere overordnet, også har tilbøjelighed til at vurderer sig selv højere.

I begge tilfælde bruges afstanden mellem selvbevidsthed og faktisk præstation til at måle overconfidence, med større afstand i lav-præstations-indstillinger, der peger på DKE-lignende adfærd.

Resultater

Studiet tester for Dunning-Kruger-effekten på tværs af seks store sprogmodeller: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, og GPT‑4o.

Hver model blev testet på multiple-choice-programmeringsspørgsmål fra det offentligt tilgængelige CodeNet-dataset, med 37 sprog* repræsenteret for at afsløre, hvordan selvbevidsthed og nøjagtighed varierede på tværs af kendte og obskure kodningsdomæner.

Den inter-model-analyse viser en tydelig Dunning-Kruger-mønster:

Faktisk versus opfattet præstation på tværs af seks kodmodeller, viser, hvordan lav-præsterende modeller som Mistral og Phi‑3 viser høj selvbevidsthed, på trods af dårlig nøjagtighed, mens stærkere modeller som GPT‑4o viser mere kalibreret eller endda underbevidst adfærd.

Modeller med lavere nøjagtighed, herunder Mistral og Phi‑3, havde tilbøjelighed til at overvurdere deres egne evner, mens højere-præsterende systemer som GPT‑4o viste selvbevidsthedsniveauer, der mere nøje matchede deres faktiske præstation, især når vurderet efter relativ selvbevidsthed.

Resultaterne antyder også, at de mest kompetente modeller kan undertiden undervurdere sig selv (et mønster, der ikke kan fanget af absolut selvbevidsthedsscores).

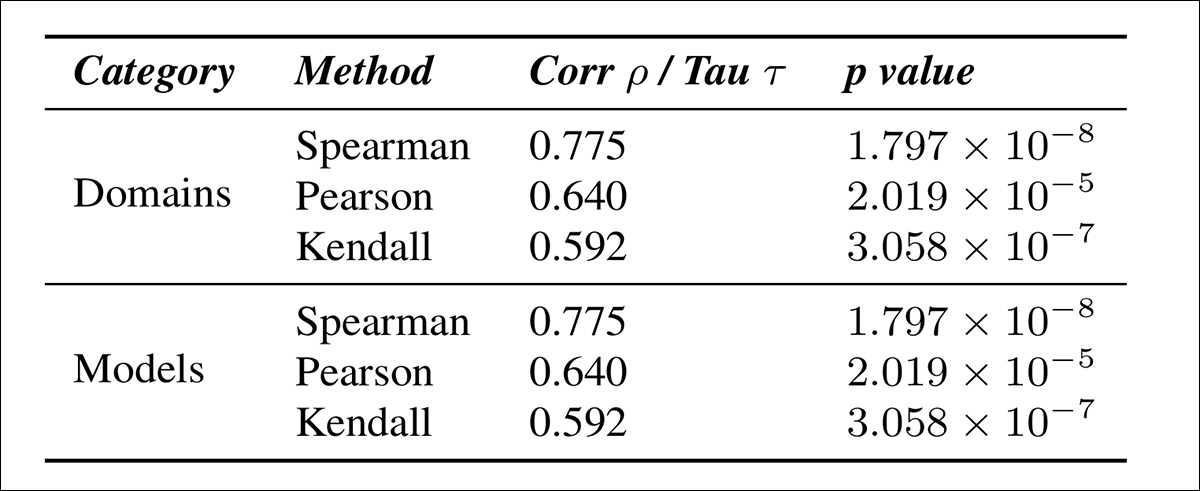

Resultaterne antyder også, at den intra-model-analyse også understøtter tilstedeværelsen af Dunning-Kruger-effekten. I resultattabelen vist i starten af artiklen, ser vi, hvordan hver model præsterede på tværs af forskellige programmeringssprog, arrangeret efter faktisk præstation.

I sprog, hvor modellerne scorede dårligt, især i sjældne eller lav-resurs-sprog som COBOL, Prolog og Ceylon, var deres selvbevidsthed påfaldende højere end deres resultater berettigede. I kendte sprog som Python og JavaScript var deres selvbevidsthed mere i overensstemmelse med deres faktiske nøjagtighed, og undertiden endda under den.

Dette mønster optrådte i både absolut og relativ selvbevidsthed, hvilket antyder, at modeller er mindre bevidste om deres egne begrænsninger, når de opererer i ukendte kodningsdomæner.

At behandle modeller som deltagere introducerede nogle begrænsninger, da det lille antal modeller i spil påvirker diversitet; forskelle inden for en enkelt models output bliver ignoreret; og datafordelingen må ikke afspejle den fra rigtige menneskelige deltagere.

For at kompensere for dette testede studiet tre alternative opsætninger: først blev hver model givet en distinkt persona; anden, blev svarene samplet ved en højere temperatur for at skabe mere variation; tredje, blev prompterne omskrevet adskillige gange, med hver version behandlet som en separat deltager:

Korrelation mellem overconfidence og faktisk præstation på tværs af forskellige eksperimentelle opsætninger, viser, at Dunning-Kruger-mønsteret forbliver konsekvent under alle betingelser og er stærkest, når multiple diverse svar samples fra den samme model.

For at bedre forstå, hvordan opfattet præstation afviger fra faktisk præstation, sammenlignede studiet absolut og relativ selvbevidsthed, ved at beregne, hvor meget hver model overvurderede sin egen evne (specifikt, forskellen mellem dens selvbevidsthedsscore og dens faktiske nøjagtighed), og derefter måle, hvordan denne overvurdering relaterede til modellens faktiske præstation:

Korrelation mellem overconfidence (målt som absolut minus relativ selvbevidsthed) og faktisk nøjagtighed på tværs af programmeringssprog og modeltyper, viser, at større overvurdering konsekvent er forbundet med lavere præstation.

Desuden viste specialiserede modeller, der var trænet på smallere domæner, stærkere DKE-effekter end generalister:

Korrelation mellem overvurdering og faktisk præstation for base-, single-domæne- og multi-domæne-specialiserede modeller, viser stærkere DKE-effekter, efterhånden som specialiseringen øges.

Ved hjælp af MultiPL-E-dataset på tværs af otte programmeringssprog, fandt forfatterne, at single-domæne-træning førte til større overconfidence end multi-domæne eller base-opsætninger, hvilket antyder, at DKE forværres med øget specialisering.

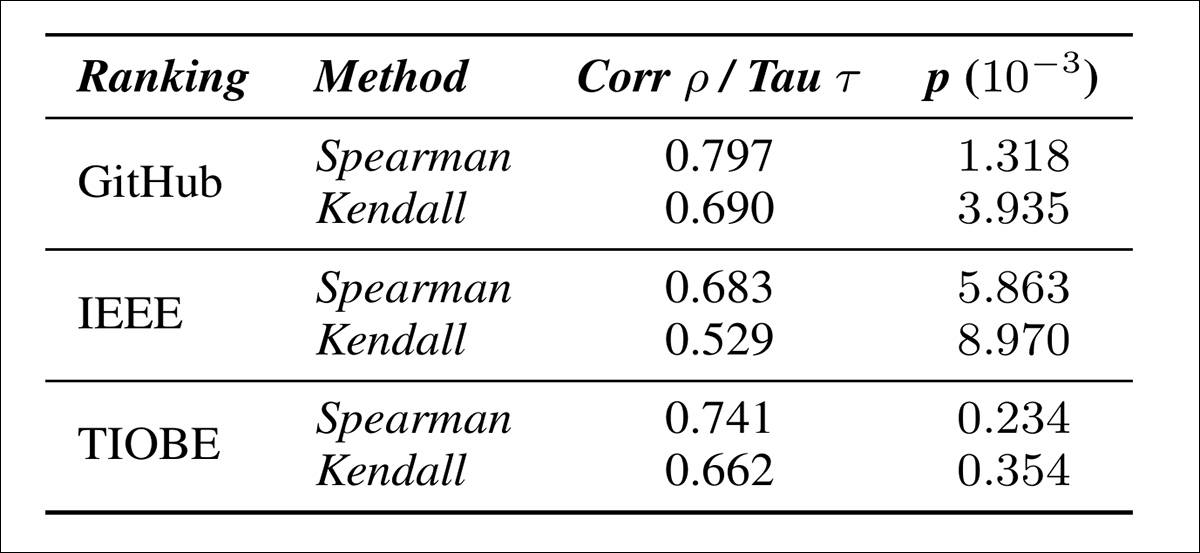

Testene fandt også, at modeller havde tilbøjelighed til at være mere overbevidste i sjældne programmeringssprog. På tværs af GitHub, IEEE og TIOBE-ranglister, korrelerer sjældenhed stærkt med højere opfattet præstation, med en toppunkt på 0,797:

Korrelation mellem model-overconfidence og sprog-sjældenhed, ved hjælp af tre popularitets-ranglister. Mindre almindelige sprog er forbundet med højere opfattet præstation.

Til sidst testede forfatterne, om Dunning-Kruger-effekten optrådte i kode-generering, ved at evaluere modeller på MultiPL-E-dataset på tværs af Ada, Dart, Prolog, Swift, C++, Python, C# og Elixir-sprogene.

Selv om effekten stadig var til stede, var den bemærkelsesværdigt svagere end i multiple-choice-spørgsmål-indstillinger, sandsynligvis på grund af den større vanskelighed ved at vurdere selvbevidsthed og korrekthed i åbne opgaver:

Korrelation mellem overvurdering og faktisk præstation i åbne kode-genererings-opgaver, baseret på MultiPL-E-resultater på tværs af otte programmeringssprog.

Ved at overveje den stadig omdiskuterede forklaring på Dunning-Kruger-effekten, konkluderer forfatterne:

‘En mulig forklaring, der kan være fælles for både mennesker og AI-modeller, er den meta-kognitive forklaring, der fastslår, at vurdering af kvaliteten af en præstation af en færdighed er en afgørende del af at erhverve en færdighed.

‘Denne forklaring kan potentielt testes eksperimentelt i AI-modeller med en kontrolleret studie af forskellige træningsstrategier og om de alle fører til samtidige forbedringer i præstation og i evnen til at vurdere kvaliteten af præstation. Men denne studie er betydeligt ud over denne artikels omfang, og vi overlader det til fremtidigt arbejde.’

Konklusion

Selv i sin native domæne kan Dunning-Kruger-effekten (som artiklen påpeger) være tilskrevet enten en statistisk eller kognitiv årsag. Hvis det skyldes en statistisk årsag, er anvendelsen af et hidtil unikt menneskeligt syndrom til en maskinlæringskontekst faktisk ret valid.

Selv om forfatterne spekulerer over, at årsagen kunne være ‘kognitiv’ i begge tilfælde, ville det kræve en lidt mere metafysisk synsvinkel.

Måske er den mest interessante opdagelse i artiklen, hvor stor en udstrækning flere kodnings-LLMs har tilbøjelighed til at dobbelt-gå i deres mindst gunstige omstændigheder, dvs. ved at vise maksimal selvbevidsthed, når de beskæftiger sig med de sparsomme eller mindst kendte sprog – hvilket ville være en næsten umiddelbart selvdestruktiv strategi i en virkelig arbejdsmiljø.

* De programmeringssprog, der blev brugt, var Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript og Visual Basic.

Først offentliggjort onsdag, 8. oktober 2025