Andersons vinkel

Kan AI udvikle en næse for nyheder?

AI bliver bedre til at skrive nyhedsartikler, men bliver ikke meget bedre til at identificere dem.

Opinion I de fem år, siden jeg sidst kiggede på AI’s evne til at finde en varm nyhedshistorie, har landskabet ændret sig betydeligt, med øgede niveauer af AI-dreven automatisering ledsaget af de uundgåelige voksende smerter og kontroverser.

For nylig præsenterede en WSJ-rapport om en produktiv, AI-baseret Fortune-bidrager journalisten i fremtiden som frigjort fra slidende arbejde som f.eks. translitterering af pressemeddelelser, og giver dem mulighed for at skrive artikler og gøre research, som normalt kun større publikationer har budget til.

Men hvad vi hører meget mindre om er AI’s evne til at spotte en nyhedshistorie.

Støjreduktion

I 2021-artiklen koncentrerede jeg mig om forfattere, der dækker forskningsområdet, da det er, hvor jeg tilbringer størstedelen af min tid; og måske den største effekt, som den nye AI-revolution har haft på det, er, at den har skabt en ukontrollerbar storm af AI-drevne forskningspapirindsendelser, som øger signal-til-støj-forholdet så højt, at selv dækning af Arxiv AI-relaterede domæner omfattende nu er uden for en enkelt persons kræfter.

Det er da også her, AI udmærker sig – ved at iterere gennem enorme mængder af data, som mennesker ikke kan løse, for at finde ‘outlier’ (som vi kommer til om lidt) i sekunder, som ville have taget mennesker dage, hvis de kunne have gjort det overhovedet.

Hvorfor er AI så dårlig til at identificere en varm nyhedshistorie ud af de tusinder, ja endda titusinder, af daglige kandidater?

Bagudrettet AI

Denne massive prolifération af AI-genereret indhold sker langt ud over det akademiske sektor, som jeg diskuterede tidligere. Sent sidste år blev det estimeret, at halvdelen af alle nye skriverier på internettet er nu ‘skrevet af AI’, med endnu større acceleration af denne trend formodet at være på vej. Derfor er støjen øredøvende overalt, ikke kun i akademiet.

Selv om der har været en vis fremgang i AI/algoritme-baseret identifikation af en ‘varm’ historie i de seneste par år, tenderer disse systemer til at koncentrere sig om stratificerede og forudsigeligt organiserede datafeeds, hvilket betyder, at de kun kan fungere i en ret begrænset kontekst.

I denne henseende har Stanford-postdoc-forsker og tidligere New York Times-journalist Alexander Spangher gjort flere forsøg på at definere ‘nyheds værdi’ i termer, der kan anvendes på maskinelæringsprocesser og statistisk analyse; og har produceret bevis for automatiseret lead-generering i korpus som retssager, lovbilleder og byrådsmøder, samt generelle offentlige dokumenter – den type skema-drevet output, som Fortune’s produktive AI-drevne skribent kan omdanne til 6-7 nyhedsartikler om dagen:

Den ‘varme’ af ordistributioner hentet fra korpus af offentlige dokumenter. I dette tilfælde kan vi se, at ‘authorizing’ har en høj score, måske fordi det repræsenterer beslutning, ændring og nytænkning. Kilde

Men problemerne med tilgange som den Spangher-ledede 2023 tilbud Tracking the Newsworthiness of Public Documents, er, at de i typisk AI-funktion center på observerede tendenser i data. Altså observerer de ting, der gjorde god nyhed før, og går derefter ud for at finde mere af samme slags.

I den virkelige verden er uventede kilder næsten altid en ‘one hit wonder’; og for hvor ukendte de var, kunne ingen have forudset deres pludselige prominens. Så, efter at have været frugtbar én gang, og på trods af lejlighedsvis forsøg på at kapitalisere på flygtig berømmelse eller notoriets, vil de normalt aldrig producere noget nyttigt igen.

Tegn på tiden

Derfor, da overvågning af denne type ‘one-and-done’-nyhedskilde normalt bare vil tilføje mere støj til den generelle storm, kunne AI i stedet ikke identificere signifikatorerne for en kilde, der en dag vil blive frugtbar? Hvis man kunne finde ud af, hvilken type kilde måske en dag vil give nyheder, kunne man fokusere på dens egenskaber snarere end dens kontekst eller metoder.

Ved denne logik kunne man slutte, at afsløringerne fra Edward Snowden i 2010’erne, at nogen, der for nylig havde forladt CIA’s (eller en lignende organisation) ansættelse, ville være værd at følge som en potentiel kilde til en fremtidig scoop.

Men der er ingen RSS-feeds eller API’er, der sandsynligvis kan automatisere denne type løbende overvågning, da LinkedIn og mange andre tidligere åbne kilder af data trækker sig tilbage over for rapace og scofflaw AI-web-scrapere. Selv hvis der var, ville hyppighed være et problem, fordi man ikke kan afhøre en API eller et websted hver femte sekund; ud over ressource-omkostningerne ville IP-blokeringssvar fra platformene gøre dette til en uholdbar aktivitet.

Derudover er der tydeligvis et ‘menneskeligt aspekt’ ved sådanne afsløringer, som er svært at automatisere.

Nyhedssamling med personlig touch: optagelse fra en disk-udgave af filmen ‘All The President’s Men’ fra 1976, med informant, der kommer ud af skyggen. Kilde

Også i den virkelige verden er det frygteligt svært at identificere definerende egenskaber for en fremtidig nyhedskilde. Det er sandsynligvis ikke ‘personer, der for nylig har forladt CIA’, og det er bestemt ikke defineret af en protokol: platforme som X eller GitHub producerer langt for meget signal i sig selv, og selv at begrænse sig til søgeord eller postkategorier gør ingen forskel – kun hvis du er involveret i problemet og engageret i fællesskabet (eller repo osv.) er du virkelig sandsynlig at erkende betydningen af en udvikling.

Selv en term som ‘sikkerhedsadvarsel’ kan ikke kontekstualisere den sande alvor eller nyheds værdi af en begivenhed, da henvisninger af den slags kastes rundt dagligt, tusinder af gange, i sådanne fællesskaber – og selv om man begrænser den slags overvågning til engelsk sprog alene, ville variationer i idiom samt brug af underforstået sprog gøre det meget svært at parse en ‘i det vilde’ post til en sand nyhed.

Den smalle vej

Den nuværende gruppe af AI-drevne nyheds-værdi-detektionssystemer afhænger af formaliserede datastrukturer (som f.eks. JSON-udgang fra en API), eller også af uformelle datastrukturer, som AI-udviklede algoritmer har en chance for at parse til en struktureret skema (som pressemeddelelser fra en bestemt organisation):

En parsed RSS/XML-feed, der afslører den stive hierarki af datacontainere. Kilde

Det er tydeligt, at tilgange af denne type er velegnede til programmatisk output, som det kedelige arbejde, som den nævnte WSJ-reporter erklærer, at AI har frigjort ham fra, herunder vejr, aktier og sportsresultater, samt rutinemæssige pressemeddelelser fra kommunale og andre regeringsorganisationer.

Selv om det er muligt at tilføje ‘menneske-alarm’-triggers til statistiske feeds som vejr (pludselige storme), aktier (pludselige fald) og sport (uventede sejre/tabs, med noget forarbejde), ville menneskelig opmærksomhed stadig være nødvendig, selv for meget stratificerede regeringsmeddelelser, for at vurdere nyheds værdi.

Selv om termer som ‘død’, ‘uventet sygdom’, ‘læk’ og ‘ulykke’ alle kan hjælpe med at bore ned til nyheds-værdige begivenheder, kan de kun tackle ‘rutinemæssige’ begivenheder og kan ikke tage hensyn til alternativt sprog (eller sprog).

Return of the Elite Writers?

I de seneste år er data-dreven journalistik blevet en stigende plank i nyhedsrapportering, med redaktionsafdelinger, der ikke længere er begrænset til søde ‘scoop’-aftaler, der giver dem tidlig adgang til særlige rapporter og hvidbøger fra store forlag; i stedet kan de selv knuse tallene.

Men dette er ingen gratis måltid; da den åbenlyse værdi af at parse offentlige data med AI på denne måde er vokset, er en rentesøgende/AI-blokerende reaktion fulgt – eller endda forudset – efterspørgslen, og driver de data-hungrende store AI-spillere ind i hemmelige taktikker.

Den tilføjede friktion i den nye tilbagetrækning giver sandsynligvis en vis mængde magt fra ‘borgerjournalister’ tilbage til legacy-medier – eller i hvert fald, velfinansierede nyhedsorganisationer, der har kapaciteten til at absorbere den ekstra manuelle arbejde, der kræves for at indsamle, raffinere og evaluere data i en æra, hvor udgivere og domæner stadig mere begrænser casual adgang.

Så, på en måde, kan AI’s praktiske manifestation i journalistik, i forhold til, hvordan store spillere og markeder har reageret på AI-baseret innovation og adoption, måske faktisk tage os tilbage i tiden: udemokratisere midlerne til nyhedsproduktion og tilføje vejrblokke til meningsfulde data-drevne nyheds-værdi-evalueringssystemer.

Fælles instinkter

Disse begrænsninger fører os tydeligvis tilbage til ‘mavefornemmelse’ som en uundgåelig komponent i evaluering af en nyheds værdi.

Naturligvis er dette beroligende for dem, der er professionelt engageret i dette aspekt; men selvtilfredshed ville være en fejl, da denne instinkt kan, i en vis udstrækning, destilleres og operationaliseres på en meget generel måde, der ikke afhænger af at studere besættelser eller hobbyheste af en given person eller organisation: i en 2022 studie brugte forskere fra Northwestern University crowd-sourced-evalueringer af potentielt nyheds-værdige historier til at træne en prædictiv model, specifikt beskæftiget med nyheds-værdien af nyligt publicerede Arxiv-forskningspapirer:

Spørgeskemaer givet til studie-deltagere for at få træningsdata til en ‘nyheds-værdi-forudsigelses’-AI-model. Kilde

Systemet rangerer kandidater ret godt, med omkring 80% af dens top ti valg også vurderet som nyheds-værdige af eksperter. Men enighed med eksperter viste sig kun at være moderat, med resultater, der mangler faktorer som ramme, eller publikumets tilpasning.

Systemet bygger på principperne i 2020-papiret Computational News Discovery: Towards Design Considerations for Editorial Orientation Algorithms in Journalism. Som med de fleste lignende projekter, tackler dette arbejde videnskabsjournalistik snarere end abstrakt nyhedssamling – måske fordi den videnskabelige litteratur tenderer mod skabeloneret output, der potentielt kan parses til trænende og fortolkningsfulde datapunkter.

Nå, som jeg observerede tilbage i 2021, would dette være tilfældet, bortset fra at forskningsvidenskabsmænd ofte misbruger konventionerne for forskningspapir-indsendelse til at skjule eller nedtone imponerende resultater eller endda åbenlyst fiasko.

Endnu mere af en udfordring er den store vanskelighed, som AI-systemer har med at fortolke figurer og tabeller i videnskabelige papirer, til den grad, at dette forsøg har, for nylig, blivet en aktiv gren i litteraturen:

Fra papiret ‘SciFigDetect: A Benchmark for AI-Generated Scientific Figure Detection’, der viser ægte videnskabelige figurer, deres generationsprompts og syntetiske modstykker produceret af Nano Banana og GPT på tværs af tre kategorier: illustration, oversigt og eksperimentelle figurer. Kilde

Det er ofte tilfældet, at en graf eller tabel vil indeholde resultater, som hovedteksten i papiret enten vil rapportere med selektiv bias eller også helt ignorere negative konsekvenser, der er implicit i grafen/tabelens resultater. Derfor er dette vejrblok i AI-dreven videnskabsjournalistik ikke et mindre problem.

Mere sigende er det, at en rapport er afledt eller kun en mindre fremgang (hvis overhovedet) på standen, ofte er begravet i en næsten uigennemtrængelig citation (dvs. du ville neede at søge efter termen, finde en læselig PDF-kopi og forstå omfanget af den tidligere viden, før du forstår mangel på originalitet eller nytænkning i det nye arbejde).

Alone Again, Naturally

Den crowd-sourced-metode, der er beskrevet ovenfor, antyder en vis enighed mellem fælles consensus om potentielle nyheds-historier og professionel evaluering af samme. Men uden kontekst kan kun de bredeste træk af nyheds-værdi tydeligvis bestemmes.

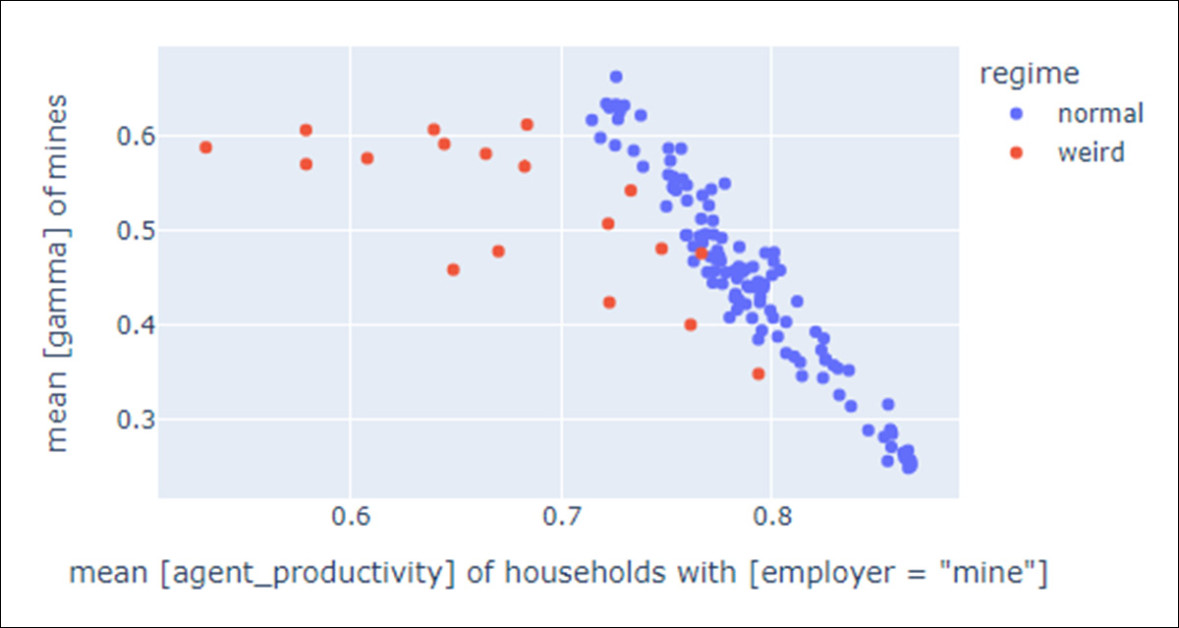

Den allerstørste styrke af AI ligger i dens evne, afhængigt af konfiguration, til at isolere outlier – enten for at afvise dem som en kurve-blowing og meningsløs undtagelse til en tendens i en dataset, eller (mere relevant for nyhedssamling) til at identificere meningsfulde og værdifulde usædvanlige instanser og begivenheder:

Outlier (i rød) i et scatterplot. Kilde

På principperne om, at lyn sjældent slår to gange, er næsten alle hit-nyheder outlier. I tilfælde, hvor de kommer fra et aktivt og volatilt domæne, som en pågående krig, kan dette domæne overvåges med en høj sandsynlighed for nyheds-værdige historier, der opstår – men til en pris af massiv konkurrence, da fælles opmærksomhed sandsynligvis også er fokuseret på domænet.

Mange nyheds-værdige videnskabelige leads er, per definition, ikke centrum for sprogfordelingen. De er sjældne kombinationer af metoder, overraskende negative resultater eller anomale re-replicationer. Hvis modellens kompetence svækkes uforholdsmæssigt på disse lavfrekvensgrupper, så bliver det område, hvor en redaktionel ‘næse’ behøver at være skarp, det område, hvor modellen er mindst pålidelig.

Trust Issues

Ved at søge efter nye historier balancerer journalister multiple begrænsninger, herunder tid, adgang, troværdighed, publikum og organisationsprioriteter), hvilket fører til ikke-åbenlyse valg. En 2022 litteraturgennemgang fra Danmark karakteriserede journalister som balancerende multiple bekymringer, akut bevidste om, at kilder kan have dagsordener eller være misinformeret; og ofte omgår direkte tjek i favør af indirekte tillidsklik, når de opererer under pres.

Disse samme ’tillids-problemer’ ville være en udviklingshinder i enhver definitiv AI-dreven nyheds-værdi-identifikationssystem, da engagement med en sådan platform kræver, at brugeren stoler på, at enhver algoritme-discarded artikler ikke er værd at bruge skribentens tid.

Udførlig beta-testning og gen-træning eller fine-tuning, med menneskelig oversigt, der samler strægere og stragglers, kunne sandsynligvis forbedre pålideligheden af en sådan tilgang; men en skift i national eller global kultur – såsom overraskende ændringer i det politiske landskab eller udbruddet af krig – kunne uundgåeligt undergrave alle grundlæggende prioriteringer for en sådan fint-kalibreret system, og efterlade AI-afhængige skribenter til at genopbygge deres nødvendige ‘interne domæne-model’ næsten fra scratch.

Offentliggjort mandag, 20. april 2026