Kunstig intelligens

Bedre Maskinlæringspræstation Gennem CNN-baseret Billedeomstørrelse

Google Research har foreslået en ny metode til at forbedre effektiviteten og nøjagtigheden af billedbaseret computer vision-træningsarbejdsprocesser ved at forbedre måden, hvorpå billederne i en datasaet bliver formindsket på forarbejdningstrinnet.

I artiklen Learning to Resize Images for Computer Vision Tasks bruger forskerne Hossein Talebi og Peyman Milanfar en CNN til at oprette en ny hybrid billedomstørrelsearkitektur, der resulterer i en bemærkelsesværdig forbedring af genkendelsesresultaterne i fire populære computer vision-datasæt.

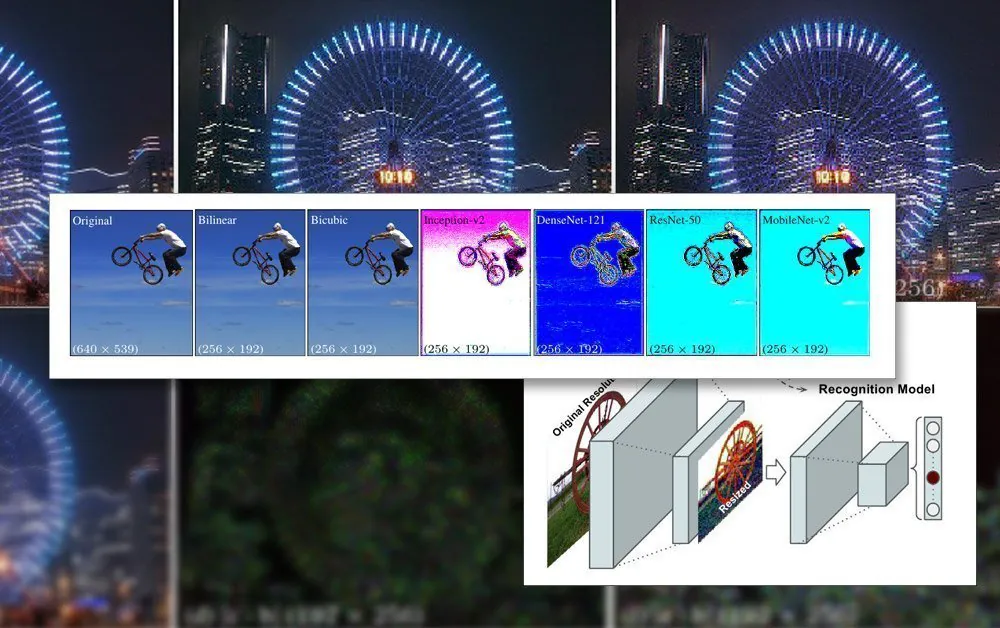

Den foreslåede fællesramme for genkendelse og omstørrelse. Kilde: https://arxiv.org/pdf/2103.09950.pdf

Artiklen observerer, at reskalerings-/omstørrelsesmetoderne, der i øjeblikket bruges i automatiserede maskinlæringspipelines, er årtier gamle og ofte kun bruger grundlæggende bilineær, bicubisk og nærmeste nabo omstørrelse – metoder, der behandler alle pixel uden diskrimination.

Til gengæld udvider den foreslåede metode billeddata via en CNN og inkorporerer denne indgang i de omstørrede billeder, der til sidst vil passere gennem modellens arkitektur.

Billedbegrænsninger i AI-træning

For at træne en model, der behandler billeder, vil en maskinlæringsramme inkludere et forarbejdningstrin, hvor en forskelligartet samling af billeder i forskellige størrelser, farverum og opløsninger (der vil bidrage til træningsdatasættet) systematisk beskæres og omstørres til konsistente dimensioner og en stabil, enkelt format.

Generelt vil dette involvere en kompromis baseret på PNG-formatet, hvor en afvejning mellem behandlingstid/ressourcer, filstørrelse og billedkvalitet vil blive etableret.

I de fleste tilfælde er de endelige dimensioner af det behandlede billede meget små. Herunder ser vi et eksempel på 80×80 opløsning, som nogle af de tidligste deepfakes-datasæt blev genereret:

Da ansigter (og andre mulige emner) sjældent passer ind i den påkrævede kvadratisk forhold, kan sorte bjælker være nødvendige (eller spildt plads tilladt) for at homogenisere billederne, hvilket yderligere reducerer den faktiske brugbare billeddata:

Her er ansigtet blevet udtaget fra en større billedområde, indtil det er beskåret så økonomisk som muligt for at inkludere hele ansigtsområdet. Men som vist til højre, vil en stor del af den resterende område ikke blive brugt under træning, hvilket tilføjer større vægt til billedkvaliteten af de omstørrede data.

Da GPU-kapaciteterne har forbedret sig i de seneste år, med den nye generation af NVIDIA-kort udstyret med øgende mængder af video-RAM (VRAM), er gennemsnitsbidragende billedstørrelser begyndt at øge, selvom 224×224 pixel stadig er ret standard (for eksempel er det størrelsen på ResNet-50-datasættet).

Et ubeskaaret 224×244 pixels billede.

At få batches ind i VRAM

Grunden til, at billederne skal være alle sammen af samme størrelse, er, at gradient descent, metoden, hvormed modellen forbedrer sig over tid, kræver ensartet træningsdata.

Grunden til, at billederne skal være så små, er, at de skal indlæses (fuldt dekomprimeret) i VRAM under træning i små batches, normalt mellem 6-24 billeder pr. batch. For få billeder pr. batch, og der er ikke nok gruppe materiale til at generalisere godt, samt forlænge træningstiden; for mange, og modellen kan ikke få de nødvendige karakteristika og detaljer (se nedenfor).

Denne ‘live loading’-sektion af træningsarkitekturen kaldes latent rum. Dette er, hvor funktioner gentagne gange udtrækkes fra samme data (dvs. samme billeder) indtil modellen er konvergeret til en tilstand, hvor den har alle de generaliserede kundskaber, den behøver for at udføre transformationer på senere, usete data af samme type.

Denne proces tager generelt dage, selvom det kan tage endda en måned eller mere af konstant og uafbrudt høj volumen 24/7 kognition for at opnå nyttig generalisering. Øgninger i VRAM-størrelse er kun nyttige op til et punkt, da selv mindre øgninger i billedopløsning kan have en orden af størrelse effekt på behandlingskapacitet og relaterede effekter på nøjagtighed, der ikke altid er gunstige.

At bruge større VRAM-kapacitet til at rumme højere batch-størrelser er også en blandet velsignelse, da de højere træningshastigheder, der opnås ved dette, sandsynligvis vil blive kompenseret af mindre præcise resultater.

Derfor, da træningsarkitekturen er så begrænset, er alt, der kan effektuere en forbedring inden for de eksisterende begrænsninger af pipelinen, en bemærkelsesværdig præstation.

Hvordan overlegen nedskalering hjælper

Den ultimative kvalitet af et billede, der vil blive inkluderet i et træningsdatasæt, er blevet bevist at have en forbedrende effekt på træningens udfald, især i genkendelse af objekter. I 2018 påstod forskere fra Max Planck Institute for Intelligent Systems , at valget af resampling-metode bemærkelsesværdigt påvirker træningspræstation og udfald.

Desuden har tidligere arbejde fra Google (co-forfattet af artiklens forfattere) fundet, at klassifikationsnøjagtighed kan forbedres ved at opretholde kontrol over kompressionsarter i datasætbilleder.

CNN-modellen, der er bygget ind i den nye resampler, kombinerer bilineær omstørrelse med en ‘skip connection’-funktion, der kan inkorporere output fra det trænede netværk i det omstørrede billede.

I modsætning til en typisk encoder/decoder-arkitektur kan den nye forslag ikke kun fungere som en feed-forward-bottleneck, men også som en invers bottleneck for op-skaleringsformål til enhver mål-størrelse og/eller aspektforhold. Desuden kan den ‘standard’-resampling-metode udskiftes med enhver anden passende traditionel metode, såsom Lanczos.

Højfrekvensdetaljer

Den nye metode producerer billeder, der i virkeligheden synes at ‘bage’ nøglefunktioner (der til sidst vil blive genkendt af træningsprocessen) direkte ind i kildebilledet. Æstetisk set er resultaterne usædvanlige:

Den nye metode anvendt på fire netværk – Inception V2; DenseNet-121; ResNet-50; og MobileNet-V2. Resultaterne af Google Researchs billed-downsampling-/omstørrelsesmetode producerer billeder med åbenlyse pixel-aggregering, der forudser de nøglefunktioner, der vil blive opfanget under træningsprocessen.

Forskerne bemærker, at disse initiale eksperimenter er eksklusivt optimeret til billedgenkendelse-opgaver, og at deres CNN-drevne ‘learned resizer’ var i stand til at opnå forbedrede fejlratninger i sådanne opgaver. Forskerne har til hensigt at anvende metoden til andre typer af billedbaseret computer vision-applikationer i fremtiden.