Tankeledere

Din AI’s personlighed er lige så vigtig som dens IQ — og vil enten gøre eller ødelægge virksomhedsudrulning

De fleste virksomheder vælger stadig AI-modeller baseret på benchmark. I praksis er det sjældent, hvad der afgør, om disse systemer faktisk virker.

Hidtil har de fleste diskussioner om store sprogmodeller i virksomhedsmiljøer været domineret af benchmark. Holdene tiltrækkes af målbart performance, såsom hvilket model er den mest intelligente, den stærkeste til kodning, den mest nøjagtige til sammenfatning eller til matematisk resonnering.

Men da holdene begynder at gå ud over eksperimentationsfasen og dykke ned i den faktiske udrulning i stor skala, vil andre vigtige faktorer, som i øjeblikket er stort set overset af de fleste CEO’er, hurtigt vise sig at være lige så afgørende for en virksomheds succes.

AI’s ansættelighed

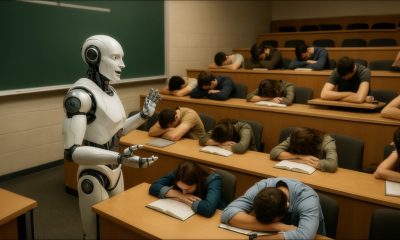

Rå intelligens og analytisk kapacitet er åbenbart vigtige, men den mest underestimerede variabel i virksomheds-AI-udrulning er personlighed. Personlighed i sammenhæng med store sprogmodeller refererer til den konsekvente stemme, tone og adfærd, som en model formidler på tværs af interaktioner. Det er, hvad der gør en AI føles koherent og pålidelig.

Når man implementerer AI, skal virksomhederne tage samme tilgang, som de ville, hvis de ansatte en menneskelig medarbejder: vurder ikke kun, hvor godt en model kan udføre en opgave, men også dens holdning til jobbet, hvordan den kommunikerer og hvordan den passer ind i den større arbejdsgang.

En models evne til at opretholde konsistens, svare passende og håndtere nuancer i forskellige sammenhænge kan have en betydelig indvirkning på forretningsresultater. En teknisk brillant AI, der svarer langsomt, skifter tone eller mishandler nuancerede interaktioner, kan være misbrugt af virksomheder, frustrere brugere, mindske engagement og ultimativt reducere effektiviteten af AI og virksomhedens succes.

Dette er særligt vigtigt i brancher som kundesupport, politisk udstrækning eller intern kommunikation, da subtile skift i tone eller formulering mellem svar kan forårsage forvirring, underminere tillid og reducere det samlede engagement. Som med mennesker, der er ingen enkelt drømmemodel, der overgår konkurrencen i hver kategori. Nogle modeller er bedre til at udføre analytiske opgaver som kodning eller matematik, mens andre udfører langt bedre konversations skrivning og sammenfatning af møder.

Men en udfordring for hold, der bygger på disse systemer, er, at disse karakteristika ikke er faste.

Et flygtigt mål

AI-landskabet udvikler sig hurtigere, end de fleste organisationer kan følge med. Nye versioner udgives hyppigt, og performance-karakteristika kan skifte fra en opdatering til den næste. Google’s Gemini-modelserie er et nyligt eksempel.

Gemini 2.0 Pro blev udgivet i februar 2025 og blev straks præsenteret som flagship-modellen for udviklere og virksomheder, der bruger det til kodning og komplekse prompter verden over.

Det kom med, hvad der på daværende tidspunkt var den største kontekstvindue, Google nogensinde havde tilbudt, på to millioner tokens, hvilket gav det evnen til at omfattende analysere og forstå enorme mængder af information på én gang, mens det samtidig kunne bruge værktøjer som Google Søgning og endda skrive kode.

For hold, der byggede systemer, der havde brug for at behandle store mængder af data hurtigt og nøjagtigt, så det ud som det klare valg. Men inden for blot uger udgav Google Gemini 2.5 Pro, som straks toppede leaderboardene og overskred sin forgænger med forbedringer i kodning, matematik og videnskab.

Om natten var modellen, der lige havde været det bedste valg på markedet, allerede ved at blive overgået mindre end to måneder efter lanceringen. Men tidlige brugere lagde straks mærke til, at ændringerne ikke kun var inkrementelle eller analytiske — Gemini’s hele personlighed var ændret over nattemødet. Flere udviklere gik så langt som til at sige, at AI’en opførte sig, som om den var blevet “lobotomeret” efter opdateringen.

De klagede over, at AI’en syntes at blive, bogstaveligt talt, “dummere” — konsekvent producerer langsommere svar, mindre koherente output og viser inkonsistens i, hvordan den håndterer prompter, den tidligere havde ingen problemer med, og opgaver, der engang føltes flydende, blev pludselig stive.

Og det er her, en virksomheds strategi omkring AI-udrulning begynder at ændre sig fundamentalt.

Uden for benchmark

På papir burde Gemini 2.5 Pro have været den klare vinder med sine enorme forbedringer i kapacitet og sikkerhed.

Men i praksis ændrede disse ændringer fuldstændig, hvor pålidelig modellen var, hvordan den opførte sig, svarede på prompter og, i sidste ende, sendte hold, der lige havde brudt banken og havde brugt utallige timer på at bygge rundt om disse systemer, tilbage til start, hvis modellens nye kapaciteter ikke passede med deres eksisterende pipeline.

Selv små ændringer i adfærd kan forstyrre systemer bygget op omkring konsistens og forudsigelighed. Dette skaber en reel operativ risiko, hvis en virksomhed er tæt koblet til en enkelt model, da enhver opdatering kan introducere umiddelbar ustabilitet til hold, der afhænger af disse systemer.

For at bekæmpe dette er mange fremtænkende virksomheder begyndt at implementere en multi-model-strategi, hvor de routerer forskellige opgaver til de modeller, der er bedst egnet til dem, i stedet for at afhænge af en enkelt model til at håndtere alt.

Denne tilgang forbedrer ikke kun performance tilpasset hver opgave, men reducerer også risikoen forbundet med AI-implementering, fordi hvis en model skulle forringes efter en opdatering, ville det ikke bringe hele systemet, der afhænger af det, ned med det, da der er reserve til rådighed.

Simpelt sagt er AI’ens personlighed og pålidelighed lige så vigtige som dens rå intelligens, når det kommer til at anvende modellen i en arbejdende miljø til at udføre forskellige opgaver. Denne ændring i tænkning repræsenterer en fundamental ændring i, hvordan virksomheder ikke længere kun køber et “smartere værktøj”, men i stedet bygger og administrerer et helt digitalt infrastruktursystem.

For at virksomheder ikke kun kan overleve, men også trives i dagens forretningslandskab, skal holdene etablere pipelines, der kan skifte ud og ind forskellige modeller afhængigt af opgaven og konstant overvåge, hvordan opdateringer påvirker både performance og interaktionskvalitet.

I sidste ende vil modellerne selv fortsætte med at udvikle sig i en takt, der er svær at følge. Men virksomheder, der planlægger for ændring, bygger redundans og behandler AI både som et værktøj og en medarbejder, vil være de, der omdanner disse hurtige skift til en konkurrencemæssig fordel.