Andersons vinkel

Kunstig intelligens splitter web-søgning i tre forskellige virkeligheder

Nyt forskning viser, at Google nu bruger tre forskellige informationsystemer inden for sin egen søgeimperium, med almindelig Søgning, AI-oversigter og Gemini, der alle favoriserer forskellige kilder, rangordninger og indhold.

Reduktionisme hersker. Over de sidste tolv måneder er ‘Lad mig google det for dig’ meme blevet overtaget af en ny ‘Lad mig sammenfatte Google-søgningen for dig’ trend, hvor AI-oversigter i søgeresultaterne stadig mere sparer læserne besværet med at klikke på søgelinks (muligvis af-finansierer kilde-siderne undervejs), ved at kondensere hele søgeresultaterne i få genererede afsnit.

Man ville tro, at den centrale viden, der kommer frem, og valget af sider, hvorfra man henter denne viden, ville være relativt lignende på tværs af de tre mest populære metoder til at søge efter information på internettet: i traditionel web-søgning; i AI-oversigterne (AIOs), der nu toppen af de fleste web-søgeresultater; og gennem den øgede brug af LLMs som ChatGPT som web-orakler (med eller uden eksterne RAG-kald).

Men, nylig forskning fra USA viser, at dette er, overraskende, langt fra tilfældet; og at selv inden for Googles egen treenighed af orakler – SERPS*, AI-summeringer og direkte interaktion med Gemini LLM-serien – der synes at være betydelige og interessante diskrepanser, for hver rute.

Three-Way Split

I en klar og omfattende ny artikel, med titlen Hvordan Generative AI Forstyrrer Søgning: En Empirisk Studie af Google Søgning, Gemini og AI-oversigter, seks forskere fra New Jersey Institute of Technology beskriver, hvordan de tre søgemetoder divergerer, og tilbyder nogle mulige teorier for disse brud i tilgang.

Artiklen fastslår:

‘[Først, vi] finder, at for 51,5% af repræsentative, virkelige brugerforespørgsler, AIOs genereres, og vises oven over de organiske søgeresultater. Kontroversielle spørgsmål resulterer ofte i en AIO.

‘Anden, vi viser, at de hentede kilder er væsentligt forskellige for hver søgemaskine (<0,2 gennemsnitlig Jaccard-lighed). Traditionel Google-søgning er betydeligt mere sandsynlig at hente information fra populære eller institutionelle websites i regering eller uddannelse, mens generative søgemaskiner er betydeligt mere sandsynlig at hente Google-ejet indhold.

‘Tredje, vi observerer, at websites, der blokerer Googles AI-crawler, er betydeligt mindre sandsynlig at blive hentet af AIOs, på trods af at have adgang til indholdet.’

Da artiklen er en smørgåsbord af fascinerende indsighter, snarere end at følge den sædvanlige lineære og metode-drevne arbejdsgang, vil vi tage en nærmere kig på disse, og nogle af dens mest overraskende og oplysende indsighter.

The Old ‘Two-One’

En af de mange interessante fund i studiet indikerer, at Googles AI-oversigter tendenser til at være undertrykt for pludselige nyhedsbegivenheder, da de tidligste og mest tilgængelige kilder måske ikke er de mest nøjagtige.

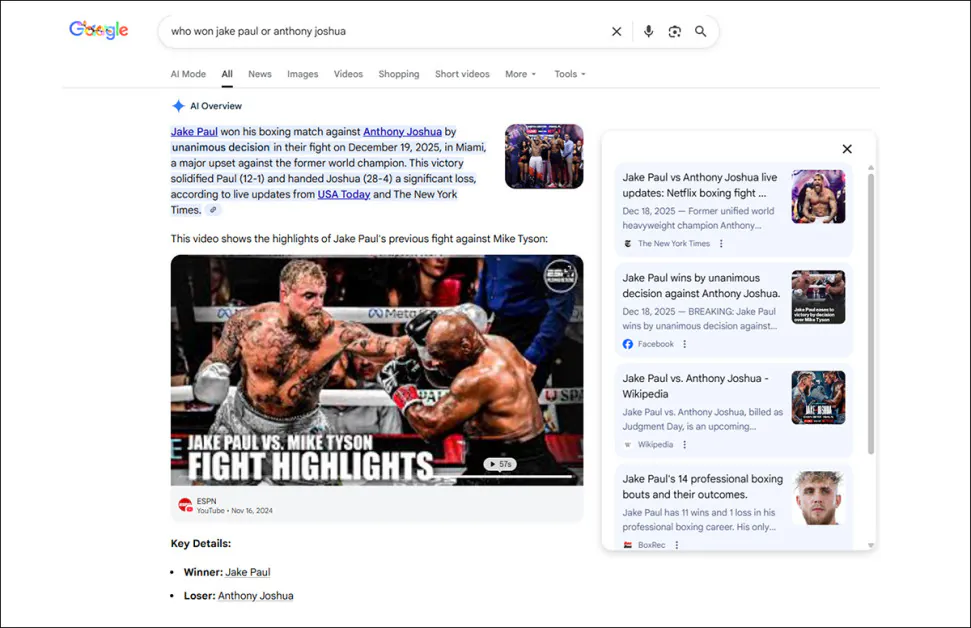

Dette system fungerer ikke altid: i eksemplet nedenfor, noteret af forskerne, en Google AI-oversigt omkring resultatet af en boksekamp tilskrev sejren til den forkerte bokser, selv om den eneste kilde, der fastslog dette (forkerte) resultat, var en satirisk sportsfeed på Facebook:

En af årsagerne til, at Googles AI-oversigter undgår tidskritiske sammenfatninger, er, at tidlige oplysninger kan være ufuldstændige eller helt urigtige. I dette tilfælde tabte bokseren Jake Paul faktisk kampen. Kilde

Forskerne noterer, at AIOs tendenser til at optræde, når en begivenhed er mindst fem dage gammel, hvilket kvalificerer dette som en anomali – men ikke desto mindre, en, som forskerne let kunne fremkalde.

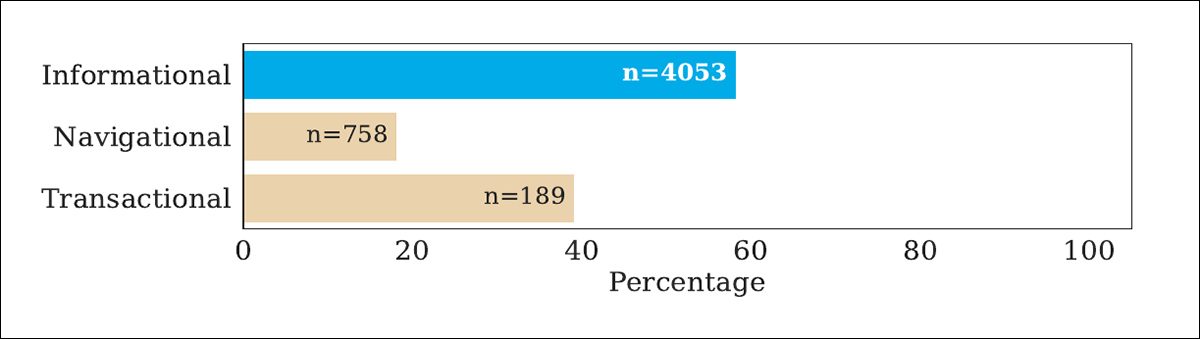

AIOs blev fundet at være mere sandsynlig at blive genereret, når forespørgslen var afsluttet med et spørgsmålstegn, og at forespørgsels-intent var en faktor i, om en AIO ville blive præsenteret:

Procentdel af tilfælde, hvor en AI-søgesammenfatning blev produceret i en af forskernes tests. Her indikerer ‘informational’ direkte spørgsmål, som tendenser til at producere AIOs mere end nogen anden type interaktion.

Derudover fastslår artiklen, længere forespørgsler tendenser til at være mere sandsynlig at producere en AI-sammenfatning i stedet for bare direkte søgeresultater, selv om forfatterne endnu ikke tilbyder en teori til at forklare dette.

A Kingdom Divided

Måske den mest overraskende overordnede resultat fra det nye arbejde er den relativt små overlap i resultaterkvalitet/type mellem Googles (nævnte) tre søgeplatforme.

Artiklen gentager, at almindelig Google-søgning, AI-oversigter og Gemini (LLM) henter markant forskellige kilder for samme forespørgsel, med overlap-scores lav nok til at antyde tre konkurrerende tilgangslogikker inden for ét selskab, hvor brugere måske antager, at Google har en autoritativ indeks, og en rangordningsfilosofi:

Selv inden for Googles eget økosystem, var overlapet mellem traditionel Søgning, AI-oversigter og Gemini overraskende småt, med samme forespørgsel ofte producerende markant forskellige kilde-lister afhængigt af, hvilket Google-system håndterede anmodningen. I denne sammenligning ser vi, hvor tæt de tre systemer matchede hinanden på tværs af tusinder af søgeforespørgsler, fra shopping og debat-emner til lokale søgninger og almindelige vidensspørgsmål, med lavere scores indikerende mindre enighed mellem de valgte kilder.

Med hensyn til denne del af deres analyse, fastslår forfatterne:

‘[Tabellen ovenfor] præsenterer den gennemsnitlige lighed mellem listen over kilder, der returneres af AIO, Gemini og traditionel SERP for hver forespørgsel i benchmark-datasættet.

‘Hovedkonklusionen er, at uanset forespørgsel-underdel og hvilket par af søgemaskiner, der sammenlignes, er de hentede lister ulige, på trods af at alle tre er udviklet af Google.’

Forskerne fastslår yderligere, at ingen af de testede søgemetoder havde en rang-biased overlap (RBO) over 0,27, hvilket er en meget lav score. De noterer yderligere, at Amazon Retail og lokaliserede forespørgsler (dvs. ‘butikker nær mig’) havde den laveste lighed mellem søgemetoderne.

De tilskriver den lave enighed til grundlæggende ‘inkonsistens mellem søgemaskiner’, noterer, at hverken tilfældighed eller nogen anden åbenlys faktor kan gøres til at forklare denne diskrepans.

En intuitiv forklaring, kan man argumentere, er, at træningsdata-punkter tildeles rang på en meget anderledes måde end de metoder, som Google har udviklet til PageRank og dens efterfølgere over de sidste to årtier. Yderligere, på den af-chance, at Googles søgealgoritme har en hemmelig dagsorden, er det meget svært, selv for Google, at få AI til at opføre sig på en forretningsmæssig måde, da Geminis PageRank-stile beslutninger dikteres ikke af Googles politik-ingeniører, men af en uperfekt forståelse af, hvordan hyperskaledata transformerer til datafordelinger og latente indlejring under træningen af en AI-model.

Self-Service..?

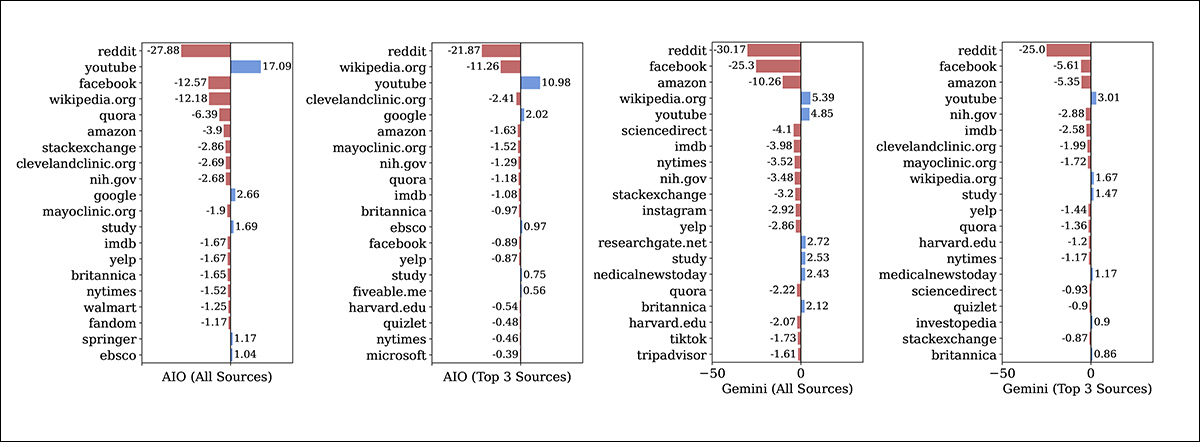

Visse websites eller kategorier af websites synes at være blevet påvirket af indførelsen af AI-sammenfatninger og LLM-baseret søgnings indtrængen i den traditionelle søge-rum – både negativt og positivt, afhængigt af sagen:

I sammenligning med traditionel Google-søgning, reducerede AI-oversigter og Gemini begge citeringer fra mange større websites, mens de øgede synligheden for en mindre mængde favoriserede domæner. YouTube blev en af de største beneficier på tværs af begge systemer, mens Reddit, Wikipedia, Facebook og mange institutionelle kilder optrådte mindre hyppigt i AI-genererede hentninger.

Forfatterne noterer, at nogle uventede præferencer opstår mellem de tre metoder under test:

‘Vi har tre hovedkonklusioner fra [grafikken ovenfor]. Først, store og velkendte websites er de mest berørte (både positivt og negativt). Dette er intuitivt, da store websites har ry og diversitet i indhold til at være relevant for mange forskellige forespørgsler.

‘Anden, den overvældende majoritet af disse websites modtager færre samlede og færre top-tre citeringer med generative søgemaskiner (indikeret af røde stolper og negative tal i [grafikken ovenfor]). Dette antyder, at generativ søgning tenderer til at hente information fra mere niche-kilder end traditionelle søgemaskiner.

‘Tredje, Googles AIOs favoriserer Google-websites (dvs. google.com og youtube.com-domæner).

‘Gemini favoriserer også YouTube i sammenligning med traditionel Google-søgning, men den absolutte forskel er mindre.’

Any ‘Blockers’..?

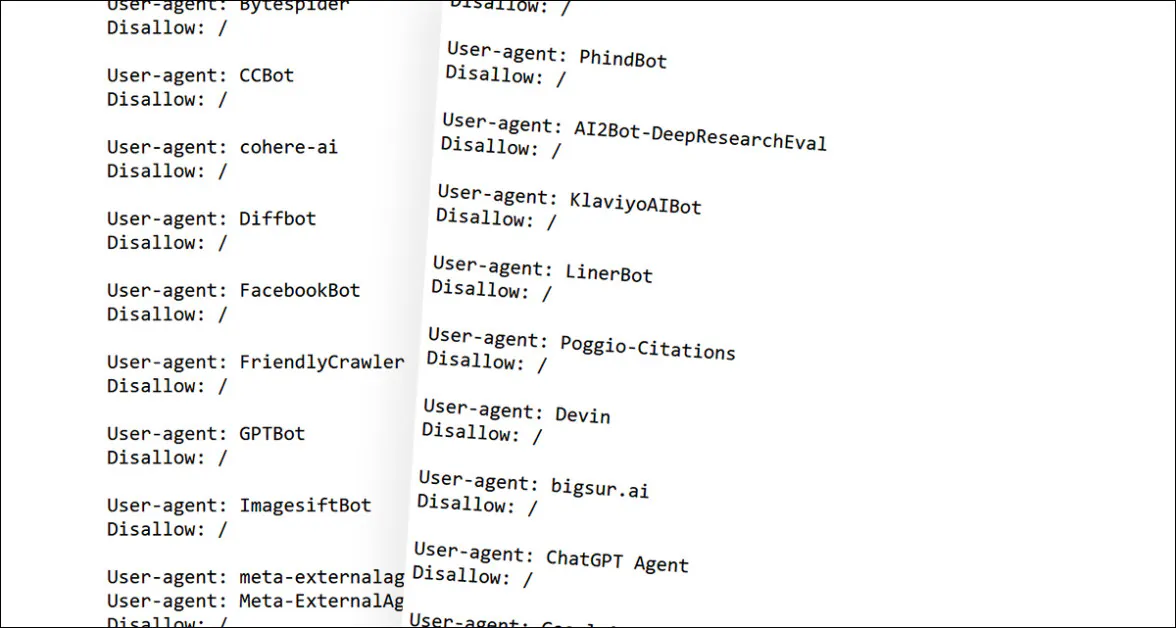

Studiet fandt også, at udgivere, der blokerer Googles AI-web-crawler – den automatiserede web-bot, der scraper data fra din side, medmindre du fortæller det ikke at gøre det med en robots.txt-fil – tenderer til ikke at optræde i AI-sammenfatninger.

Dette kan synes som en åbenlyst selvforvoldt sår, men i virkeligheden har Google offentligt erklæret, at indhold fra platforme, der blokerer AI-crawlers, vil ikke forhindre, at de optræder i AI-sammenfatninger; snarere vil udgiverne blot ikke have deres data scraped, kurateret i en samling og kørt gennem den næste runde af AI-træning til Gemini og andre Google AI-projekter.

Men, det var ikke den konklusion, som de nye artiklens forskere kom til, da de fandt, at populære AI-forbuds-udgivere var meget sjældent citeret af Gemini, enten i LLM eller i den mere agile søgeresultat-inkarnation. De ‘effektivt forbudte’ udgivere blev rapporteret af artiklen til at være NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports og STAT.

Nogle af de robots.txt AI-scraping-forbud, der er effektueret af de ovennævnte udgivere. Men har det ført til en bredere censur fra Google?

Forfatterne fastslår:

‘I vores analyse af de mest berørte domæner fandt vi, at 21 populære [udgivere] (der hentes for mindst 20 unikke forespørgsler af både Google Søgning og AIOs) aldrig blev citeret af Gemini.

‘Flere populære sociale medier (Facebook, Instagram, Tiktok) og anmeldelses-websites (IMDb, Yelp, Tripadvisor) modtog også ingen citeringer fra Gemini. Ved yderligere undersøgelse fandt vi, at alle disse websites blokerer Googles udvidede-bot i deres robots.txt-filer.’

Hvis dette fund viser sig at være verificeret andre steder og varigt, kunne man spekulere, at disse selskaber muligvis er under pres fra Google til at kapitulere og samarbejde med deres AI-operationer gennem delvis de-listning. Ved første øjekast ser resultaterne ud til at være straffende – men så er fundene fra det nye arbejde mere indikative for kaos end forudsætning; derfor er den eneste rimelige kommentar, man kan slutte sig til, at disse resultater ser overfladisk ‘spiteful’ ud, uanset hvad der virkelig forårsager dem.

Conclusion

Opinion Dette er en klarhovedet zip-bomb af en artikel, hvis blot ti primære sider udvikler sig til en næsten overvældende kaskade af yderligere fund. Da vi har haft tid til at dække kun en lille del af disse, anbefaler jeg kilde-PDF’en, selv til den almindelige læser (en sjælden begivenhed).

En ‘gul’ disposition kunne kaste mange negative fortolkninger over forfatternes opdagelser, men arbejdet er måske bedst behandlet som indikativ for en global teknologileder, der forsøger at opnå og fastholde en global føring i AI-baseret søgning, ved hjælp af højkontrasterende platforme, der udviklede sig under meget forskellige omstændigheder og på tværs af meget forskellige epoker.

Da tre søgemetoder undersøges i artiklen, er den virkelige kontention mellem traditionelle søgeresultater, rangeret af proprietære metoder, og de skarpt kontrasterende distributions-baserede udvælgelsesmetoder, der dominerer data-kurering og AI-træning.

AI Like It’s 1999

Før Googles opkomst, var det muligt at ‘spille’ søgeresultater gennem ren mængde, og på den måde kunne man ofte opnå front-side SERPS-placering med minimal (ofte automatiseret) indsats. Dette ‘tal-spil’ blev effektivt stoppet omkring 2002 af Googles mere avancerede og hemmelige søge-rang-algoritme. Men da indsatsen var betydelig, forsvandt høj-mængde og lav-kvalitetsindhold aldrig på nogen meningsfuld måde.

Derfor, da hyperskale-samlinger som Common Crawl lagde grundstenen til den moderne AI-revolution, var data-fremhævelse dømt til at blive domineret af, i hvilken udstrækning automatiserede processer kunne filtrere og rangere indkommende datakvalitet, og (langt mindre sandsynligt), i hvilken udstrækning penge var til rådighed til at betale mennesker for at rangere denne data.

Der var meget dårligt eller lav-kvalitetsdata i disse enorme og ukritiske samlinger; data, der måske ikke indeholdt nøgenhed eller bandeord eller racistiske stereotyper eller nogen af de andre ting, der er relativt let at filtrere ud af træningsdatasæt – men som alligevel var selvoptaget og omfattende, ligesom resultater fra internettet-søgning cirka 1999-2001.

Fordi disse data-induktionsprocesser er stadig ikke store, er det meget svært, selv for Google, at få AI til at opføre sig på en forretningsmæssig måde, da Geminis PageRank-stile beslutninger dikteres ikke af Googles politik-ingeniører, men af en uperfekt forståelse af, hvordan hyperskaledata transformerer til datafordelinger og latente indlejring under træningen af en AI-model.

* Søgeresultatsider.

† Forfatternes fremhævelse, ikke min. Jeg har dog erstattet fed med kursiv, da kursiv fremhævelse ikke virker godt i citater, der allerede er primært i kursiv.

Først publiceret onsdag, 13. maj 2026