Umělá inteligence

Problém černé skříňky v LLM: Výzvy a vznikající řešení

Strojové učení, podmnožina umělé inteligence, zahrnuje tři komponenty: algoritmy, trénovací data a výsledný model. Algoritmus, ve své podstatě soubor procedur, se učí identifikovat vzory z velké sady příkladů (trénovací data). Vyvrcholením tohoto tréninku je model strojového učení. Například algoritmus trénovaný s obrázky psů by vedl k modelu schopnému identifikovat psy na obrázcích.

Černá skříňka ve strojovém učení

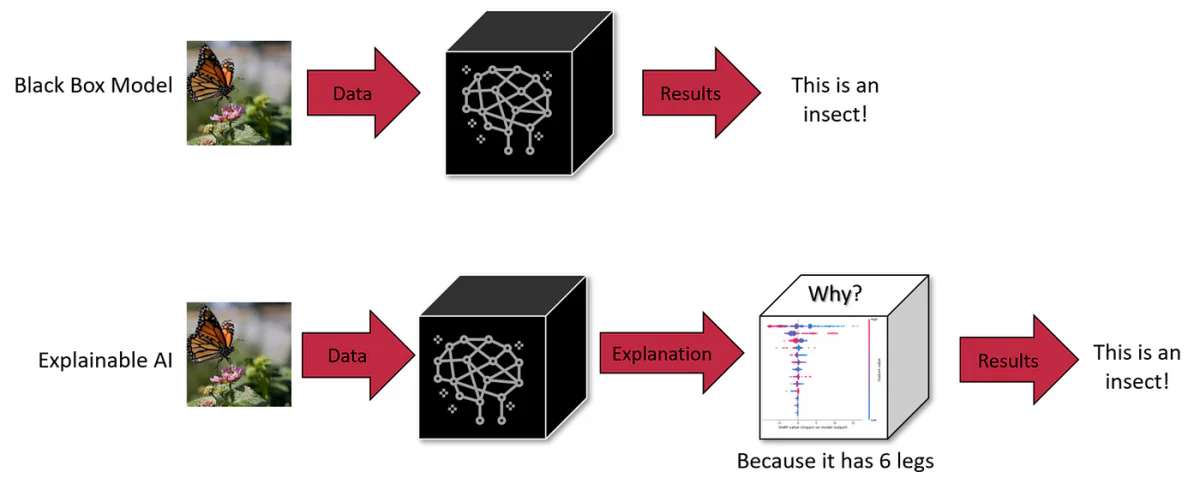

Ve strojovém učení může být kterákoli ze tří komponent – algoritmus, trénovací data nebo model – černou skříňkou. Zatímco algoritmy jsou často veřejně známy, vývojáři mohou zvolit uchovat model nebo trénovací data v tajnosti, aby chránili duševní vlastnictví. Tato neprůhlednost činí obtížným pochopit proces rozhodování umělé inteligence.

Umělé černé skříňky jsou systémy, jejichž vnitřní fungování zůstává neprůhledné nebo neviditelné pro uživatele. Uživatelé mohou zadat data a získat výstup, ale logika nebo kód, který produkuje výstup, zůstává skrytý. To je společná charakteristika mnoha systémů umělé inteligence, včetně pokročilých generativních modelů, jako je ChatGPT a DALL-E 3.

LLM, jako je GPT-4, představují významnou výzvu: jejich vnitřní fungování je značně neprůhledné, dělají je “černými skříňkami”. Taková neprůhlednost není pouze technickou hádankou; klade reálné bezpečnostní a etické obavy. Pokud například nemůžeme určit, jak tyto systémy dospěly k určitým závěrům, můžeme je důvěřovat v kritických oblastech, jako jsou lékařské diagnózy nebo finanční hodnocení?

Prozkoumání technik LIME a SHAP

Interpretovatelnost ve strojovém učení (ML) a hlubokém učení (DL) pomáhá nám nahlédnout do neprůhledných vnitřních mechanismů těchto pokročilých modelů. Místní interpretovatelné model-agnostické vysvětlení (LIME) a SHapley Additive exPlanations (SHAP) jsou dvě takové hlavní techniky interpretovatelnosti.

LIME, například, rozkládá složitost vytvořením jednodušších, místních náhradních modelů, které aproximují chování původního modelu kolem konkrétního vstupu. Tímto způsobem LIME pomáhá pochopit, jak jednotlivé funkce ovlivňují předpovědi komplexních modelů, poskytující tak “místní” vysvětlení, proč model učinil určitou rozhodnutí. Je zvláště užitečné pro netechnické uživatele, protože překládá složitý rozhodovací proces modelů do srozumitelnějších termínů.

SHAP, na druhé straně, čerpá inspiraci z teorie her, konkrétně z konceptu Shapleyových hodnot. Přisuzuje “důležitost” hodnotu každé funkci, ukazující, jak moc každá funkce přispívá k rozdílu mezi skutečnou předpovědí a základní předpovědí (průměrnou předpovědí napříč všemi vstupy). SHAPova síla spočívá v jeho konzistenci a schopnosti poskytnout globální perspektivu – nejen vysvětluje jednotlivé předpovědi, ale také poskytuje vhled do modelu jako celku. To je zvláště cenné v hlubokých učících se modelech, kde propojené vrstvy a četné parametry často dělají proces předpovědi podobným bludišti. SHAP demystifikuje toto kvantifikací příspěvku každé funkce, nabízející jasnější mapu rozhodovacích cest modelu.

SHAP (Zdroj)

Obě LIME a SHAP se staly nezbytnými nástroji v oblasti umělé inteligence a strojového učení, řešícími kritickou potřebu transparentnosti a důvěryhodnosti. Jak budeme pokračovat v integraci umělé inteligence do různých sektorů, schopnost interpretovat a pochopit tyto modely se stává nejen technickou nutností, ale také základním požadavkem pro etický a zodpovědný vývoj umělé inteligence. Tyto techniky představují významné kroky ve vyřešení složitostí modelů ML a DL, přeměňující je z nesrozumitelných “černých skřínek” na srozumitelné systémy, jejichž rozhodnutí a chování lze pochopit, důvěřovat a účinně využívat.

Měřítko a složitost LLM

Měřítko těchto modelů přidává k jejich složitosti. Vezměme si například GPT-3 s jeho 175 miliardami parametrů a novější modely s biliony. Každý parametr interaguje složitými způsoby v rámci neuronové sítě, přispívaje k emergentním schopnostem, které nelze předpovědět zkoumáním jednotlivých komponent samostatně. Toto měřítko a složitost činí téměř nemožným plně pochopit jejich vnitřní logiku, představující překážku v diagnostice zkreslení nebo nežádoucích chování v těchto modelech.

Kompromis: Měřítko vs. Interpretovatelnost

Snížení měřítka LLM by mohlo zvýšit interpretovatelnost, ale za cenu jejich pokročilých schopností. Měřítko je to, co umožňuje chování, které menší modely nemohou dosáhnout. To představuje vnitřní kompromis mezi měřítkem, schopnostmi a interpretovatelností.

Dopad problému černé skříňky LLM

1. Chybné rozhodování

Neprůhlednost v rozhodovacím procesu LLM, jako je GPT-3 nebo BERT, může vést k nezjištěným zkreslením a chybám. V oblastech, jako je zdravotnictví nebo trestní soudnictví, kde rozhodnutí mají dalekosáhlé důsledky, neschopnost auditovat LLM pro etickou a logickou správnost je závažnou obavou. Například lékařský diagnostický LLM spoléhající se na zastaralá nebo zkreslená data může učinit škodlivá doporučení. Podobně LLM v náborovém procesu může neúmyslně prodloužit genderové zkreslení. Černá skříňková povaha tak nejen skrývá chyby, ale může je potenciálně zesílit, vyžadující proaktivní přístup ke zvýšení transparentnosti.

2. Omezená adaptabilita v různých kontextech

Nedostatek vhledu do vnitřního fungování LLM omezuje jejich adaptabilitu. Například náborový LLM může být neefektivní při hodnocení kandidátů pro roli, která oceňuje praktické dovednosti nad akademickými kvalifikacemi, kvůli jeho neschopnosti upravit svá hodnocení kritérií. Podobně lékařský LLM může mít potíže s diagnostikou vzácných onemocnění kvůli nerovnováze dat. Tato inflexibilita zdůrazňuje potřebu transparentnosti pro rekalibraci LLM pro specifické úkoly a kontexty.

3. Zkreslení a mezery v znalostech

Zpracování rozsáhlých trénovacích dat LLM je podrobeno omezením uloženým jejich algoritmy a architekturou modelu. Například lékařský LLM může projevit demografická zkreslení, pokud je trénován na nevyvážených datech. Kromě toho může profese LLM v úzkých tématech být klamná, vedoucí k sebevědomým, nesprávným výstupům. Řešení těchto zkreslení a mezer v znalostech vyžaduje více než jen další data; vyžaduje zkoumání vnitřních mechanismů modelu.

4. Právní a etická zodpovědnost

Neprůhledná povaha LLM vytváří právní šedou zónu týkající se odpovědnosti za jakoukoli újmu způsobenou jejich rozhodnutími. Pokud LLM v lékařském prostředí poskytuje vadná doporučení, vedoucí k poškození pacienta, stanovení odpovědnosti se stává obtížným kvůli neprůhlednosti modelu. Tato právní nejistota představuje rizika pro subjekty nasazující LLM v citlivých oblastech, zdůrazňující potřebu jasných pravidel a transparentnosti.

5. Problémy s důvěrou v citlivých aplikacích

Pro LLM používané v kritických oblastech, jako je zdravotnictví a finance, nedostatek transparentnosti podkopává jejich důvěryhodnost. Uživatelé a regulátoři potřebují zajistit, aby tyto modely neobsahovaly zkreslení nebo nedělaly rozhodnutí založená na nespravedlivých kritériích. Ověření absence zkreslení v LLM vyžaduje pochopení jejich rozhodovacích procesů, zdůrazňující důležitost vysvětlitelnosti pro etické nasazení.

6. Rizika s osobními údaji

LLM vyžadují rozsáhlá trénovací data, která mohou zahrnovat citlivé osobní informace. Černá skříňková povaha těchto modelů vyvolává obavy o tom, jak jsou tato data zpracovávána a používána. Například lékařský LLM trénovaný na pacientských záznamech vyvolává otázky o ochraně a využívání dat. Zajištění toho, aby osobní data nebyla zneužita nebo využita, vyžaduje transparentní procesy zpracování dat uvnitř těchto modelů.

Vznikající řešení pro interpretovatelnost

Pro řešení těchto výzev se vyvíjejí nové techniky. Tyto zahrnují kontrafaktické (CF) aproximace. První metoda zahrnuje vyvolání LLM ke změně konkrétního textového konceptu, zatímco ostatní koncepty zůstávají konstantní. Tento přístup, ačkoli efektivní, je náročný na zdroje během inferenční doby.

Druhý přístup zahrnuje vytvoření speciálního vloženého prostoru vedeného LLM během tréninku. Tento prostor se shoduje s kauzálním grafem a pomáhá identifikovat shody aproximující CF. Tato metoda vyžaduje méně zdrojů během testovací doby a prokázala se jako efektivní při vysvětlování modelových předpovědí, dokonce i u LLM s miliardami parametrů.

Tyto přístupy zdůrazňují důležitost kauzálních vysvětlení v systémech NLP, aby se zajistila bezpečnost a důvěra. Kontrafaktické aproximace poskytují způsob, jak si představit, jak by se daný text změnil, kdyby určitý koncept v jeho generativním procesu byl jiný, usnadňující praktické kauzální efektivní odhady vysokých konceptů na NLP modely.

Deep Dive: Vysvětlující metody a kauzalita v LLM

Probing a nástroje pro důležitost funkcí

Probing je technika používaná k rozluštění, co vnitřní reprezentace v modelech kódují. Může být buď dohlížená nebo nedohližená a je zaměřena na určení, zda konkrétní koncepty jsou zakódovány na určitých místech v síti. Ačkoli efektivní do určité míry, sondy nedosahují poskytování kauzálních vysvětlení, jak je zdůrazněno Geigerem et al. (2021).

Nástroje pro důležitost funkcí, další forma vysvětlujících metod, se často soustředí na vstupní funkce, ačkoli některé gradientem-založené metody rozšiřují tuto analýzu na skryté stavy. Příkladem je metoda Integrated Gradients, která nabízí kauzální interpretaci prozkoumáním základních (kontrafaktických, CF) vstupů. Navzdory jejich užitečnosti tyto metody stále zápasí s propojením své analýzy se skutečnými koncepty za hranicemi jednoduchých vstupních vlastností.

Zásahem-založené metody

Zásahem-založené metody zahrnují modifikaci vstupů nebo vnitřních reprezentací ke studiu efektů na chování modelu. Tyto metody mohou vytvořit kontrafaktické stavy pro odhad kauzálních efektů, ale často generují nepravděpodobné vstupy nebo síťové stavy, pokud nejsou pečlivě kontrolovány. Causal Proxy Model (CPM), inspirovaný konceptem S-learner, je novým přístupem v tomto rámci, napodobujícím chování vysvětlovaného modelu pod kontrafaktickými vstupy. Nicméně, potřeba samostatného vysvětlovače pro každý model je významnou limitací.

Aproximace kontrafaktů

Kontrafaktory jsou široce používány ve strojovém učení pro augmentaci dat, zahrnující perturbace různých faktorů nebo štítků. Tyto lze generovat prostřednictvím manuálního editování, heuristického klíčového slova nahrazování nebo automatizovaného přepisování textu. Zatímco manuální editování je přesné, je také náročné na zdroje. Klíčové metody mají své omezení a generativní přístupy nabízejí rovnováhu mezi plynulostí a pokrytím.

Věrná vysvětlení

Věrnost ve vysvětleních se vztahuje k přesnému znázornění základního uvažování modelu. Neexistuje univerzálně přijímaná definice věrnosti, vedoucí k její charakterizaci prostřednictvím různých metrik, jako je Senzitivita, Konsistence, Shoda důležitosti funkcí, Odolnost a Simulovatelnost. Většina z těchto metod se soustředí na vysvětlení na úrovni funkcí a často splétá korelaci s kauzalitou. Naše práce si klade za cíl poskytnout vysvětlení na vysoké úrovni konceptů, využívající literaturu o kauzalitě k navržení intuitivního kritéria: Řád-věrnost.

Prokázali jsme vnitřní složitosti LLM, pochopili jejich “černou skříňkovou” povahu a významné výzvy, které to klade. Od rizik chybného rozhodování v citlivých oblastech, jako je zdravotnictví a finance, až po etické dilemata týkající se zkreslení a spravedlnosti, potřeba transparentnosti v LLM nikdy nebyla více zřejmá.

Budoucnost LLM a jejich integrace do našeho každodenního života a kritických rozhodovacích procesů závisí na naší schopnosti učinit tyto modely nejen pokročilejší, ale také srozumitelnější a zodpovědnější. Pronásledování vysvětlitelnosti a interpretovatelnosti není pouze technickým úkolem, ale základním aspektem budování důvěry v systémy umělé inteligence. Jakmile se LLM stanou více integrovanými do společnosti, poptávka po transparentnosti poroste, nejen ze strany odborníků na umělou inteligenci, ale ze strany každého uživatele, který interaguje s těmito systémy.