Umělá inteligence

Google představuje systém dotazů podobný GPT-3, bez výsledků vyhledávání

Nová studie od čtyř výzkumníků z Google navrhuje “expertní” systém, který je schopen autoritativně odpovídat na dotazy uživatelů bez předkládání seznamu možných výsledků vyhledávání, podobně jako paradigma Q&A, které se dostalo do veřejného povědomí prostřednictvím vzniku GPT-3 za poslední rok.

Studie paper, nazvaná Rethinking Search: Making Experts out of Dilettantes, naznačuje, že současný standard předkládání uživateli seznamu výsledků vyhledávání v odpovědi na dotaz je “kognitivní zátěží” a navrhuje zlepšení schopnosti systému zpracování přirozeného jazyka (NLP) poskytovat autoritativní a definitivní odpověď.

Pod proposed modelem ‘expert’, cross-domain oracle, budou tisíce možných zdrojů výsledků vyhledávání integrovány do jazykového modelu místo toho, aby byly explicitně dostupné jako průzkumný zdroj pro uživatele, aby je sami vyhodnotili a navigovali. Source: https://arxiv.org/pdf/2105.02274.pdf

Studie, vedená Donaldem Metzlerem z Google Research, navrhuje zlepšení typu multi-domain oracle odpovědí, které lze目前 získat z hlubokých autoregresivních jazykových modelů, jako je GPT-3. Hlavní zlepšení, která jsou předpokládána, jsou a) že model bude schopen přesně citovat zdroje, které informovaly odpověď, a b) že model bude zabránit “hallucinaci” odpovědí nebo vynález non-existentních zdrojů, což je目前 problém s těmito architekturami.

Multi-Domain Training And Capabilities

Navíc by navrhovaný jazykový model, charakterizovaný v studii jako “Jeden model pro všechny úkoly vyhledávání informací”, měl být trénován na různých doménách, včetně obrazů a textu. Také by potřeboval porozumění o původu znalostí, které chybí v architekturách stylu GPT-3.

‘Abyste nahradili indexy jedním, sjednoceným modelem, musí být možné, aby model sám měl znalosti o univerzu dokumentových identifikátorů, stejně jako tradiční indexy. Jedním ze způsobů, jak toho dosáhnout, je odstoupit od tradičních LM a přesunout se k modelům korpusu, které společně modelují term-term, term-dokument a dokument-dokument vztahy.’

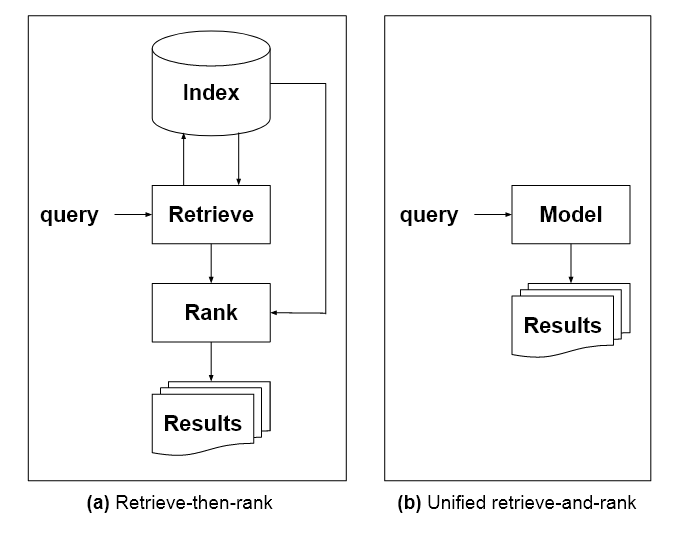

Na obrázku výše, ze studie, jsou tři přístupy k odpovědi na dotaz uživatele: vlevo, implicitní jazykové modely v algoritmu vyhledávání Google vybraly a prioritizovaly “nejlepší odpověď”, ale ponechaly ji jako horní výsledek mnoha. Uprostřed, odpověď stylu GPT-3, která mluví s autoritou, ale neospravedlňuje své nároky nebo cituje zdroje. Vpravo, navrhovaný expertní systém zahrnuje “nejlepší odpověď” z řazených výsledků vyhledávání přímo do didaktické odpovědi, s akademickými stylovými poznámkami (nezobrazenými v originálním obrázku) označujícími zdroje, které informují odpověď.

Odstranění jedovatých a nepřesných výsledků

Výzkumníci poznamenávají, že dynamická a neustále aktualizovaná povaha indexů vyhledávání je výzvou pro replikaci v modelu strojového učení tohoto typu. Například, pokud jednou důvěryhodný zdroj byl trénován přímo do modelu porozumění světa, odstranění jeho vlivu (například po jeho diskreditaci) může být obtížnější než odstranění URL z SERP, protože datové koncepty mohou stát abstraktní a široce reprezentované během asimilace během tréninku.

Navíc by takový model potřeboval být neustále trénován, aby poskytoval stejnou úroveň reaktivity na nové články a publikace, jako je目前 poskytována službou Google’s constant spidering zdrojů. Efektivně to znamená kontinuální a automatizovanou aktualizaci, na rozdíl od současného režimu, kde jsou provedeny malé úpravy vah a nastavení volného vyhledávacího algoritmu, ale algoritmus sám je obvykle aktualizován pouze příležitostně.

Útočné plochy pro centralizovaný expertní oracle

Centralizovaný model, který neustále asimiluje a generalizuje nové údaje, by mohl transformovat útočnou plochu pro dotazy vyhledávání.

V současnosti může útočník získat prospěch tím, že získá vysoké hodnocení pro domény nebo stránky, které buď obsahují dezinformace nebo škodlivý kód. Pod záštitou více neprůhledného “expertního” oracle je možnost přesměrovat uživatele na útočné domény značně snížena, ale možnost injektáže jedovatých útoků dat je značně zvýšena.

To je protože navrhovaný systém neeliminuje algoritmus vyhledávání, ale skrývá ho před uživatelem, efektivní automatizací priority horního výsledku/výsledků a jejich začleněním do didaktické odpovědi. Útočníci již dlouho mohou orchestrovat útoky proti algoritmu vyhledávání Google, aby prodávali falešné produkty, směrovali uživatele na domény, které šíří malware, nebo pro účely politické manipulace, mezi mnoha dalšími případy použití.

Not AGI

Výzkumníci zdůrazňují, že takový systém by byl nepravděpodobně kvalifikován jako Umělá Obecná Inteligence (AGI) a umístí perspektivu univerzálního expertního respondéra v kontextu zpracování přirozeného jazyka, podrobeného všem výzvám, kterým čelí současné modely.

Studie uvádí pět požadavků na “high-quality” odpověď:

1: Autorita

Stejně jako u současných algoritmů řazení, “autorita” parece být odvozena z citací z vysoce kvalitních domén, které jsou považovány za autoritativní samy o sobě. Výzkumníci poznamenávají:

‘Odpovědi by měly generovat obsah tak, že budou čerpat z vysoce autoritativních zdrojů. To je další důvod, proč je tak důležité stanovit explicitní souvislosti mezi sekvencemi termínů a metadata dokumentu. Pokud všechny dokumenty v korpusu jsou anotovány s autoritativitou, tato autoritativita by měla být zohledněna při tréninku modelu, generování odpovědí nebo obou.’

Ačkoli výzkumníci nenavrhuje, že tradiční výsledky vyhledávání by se staly nedostupnými, pokud by expertní oracle tohoto typu byl nalezen jako performantní a populární, celá studie prezentuje tradiční řazený systém a seznamy výsledků vyhledávání v světle “desítky let starého” a zastaralého systému vyhledávání informací.

‘Skutečnost, že řazení je kritickou součástí tohoto paradigmatu, je symptomem toho, že systém vyhledávání poskytuje uživatelům výběr potenciálních odpovědí, což indukuje poměrně značnou kognitivní zátěž na uživatele. Přání vrátit odpovědi místo řazených seznamů výsledků bylo jedním z motivujících faktorů pro vývoj otázek a odpovědí.’

2: Průhlednost

Výzkumníci komentují:

‘Kdykoli je to možné, měla by být uživatelům zpřístupněna provenience informací, které jsou jim prezentovány. Je to primární zdroj informací? Pokud ne, co je primární zdroj?’

3: Zpracování biasu

Studie poznamenává, že předtrénované jazykové modely jsou navrženy tak, aby nehodnotily empirickou pravdu, ale aby generalizovaly a prioritizovaly dominantní trendy v datech. Přiznává, že toto směrnice otevírá model útokům (jako se stalo u Microsoftova neúmyslně rasistického chatbota v roce 2016), a že budou potřebné pomocné systémy, aby zajistily ochranu proti takovým předpojatým systémovým odpovědím.

4: Povolení různých pohledů

Studie také navrhuje mechanismy, aby zajistila pluralitu pohledů:

‘Generované odpovědi by měly reprezentovat řadu různých perspektiv, ale neměly by být polarizující. Například pro dotazy o kontroverzních tématech by měly být pokryty obě strany tématu v férové a vyvážené podobě. To samozřejmě má blízké vazby na modelový bias.’

5: Přístupný jazyk

Kromě toho, že poskytuje přesné překlady v případech, kdy je považována za autoritativní odpověď v jiném jazyce, studie navrhuje, že uzavřené odpovědi by měly být “napsány v co nejjednodušších termínech”.