Myslitelé

Autonomní agenti potřebují více než pouze pozorovatelnost AI

Společnosti používají agentní AI k myšlení, jednání a iniciaci pracovních postupů, je proto nezbytné vyvinout plán na monitorování a řízení těchto agentů.

Když různé komponenty systému AI začínají dělat své vlastní rozhodnutí, pozorovatelnost sama o sobě nestačí k zajištění stability, bezpečnosti nebo spolehlivosti operací.

Abyste mohli efektivně řídit agentní AI v rámci celé společnosti, musíte most mezi identifikací problémů a akcí. To přesahuje pouhé pozorování problémů; společnosti musí aktivně předcházet jim.

Vznik autonomních agentů

První vlna podnikového AI byla založena na systémech založených na dotazech; uživatel položil otázku, model odpověděl a výměna skončila tam. Ačkoli tyto rané technologie byly v podstatě reaktivní, byly užitečné pro vyhledávání, kopiloty, tvorbu obsahu a souhrny.

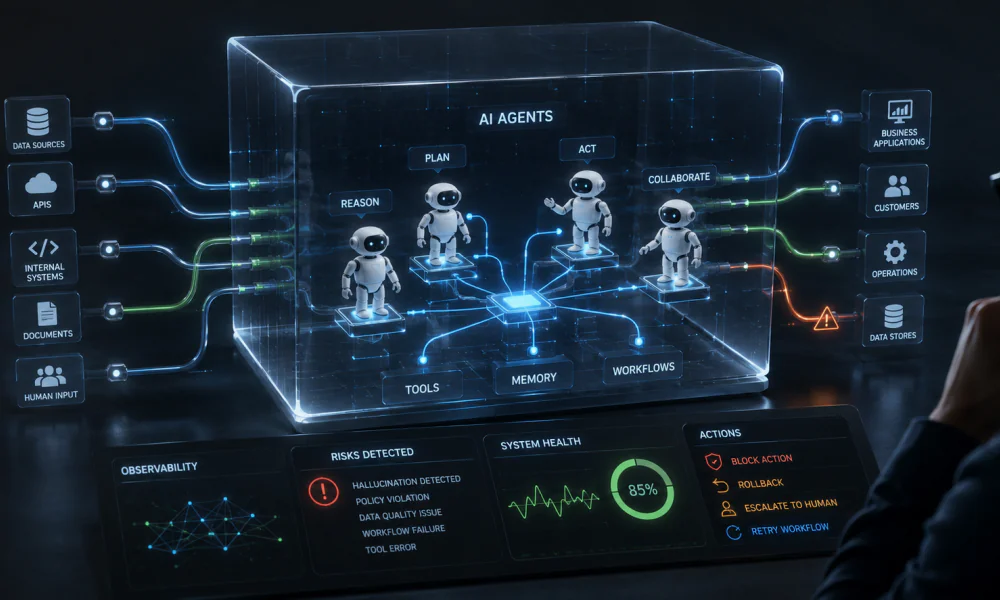

Následující vlna je odlišná. Nejenže autonomní agentní AI reagují, ale také rozumí přes cíle, vybírají nástroje, extrahují informace, činí akce a iniciují pracovní postupy. Někdy pracují ve spolupráci s jinými agenty nebo systémy a stále více slouží jako operativní hráči v rámci společnosti, spíše než jako rozhraní pro lidské instrukce.

Tato změna je významná, protože ovlivňuje provozní charakteristiky AI. Týmy již nejsou pouze zaměřeny na výstupy modelů. Místo toho řídí dynamické systémy, které mohou okamžitě ovlivnit zákazníky, personál, infrastrukturu, obchodní procesy a další aplikace.

Schopnosti agentů dnes

Schopnosti agentů se vyvíjejí spolu s nimi. Agenti mohou vybrat, co udělat dál, rozložit cíl na kroky a dokončit činnosti na různých úrovních. Kontaktem s API, dotazováním databází, vyhledáváním vnitřních systémů, aktualizací záznamů a iniciací následných akcí koordinují pracovní postupy. Integrací podnětů, paměti, obchodních pravidel, získaných informací a provozních signálů v reálném čase mohou agenti také činit kontextová rozhodnutí.

Více sofistikovaní agenti mohou identifikovat, kdy pracovní postup selže, pokusit se znovu, eskalovat problémy nebo předat úkoly lidskému recenzentovi. V rámci CRM, ticketingu, cloudové infrastruktury, interních znalostních bází, platforem pro pozorovatelnost a obchodních aplikací mohou agenti fungovat nezávisle. Předpokládáme, že tyto dovednosti budou dále rychle expandovat.

Jak společnosti integrují autonomní agentní AI

Agenti jsou začleňováni do stále rostoucího počtu organizačních operací a dostávají se blíže k provozním procesům, kde je důležitá rychlost, přesnost, bezpečnost a správa. Některé z těchto operací zahrnují: zákaznickou podporu a zpracování případů, reakci na incidenty a IT operace, pracovní postupy pro DevOps a závislost webu, opravu kódu a vývoj softwaru, provozní a dodavatelské plány a další.

Vznikající provozní hrozby

Nicméně, jak agenti získávají stále větší nezávislost, společnosti musí řešit nový typ provozní hrozby.

- Špatná rozhodnutí nejsou pouze doporučena; jsou často provedena

- Menší chyby se mohou rychle rozšířit do dalších propojených systémů

- Skutečné akce mohou být spuštěny halucinacemi

- Agenti se mohou odchýlit od obchodního záměru, politiky nebo souladu

- Interakce mezi několika komponentami mohou vést k selháním

- Automatizované rozhodování může učinit rozhodnutí rychleji než lidská evaluace

Zatímco týmy mohou pozorovat symptomy, musí být také schopny pochopit důvody za chováním systému. Podnikový AI potřebuje kontrolní prvky kromě pozorovatelnosti.

Složitosti systémů AI

Dnešní systémy poháněné AI zřídka tvoří jediný model. Jsou to distribuované, vrstvené systémy složené z mnoha interagujících komponent, které zahrnují:

- Základní modely (LLM)

- Jemně vyškolené nebo úkolem specifické malé jazykové modely (SLM)

- Modely pro vkládání

- Vektorové databáze

- Získávání dat a komponenty RAG

- Šablony pro podněty a vrstvy pro orchestraci podnětů

- Trénovací a evaluační datové sady

- Bezpečnostní prvky a vrstvy zásad

- Agenti a pracovní postupy

- Systémy pro volání nástrojů

- Telemetrie (tj. protokoly, metriky a stopy)

- Lidská kontrola v smyčce pro schvalování

Rizikové faktory

Každá komponenta přidává jiný režim selhání a způsob, jakým interagují, přidává další složitost. I když systém vypadá silný na úrovni infrastruktury, může stále dělat špatná rozhodnutí a generovat uspokojivé výsledky; a zároveň budovat provozní riziko pod povrchem.

Některá z těchto souvisejících rizik zahrnují: zavedení špatných nebo poškozených vstupů do datových potrubí, infrastrukturní úzká místa, která snižují spolehlivost, škodlivé nebo nesprávné výsledky a provozní úzká místa v reakci na lidskou kontrolu. Tyto problémy jsou dále komplikovány systémy s více agenty nebo kroky, které mohou selhat způsobem, který není okamžitě zřejmý.

Pozorovatelnost AI

Tradiční monitorování je nedostatečné pro pochopení chování podnětů, kvality získávání, posunu modelu, kanálů pro spuštění agenta nebo spojení mezi chováním AI a následným obchodním nebo provozním dopadem.

To je místo, kde pozorovatelnost AI přichází. Pozorovatelnost AI umožňuje týmům pochopit, jak systémy AI fungují ve výrobě, shromažďováním, korelací a hodnocením vstupů a výstupů, požadovaného chování a signálů pro rozhodnutí generovaných těmito systémy. To je nezbytné, protože systémy AI jsou rozptýlené, nedeterministické a extrémně kontextově citlivé.

Pozorovatelnost AI nabízí komplexní přehled o pracovních postupech AI, takže týmy, které ji využívají, mohou pochopit, jak podněty, modely, vrstvy pro získávání, nástroje a následné systémy interagují během provádění.

Pozorovatelnost AI umožňuje sledovat výkon a chování, včetně latence, nákladů, využití tokenů, propustnosti, míry chyb, chování modelu a ukazatelů kvality výstupu. Sleduje a analyzuje cesty pro provádění v komplexních pracovních postupech agenta a demonstruje, jak jsou výsledky dosaženy napříč několika kroky a závislostmi.

Pozorovatelnost AI také odhaluje anomálie napříč provozními a signály AI, odhalováním anomálního chování v modelech, potrubích, infrastruktuře nebo uživatelských výsledcích, než je týmy objeví ručně. Zrychluje diagnostiku, když něco jde špatně, a usnadňuje vyšetřování příčin, včetně AI-specifických operací do systémové telemetrie (protokoly, metriky, stopy a události).

Pozorovatelnost sama o sobě nestačí

Navzdory tomu, že je pozorovatelnost AI nezbytnou obchodickou praxí, má inherenty omezení.

Pozorovatelnost je diagnostická, nikoli preventivní; týmy se mohou dozvědět, co šlo špatně, ale nemusí nutně vědět, jak tomu zabránit. Je důležité pochopit, že znalost minulých akcí agenta se automaticky nepřekládá do kontroly nad budoucími akcemi agenta.

Při složitých, nedeterministických systémech může pozorovatelnost často týmy zahlcovat daty, která vedou k nejistotě. Místo toho, aby nabízela provozní odpověď, pozorovatelnost často končí u vysvětlení. I když jsou týmy vědomi problému, nemusí mít automatizaci, bezpečnostní prvky a kontrolní smyčky nezbytné pro nápravná opatření.

To vytváří provozní mezery. Společnosti mohou identifikovat drift, špatné výsledky, nebezpečné chování nebo sníženou produktivitu, ale mohou stále být neschopny tomu zabránit, zmírnit jeho účinky nebo udržet autonomní systémy v rámci bezpečných provozních parametrů.

To znamená, že týmy pokračují v reakčním provozu. Používají manuální zásahy, když něco selže, vyšetřují incidenty dodatečně a spoléhají na lidskou práci, aby nahradily systémy, které se stávají rychlejšími a autonomnějšími.

Přehled spolehlivosti AI

Spolehlivost AI jde nad rámec pouhého pozorování problémů. Je to disciplína zajišťující, že systémy AI fungují bezpečně, konzistentně, předvídatelně a úspěšně v reálných výrobních prostředích. Spolehlivost AI chápe a spravuje celý systém systémů kolem AI. Zavírá smyčku mezi detekcí a akcí.

Spolehlivost AI se zaměřuje na to, zda celý systém poháněný AI může fungovat v rámci rozumných provozních omezení po delší dobu, spíše než zda model poskytl přesnou odpověď. Kvalita, bezpečnost, odolnost, vysvětlitelnost, soulad s politikou, nákladová efektivita a provozní stabilita jsou všechny součástí rovnice.

Přechod z detekce na prevenci

Spolehlivost AI snižuje dobu mezi rozpoznáním problému a jeho řešením. Přesouvá diskusi z “co šlo špatně?” na “jak rychle se naše AI zlepší?” Používání následujících technik posouvá pozorovatelnost z pasivní observace na proaktivní prevenci:

- Korelace signálů napříč modely, daty a infrastrukturou pro identifikaci problémů

- Proaktivní detekce problémů před dopadem

- Ověření všech vstupů a výstupů v pravděpodobnostních systémech AI pro detekci jemných změn chování

- Vytvoření zpětné vazby mezi detekcí nežádoucího výstupu ve výrobě a použitím této zpětné vazby pro generování dat pro jemné doladění, která zlepšují přesnost základních modelů

- Sledování pracovních postupů více agentů pro zajištění spojení mezi kroky a závislostmi

- Definované lidské smyčky pro agenty pro bezpečnou odpověď a automatizovanou nápravu

Zavření mezery mezi kontrolou a pozorováním

Společnosti profitují z rámců, které integrují viditelnost a kontrolu a vyžadují více než pouze vrstvu pro pozorovatelnost nad generativní AI. V deterministických i nedeterministických systémech může platforma pro spolehlivost identifikovat, předvídat, vysvětlit a pomoci při kontrole problémů.

Následující prvky by měly být zahrnuty do životaschopného rámce pro spolehlivé operace AI:

- Integrovaná telemetrie pro IT systémy i systémy AI

- Sledování pracovních postupů agenta a závislostí systému

- Sledování chování a kvality AI (podněty a evaluační údaje)

- Pokročilá detekce anomálií, bez ohledu na zdroj

- Kauzální uvažování a analýza příčin

- Upozornění, která se automaticky přizpůsobí vašemu prostředí a nevyžadují manuální prahové hodnoty

- Vynucení zásad a bezpečnostní prvky

- Lidská evaluace jemných nebo významných akcí

- Automatizace pracovních postupů a koordinace nápravy

- Použití prediktivní analýzy pro prevenci problémů

- Zpětné vazby, které spojují detekci anomálií se zlepšenou kvalitou modelu AI

Usnadnění funkcí AI

Systémy AI závisí na infrastruktuře, službách, datových potrubích a provozních postupech; neselhávají samy o sobě. Týmy získávají úplný přehled, když kombinují spolehlivost AI a IT.

Tenká vrstva LLM by neměla být základem důvěryhodné platformy. Pro identifikaci a opravu problémů, které ostatní generativní nástroje AI přehlížejí, by měly být zvažovány různé techniky AI, včetně nesupervizované AI, prediktivní AI, kauzální AI a generativní AI. Tato kombinace technik je obecně známa jako „kompozitní AI“.

Generativní AI je dobrá v souhrnech přirozeného jazyka. Je nejlépe vhodná pro situace, které vyžadují uvažování přes nestrukturovaná data nebo interakci s lidmi. Ale to se nehodí tvaru většiny problémů se spolehlivostí ve výrobě.

Prediktivní AI se zaměřuje na identifikaci raných signálů, než se stanou výpadky, špatnými zákaznickými zkušenostmi nebo drahými selháními, pomocí algoritmů pro detekci anomálií.

Kauzální AI pomáhá určit skutečné příčiny, aby odhalila, zda kvalita získávání, chování modelu, zpomalení infrastruktury, drift dat nebo selhání následného systému byla příčinou poklesu výkonu.

Nesupervizovaná AI autonomně odhaluje skryté vzory, struktury nebo anomálie v datech bez lidského vedení. Převyšuje generativní AI pro spolehlivost, protože se zaměřuje na nalezení skrytých struktur v komplexních, nekategorizovaných datech pro seskupení podobných položek nebo nalezení vztahů.

Když je riziko, nejistota nebo obchodní dopady významné, operativní agenti AI musí být schopni automatizovat reakci, zatímco zachovávají lidskou účast pro spolehlivé operace.

Pochopení modelu AI pro konkrétní obchodní kontext lze vylepšit při každé interakci pomocí učení s posilováním z reálných uživatelských dat ve výrobě.

I ty nej pokročilejší systémy jdou za upozorněním; uzavřená nápravná smyčka se učí z každé události, automatizuje rozpoznávané reakce a spouští bezpečná opatření.

Příprava na autonomní systémy AI

Společnosti se mohou připravit na autonomní systémy AI několika způsoby. První, agenti by měli být považováni za provozní systémy, nikoli za nástroje pro produktivitu. Jakmile agent získá schopnost jednat, stává se nedílnou součástí obchodních operací a měl by být regulován odpovídajícím způsobem.

Týmy mohou zaznamenat signály z modelů, podnětů, nástrojů, pracovních postupů, infrastruktury a uživatelských výsledků okamžitě instrumentací agentů. Tento základní dohled by neměl být odložen, dokud agenti nebudou nezbytní pro obchodní operace.

Stanovení standardů pro spolehlivost před rozsáhlým nasazením agentů je také zásadní. Místo toho, aby byly zavedeny dodatečně, měly by být přijatelné prahové hodnoty pro bezpečnost, latenci, míru chyb, riziko halucinací, soulad s politikou a obchodní dopad začleněny do jejich návrhu.

Propojení chování AI s podkladovými systémy a postupy, které je podporují, umožňuje společnostem integrovat operace AI a IT. Používání různých nástrojů pro infrastrukturu a monitorování modelů vytváří slepá místa.

Platformový inženýring, SRE, bezpečnostní týmy, datové týmy, týmy AI a majitelé podniků musí spolupracovat, aby poskytli spolehlivé operace AI, a autonomní systémy překračují tradiční sila.

Každá událost, anomálie a téměř selhání budou zlepšovat systém začleněním zpětných vazeb do operací, což umožní společnostem kontinuálně se učit z chování ve výrobě.

Nakonec je zásadní vybrat platformy, které jsou navrženy pro kontrolu, nikoli pouze pro pozorování. Společnosti budou profitovat ze systémů, které integrují pozorovatelnost, predikci, vysvětlení a akci, protože agenti AI budou stále autonomnější. Organizace, které úspěšně přejdou z identifikace problémů na bezpečné řízení výsledků, budou vítězi.

Závěrečné shrnutí

AI v podnikání je nyní provozním systémem v podnikovém prostředí, nikoli nástrojem. Ve skutečných výrobních prostředích zajišťuje přidání spolehlivosti do systémů AI bezpečné, konzistentní, předvídatelné a efektivní operace.