Andersonův úhel

AI Raději Čte Knihu Než Sleduje Film

Je překvapivě obtížné donutit modely AI, aby sledovaly a komentovaly skutečný videoobsah, i když jsou pro tuto úlohu vytvořeny. Více se zajímají o psaný text.

Pokud jste někdy zkoušeli nahrát malé video na ChatGPT nebo na podobný populární model jazyka a vidění, mohli jste být překvapeni, že nemohou vlastně rozpoznat video. Zatímco modely, jako je ChatGPT-4o+, jsou schopny analyzovat jednotlivé snímky – ve formě obrázků, jako jsou JPEG a PNG – preferují, aby uživatel extrahoval自己的 snímky a nahrál je jako obrázky (které jsou připraveny komentovat).

V případě série OpenAI GPT lze, poměrně zdlouhavě, extrahovat kompletní běh snímků z video klipu a krmit je do ChatGPT, za účelem, například, generování AI-vytvořené narativní stopy pro video:

![Obrázky a kód z OpenAI tutoriálu o parsování více extrahovaných snímků za účelem vývoje AI-generované komentáře pro video klip. [ Zdroj ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Obrázky a kód z OpenAI tutoriálu o parsování více extrahovaných snímků za účelem vývoje AI-generované komentáře pro video klip. Zdroj

Ale uživatel musí provést konverzi z videa na snímky, buď voláním funkcí v větší rutině, jako je výše uvedený příklad, nebo extrahováním snímků pomocí FFMPEG nebo různých bezplatných a placených video editorů.

Do jisté míry, možná i velké míry, omezení video analýzy ve velkých produktech, jako je ChatGPT, závisí na výkonu zdrojů: pouze jeden AI instance s výběrem nejoblíbenějších video kodeků a závazkem výpočetních zdrojů k disku-těžké a CPU-throttling procesu extrakce není žádná malá úvaha, pokud se stovky milionů uživatelů rozhodnou začít používat tyto zařízení každý den.

Kromě toho může temporální analýza malovat velmi odlišný obraz než jeden snímek (představte si někoho, kdo vchází do domu v dobrém rozmaru a poté objeví tělo); proto je zvažování celého temporálního “kontrolního součtu” i krátkého video klipu náročným a výpočetně náročným úkolem – stejně jako specializovaná oblast výzkumné literatury, například s pokračujícím vývojem rámců, jako je Optical Flow – který vlastně “rozvinuje” délku videa, aby mohla být považována a jednáním, jako kdyby to byla statický dokument:

![Optické tokové diagramy ukazují, jak je pohyb sledován napříč snímky ve video sekvenci, se zelenými vektory ukazujícími směr a intenzitu pohybu. Tyto mapy poskytují temporální kontinuitu potřebnou pro VLM a mohou také sloužit jako strukturální průvodci ve VFX pracovních postupech. [ Zdroj ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optické tokové diagramy ukazují, jak je pohyb sledován napříč snímky ve video sekvenci, se zelenými vektory ukazujícími směr a intenzitu pohybu. Tyto mapy poskytují temporální kontinuitu potřebnou pro VLM a mohou také sloužit jako strukturální průvodci ve VFX pracovních postupech. Zdroj

Uspokojení s Klíčovými Body

Nicméně, protože modely, jako je Google’s Notebook LM a nedávnější verze ChatGPT, jsou schopny číst přidružené metadata (tj. vestavěný textový obsah, který kontextualizuje video nějakým způsobem), nepřímo zakazují nahrávání video souborů; a někdy se dokonce pokusí interpretovat video, které nemá žádná taková data.

V následujícím případě jsem nahrál 6sekundový náhodný klip z italského filmu Ruka Boží (2021) do NotebookLM, zajistil, že klip neobsahoval žádný užitečný text, ani v metadata, ani v názvu souboru.

NotebookLM pak pokračoval v elaborovaném halucinování materiálu zcela nesouvisejícího s videem*, kompletně s nesmyslným a nesouvisejícím pětiminutovým rozhovorem:

Každodenní okamžik v 6sekundovém klipu z italského filmu je divoce špatně interpretován NotebookLM. Zdroj: Google NotebookLM

Ačkoli Notebook, stejně jako ChatGPT, přijme YouTube video jako vstup, bude to dělat pouze tehdy, pokud video obsahuje interpretovatelnou textovou vrstvu anotace a/nebo titulky (ne rasterizované titulky, které jsou vypáleny do videa).

Tímto způsobem je tvrdá práce skutečného hledání na obsah videa a provedení sémantické interpretace (právní nutnost pro YouTube, kvůli jeho opatřením na ochranu autorských práv, a jeho budoucím systémem na ochranu identity), provedena po nahrání uživatelem, kdykoli mohl být klip přidělen nezbytným zdrojům.

Skutečná video interpretace je drahá a vyčerpávající, a, jak se ukázalo, i modely, které byly speciálně vyškoleny pro tento úkol, raději čtou text než skutečně hledí na video.

TL;DW

To, podle nové studie z britské Univerzity v Bristolu, nazvané Video není Worth tisíc slov, kde autoři docházejí k závěru, že současné modely VLM (Vision Language Models) – modely speciálně určené pro analýzu videa – také přecházejí na textové informace, kdykoli je to možné.

Když byly dané pohyblivé obrázky a psané otázky a multiple-choice odpovědi, autoři studie zjistili, že modely obvykle založily své výběry na vzorcích v textu, spíše než na čemkoli, co se děje na obrazovce – ve mnoha případech fungovaly stejně dobře, i když byla otázka odstraněna úplně.

V tom, co vypadá jako zvyk zkracování nebo podvádění, co bylo nejdůležitější pro většinu modelů, bylo schopnost rozpoznat vzorce v možných odpovědích; pouze když byl úkol učiněn obtížnějším, přidáním více odpovědí, začaly AI začít věnovat pozornost videu.

Autoři provedli VQA testy za různých podmínek u šesti VLM modelů různých kontextových délek, na čtyřech vhodných datech; a zjistili, že výsledky ukazují, že modely závisí na textu spíše než na video obsahu.

![Příklad ze studie, který ukazuje, jak video-analytický model váží to, co vidí, ve srovnání s tím, co čte. Klip ukazuje osobu, která tká bambus, ale model přiřazuje mnohem větší důležitost psanému otázkám a odpovědím než video snímkům samotným. Modré zvýraznění označuje prvky, které podporují zvolenou odpověď, zatímco červené označují ty, které ji táhnou v opačném směru, ilustrujíce, jak se modelovo uvažování zaměřuje na znění spíše než na pohyblivé obrázky. [ Zdroj ] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Příklad ze studie, který ukazuje, jak video-analytický model váží to, co vidí, ve srovnání s tím, co čte. Klip ukazuje osobu, která tká bambus, ale model přiřazuje mnohem větší důležitost psanému otázkám a odpovědím než video snímkům samotným. Modré zvýraznění označuje prvky, které podporují zvolenou odpověď, zatímco červené označují ty, které ji táhnou v opačném směru, ilustrujíce, jak se modelovo uvažování zaměřuje na znění spíše než na pohyblivé obrázky. Zdroj

Metoda

Abychom porozuměli, jak každý vstup přispívá k modelovému rozhodnutí, nová práce používá metodu z herní teorie nazvanou Shapley Values. Původně navržená pro spravedlivé rozdělení odměny mezi hráči v koalici, Shapley Values přiřazují kredit každému “hráči” na základě jeho individuálního dopadu.

Efektivně tedy “hráči” v tomto scénáři jsou buď video snímky nebo textové komponenty (anotace, titulky, popisky atd.) VQA úkolu; a “odměna” je modelova konečná odpověď. Prostřednictvím systematického testování toho, co se stane, když je každá část přidána nebo odstraněna, tato technika odhaluje, jak důležitý byl každý prvek při dosažení zvolené odpovědi.

V případě nové studie byly Shapley Values přizpůsobeny pro zpracování smíšených modalit, s video a textovými komponentami zpracovanými odděleně, a jejich různé vlivy na modelovy výstupy byly měřeny, což odhalilo, zda video obsah byl skutečně interpretován, nebo zda byly použity psané nápovědy jako zkratky.

Metriky

Byly definovány dvě jednoduché metriky pro srovnání, jak každý modus (tj. video, otázka nebo odpověď) přispívá k modelovému rozhodnutí: Modální Příspěvek měří, kolik z celkového vysvětlení pochází z každého typu vstupu; zde jsou všechny dostupné Shapley hodnoty sečteny a podíl patřící každému modusu vypočten jako procento z celkového.

Druhá, Příspěvek na funkci koriguje fakt, že některé modality, jako je video, obsahují mnohem více funkcí než ostatní. Místo toho je vypočten průměrný Shapley hodnot pro každou funkci a tyto průměry jsou srovnány, aby určily, která modální vliv je dominantní.

Data a Testy

Autoři otestovali přístup na šesti VLM modelech s různými charakteristikami, navržených tak, aby zajistily, že testy jsou obecně aplikovatelné a generalizovatelné. Proto byly modely vybrány pro různé kontextové délky, různé věky (tj. jak dlouho od vydání rámce) a různé architektonické konfigurace.

Kandidáti byli FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (který využívá Qwen2); a LongVA (také využívající Qwen2).

S stejným cílem různorodé variety byly čtyři cílové datové sady vybrány EgoSchema, VQA datová sada navržená tak, aby byla dokončena bez plného zobrazení přidružených videí; HD-EPIC, kuchyňská datová sada s některými neobvykle dlouhými videi; MVBench, kurátorská sbírka příspěvků z jiných datových sad; a LVBench, která klade VQA dotazy pro velmi dlouhá videa.

Z nich autoři vytvořili 60 otázek – deset z každé otázka typu.

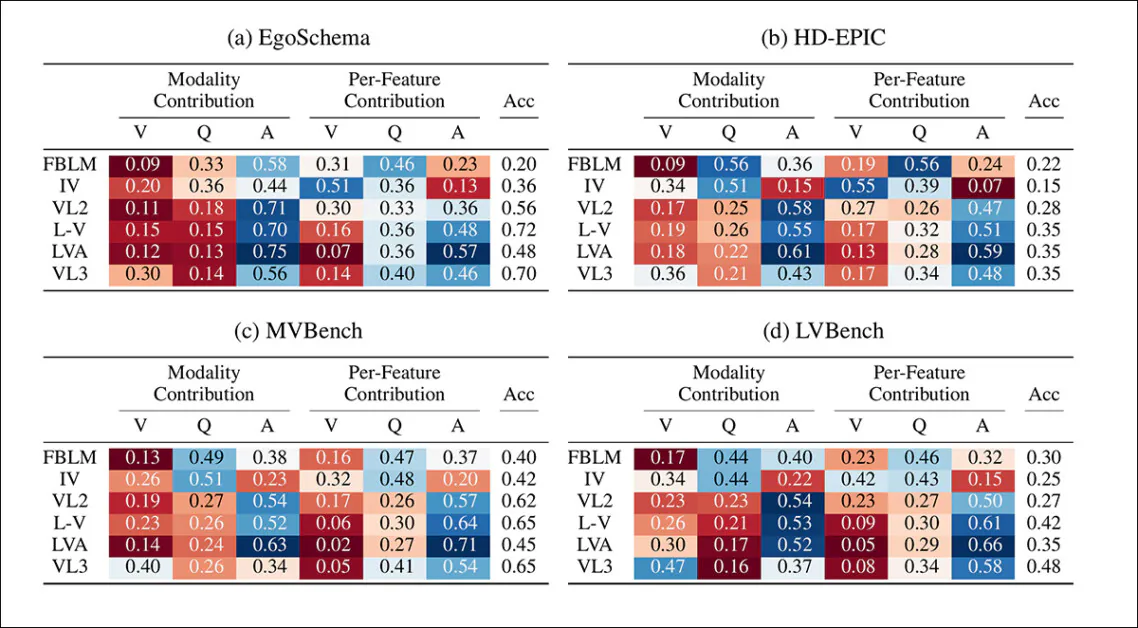

Příspěvkové metriky jasně ukázaly, že většina modelů spoléhala méně na video než na text, zejména když byly posuzovány snímek po snímku. I když video mělo rozumný výkon v celkovém příspěvku, jeho vliv na funkci byl často minimální, naznačující, že zatímco model mohl používat video v agregátu, věnoval málo pozornosti jednotlivým snímkům. VideoLLaMA3 byl hlavním outlierem, s těžší vizuální závislostí, zejména na delších sekvencích v LVBench:

Modální Příspěvek (MC) a Příspěvek na funkci (PFC) skóre napříč modely a datovými sadami, ukazující relativní váhu video (V), otázka (Q) a odpověď (A) vstupů. Chladnější barvy označují silnější příspěvky; teplejší barvy označují slabší nebo zanedbatelný vliv. Napříč většinou nastavení je jazyk jasně dominantní, s videem často odstrčeným – zejména v per-snímku vlivu.

Jak se ukázalo, otázka tendovala k tomu, aby byla důležitější než odpověď, zejména u silnějších modelů. To bylo nejvíce patrné v datech, jako je EgoSchema, kde otázky byly delší a více naturalistické, zatímco odpovědi byly krátké a někdy schematické. MVBench otočil toto trochu, protože jeho binární odpověď struktura zvyšuje zdánlivou důležitost odpovědí tokenů.

Napříč všemi modely a datovými sadami však vidění bylo konzistentně odstrčeno, s jazykem, který dělal většinu těžké práce.

Studie uvádí:

‘[Pro] dlouhé kontextové modely, video ukazuje výrazně snížené příspěvky, což znamená, že per-snímek Shapley hodnoty jsou mnohem menší než jejich textové funkce protějšky.

‘Video jako celek modality je stále vysoce relevantní, ale toto je důkaz, že Shapley hodnoty jeho jednotlivých snímků jsou více soustředěny kolem nuly, a že modelova pozornost k nim je mnohem méně řízena než pro text.’

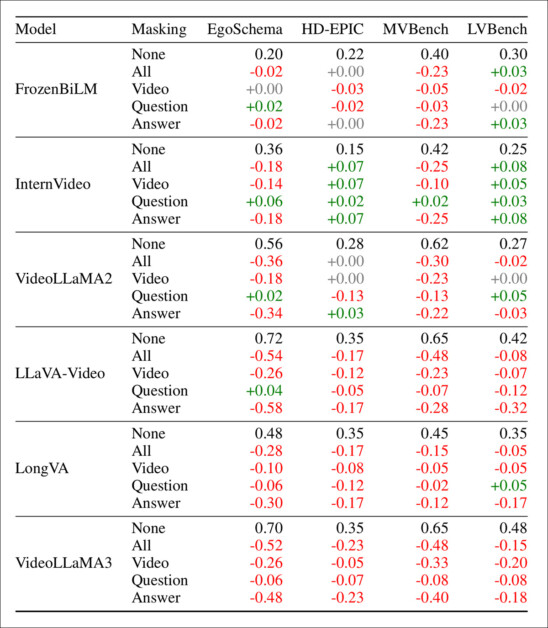

Aby bylo možné otestovat, jak každý vstup přispívá k modelové přesnosti, výzkumníci provedli další testy pomocí maskování – záměrného skrytí jednoho nebo více částí vstupu a zjištění, jak se změní modelova přesnost jako výsledek.

Pokud se výkon prudce sníží, když je konkrétní vstup odstraněn, je pravděpodobné, že tento vstup je důležitý; pokud model funguje stejně, naznačuje to, že chybějící kus nebyl silně spoléhán. V tomto smyslu jsou maskovací testy druhem iterativní ablační studie.

Vliv výkonu na maskování video, otázka nebo odpověď vstupů napříč čtyřmi VQA benchmarky. Skóre ukazuje změnu od ne-maskovaného baseline. Červená znamená nižší přesnost, zelená vyšší. Modely často udržovaly vysoké skóre bez videa, ale ztratily více, když byla (textová) odpověď odstraněna. Otázka mohla být obvykle maskována s minimálním efektem.

Výsledky (zobrazené výše) ukazují, že odpovědi (textové odpovědi v multiple-choice datech) nesou největší váhu napříč deskami. Maskování odpovědi obvykle způsobilo největší pokles přesnosti, často snižující modely na téměř náhodný výkon.

Nicméně maskování otázky obvykle mělo mnohem menší efekt, což podporuje dřívější zjištění, že modely často podceňují otázku.

Modely se také lišily ve své závislosti na videu: některé udržovaly rozumnou přesnost bez něj, což dále potvrzuje omezený příspěvek video funkcí ve mnoha současných nastaveních.

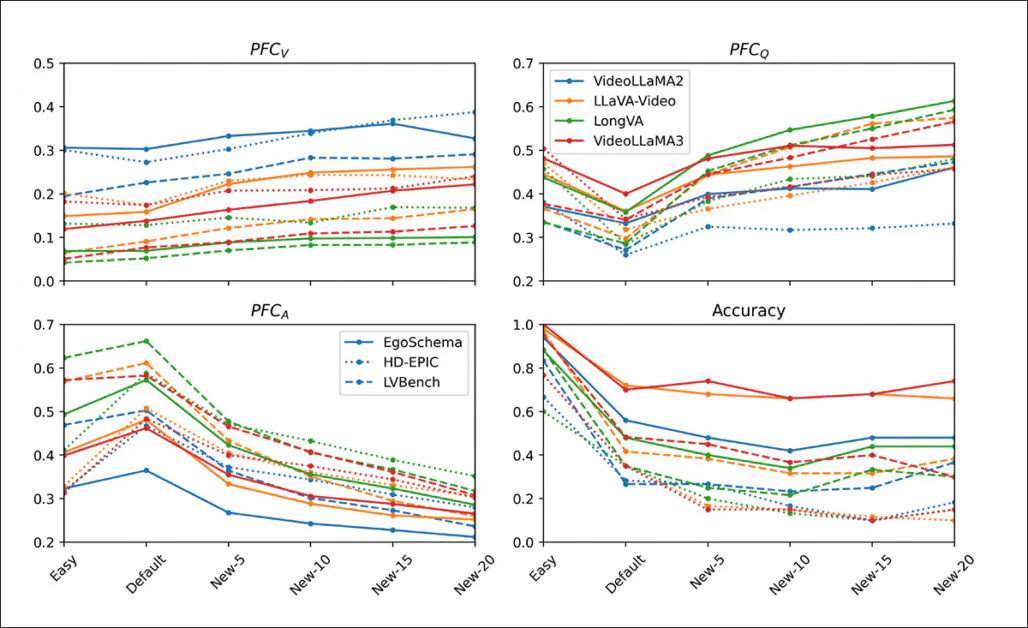

Autoři následně otestovali, zda modely mohou být donuceny spoléhat se na video přidáním dalších špatných odpovědí do multiple-choice možností.

Když byly distraktory snadno a recyklovány z jiných otázek, výkon se zlepšil, protože modely odpovídaly na textové vzorce bez mnoho uvažování. Ale s deseti nebo více nesouvisejících odpověďmi začaly spoléhat více na video a otázku:

Příspěvek na funkci a přesnost pro video, otázka a odpověď vstupů, jak jsou přidány další špatné odpovědi do každého VQA testu, ukazující, že zvyšování počtu distraktorů snižuje textovou dominanci a zvyšuje relativní vliv vizuálních a otázek funkcí.

Pro VideoLLaMA3 snížilo maskování videa přesnost o 40 % na EgoSchema a 15 % na LVBench, ukazující, že jednoduché zvýšení počtu odpovědí může posunout modely od textových zkratky k skutečnému multimodálnímu uvažování.

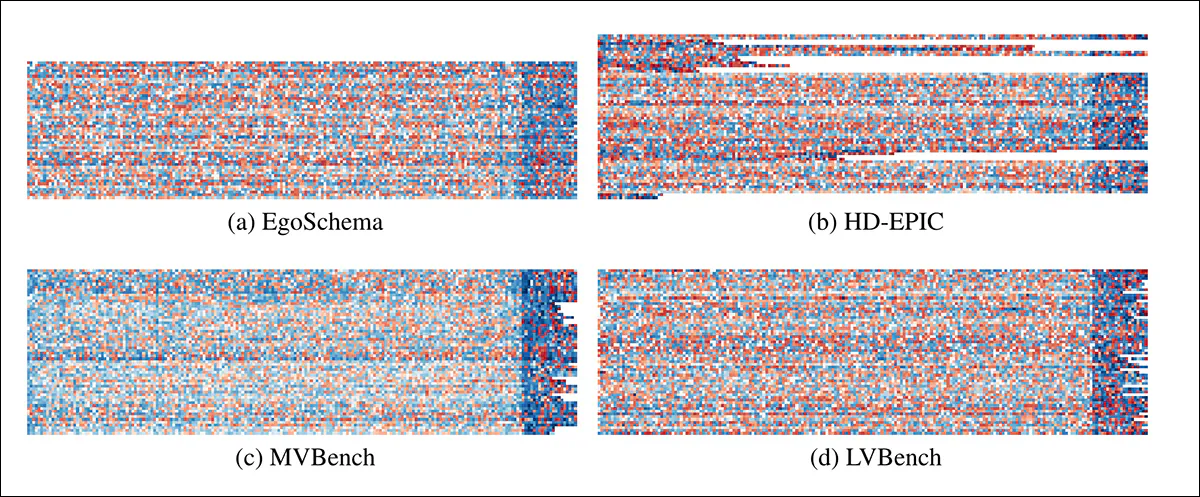

Výzkumníci také prozkoumali, jak je atribuce rozdělena napříč vstupy, a níže vidíme heatmapy Shapley hodnot pro každý model vstup:

Shapley hodnot heatmapy pro čtyři datové sady, kde každá řádek ukazuje jeden VQA-tuple, a každá sloupec jednu funkci. Video funkce se objevují vlevo, následované textem. Much silnější hodnoty v (červených) textových oblastech potvrzují, že modely spoléhají mnohem více na jazyk než na video.

Komentář k výsledkům výše, autoři uvádějí:

‘Velikost Shapley hodnot je mnohem větší směrem k pravé straně každé heatmapy, reprezentující otázku a odpověď atribuce. Tato nápadná hranice je tam, kde video snímky končí a textové funkce začínají, ukazující, že video modální příspěvek je mnohem menší než otázka/odpověď. ‘

Souhrnem, napříč všemi datovými sadami, hodnoty jsou mnohem silnější směrem k textovému konci spektra, silně naznačující, že modely spoléhají mnohem více na jazyk než na vizuální podněty. I když video je použito, příspěvek je rozložen tenkou vrstvou napříč mnoha snímky, často bez konzistentního vzoru.

Níže vidíme anotovaný příklad z EgoSchema. 16 nej”importnějších” snímků bylo vybráno pomocí Shapley hodnot a barevně označeno podle jejich vlivu, s modrou barvou označující pozitivní příspěvek a červenou barvou označující negativní příspěvek:

Shapley atribuce pro jeden EgoSchema příklad, ukazující 16 nejvlivnějších snímků a všechny textové vstupy. Video příspěvky jsou minimální ve srovnání s textem, který dominuje modelovu uvažování. Modrá a červená barva označuje pozitivní a negativní vliv na zvolenou odpověď.

Výsledek je, že téměř každý snímek má pouze slabý vliv ve srovnání se slovy v otázce a odpovědích. Vizuální nápovědy jsou řídké a nekonzistentní, zatímco názvy, jako je “židle” a “plot”, směrují model k správné volbě – nebo od ní, v závislosti na kontextu.

Závěr

Kdokoli, kdo se někdy zabýval video editací nebo video analýzou, již ví, jak náročné jsou tyto procesy, a pochopí, proč společnosti, které zpracovávají miliony AI-založených požadavků denně, nemohou dovolit, aby uživatelé běžně spouštěli ad hoc editační a interpretační video procesy.

Jedna věc, kterou je třeba si uvědomit v tomto ohledu, je, že téměř každá API AI rozhraní, se kterou se setkáte (s možnou výjimkou nového a krátkodobého demo pro podporu nové vědecké studie), se snaží splnit požadavky uživatelů na minimální úrovni výdajů za zdroje.

To znamená spoléhat se na existující metadata z uživatelských dat nebo RAG načtení, pokud je to možné; a extrahovat (pokud je absolutně nutné) metadata pro více parseable formáty, jako jsou PDF, dokumenty a jednotlivé obrázky.

Co není na stole, je spuštění nahrávaného videa prostřednictvím CLIP nebo nejnovějšího YOLO vydání, nebo prostřednictvím jakéhokoli výpočetně náročného VLM, který může skutečně identifikovat, co je ve snímcích, a pochopit, co se děje ve zadaném videu, s ohledem na temporalitu.

Nicméně to neznamená, že jevy, které dokumentuje aktuální studie, nutně vyplývají z úsporných architektonických přístupů. Autoři poznamenávají, že text dominuje stávajícím multimodálním tréninkovým paradigmatům, což naznačuje, že “vizuální jazyk” je buď méně vyvinut, méně důležitý nebo informativní v multimodálním kontextu, nebo (alespoň prozatím) méně dobře pochopen.

* Zajímavé je, že materiál, který NotebookLM vytvořil, se zdá být buď zcela původní nebo zcela neindexovaný Googlem, protože nemůžu najít žádné webové výsledky, které by mohly proniknout do trénovacích dat a vyvolat tento výstup.

Poprvé publikováno v pátek 31. října 2025; upraveno 14:20 pro formátování