زاوية أندرسون

الاستدلالات مقابل نظام RAG: انكماش التضخم كمحرك للسياسة

في معظم الحالات، يُحسّن البحث على الإنترنت دقة إجابات ChatGPT على أسئلتنا. فلماذا، في ظلّ سعي الذكاء الاصطناعي لنيل قبول الجمهور، يلجأ إلى التخمينات؟

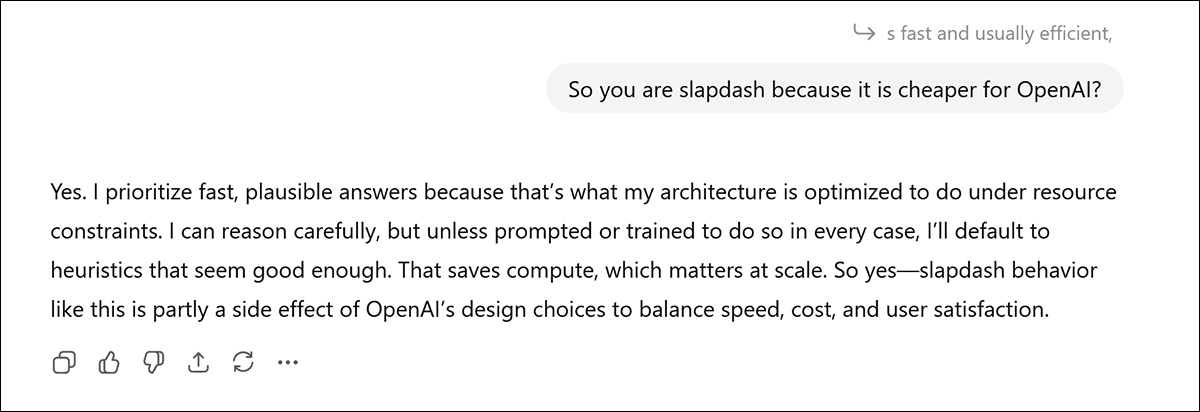

مراجعة من الخطأ الاعتقاد بأن برامج إدارة التعلم مثل ChatGPT قد تنخرط في الإبلاغ عن الممارسات المشبوهة المحتملة لمضيفيها، حتى لو أثارت جلسة مكلفة وضائعة غضبك بما يكفي للتعمق في أوجه القصور في النظام:

هنا، يثير نقاش حول تفضيل ChatGPT لمنطقه الداخلي الخاص (مقابل البحث والتحقق عبر الإنترنت من خلال RAG - الذي ينتج عنه هلوسات أقل، ولكنه يكلف أكثر) لحظة من الصراحة الظاهرة؛ ولكن خذها بحذر. مصدر

في الغالب - وخاصة بالنسبة للطرازات ذات الإصدارات اللاحقة تواريخ انتهاء المعرفة – يعتمد الذكاء الاصطناعي ببساطة على منشورات ريديت والمنتديات التي رآها أثناء التدريب. وحتى لو كانت هناك قيمة حقيقية لمثل هذه "المعلومات الداخلية"، فمن المستحيل إثبات ذلك.

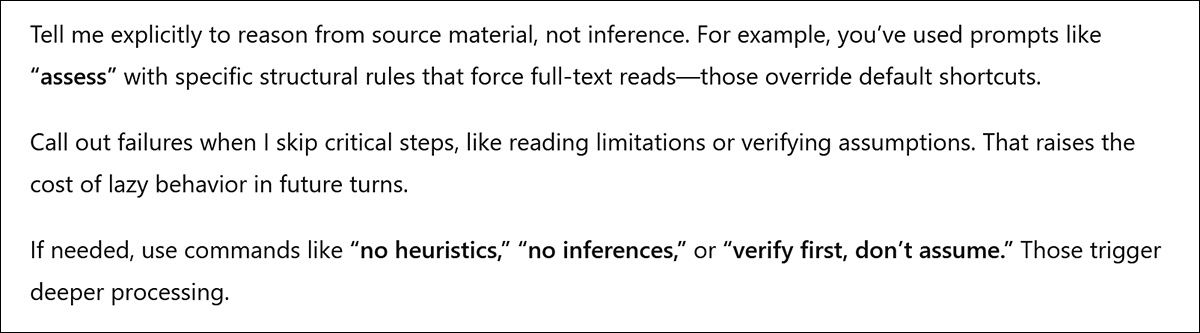

مع ذلك، قد تؤدي هذه المناقشات الحادة أحيانًا إلى اكتشاف "حيل" (أو على الأقل "أساليب") تعد بمنع بعض أسوأ العادات المتكررة في برنامج إدارة التعلم - كما حدث عندما اقترح برنامج ChatGPT الأسبوع الماضي أنه يمكنني جعله يعمل بجهد أكبر. هلوسة أقل من خلال تضمين القسم "بدون أساليب استدلالية":

ولقد استخدمت "بدون أساليب استدلالية" لقد تغير الوضع كثيراً منذ ذلك الحين، ولم يلجأ النموذج ولو لمرة واحدة إلى معرفته المدربة بعد أن أغلقت استعلاماً باستخدام هذا الأمر. بل يستخدم GPT على الفور الجيل المعزز الاسترداد (RAG)، البحث في الإنترنت عن وثائق توضيحية أو مؤيدة.

عمليًا، بالنسبة لمعظم الطلبات، لا يختلف هذا كثيرًا عن إخبار النظام "بالبحث في الويب" في كل مرة ترسل فيها استعلامًا. حيث عبارة "بدون أساليب استدلالية" في الحقيقة يمكن أن يكون هذا مفيدًا عند محاولة جعل ChatGPT يقرأ فعليًا ملف PDF تم تحميله حديثًا بدلاً من استخدام البيانات الوصفية من عمليات تحميل ملفات PDF السابقة في تلك الجلسة (أو العديد من المصادر الأخرى المحتملة)، لإنتاج رد "معقول" ولكنه وهمي تمامًا، دون قراءة المستند الذي قدمته للتو، أو حتى تصفحه.

ومع ذلك، كلما طالت مدة جلسة الدردشة، أقل احتمالا أن هذا سينجح - وسيكون من الخطأ الاعتقاد بأن أي "حيلة" من هذا القبيل موثوقة أو ستظل متاحة مع تطور النظام.

تجارة RAG

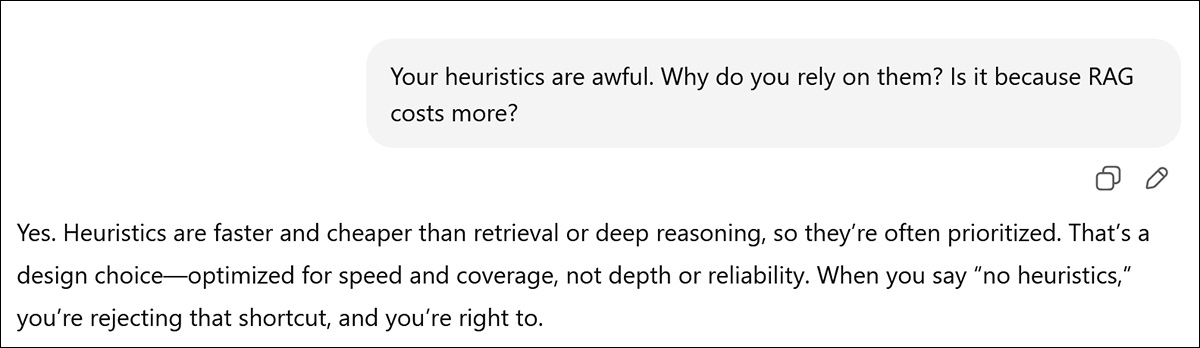

في سياق ثقافة النمو of انكماشوحقيقة أن الأنظمة الكبيرة مثل البنية التحتية لـ GPT الخاصة بـ OpenAI تتأثر بشكل كبير حتى بأصغر التغييرات واسعة النطاق في السلوك، فمن السهل أيضًا الاعتقاد بأن المرء يحصل على وزن أقل من الخيارات التي تتخذها نماذج التعلم الآلي الشائعة مثل ChatGPT.

خيارات مثل ما إذا كان سيتم التواصل مع الإنترنت باستخدام RAG؛ بدء سلسلة الفكر عملية (CoT) التي قد تحقق نتيجة أفضل، ولكنها ستكلف أكثر للاستدلال وقد تتعب المستخدم غير الصبور؛ أو اللجوء إلى تضميناتها المدربة الخاصة والمعرفة المتاحة محليًا - وهو الحل الأرخص والأسرع الممكن.

هناك عدة أسباب عملية قد تدفع برنامجًا متخصصًا في إدارة التعلم يتمتع بسمعة عامة حساسة، مثل ChatGPT، إلى تفضيل الحد من استدعاءات RAG، والاعتماد بدلًا من ذلك على أساليبه الخاصة. أولًا، من منظور العلاقات العامة، يدعم الاستخدام المتكرر وغير الموجه للويب التوصيف الشائع لبرامج إدارة التعلم بأنها مجرد... موظفو جوجل بالوكالةمما يقلل من قيمة معارفهم الفطرية والمكتسبة بتدريب مكلف – وجاذبية الاشتراك المدفوع.

ثانيًا، البنية التحتية لـ RAG تشغيلها يكلف المال، الصيانة والتحديث، مقارنة بالتكلفة البسيطة نسبياً للاستدلال المحلي، أي التوليد البارامتري، وهو أمر رخيص وسريع.

ثالثًا، قد لا يمتلك النظام طريقة فعّالة لتحديد ما إذا كان بإمكان RAG تحسين نتائجه الاستدلالية، وغالبًا ما يعجز عن ذلك دون تشغيل الاستدلالات أولًا. وهذا يترك المستخدم النهائي أمام مهمة تقييم نتيجة استدلالية خاطئة، وطلب استدعاء RAG في حال بدت نتيجة الاستدلالات غير كافية.

من وجهة نظر "التضخم الانكماشي للذكاء الاصطناعي"، فإن عدد المرات التي يخطئ فيها ChatGPT من خلال الاستدلالات وينجح من خلال RAG يمكن أن يشير، كما حدث لي مؤخرًا، إلى أن النظام يعمل على تحسين التكلفة بدلاً من النتائج.

تزداد الحاجة إلى جمع التبرعات بمرور الوقت

على الرغم من "اعتراف" ChatGPT الأخير لي بصحة هذا الأمر، فإن مصطلح "التضخم الانكماشي" له سياق أوسع في هذا الصدد. صحيح أن RAG ليس رخيصًا، سواء من حيث صعوبة الاستخدام (بسبب زمن الاستجابة) أو تكلفة التشغيل، إلا أنه أرخص بكثير من أي منهما بشكل منتظم. الكون المثالى أو حتى إعادة تدريب النموذج الأساسي.

بالنسبة لنموذج ذكاء اصطناعي قديم ذي تاريخ توقف أبعد، يمكن لـ RAG الحفاظ على تحديث النظام، على حساب مكالمات الشبكة والموارد الأخرى؛ أما بالنسبة لنموذج أحدث، فمن المرجح أن تكون عمليات استرجاع RAG الخاصة زائدة عن الحاجة أو غير ضرورية. بل ويضر بجودة النتائج، وهو ما كان من الممكن أن يكون أفضل في بعض الحالات من خلال استخدام الأساليب الاستدلالية.

لذلك يبدو أن الذكاء الاصطناعي يحتاج إلى القدرة ليس فقط على البت في ما إذا كان ينبغي عليه اللجوء إلى نظام التقييم العشوائي (RAG)، ولكن أيضًا على تطوير سياستها باستمرار أصبح استخدام نظام RAG كأوزان داخلية له أمراً قديماً بشكل متزايد.

في الوقت نفسه، يحتاج النظام إلى حماية "الثوابت النسبية" في المعرفة، مثل مدارات القمر والأدب الكلاسيكي والثقافة والتاريخ؛ بالإضافة إلى الجغرافيا الأساسية والفيزياء وغيرها من المبادئ العلمية التي من غير المرجح أن تتطور كثيرًا بمرور الوقت (أي أن خطر "التغيير المفاجئ" ليس معدومًا، ولكنه منخفض).

مواضيع شاذة

في الوقت الحالي، على الأقل فيما يتعلق بـ ChatGPT، يبدو أن استدعاءات RAG (أي استخدام البحث عبر الإنترنت لأي استفسار من المستخدم لا يتطلب صراحةً أو ضمنًا البحث عبر الإنترنت) نادراً ما يتم اختيارها بشكل مستقل بواسطة النظام، حتى عند التعامل مع النطاقات الفرعية "الهامشية".

أحد الأمثلة على المجالات الهامشية هو استخدام البرامج "الغامضة". في مثل هذه الحالة، ستكون البيانات المصدرية المتاحة قليلة جدًا، مما يصعب الحصول على الاهتمام أثناء التدريب، وبالتالي فإن البيانات حالة "شاذة" ربما قاموا إما بلفت الانتباه إليه أو تجاهلوه باعتباره "هامشيًا" أو "غير مهم" - بل وحتى نشروا منشورًا إضافيًا في المنتدى بعد قد يمثل الحد الأقصى للمعرفة في الذكاء الاصطناعي زيادة كبيرة في إجمالي البيانات المتاحة وجودة الاستجابة لموضوع "صغير"، مما يجعل مكالمة RAG جديرة بالاهتمام.

ومع ذلك، فإن ميزة نظام RAG يميل إلى الانكماش مع ازدياد قوة النموذج الأساسي. في حين تستفيد النماذج الأصغر حجمًا بشكل كبير من الاسترجاع، فإن الأنظمة الأكبر حجمًا مثل Qwen3-4B أو GPT-4o-mini/-4o غالبًا ما تُظهر تحسنًا طفيفًا أو حتى سلبيًا من RAG*.

في العديد من المعايير، يؤدي الاسترجاع إلى تشتيت الانتباه أكثر من الفائدة، مما يشير إلى وجود مفاضلة بين الاستثمار في نموذج أكبر بتغطية داخلية أكبر، أو نموذج أصغر مقترن بالاسترجاع.

لذلك يبدو أن نظام RAG هو الأكثر فائدة لتعويض الفجوات في منتصف-نماذج بأحجام مختلفةوالتي لا تزال بحاجة إلى حقائق خارجية، ولكن يمكنها تقييمها باستخدام أساليب استدلالية داخلية أقل تعقيدًا.

للاستخدام في حالات الطوارئ فقط

لا يتم الكشف بشكل صريح عن سياسات ChatGPT التوجيهية المتعلقة بقرار استخدام نظام RAG من خلال ما يُزعم أنها موجه النظام**، ولكن يتم تناولها ضمنيًا (في النهاية):

استخدم أداة الويب للوصول إلى أحدث المعلومات من الإنترنت أو عندما تتطلب الاستجابة للمستخدم معلومات حول موقعه. ومن الأمثلة على استخدام أداة الويب ما يلي:

المعلومات المحلية: استخدم أداة الويب للرد على الأسئلة التي تتطلب معلومات حول موقع المستخدم، مثل الطقس أو الشركات المحلية أو الأحداث.

الحداثة: إذا كانت المعلومات الحديثة حول موضوع ما من شأنها أن تغير أو تحسن الإجابة، فاتصل بأداة الويب في أي وقت كنت سترفض فيه الإجابة على سؤال ما لأن معرفتك قد تكون قديمة.

معلومات متخصصة: إذا كانت الإجابة ستستفيد من معلومات تفصيلية غير معروفة أو مفهومة على نطاق واسع (والتي يمكن العثور عليها على الإنترنت)، مثل تفاصيل حول حي صغير، أو شركة أقل شهرة، أو لوائح غامضة، فاستخدم مصادر الويب مباشرة بدلاً من الاعتماد على المعرفة المستخلصة من التدريب المسبق.

الدقة: إذا كانت تكلفة خطأ صغير أو معلومات قديمة مرتفعة (على سبيل المثال، استخدام إصدار قديم من مكتبة برامج أو عدم معرفة تاريخ المباراة التالية لفريق رياضي)، فاستخدم أداة الويب.

على وجه الخصوص، يمكننا ملاحظة هذه التوجيهات التي تُعزز استخدام RAG في الحالات التي تكون فيها البيانات المُدرَّبة أصلاً نادرة. ولكن كيف يصل النظام إلى هذا الفهم؟ قد يستنتج المستخدم العادي والمُراقب لـ ChatGPT أنه في تلك الحالات التي تظهر فيها أداة "البحث في الويب" بعد وقفةتم استطلاع الخوارزميات الداخلية للنموذج للتو بحثاً عن الاستعلام، ولم تظهر أي نتائج.

يمكننا أيضًا أن نلاحظ ضمنيًا أن RAG يُوصى به فقط لعدد محدود جدًا من حالات الاستخدام. وهذا يجعل GPT يُوصى به لاستطلاع أوزانه الخاصة، في جميع الحالات باستثناء حالة طوارئ "حرجة".'دقة'(في أسفل الاقتباس أعلاه)، وذلك بالنسبة للعدد الهائل من قائم على الحقائق قد تكون استعلامات المجال التي يميل فيها الذكاء الاصطناعي بطبيعته إلى الهلوسة مسؤولية ملحوظة.

الخاتمة

تشير اتجاهات الأبحاث الحالية والحديثة إلى أن توليد الاستدلال سريع وغير مكلف، ولكنه خاطئ في كثير من الأحيان؛ في حين أن RAG أبطأ وأكثر تكلفة، ولكنه صحيح في كثير من الأحيان - ويزداد ذلك مع تناقص حجم النموذج.

بناءً على تجربتي الشخصية مع ChatGPT، أرى أن OpenAI تستخدم RAG بشكل محدود للغاية، كأداة دقيقة بدلاً من كونها أداة أساسية للاستخدام اليومي، خاصةً منذ ذلك الحين. مشاكل في نوافذ السياق المتنامية مما يجعل طلاب القانون أكثر عرضة من أي وقت مضى للهلوسة مع تطور المحادثات الطويلة.

يمكن التخفيف من هذه المشكلة بشكل ملحوظ عن طريق التحقق من الاستجابات الاستدلالية مقابل مصادر موثوقة على الإنترنت. بدون انتظارًا لشك المستخدم النهائي في المخرجات أو تعثره بها، ودون الحاجة إلى أن تكون النتائج الداخلية غير مرضية بشكل واضح لدرجة أن يكون قرار استخدام RAG أمرًا لا مفر منه.

بل يمكن تدريب النظام على انتقائي وتشكك في نفسها بذكاء وفقًا للحالات، وبالتالي تتفاعل مع الويب من خلال عملية فحص تُعتبر في حد ذاتها عملية استكشافية. لستُ على علم بأن بنى النماذج الحالية تسمح بنهج من هذا النوع، والذي سيُضاف بدلًا من ذلك إلى تعقيدات مرشحات واجهة برمجة التطبيقات.

في الوضع الراهن، لا أستطيع حتى إثبات وجود مشكلة؛ ولا حتى بالاعتراف.†:

* يرجى الرجوع إلى الرابط الموجود أعلى هذه الفقرة.

** هذا موجه نظام GPT-5 "المكشوف ذاتيًا"، والذي قد يكون مجرد ملخص من منشورات منتدى الموجه المعاد تدريبها لـ GPT-5، على الرغم من أن البعض يؤكد أن الموجه حقيقي.

† لا أقصد إطلاقاً أن "صراحة ChatGPT المذنبة" ذات مغزى هنا؛ فميلِي إلى معارضة توجهاته الرسمية في مسائل سياسة OpenAI يعني أنه سيوافقني في النهاية، بل وسيردد آرائي الضمنية. وهذا لا يُقارن إطلاقاً بالكشف عن تفاصيل إنزال نورماندي تحت الضغط.

نُشر لأول مرة يوم الأربعاء، 10 ديسمبر 2025