الذكاء الاصطناعي

RigNeRF: طريقة جديدة للديب فايكس تستخدم مجالات الإشعاع العصبية

بحث جديد تم تطويره في Adobe يقدم أول طريقة قابلة للتطبيق وفعالة للديب فايكس تستند إلى مجالات الإشعاع العصبية (NeRF) – ربما تكون أول ابتكار حقيقي في الهندسة أو النهج خلال الخمس سنوات منذ ظهور الديب فايكس في عام 2017.

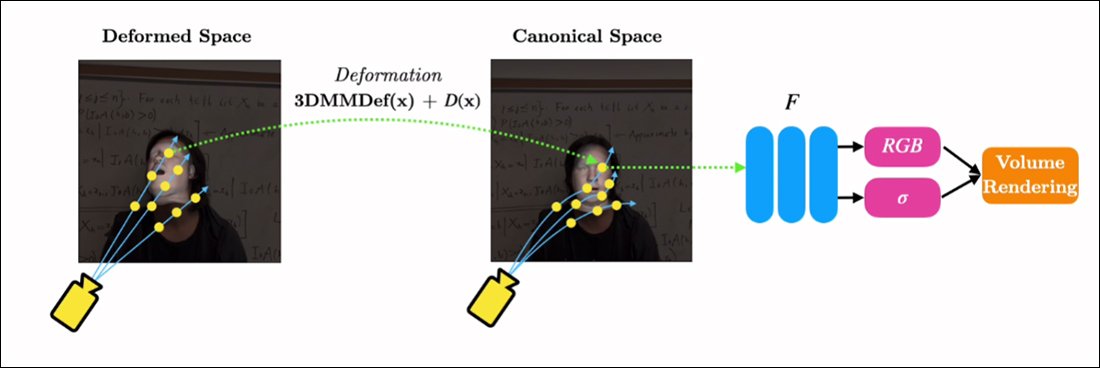

الطريقة، التي تحمل عنوان RigNeRF، تستخدم نماذج الوجه القابلة للتشكيل ثلاثية الأبعاد (3DMMs) كطبقة وسيطة بين الإدخال المرغوب فيه (أي الهوية التي سيتم فرضها على عرض NeRF) والفضاء العصبي، وهي طريقة تم採ها على نطاق واسع في السنوات الأخيرة بواسطة نهج التوليد العدائي للوجه (GAN) ، ولا يزال أي منهم لم ينتج إطارات قابلة للاستخدام وملائمة لاستبدال الوجه في الفيديو.

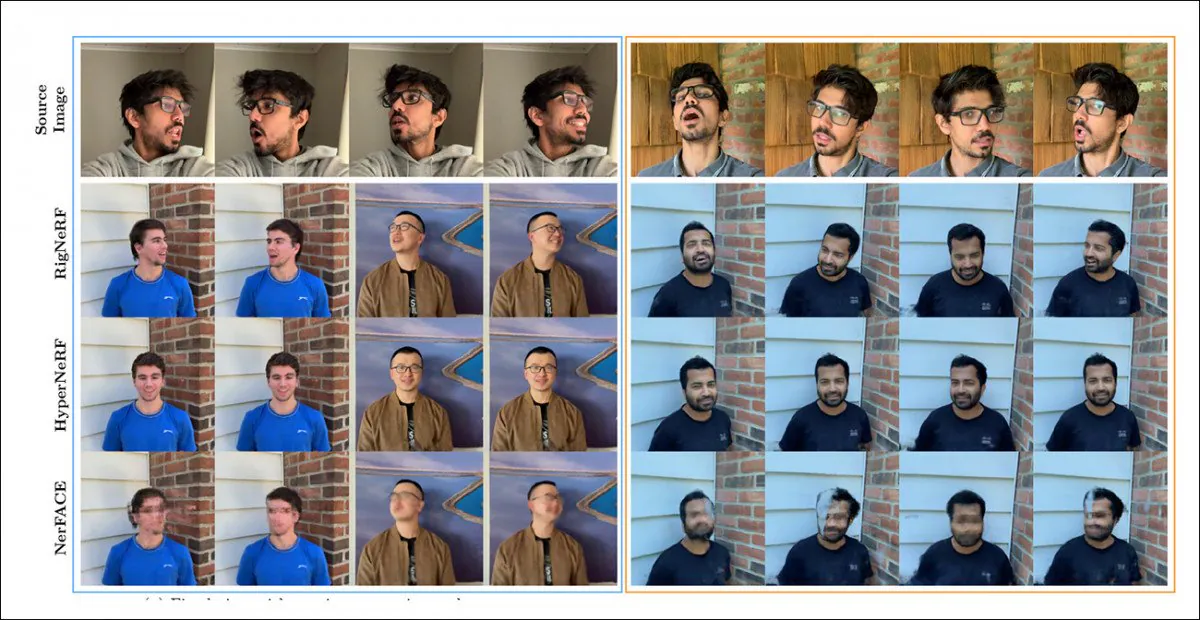

على عكس مقاطع الفيديو التقليدية للديب فايكس، لا يوجد أي محتوى متحرك موضح هنا “حقيقي”، بل هو فضاء عصبي قابل للاستكشاف تم تدريبه على مقاطع فيديو قصيرة. على اليمين نرى نموذج الوجه القابل للتشكيل ثلاثي الأبعاد (3DMM) يعمل كواجهة بين التحكم المرغوب فيه (“الابتسامة”، “النظر إلى اليسار”، “النظر إلى الأعلى”، إلخ.) ومعاملات مجال الإشعاع العصبي عادة ما تكون صعبة الإمساك. المصدر: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

نماذج الوجه القابلة للتشكيل ثلاثية الأبعاد (3DMMs) هي في الأساس نماذج رسومات حاسوبية للوجوه، يمكن تعديل معاملاتها لتناسب أنظمة合成 الصور المجردة، مثل NeRF وGAN، التي من الصعب التحكم فيها.

ما تراه في الصورة أعلاه (الصورة الوسطى، رجل بلون أزرق)، وكذلك الصورة الموجودة مباشرة أدناه (الصورة اليسرى، رجل بلون أزرق)، ليس “فيديو حقيقي” تم وضع رقعة “مزيفة” من الوجه عليه، بل هو مشهد تم تحويله بالكامل كتجسيد عصبي حجمي – بما في ذلك الجسم والخلفية:

في المثال المباشر أعلاه، تم استخدام الفيديو الحقيقي على اليمين (امرأة بلون أحمر) لتحريك الهوية المحصودة (رجل بلون أزرق) على اليسار عبر RigNeRF، والتي (يزعم المؤلفون أنها) هي أول نظام يستند إلى NeRF يحقق فصل بين وضع ومظهر مع القدرة على أداء تحليلات جديدة للمشاهدة.

تم الحصول على بيانات RigNeRF المشاهد من خلال تسجيل مقاطع فيديو قصيرة. สำหร مشروع، استخدم RigNeRF’s باحثو iPhone XR أو iPhone 12 لجميع التجارب. بالنسبة للنصف الأول من التسجيل، يُطلب من الموضوع أداء مجموعة واسعة من التعبيرات الوجهية والكلام مع الحفاظ على رأس ساكن بينما يتم تحريك الكاميرا حولهم.

بالنسبة للنصف الثاني من التسجيل، تظل الكاميرا في وضع ثابت بينما يجب على الموضوع تحريك رأسه حول بينما يعبر عن مجموعة واسعة من التعبيرات. تمثل النتيجة 40-70 ثانية من الفيديو (حوالي 1200-2100 إطار) مجموعة البيانات الكاملة التي ستستخدم لتدريب النموذج.

من خلال المقارنة، تتطلب أنظمة Autoencoder مثل DeepFaceLab جمعًا متعمدًا وتنظيمًا لآلاف الصور المتنوعة، غالبًا ما يتم أخذها من مقاطع فيديو على YouTube وقنوات وسائل الإعلام الاجتماعية الأخرى، بالإضافة إلى الأفلام (في حالة ديب فايكس المشاهير).

النماذج المُدرَّبة من Autoencoder غالبًا ما تُقصد للاستخدام في مجموعة متنوعة من الحالات. ومع ذلك، قد يُدرِّب أكثر “مُصَنِّعو ديب فايكس” متعطشين للاهتمام نماذج كاملة من الصفر لمقطع فيديو واحد، على الرغم من أن التدريب يمكن أن يستغرق أسبوعًا أو أكثر.

على الرغم من ملاحظة تحذيرية من قبل باحثي الورقة الجديدة، فإن مجموعات البيانات “المركبة” والشاملة التي تعمل بالطاقة الديب فايكس الإباحية وكذلك إعادة تمثيل الديب فايكس الشهيرة على YouTube / TikTok يبدو أنها غير محتملة لإنتاج نتائج مقبولة ومتسقة في نظام ديب فايكس مثل RigNeRF، الذي له منهجية محددة للمشهد. بالنظر إلى القيود على جمع البيانات المحددة في العمل الجديد، قد يثبت هذا، إلى حد ما، حارسًا إضافيًا ضد الاستيلاء على الهوية بشكل خاطئ من قبل مُصَنِّعي الديب فايكس الخبيثين.

تكييف NeRF مع فيديو الديب فايكس

NeRF هو طريقة تعتمد على التصوير الفوتوغرافي الذي يتم تجميع عدد صغير من الصور المصدر من زوايا مختلفة في فضاء عصبي قابل للاستكشاف. جاءت هذه الطريقة إلى الواجهة في وقت سابق من هذا العام عندما كشفت NVIDIA عن نظام النيرف الفوري، القادر على تقصير أوقات التدريب الطويلة للنيرف إلى دقائق أو حتى ثوان:

النيرف الفوري. المصدر: https://www.youtube.com/watch?v=DJ2hcC1orc4

المشهد الناتج عن مجال الإشعاع العصبي هو في الأساس بيئة ثابتة يمكن استكشافها، ولكن من الصعب تحريرها. يلاحظ الباحثون أن مبادرتين سابقتين مستندتين إلى NeRF – HyperNeRF + E / P و NerFACE – قد حاولتا合成 فيديو الوجه، و (الذي يبدو أنه من أجل الإكتمال والاجتهاد) وضع RigNeRF ضد هذه الإطارات İki:

مقارنة نوعية بين RigNeRF و HyperNeRF و NerFACE. راجع مقاطع الفيديو المصدر و PDF للحصول على إصدارات عالية الجودة. مصدر الصورة الثابتة: https://arxiv.org/pdf/2012.03065.pdf

القدرات المشتركة

القيود الرئيسية على NerFACE، التي يمكنها إنشاء تحكم في الموقف والتعبير في بيئة NeRF، هي أنها تفترض أن مصادر الفيديو ستتم تسجيلها ب كاميرا ثابتة. هذا يعني بشكل فعال أنها لا تستطيع إنتاج مناظر جديدة تمتد إلى ما وراء قيود التقاطها. هذا ينتج نظامًا يمكنه إنشاء “صور متحركة”، ولكنه غير مناسب للفيديو ذي النمط الديب فايكس.

من ناحية أخرى، HyperNeRF، على الرغم من أنه يمكنه إنشاء مناظر جديدة ومتطورة، لا يمتلك أي آلية تتيح له تغيير وضع الرأس أو التعبيرات الوجهية، مما لا ينتج أيضًا أي منافس للديب فايكس القائم على Autoencoder.

RigNeRF يمكنه الجمع بين هذه الوظائف المنفصلة من خلال إنشاء “مساحة معيارية”، وهي خط أساسي افتراضي من الذي يمكن أن تتم تنفيذ الانحرافات والتشوهات عبر الإدخال من وحدة 3DMM.

إنشاء “مساحة معيارية” (لا وضع، لا تعبير)، والتي يمكن أن تؤثر عليها الانحرافات (أي أوضاع وتعبيرات) التي تنتجها وحدة 3DMM.

نظرًا لأن نظام 3DMM لن يتطابق تمامًا مع الموضوع المحصود، فمن المهم تعويض ذلك في العملية. ينجز RigNeRF ذلك بمنطقة انحراف مسبقة يتم حسابها من الشبكة العصبية متعددة الطبقات (MLP) المشتقة من الفيديو المصدر.

يتم الحصول على معاملات الكاميرا اللازمة لحساب الانحرافات عبر COLMAP، بينما يتم الحصول على معاملات الشكل والتعبير لكل إطار من DECA.

يتم تحسين التموضع عبر التحام اللمسات ومعاملات الكاميرا من COLMAP، و، بسبب قيود الموارد الحاسوبية، يتم تصغير الإخراج الفيديوي إلى دقة 256×256 للتدريب (عملية تصغير مقيدة بالأجهزة التي تعاني منها أيضًا مشاهد الديب فايكس القائمة على Autoencoder).

بعد ذلك، يتم تدريب شبكة الانحراف على أربعة V100s – أجهزة قوية غير محتملة للوصول إليها من قبل هواة غير محترفين (ومع ذلك، حيث يتعلق الأمر بتدريب التعلم الآلي، غالبًا ما يكون من الممكن التبادل بين القوة والزمن، وبالتالي يمكن أن يكون تدريب النموذج مسألة أيام أو حتى أسابيع).

في الختام، يصرح الباحثون:

‘على عكس الطرق الأخرى، RigNeRF، بفضل استخدام وحدة تشوه 3DMM الموجهة، قادر على نمذجة وضع الرأس والتعبيرات الوجهية والصورة الثلاثية الأبعاد الكاملة بدقة عالية، وبالتالي يعطي إعادة بناء أفضل مع تفاصيل حادة.’

انظر مقاطع الفيديو المرفقة أدناه لمزيد من التفاصيل ومقاطع الفيديو الناتجة.

نُشر لأول مرة في 15 يونيو 2022.