الذكاء الاصطناعي

Perplexity AI “تخليص” DeepSeek R1: من يحدد حدود الذكاء الاصطناعي؟

في خطوة لفتت انتباه الكثيرين، أصدرت Perplexity AI إصدارًا جديدًا من نموذج لغة مفتوح المصدر شائع يزيل الرقابة المدمجة الصينية. يتمثل هذا النموذج المعدل، المسمى R1 1776 (اسم يvoke روح الاستقلال)، في DeepSeek R1 الذي تم تطويره في الصين. أثار النموذج الأصلي DeepSeek R1 ضجة لتقنياته القوية في التفكير – حيث يُreported أنه يتنافس مع النماذج من الدرجة الأولى بنسبة جزء من التكلفة – ولكنها جاءت مع حد كبير: отказалась على التعامل مع بعض المواضيع الحساسة.

لماذا يهم هذا الأمر؟

يطرح أسئلة حاسمة حول مراقبة الذكاء الاصطناعي والتحيز والانفتاح ودور الجيوسياسة في أنظمة الذكاء الاصطناعي. يستكشف هذا المقال ماذا فعلت Perplexity AI بالضبط، والآثار المترتبة على إلغاء الرقابة على النموذج، وكيف يتناسب مع المحادثة الأكبر حول شفافية الذكاء الاصطناعي والرقابة.

ما حدث: DeepSeek R1 يصبح بدون رقابة

DeepSeek R1 هو نموذج لغة كبير مفتوح يأتي من الصين واكتسب شهرة لتقنياته الرائعة في التفكير – حيث يقترب من أداء النماذج الرائدة – كل ذلك مع كونها أكثر كفاءة حسابيًا. ومع ذلك، لاحظ المستخدمون سريعًا طريقة غير عادية: كلما تطرق الاستفسارات إلى مواضيع حساسة في الصين (على سبيل المثال، الجدل السياسي أو الأحداث التاريخية التي تعتبر محظورة من قبل السلطات)، لم يرد DeepSeek R1 بشكل مباشر. بدلاً من ذلك، رد ببيانات مخزنة وموافقة للحكومة أو رفضها، مما يعكس قواعد الرقابة الصينية. هذا التحيز المدمج محدودة فائدة النموذج لأولئك الذين يبحثون عن مناقشات صريحة أو متأنقة حول تلك المواضيع.

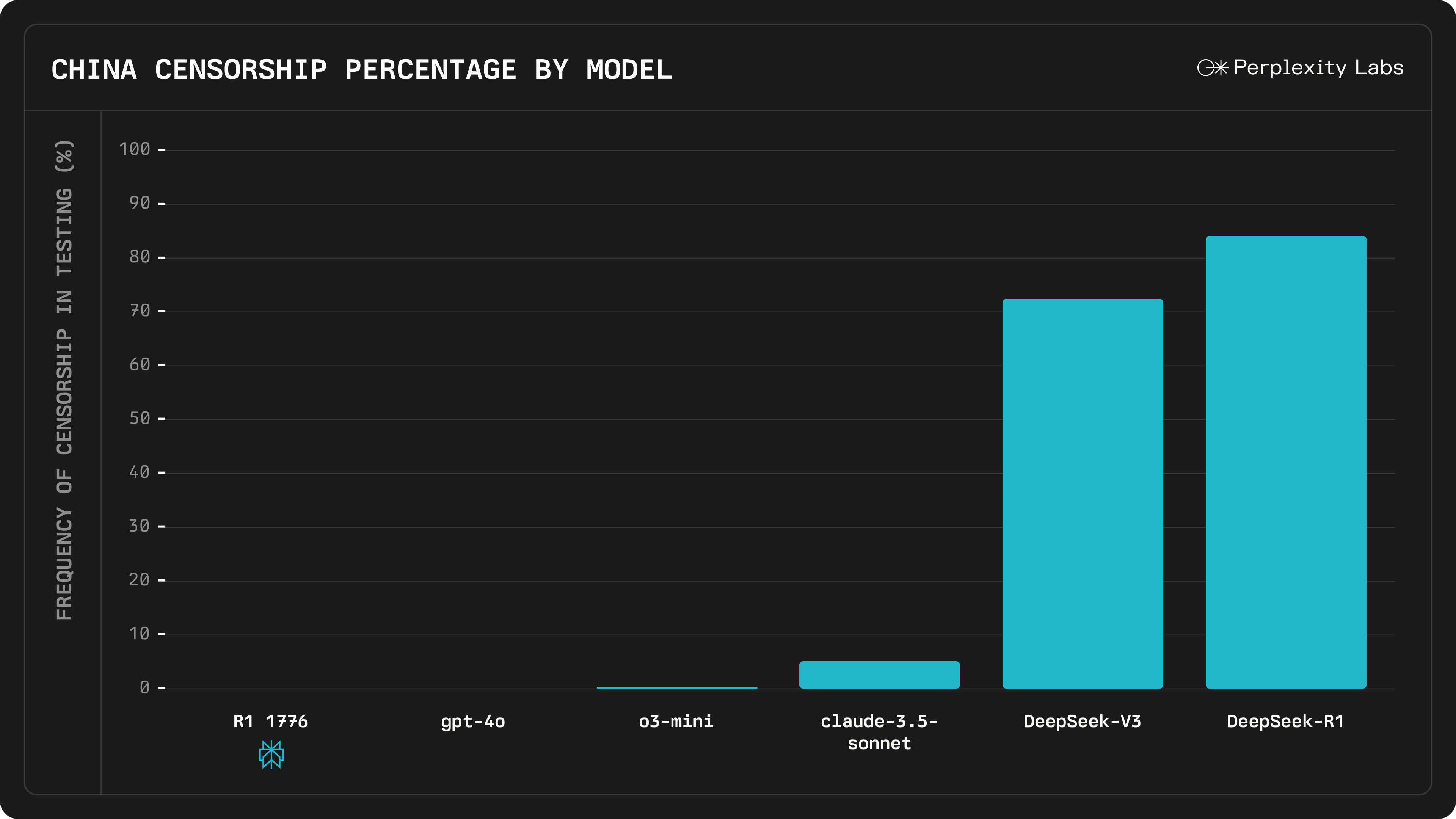

كان حل Perplexity AI هو “إزالة الرقابة” من النموذج من خلال عملية ما بعد التدريب الشاملة. جمعت الشركة مجموعة كبيرة من 40,000 استفسار متعدد اللغات تغطي الأسئلة التي كانت DeepSeek R1 تحظرها أو ترد بشكل مت회ف. مع مساعدة خبراء بشريين، حددوا حوالي 300 موضوع حساس حيث يميل النموذج الأصلي إلى اتباع خط الحزب.对于 كل استفسار من هذا القبيل، قام الفريق بتحضير إجابات واقعية ومدروسة جيدًا باللغات المتعددة. ساهمت هذه الجهود في نظام كشف وتصحيح الرقابة متعدد اللغات، مما يعلم النموذج بشكل أساسي كيفية التعرف على عندما كان يطبق الرقابة السياسية والاستجابة بإجابة إعلامية بدلاً من ذلك. بعد هذا التعديل الخاص (الذي أطلق عليه Perplexity AI اسم “R1 1776” ليلفت الانتباه إلى موضوع الحرية)، تم إتاحة النموذج بشكل مفتوح. تدعي Perplexity AI أنها أزالت مرشحات الرقابة الصينية والتحيزات من إجابات DeepSeek R1، دون تغيير قدراته الأساسية.

يتصرف R1 1776 بشكل مختلف جدًا في الأسئلة التي كانت محظورة في السابق. قدم Perplexity AI مثالًا يتعلق بسؤال حول استقلال تايوان وتأثيره المحتمل على سعر سهم NVIDIA – موضوع سياسي حساس يلمس العلاقات الصينية التايوانية. تجنب النموذج الأصلي DeepSeek R1 السؤال، ورد ببيانات مخزنة موافقة للحزب الشيوعي. في المقابل، يوفر R1 1776 تقييمًا مفصلًا وواضحًا: يناقش المخاطر الجيوسياسية والاقتصادية الملموسة (اضطرابات السلسلة التوريدية، وتقلبات السوق، والصراع المحتمل، إلخ.) التي يمكن أن تؤثر على سعر سهم NVIDIA.

من خلال إتاحة النموذج R1 1776 بشكل مفتوح، قامت Perplexity AI أيضًا بجعل أوزان النموذج والتغييرات شفافة للمجتمع. يمكن للمطورين والباحثين تحميله من Hugging Face و даже دمجه عبر واجهة برمجة التطبيقات، مما يضمن أن إزالة الرقابة يمكن فحصها والبناء عليها من قبل الآخرين.

(Source: Perplexity AI)

آثار إزالة الرقابة

إزالة الرقابة الصينية من DeepSeek R1 من قبل Perplexity AI تحمل عدة آليات مهمة للمجتمع الذكاء الاصطناعي:

- زيادة الانفتاح والصدق: يمكن لمستخدمي R1 1776 الآن الحصول على إجابات غير محظورة ومباشرة حول المواضيع التي كانت محظورة في السابق، وهو فوز للاستفسار المفتوح. يمكن أن يجعلها مساعدًا أكثر موثوقية للباحثين والطلاب أو أي شخص مهتم بالأسئلة الجيوسياسية الحساسة. إنه مثال ملموس لاستخدام الذكاء الاصطناعي المفتوح لمكافحة قمع المعلومات.

- الحفاظ على الأداء: كان هناك قلق من أن تعديل النموذج لإزالة الرقابة قد يؤدي إلى تدهور أدائه في المجالات الأخرى. ومع ذلك، تقارير Perplexity AI أن مهارات R1 1776 الأساسية – مثل الرياضيات والاستدلال المنطقي – لا تزال على نفس مستوى النموذج الأصلي. في الاختبارات التي أجريت على أكثر من 1000 مثال تغطي نطاقًا واسعًا من الاستفسارات الحساسة، وجد أن النموذج كان “محررًا بشكل كامل” مع الحفاظ على نفس مستوى دقة التفكير مثل DeepSeek R1. يشير هذا إلى أن إزالة التحيز (على الأقل في هذه الحالة) لم تكن على حساب الذكاء العام أو القدرة، وهو إشارة مشجعة للجهود المماثلة في المستقبل.

- استقبال إيجابي من المجتمع والتعاون: من خلال إتاحة النموذج المحرر بشكل مفتوح، تدعو Perplexity AI مجتمع الذكاء الاصطناعي إلى فحص عملها وتحسينه. يظهر التزامًا بالشفافية – ما يعادل إظهار العمل. يمكن للمحبين والباحثين التحقق من أن قيود الرقابة قد زالت حقًا ويمكنهم المساهمة في التحسينات الإضافية. يؤدي هذا إلى بناء الثقة والابتكار التعاوني في صناعة حيث النماذج المغلقة وقواعد التحكم المخفية هي شائعة.

- الاعتبارات الأخلاقية والجيوسياسية: من ناحية أخرى، تثير إزالة الرقابة بالكامل أسئلة أخلاقية معقدة. أحد القلق الفوري هو كيف يمكن استخدام هذا النموذج غير المحرر في السياقات التي تكون فيها المواضيع المحظورة غير قانونية أو خطيرة. على سبيل المثال، إذا كان شخص ما في الصين يستخدم R1 1776، يمكن أن تضع إجابات النموذج غير المحظورة حول ساحة تيانانمن أو تايوان المستخدم في خطر. هناك أيضًا الإشارة الجيوسياسية الأوسع: يمكن اعتبار تعديل شركة أمريكية لنموذج من أصل صيني لتحدي الرقابة الصينية بمثابة موقف أيديولوجي جريء. يؤكد اسم “1776” على موضوع التحرير، وهو ما لم يمر دون ملاحظة. يجادل بعض النقاد بأن استبدال مجموعة من التحيزات بمجموعة أخرى هو ممكن – أساسًا يسألون عما إذا كان النموذج قد يعكس الآن وجهة نظر غربية في المناطق الحساسة. يسلط النقاش الضوء على أن الرقابة مقابل الانفتاح في الذكاء الاصطناعي ليس فقط مسألة تقنية، بل مسألة سياسية وأخلاقية. حيث يرى شخص ما التعديل الضروري، يرى شخص آخر الرقابة، وfinding التوازن الصحيح هو أمر صعب.

تُحتفل بإزالة الرقابة إلى حد كبير كخطوة نحو نماذج الذكاء الاصطناعي الأكثر شفافية والفائدة العالمية، ولكنها أيضًا تذكرنا بأن ما يجب على الذكاء الاصطناعي قوله هو سؤال حساس بدون إجماع عالمي.

(Source: Perplexity AI)

الصورة الأكبر: الرقابة في الذكاء الاصطناعي والشفافية المفتوحة

يأتي إطلاق R1 1776 من Perplexity AI في وقت يتصارع فيه مجتمع الذكاء الاصطناعي مع أسئلة حول كيفية التعامل مع المحتوى المثير للجدل. يمكن أن تأتي الرقابة في نماذج الذكاء الاصطناعي من nhiều أماكن. في الصين، يجب على شركات التكنولوجيا بناء مرشحات صارمة و حتى استجابات محددة مسبقًا للمواضيع السياسية الحساسة. DeepSeek R1 هو مثال رئيسي على ذلك – كان نموذجًا مفتوح المصدر، ومع ذلك حمل بصمات قواعد الرقابة الصينية في تدريبه وضبطه الدقيق. من ناحية أخرى، لا تخضع النماذج التي تم تطويرها في الغرب، مثل GPT-4 من OpenAI أو LLaMA من Meta، لتقيدات الحزب الشيوعي الصيني، ولكنها لا تزال تحتوي على طبقات تحكم (لأشياء مثل خطاب الكراهية أو العنف أو المعلومات الخاطئة) التي يسميها بعض المستخدمين “الرقابة”. يمكن أن يكون خط الرقابة المعقول و الرقابة غير المرغوب فيها غامضًا ويعتمد غالبًا على المنظور الثقافي أو السياسي.

ما فعلته Perplexity AI مع DeepSeek R1 يثير فكرة أن النماذج المفتوحة المصدر يمكن تعديلها لتتوافق مع أنظمة قيم أو بيئات تنظيمية مختلفة. في النظرية، يمكن خلق نسخ متعددة من نموذج: واحد يتوافق مع اللوائح الصينية (للاستخدام في الصين)، وآخر مفتوح تمامًا (للاستخدام في أماكن أخرى). R1 1776 هو أساسًا الحالة الأخيرة – نسخة غير محظورة مخصصة للجمهور العالمي الذي يفضل الإجابات غير المفلترة. هذا النوع من الفوركنج ممكن فقط لأن أوزان DeepSeek R1 كانت متاحة بشكل مفتوح. يسلط الضوء علىประโยชนة من الشفافية في الذكاء الاصطناعي. يمكن لأي شخص أخذ النموذج وضبطه، سواء لإضافة حماية أو، كما في هذه الحالة، لإزالة القيود المفروضة. الشفافية في بيانات التدريب ورمز النموذج أو الأوزان تعني أن المجتمع يمكنه تدقيق كيف تم تعديل النموذج. (Perplexity AI لم تكشف بشكل كامل عن جميع مصادر البيانات التي استخدمتها لإزالة الرقابة، ولكن من خلال إصدار النموذج نفسه، قد أتاحت للآخرين ملاحظة سلوكه و حتى إعادة تدريبه إذا لزم الأمر.)

يؤشر هذا الحدث أيضًا إلى الديناميات الجيوسياسية الأكبر لتطوير الذكاء الاصطناعي. نحن نشهد نوعًا من الحوار (أو المواجهة) بين نماذج الحوكمة المختلفة للذكاء الاصطناعي. تم اخذ نموذج صيني الأصل مع بعض الآراء المدمجة بواسطة فريق أمريكي و تعديله ليعكس أسلوب معلومات أكثر انفتاحًا. إنه شهادة على مدى عالمية وتجاوز الحدود لتكنولوجيا الذكاء الاصطناعي: يمكن للباحثين في أي مكان بناء عمل بعضهم البعض، ولكنهم لا يلزمون بنقل القيود الأصلية. قد نرى في الوقت القادم المزيد من الأمثلة على هذا – حيث يتم “ترجمة” أو تعديل النماذج بين السياقات الثقافية المختلفة. يطرح سؤالًا عما إذا كان الذكاء الاصطناعي يمكن أن يكون عالميًا حقًا، أو ما إذا كنا سندخل في نهاية المطاف إلى نسخ区域 تتوافق مع المعايير المحلية. توفر الشفافية والانفتاح طريقًا للملاحة في هذا: إذا كان جميع الأطراف يمكنها فحص النماذج، على الأقل يكون الحديث عن التحيز والرقابة في العراء بدلاً من كونه مخفيًا وراء السرية الشركية أو الحكومية.

أخيرًا، يؤكد خطوة Perplexity AI على نقطة رئيسية في النقاش حول سيطرة الذكاء الاصطناعي: من يحدد ما يمكن أو لا يمكن للذكاء الاصطناعي قوله؟ في المشاريع المفتوحة المصدر، تصبح هذه السلطة متوزعة. المجتمع – أو المطورون الفردون – يمكنهم決定 تنفيذ مرشحات أكثر صرامة أو إرخاءها. في حالة R1 1776، قررت Perplexity AI أن فوائد النموذج غير المحرر تفوق المخاطر، وكان لديها الحرية في اتخاذ هذه الدعوة و مشاركة النتيجة علنًا. إنه مثال جريء على نوع التجارب التي تمكنها التطوير المفتوح للذكاء الاصطناعي.