زاوية Anderson

إخراج الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي إلى الضوء مع HDR

قد تكون الصور والفيديو التي تم إنشاؤها بواسطة الذكاء الاصطناعي ممتعة، ولكنها لا تصل إلى معايير الاحترافية – مشكلة تحاول مشروع بحثي جديد حلها.

في مجتمع الصوت والصورة الاحترافي، واحدة من أكثر الاعتراضات الشائعة على انتشار الذكاء الاصطناعي هي نقص المعايير الاحترافية الحالية لاستعادة الصور والفيديو. وليس أقل هذه المعايير القدرة على العمل مع صور وفیديوهات النطاق الديناميكي العالي (HDR).

تعتبر صور HDR مكافئة حديثة لممارسة фотوغرافية قديمة في القرن التاسع عشر والعشرين تسمى التراكب، حيث يتم أخذ نفس الصورة عدة مرات مع زيادة كمية الضوء المسموح بها للوصول إلى الغشاء الفيلم:

في الأعلى، تسلسل قصير من الصور المتراكبة. في الإدراج أدناه، النطاق الديناميكي العالي الذي يمكن استخلاصه من هذه الصور في صورة واحدة. مصدر

في التصوير الفوتوغرافي التقليدي، أدى ذلك إلى مجموعة من الصور التي يمكن، مع بعض الخبرة والجهد، تجميعها في صورة واحدة تستفيد من جميع مستويات التفاصيل المختلفة عبر مدى التعرضات. ولكن لم يكن هذا عملية سهلة أو تافها.

في هذه الأيام، يمكن أن تنتج تسلسلات الصور المتراكبة الآلي إما إنتاج صور متعددة أو تجميعها في صورة HDR واحدة – بشكل فعال، مجموعة من التعرضات في صورة واحدة، والتي يمكن أن تكرر عبر تطبيقات تحرير الصور التي تدعم HDR مثل Photoshop، وتمكن المصور من تنسيقها في صورة واحدة مثالية.

إذا كنت تتساءل لماذا يجب أن تهتم، أو كيف يؤثر هذا النوع من الأشياء على التصوير الخاص بك، فإن التوضيح لهذا المقال يهدف إلى إظهار ذلك بطريقة مألوفة:

في الأعلى، على اليسار نرى مثالًا نموذجيًا لصورة sRGB (أي غير HDR). مجرد إضاءة (مظهر على اليمين) لا تظهر الوحش في الخزانة، لأن هذا التفاصيل تم التخلص منه عندما قرر المصور والعمليات الآلية للكاميرا ما يجب إعطاء الأولوية له في الصورة:

في الأسفل، هناك مؤشر (على اليسار) لمدى ما سيكون عليه الخلفية “مبهتة” في وقت التعرض لتحديد الوحش في صورة غير HDR، وعلى اليمين كيف يتم غمر الوحش في الظلام عندما يتم جعل التعرض مناسبًا للموضوعات المضاءة جيدًا في المقدمة:

في الأسفل، نرى نوعًا من التفاصيل التي يمكن “إنقاذها” من صورة HDR أو تسلسل الصور. في هذه الحالة، كان الوحش “مختبئًا” في السجلات البصرية الأدنى من تسلسل HDR، في مستوى حيث سيكون المحتوى الآخر “مفجورًا” إلى اللون الأبيض القريب (في الأعلى، على اليسار). من خلال تحديد نطاق واسع من مستويات السطوع يجب أن يتم التعبير عنها، بشكل انتقائي، في نفس الصورة، يمكن تجميع هذه العناصر المتناقضة في صورة منطقية واحدة:

تُعرف الصورة غير HDR باسم صورة مرجعية للعرض، وتصوير HDR عالي الغاموت باسم صورة مرجعية للمشهد.

يعد فيديو HDR موجودًا أيضًا، وهذه المرونة اللونية والductility تمنح صانعي الأفلام بعض المرونة لإنقاذ وتحديد وتفسير اللقطات بطرق إبداعية ومتسقة؛ غير مفاجئ، ثم، أن الخلاب يتحمسون للعمل مع الإخراج المعتاد من سRGB للعديد من الإطارات التوليدية.

HDR في الذكاء الاصطناعي

طبعًا، فإن المشهد البحثي مهتم بإحضار الإطارات التوليدية التي تم إنشاؤها بواسطة الذكاء الاصطناعي إلى عصر HDR. ومع ذلك، فإن هذا ليس مهمة سهلة، بسبب الهيكل المعماري الأساسي لأنظمة التوليد التوليفي، و因为 بيانات HDR الجيدة تتطلب مساحة قرص كبيرة، مما يجعل من مجموعات البيانات غير مريحة؛ وبالتالي، تكون مجموعات البيانات المناسبة للغرض نادرة.

على الرغم من ذلك، تقدم تعاون بين جامعة في سنغافورة وAdobe Research طريقة لإنتاج تسلسلات صور HDR، في منهجية يمكن تطبيقها نظريًا على الفيديو بالإضافة إلى الصور الثابتة:

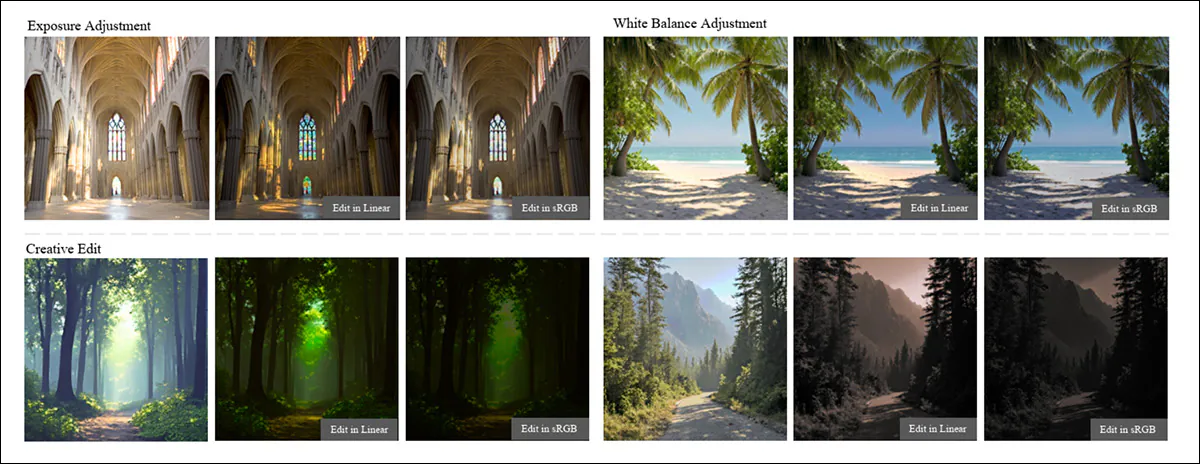

من موقع المشروع للعمل الجديد، أمثلة على مخرجات الصور النصية المتراكبة. مصدر

ينتج النظام عدة نسخ من نفس الصورة عند مستويات سطوع مختلفة ويتعلم كيف يُضاء المشهد حقًا، ثم يجمعها في نتيجة واحدة تحافظ على التفاصيل في الظلال والمناطق المضاءة، مما يسمح بالتعديلات اللاحقة للتعرض أو اللون لتتصرف مثل التعديلات على التقاط الكاميرا الحقيقي، وليس التعديلات الهشة للصورة المعالجة بالكامل.

يستفيد النظام من مجموعة متنوعة من النماذج للمهمة، بما في ذلك متغيرات Qwen وFlux:

أمثلة من الورقة الجديدة، تظهر كيف يمكن للنظام توليد نسخ متعددة من التعرض لنفس المشهد مع الحفاظ على الهيكل الأساسي ثابتًا. بدءًا من خريطة حافة بسيطة، ينتج النموذج صورًا متسقة عبر إعدادات مضاءة داكنة جدًا إلى مضاءة جدًا، سواء كان النص يصف ضوء القمر أو ضوء الشمس أو غروب الشمس أو حتى كائن صغير مثل البالون، مع استقرار الموضوع والتركيبة مع تغير الإضاءة فقط. يمكن أن يغير الطريقة السطوع بطريقة خاضعة للسيطرة، مثل الكاميرا، بدلاً من الانجراف أو اختراع محتوى جديد مع تغيير التعرض. مصدر

يصرح المؤلفون:

‘إن توليد الصور الخطية يعد تحديًا، لأن النماذج المسبقة التدريب في نماذج الانحلال اللاتنتي ت투쟁 لتحافظ على التباين العالي والمنخفض بسبب النطاق الديناميكي الأعلى وعمق البت.

‘لهذا السبب، نعرض صورة خطية كتسلسل من حزم التعرض، كل منها يلتقط جزءًا معينًا من النطاق الديناميكي، ونقترح هيكلًا معماريًا لجريان التطابق القائم على DiT لإنشاء حزم التعرض المحددة النص.

‘نثبت أيضًا التطبيقات الجانبية بما في ذلك تحرير الصور الخطية الموجهة النص وتوليد الهيكل الموجه بواسطة ControlNet.’

يعتبر العمل الجديد مسمى توليد الصور الخطية عن طريق σύνthesis حزم التعرض، ويأتي من أربعة مؤلفين عبر S-Lab في جامعة Nanyang Technological، وAdobe NextCam، وAdobe Research. بالإضافة إلى صفحة المشروع ومقاطع الفيديو المصاحبة للإصدار، هناك أيضًا مستودع GitHub (الذي يبدو فارغًا حاليًا) مستودع GitHub، ووعد بإصدار مجموعة بيانات.

على الرغم من أن المؤلفين يقدمون العديد من الأمثلة على مخرجات النظام في صفحة المشروع، سيحتاج المشاهدون إلى شاشة قادرة على HDR للتمييز الفعلي بين خصائص مخرجات HDR المعروضة. ومع ذلك، يرجى العثور على نظرة عامة للمحققين على YouTube مدمجة في نهاية هذا المقال – لكنكن على علم بأن الفروق بين الأمثلة المعروضة قد لا تكون واضحة على شاشة غير HDR.

الطريقة والبيانات

يشدد المؤلفون على مدى تحدي جمع البيانات في هذا السعي:

‘إن الحصول على عدد كبير من الصور الخطية يعد تحديًا شديدًا في الممارسة. بالإضافة إلى ذلك، فإن معظم مجموعات بيانات HDR العامة إما بانورامية (لذا تركز بشكل حصري تقريبًا على محتوى المشهد على نطاق واسع) أو لا توفر صورًا خطية حقيقية، مما يجعلها غير مناسبة لأغراضنا.

‘لذلك، نستخدم بشكل أساسي مجموعات بيانات الصور الخام كأساس للتدريب.’

استخدم الباحثون استخدامًا إبداعيًا للخيارات القليلة المتاحة، واستفادوا من مجموعة بيانات RAISE كبيانات تدريب فعلي، ومجموعة بيانات MIT-Adobe FiveK كبيانات تقييم*.

لبناء بيانات تدريب HDR قابلة للاستخدام، قام الباحثون بتشغيل ملفات الكاميرا الخام عبر трубة معيارية لاستبعاد الخواص الخاصة بالكاميرا، وتحويل الصور إلى صيغة خطية متسقة ومرجعية للمشهد:

schema للعملية التي يتبعها المؤلفون: يبدأ النظام من الضوضاء التي تمثل أربع مستويات من التعرض لنفس المشهد، جنبًا إلى جنب مع نص وبطاقة سطوع، ويعالجها عبر كتلة تحويل متكررة تظاهر بأنها تحافظ على التعرضات المختلفة مع بعضها البعض أثناء تعديل الإضاءة. ثم يتوقع النظام مجموعة من صور التعرض، جنبًا إلى جنب مع مقياس سطوع عام، ويقوم بعد ذلك بفك الشفرة ودمجها في صورة مرجعية للمشهد، مع الحفاظ على التفاصيل في كلا الظلال والمناطق المضاءة.

كان ذلك يتطلب إعادة بناء RGB الكامل من بيانات الحساسية، وتطبيق تصحيح الألوان، وتنظيم توازن الأبيض، والانتقال لفترة قصيرة إلى فضاء لوني محسوس للتنقية قبل العودة إلى إشارة خطية نظيفة. ثم تم استعادة الضوء الفعلي في المشهد باستخدام إعدادات التعرض للكاميرا، بحيث تعكس كل بكسل السطوع الفعلي بدلاً من تقدير جاهز للعرض.

نظرًا لأن هذه القيم يمكن أن تختلف على نطاق واسع، تم تثبيت البيانات بعد ذلك عن طريق تحجيم كل صورة بناءً على توزيع سطوعها الخاص، باستخدام إحصاءات منتصف النطاق والمناطق المضاءة لتجنب الصور المبهتة والمناطق المضاءة؛ في النهاية، الحصول على صورة خطية معيارية حافظت على مدى الضوء الحقيقي في المشهد، مع الحفاظ على استقرار كافٍ للتدريب.

تم إنشاء تسميات نصية للصور باستخدام نموذج Qwen2.5-VL 7B، مع صياغة نصوص مطابقة لخصائص نموذج Flux الذي سيتم استخدامه في وقت التوليد.

تم تقسيم كل صورة إلى “شريحة” من التعرض وتم تمريرها عبر محول VAE مشترك، مما حول جميع التعرضات إلى مساحة لاتنتي مشتركة مصممة لالتقاط النطاق الكامل للسطوع. ثم تم تحسين اللاتنتي من الضوضاء، وتم فك الشفرة مرة أخرى إلى صور، مما سمح بإعادة بناء متسقة عبر المناطق الداكنة والمناطق المضاءة، دون انهيارها في تعرض واحد “ممسوح”.

تم استخدام LoRA Fine-tuning لتكييف نموذج Flux المسبق التدريب مع بيانات الصور الخطية مع الحد الأدنى من المعلمات الإضافية، مما ساعد نموذج Single-Diffusion Transformers (single-DiT) على الحفاظ على الاستقرار، حتى مع تغير السطوع عبر حزم التعرض.

تم إدخال انتباه تعديل التعرض الذاتي (العمود الوسط في التخطيط التوضيحي أعلاه) لمعالجة جميع الحزم بشكل مشترك، مما سمح بتعديل السطوع لكل تعرض مع الحفاظ على الهيكل والتفاصيل الدقيقة مع بعضها البعض.

تم استخدام 3D Rotary Positional Embedding (3D-R[o]PE) لترميز كل من الموقع المكاني وتعريف التعرض، بحيث يمكن للنموذج التمييز بين التعرض الذي ينتمي إليه كل رمز، مع الحفاظ على الاتساق المكاني، وتمكين الفصل النظيف لتغيير السطوع عن محتوى المشهد.

نظرة عامة على مجموعة البيانات المستخدمة في الدراسة، تظهر كيف يتم توزيع الصور عبر أنواع المحتوى والمناظر الداخلية والخارجية، جنبًا إلى جنب مع توزيع قيم السطوع في البيانات المعالجة. تظهر المخططات التكرارية السطوع ومقياس الإشعاع في الفضاء اللوغاريتمي، مما يظهر كيف يمكن أن تختلف السطوع في العالم الحقيقي على نطاق واسع، مع قيم إشعاع أعلى تتطابق مع مشاهد أكثر إضاءة، وتسليط الضوء على النطاق الديناميكي القوي الذي تم تدريبه على النموذج.

الاختبارات

استخدم الباحثون Flux-dev كإطار توليدي، مع تدريب يحدث على أربعة وحدات معالجة رسومات NVIDIA A100، كل منها مع 80GB من VRAM. تم تعيين حجم الدفعة على 4 (لكل وحدة معالجة رسومات)، عبر 10,000 تكرار.

استخدم LoRA Fine-tuning رتبة 64. تم استخدام مثبط AdamW عند معدل تعلم 2×102 (لجزء تعديل التعرض).

يشير المؤلفون إلى أن هناك عملين سابقيين مشابهين في النطاق، ولكن لا يوجد منهما مرشح واضح لمرحلة الاختبار.

من الورقة الأصلية GlowGAN، الصور التقليدية منخفضة النطاق الديناميكي (LDR) تفقد التفاصيل في الظلال والمناطق المضاءة، في حين يتعلم النموذج إنتاج نسخ HDR التي تحتفظ بالتفاصيل عبر مستويات السطوع وتمكن من استعادة المناطق المشبعة من خلال خريطة التون المقلوبة. مصدر

لذلك، قام المؤلفون بمقارنة طريقةهم مع إصدارات محسنة من نماذج قوية موجودة، بدلاً من بديلات مصممة خصيصًا.

كانت واحدة من التجارب (‘T2I Fine-Tuning’) تثبيت نموذج التوليد النصي-صورة Flux باستخدام LoRA، ومدربًا على توليد صور خطية مباشرة، وتقييم كيف يتعامل نموذج T2I مع هذا المجال.

كانت المقارنة الثانية (‘T2V Fine-tuning’) تستخدم نموذج النص-فيديو Wan 2.1، الذي يضغط النموذج VAE الإضافي عدة إطارات في تمثيل لاتنتي مشترك؛ في هذا الإعداد، تم ترميز أربع حزم تعرض في تمثيل لاتنتي واحد، وتم فك الشفرة مرة أخرى، لاختبار ما إذا كان يمكن للpipeline الفيديو نمذجة تغيير التعرض.

المقارنة الثالثة (‘T2I Model Inflation’) قارنت ضد CameraCtrl وGenerative Photography، والتي تمتد نماذج الانحلال الصوري عبر وحدات زمنية، لإنتاج مخرجات متعددة الإطارات. تم تثبيت هذه أيضًا على نفس البيانات، من أجل مقارنة متسقة.

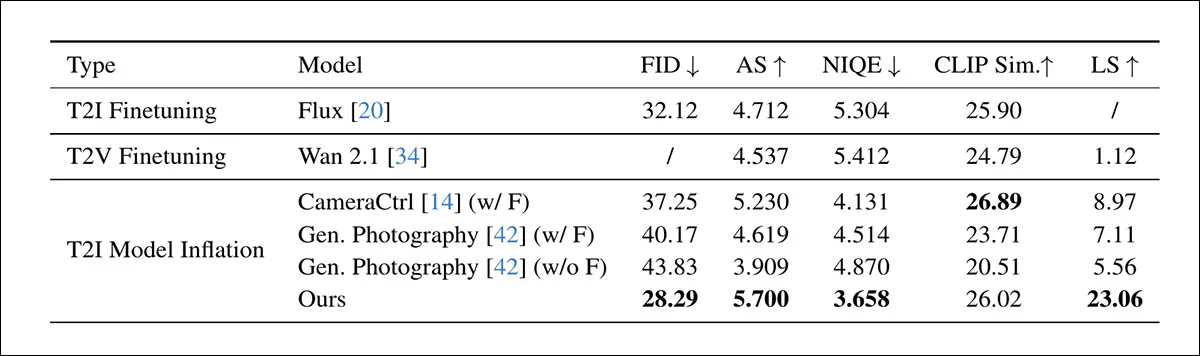

تم استخدام معايير مثل Fréchet Inception Distance (FID)؛ ودرجة الجمال (AS)؛ Naturalness Image Quality Evaluator (NIQUE)؛ ودرجة CLIP Sim؛ ودرجة تشابه السطوع (LS):

مقارنة بين طريقة المؤلفين وعدد من الإصدارات المحسنة من النماذج القوية لإنشاء صور خطية مرجعية للمشهد. تم تثبيت نماذج T2I وT2V باستخدام LoRA لاختبار كيفية تعامل أنظمة التوليد الحالية مع هذا الإعداد، في حين تم تمديد نماذج CameraCtrl وGenerative Photography بنماذج زمنية. بعض الدرجات مفقودة، لأن بعض النماذج لا يمكنها إنتاج حزم تعرض متسقة بانتظام، والتي تكون ضرورية لاستعادة النطاق الديناميكي الكامل. عبر المقاييس المعلنة، تحقق الطريقة الجديدة أقوى النتائج الإجمالية، ولا سيما في المقاييس المرتبطة بجودة الصورة وإعادة بناء السطوع الدقيق.

بخصوص هذه النتائج، يصرح المؤلفون:

‘نظرًا لتوزيع الصور الخطية على نطاق واسع، فإن تثبيت T2I Model مباشرة على البيانات الخطية يجعل من الصعب موازنة التفاصيل في الظلال والمناطق المضاءة. تعاني طرق T2I Model Inflation من نطاق ديناميكي محدود بشكل كبير وتدهور جودة الصورة بشكل كبير حتى بعد التثبيت.

‘对于 T2V Fine-tuning، يؤدي تقليل الترميز الزمني 4× لنموذج Wan 2.1 إلى دمج حزم التعرض الأربعة في تمثيل لاتنتي واحد، مما يسبب عدم تطابق توزيع شديد لا يمكن حله من خلال التثبيت وحده.

‘من خلال نمذجة خصائص مرجعية للمشهد باستخدام حزم التعرض، تحقق طريقةنا نتائج جودة وديناميكية فائقة مقارنة بجميع القواعد.

مقارنة مع Flux وWan 2.1 المعدلين بواسطة LoRA، تظهر كيفية تعامل كل طريقة مع تغيير التعرض عبر نفس المشاهد. تميل الطرق التنافسية إلى فقدان التفاصيل في المناطق الداكنة أو المضاءة جدًا، في حين تحتفظ طريقة المقترح بالهيكل المتسق وتنقذ التفاصيل المفيدة عبر مدى التعرض الكامل. يرجى الرجوع إلى الورقة الأصلية وموقع المشروع لأمثلة نتائج أفضل جودة.

يرجى الرجوع إلى قسم التجارب الممتدة والملحقات في الورقة الأصلية لمزيد من الاختبارات.

الاستنتاج

للمهنيين في الإعلام، مثل أولئك العاملين في إنتاج الأفلام والتلفزيون، فإن نفس الإخراج الذي أثار خيال العالم (وأحيانًا غضبه) قد تركه غير مبالٍ، منذ أن تعتمد معظم خطوط أنابيبهم على بعض الإلتقاطات HDR.

لذلك، هذا مشروع مناسب للوقت، ويمثل ميزة واحدة التي من المفترض أن تصبح معيارًا اختياريًا عبر الإطارات الجديدة – على الرغم من أنه من المؤكد أن هذا سيزيد من أوقات الت渲ن؛ واضحًا، أيضًا، أن الحد الأقصى للاتساق سيتعين معالجته بجدية إذا لم تكن المحتوى HDR التي تم إنشاؤها بواسطة الذكاء الاصطناعي محتجزة في “الما بعد” بدلاً من “في الكاميرا” الفئة.

* نظرًا لأن القارئ قد لا يمتلك شاشة قادرة على HDR، ن省ف الأمثلة في هذه الحالة.

نشر لأول مرة يوم الأحد، 26 أبريل 2026