الذكاء الاصطناعي

كيفية تدريب واستخدام نماذج Hunyuan Video LoRA

هذا المقال سيعرض لك كيفية تثبيت واستخدام برنامج على نظام ويندوز يمكنه تدريب نماذج Hunyuan Video LoRA، مما يسمح للمستخدم بإنشاء شخصيات مخصصة في نموذج Hunyuan Video الأساسي:

[فيديو عرض=”1200″ ارتفاع=”900″ mp4=”https://www.unite.ai/wp-content/uploads/2025/01/loras-hunyuan-AE2.mp4″][/فيديو]

انقر للتشغيل. أمثلة من الانفجار الأخير من Hunyuan LoRAs المشهورة من مجتمع civit.ai.

في الوقت الحالي، هناك طريقتان شائعتان لإنشاء نماذج Hunyuan LoRA محليًا:

1) إطار diffusion-pipe-ui المعتمد على Docker، الذي يعتمد على نظام ويندوز الفرعي للينكس (WSL) لمعالجة بعض العمليات.

2) Musubi Tuner، إضافة جديدة إلى هيكل تدريب الانفجار الشهير Kohya ss. لا يتطلب Musubi Tuner Docker ولا يعتمد على WSL أو وكلاء لينكس آخرين – ولكن يمكن أن يكون من الصعب الحصول عليه على نظام ويندوز.

لذلك، سيركز هذا العرض التوضيحي على Musubi Tuner، وتقديم حل محلي كامل لتدريب Hunyuan LoRA وتوليدها، دون استخدام مواقع API أو عمليات استئجار GPU تجارية مثل Runpod.

[فيديو عرض=”1200″ ارتفاع=”674″ mp4=”https://www.unite.ai/wp-content/uploads/2025/01/example-woman-hunyuan-loras.mp4″ loop=”true”][/فيديو]

انقر للتشغيل. عينات من تدريب LoRA على Musubi Tuner لهذا المقال. تم الحصول على جميع التصاريح من الشخص المُصوَّر، لغرض توضيح هذا المقال.

المتطلبات

ستتطلب التثبيت الحد الأدنى من جهاز كمبيوتر يعمل بنظام ويندوز 10 مع بطاقة NVIDIA من سلسلة 30+/40+ تحتوي على ما لا يقل عن 12 غيغابايت من ذاكرة الوصول العشوائي (VRAM) (على الرغم من أن 16 غيغابايت موصى بها). تم اختبار التثبيت المستخدم لهذا المقال على جهاز مع 64 غيغابايت من ذاكرة نظام RAM و بطاقة رسومات NVIDIA 3090 تحتوي على 24 غيغابايت من VRAM. تم اختباره على نظام اختبار مخصص باستخدام تثبيت جديد من نظام ويندوز 10 المحترف، على قسم يحتوي على أكثر من 600 غيغابايت من مساحة القرص الخالية.

تحذير

تثبيت Musubi Tuner والبرامج المسبقة له يتضمن أيضًا تثبيت برامج و حزم موجهة للمطور مباشرة إلى التثبيت الرئيسي لنظام ويندوز على جهاز الكمبيوتر. مع الأخذ في الاعتبار تثبيت ComfyUI في مراحل النهاية، سيحتاج هذا المشروع إلى حوالي 400-500 غيغابايت من مساحة القرص. على الرغم من أنني قمت باختبار الإجراء دون حوادث عديدة في بيئات اختبار جديدة من نظام ويندوز 10، لا أتحمل ولا Unite.ai مسؤولية أي ضرر للأنظمة الناجم عن اتباع هذه الإرشادات. أوصي ب备份 أي بيانات مهمة قبل محاولة هذا النوع من إجراء التثبيت.

الاعتبارات

هل هذه الطريقة لا تزال صالحة؟

مشهد الذكاء الاصطناعي التوليدي يتحرك بسرعة كبيرة، ويمكننا توقع طرق أفضل وأكثر تسهيلًا لتدريب Hunyuan Video LoRA في هذا العام.

… أو حتى هذه الأسبوع! بينما كنت أكتب هذا المقال، أنتج مطور Kohya/Musubi musubi-tuner-gui, واجهة مستخدم رسومية متقدمة من Gradio لموسيبي تونر:

من الواضح أن واجهة مستخدم友ية تفضل على ملفات BAT التي أستخدمها في هذه الميزة – بمجرد أن يصبح musubi-tuner-gui يعمل. في الوقت الذي أكتب فيه، تم إطلاقه قبل خمس أيام فقط، ولا أستطيع العثور على حساب لأي شخص استخدمه بنجاح.

وفقًا للمشاركات في المستودع، يُقصد من واجهة المستخدم الجديدة دمجها مباشرة في مشروع Musubi Tuner في أقرب وقت ممكن، مما سيؤدي إلى إنهاء وجودها كمتجر مستقل على GitHub.

بناءً على تعليمات التثبيت الحالية، يتم استنساخ الواجهة الجديدة مباشرة إلى البيئة الافتراضية Musubi الحالية؛ ومع ذلك، بعد العديد من المحاولات، لا أستطيع أن أجعلها تتوافق مع التثبيت الحالي من Musubi.

مرة واحدة يتم دمج الواجهة في Musubi Tuner، سيتم حل مشاكل من هذا القبيل (بالإضافة إلى مسارات افتراضية في وقت التثبيت، واستخدام حزمة Python UV، والتي تعقيد بعض الإجراءات في الإصدار الجديد))، وربما سنضطر إلى الانتظار لفترة من الوقت حتى نحصل على تجربة تدريب Hunyuan Video LoRA أكثر سلاسة. ومع ذلك، يبدو واعدًا!

ولكن إذا كنت لا تستطيع الانتظار، وترغب في لف袖يك قليلاً، يمكنك تشغيل Hunyuan Video LoRA Training محليًا الآن.

هيا نبدأ.

لماذا نثبت أي شيء على معدن عاري؟

(تخطى هذا الفقرة إذا كنت مستخدمًا متقدمًا)

سيستغرب المستخدمون المتقدمون لماذا اخترت تثبيت الكثير من البرامج على التثبيت العاري لنظام ويندوز 10 بدلاً من في بيئة افتراضية. السبب هو أن منفذ نظام ويندوز للطراز المعتمد على لينكس Triton أكثر صعوبة في الحصول عليه في بيئة افتراضية. لا يمكن تثبيت جميع التثبيتات العارية الأخرى في هذا البرنامج التعليمي في بيئة افتراضية، لأنها يجب أن تتواصل مباشرة مع الأجهزة المحلية.

تثبيت الحزم والبرامج المسبقة

对于 البرامج والحزم التي يجب تثبيتها في البداية، يهم ترتيب التثبيت. هيا نبدأ.

1: تحميل Microsoft Redistributable

تحميل وتثبيت حزمة Microsoft Redistributable من https://aka.ms/vs/17/release/vc_redist.x64.exe.

هذا تثبيت سريع وبسيط.

2: تثبيت Visual Studio 2022

تحميل إصدار المجتمع من Microsoft Visual Studio 2022 من https://visualstudio.microsoft.com/downloads/?cid=learn-onpage-download-install-visual-studio-page-cta

تشغيل المثبت الذي تم تحميله:

لا نحتاج إلى جميع الحزم المتاحة، والتي ستكون تثبيتًا ثقيلًا وطويلًا. في الصفحة الأولى الاحمال التي تفتح، اختر تطوير سطح المكتب مع C++ (انظر الصورة أدناه).

انقر الآن على علامة المكونات الفردية في الجزء العلوي الأيسر من الواجهة واستخدم مربع البحث للعثور على ‘Windows SDK’.

بالافتراض، يتم تحديد Windows 11 SDK فقط. إذا كنت على نظام ويندوز 10 (لم يتم اختبار إجراء التثبيت من قبلي على نظام ويندوز 11)، اختر أحدث إصدار من نظام ويندوز 10، كما هو موضح في الصورة أعلاه.

ابحث عن ‘C++ CMake’ واكد أن أدوات C++ CMake لويندوز محددة.

سيحتاج هذا التثبيت إلى ما لا يقل عن 13 غيغابايت من المساحة.

مرة واحدة يتم تثبيت Visual Studio، سيتحاول تشغيله على جهاز الكمبيوتر. اسمح له بالتشغيل بالكامل. عندما تكون واجهة Visual Studio كاملة على الشاشة، أغلق البرنامج.

3: تثبيت Visual Studio 2019

تتوقع بعض الحزم اللاحقة لموسيبي إصدارًا أقدم من Microsoft Visual Studio، في حين أن البعض الآخر يحتاج إلى إصدار أحدث.

لذلك، قم أيضًا بتحميل إصدار المجاني من Visual Studio 19 إما من Microsoft (https://visualstudio.microsoft.com/vs/older-downloads/ – حساب مطلوب) أو Techspot (https://www.techspot.com/downloads/7241-visual-studio-2019.html).

ثبت مع نفس الخيارات مثل Visual Studio 2022 (انظر الإجراء أعلاه، باستثناء أن Windows SDK يتم تحديده بالفعل في مثبت Visual Studio 2019).

سترون أن مثبت Visual Studio 2019 يعرف بالفعل الإصدار الأحدث أثناء التثبيت:

عند اكتمال التثبيت، وفتحت تطبيق Visual Studio 2019 وتغييته، افتح سطر أوامر ويندوز (اكتب CMD في بحث البداية) واكتب وادخل:

where cl

يجب أن يكون الناتج هو مواقع الإصدارين المثبتين من Visual Studio.

إذا حصلت على INFO: Could not find files for the given pattern(s)، راجع قسم تحقق من المسارات في هذا المقال، واستخدم تلك التعليمات لإضافة مسارات Visual Studio ذات الصلة إلى بيئة ويندوز.

احفظ أي تغييرات تم إجراؤها وفقًا لجزء تحقق من المسارات أدناه، ثم حاول أمر where cl مرة أخرى.

4: تثبيت CUDA 11 + 12 Toolkits

تتطلب الحزم المختلفة المثبتة في Musubi إصدارات مختلفة من NVIDIA CUDA، والتي تعمل على تسريع وضبط التدريب على بطاقات الرسومات من NVIDIA.

السبب الذي قمت به تثبيت إصدارات Visual Studio أولاً هو أن مثبتات NVIDIA CUDA تبحث عن وتكامل مع أي تثبيتات Visual Studio موجودة.

تحميل حزمة تثبيت CUDA 11+ من:

https://developer.nvidia.com/cuda-11-8-0-download-archive?target_os=Windows&target_arch=x86_64&target_version=11&target_type=exe_local (تحميل ‘exe (local)’ )

تحميل حزمة تثبيت CUDA 12+ من:

https://developer.nvidia.com/cuda-downloads?target_os=Windows&target_arch=x86_64

عملية التثبيت متطابقة للطريقتين (11+ و 12+).

تثبيت NVIDIA CUDA Toolkit V11+

تشغيل مثبت CUDA 11+.

في خيارات التثبيت، اختر مخصص (متقدم) وتابع.

ألغِ تحديد خيار NVIDIA GeForce Experience واكتب التالي.

اترك تحديد موقع التثبيت على الإعدادات الافتراضية (هذا مهم):

انقر على التالي واسمح للتثبيت أن يكتمل.

تجاهل أي تحذير أو ملاحظات يقدمها المثبت حول تكامل Nsight Visual Studio، الذي لا يُستخدم في حالتنا.

تثبيت NVIDIA CUDA Toolkit V12+

كرر العملية بالكامل لمثبت NVIDIA Toolkit 12+:

عملية التثبيت متطابقة مع الإصدار 11+ (الموضح أعلاه)، باستثناء تحذير واحد حول مسارات البيئة، والتي يمكن تجاهلها:

عند اكتمال تثبيت إصدار CUDA 12+، افتح سطر أوامر ويندوز واكتب وادخل:

nvcc --version

يجب أن يُظهر ذلك معلومات حول إصدار السائق المثبت:

لتحقق من أن بطاقتك معترف بها، اكتب وادخل:

nvidia-smi

5: تثبيت GIT

GIT سيتولى تثبيت مستودع Musubi على جهاز الكمبيوتر المحلي. تحميل المثبت GIT من:

https://git-scm.com/downloads/win (’64-bit Git for Windows Setup’)

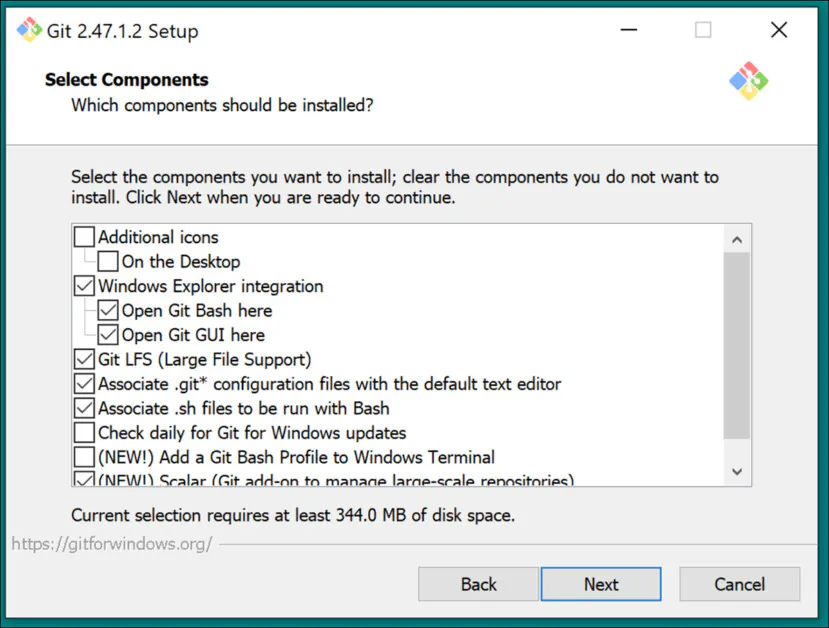

تشغيل المثبت:

استخدم الإعدادات الافتراضية لـ تحديد المكونات:

اترك المحرر الافتراضي على Vim:

اسمح لGIT أن يقرر عن أسماء الفروع:

استخدم الإعدادات الموصى بها ل مسار البيئة:

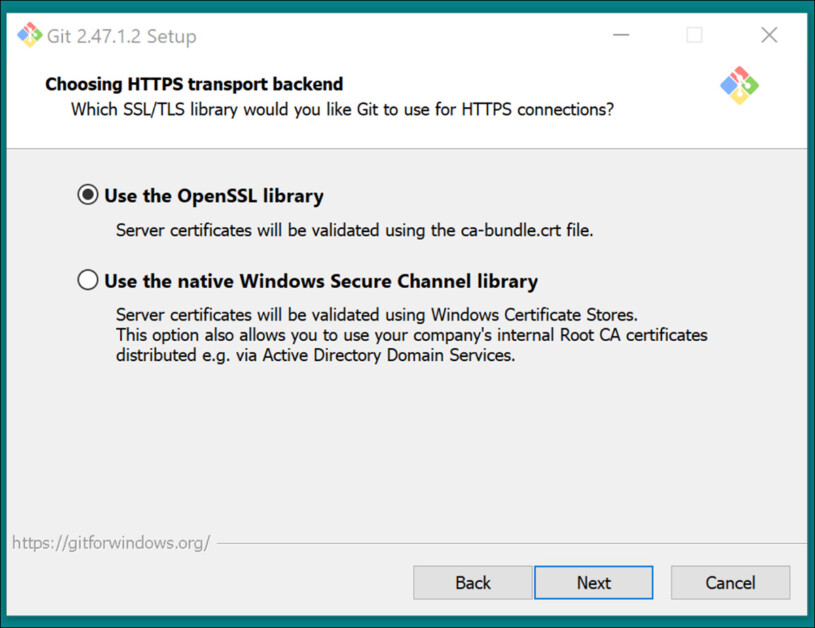

استخدم الإعدادات الموصى بها ل SSH:

استخدم الإعدادات الموصى بها ل نقل HTTPS:

استخدم الإعدادات الموصى بها لتحويلات نهاية السطر:

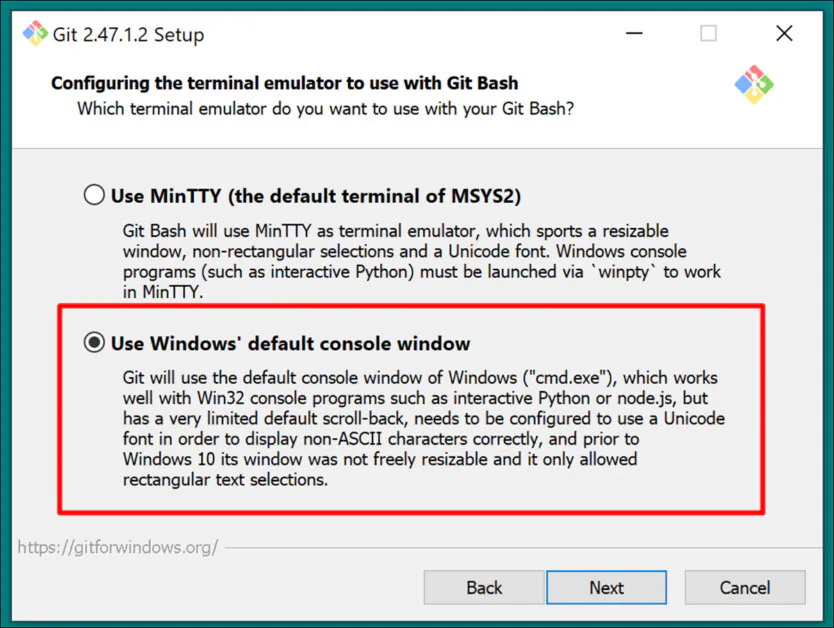

اختر محطة ويندوز الافتراضية كمحاكي طرفي:

استخدم الإعدادات الافتراضية (التقدّم السريع أو الدمج) لجذب GIT:

استخدم مدير بيانات GIT (الإعداد الافتراضي) لمساعد الإعدادات:

في تكوين الخيارات الإضافية، اترك تمكين ذاكرة التخزين المؤقت للنظام الملفات محددًا، و تمكين الارتباطات الرمزية غير محدد (ما لم تكن مستخدمًا متقدمًا تستخدم الارتباطات الرمزية ل仓 مخزن مركزي).

اكمل التثبيت واختبر أن GIT مثبت بشكل صحيح عن طريق فتح نافذة CMD وكتابة وادخال:

git --version

يجب أن يظهر ذلك:

git version 2.38.1.windows.1

تسجيل الدخول إلى GitHub

في وقت لاحق، عندما تحاول استنساخ مستودعات GitHub، قد يتم الطلب منك بيانات اعتماد GitHub. لتوقع ذلك، سجل الدخول إلى حساب GitHub (أنشئ حسابًا إذا لزم الأمر) على أي متصفح مثبت على نظام ويندوز. بهذه الطريقة، يجب أن تكون طريقة المصادقة 0Auth (نافذة منبثقة) تستغرق وقتًا قصيرًا قدر الإمكان.

بعد ذلك التحدي الأول، يجب أن تظل مصادقًا تلقائيًا.

6: تثبيت CMake

يتطلب CMake 3.21 أو أحدث لبعض أجزاء عملية تثبيت Musubi. CMake هو هيكل تطوير متقاطع القطر يمكنه تنسيق مجمعات متنوعة، وترجمة برامج من شفرة المصدر.

تحميله من:

https://cmake.org/download/ (‘Windows x64 Installer’)

تشغيل المثبت:

اكد أن إضافة Cmake إلى متغير المسار محدد.

انقر على التالي.

اكتب وادخل هذا الأمر في سطر أوامر ويندوز:

cmake --version

إذا تم تثبيت CMake بنجاح، يجب أن يظهر شيء مثل:

cmake version 3.31.4

CMake suite maintained and supported by Kitware (kitware.com/cmake).

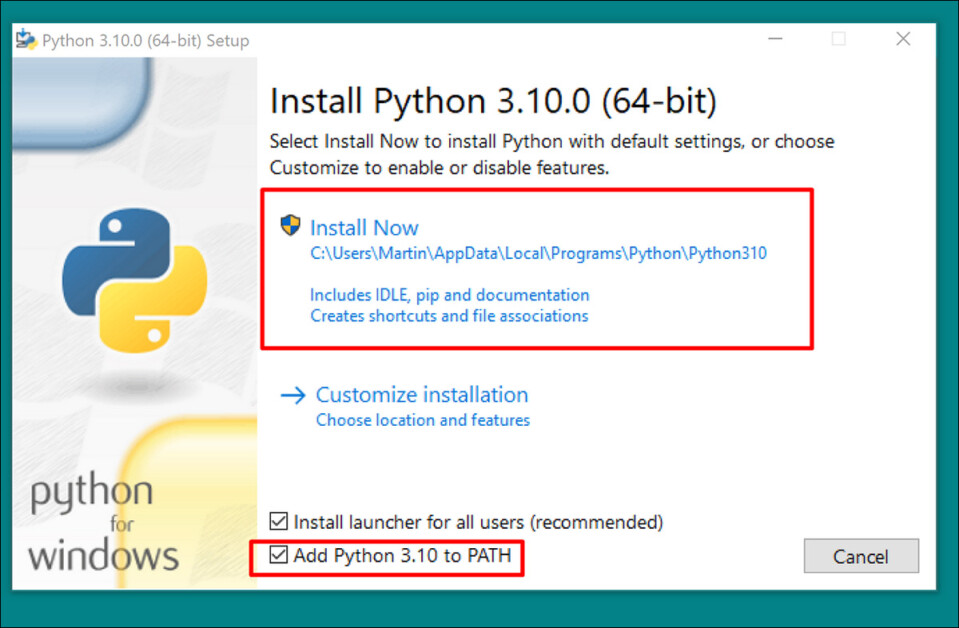

7: تثبيت Python 3.10

مفسر Python هو مركزي في هذا المشروع. تحميل الإصدار 3.10 (أفضل حل وسط بين المطالب المختلفة لحزم Musubi) من:

https://www.python.org/downloads/release/python-3100/ (‘مثبت ويندوز (64 بت)’)

تشغيل المثبت الذي تم تحميله، وترك الإعدادات على الإعدادات الافتراضية:

في نهاية عملية التثبيت، انقر على عطل حد طول المسار (يتطلب تأكيد إدارة المستخدم):

في سطر أوامر ويندوز، اكتب وادخل:

python --version

يجب أن يظهر ذلك Python 3.10.0

تحقق من المسارات

تثبيت وتنفيذ إطارات Musubi يتطلب أن تعرف مكوناته مسار مكونات خارجية مهمة في نظام ويندوز، ولا سيما CUDA.

لذلك نحتاج إلى فتح مسار البيئة وتحقق من أن جميع المتطلبات موجودة هناك.

طريقة سريعة للوصول إلى التحكم في بيئة نظام ويندوز هي كتابة تحرير متغيرات النظام في شريط بحث نظام ويندوز.

النقر على هذا سيفتح لوحة تحكم خصائص النظام. في الجزء السفلي الأيمن من خصائص النظام، انقر على زر متغيرات البيئة، وستفتح نافذة تسمى متغيرات البيئة. في لوحة متغيرات النظام في الجزء السفلي من هذه النافذة، انتقل لأسفل إلى مسار واضغط ضغطاً مزدوجاً عليه. هذا سيفتح نافذة تسمى تحرير متغيرات البيئة. اسحب عرض هذه النافذة حتى تتمكن من رؤية المسار الكامل للمتغيرات:

هنا، المدخلات المهمة هي:

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\libnvvp

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\libnvvp

C:\Program Files (x86)\Microsoft Visual Studio\2019\Community\VC\Tools\MSVC\14.29.30133\bin\Hostx64\x64

C:\Program Files\Microsoft Visual Studio\2022\Community\VC\Tools\MSVC\14.42.34433\bin\Hostx64\x64

C:\Program Files\Git\cmd

C:\Program Files\CMake\bin

في معظم الحالات، يجب أن تكون متغيرات المسار الصحيحة موجودة بالفعل.

أضف أي مسارات مفقودة عن طريق النقر على جديد على يسار نافذة تحرير متغير البيئة ولصق المسار الصحيح:

لا تقم ببساطة بنسخ ولصق من المسارات المدرجة أعلاه؛ تحقق من أن كل مسار مكافئ موجود في تثبيت نظام ويندوز الخاص بك.

إذا كانت هناك اختلافات طفيفة في المسار (特别 مع تثبيتات Visual Studio)، استخدم المسارات المدرجة أعلاه للعثور على المجلدات المستهدفة الصحيحة (أي، x64 في Host64 في تثبيتك). ثم لصق هذه المسارات في نافذة تحرير متغير البيئة.

بعد ذلك، أعد تشغيل الكمبيوتر.

تثبيت Musubi

ترقية PIP

يمكن أن يسهل استخدام أحدث إصدار من مثبت PIP بعض مراحل التثبيت. في سطر أوامر ويندوز مع امتيازات مسؤول (انظر الرفع أدناه)، اكتب وادخل:

pip install --upgrade pip

الرفع

قد تتطلب بعض الأوامر امتيازات مسؤول (أي، تشغيلها كمسؤول). إذا تلقيت رسائل خطأ حول الأذونات في المراحل التالية، أغلق نافذة سطر الأوامر وافتحها مرة أخرى في وضع المسؤول عن طريق كتابة CMD في مربع بحث نظام ويندوز، وزر اليمين على سطر الأوامر واختيار تشغيل كمسؤول:

للمراحل التالية، سنستخدم Powershell بدلاً من سطر أوامر ويندوز. يمكنك العثور عليها عن طريق كتابة Powershell في مربع بحث نظام ويندوز، و (كما هو مطلوب) النقر بزر الماوس الأيمن عليها لتشغيلها كمسؤول:

تثبيت Torch

في Powershell، اكتب وادخل:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

كن صبورًا أثناء تثبيت العديد من الحزم.

عند اكتمال التثبيت، يمكنك التحقق من تثبيت PyTorch المتمكّن من GPU عن طريق كتابة وادخل:

python -c "import torch; print(torch.cuda.is_available())"

يجب أن يظهر ذلك:

C:\WINDOWS\system32>python -c "import torch;

print(torch.cuda.is_available())"

True

تثبيت Triton لويندوز

التالي، تثبيت مكون Triton لويندوز. في Powershell المرفوع، أدخل (في سطر واحد):

pip install https://github.com/woct0rdho/triton-windows/releases/download/v3.1.0-windows.post8/triton-3.1.0-cp310-cp310-win_amd64.whl

(مثبت triton-3.1.0-cp310-cp310-win_amd64.whl يعمل لكل من معالجات Intel وAMD طالما كانت المعمارية 64 بت والبيئة تتوافق مع إصدار Python)

بعد التشغيل، يجب أن يظهر ذلك:

Successfully installed triton-3.1.0

يمكننا التحقق من عمل Triton عن طريق استيراده في Python. أدخل هذا الأمر:

python -c "import triton; print('Triton is working')"

يجب أن يظهر ذلك:

Triton is working

لتحقق من أن Triton متمكّن من GPU، أدخل:

python -c "import torch; print(torch.cuda.is_available())"

يجب أن يظهر ذلك True:

إنشاء بيئة افتراضية لـ Musubi

من الآن فصاعدًا، سنثبت أي برنامج إضافي في بيئة افتراضية Python (أو venv). هذا يعني أن كل ما عليك فعله لإلغاء تثبيت جميع البرامج التالية هو سحب مجلد تثبيت venv إلى سلة المحذوفات.

دعونا ننشئ ذلك مجلد التثبيت: قم بإنشاء مجلد باسم Musubi على سطح المكتب. الأمثلة التالية تفترض أن هذا المجلد موجود: C:\Users\[اسم ملفك الشخصي]\Desktop\Musubi\.

في Powershell، انتقل إلى ذلك المجلد عن طريق كتابة:

cd C:\Users\[اسم ملفك الشخصي]\Desktop\Musubi

نريد أن يكون للبيئة الافتراضية وصولًا إلى ما قمنا بتثبيته حتى الآن (خاصة Triton)، لذلك سنستخدم علامة --system-site-packages. أدخل ذلك:

python -m venv --system-site-packages musubi

انتظر حتى يتم إنشاء البيئة، ثم قم بتفعيلها عن طريق كتابة:

.\musubi\Scripts\activate

من هذه النقطة فصاعدًا، يمكنك أن تعرف أنك في البيئة الافتراضية النشطة من خلال حقيقة أن (musubi) تظهر في بداية جميع أوامرك.

استنساخ المستودع

انتقل إلى المجلد الجديد musubi (الذي يوجد داخل مجلد Musubi على سطح المكتب):

cd musubi

الآن بعد أن وصلنا إلى المكان الصحيح، أدخل الأمر التالي:

git clone https://github.com/kohya-ss/musubi-tuner.git

انتظر حتى يتم استنساخ المستودع (لا يستغرق وقتًا طويلاً).

تثبيت المتطلبات

انتقل إلى مجلد التثبيت:

cd musubi-tuner

أدخل:

pip install -r requirements.txt

انتظر حتى تكتمل العديد من التثبيتات (هذا سوف يستغرق وقتًا أطول).

تأتمتة الوصول إلى venv Hunyuan Video

للوصول بسهولة إلى venv الجديد لمجلسات مستقبلية، لصق النص التالي في Notepad و احفظه باسم activate.bat، و احفظه مع خيار جميع الملفات (انظر الصورة أدناه).

@echo off

call C:\Users\[اسم ملفك الشخصي]\Desktop\Musubi\musubi\Scripts\activate

cd C:\Users\[اسم ملفك الشخصي]\Desktop\Musubi\musubi\musubi-tuner

cmd

(تأكد من استبدال [اسم ملفك الشخصي] باسم ملفك الشخصي الحقيقي على نظام ويندوز)

لا يهم إلى أي موقع تحفظ هذا الملف.

من الآن فصاعدًا، يمكنك تشغيل activate.bat وبدء العمل على الفور.

استخدام Musubi Tuner

تحميل النماذج

يتطلب عملية تدريب Hunyuan Video LoRA تحميل ما لا يقل عن سبعة نماذج لتدعم جميع خيارات التحسين الممكنة للمواد المسبقة والتدريب على Hunyuan Video LoRA. معًا، تزن هذه النماذج أكثر من 60 غيغابايت.

التعليمات الحالية لتحميلها يمكن العثور عليها في https://github.com/kohya-ss/musubi-tuner?tab=readme-ov-file#model-download

ومع ذلك، هذه هي تعليمات التحميل في وقت الكتابة:

clip_l.safetensors

llava_llama3_fp16.safetensors

llava_llama3_fp8_scaled.safetensors

يمكن تحميلها من:

https://huggingface.co/Comfy-Org/HunyuanVideo_repackaged/tree/main/split_files/text_encoders

mp_rank_00_model_states.pt

mp_rank_00_model_states_fp8.pt

mp_rank_00_model_states_fp8_map.pt

يمكن تحميلها من:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/transformers

pytorch_model.pt

يمكن تحميلها من:

https://huggingface.co/tencent/HunyuanVideo/tree/main/hunyuan-video-t2v-720p/vae

على الرغم من أنك يمكنك وضعها في أي مجلد تختاره، من أجل الاتساق مع التوجيهات البرمجية السابقة، دعونا نضعها في:

C:\Users\[اسم ملفك الشخصي]\Desktop\Musubi\musubi\musubi-tuner\models\

هذا يتوافق مع ترتيب الدلائل حتى هذه النقطة. لا تنس أن تحل محل [اسم ملفك الشخصي] باسم ملفك الشخصي الحقيقي على نظام ويندوز.

تحضير البيانات

مما لا شك فيه أنك ستحتاج إلى مكان ما بين 10-100 صورة لبيانات التدريب ل LoRA Hunyuan. يمكن الحصول على نتائج جيدة جدًا حتى مع 15 صورة، طالما كانت الصور متوازنة وجيدة الجودة.

يمكن تدريب Hunyuan LoRA على الصور أو مقاطع فيديو قصيرة وذات دقة منخفضة، أو حتى مزيج من كليهما – على الرغم من أن استخدام مقاطع فيديو كبيانات تدريب يعتبر تحديًا، حتى لمعامل 24 غيغابايت.

ومع ذلك، فإن مقاطع الفيديو مفيدة حقًا فقط إذا كان الشخص الذي تمثلته تتحرك بطريقة غير عادية قد لا يعرف عنها Hunyuan Video Foundation Model، أو لا يستطيع تخمينها.

الأمثلة تشمل روجر رابيت، و كсенومورف، و The Mask، و Spider-Man، أو شخصيات أخرى تتمتع بحركات فريدة.

منذ أن يعرف Hunyuan Video بالفعل كيف يتحرك الرجال والنساء العاديون، فإن مقاطع الفيديو ليست ضرورية لتحصل على شخصية LoRA Hunyuan Video من النوع البشري. لذلك سنستخدم الصور الثابتة.

تحضير الصور

قائمة الأماني

النسخة المختصرة:

من الأفضل استخدام صور جميعها بنفس الحجم لمجموعة بياناتك، أو استخدام تقسيم 50/50 بين حجمين مختلفين، أي 10 صور بحجم 512x768px و 10 بحجم 768x512px.

التركيب قد ينجح حتى لو لا تفعل ذلك – Hunyuan Video LoRAs يمكن أن تكون متسامحة بشكل مدهش.

النسخة الأطول:

كما هو الحال مع LoRAs Kohya-ss لمنظومات التوليد الثابتة مثل Stable Diffusion، التركيب يستخدم لتوزيع العبء على صور بحجم مختلف، مما يسمح باستخدام صور أكبر دون حدوث أخطاء ناتجة عن عدم كفاية الذاكرة في وقت التدريب (أي أن التركيب “يقسم” الصور إلى قطع يمكن للوحة الرسومات التعامل معها، مع الحفاظ على السلامة الدلالية للصورة الكاملة).

对于 كل حجم صورة تضيفه إلى مجموعة بيانات التدريب (أي 512x768px)، سيتم إنشاء “دلو” أو “مهمة فرعية” لهذا الحجم. إذا كان لديك توزيع الصور التالي:

2x 512x768px images

7x 768x512px images

1x 1000x600px image

3x 400x800px images

يمكننا رؤية أن انتباه الدلو غير متوازن بين هذه الصور:

لذلك، إما أن تظل على تنسيق واحد، أو حاول الحفاظ على توزيع الأحجام المختلفة بشكل متساوي.

في كلتا الحالتين، تجنب الصور الكبيرة، لأن هذا قد يبطئ عملية التدريب، دون فائدة تذكر.

للمساهمة، استخدمت 512x768px لجميع الصور في مجموعة بياناتي.

الاستثناء: النموذج (الشخص) المستخدم في مجموعة البيانات أعطاني الإذن الكامل لاستخدام هذه الصور لهذا الغرض، ووافق على جميع الإخراجات القائمة على الذكاء الاصطناعي التي تظهر شبهه في هذا المقال.

مجموعة بياناتي تتكون من 40 صورة، بتنسيق PNG (على الرغم من أن JPG جيد أيضًا). كانت صوري مخزنة في C:\Users\Martin\Desktop\DATASETS_HUNYUAN\examplewoman

يجب عليك إنشاء مجلد cache داخل مجلد الصور:

الآن دعونا ننشئ ملفًا خاصًا سيقوم بتهيئة التدريب.

ملفات TOML

عمليات التدريب والتركيب المسبق ل Hunyuan Video LoRAs تحصل على مسارات الملفات من ملف نص مسطح مع الامتداد .toml.

لمoji، يقع ملف TOML في C:\Users\Martin\Desktop\DATASETS_HUNYUAN\training.toml

محتوى ملف TOML الخاص بي يبدو كما يلي:

[general]

resolution = [512, 768]

caption_extension = ".txt"

batch_size = 1

enable_bucket = true

bucket_no_upscale = false

[[datasets]]

image_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman"

cache_directory = "C:\\Users\\Martin\\Desktop\\DATASETS_HUNYUAN\\examplewoman\\cache"

num_repeats = 1

(الشرطات المزدوجة للبيانات ومجلدات الذاكرة المؤقتة ليست ضرورية دائمًا، ولكنها يمكن أن تساعد في تجنب الأخطاء في الحالات التي يوجد فيها مسافة في المسار. لقد قمت بتدريب نماذج مع ملفات .toml استخدمت شرطات إلى الأمام وشرطات إلى الخلف).

يمكننا رؤية في قسم resolution أن هناك حجمين سيتم النظر فيهما – 512px و 768px. يمكنك أيضًا تركها على 512px، وستحصل على نتائج جيدة.

الصور

Hunyuan Video هو نموذج أساسي نص+رؤية، لذلك نحن بحاجة إلى صور وصفية ل这些 الصور، والتي سيتم النظر فيها أثناء التدريب. عملية التدريب ستفشل بدون صور.

هناك كثير من أنظمة تعليم رؤية مفتوحة المصدر التي يمكننا استخدامها لهذه المهمة، ولكن دعونا نبسط الأمور ونستخدم نظام taggui. على الرغم من أنه مخزن في GitHub، و على الرغم من أنه ي下载 بعض نماذج التعلم العميق الثقيلة عند التشغيل لأول مرة، إلا أنه يأتي في شكل تطبيق ويندوز بسيط ي تحميل مكتبات بايثون وواجهة مستخدم رسومية بسيطة.

بعد تشغيل Taggui، استخدم ملف > تحميل الدليل للانتقال إلى مجموعة بيانات الصور، واختياريًا وضع معرّف رمز (في هذه الحالة، examplewoman) سيتم إضافته إلى جميع الصور:

(تأكد من إيقاف تشغيل تحميل في 4 بت عند فتح Taggui لأول مرة – سيقوم بطرح أخطاء أثناء التسمية)

حدد صورة في عمود المعاينة الأيسر واضغط على CTRL+A لتحديد جميع الصور. ثم اضغط على زر بدء التسمية التلقائية على اليمين:

سترون Taggui ي下载 النماذج في الشريط الصغير في العمود الأيمن، ولكن فقط إذا كان هذا هو المرة الأولى التي تشغل فيها التسمية.

الآن، كل صورة لها ملف نصي対応 مع وصف لمحتوى الصورة:

يمكنك النقر على خيارات متقدمة في Taggui لزيادة طول ونمط الصور، ولكن ذلك يتجاوز نطاق هذا العرض التوضيحي.

اغلق Taggui و دعونا ننتقل إلى…

التركيب اللاتنتي

为了避免 تحميل GPU المفرط في وقت التدريب، من الضروري إنشاء نوعين من الملفات المسبقة – واحد لتمثيل الصورة اللاتنتية المستمدة من الصور نفسها، وآخر لتقييم ترميز نصي يتعلق بمحتوى التسمية.

为了简化这三个过程(2x缓存+训练),您可以使用交互式.BAT文件,它将询问您问题并在您提供必要信息后执行这些过程。

对于缓存潜在,我们将创建一个.BAT文件。将以下文本复制到记事本并将其保存为.BAT文件(例如,将其命名为“latent-precache.bat”),如下所示:

@echo off

REM Activate the virtual environment

call C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\Scripts\activate

REM Get user input

set /p IMAGE_PATH=Enter the path to the image directory:

set /p CACHE_PATH=Enter the path to the cache directory:

set /p TOML_PATH=Enter the path to the TOML file:

echo You entered:

echo Image path: %IMAGE_PATH%

echo Cache path: %CACHE_PATH%

echo TOML file path: %TOML_PATH%

set /p CONFIRM=Do you want to proceed with latent pre-caching (y/n)?

if /i "%CONFIRM%"=="y" (

REM Run the latent pre-caching script

python C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\cache_latents.py --dataset_config %TOML_PATH% --vae C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\models\pytorch_model.pt --vae_chunk_size 32 --vae_tiling

) else (

echo Operation canceled.

)

REM Keep the window open

pause

(请确保用您的真实Windows个人资料文件夹名称替换[Your Profile Name])

现在,您可以运行.BAT文件进行自动潜在缓存:

当.BAT文件提示您各种问题时,请粘贴或输入图像目录、缓存文件夹和TOML文件的路径。

文本预缓存

我们将创建第二个.BAT文件,这次用于文本预缓存。

@echo off

REM Activate the virtual environment

call C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\Scripts\activate

REM Get user input

set /p IMAGE_PATH=Enter the path to the image directory:

set /p CACHE_PATH=Enter the path to the cache directory:

set /p TOML_PATH=Enter the path to the TOML file:

echo You entered:

echo Image path: %IMAGE_PATH%

echo Cache path: %CACHE_PATH%

echo TOML file path: %TOML_PATH%

set /p CONFIRM=Do you want to proceed with text encoder output pre-caching (y/n)?

if /i "%CONFIRM%"=="y" (

REM Use the python executable from the virtual environment

python C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\cache_text_encoder_outputs.py --dataset_config %TOML_PATH% --text_encoder1 C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\models\llava_llama3_fp16.safetensors --text_encoder2 C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\models\clip_l.safetensors --batch_size 16

) else (

echo Operation canceled.

)

REM Keep the window open

pause

请确保用您的真实Windows个人资料文件夹名称替换[Your Profile Name]

将脚本保存为“text-cache.bat”(或您喜欢的任何名称),并按照与前一个.BAT文件相同的程序保存。

运行此新.BAT文件,按照指示,必要的文本编码文件将出现在缓存文件夹中:

训练Hunyuan Video LoRA

训练实际的LoRA将比这两个准备过程花费更长的时间。

虽然有多个变量我们可以担心(例如批次大小、重复次数、epochs、是否使用完整或量化模型等),但我们将把这些考虑留到另一天,并对LoRA创建进行更深入的研究。

现在,让我们最小化选择,训练一个LoRA,使用“中位数”设置。

我们将创建第三个.BAT文件,这次用于启动训练。将以下文本复制到记事本并将其保存为.BAT文件,如前所述,将其命名为“training.bat”(或您喜欢的任何名称):

@echo off

REM Activate the virtual environment

call C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\Scripts\activate

REM Get user input

set /p DATASET_CONFIG=Enter the path to the dataset configuration file:

set /p EPOCHS=Enter the number of epochs to train:

set /p OUTPUT_NAME=Enter the output model name (e.g., example0001):

set /p LEARNING_RATE=Choose learning rate (1 for 1e-3, 2 for 5e-3, default 1e-3):

if "%LEARNING_RATE%"=="1" set LR=1e-3

if "%LEARNING_RATE%"=="2" set LR=5e-3

if "%LEARNING_RATE%"=="" set LR=1e-3

set /p SAVE_STEPS=How often (in steps) to save preview images:

set /p SAMPLE_PROMPTS=What is the location of the text-prompt file for training previews?

echo You entered:

echo Dataset configuration file: %DATASET_CONFIG%

echo Number of epochs: %EPOCHS%

echo Output name: %OUTPUT_NAME%

echo Learning rate: %LR%

echo Save preview images every %SAVE_STEPS% steps.

echo Text-prompt file: %SAMPLE_PROMPTS%

REM Prepare the command

set CMD=accelerate launch --num_cpu_threads_per_process 1 --mixed_precision bf16 ^

C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\hv_train_network.py ^

--dit C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\models\mp_rank_00_model_states.pt ^

--dataset_config %DATASET_CONFIG% ^

--sdpa ^

--mixed_precision bf16 ^

--fp8_base ^

--optimizer_type adamw8bit ^

--learning_rate %LR% ^

--gradient_checkpointing ^

--max_data_loader_n_workers 2 ^

--persistent_data_loader_workers ^

--network_module=networks.lora ^

--network_dim=32 ^

--timestep_sampling sigmoid ^

--discrete_flow_shift 1.0 ^

--max_train_epochs %EPOCHS% ^

--save_every_n_epochs=1 ^

--seed 42 ^

--output_dir "C:\Users\[Your Profile Name]\Desktop\Musubi\Output Models" ^

--output_name %OUTPUT_NAME% ^

--vae C:/Users/[Your Profile Name]/Desktop/Musubi/musubi/musubi-tuner/models/pytorch_model.pt ^

--vae_chunk_size 32 ^

--vae_spatial_tile_sample_min_size 128 ^

--text_encoder1 C:/Users/[Your Profile Name]/Desktop/Musubi/musubi/musubi-tuner/models/llava_llama3_fp16.safetensors ^

--text_encoder2 C:/Users/[Your Profile Name]/Desktop/Musubi/musubi/musubi-tuner/models/clip_l.safetensors ^

--sample_prompts %SAMPLE_PROMPTS% ^

--sample_every_n_steps %SAVE_STEPS% ^

--sample_at_first

echo The following command will be executed:

echo %CMD%

set /p CONFIRM=Do you want to proceed with training (y/n)?

if /i "%CONFIRM%"=="y" (

%CMD%

) else (

echo Operation canceled.

)

REM Keep the window open

cmd /k

请确保用您的真实Windows个人资料文件夹名称替换所有[Your Profile Name]实例。

确保目录C:\Users\[Your Profile Name]\Desktop\Musubi\Output Models\存在,如果不存在,请在该位置创建它。

训练预览

Musubi训练器中有一个基本的训练预览功能,允许您强制训练模型暂停并根据您保存的提示生成图像。这些图像将保存在名为Sample的自动创建文件夹中,在保存训练模型的同一目录中。

为了启用此功能,您需要至少保存一个提示文件用于训练预览。训练.BAT文件将要求您输入此文件的位置,因此您可以将提示文件命名为任何名称,并将其保存在任何位置。

以下是提示文件的示例,用于训练预览,将输出三个不同图像:

如您所见,上面的示例中,提示的末尾有标志,这些标志将影响生成的图像:

–w是宽度(如果未设置,默认为256px,根据文档)

–h是高度(如果未设置,默认为256px)

–f是帧数。如果设置为1,则生成图像;如果设置为多个,则生成视频。

–d是种子。如果未设置,则为随机种子;但是,您应该设置它以查看提示的演变。

–s是生成步骤数,默认为20。

请参阅官方文档,以获取有关其他标志的更多信息。

虽然训练预览可以快速揭示可能导致您取消训练并重新考虑数据或设置的问题,但请记住,每个额外的提示都会减慢训练速度。

此外,训练预览图像的宽度和高度(如上所述的标志)越大,训练速度就会越慢。

启动训练.BAT文件。

问题#1是“输入数据集配置文件的路径”。粘贴或输入TOML文件的正确路径。

问题#2是“输入训练epoch数”。这是一个试错变量,因为它受到图像数量和质量以及字幕和其他因素的影响。一般来说,最佳方法是将其设置得过高而不是过低,因为您可以随时使用训练窗口中的Ctrl+C停止训练。首先将其设置为100,然后看看效果如何。

问题#3是“输入输出模型名称”。命名您的模型!最好保持名称相对较短和简单。

问题#4是“选择学习率”,默认为1e-3(选项1)。这是一个好的起点,暂时不需要更改。

问题#5是“多久保存一次预览图像(以步骤为单位)”。如果您将其设置得太低,您将看到训练预览图像之间的进度很小,这将减慢训练速度。

问题#6是“训练预览的文本提示文件位置是什么?”。粘贴或输入文本提示文件的路径。

然后,.BAT文件将显示它将发送到Hunyuan模型的命令,并询问您是否要继续,y/n。

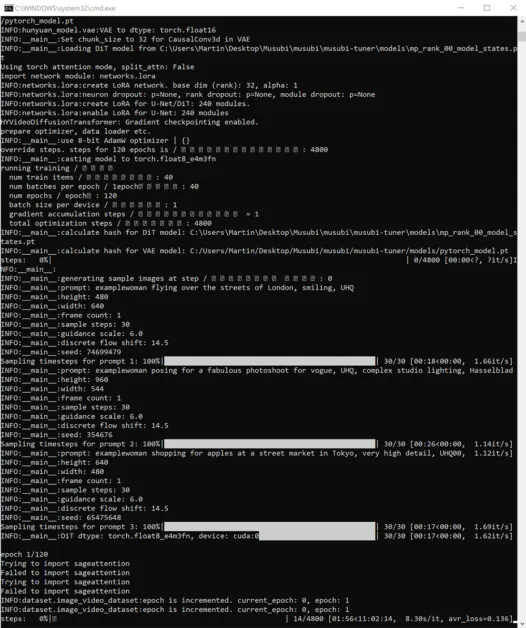

继续开始训练:

在此期间,如果您查看Windows任务管理器的性能选项卡的GPU部分,您将看到该过程占用了大约16GB的VRAM。

这可能不是一个任意的数字,因为这是许多NVIDIA图形卡上可用的VRAM数量,且上游代码可能已针对这些卡进行了优化。

话虽如此,增加此使用量非常容易,只需向训练命令发送更过分的标志即可。

在训练过程中,您将在CMD窗口的右下角看到自训练开始以来经过的时间,以及预计的总训练时间(这将根据标志、训练图像数量、训练预览图像数量和其他几个因素而有很大差异)。

典型的训练时间约为中等设置下的3-4小时,具体取决于可用的硬件、图像数量、标志设置和其他因素。

在Hunyuan Video中使用训练的LoRA模型

选择检查点

当训练完成时,您将为每个训练epoch拥有一个模型检查点。

此保存频率可以通过在训练.BAT文件中修改--save_every_n_epochs [N]数字来更改。如果您在设置训练时将每步保存次数设置得太低,则将有大量保存的检查点文件。

选择哪个检查点?

如前所述,早期训练的模型将更加灵活,而后期检查点可能提供更多细节。测试这些因素的唯一方法是运行一些LoRAs并生成一些视频。这样,您就可以了解哪些检查点是最有生产力的,并且在灵活性和保真度之间取得了最佳平衡。

ComfyUI

目前,Hunyuan Video LoRAs最流行的环境(尽管不是唯一的环境)是ComfyUI,一个具有复杂Gradio界面的基于Web的节点编辑器。

来源:https://github.com/comfyanonymous/ComfyUI

安装说明很简单,且可在ComfyUI的官方GitHub仓库中找到(可能需要下载其他模型)。

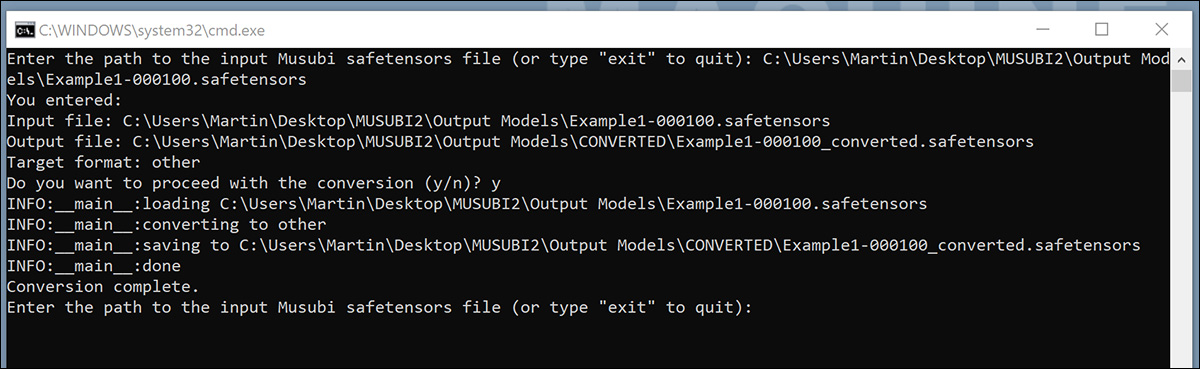

将模型转换为ComfyUI兼容格式

您的训练模型以(diffusers)格式保存,这种格式与大多数ComfyUI实现不兼容。Musubi可以将模型转换为ComfyUI兼容格式。让我们设置一个.BAT文件来实现此转换。

在运行此.BAT文件之前,请创建C:\Users\[Your Profile Name]\Desktop\Musubi\CONVERTED\文件夹,该文件夹是脚本所期望的。

@echo off

REM Activate the virtual environment

call C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\Scripts\activate

:START

REM Get user input

set /p INPUT_PATH=Enter the path to the input Musubi safetensors file (or type "exit" to quit):

REM Exit if the user types "exit"

if /i "%INPUT_PATH%"=="exit" goto END

REM Extract the file name from the input path and append 'converted' to it

for %%F in ("%INPUT_PATH%") do set FILENAME=%%~nF

set OUTPUT_PATH=C:\Users\[Your Profile Name]\Desktop\Musubi\Output Models\CONVERTED\%FILENAME%_converted.safetensors

set TARGET=other

echo You entered:

echo Input file: %INPUT_PATH%

echo Output file: %OUTPUT_PATH%

echo Target format: %TARGET%

set /p CONFIRM=Do you want to proceed with the conversion (y/n)?

if /i "%CONFIRM%"=="y" (

REM Run the conversion script with correctly quoted paths

python C:\Users\[Your Profile Name]\Desktop\Musubi\musubi\musubi-tuner\convert_lora.py --input "%INPUT_PATH%" --output "%OUTPUT_PATH%" --target %TARGET%

echo Conversion complete.

) else (

echo Operation canceled.

)

REM Return to start for another file

goto START

:END

REM Keep the window open

echo Exiting the script.

pause

请确保用您的真实Windows个人资料文件夹名称替换所有[Your Profile Name]实例。

将脚本保存为“convert.bat”(或您喜欢的任何名称),并按照与前几个.BAT文件相同的程序保存。

一旦保存,双击新.BAT文件,它将询问要转换的文件的位置。

粘贴或输入要转换的文件的路径,输入y,然后按Enter。

转换LoRA后,脚本将询问您是否要转换另一个文件。如果您想在ComfyUI中测试多个检查点,请转换一些模型。

当您转换了足够的检查点后,关闭.BAT命令窗口。

现在,您可以将转换后的模型复制到ComfyUI安装中的models\loras文件夹中。

通常,正确的位置是类似这样的路径:

C:\Users\[Your Profile Name]\Desktop\ComfyUI\models\loras\

在ComfyUI中创建Hunyuan Video LoRAs

虽然ComfyUI的节点工作流看起来最初很复杂,但其他更高级用户的设置可以通过将用其他用户的ComfyUI创建的图像直接拖入ComfyUI窗口来加载。工作流也可以以JSON文件的形式导出,这些文件可以手动导入或拖入ComfyUI窗口。

一些导入的工作流可能具有在您的安装中不存在的依赖项。因此,请安装ComfyUI-Manager,它可以自动获取缺失的模块。

来源:https://github.com/ltdrdata/ComfyUI-Manager

要加载本教程中模型的工作流,请下载此JSON文件并将其拖入ComfyUI窗口(尽管有更好的工作流示例可在采用Hunyuan Video的Reddit和Discord社区中找到,我自己的工作流是从其中一个改编而来)。

这不是ComfyUI使用的综合教程的地方,但值得提到几个将影响输出的关键参数,如果您下载并使用我链接到的JSON布局。

1) 宽度和高度

您的图像越大,生成时间就越长,出-of-memory(OOM)错误的风险就越高。

2) 长度

这是帧数的数字值。它加起来的秒数取决于帧率(在此布局中设置为30fps)。您可以使用Omnicalculator根据fps将秒转换为帧。

3) 批次大小

您将批次大小设置得越高,结果可能就会越快,但VRAM的负担也会越大。将其设置得太高,您可能会遇到OOM。

4) 生成后控制

这控制随机种子。子节点的选项是固定、递增、递减和随机化。如果您将其留在固定,并且不更改文本提示,则每次都会得到相同的图像。如果您修改文本提示,图像将以有限的方式更改。递增和递减设置允许您探索附近的种子值,而随机化会给您一个完全新的提示解释。

5) LoRA名称

您需要在这里选择自己的已安装模型。

6) 令牌

如果您已经训练了模型以触发概念(例如example-person),请在提示中包含触发词。

7) 步骤

这代表系统将应用于扩散过程的步骤数量。更高的步骤可能会获得更好的细节,但这种方法的有效性有一个上限,而这个上限可能很难找到。步骤的常见范围是20-30。

8) 瓦片大小

这定义了生成过程中一次处理的信息量。默认设置为256。提高它可以加快生成速度,但提高太多可能会导致OOM,这是一个令人沮丧的体验,因为它发生在漫长的过程结束时。

9) 时间重叠

Hunyuan Video生成的人物可能会导致“鬼影”或不令人信服的运动,如果此设置太低。通常,当前的智慧是应该将其设置为高于帧数,以产生更好的运动。

结论

虽然ComfyUI的使用不在本文的讨论范围内,但社区经验和在线指南可以帮助您学习曲线。