الذكاء الاصطناعي

مقدمة إلى Vertex AI

نظرًا لتطور المناظر الطبيعية سريعًا للذكاء الاصطناعي، فإن أحد أكبر العوائق التي تواجه قادة التكنولوجيا غالبًا هو الانتقال من كونهم “تجريبيين” إلى كونهم “جاهزين للشركة”. في حين أن روبوتات الدردشة التفاعلية والمنصات التفاعلية تساعد في تخيل الجمهور، لا يمكن للشركات النجاح مع واجهة دردشة فقط. في عصر حيث التنافس أكثر عدوانية من أي وقت مضى، تحتاج الشركات إلى نظام بيئي قوي وموسع وأمني، وهذا ما تحاول جوجل تقديمه مع Vertex AI، منصة الذكاء الاصطناعي والتعلم الآلي الموحدة لجوجل كلود.

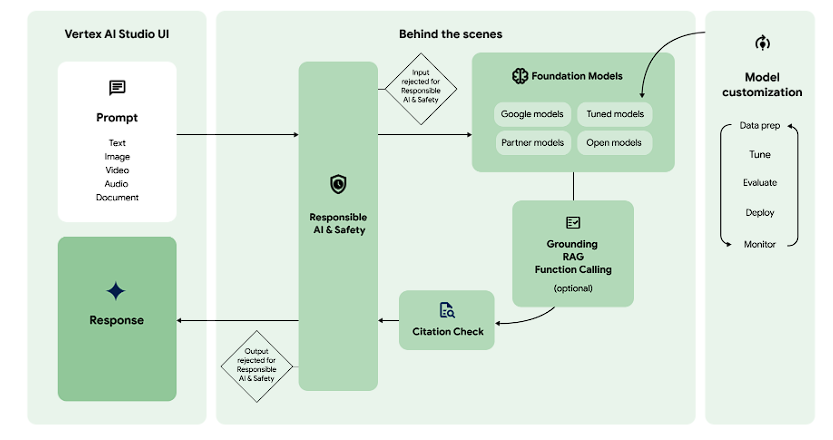

تحاول Vertex AI تعزيز نفسها كالعصب للدمج التوليدي للذكاء الاصطناعي مع البنية التحتية السحابية الحديثة، وتقدم مجموعة شاملة من الميزات التي تُغلق الفجوة بين نماذج الأساس الخام وتطبيقات الإنتاج من الدرجة الأولى. Vertex AI ليست مجرد غلاف لنماذج اللغة الكبيرة (LLMs)، بل هي نظام موحد للتعلم الآلي والذكاء الاصطناعي (ML/AI) يعامل الذكاء التوليدي كمواطن من الدرجة الأولى في البنية التحتية السحابية الحديثة.

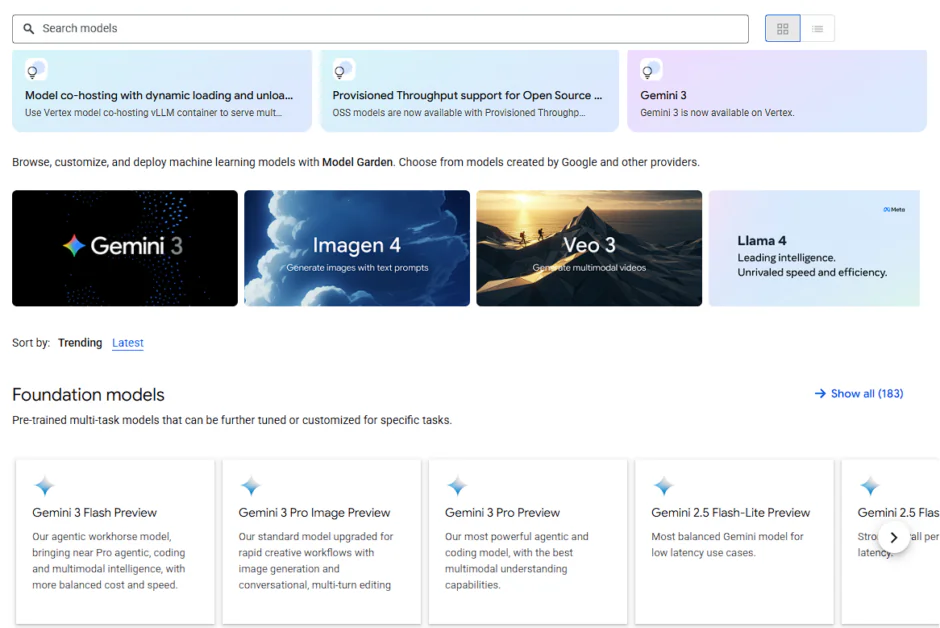

في قلب Vertex AI يقع حديقة النماذج، وهو سوق مركزي يوفر الوصول إلى أكثر من 200 نموذج أساسي منقول، بما في ذلك قوة متعددة الأوضاع جيميني 2.5 برو، والتي تتميز بنافذة سياق مذهلة تبلغ 2 مليون رمز. في هذه المقالة، سنقوم بفحص هيكل Vertex AI، واستكشاف كيف تعمل حديقة النماذج كمتجر تطبيقات للصناعة، وننظر إلى الركائز الفنية التي تجعل هذه المنصة العمود الفقري للجيل التالي من برامج الشركات.

الهيكل الرئيسي: منصة موحدة

Vertex AI ليست مجموعة من الأدوات غير المتصلة، بل نظام بيئي موحد للبيانات والذكاء مصمم لجسر التجزئة للبيانات والأدوات والفرق التي تعاني منها التعلم الآلي حتى اليوم. تقليديًا، يتم تطوير الذكاء الاصطناعي في بيئات معزولة، وأحيانًا يتم نشر البيانات وتحجيزها عبر مستودعات متعددة. على سبيل المثال، قد تخزن المنظمات بيانات العملاء في مستودعات SQL بينما يتم إلقاء الوثائق غير المهيكلة في بحيرة البيانات. عندما يتم عزل البيانات، يرى الذكاء الاصطناعي فقط “الحقيقة الجزئية”، مما يؤدي إلى نتائج متحيزة أو معدلات هلوسة عالية لأنها تفتقر إلى السياق الكامل للشركة.

تحاول Vertex AI دمج الدورة الحياتية الكاملة، من استهلاك البيانات الخام في BigQuery و Cloud Storage إلى مراقبة الإنتاج، وتعمل بشكل أساسي كـ “نسيج رابط” بين هذه السيلوس. تدمج Vertex AI بشكل أصلي مع Cloud Storage و BigQuery، مما يسمح للأطراف الذكية بالحصول على البيانات دون трубوبات استخراج وتحويل و تحميل معقدة.

الأساس: حاسوب الذكاء الاصطناعي الفائق لجوجل

تقع طبقة GenAI من Vertex AI على قمة هيكل حاسوب الذكاء الاصطناعي الفائق لجوجل، وهو نظام حاسوبي فائق متكامل، يتكون من:

TPU v5p & v5e (وحدات معالجة التنسور)

وحدات معالجة التنسور المخصصة لجوجل هي دوائر متكاملة مخصصة مصممة خصيصًا للضرب المصفوفي الذي يحدد التعلم العميق.

- TPU v5p (الأداء): هذا هو المسرع الرئيسي للتدريب على نطاق ضخم. يمكن لكل_pod TPU v5p النمو إلى 8,960 شريحة متصلة بواسطة Inter-Chip Interconnect (ICI) الأعلى 带width في جوجل عند 4,800 Gbps. لمدير التكنولوجيا، هذا يعني تدريب أسرع 2.8 مرة لنموذج بحجم GPT-3 (175B معامل) مقارنة بالجيل السابق، مما يقلل بشكل كبير من وقت التسويق.

- TPU v5e (الكفاءة): مصمم لأداء “مثالي التكلفة”، v5e هو الحصان للتدريب على نطاق متوسط والاستدلال عالي الإنتاجية. يقدم حتى 2.5 مرة أفضل أداء سعري، مما يجعله الخيار المثالي للشركات التي تحتاج إلى تشغيل الاستدلال 24/7 دون ميزانية ضخمة.

NVIDIA H100/A100 GPUs للتنوع

في حين أن وحدات معالجة التنسور مخصصة، يعتمد العديد من فرق التطوير على نظام NVIDIA CUDA. توفر Vertex AI دعمًا من الدرجة الأولى لأحدث أجهزة NVIDIA:

- NVIDIA H100 (Hopper): مثالي لتعديل النماذج المفتوحة الأكبر (مثل Llama 3.1 405B) التي تتطلب مساحة ذاكرة كبيرة.

- شبكة جوبيتر: لمنع “عقبة الشبكة”، تستخدم جوجل شبكة شبكة مركز البيانات جوبيتر. هذا يضمن أن تتحرك البيانات بسرعة البرق بين وحدات معالجة الرسومات، مع دعم RDMA (الوصول المباشر إلى الذاكرة عن بُعد) لتجاوز عبء المعالجة المركزية وتقديم أداء قريب من المحلي عبر العقد الموزعة.

التوجيه الديناميكي

أهم تحول تقني في Vertex AI هو التوجيه الديناميكي. في بيئة موروثة، إذا فشلت عقدة GPU أثناء تشغيل تدريبي لمدة 3 أسابيع، قد ينهار العمل كله.

- الاستجابة التلقائية: Vertex AI، التي تعمل غالبًا بواسطة جوجل كوبيرنيتس إنجن (GKE) تحت الغطاء، تتميز بعقد “تعالج نفسها”. إذا تم الكشف عن عطل أجهزة، تهاجر المنصة تلقائيًا إلى عقدة صحية.

- مجدول شغل ديناميكي: يسمح هذا الأداة للفرق بطلب السعة بناءً على الضرورة. يمكنك اختيار بدء مرن (أرخص، يبدأ عند توفر السعة) أو سعة مضمونة للإصدارات الحيوية.

- تدريب بدون خادم: للفرق التي تريد إدارة البنية التحتية صفر، يسمح Vertex AI Serverless Training لك بتقديم رمزك وبياناتك؛ توفر المنصة الكلستر، وتشغيل الوظيفة، وتفكيكها – وتفرض عليك فقط على ثواني الحوسبة المستخدمة.

النقاط الثلاث للدخول: الاكتشاف والتجربة والتحكم الآلي

للمواجهة مع مختلف الشخصيات الفنية – من علماء البيانات إلى مطورين التطبيقات – توفر Vertex AI ثلاث نقاط دخول رئيسية:

- حديقة النماذج: سوق الاكتشاف.

- Vertex AI Studio: ملعب التجربة.

- Vertex AI Agent Builder: مصنع التحكم الآلي.

حديقة النماذج: سوق الاكتشاف

حديقة النماذج لجوجل كلود هي منصة مركزية داخل جوجل كلود لاكتشاف وتجربة وتعديل وتشغيل مجموعة واسعة من نماذج الذكاء الاصطناعي، بما في ذلك النماذج متعددة الأوضاع (الرؤية، النص، الشفرة) لمختلف الاحتياجات التجارية، وتوفر تكاملًا سلسًا مع أدوات Vertex AI لعمليات MLOps المُدارة. تعمل كمكتبة شاملة، تساعد المطورين والشركات على اختيار النموذج الصحيح (من نماذج الأساس الكبيرة إلى النماذج المتخصصة) لمهامهم، سواء كانت لإنشاء نص أو تحليل صورة أو إكمال شفرة، وتنشرها بفعالية داخل بيئة جوجل كلود.

تصنف حديقة النماذج نماذجها البالغ عددها 200+ إلى ثلاث فئات متميزة، مما يسمح للمهندسين المعماريين بالتوازن بين الأداء والتكلفة والتحكم:

- نماذج جوجل الأولى (جوجل): هذه هي نماذج متعددة الأوضاع الرئيسية المتاحة داخل Vertex AI، وتقدم جوجل هذه النماذج في أحجام مختلفة، تتراوح من برو مع منطق معقد إلى فلاش منخفض الاتساع وعالية الحجم، مما يسمح للمطورين بتحسين نماذجهم وفقًا لاستخداماتهم.

- نماذج طرف ثالث (مملوكة): من خلال شراكات استراتيجية، توفر Vertex AI وصولًا إلى “نموذج كخدمة” (MaaS) لنماذج مثل Anthropic (Claude 3.5) وMistral AI. بدلاً من إدارة بيانات فواتير وأمان منفصلة لخمسة مقدماً لذكاء اصطناعي مختلفين، يمكن لفريق التكنولوجيا الوصول إلى جميعها من خلال مشروع جوجل كلود الحالي، باستخدام تنسيق API موحد.

- النماذج المفتوحة والمفتوحة الوزن: تتضمن هذه الفئة Meta’s Llama 3.2، Mistral، و Gemma الخاصة بجوجل. هذه مثالية للشركات التي تريد نشر النماذج داخل VPC (شبكة خاصة افتراضية) الخاصة بها لضمان عزل البيانات الأقصى.

في بيئة غير موحدة، يتطلب نشر نموذج مفتوح المصدر مثل Llama إعداد بيئة PyTorch، وتكوين سائق CUDA، وإدارة غلاف Flask أو FastAPI.

تُزيل حديقة النماذج مرحلة “التنقيب” هذه من خلال نقاط النهاية المدارة الموحدة:

- تثبيت النقرة الواحدة: بالنسبة للعديد من النماذج، يؤدي النقر على “تثبيت” إلى توفير الموارد اللازمة TPU/GPU تلقائيًا، وغليف النموذج في حاوية جاهزة للإنتاج، وتوفير نقطة نهاية API.

- تكامل Hugging Face: Vertex AI الآن تسمح للمطورين بنشر النماذج مباشرة من Hugging Face Hub إلى نقطة نهاية Vertex، مما يوفر توسعًا شبه لا نهائي للذكاء المتاح.

- اتصال الخدمة الخاصة (PSC): للصناعات الخاضعة للتنظيم بشدة، يمكن نشر النماذج باستخدام اتصال الخدمة الخاصة، مما يضمن أن نقطة نهاية النموذج لا يتم الكشف عنها على الإنترنت العام أبدًا – يحتفظ بحركة البيانات داخل الشبكة الشركة فقط.

استوديو Vertex AI: ملعب التجربة

في حين أن حديقة النماذج تتعلق بالاختيار، استوديو Vertex AI يتعلق بالدقة. يمكن مقارنة استوديو Vertex AI بالمنقح والمنقح الذي تتعامل معه في عالم البرمجيات التقليدية. استوديو Vertex AI هو مساحة العمل حيث يتم نحت النماذج الخام إلى أدوات أعمال محددة من خلال مزيج من هندسة التحفيز، واختبار متعدد الأوضاع، وضبط المعاملات المتقدم.

النمذجة متعددة الأوضاع: ما وراء النص

تتميز واحدة من ميزات الاستوديو هي دعمها الأصلي لمتعددة الأوضاع. في حين أن المنصات الأخرى تتطلب برمجة معقدة لمعالجة بيانات غير نصية، يسمح استوديو Vertex AI لك بإسقاط الملفات مباشرة إلى الواجهة لاختبار قدرات المنطق Gemini 2.5.

- ذكاء الفيديو: يمكنك تحميل مقطع فيديو تقني لمدة 45 دقيقة وطلب من النموذج “تحديد كل مرة يتم ذكر واجهة برمجة تطبيقات معينة وتقديم ملخص موصوف بالتوقيت”.

- تحليل الوثائق: بدلاً من مجرد قراءة النص، يمكن للنموذج تحليل التخطيط البصري لملف PDF يبلغ طوله 1000 صفحة، وفهم العلاقة بين الرسومات والجداول والنص المحيط.

- تنفيذ الشفرة: يدعم الاستوديو الآن تنفيذ الشفرة في الملعب. إذا سألت النموذج حل مشكلة رياضية معقدة أو تحليل ملف CSV، يمكن للنموذج كتابة وتنفيذ شفرة Python في بيئة آمنة معزولة لتوفير إجابة مؤكدة.

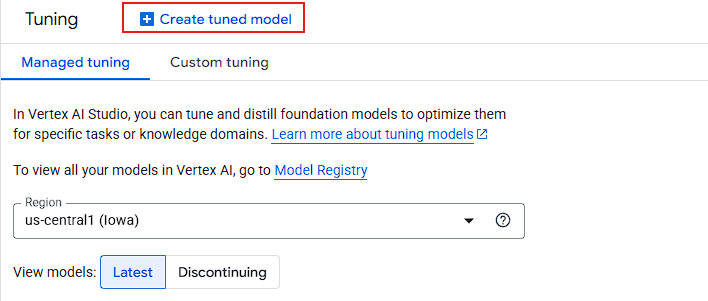

التخصيص المتقدم: مسار الضبط

عندما تصل هندسة التحفيز (Zero-shot أو Few-shot) إلى الحد الأقصى، يوفر استوديو Vertex AI الماكينة الثقيلة: ضبط النموذج.

- التعديل الدقيق الموجه (SFT): يوفر المطورون مجموعة بيانات من أزواج “تحفيز/استجابة” (مثاليًا 100+ مثال). هذا يعلم النموذج采用 صوت علامة تجارية معينة، أو تنسيق إخراج (مثل JSON مخصص)، أو مصطلحات معينة لصناعة معينة.

- مخزن السياق: للشركات التي تتعامل مع مجموعات بيانات ضخمة وساكنة (مثل مكتبة قانونية أو قاعدة شفرة)، يسمح الاستوديو بمخزن السياق. هذا يسمح لك “بتحميل مسبق” مليون رمز من البيانات إلى ذاكرة النموذج، مما يقلل بشكل كبير من التأخير والتكاليف للاستفسارات اللاحقة.

- التنقيط (المدرس-الطالب): هذا هو تحرك معماري عالي المستوى. يمكنك استخدام نموذج ضخم (Gemini 2.5 Pro) “لتعليم” نموذج أصغر وأسرع (Gemini 2.0 Flash). النتيجة هي نموذج خفيف الوزن يعمل على مستوى “Pro” ولكن ي चलत بسرعة وبتكلفة “Flash”.

بناء Vertex AI Agent: مصنع التحكم الآلي

بناء Vertex AI Agent هو إطار توجيه عالي المستوى يسمح للمطورين بإنشاء هذه الوكلاء من خلال الجمع بين نماذج الأساس مع بيانات الشركات وواجهات برمجة التطبيقات الخارجية.

هيكل “الحقيقة”: التأسيس و RAG

المانع الفني الرئيسي للذكاء الاصطناعي للشركات هو الهلوسة. يحل بناء الوكيل هذا من خلال محرك تأسيس متقدم.

- التأسيس مع بحث جوجل:对于 الاستفسارات التي تتطلب معرفة العالم في الوقت الفعلي (على سبيل المثال، “ما هي معدلات الرهن العقاري الحالية في نيويورك؟”)، يمكن للوكيل إجراء بحث جوجل، استخراج الحقائق، وذكر مصادره.

- بحث Vertex AI (RAG كخدمة): بدلاً من بناء قاعدة بيانات متجهة (Pinecone، Weaviate) يدوياً، يمكن للمطورين استخدام بحث Vertex AI لفهارس وثائقهم (PDFs، HTML، BigQuery). يعالج التجزئة، والتحويل، والاسترجاع تلقائياً، مما يضمن أن الوكيل يُجيب فقط بناءً على “مصدر الحقيقة” الداخلي.

- محرك Vertex AI RAG: للتنفيذات المخصصة على نطاق كبير، يسمح هذا الخدمة المدارة ببحث هجين (مزيج من نتائج قائم على المتجه والكلمات الرئيسية) لتحسين الدقة بنسبة تصل إلى 30% أكثر من مخرجات LLM القياسية.

توجيه الوكيل المتعدد (بروتوكول A2A)

تتطلب سير عمل الشركات المتقدمة غالبًا وكلاء متخصصين يعملون معًا. تقدم Vertex AI بروتوكول الوكيل إلى الوكيل (A2A)، وهو معيار مفتوح يسمح:

- التواصل بين الوكلاء: يمكن لوكيل “السفر” التحدث إلى “وكيل المالية” لضمان حجز رحلة ضمن الميزانية الشركة.

- التوافق: نظرًا لاستخدامه بروتوكول مفتوح، يمكن لوكلاء بناء Vertex التواصل مع أولئك الذين بنوا على إطارات أخرى مثل LangChain أو CrewAI.

مجموعة المطور: ADK ومحرك الوكيل

لمجموعة “منصة التكنولوجيا”، يقدم بناء الوكيل مساران متميزان:

- واجهة بدون كود: واجهة سحب وإفلات للنمذجة السريعة وتكوين مستخدم الأعمال.

- عربة تطوير الوكيل (ADK): أداة كود أولاً باللغة Python للمهندسين. يسمح ب “التحفيز ككود”، وتكامل التحكم في الإصدار، والقدرة على النشر إلى محرك Vertex AI Agent – وقت تشغيل مُدار يعالج استمرارية الجلسة، والتمكين، وإدارة الحالة تلقائيًا.

الخلاصة: من “ماذا لو” إلى “ماذا بعد”

الانتقال من عرض ذكاء اصطناعي جذاب إلى تطبيق شركة من الدرجة الأولى كان دائمًا “وادي الموت” لمشاريع التحول الرقمي. كما ناقشنا، تم تصميم Vertex AI خصيصًا لجسر هذه الفجوة. من خلال توحيد السيلوس المتجزئة للبيانات والبنية التحتية وتنسيق النموذج، انتقلت جوجل كلود الحوار بعيدًا عن القوة الخام لنماذج اللغة الكبيرة وتoward النضج التشغيلي لدورة حياة الذكاء الاصطناعي.