人工智能

面向实时 AI 人类的神经光图渲染

尽管当前对神经辐射场(NeRF)的兴趣浪潮正在兴起,NeRF是一种能够创建AI生成的3D环境和对象的技术,但这种新型图像合成技术仍需要大量的训练时间,并缺乏能够实现实时、高响应界面的实现。

然而,行业和学术界的一些著名人物之间的合作提出了对这一挑战的新解法(通常被称为新视图合成或NVS)。

研究论文《神经光图渲染》,声称相对于当前最先进的技术有了两个数量级的改进,代表了向实时CG渲染通过机器学习管道迈出了几步。

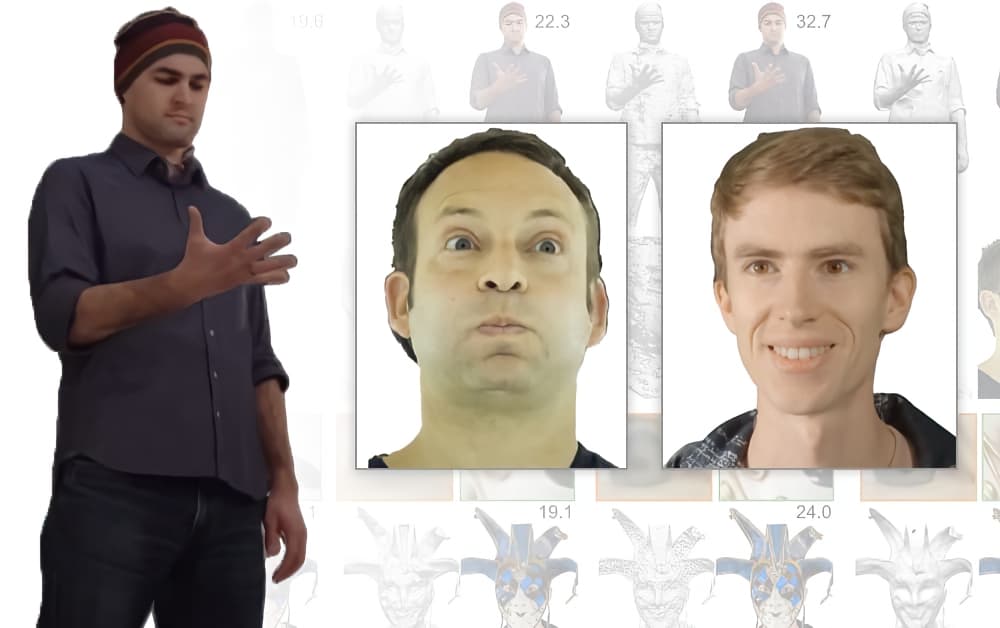

神经光图渲染(右)提供了更好的混合伪影分辨率和改进的遮挡处理,超过了以前的方法。 来源.

尽管论文只提到了斯坦福大学和全息显示技术公司Raxium(目前处于隐身模式),但贡献者包括谷歌的一位主要机器学习架构师,一位Adobe的计算机科学家,以及StoryFile的CTO(最近因创建AI版本的威廉·夏特纳而登上头条)。

关于最近的夏特纳宣传活动,StoryFile似乎正在其新过程中使用NLR,用于创建交互式、AI生成的实体,基于个人的特征和叙述。

StoryFile设想这种技术在博物馆展示、在线交互式叙述、全息显示、增强现实(AR)和文化文物记录中使用,并且似乎也在考虑NLR在招聘面试和虚拟约会应用中的潜在新应用:

StoryFile的在线视频中提出的用途。 来源:https://www.youtube.com/watch?v=2K9J6q5DqRc

体积捕捉用于新视图合成接口和视频

体积捕捉的原理,在一系列论文中,是从一个主题中获取静态图像或视频,并使用机器学习来“填充”原始摄像机阵列中未覆盖的视点。

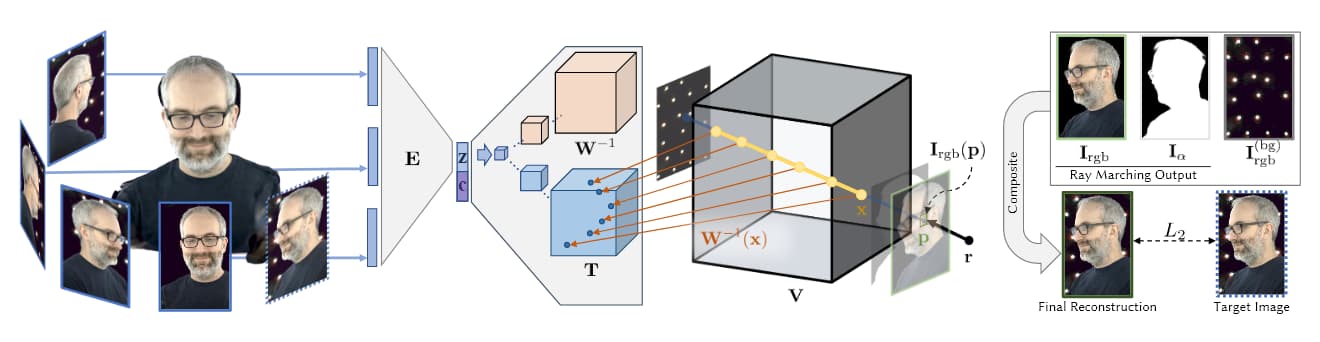

来源:https://research.fb.com/wp-content/uploads/2019/06/Neural-Volumes-Learning-Dynamic-Renderable-Volumes-from-Images.pdf

在上面的图像中,从Facebook 2019年的AI研究中,我们看到体积捕捉的四个阶段:多个摄像机获取图像/视频;编码器/解码器架构(或其他架构)计算和连接视图的相对性;射线行进算法计算体积空间中每个点的体素(或其他XYZ空间几何单位);并且(在最近的论文中)训练发生以合成一个可以在实时中操纵的完整实体。

正是这种通常广泛且数据密集的训练阶段,到目前为止,限制了新视图合成进入实时或高响应捕捉的领域。

新视图合成创建了一个完整的3D体积空间地图,这意味着将这些点拼接成传统的计算机生成网格相对简单,从而可以实时捕捉和表达CGI人类(或任何其他相对边界对象)。

使用NeRF的方法依赖于点云和深度图来生成捕捉设备的稀疏视点之间的插值:

NeRF可以通过深度图的计算生成体积深度,而不是生成CG网格。 来源:https://www.youtube.com/watch?v=JuH79E8rdKc

虽然NeRF能够计算网格,但大多数实现不使用此方法来生成体积场景。

相比之下,隐式可微分渲染器(IDR)方法,由威兹曼科学研究所于2020年10月发表,依赖于从捕捉阵列中自动生成的3D网格信息:

IDR捕捉转换为交互式CGI网格的示例。 来源:https://www.youtube.com/watch?v=C55y7RhJ1fE

虽然NeRF缺乏IDR的形状估计能力,但IDR无法匹配NeRF的图像质量,两者都需要大量资源来训练和收集(尽管NeRF的最近创新开始解决这个问题)。

NLR的自定义相机支架,配备16个GoPro HERO7和6个中心Back-Bone H7PRO相机。为了实现“实时”渲染,这些相机至少以60fps运行。 来源:https://arxiv.org/pdf/2103.11571.pdf

相反,神经光图渲染利用SIREN(正弦表示网络)将每种方法的优势融入其框架中,该框架旨在生成直接可用于现有实时图形管道的输出。

SIREN已被用于过去一年中类似的实现,现在代表了图像合成社区中业余Colab的热门API调用;然而,NLR的创新之处在于将SIREN应用于二维多视图图像监督,这由于SIREN产生过拟合而不是通用输出而变得具有挑战性。

提取CG网格后,通过OpenGL将网格光栅化,并将网格的顶点位置映射到相应的像素,然后计算各种贡献图的混合。

生成的网格比NeRF的更具普遍性和代表性,需要较少的计算,并且不会对无法从中受益的区域(如光滑的面部皮肤)施加过多的细节:

在负面方面,NLR目前尚无动态照明或重新照明的能力,输出仅限于捕捉时获得的阴影图和其他照明考虑。研究人员计划在未来的工作中解决这个问题。

此外,论文承认NLR生成的形状不如某些替代方法(如《像素级视图选择用于无结构多视立体》或威兹曼研究所提到的研究)准确。

体积图像合成的崛起

使用神经网络从有限的照片系列创建3D实体的想法早于NeRF,具有远见的论文可以追溯到2007年或更早。在2019年,Facebook的AI研究部门制作了一篇开创性的研究论文《神经体积:从图像学习动态可渲染体积》,这首先实现了对由机器学习生成的合成人类的响应式界面。

Facebook 2019年的研究实现了对体积人類的响应式用户界面的创建。 来源:https://research.fb.com/publications/neural-volumes-learning-dynamic-renderable-volumes-from-images/