人工智能

稳定的视频扩散:大型数据集的潜在视频扩散模型

生成式人工智能 一段时间以来,它一直是人工智能社区的推动力量,生成图像建模领域取得的进步,特别是扩散模型的使用,帮助生成视频模型不仅在研究方面取得了显着进展,而且在现实世界的应用程序。 传统上,生成视频模型要么从头开始训练,要么在图像和视频数据集的混合上从具有额外时间层的预训练图像模型部分或完全微调。

推进生成视频模型的进步,在本文中,我们将讨论 稳定的视频扩散模型,一种潜在视频扩散模型,能够生成高分辨率、最先进的图像到视频以及文本到视频内容。 我们将讨论用于合成 2D 图像的潜在扩散模型如何通过添加时间层以及在由高质量视频组成的小型数据集上微调模型来提高生成视频模型的能力和效率。 我们将更深入地研究稳定视频扩散模型的架构和工作原理,评估其在各种指标上的性能,并将其与当前最先进的视频生成框架进行比较。 那么让我们开始吧。

稳定视频扩散模型和生成视频模型:简介

由于其几乎无限的潜力,生成式人工智能一段时间以来一直是人工智能和机器学习从业者的主要研究课题,并且在过去几年中,生成图像模型的效率和性能都取得了快速进步。 从生成图像模型中学到的知识使研究人员和开发人员能够在生成视频模型方面取得进展,从而增强实用性和实际应用。 然而,大多数试图提高生成视频模型能力的研究主要集中在时间和空间层的精确排列上,很少关注选择正确的数据对这些生成模型结果的影响。

由于生成图像模型取得的进展,研究人员观察到训练数据分布对生成模型性能的影响确实是显着且无可争议的。 此外,研究人员还观察到,在大型且多样化的数据集上预训练生成图像模型,然后在质量更好的较小数据集上对其进行微调,通常会显着提高性能。 传统上,生成视频模型实现了从成功的生成图像模型中获得的学习,研究人员尚未研究数据的效果,训练策略也有待研究。 稳定视频扩散模型是一种尝试,通过冒险进入以前未知的领域,特别注重选择数据来增强生成视频模型的能力。

最近的生成视频模型依赖于扩散模型以及文本调节或图像调节方法来合成多个一致的视频或图像帧。 扩散模型以其学习如何通过实施迭代细化过程逐渐从正态分布中对样本进行去噪的能力而闻名,并且它们在高分辨率视频和文本到图像合成方面提供了理想的结果。 稳定视频扩散模型的核心使用相同的原理,在其视频数据集上训练潜在视频扩散模型,并使用生成对抗网络或 GAN,甚至在某种程度上使用自回归模型。

稳定视频扩散模型遵循任何生成视频模型都从未实现的独特策略,因为它依赖于具有固定架构的潜在视频扩散基线,以及固定的训练策略,然后评估整理数据的效果。 稳定视频扩散模型旨在在生成视频建模领域做出以下贡献。

- 提出一个系统且有效的数据管理工作流程,试图将大量未经管理的视频样本转换为高质量的数据集,然后供生成视频模型使用。

- 训练最先进的图像到视频、文本到视频模型,使其性能优于现有框架。

- 进行特定领域的实验来探索 3D 理解以及模型运动的强大先验。

现在,稳定视频扩散模型实现了从潜在视频扩散模型中学到的知识,并将数据管理技术作为其基础的核心。

潜视频扩散模型

潜在视频扩散模型或视频-LDM 遵循在潜在空间中训练主要生成模型的方法,以降低计算复杂性,并且大多数视频-LDM 实现预训练的文本到图像模型,并在预训练中添加时间混合层建筑学。 因此,大多数视频潜在扩散模型要么只训练时间层,要么完全跳过训练过程,这与微调整个框架的稳定视频扩散模型不同。 此外,为了将文本合成到视频数据,稳定视频扩散模型直接以文本提示为条件,结果表明所得框架可以轻松地微调为多视图合成或图像到视频模型。

数据管理

数据管理不仅是稳定视频扩散模型的重要组成部分,也是整个生成模型的重要组成部分,因为在大规模数据集上预训练大型模型以提高不同任务的性能(包括语言建模或区分文本到图像生成)至关重要, 以及更多。 通过利用高效的语言图像表示的能力,数据管理已经在生成图像模型上成功实施,尽管此类讨论从未集中于开发生成视频模型。 开发人员在为生成视频模型整理数据时面临一些障碍,为了解决这些挑战,稳定视频扩散模型实施了三阶段训练策略,从而增强了结果并显着提高了性能。

高质量视频合成的数据管理

如上一节所述,稳定视频扩散模型实施了三阶段训练策略,从而增强了结果并显着提高了性能。 第一阶段是 图像预训练 使用 2D 文本到图像扩散模型的阶段。 第二阶段是为了 视频预训练 其中框架对大量视频数据进行训练。 最后,我们进入了第三阶段 视频微调 其中模型是在一小部分高质量和高分辨率视频上进行改进的。

然而,在稳定视频扩散模型实现这三个阶段之前,对数据进行处理和注释至关重要,因为它是第二阶段或视频预训练阶段的基础,并且在确保最佳输出方面发挥着关键作用。 为了确保最大效率,该框架首先以 3 个不同的 FPS 或每秒帧数级别实现级联剪切检测管道,下图演示了对此管道的需求。

接下来,稳定视频扩散模型使用三种不同的合成字幕方法来注释每个视频剪辑。 下表比较了过滤过程前后稳定扩散框架中使用的数据集。

第一阶段:图像预训练

稳定视频扩散模型中实现的三阶段管道的第一阶段是图像预训练,为了实现这一目标,初始稳定视频扩散模型框架基于预训练的图像扩散模型,即 稳定扩散2.1 为其配备更强视觉表现的模型。

第二阶段:视频预训练

第二阶段是视频预训练阶段,它建立在以下发现的基础上:在多模态生成图像模型中使用数据管理通常会产生更好的结果,并提高效率以及强大的判别性图像生成。 然而,由于缺乏类似的强大的现成表示来过滤掉生成视频模型中不需要的样本,稳定视频扩散模型依赖于人类偏好作为输入信号来创建用于预训练框架的适当数据集。 下图展示了在精选数据集上预训练框架的积极效果,有助于提高较小数据集上视频预训练的整体性能。

更具体地说,该框架使用不同的方法来管理潜在视频扩散的子集,并考虑在这些数据集上训练的 LVD 模型的排名。 此外,稳定视频扩散框架还发现,使用精选数据集来训练框架有助于提高框架和扩散模型的性能。 此外,数据管理策略还适用于更大、更相关且高度实用的数据集。 下图展示了在精选数据集上预训练框架的积极效果,有助于提高较小数据集上视频预训练的整体性能。

第三阶段:高质量微调

到第二阶段,稳定视频扩散框架的重点是提高视频预训练之前的性能,而在第三阶段,该框架的重点是在高质量视频微调之后优化或进一步提升框架的性能,以及如何从第二阶段到第三阶段的过渡是在该框架内实现的。 在第三阶段,该框架借鉴了潜像扩散模型的训练技术,并提高了训练示例的分辨率。 为了分析这种方法的有效性,该框架将其与三个仅在初始化方面不同的相同模型进行了比较。 第一个相同模型的权重被初始化,并且视频训练过程被跳过,而其余两个相同模型则使用从其他潜在视频模型借用的权重来初始化。

结果和发现

现在是时候了解一下稳定视频扩散框架在实际任务中的表现,以及它与当前最先进的框架的比较。 稳定视频扩散框架首先使用最佳数据方法来训练基本模型,然后进行微调以生成多个最先进的模型,其中每个模型执行特定的任务。

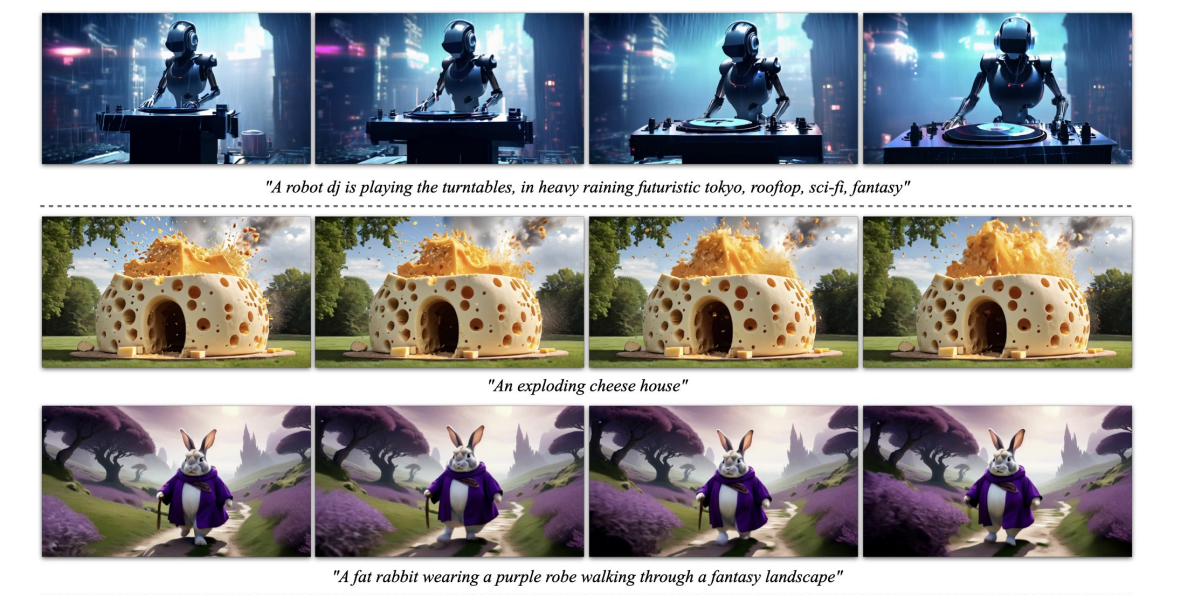

上图表示框架生成的高分辨率图像到视频样本,下图演示了框架生成高质量文本到视频样本的能力。

预训练基地 M奥德尔

如前所述,Stable Video Diffusion 模型建立在 Stable Diffusion 2.1 框架之上,根据最近的研究结果,开发人员在训练图像扩散时采用噪声调度并增加噪声以获得更高分辨率的图像至关重要楷模。 借助这种方法,稳定视频扩散基础模型可以学习强大的运动表示,并在此过程中优于基线模型 发短信到 零镜头设置下的视频生成,结果如下表所示。

帧插值和多视图生成

稳定视频扩散框架在多视图数据集上对图像到视频模型进行微调,以获得对象的多个新视图,该模型被称为 SVD-MV 或稳定视频扩散-多视图模型。 原始 SVD 模型在两个数据集的帮助下进行微调,框架输入单个图像,并返回一系列多视图图像作为其输出。

如下图所示,稳定视频扩散多视图框架提供了与最先进的 Scratch 多视图框架相媲美的高性能,并且结果清楚地证明了 SVD-MV 能够利用所获得的学习成果来自用于多视图图像生成的原始 SVD 框架。 此外,结果还表明,运行模型相对较少的迭代次数有助于提供最佳结果,就像大多数从 SVD 框架微调的模型一样。

在上图中,指标显示在左侧,可以看出,Stable Video Diffusion Multi-View 框架的性能明显优于 Scratch-MV 和 SD2.1 Multi-View 框架。 第二张图展示了训练迭代次数对框架总体性能(在剪辑分数方面)的影响,并且 SVD-MV 框架提供了可持续的结果。

最后的思考

在本文中,我们讨论了稳定视频扩散,这是一种潜在视频扩散模型,能够生成高分辨率、最先进的图像到视频以及文本到视频内容。 稳定视频扩散模型遵循任何生成视频模型都从未实现的独特策略,因为它依赖于具有固定架构的潜在视频扩散基线,以及固定的训练策略,然后评估整理数据的效果。

我们讨论了用于合成 2D 图像的潜在扩散模型如何提高了 生成视频模型 通过添加时间层,并在由高质量视频组成的小数据集上微调模型。 为了收集预训练数据,该框架进行了扩展研究并遵循系统的数据收集实践,最终提出了一种整理大量视频数据的方法,并将噪声视频转换为适合生成视频模型的输入数据。

此外,稳定视频扩散框架采用三个不同的视频模型训练阶段,对这些阶段进行独立分析以评估它们对框架性能的影响。 该框架最终输出一个足够强大的视频表示,可以微调模型以实现最佳视频合成,并且结果与已经使用的最先进的视频生成模型相当。