人工智能

Google 设想一个类似 GPT-3 的查询系统,无需搜索结果

Google 四名研究人员的一篇新论文提出了一个能够权威地回答用户问题而无需呈现可能的搜索结果列表的“专家”系统,这类似于 GPT-3 在过去一年中引起公众关注的问答范式。

该论文 paper,题为 重新思考搜索:让专家从门外汉中脱颖而出,认为当前标准的呈现用户可能的搜索结果列表是“认知负担”,并提出了自然语言处理系统(NLP)提供权威和明确响应的改进。

在提出的“专家”跨领域预言模型中,成千上万的可能搜索结果来源将被融入语言模型中,而不是作为用户自己评估和导航的探索资源。来源:https://arxiv.org/pdf/2105.02274.pdf

该论文由 Google 研究的 Donald Metzler 领导,提出了改进当前从深度学习自回归语言模型(如 GPT-3)中可以获得的多领域预言响应类型。主要改进包括:a)模型能够准确引用响应的来源,b)模型将被防止“幻觉”响应或编造不存在的源材料,这是此类体系结构的当前问题。

多领域训练和能力

此外,提出的语言模型被描述为“所有信息检索任务的单一模型”,将在包括图像和文本在内的各种领域中进行训练。它还需要对知识来源有所了解,这是 GPT-3 风格的体系结构所缺乏的。

“要用单一的统一模型替换索引,就必须让模型本身拥有关于文档标识符宇宙的知识,就像传统索引一样。实现这一点的一种方法是,放弃传统的语言模型,转向联合建模术语-术语、术语-文档和文档-文档关系的语料模型。”

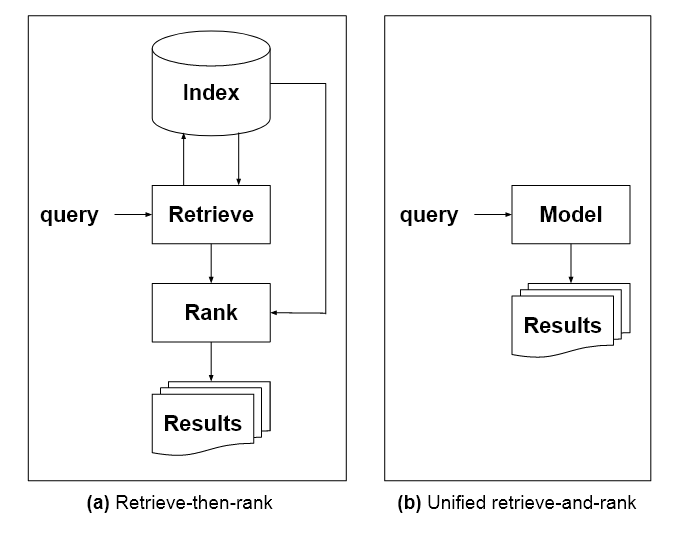

上图来自论文,展示了对用户查询的三种响应方法:左侧,语言模型隐含在 Google 的算法搜索结果中,选择并优先考虑“最佳答案”,但将其留作多个结果中的第一个。中间,GPT-3 风格的对话响应,以权威的方式说话,但不证明其主张或引用来源。右侧,提出的专家系统将排名搜索结果中的“最佳响应”直接纳入教学答案中,带有学术风格的脚注引用(在原始图像中未显示),指示响应的来源。

删除有毒和不准确的结果

研究人员指出,搜索索引的动态和不断更新的性质是完全复制机器学习模型的挑战。例如,如果一个曾经值得信赖的来源直接被训练到模型对世界的理解中,删除其影响(例如,在其被驳斥后)可能比从 SERPs 中删除一个 URL 更困难,因为数据概念在训练期间可以变得抽象和广泛代表。

此外,这种模型需要持续训练,以提供与 Google 持续爬取来源相同的响应水平,以适应新文章和出版物。有效地,这意味着持续和自动推出,与当前制度不同,当前制度中,会对自由形式搜索算法的权重和设置进行轻微的修改,但通常只会不时更新算法本身。

集中式专家预言的攻击面

不断吸收和概括新数据的集中式模型可以改变搜索查询的攻击面。

目前,攻击者可以通过使包含错误信息或恶意代码的域名或页面获得高排名来获得好处。在更不透明的“专家”预言的掩护下,重定向用户到攻击域名的机会大大减少,但注入有毒数据攻击的可能性大大增加。

这是因为提出的系统并没有消除搜索排名算法,而是将其隐藏在用户面前,有效地自动化了首要结果/的优先级,并将其(或它们)融入教学陈述中。恶意用户长期以来一直能够对 Google 搜索算法发起攻击,以 出售假产品,将用户 引导到传播恶意软件的域名,或用于 政治操纵,以及其他许多用例。

不是 AGI

研究人员强调,这样的系统不太可能被视为通用人工智能(AGI),并将普遍的专家响应置于自然语言处理的背景下,受到这些模型目前面临的所有挑战的制约。

该论文概述了五个“高质量”响应的要求:

1:权威性

与当前排名算法一样,“权威性”似乎是从被认为是权威的高质量域名的引用中推导出来的。研究人员观察到:

“响应应通过从高度权威的来源中提取内容来生成。这是建立术语序列和文档元数据之间更明确的联系的另一个原因。如果语料库中的所有文档都用权威性评分进行注释,则在训练模型、生成响应或两者时应考虑该评分。”

虽然研究人员没有建议,如果这种专家预言被证明是高效和流行的,传统的 SERPs 结果将变得不可用,但整个论文将传统的排名系统和搜索结果列表呈现为“几十年前的”和过时的信息检索系统。

“排名是这种范式的关键组成部分,这是检索系统为用户提供潜在答案的选择,这对用户来说是一种相当大的认知负担。返回答案而不是排名结果列表的愿望是开发问答系统的动机之一。”

2:透明度

研究人员评论:

“在可能的情况下,应向用户提供所呈现信息的来源。它是信息的主要来源吗?如果不是,什么是主要来源?”

3:处理偏见

该论文指出,预训练语言模型的设计不是为了评估经验真相,而是为了概括和优先考虑数据中的主导趋势。它承认,这一指令使模型容易受到攻击(如 2016 年 Microsoft 的 无意中种族主义聊天机器人),并且将需要辅助系统来防范此类偏见系统响应。

4:启用多样化的观点

该论文还提出了确保多样化观点的机制:

“生成的响应应代表多种多样的观点,但不应是两极分化的。例如,对于有关有争议的话题的查询,应以公平和平衡的方式涵盖该话题的两方面。这显然与模型偏见密切相关。”

5:可访问的语言

除了提供准确的翻译(以防被认为是权威的响应是以不同语言书写的),该论文建议应将封装的响应“以尽可能简单的术语”书写。